تجربة المطوّرين مع تحليل الفيديو في ChatGPT تصطدم غالبًا بجدار: الروابط المباشرة إلى YouTube تفشل، ورفع ملفات MP4 يُنتج ملخصات "مُتوهَّمة" تغفل الفروق البصرية. هذا ليس خللًا برمجيًا—إنه قيد معماري. لا يقوم ChatGPT ببث الفيديو؛ بل يعالج تسلسلات من الإطارات المستخرجة ونصوص التفريغ الصوتي. لذلك جرّبت رفع ملف MP4 ونجح… نوعًا ما. ذكر الملخص نص الصوت لكنه تجاهل النكتة البصرية في المشهد الثالث التي جعلت الفيديو برمته منطقيًا.

يمكن لـ ChatGPT تحليل الفيديوهات — ولكن ليس عبر مشاهدتها فعليًا

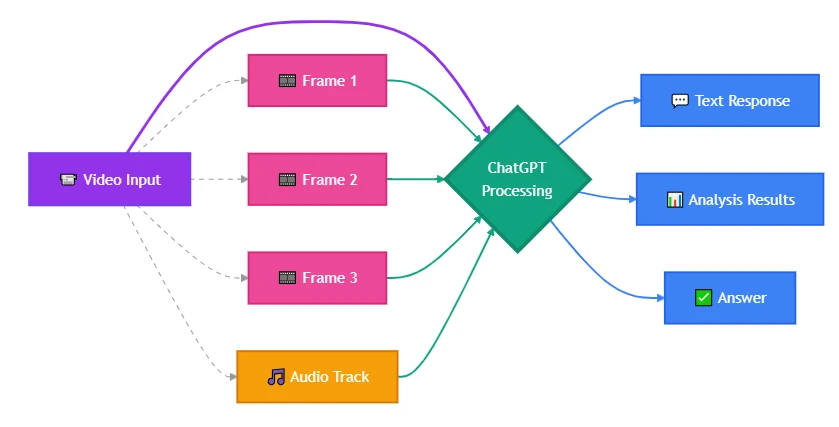

إليك ما يجري فعليًا: ChatGPT لا "يشاهد" الفيديوهات كما تفعل أنت. لا يضغط تشغيلًا، ولا يبث المحتوى، ولا يلاحظ الحركة عبر الزمن. ما يفعله هو تفكيك الفيديو إلى مكوّنات يعرف كيف يتعامل معها—صور ثابتة ونصوص تفريغ—ثم يستدل على تلك الأجزاء على نحو مستقل. يرى النموذج الفيديو كألبوم صور مع تعليق صوتي، لا كخبرة مستمرة. لهذا التقط الشرح المنطوق لكنه فاتته الخاتمة الكوميدية البصرية: على الأرجح أنّ الإطار الذي تضمّن النكتة لم يكن ضمن مجموعة الإطارات المُختارة.

عندما يسأل أحدهم "هل يمكن لـ ChatGPT مشاهدة الفيديوهات؟" فهو غالبًا يقصد أحد سؤالين: هل يمكنه بثّ المحتوى البصري مثل مراقب بشري، أم يمكنه استخراج المعنى وتحليله من بيانات الفيديو—المشاهد، الحوارات، الطوابع الزمنية، الأفعال الظاهرة على الشاشة؟ الإجابة العملية نعم على السؤال الثاني، مع قيود تُفشل بعض حالات الاستخدام كليًا. النماذج الحديثة من ChatGPT تعالج الفيديو بمعاملته كإطارات مُقتطعة مدمجة مع تفريغ صوتي، إما عبر الاستخراج التلقائي في واجهة الويب أو عبر قبول إطارات يقدّمها المستخدم عبر الـ API. هذا يعمل للتلخيص، ووصف المشاهد، واستخراج النص. لكنه يفشل في تتبّع الحركة، والتحليل المعتمد على التوقيت، أو أي شيء يتطلب من النموذج أن "يرى" ما يحدث بين الإطارات.

معظم الأدلة تتوقف عند تأكيد وجود القدرة دون شرح لماذا لم تنجح تطبيقك تحديدًا—أو أي طريقة إدخال بديلة ينبغي استخدامها.

ChatGPT قدرات الفيديو: ما الذي يراه النموذج فعليًا

لا يقوم ChatGPT بتحميل ملف MP4 والتمرير عبره إطارًا بإطار. لديه "قدرة رؤية"—أي القدرة على تحليل الصور الثابتة—و"نسخ صوتي" عبر تكامل Whisper. عندما ترسل فيديو عبر واجهة الويب أو تطبيقات الجوال لـ ChatGPT، يقوم النظام باستخراج الإطارات الأساسية، وبتفريغ الصوت بشكل منفصل، ثم يزوّد النموذج بكليهما كمدخلات مميزة. بعد ذلك يصف النموذج ما "رآه" في تلك الإطارات وما "سمعه" في التفريغ.

من وجهة نظرك، يبدو الأمر كاستيعاب للفيديو. من وجهة نظر النموذج، هو تحليل صور + معالجة نص. هذا الاختلاف المعماري يحدد أي حالات الاستخدام تعمل وأيها لا تعمل.

إذا كان الفيديو يعتمد على الحركة، أو تغييرات دقيقة بين الإطارات، أو توقيت دقيق—مثل اكتشاف الوقت الذي يدخل فيه كائن ما إلى الإطار بالضبط، أو تتبّع كيفية تحريك عنصر واجهة مستخدم—فإن نهج الإطارات الأساسية سيفوّت ذلك. لن يلتقط ChatGPT إشارة بصرية مدتها ثانيتان تقع بين الإطارات المُختارة. كما لن يتتبّع الكائنات عبر الزمن ما لم تقم ببناء الإدخال صراحةً لإظهار التسلسل.

قدرات ChatGPT الحالية في الفيديو (حتى أوائل 2026):

- تحليل فيديو قائم على الصور: يقبل ملفات الفيديو أو الإطارات المستخرجة؛ يفسّر المحتوى البصري من الصور المُقتطعة

- نسخ الصوت: يحوّل الكلمات المنطوقة إلى نص عبر Whisper؛ يمكن للنموذج بعدها تلخيص التفريغ أو الإجابة عنه

- وصف المشاهد: يحدد الكائنات والأفعال والبيئات والنص الظاهر في الإطارات المقدمة

- الاستعلامات المعتمدة على الطوابع الزمنية: يمكنه الرجوع إلى لحظات محددة إذا زوّدتَه بطوابع زمنية للإطارات أو قمت بتقسيم الفيديو يدويًا

- استخراج النص: يقرأ الترجمات على الشاشة، وتسميات الواجهات، أو المستندات الظاهرة في الإطارات

سلوك معدل أخذ عينات الإطارات والاختيار التلقائي للإطارات المفتاحية في واجهة الويب لـ ChatGPT—غير موثق علنًا حتى تاريخ المعرفة

ما لا يتضمنه:

- إدخال فيديو متدفق في الوقت الحقيقي عبر الـ API

- تتبع حركة بدقة الإطار أو استمرارية الكائن عبر الزمن

- دعم أصلي لبرامج ترميز الفيديو—كل المعالجة تتم على الإطارات المستخرجة والصوت

- كشف تلقائي لتغيرات المشهد دون تنبيه صريح من المستخدم

سعة الفيديو مقيدة بحدود الرموز وحجم الملف، لا بالمدة. بينما تُعد 5–10 دقائق قاعدة عملية، فإن الحدود الفعلية تتدرج ديناميكيًا مع كثافة المحتوى البصري.

إذا كانت حالتك تتطلب تلك القدرات، فإما أن تقوم بالمعالجة المسبقة بنفسك لاستخراج الإطارات المناسبة، أو تنتقل إلى نموذج يملك دعمًا للفيديو أصلاً. القسم التالي يوضح طريقة الإدخال المناسبة لسيناريوك المحدد.

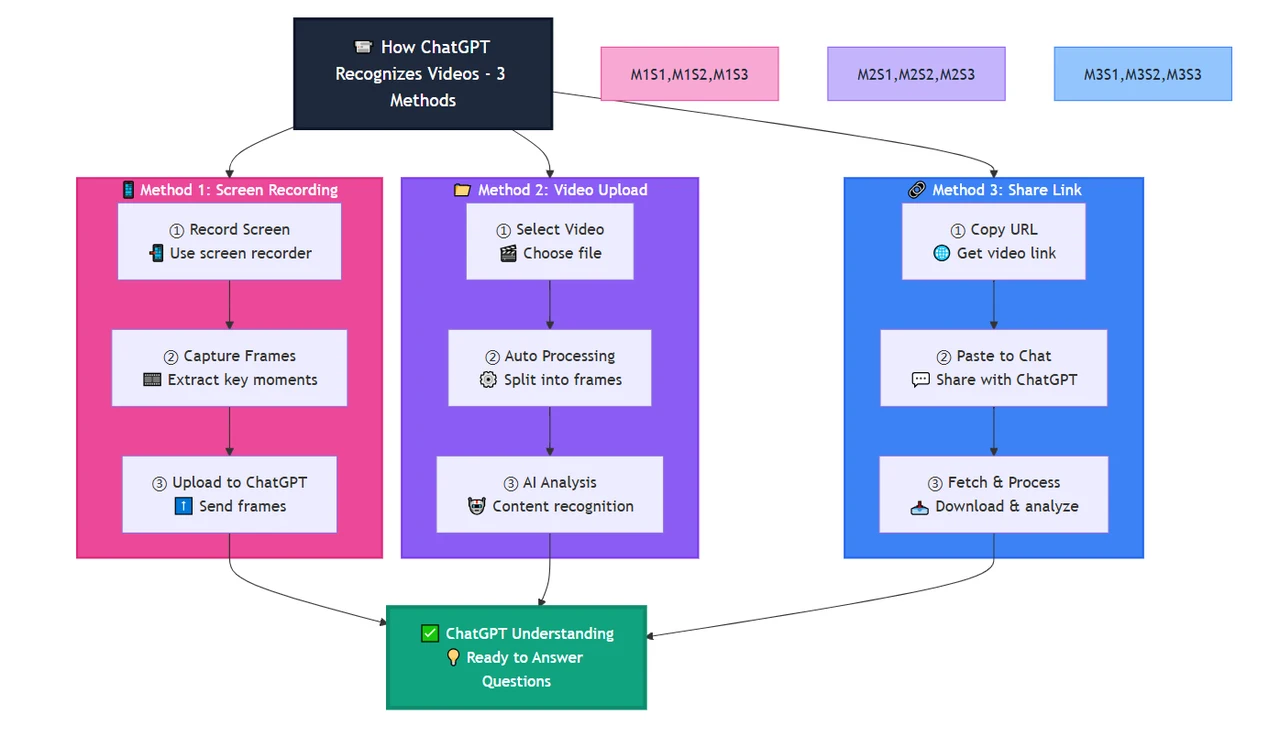

كيف يتعرّف ChatGPT على الفيديوهات: ثلاث طرق عملية

لا توجد طريقة واحدة لإرسال الفيديو إلى ChatGPT. الطريقة التي تختارها تتحكم بما يمكن للنموذج تحليله وبما سيفوّته. معظم الإخفاقات تأتي من اختيار الطريقة الأسهل لا الأنسب.

الطريقة 1: استخراج الإطارات يدويًا + رفع الصور

استخرج الإطارات بنفسك باستخدام ffmpeg أو أدوات مشابهة، ثم ارفع تلك الإطارات المحددة كصور. هذا يمنحك تحكمًا كاملًا بما يحلّله ChatGPT.

مثال سير عمل (bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

يتيح لك هذا النهج:

- تركيز التحليل على لحظات محددة (المقدمة، الفعل الرئيسي، الخاتمة) دون إضاعة السياق في مقاطع غير مهمة

- التقاط الحركة عبر رفع إطارات متتالية بمعدل أخذ عينات تختاره

- تجاوز حدود حجم الملف—الصور أصغر من ملفات الفيديو الكاملة

- الحفاظ على جودة الإطارات التي قد تتدهور أثناء الضغط التلقائي

المقابل:

ستتعامل أنت مع المعالجة المسبقة. لتحليل مئات الفيديوهات على نطاق واسع، يتطلب هذا أتمتة. لتحليل عميق لمرة واحدة أو تصحيح مشاهد بعينها، فهو النهج الأكثر موثوقية.

متى تستخدم هذه الطريقة:

- تحتاج تحليلًا دقيقًا للإطارات للحظات معينة

- المعلومات البصرية الحاسمة قصيرة أو تقع بين فواصل الإطارات المعتادة

- تقارن تغييرات بصرية عبر تسلسل (تغييرات حالة واجهة المستخدم، إطارات الرسوم)

- تريد التحقق مما "شاهده" النموذج فعليًا عبر فحص الإطارات التي رفعتها أنت

الطريقة 2: رفع الملف مباشرة عبر واجهة ChatGPT

تقبل واجهة الويب وتطبيقات الجوال لـ ChatGPT رفع الفيديو مباشرة في المحادثة. اسحب ملف MP4 أو MOV إلى حقل الإدخال، وسيتكفل النظام باستخراج الإطارات وتفريغ الصوت تلقائيًا.

ما يحدث داخليًا:

- يقوم الخدمة بأخذ عينات من الإطارات على فواصل زمنية (المعدل غير موثق؛ يُقدّر بـ 1–2 إطار في الثانية بناءً على ملاحظة السلوك)

- يُنسخ الصوت عبر Whisper أو خدمة مشابهة

- تُمرَّر المخرجات كلها إلى النموذج كمدخلات سياقية منفصلة

- يُنتج النموذج الردود بناءً على الإطارات المرئية والتفريغ النصي المسموع

تعمل هذه الطريقة من أجل:

- ملخصات عالية المستوى للفيديو حيث لا تحتاج لدقة إطار

- تحديد الكائنات الرئيسية، الأشخاص، أو البيئات التي تستمر عبر المشاهد

- استخراج المحتوى المنطوق أو النص الظاهر على الشاشة الذي يتكرر عبر عدة إطارات

- تحليل استكشافي سريع دون معالجة مسبقة

تفشل هذه الطريقة في:

- التحليل بدقة الإطار—لا تتحكم في الإطارات المأخوذة

- المحتوى الطويل الذي يتجاوز سعة السياق المريحة للنموذج، يتطلب تقسيمًا منطقيًا. دون تقسيم استراتيجي أو معالجة مسبقة، قد يحدث تدهور أو قطع للمخرجات مع تسارع استهلاك الرموز في البيانات البصرية عالية الكثافة

- رصد الحركة، أو الانتقالات، أو المحتوى المعتمد على التوقيت الذي يحتاج مقارنة إطارات متعاقبة

- السيناريوهات حيث تظهر المعلومات البصرية الحرجة لفترة وجيزة بين الإطارات المُختارة

إذا احتجت إلى تحكم في اللحظات المُحلَّلة، فاستخدم الطريقة 1.

الطريقة 3: رابط YouTube + جلب التفريغ

تزعم بعض إضافات ChatGPT وأدوات الأطراف الثالثة أنها "تحلل فيديوهات YouTube". ما تفعله فعليًا هو جلب بيانات الفيديو العامة وتفريغه (إن وُجد)، ثم تمرير ذلك النص إلى ChatGPT.

ينجح هذا عندما:

- يملك الفيديو ترجمات تلقائية أو مرفوعة من المستخدم

- يحتاج تحليلك محتوى منطوقًا فقط لا معلومات بصرية

- الفيديو متاح للعامة (ليس خاصًا، غير مدرج، أو مقيدًا إقليميًا)

- تلخيص محاضرات، بودكاست، أو مقابلات حيث يحمل الصوت معظم المعنى

لا ينجح هذا عندما:

- تحتاج تحليلًا بصريًا (عروض على الشاشة، مخططات، تعابير وجه)

- يفتقر الفيديو إلى تفريغ أو ترجمة

- تظهر المعلومات الحاسمة بصريًا دون أن تُذكر في الحوار

- تعمل مع ملفات خاصة أو محتوى خلف بوابة مصادقة

خطأ شائع: يتوقع المطوّرون استيعابًا كاملاً للفيديو (بصري + صوت) لكنهم يتلقون ملخصًا للتفريغ فقط. هذا مناسب لتحليل محتوى منطوق. لكنه عديم الجدوى لمراجعة عروض المنتجات، تحليل التصميم البصري، أو أي سيناريو حيث ما تراه أهم مما يُقال.

النمط: الطريقة 2 لملخصات سريعة حيث لا تهم الدقة. الطريقة 1 لتحليل مضبوط عندما تحتاج إطارات محددة. الطريقة 3 للمحتوى المعتمد على الصوت حيث تكون المعلومة البصرية ثانوية أو غير موجودة. اختر بناءً على مكان وجود الإشارة الحاسمة لحالة الاستخدام—في الحركة، في إطارات محددة، أم في الحوار فقط.

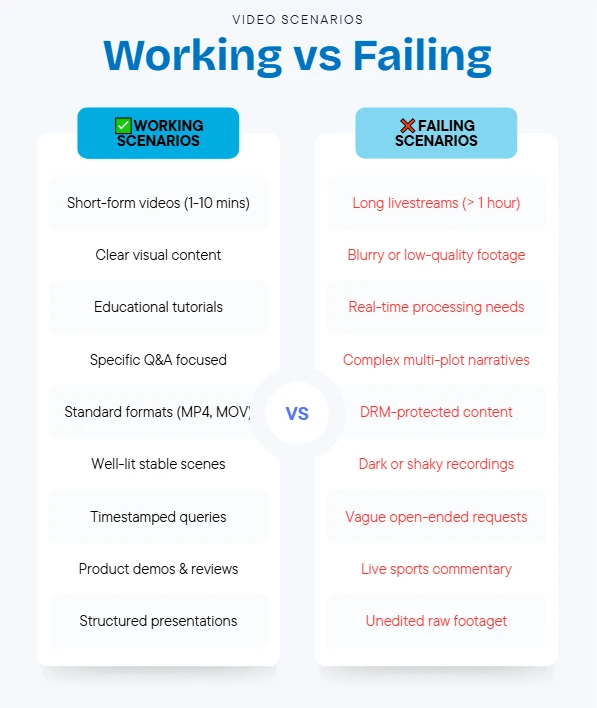

سيناريوهات تطبيق فيديو ChatGPT: ما الذي يعمل فعليًا في الإنتاج

معرفة أن ChatGPT يمكنه معالجة مكونات الفيديو لا تخبرك ما إذا كان الأداة المناسبة لمشكلتك. السيناريوهات التالية تُظهر أين ينجح تحليل الإطارات—وأين تُفشل القيود المعمارية حالة الاستخدام.

السيناريو 1: تلخيص محتوى تعليمي

حالة الاستخدام: لديك فيديو تعليمي مدته 10 دقائق وتحتاج ملخصًا هيكليًا للخطوات الرئيسية، والأدوات المذكورة، والأمثلة البصرية المعروضة.

لماذا يعمل: عادةً ما تحتوي الفيديوهات التعليمية على حدود مشهد واضحة، ونص ظاهر على الشاشة مستمر، ورواية تتماشى مع المرئيات. يصف المتحدث ما يعرضه بينما يكون ظاهرًا. يمكن لـ ChatGPT نسخ الشرح، وتحديد الأدوات أو المخططات في الإطارات المُقتطعة، ودمج كليهما في مخرجات مُهيكلة.

نهج التنفيذ: ارفع الفيديو عبر واجهة ChatGPT أو استخرج 8–12 إطارًا مفتاحيًا عند انتقالات الموضوعات الكبرى. صيغة الطلب: "اسرد الخطوات الرئيسية الموضحة في هذا الفيديو، بالرجوع إلى كل من السرد المنطوق وأي نص على الشاشة، مخططات، أو أسماء أدوات تراها."

أين تفشل: الفيديوهات التي تعتمد على حركة مستمرة—مثل screencast برمجي حيث يكتب المدرب بسرعة عبر عدة ملفات—ستفقد خطوات بين الإطارات. ستحتاج معدل أخذ عينات أعلى أو تركيزًا على التفريغ الصوتي وحده.

نصيحة عملية: لمحتوى المحاضرات أو الدروس، اجمع بين الرفع التلقائي (من أجل التفريغ) وإطارات مستخرجة يدويًا لأهم 3–5 لحظات بصرية. هذا يمنحك تغطية شاملة للصوت وصورًا عالية الجودة للمفاهيم الأساسية.

السيناريو 2: تحليل عرض منتج

حالة الاستخدام: تراجع عرضًا تنافسيًا لمنتج وتريد استخراج عناصر الواجهة، أسماء الميزات، تدفقات المستخدم، وتفاصيل التسعير الظاهرة على الشاشة.

لماذا يعمل: عادةً ما تعرض عروض المنتجات كل شاشة لمدة كافية لالتقاط الإطار الثابت عبر أخذ العينات. تبقى النصوص التوضيحية، تسميات الأزرار، بنى القوائم، وجداول التسعير ظاهرة عبر عدة إطارات. يمكن لقدرات الرؤية في ChatGPT قراءة هذه العناصر ووصفها حتى لو لم تُذكر في السرد.

نهج التنفيذ: استخرج إطارات عند تغيّر المشاهد الرئيسية (شريحة المقدمة، ميزة 1، ميزة 2، شاشة التسعير، CTA). ارفع تلك الإطارات واطلب: "لكل إطار، حدد كل عناصر الواجهة الظاهرة، تسميات الأزرار، أسماء الميزات، وأي معلومات تسعير أو منتج معروضة."

أين تفشل: العروض ذات انتقالات سريعة، حالات التحويم التي تكشف معلومات وجيزة، أو العناصر التفاعلية المعروضة لمدة 1–2 ثانية لن تُلتقط عبر أخذ عينات الإطارات. إذا عرض المنافس جدول مقارنة بسرعة، ستفوّته ما لم يُلتقط ذلك اللحظة بعينها.

نصيحة عملية: مرّر الفيديو يدويًا أولًا لتحديد طوابع زمنية للحظات الإفصاح المهمة. استخرج الإطارات عند تلك اللحظات بدل الاعتماد على فواصل أخذ عينات ثابتة.

السيناريو 3: تفريغ اجتماع أو مقابلة مع سياق بصري

حالة الاستخدام: سجّلت مكالمة مع عميل وتحتاج تفريغًا وتعليقات تشير إلى متى ظهرت مستندات محددة، شرائح، أو مشاركة شاشة.

لماذا يعمل: يتعامل نسخ الصوت مع الحوار المنطوق. عندما يشارك المشاركون شاشاتهم أو يرفعون مستندات، تظهر تلك في الإطارات المُقتطعة. يمكن لـ ChatGPT أن يعلّق "حوالي [timestamp]، ظهر مستند عقد على الشاشة" إلى جانب التفريغ—مفيد لمحاضر الاجتماعات التي تُشير إلى مواد بصرية.

نهج التنفيذ: ارفع الفيديو واطلب: "انسخ هذا الاجتماع وسجّل أي لحظات ظهرت فيها مستندات، شرائح عرض، مشاركات شاشة، أو مراجع بصرية أخرى. لكل عنصر بصري، صف ما ظهر."

أين تفشل: المشاركات الوجيزة (أقل من 5–10 ثوان) قد تقع بين الإطارات المأخوذة. النص الصغير جدًا في إطارات مضغوطة لن يكون قابلًا للاستخراج. لاستخدامات قانونية أو تنظيمية تتطلب دقة حرفية لما عُرض، تحقّق من جودة الإطارات وتغطية أخذ العينات قبل الاعتماد على المخرجات.

نصيحة عملية: للاجتماعات المهمة، سجّل بدقة أعلى واستخرج إطارات يدويًا عند لحظات مثل "دعوني أريكم هذا المستند"—ما يشير إلى مرجع بصري وشيك.

السيناريو 4: الإشراف على المحتوى أو مراجعة الامتثال

حالة الاستخدام: تحتاج إلى مسح فيديوهات يرفعها المستخدمون بحثًا عن محتوى محظور—شعارات محددة، أنماط نص، أو عناصر بصرية تنتهك سياسات المنصة.

لماذا يعمل: يستطيع ChatGPT مسح الإطارات بحثًا عن نص ظاهر، كائنات معروفة، أو مشاهد موصوفة. إذا أردت التحقق "هل يظهر شعار منافس؟"، يكتشف التحليل القائم على الإطار الشعارات التي تبقى على الشاشة لأكثر من ثانية أو ثانيتين.

نهج التنفيذ: استخرج إطارات على فواصل منتظمة (كل 3–5 ثوان)، ارفعها، واطلب: "راجع هذه الإطارات وحدد أي إطار يحتوي على [شعار محدد، اسم علامة تجارية، رمز محظور، إلخ.]. لكل تطابق، صف مكان ظهوره في الإطار."

أين تفشل: المخالفات المعتمدة على الصوت (موسيقى محمية، خطاب محظور) تتطلب تحليلًا سمعيًا منفصلًا. المخالفات المعتمدة على الحركة (إيماءات محظورة، أفعال تمتد عبر إطارات) لن تُلتقط عبر صور ثابتة. المحتوى المحظور الذي يُعرض سريعًا قد لا يظهر في الإطارات المُختارة.

نصيحة عملية: اجمع مسح ChatGPT البصري مع خدمات بصمة صوتية مخصصة ومعدلات أخذ عينات إطارات أعلى للفئات عالية المخاطر. استخدم ChatGPT كطبقة تصفية أولى، لا كطبقة إشراف وحيدة.

النمط في السيناريوهات الناجحة: يوجد محتوى ذو معنى في إطارات منفصلة وثابتة ويرتبط بالصوت أو عناصر نصية. الإخفاقات تحدث عندما تعيش المعلومات الحرجة في الحركة، التوقيت، الانتقالات، أو تظهر لفترة وجيزة جدًا بحيث لا تُؤخذ عيناتها موثوقًا.

قدرات Gemini للفيديو مقابل قدرات Claude مقابل ChatGPT

إذا لم تناسبك بنية أخذ عينات الإطارات في ChatGPT، فستقيّم البدائل. تقدّم Gemini وClaude قدرات مختلفة متعلقة بالفيديو—وتلك الفروق تحدد النموذج المناسب لتطبيقك.

معالجة الفيديو الأصلية لدى Gemini

تدعم نماذج Gemini إدخال الفيديو أصلاً على مستوى الـ API. تمُرِّر ملف فيديو مباشرة دون معالجة مسبقة إلى إطارات. يعالج النموذج الفيديو كتيار مستمر، ما يتيح تتبّع الحركة، كشف تغيّر المشهد، والاستدلال الزمني الذي لا يقدر عليه نهج ChatGPT القائم على الإطارات.

حالة يفوز فيها Gemini:

تحتاج لاكتشاف متى يدخل كائن محدد الإطار ويخرج عبر مقطع 30 ثانية، أو تتبّع حركة شخص عبر مشهد. يمكن لـ Gemini متابعة الكائنات عبر الإطارات والاستدلال على الحركة. سيشاهد ChatGPT الكائن فقط في الإطارات التي صادف أخذ عينتها—وقد يفوّت الدخول أو الخروج تمامًا.

المقايضات:

- واجهة Gemini الأصلية أكثر فعالية من حيث التكلفة مقارنة بأسلوب أخذ العينات في OpenAI. عبر تجنب الزيادة الخطية في الرموز بواسطة التخزين المؤقت للسياق، يتدرج Gemini أفضل في التحليل طويل الأمد.

- معالجة الفيديوهات الأطول تؤدي إلى زمن استجابة أعلى—إذ يجب على النموذج ابتلاع الملف كاملًا قبل الرد

- ليست كل إصدارات Gemini تدعم إدخال الفيديو؛ يتطلب إصدارات أحدث من Gemini

- توجد حدود لطول الفيديو لكنها أكثر سخاءً من قيود ChatGPT المعتمدة على السياق

متى تختار Gemini بدل ChatGPT:

- تتطلب حالتك تتبّع الحركة، كشف حدود المشاهد، أو فهم العلاقات الزمنية

- تظهر المعلومات الحرجة وتختفي سريعًا عبر الإطارات

- تحلل فيديوهات تهم فيها تسلسلات الأحداث (لقطات رياضية، مراجعة مراقبة، تحليل رسوم متحركة)

- تريد تجنب استخراج الإطارات يدويًا كمعالجة مسبقة

قيود Claude الحالية في الفيديو

حتى أوائل 2026، نماذج Claude لا تدعم إدخال الفيديو مباشرة عبر الـ API. يمكنك رفع صور (بما في ذلك إطارات مستخرجة من فيديو)، لكن لا توجد قدرة معالجة فيديو أصلية مكافئة لـ Gemini.

ما يستطيع Claude فعله:

- تحليل تسلسلات من الإطارات المرفوعة، شبيهًا بالطريقة اليدوية في ChatGPT (الطريقة 2)

- تقديم أوصاف مفصلة للمحتوى البصري في كل إطار

- الاستدلال على حركة ضمنية أو تغيرات بين الإطارات إذا طُلِب صراحةً إطارًا بإطار

- التعامل مع تسلسلات أطول من الصور بفضل نافذة سياق ممتدة (حتى 1M من الرموز في Claude Opus 4.7)

ما لا يستطيع Claude فعله:

- قبول ملفات فيديو مباشرة عبر أي واجهة

- تتبّع الحركة أو الكائنات تلقائيًا عبر الإطارات دون مطالبة صريحة إطارًا بإطار

- نسخ الصوت—يتطلب معالجة منفصلة عبر Whisper أو خدمة مشابهة ثم تمرير التفريغ إلى Claude

متى تختار Claude رغم ذلك:

- سير عملك يتضمن بالفعل استخراج الإطارات كخطوة مسبقة

- تحلل فيديوهات طويلة تتطلب العديد من الإطارات وتحتاج نافذة السياق الأكبر لدى Claude

- تقارن جودة التحليل البصري وتجد أوصاف Claude للإطارات أدق لمجالك (مثل التصوير الطبي، المخططات التقنية)

- تحتاج دمج تحليل إطارات فيديو مع كم كبير من معلومات سياقية أخرى

جدول مقارنة القدرات

| الميزة | ChatGPT | Gemini | Claude |

|---|---|---|---|

| رفع ملف فيديو مباشرة | ✓ (واجهة الويب/التطبيق) | ✓ (API + واجهة ويب) | ✗ |

| تتبع الحركة بشكل أصلي | ✗ | ✓ | ✗ |

| نسخ الصوت | ✓ (تكامل Whisper) | ✓ (مُدمج) | ✗ (يتطلب أداة خارجية) |

| تحليل قائم على الإطارات | ✓ | ✓ (وأيضًا معالجة مستمرة) | ✓ (استخراج يدوي فقط) |

| كشف تغيّر المشهد | ✗ (يدوي فقط) | ✓ (تلقائي) | ✗ |

| التعامل مع طول الفيديو النموذجي | ~5–10 دقائق (مقيد بالسياق) | ~1 ساعة (حسب الدقة) | غير متاح (عدد الإطارات مقيد بالسياق) |

| أفضل حالة استخدام | ملخصات سريعة، تحليل على مستوى الإطار مع بعض التحكم | تتبع الحركة، استدلال زمني، فيديو مستمر | وصف إطارًا بإطار بعمق مع احتياجات سياق كبيرة |

| دعم الفيديو عبر API | ✗ (صور فقط) | ✓ | ✗ |

إطار اتخاذ القرار:

- اختر ChatGPT عندما: تحتاج ملخصات فيديو سريعة، تبقى المعلومات الحرجة عبر عدة إطارات، تعمل مع مقاطع قصيرة (أقل من 10 دقائق)، ولا تحتاج تتبع حركة. الأفضل للمحتوى التعليمي، عروض منتجات ثابتة، تفريغ اجتماعات.

- اختر Gemini عندما: تتطلب حالتك تتبع حركة، كشف تغيّر المشاهد، أو استدلالًا زمنيًا عن كيفية تحرك أو تغيّر العناصر عبر الزمن. حاسم للرقابة، الرياضة، مراجعة الرسوم المتحركة، أو أي سيناريو يهم فيه "ما يحدث بين الإطارات".

- اختر Claude عندما: تستخرج الإطارات كجزء من خطك، تحتاج تحليل الكثير من الإطارات مع سياق إضافي واسع، أو تجد أوصاف Claude البصرية أدق لمجالك. يتطلب أكبر قدر من المعالجة المسبقة لكنه يقدم أكبر نافذة سياق.

للمطورين الذين يعملون عبر عدة نماذج، توفّر CometAPI واجهة موحّدة لاختبار جودة معالجة الفيديو عبر GPT وGemini وClaude دون إعادة كتابة كود التكامل—مفيد عند مقارنة جودة المخرجات قبل الالتزام بمزوّد محدد.

الإجابة الحقيقية على "هل يستطيع ChatGPT مشاهدة الفيديوهات" ليست ثنائية. إنها "نعم، عبر تحويل الفيديو إلى صيغ يتعامل معها أصلاً—مع قيود تُفشل حالات استخدام محددة." معظم الإخفاقات تأتي من عدم التوافق المعماري، لا فجوات القدرة. يعمل النموذج تمامًا كما صُمّم؛ توقّع المطوّرون تصميمًا مختلفًا فحسب.

إذا كنت تبني ميزات تحليل فيديو على نطاق واسع، اختبر سير عملك على الحالات الحدّية أولًا: ارفع الفيديو نفسه عبر ملف مباشر، وإطارات مستخرجة يدويًا، وطريقة التفريغ فقط. قارن المخرجات. الطريقة التي تلتقط الإشارة الحاسمة لحالتك—لا الأسرع تنفيذًا—هي التي تصمد في الإنتاج.

قبل الالتزام باستخدام ChatGPT للفيديو:

- حدّد ما إذا كانت معلوماتك الحرجة تعيش في إطارات ثابتة، حركة، أم صوت

- اختبر تغطية أخذ عينات الإطارات عبر استخراجها يدويًا بمعدلاتك المتوقعة

- تحقّق من قابلية قراءة النص الظاهر على الشاشة بدقة الفيديو بعد الضغط

- تأكّد أن طول الفيديو ينسجم مع حدود السياق العملية لشريحتك

- امتلك مسارًا احتياطيًا للمحتوى الذي يظهر وجيزًا أو بين الإطارات المُختارة

للمطورين الذين يقيّمون عدة مزوّدي ذكاء اصطناعي لمهام الفيديو، يقدّم CometAPI ساحة لعب موحّدة لاختبار ChatGPT وGemini وClaude بالمدخلات نفسها—ما يتيح مقارنة جودة المخرجات، زمن الاستجابة، والتكلفة قبل بناء تكاملات خاصة بكل مزوّد.

الأسئلة الشائعة - دليل تحليل الفيديو بالذكاء الاصطناعي

إجابات سريعة على الأسئلة الشائعة حول تحليل الفيديو بالذكاء الاصطناعي.

هل يمكن لـ ChatGPT تحليل الفيديوهات؟

نعم، يمكن لـ ChatGPT (GPT-4o وما بعده) تحليل الفيديوهات عبر أخذ عينات من الإطارات (~إطار واحد في الثانية) ونسخ الصوت. يعمل جيدًا لملخصات الاجتماعات، استخراج النص من الشرائح، وتحديد الكائنات. لكنه يواجه صعوبة في تتبّع الحركة، الفيديوهات التي تتجاوز 10 دقائق، والبث في الوقت الحقيقي.

كيف أرفع فيديوهات إلى ChatGPT؟

الرفع عبر عنوان URL مباشر (موصى به): ارفع عبر رابط عام لتحليل سريع. الأفضل لمقاطع أقل من 10 دقائق.

استخراج الإطارات يدويًا: استخرج إطارات محددة لتحكم أدق. الأفضل عندما تحتاج تحليل لحظات بعينها أو لتقليل تكلفة الرموز.

ما أقصى طول فيديو يمكن لـ ChatGPT التعامل معه؟

يتعامل ChatGPT بشكل موثوق مع فيديوهات حتى 5–10 دقائق. بعد ذلك، ستحتاج تقسيم الفيديو أو الانتقال إلى Gemini 2.5 Pro، الذي يدعم فيديوهات حتى 60 دقيقة أصلاً.

ما هي قيود تحليل الفيديو لدى ChatGPT؟

- لا يمكنه تتبّع الحركة المستمرة (رياضة، رقص)

- طوابع زمنية غير دقيقة (±1 ثانية)

- يفوّت محتوى يظهر لأقل من ثانية

- حد عملي 10 دقائق

- لا دعم للبث في الوقت الحقيقي

- يواجه صعوبات مع الفيديوهات منخفضة الجودة أو المظلمة

- ضعف في الاستدلال السببي الزمني *

هل أستخدم ChatGPT أم Gemini لتحليل الفيديو؟

استخدم ChatGPT لـ:

- فيديوهات أقل من 10 دقائق

- استدلال نصي متفوق بعد التحليل

- تحليل على مستوى الإطار (شرائح، لقطات شاشة)

استخدم Gemini لـ:

- فيديوهات بطول 10–60 دقيقة

- تتبّع الحركة وتحليل الحركة

- مهام الاستدلال الزمني

- لقطات رياضية، رقص، أو مراقبة *

هل يمكن لـ Claude تحليل الفيديوهات؟

لا، لا يدعم Claude إدخال الفيديو مباشرة. لكن يمكنك استخراج إطارات من الفيديو وتحليلها عبر Claude، الذي يقدم استدلالًا نصيًا وسعة سياق أكبر لتحليلات طويلة.

كم تكلفة تحليل الفيديو؟

تختلف التكاليف حسب النموذج وطول الفيديو:

- ChatGPT 4o: ~$0.05 للدقيقة

- Gemini 2.5 Pro: ~$0.04 للدقيقة

يقدّم CometAPI رصيدًا للمستخدمين الجدد للبدء.