Fitur utama

- Rendering teks native/berkualitas tinggi di dalam gambar — unggul dalam menghasilkan teks yang terbaca jelas dan akurat secara semantik dalam gambar yang dihasilkan (poster, kemasan, tangkapan layar) — area yang sulit ditangani oleh banyak model gambar sebelumnya.

- Output multimodal dengan fidelitas tinggi — menghasilkan gambar fotorealistis dan bergaya dengan detail yang baik serta tata letak yang peka terhadap bahasa.

- Transfer gaya & peningkatan detail — dapat menerapkan gaya artistik yang konsisten atau meningkatkan detail lokal sambil mempertahankan koherensi adegan.

Detail teknis — cara kerja Qwen-Image

Arsitektur dan komponen (kata kunci: MMDiT, Qwen2.5-VL). Model ini menggunakan diffusion transformer berbasis MMDiT untuk sintesis gambar yang dikombinasikan dengan encoder visual-language (Qwen2.5-VL) untuk menafsirkan prompt dan konteks visual. Pemisahan ini memungkinkan model memperlakukan panduan semantik dan tampilan piksel secara berbeda, sehingga meningkatkan fidelitas teks dan konsistensi pengeditan. Repositori resmi dan laporan teknis mencatat backbone 20B-parameter untuk model T2I utama.

Pipeline pelatihan (kata kunci: curriculum learning, data pipeline). Untuk mengatasi rendering teks yang sulit, Qwen-Image menggunakan kurikulum progresif: dimulai dari gambar non-teks yang lebih sederhana dan secara bertahap dilatih pada contoh kaya teks yang lebih kompleks hingga input setingkat paragraf. Tim membangun pipeline komprehensif yang mencakup pengumpulan skala besar, penyaringan yang cermat, augmentasi sintetis, dan penyeimbangan untuk memastikan model melihat banyak komposisi teks/foto yang realistis selama pelatihan. Kurikulum strategis ini merupakan alasan utama model unggul dalam rendering teks multibahasa.

Mekanisme pengeditan (kata kunci: dual-encoding, VAE + VL encoder). Untuk pengeditan, sistem memasukkan gambar asli dua kali: sekali ke encoder Qwen2.5-VL untuk kontrol semantik dan sekali ke encoder VAE untuk informasi tampilan rekonstruktif. Desain dual-encoding memungkinkan modul edit mempertahankan identitas dan fidelitas visual sambil memungkinkan modifikasi semantik — misalnya, mengganti objek atau mengubah konten tekstual tanpa menurunkan kualitas area yang tidak terkait.

Performa benchmark

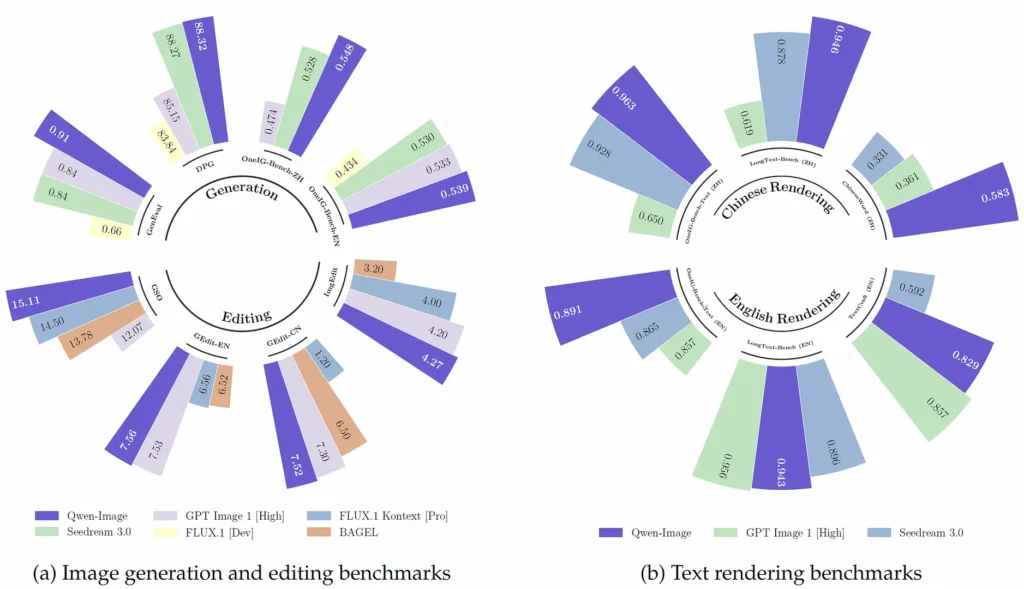

Qwen-Image mencapai performa SOTA atau mendekati SOTA di berbagai benchmark publik untuk generasi maupun pengeditan, dengan hasil yang sangat kuat khususnya pada tugas rendering teks dan benchmark komposisi dunia nyata (misalnya, T2I-CoreBench dan suite pengeditan gambar terkurasi).

Bagaimana Qwen-Image dibandingkan dengan model terdepan lainnya

Kekuatan relatif: rendering teks dan fidelitas teks dwibahasa adalah keunggulan khas model ini dibandingkan banyak pesaing generatif (misalnya, DALL·E 3, SDXL, Midjourney), yang sering kali lebih kuat dalam komposisi artistik murni atau keragaman gaya tetapi lebih lemah pada tata letak teks padat multi-baris atau teks bahasa Tionghoa. Berbagai perbandingan komunitas dan tabel benchmark dari penulis model mendukung karakterisasi ini.

Tradeoff relatif: dibandingkan dengan sistem komersial tertutup yang sangat disetel, Qwen-Image mungkin memerlukan post-processing atau penyetelan prompt/adapter untuk mencapai realisme yang identik dalam beberapa konteks (distorsi pada permukaan melengkung, compositing fotorealistis), menurut pengujian independen. Bagi pengguna yang memprioritaskan desain template, mockup kemasan, atau tata letak teks dwibahasa, Qwen-Image cenderung lebih disukai.

Kasus penggunaan umum dan bernilai tinggi

- Kemasan & mockup produk: teks akurat dan tata letak multi-baris untuk label dan uji coba kemasan.

- Draf iklan & desain: pembuatan prototipe cepat ketika fidelitas teks penting (poster, banner).

- Generasi gambar terdokumentasi: menghasilkan gambar yang harus menyertakan konten yang dapat dibaca (menu, tanda, antarmuka).

- Pipeline pengeditan gambar: edit terarah (penggantian teks, penambahan/penghapusan objek) dengan tetap mempertahankan gaya dan perspektif.

- Cara mengakses API gambar Qwen

Langkah 1: Daftar untuk Mendapatkan API Key

Masuk ke cometapi.com. Jika Anda belum menjadi pengguna kami, silakan daftar terlebih dahulu. Masuk ke konsol CometAPI Anda. Dapatkan kredensial akses API key dari antarmuka. Klik “Add Token” pada API token di pusat pribadi, dapatkan token key: sk-xxxxx lalu kirimkan.

Langkah 2: Kirim Permintaan ke API gambar Qwen

Pilih endpoint “qwen-image” untuk mengirim permintaan API dan atur request body. Metode permintaan dan request body diperoleh dari dokumentasi API di situs web kami. Situs web kami juga menyediakan pengujian Apifox untuk kenyamanan Anda. Ganti <YOUR_API_KEY> dengan key CometAPI aktual dari akun Anda. base url adalah Images format(https://api.cometapi.com/v1/images/generations) melalui CometAPI.

Masukkan pertanyaan atau permintaan Anda ke dalam field content—ini adalah yang akan direspons oleh model.

Langkah 3: Ambil dan Verifikasi Hasil

Proses respons API untuk mendapatkan jawaban yang dihasilkan. Setelah diproses, API merespons dengan status tugas dan data output.