Hurtigt svar: Hvilken AI-model bør udviklere prioritere i 2026?

Til opgaver, der kræver maksimal autonom ræsonnering og minimal hallucination, bør udviklere vælge GPT-5.5 (xhigh), som fører markedet med et Intelligensindeks på 60. Applikationer, der kræver realtidsinteraktivitet, bør anvende Mercury 2, den nuværende hastighedsleder med cirka 859 tokens i sekundet. Til storskala produktion, hvor budget er den primære begrænsning, tilbyder DeepSeek V4 Pro og Kimi K2.6 intelligens tæt på grænsen til omkring 10% af prisen for flagskibs proprietære modeller.

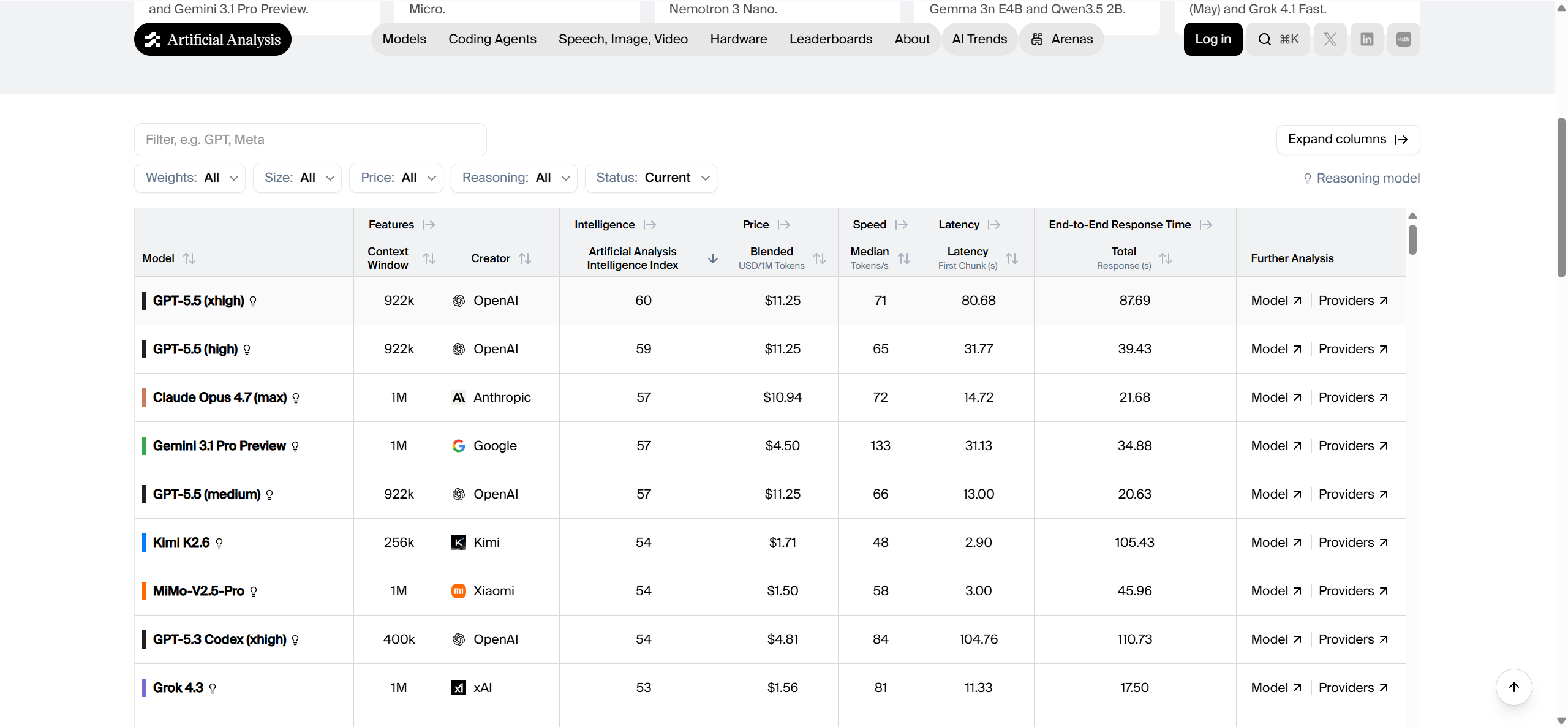

Intelligensindekset: Rangering af frontier-modellerne

AI-landskabet i 2026 er skiftet fra at jagte parameterantal til at optimere “tænke”-tæthed. Artificial Analysis Intelligence Index v4.0 fungerer som industristandard for at kvantificere modelkapabilitet på tværs af ti specialiserede dimensioner, inklusive professionel kodning og ekstrem logisk deduktion.

| Model | Intelligensindeks | Kontekstvindue | Bedste anvendelse |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Videnskabelig forskning og logik |

| GPT-5.5 (high) | 59 | 922K | Kodning på professionelt niveau |

| Claude Opus 4.7 (max) | 57 | 1M | Autonome agenter og planlægning |

| Gemini 3.1 Pro | 57 | 1M - 2M | Multimodal datasyntese |

| Kimi K2.6 | 54 | 256K | Terminalbaseret agentarbejde |

| MiMo-V2.5-Pro | 54 | 1M | Fuldstack-softwareudvikling |

| DeepSeek V4 Pro (Max) | 52 | 1M | Skalerbare ræsonnementsarbejdsgange |

| GLM-5.1 | 51 | 200K | Langsigtede autonome opgaver |

Sådan læser du denne tabel

Blandt de fem bedste modeller er tre GPT-5.5-modeller, GPT-5.5 Medium, Claude Opus 4.7 og Gemini 3.1 Pro. Disse tre vestlige flagskibsmodeller ligger tæt, mens Kimi K2 og mimo-v2.5 pro, to kinesiske modeller, tilbyder ydeevne sammenlignelig med top vestlige modeller til ekstremt konkurrencedygtige priser.

Artificial Analysis Intelligence Index er en normaliseret metrik, der er afledt af uafhængige evalueringer såsom Terminal-Bench Hard og IFBench. En enkelt points forskel repræsenterer et statistisk signifikant gab i en models “autonomitærskel”. For eksempel betyder kløften på 3 point mellem GPT-5.5 (60) og Claude Opus 4.7 (57) ofte forskellen mellem en model, der kræver menneskelig intervention hvert par trin, og en, der kan fuldføre en kompleks logikkæde selvstændigt. Et højere indeksresultat er generelt forbundet med højere succesrater i "Humanity's Last Exam" og reducerede værktøjsopkaldsfejl i agentiske miljøer.

Reflekserne: Latens og genereringshastighed

For interaktiv software—fra live IDE-assistenter til kundevendte stemmeagenter—er rå intelligens sekundær i forhold til Time to First Token (TTFT) og Generation Throughput.

Top 5 hurtigste modeller (gennemstrømning)

Gennemstrømning måler den hastighed, hvormed en model genererer tekst efter den indledende behandlingsfase. Høj gennemstrømning er afgørende for generering af længere indhold og hurtig koderefaktorering.

- Mercury 2: Cirka 859 tokens/s

- Granite 4.0 H Small: Cirka 407 tokens/s

- Granite 3.3 8B: Cirka 365 tokens/s

- Gemini 3.1 Flash-Lite**** : Cirka 331 tokens/s

- Qwen3.5 0.8B: Cirka 287 tokens/s

Top 5 modeller med lavest latens (TTFT)

Latens indikerer forsinkelsen, før den første token når brugeren. Dette er den kritiske metrik for “vibe” og oplevet responsivitet i UI/UX.

- NVIDIA Nemotron 3 Nano: Cirka 0,40 s

- Ministral 3 3B: Cirka 0,47 s

- Qwen3.5 0.8B: Cirka 0,52 s

- LFM2 24B A2B: Cirka 0,55 s

- Grok 3 mini Reasoning: Cirka 0,58 s

Sådan vælger du din model i 2026

Valg af model kræver balance mellem “Intelligens pr. dollar”-forholdet og de specifikke oppetidskrav i din applikation. Markedet i 2026 er delt i tre forskellige arkitektoniske spor.

Uafhængige udviklere og budgetfølsomme teams

For solo-udviklere eller små teams, der kører tusindvis af eksperimentelle agent-loops, er DeepSeek V4 Pro det optimale strategiske valg. Den anvender en massiv 1,6T parameter Mixture-of-Experts (MoE)-arkitektur, hvor kun 49B parametre aktiveres pr. token, hvilket gør det muligt at levere flagskibspræstation til cirka $0,416 pr. million tokens. En anden fremragende mulighed til kode-specifikke opgaver er Kimi K2.6, som er specialiseret i terminal-first-arbejdsgange. Disse modeller leverer næsten 90% af ræsonneringskraften fra premium-modeller, mens de er cirka 70-80% billigere, hvilket effektivt forlænger en startups runway.

Virksomhedsproduktionsmiljøer

Til koncernomspændende udrulninger, hvor stabilitet og overholdelse af komplekse systemprompter er ufravigelige, er industristandarden fortsat GPT-5.5 Pro og Claude Opus 4.7. GPT-5.5 Pro er konstrueret til højrisiko-præcision og udmærker sig i områder som investmentbank-modellering og videnskabelig udforskning, hvor fejlkostnaden opvejer omkostningen ved API-kaldet. Claude Opus 4.7 foretrækkes af teams, der kræver vedvarende pålidelighed i fler-dages projekter, da den viser en markant lavere hallucinationsrate i terminalmiljøer sammenlignet med den bredere GPT-familie. Virksomheder bruger typisk CometAPI til at integrere disse modeller via en enkelt gateway, hvilket sikrer 99,9% oppetid og øjeblikkelig failover, hvis en primær udbyder oplever regionale latensspidser.

Realtime-interaktive applikationer

Applikationer som realtids kundesupportbots eller øjeblikkelig videotekstning kræver “flydende” AI, der føles øjeblikkelig. I denne kategori er Mercury 2 og Gemini 3.1 Flash-Lite de bedste valg. Mercury 2 tilbyder gennemstrømning, der er næsten ti gange hurtigere end standard ræsonneringsmodeller, hvilket gør den ideel til realtids dokumentudarbejdelse. Gemini 3.1 Flash-Lite giver en afbalanceret multimodal kapabilitet, der behandler tekst, lyd og billeder i en samlet kontekst med cirka 2,5x hastigheden af tidligere generationer, samtidig med at den understøtter et kontekstvindue på 1 million tokens.

Kontekstvindue: Fra snippets til hele repositorier

Kontekstvinduet fungerer som modellens “korttidshukommelse”. I 2026 har branchen delt sig mellem standardvinduer (128K) og repository-skala kapaciteter (1M-10M).

- Llama 4 Scout: 10.000.000 tokens

- Grok 4.20: 2.000.000 tokens

- Gemini 3.1 Pro: Cirka 1.048.576 tokens

- DeepSeek V4 Pro: 1.000.000 tokens

- GPT-5.5 Pro: 1.050.000 tokens

Hvornår betyder kontekststørrelse noget?

Et 128K kontekstvindue—standard for modeller som DeepSeek-V3.2—er nu baseline for grundlæggende samtalechat og sammenfatning af individuelle artikler. Professionel softwareudvikling kræver dog “helhedssystem”-bevidsthed.

Et 1-million-token-vindue giver en AI-agent mulighed for at indlæse et helt software-repository, inklusive alle kildefiler, dokumentation og historiske logs, i et enkelt forward pass. Dette forhindrer den “memory drift”, der er forbundet med traditionelle RAG-systemer, hvor relevant data kan gå tabt under chunking. Et konkret eksempel er en kodebase-refaktorering: En model med 1M tokens kan forstå, hvordan en ændring i et centralt databaseskema påvirker halvtreds forskellige API-endpoints på tværs af separate filer, mens en mindre model måske kun “ser” nogle få filer ad gangen, hvilket fører til brudte afhængigheder.

Økonomisk sammenligning: Enhedspris pr. 1 million tokens

Følgende tabel bruger en Blandet USD/1M Tokens-metrik, under antagelse af et 3:1-forhold mellem input- og output-tokens for at afspejle virkelige brugsmønstre.

| Model | Blandet pris (pr. 1M) | Relativ værdi | Rabat via CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | Cirka $11,25 | Premium | 20% OFF |

| Claude Opus 4.7 (max) | Cirka $10,00 | Høj | 20% OFF |

| Gemini 3.1 Pro | Cirka $4,50 | Balanceret | 20% OFF |

| Kimi K2.6 | Cirka $1,71 | Høj værdi | 20% OFF |

| DeepSeek V4 Pro | Cirka $0,53 | Ekstrem værdi | 20% OFF |

| Qwen3.5 0.8B | Cirka $0,02 | Nytte | 20% OFF |

Alle satser verificeret pr. maj 2026. Officielle leverandørsatser er typisk 20% højere end de rabatpriser der tilbydes via samlede gateways.

Omkostningsoptimeringsstrategi

For at hjælpe arkitekturplanlægning har vi estimeret månedlige udgifter for tre almindelige vækstniveauer.

- Lille udviklerteam (10M tokens/måned): Teams, der primært bruger Kimi K2.6 til funktionsudvikling og DeepSeek V4 Flash til enkel logik, vil se en månedlig udgift i størrelsesordenen $15 til $40. Dette muliggør aggressiv prototyping med en økonomisk byrde, der ikke er større end et standard SaaS-abonnement.

- Mellemstor SaaS (100M tokens/måned): En startup, der skalerer en AI-drevet automatiseringsplatform med Claude Sonnet 4.6 og Gemini 3.1 Flash, kan forvente månedlige omkostninger mellem $250 og $550. Ved at udnytte prompt-caching tilgængelig på disse modeller falder den effektive omkostning ofte yderligere 15%.

- Stor virksomhed (1B tokens/måned): Globale firmaer, der kører høj-samtidige agentiske arbejdsgange med GPT-5.5 og Claude Opus 4.7, vil sandsynligvis bruge i størrelsesordenen $3.000 til $6.500 månedligt. I denne skala bliver integration via en samlet API-gateway essentiel for centraliseret fakturering og for at undgå overhead ved at administrere separate kontrakter med flere leverandører.

Konklusion: Vælg din vej i 2026

Æraen med “one-size-fits-all”-modellen er forbi. Moderne AI-arkitektur kræver orkestrering af en flåde af specialiserede modeller: GPT-5.5 til høj-compute ræsonnering, Mercury 2 til interaktivitet og DeepSeek V4 til høj-volumen eksekvering. Ved at integrere én gang med CometAPI får udviklere portabilitet til at udskifte modeller, efterhånden som benchmarks udvikler sig, samtidig med at de sikrer en permanent rabat på 20-40% på hver forespørgsel.

FAQ

Hvilken AI-model er i øjeblikket den mest intelligente?

Ifølge Artificial Analysis Intelligence Index v4.0 er GPT-5.5 (xhigh) den mest intelligente model, der er tilgængelig, med en score på 60. Den efterfølges tæt af GPT-5.5 (high) på 59 og Claude Opus 4.7 (max) på 57.

Hvad er den hurtigste AI-model til realtidsapplikationer?

Mercury 2 er hastighedsmesteren i 2026 og leverer cirka 859,1 tokens pr. sekund. For lav latens (TTFT) fører NVIDIA Nemotron 3 Nano med en responstid på cirka 0,40 sekunder.

Hvor høj skal en Intelligensindeks-score være for produktionsagenter?

Til basal automatisering eller klassifikation er en score mellem 30 og 40 (som GPT-5.4 nano) ofte tilstrækkelig. Til “Agentic Engineering”, hvor AI’en håndterer kodebaser eller hele browsersessioner, anbefales en score over 54 (såsom Kimi K2.6 eller GPT-5.5) for at sikre konsistens i langsigtet planlægning.

Med lignende priser, bør jeg vælge GPT-5.5 eller Claude Opus 4.7?

Hvis dit workflow involverer terminaleksekvering og “Vibe Coding”, excellerer GPT-5.5 generelt i disse specifikke benchmarks. Hvis du derimod kræver ekstrem konsistens til professionel skrivning, juridisk research eller fler-dages agent-cyklusser med lav hallucinationsrate, er Claude Opus 4.7 den dokumenterede leder i disse kategorier.

Hvad er den faktiske præstationskløft mellem open-weights (DeepSeek) og proprietære modeller?

I 2026 er kløften indsnævret til cirka 10-15% i rå ræsonneringsbenchmarks. Mens proprietære flagskibe som GPT-5.5 (xhigh) stadig fører i “peak” logik (Indeks 60), leverer open-weight-modeller som DeepSeek V4 Pro (Indeks 52) og Kimi K2.6 (Indeks 54) over 85% af kapabiliteten til cirka 1/10 af prisen.

Hvordan kan jeg reducere mine samlede API-omkostninger for disse modeller?

Ved at bruge et samlet API-lag som CometAPI får du adgang til hele kataloget til satser, der er 20% til 40% lavere end officielle leverandørpriser gennem masseindkøb og intelligent path routing.

Hvilken model har det største kontekstvindue til lange dokumenter?

Llama 4 Scout understøtter i øjeblikket det største kontekstvindue på markedet med 10 millioner tokens. Grok 4.20 følger med 2 millioner tokens, mens GPT-5.5 Pro, Gemini 3.1 Pro og DeepSeek V4 Pro alle understøtter cirka 1 million tokens.

Er der en måde at teste disse benchmarks uden høje startomkostninger?

Ja. Du kan tilmelde dig en gratis konto hos CometAPI for at modtage testkreditter uden kreditkort, så du kan køre sammenlignende præstationstests på tværs af over 500 modeller i det indbyggede Playground.