Udvikleroplevelsen med ChatGPT-videoanalyse støder ofte på en mur: direkte YouTube-links fejler, og MP4-uploads returnerer “hallucinerede” sammenfatninger, der overser visuelle nuancer. Det er ikke en bug — det er en arkitektonisk begrænsning. ChatGPT streamer ikke video; det behandler sekvenser af udtrukne frames og transkripttekst. Så du prøvede at uploade en MP4-fil, hvilket fungerede… på sin vis. Sammenfatningen nævnte lydtranskriptet, men missede fuldstændigt den visuelle joke i tredje scene, som fik hele videoen til at give mening.

ChatGPT kan analysere videoer — men ikke ved faktisk at se dem

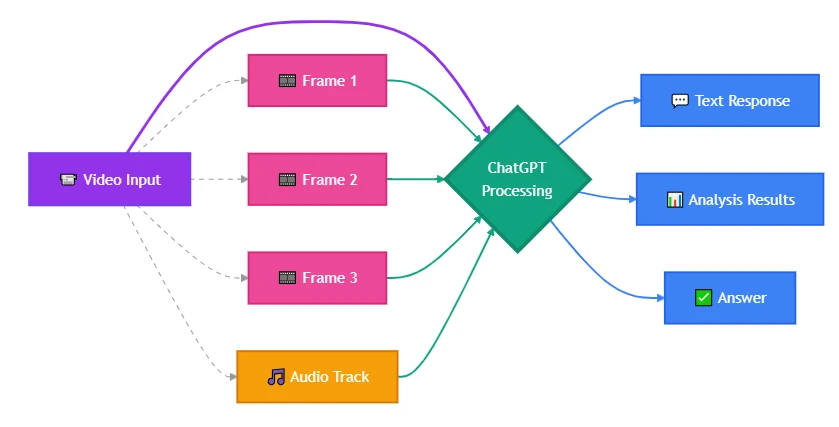

Her er, hvad der faktisk sker: ChatGPT “ser” ikke videoer, som du gør. Det trykker ikke play, streamer indholdet og observerer bevægelse over tid. I stedet bryder det videoen op i komponenter, det allerede kan håndtere — stillbilleder og teksttranskripter — og ræsonnerer over disse dele hver for sig. Modellen opfatter din video som et fotoalbum med fortælling, ikke som en kontinuerlig oplevelse. Derfor fangede den den talte forklaring, men missede den visuelle pointe: framen med joken var sandsynligvis ikke med i det udtagne sample.

Når nogen spørger “kan ChatGPT se videoer”, spørger de typisk om én af to ting: Kan den streame visuelt indhold som en menneskelig observatør, eller kan den udtrække og analysere mening fra videodata — scener, dialog, tidsstempler, handlinger på skærmen? Det funktionelle svar er ja til det andet, med begrænsninger, der helt knækker visse use cases. Moderne ChatGPT-varianter behandler video ved at betragte den som samplede frames kombineret med lydtranskription, enten via automatisk ekstraktion i webgrænsefladen eller ved at acceptere brugerleverede frames via API. Det virker til sammenfatning, sceneresumé og tekstudtræk. Det fejler ved bevægelsessporing, tidsafhængig analyse eller alt, der kræver, at modellen “ser”, hvad der sker mellem frames.

De fleste guider nøjes med at bekræfte, at evnen findes, uden at forklare hvorfor din specifikke implementering ikke virkede — eller hvilken alternativ inputmetode der ville have gjort.

ChatGPT Video Capabilities: What the Model Actually Sees

ChatGPT indlæser ikke en MP4 og skrubber den frame-for-frame. Den har vision-kapabilitet — evnen til at analysere statiske billeder — og lydtranskription via Whisper-integration. Når du indsender video gennem ChatGPTs web- eller mobilgrænseflade, udtrækker systemet nøgleframes, transskriberer lyden separat og giver begge dele til modellen som separate inputs. Modellen beskriver så, hvad den “så” i de frames, og hvad den “hørte” i transkriptet.

Fra dit perspektiv ligner det videoforståelse. Fra modellens perspektiv er det billedanalyse plus tekstbehandling. Den arkitektoniske forskel afgør, hvilke use cases der virker, og hvilke der ikke gør.

Hvis din video afhænger af bevægelse, subtile frame-til-frame-ændringer eller præcis timing — som at detektere præcist, hvornår et objekt kommer ind i billedet, eller spore hvordan et UI-element animeres — vil en keyframe-baseret tilgang misse det. ChatGPT opfanger ikke et to-sekunders visuelt hint, der falder mellem samplede frames. Den sporer heller ikke objekter over tid, medmindre du eksplicit strukturerer inputtet til at vise progression.

Aktuelle ChatGPT-videokapabiliteter (pr. begyndelsen af 2026):

- Billedbaseret videoanalyse: Accepterer videofiler eller udtrukne frames; tolker visuelt indhold ud fra samplede billeder

- Lydtranskription: Konverterer tale til tekst via Whisper; modellen kan derefter sammenfatte eller forespørge transkriptet

- Scenebeskrivelse: Identificerer objekter, handlinger, miljøer og tekst synlig i leverede frames

- Tidsstempel-baserede forespørgsler: Kan referere til specifikke øjeblikke, hvis du giver frame-tidsstempler eller segmenterer videoen manuelt

- Tekstudtræk: Læser undertekster, UI-labels eller dokumenter synlige i frames

Specifik frame-samplingshastighed og automatisk keyframe-udvælgelsesadfærd i ChatGPTs webgrænseflade — ikke offentligt dokumenteret pr. vidensafskæring

Hvad den ikke omfatter:

- Realtids streaming-videoinput via API

- Frame-perfekt bevægelsessporing eller objektpersistens over tid

- Native understøttelse af videocodecs — al behandling sker på udtrukne frames og lyd

- Automatisk sceneskift-detektion uden eksplicit brugerprompt

Videokapacitet er bundet af token-grænser og filstørrelse, ikke længde. Mens 5–10 minutter er en praktisk tommelfingerregel, skalerer de faktiske grænser dynamisk med visuel tæthed.

Hvis din use case kræver disse kapabiliteter, forbehandler du enten videoen selv for at udtrække de rigtige frames, eller skifter til en model med native videosupport. Næste afsnit gennemgår, hvilken inputmetode du bør bruge til din specifikke situation.

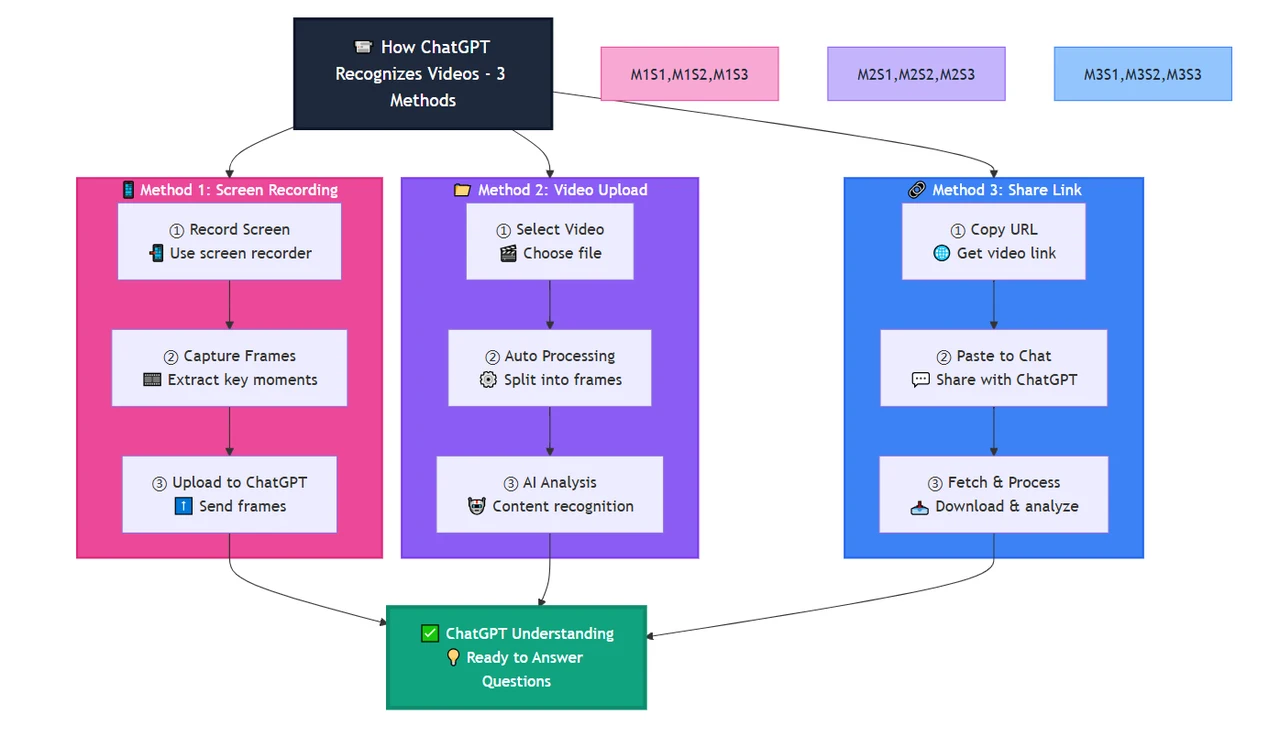

Sådan genkender ChatGPT videoer: Tre praktiske metoder

Der er ikke kun én måde at indsende video til ChatGPT. Metoden, du vælger, styrer, hvad modellen kan analysere, og hvad den overser. De fleste implementeringsfejl skyldes, at man vælger den bekvemme metode frem for den korrekte.

Metode 1: Manuel frame-ekstraktion + upload af billeder

Ekstrahér selv frames med ffmpeg eller lignende værktøjer, og upload derefter disse specifikke frames som billeder. Det giver dig fuld kontrol over, hvad ChatGPT analyserer.

Eksempelworkflow (bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Denne tilgang lader dig:

- Fokuserer analysen på specifikke øjeblikke (intro, nøglehandling, konklusion) uden at spilde kontekst på irrelevante afsnit

- Indfange bevægelse ved at uploade på hinanden følgende frames med din valgte samplingsrate

- Omgå filstørrelsesbegrænsninger — billeder er mindre end fulde videofiler

- Bevare frame-kvalitet, som kan forringes ved automatisk komprimering

Afvejningen:

Du håndterer forbehandlingen selv. For analyse af hundreder af videoer i skala kræver dette automatisering. Til enkeltstående dyb analyse eller fejlfinding af specifikke scener er det den mest pålidelige metode.

Hvornår du bør bruge denne metode:

- Du har brug for frame-præcis analyse af specifikke øjeblikke

- Den kritiske visuelle information er kortvarig eller forekommer mellem typiske keyframe-intervaller

- Du sammenligner visuelle ændringer på tværs af en sekvens (UI-tilstandsskift, animationsframes)

- Du vil verificere, hvad modellen faktisk “så”, ved at inspicere de præcise frames, du uploadede

Metode 2: Direkte filupload via ChatGPT-grænsefladen

ChatGPTs web- og mobilapps accepterer direkte videouploads i chatten. Slip en MP4- eller MOV-fil i inputfeltet, og systemet håndterer automatisk frame-ekstraktion og transkription.

Hvad der sker internt:

- Tjenesten sampler frames med intervaller (specifik rate ikke dokumenteret; anslået til 1–2 frames pr. sekund baseret på observeret adfærd)

- Lyd transskriberes via Whisper eller lignende service

- Begge outputs gives til modellen som separate kontekstinputs

- Modellen genererer svar baseret på synlige frames og transkriptet

Denne metode virker til:

- Overordnede videosammenfatninger, hvor du ikke behøver frame-præcise detaljer

- Identifikation af nøgleobjekter, personer eller miljøer, der persisterer på tværs af scener

- Udtræk af taleindhold eller on-screen-tekst, der vises i flere frames

- Hurtig, eksplorativ analyse uden forbehandling

Denne metode fejler ved:

- Frame-præcis analyse — du kontrollerer ikke, hvilke frames der samples

- For længere videoer, der overskrider modellens komfortable kontekstkapacitet, er logisk segmentering nødvendig. Uden strategisk chunking eller forbehandling kan modeller forringes eller trunkere, efterhånden som tokenforbruget accelererer med højdensitets visuelt indhold

- Detektering af bevægelse, overgange eller tidsafhængigt indhold, der kræver sammenligning af på hinanden følgende frames

- Scenarier, hvor den kritiske visuelle information vises kortvarigt mellem samplede frames

Hvis du har brug for kontrol over, hvilke øjeblikke der analyseres, skal du bruge Metode 1.

Metode 3: YouTube-link + transkripthentning

Nogle ChatGPT-plugins og tredjepartsværktøjer hævder at “analysere YouTube-videoer”. Hvad de faktisk gør, er at hente videoens offentlige metadata og transkript (hvis tilgængeligt) og derefter give den tekst til ChatGPT.

Dette virker, når:

- Videoen har automatisk genererede eller brugeruploadede undertekster

- Din analyse kun kræver taleindhold, ikke visuel information

- Videoen er offentligt tilgængelig (ikke privat, unoteret eller regionsbegrænset)

- Du sammenfatter forelæsninger, podcasts eller interviews, hvor lyden bærer det meste af meningen

Dette virker ikke, når:

- Du skal analysere visuelt indhold (on-screen-demonstrationer, diagrammer, ansigtsudtryk)

- Videoen mangler transkript eller undertekster

- Kritisk information optræder visuelt uden at blive nævnt i dialogen

- Du arbejder med private videofiler eller indhold bag autentificering

Almindelig fejl: Udviklere forventer fuld videoforståelse (visuelt + lyd), men får kun en transkriptsammenfatning. Det er fint til indholdsanalyse af tale. Det er ubrugeligt til gennemgang af produktdemoer, analyse af visuelt design eller ethvert scenarie, hvor det, du ser, er vigtigere end det, der siges.

Mønsteret: Metode 2 til hurtige sammenfatninger, hvor præcision er ligegyldig. Metode 1 til kontrolleret analyse, hvor du behøver specifikke frames. Metode 3 til lydfokuseret indhold, hvor visuel information er sekundær eller ikke-eksisterende. Vælg baseret på, hvor din use cases kritiske information lever — i bevægelse, i specifikke frames eller udelukkende i dialog.

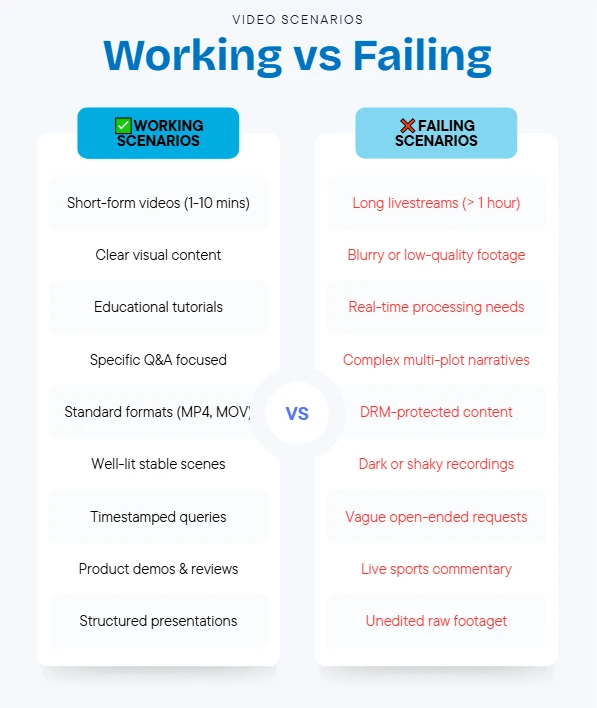

ChatGPT-videoanvendelsesscenarier: Hvad virker faktisk i produktion

At vide, at ChatGPT kan behandle videokomponenter, fortæller dig ikke, om det er det rette værktøj til dit problem. Disse scenarier viser, hvor frame-baseret analyse lykkes — og hvor de arkitektoniske begrænsninger knækker use casen.

Scenarie 1: Sammenfatning af undervisningsindhold

Use case: Du har en 10-minutters tutorial-video og behøver en struktureret sammenfatning af nøgletrin, nævnte værktøjer og viste visuelle eksempler.

Hvorfor det virker: Undervisningsvideoer har typisk klare sceneskift, vedvarende on-screen-tekst og en fortælling, der flugter med visualerne. Oplægsholderen beskriver, hvad der vises, mens det er synligt. ChatGPT kan transskribere forklaringen, identificere værktøjer eller diagrammer i samplede frames og kombinere begge dele til et struktureret output.

Implementeringsmetode: Upload videoen via ChatGPT-grænsefladen eller ekstrahér 8–12 nøgleframes ved større emneskift. Prompt: “List de vigtigste trin, der forklares i denne video, med reference til både fortællingen og al on-screen-tekst, diagrammer eller værktøjsnavne, du ser.”

Hvor det knækker: Videoer, der bygger på kontinuerlig bevægelse — som en kodningsscreencast, hvor underviseren skriver hurtigt på tværs af flere filer — vil have manglende trin mellem frames. Du får brug for højere samplingsrater eller fokus på lydtranskriptet alene.

Praktisk tip: Til forelæsninger eller tutorials: Kombinér automatisk upload (for transkriptet) med manuelt udtrukne frames af de 3–5 vigtigste visuelle øjeblikke. Så får du både dækkende lyd og høj-kvalitetsbilleder af nøglekoncepter.

Scenarie 2: Analyse af produktdemo

Use case: Du gennemgår en konkurrents produktdemo og vil udtrække UI-elementer, funktionstitler, brugerflows og prissætningsdetaljer vist på skærmen.

Hvorfor det virker: Produktdemoer holder typisk hver skærm længe nok til, at frame-sampling opfanger statisk UI. Tekstoverlays, knaplabels, menustrukturer og prisskemaer forbliver synlige i flere frames. ChatGPTs vision kan læse og beskrive disse elementer, selv hvis de ikke nævnes i speaket.

Implementeringsmetode: Ekstrahér frames ved større sceneskift (introslide, feature 1-demo, feature 2-demo, prisskærm, CTA). Upload disse frames og prompt: “Identificér for hver frame alle synlige UI-elementer, knaplabels, funktionsnavne og enhver pris- eller produktoplysning, der vises.”

Hvor det knækker: Demoer med hurtige skift, hover-tilstande, der kun afslører information kortvarigt, eller interaktive elementer vist i kun 1–2 sekunder bliver ikke fanget af frame-sampling. Hvis konkurrenten hurtigt flasher en feature-sammenligningstabel, misser du den, medmindre netop det øjeblik blev samplet.

Praktisk tip: Scrub videoen manuelt først for at identificere tidsstempler for vigtige afsløringer. Ekstrahér frames på disse specifikke tidspunkter i stedet for at stole på automatiske samplingintervaller.

Scenarie 3: Møde- eller interviewtranskription med visuel kontekst

Use case: Du har optaget et kundemøde og behøver både et transkript og annoteringer, der noterer, hvornår specifikke dokumenter, slides eller skærmdelinger dukkede op.

Hvorfor det virker: Lydtranskription håndterer den talte dialog. Når deltagere deler skærm eller holder dokumenter op, optræder disse i samplede frames. ChatGPT kan annotere “omkring [tidsstempel] var et kontraktdokument synligt på skærmen” sammen med transkriptet — nyttigt til referater, der henviser til visuelt materiale.

Implementeringsmetode: Upload videoen og prompt: “Transskriber dette møde og notér alle tidspunkter, hvor dokumenter, præsentationsslides, skærmdelinger eller andre visuelle referencer optrådte. Beskriv for hvert visuelt element, hvad der blev vist.”

Hvor det knækker: Korte skærmdelinger (under 5–10 sekunder) kan falde mellem samplede frames. Tekst, der er for lille til at læse i komprimerede videoframes, kan ikke udtrækkes. Til juridiske eller compliance-formål, der kræver ordret nøjagtighed af viste dokumenter, skal du verificere framekvalitet og samplingsdækning, før du stoler på output.

Praktisk tip: Til vigtige møder: Optag i højere opløsning, og ekstrahér frames manuelt, når nogen siger “jeg vil lige vise et dokument” — et tegn på, at en visuel reference er på vej.

Scenarie 4: Indholdsmoderation eller compliance-gennemgang

Use case: Du skal scanne brugeruploadede videoer for forbudt indhold — specifikke logoer, tekstmønstre eller visuelle elementer, der bryder platformspolicys.

Hvorfor det virker: ChatGPT kan scanne frames for synlig tekst, genkendelige objekter eller beskrevne scener. Hvis du tjekker “viser nogen af disse videoer en konkurrents logo”, vil frame-baseret analyse detektere logoer, der persisterer på skærmen i mere end et-to sekunder.

Implementeringsmetode: Ekstrahér frames med regelmæssige intervaller (hver 3–5 sekund), upload dem, og prompt: “Gennemgå disse frames og identificér alle, der indeholder [specifikt logo, brandnavn, forbudt symbol, etc.]. Beskriv for hvert match, hvor i framen det optræder.”

Hvor det knækker: Lyd-baserede overtrædelser (copyrightet musik, forbudt tale) kræver separat lydanalyse. Bevægelsesbaserede overtrædelser (forbudte gestus, handlinger på tværs af flere frames) fanges ikke af stillbilledanalyse. Kortvarigt flash’et forbudt indhold optræder måske ikke i samplede frames.

Praktisk tip: Kombinér ChatGPTs visuelle scanning med dedikerede lyd-fingerprinting-tjenester og højere samplingsrater for højrisikokategorier. Brug ChatGPT som første filter, ikke den eneste moderationslag.

Mønsteret på tværs af succesfulde scenarier: Meningsfuldt indhold findes i diskrete, stabile frames og korrelerer med lyd eller tekst. Fejl opstår, når kritisk information ligger i bevægelse, timing, overgange, eller vises for kort til at blive samplet pålideligt.

Gemini Video Capabilities vs. Claude Video Capabilities vs. ChatGPT

Hvis ChatGPTs frame-samplingsarkitektur ikke passer til din use case, bør du evaluere alternativer. Gemini og Claude tilbyder forskellige video-relaterede kapabiliteter — og de forskelle afgør, hvilken model der virker for din specifikke implementering.

Geminis native videobehandling

Gemini-modeller understøtter native videoinput på API-niveau. Du sender en videofil direkte uden forbehandling til frames. Modellen behandler video som en kontinuerlig strøm, hvilket muliggør bevægelsessporing, sceneskift-detektion og tidslig ræsonnering, som ChatGPTs frame-baserede tilgang ikke kan håndtere.

Eksempel-use case, hvor Gemini vinder:

Du skal detektere, hvornår et specifikt objekt kommer ind og forlader billedet i et 30-sekunders klip, eller spore hvordan en person bevæger sig gennem en scene. Gemini kan følge objekter på tværs af frames og ræsonnere om bevægelse. ChatGPT vil kun se objektet i de frames, der tilfældigvis blev samplet — og kan misse indgang eller udgang helt.

Afvejninger:

- Geminis native API er mere omkostningseffektiv end OpenAIs frame-baserede sampling. Ved at undgå lineært token-overhead via kontekst-caching skalerer Gemini bedre til langformet analyse.

- Behandling af længere videoer medfører højere latens — modellen skal indlæse hele filen, før den svarer

- Ikke alle Gemini-varianter understøtter videoinput; kræver senere Gemini-modeller

- Videolængdebegrænsninger findes, men er mere generøse end ChatGPTs kontekstbaserede begrænsninger

Hvornår du bør vælge Gemini over ChatGPT:

- Din use case kræver bevægelsessporing, sceneboundary-detektion eller forståelse af tidslige relationer

- Kritisk information dukker op og forsvinder hurtigt på tværs af frames

- Du analyserer videoer, hvor begivenhedsforløb betyder noget (sportsoptagelser, overvågningsreview, animationsanalyse)

- Du vil undgå manuel frame-ekstraktion som forbehandling

Claudes nuværende videobegrænsninger

Pr. begyndelsen af 2026 understøtter Claude-modeller ikke direkte videoinput via API. Du kan uploade billeder (inkl. manuelt udtrukne videoframes), men der er ingen native videobehandling svarende til Gemini.

Hvad Claude kan:

- Analysere sekvenser af uploadede frames, svarende til ChatGPTs manuelle ekstraktionsmetode (Metode 2)

- Give detaljerede beskrivelser af visuelt indhold i hver frame

- Ræsonnere om implicit bevægelse eller ændringer mellem frames, hvis det eksplicit promptes

- Håndtere længere billedsekvenser pga. udvidet kontekstvindue (op til 1M tokens i Claude Opus 4.7)

Hvad Claude ikke kan:

- Acceptere videofiler direkte via nogen grænseflade

- Automatisk spore bevægelse eller objekter på tværs af frames uden eksplicit frame-for-frame-prompting

- Transskribere lyd — kræver separat forbehandling med Whisper eller lignende, og derefter at give transkriptet til Claude

Hvornår du alligevel vælger Claude:

- Din workflow inkluderer allerede frame-ekstraktion som forbehandlingstrin

- Du analyserer lange videoer, der kræver mange frames, og har brug for Claudes større kontekstvindue

- Du sammenligner kvaliteten af visuel analyse og oplever, at Claudes framedeskriptioner er mere nøjagtige for din domæne (fx medicinske billeder, tekniske diagrammer)

- Du skal kombinere analyse af videoframes med store mængder anden kontekstuel information

Kapabilitets-sammenligningstabel

| Feature | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Direkte upload af videofiler | ✓ (web/app-grænseflade) | ✓ (API + webgrænseflade) | ✗ |

| Native bevægelsessporing | ✗ | ✓ | ✗ |

| Lydtranskription | ✓ (Whisper-integration) | ✓ (integreret) | ✗ (kræver eksternt værktøj) |

| Frame-baseret analyse | ✓ | ✓ (også kontinuerlig behandling) | ✓ (kun manuel ekstraktion) |

| Sceneskift-detektion | ✗ (kun manuelt) | ✓ (automatisk) | ✗ |

| Typisk håndtering af længde | ~5–10 min (kontekstbegrænset) | ~1 time (afhænger af opløsning) | N/A (antal frames begrænset af kontekst) |

| Bedste use case | Hurtige sammenfatninger, frame-niveau analyse med kontrol | Bevægelsessporing, tidslig ræsonnering, kontinuerlig video | Dyb frame-for-frame-beskrivelse med stort kontekstbehov |

| API-videosupport | ✗ (kun billeder) | ✓ | ✗ |

Beslutningsramme:

- Vælg ChatGPT når: Du behøver hurtige videosammenfatninger, den kritiske information persisterer på tværs af flere frames, du arbejder med korte klip (under 10 minutter), og du ikke behøver bevægelsessporing. Bedst til undervisningsindhold, statiske produktdemoer, møde-transkription.

- Vælg Gemini når: Din use case kræver bevægelsessporing, sceneskift-detektion eller tidslig ræsonnering om, hvordan elementer flytter sig eller ændrer sig over tid. Kritisk til overvågningsoptagelser, sportsanalyse, animationsreview eller ethvert scenarie, hvor “hvad der sker mellem frames” betyder noget.

- Vælg Claude når: Du allerede udtrækker frames som led i din pipeline, skal analysere mange frames med omfattende ekstra kontekst, eller oplever, at Claudes visuelle beskrivelser er mere nøjagtige for din visuelle domæne. Kræver mest forbehandling, men tilbyder det største kontekstvindue.

For udviklere, der arbejder på tværs af flere modeller, giver CometAPI en samlet grænseflade til at teste videobehandlingskvalitet på GPT-, Gemini- og Claude-varianter uden at omskrive integrationskode — nyttigt, når du sammenligner outputkvalitet, før du binder dig til en specifik udbyder.

Det rigtige svar på “kan ChatGPT se videoer” er ikke binært. Det er “ja, ved at konvertere video til formater, den allerede håndterer — med begrænsninger, der knækker specifikke use cases.” De fleste implementeringsfejl kommer af arkitektoniske mismatch, ikke kapabilitetsgab. Modellen fungerer præcis som designet; udviklere forventede blot et andet design.

Hvis du bygger videoanalysefunktioner i skala, så test din workflow med edge cases først: Upload den samme video via direkte fil, manuelt udtrukne frames og kun-transkript-metoder. Sammenlign outputs. Den metode, der fanger din use cases kritiske signal — ikke den, der er hurtigst at implementere — er den, der klarer produktionstrafik.

Før du vælger ChatGPT til video:

- Identificér om din kritiske information lever i stabile frames, bevægelse eller lyd

- Test framesamplingsdækning ved manuelt at ekstrahere frames i dine forventede intervaller

- Verificér, at on-screen-tekst er læsbar ved din videos opløsning efter komprimering

- Bekræft, at videolængden passer inden for praktiske kontekstgrænser for dit abonnement

- Hav en fallback for indhold, der optræder kortvarigt eller mellem samplede frames

For udviklere, der evaluerer flere AI-udbydere til videobelastninger, tilbyder CometAPI en samlet playground til at teste ChatGPT, Gemini og Claude med de samme videoinputs — så du kan sammenligne outputkvalitet, latens og omkostninger, før du bygger udbyderspecifikke integrationer.

FAQ - Guide til AI-videoanalyse

Hurtige svar på almindelige spørgsmål om AI-videoanalyse.

Kan ChatGPT analysere videoer?

Ja, ChatGPT (GPT-4o og senere) kan analysere videoer ved at sample frames (~1 pr. sekund) og transskribere lyd. Det fungerer godt til mødereferater, udtræk af tekst fra slides og identifikation af objekter. Men den har svært ved bevægelsessporing, videoer over 10 minutter og realtidsstreaming.

Hvordan uploader jeg videoer til ChatGPT?

Direkte URL-upload (anbefales): Upload via en offentlig URL for hurtig analyse. Bedst til videoer under 10 minutter.

Manuel frame-ekstraktion: Ekstrahér specifikke frames for præcis kontrol. Bedst når du vil analysere særlige øjeblikke eller reducere token-omkostninger.

Hvad er den maksimale videolængde, ChatGPT kan håndtere?

ChatGPT håndterer pålideligt videoer op til 5–10 minutter. Udover det skal du segmentere videoen eller skifte til Gemini 2.5 Pro, som understøtter videoer op til 60 minutter native.

Hvad er ChatGPTs begrænsninger i videoanalyse?

- Kan ikke spore kontinuerlig bevægelse (sport, dans)

- Upålidelige tidsstempler (±1 sekunds nøjagtighed)

- Overser indhold, der vises i under 1 sekund

- Praktisk grænse på 10 minutter

- Ingen understøttelse af realtidsstreaming

- Har svært ved lavkvalitets- eller mørke videoer

- Svag til tidslig årsag-virkning-ræsonnering *

Skal jeg bruge ChatGPT eller Gemini til videoanalyse?

Brug ChatGPT til:

- Videoer under 10 minutter

- Overlegen tekstræsonnering efter videoanalyse

- Frame-niveau-analyse (slides, screenshots)

Brug Gemini til:

- Videoer på 10–60 minutter

- Bevægelsessporing og bevægelsesanalyse

- Tidslige ræsonneringsopgaver

- Sport, dans eller overvågningsoptagelser *

Kan Claude analysere videoer?

Nej, Claude understøtter ikke direkte videoinput. Men du kan udtrække frames fra videoer og analysere dem med Claude, som tilbyder overlegen tekstræsonnering og kontekstvindue til lange analyser.

Hvor meget koster videoanalyse?

Omkostninger varierer efter model og videolængde:

- ChatGPT 4o: ~$0.05 pr. minut

- Gemini 2.5 Pro: ~$0.04 pr. minut

CometAPI tilbyder kredit til nye brugere, så du kan komme i gang.