Claude Opus 4.7, lanceret 16. april 2026, er en markant opgradering i forhold til Opus 4.6 inden for kodning, agentbaserede arbejdsgange, vision og evnen til at følge instruktioner. Den scorer +6.8pp på SWE-bench Verified (87.6% vs 80.8%), +10.9pp på SWE-bench Pro (64.3% vs 53.4%), +12pp på CursorBench (70% vs 58%), og leverer 3.3× højere visuel opløsning med selvverifikationssløjfer, der reducerer hallucinationer ved lange opgaver. Priserne forbliver officielt identiske ($5/$25 per million tokens), men 4.7 ved lavt indsatsniveau matcher 4.6 ved mellem indsatsniveau i kvalitet, hvilket reducerer de faktiske omkostninger.

På CometAPI får du begge modeller (Claude Opus 4.7 og Opus 4.6) til $4 input / $20 output med OpenAI-kompatible endpoints og nul leverandørlåsning. Opgradér, hvis du kører produktions-kodeagenter, kompleks dokumentanalyse eller fler-session arbejdsgange—4.7 er den nye standard for banebrydende arbejde.

Claude Opus 4.7 vs Opus 4.6: Hurtig sammenligning

Kort fortalt: Opus 4.7 føles som “Opus 4.6, men ubegrænset og forfinet.” Den fjerner begrænsninger, der af og til dukkede op i 4.6 (fx for tidlig opgaveafslutning, lavere visuel skarphed), og tilføjer effektivitet gennem adaptiv ræsonnering. Brugere rapporterer, at den er mere “bestemt” og samarbejdsvillig—som at arbejde med en senioringeniør, der dobbelttjekker sit eget arbejde.

Hvorfor Claude Opus 4.7 er vigtig i 2026

Den 16. april 2026 lancerede Anthropic stille og roligt deres hidtil mest kapable, generelt tilgængelige model: Claude Opus 4.7. Kun få uger efter den begrænsede Mythos Preview (en cyberfokuseret kraftpakke) genvinder Opus 4.7 førertrøjen til produktionsarbejdsbelastninger, mens den bevarer præcis samme pris som Opus 4.6.

Udviklere og virksomheder behøver ikke længere at holde opsyn med de sværeste kodningsopgaver. Brugere rapporterer, at de med ro i sindet overlader “den slags, der tidligere krævede tæt overvågning” til 4.7. Modellen selvverificerer sine outputs, følger instruktioner bogstaveligt og kan køre agentiske forløb i flere timer med færre værktøjsfejl og bedre fejlgendannelse.

Modellen udmærker sig ved:

- Strenge, langvarige opgaver med indbygget selvverifikation (Plan → Udfør → Verificer → Rapportér).

- Bogstavelig instruktionsefterlevelse—ikke længere løse fortolkninger af “overvej” eller “du kunne”.

- Væsentligt bedre vision (op til 2,576 px på længste led ≈ 3.75 MP, mere end 3× forrige opløsning).

- Højere smag og kreativitet i professionelle outputs som grænseflader, slides og dokumenter.

- Forbedret filsystemhukommelse for ægte fler-session autonomi.

Nye funktioner omfatter et xhigh-indsatsniveau (mellem high og max), opgavebudgetter på Platform API og integration med Claude Design-værktøjet. Model-ID’et er nu claude-opus-4-7. Prissætningen er uændret officielt, men forbedret tokeneffektivitet sænker ofte den effektive pris per opgave.

Kerneforbedringer – hvad er faktisk ændret

Avanceret software engineering & agentbaseret kodning

Opus 4.7 skinner på de hårdeste problemer. På en intern kodningsbenchmark med 93 opgaver opnåede den en 13% løft over 4.6 og løste fire opgaver, som hverken 4.6 eller Sonnet 4.6 kunne knække. Rakuten-SWE-Bench viste 3× flere produktionsklare opgaver løst uden menneskelig indgriben. CursorBench (reelle IDE-arbejdsgange) sprang +12 point til 70%.

Den interne 93-opgavers kodningsbenchmark viste et 13% løft og løste fire opgaver, som hverken 4.6 eller Sonnet 4.6 kunne knække. I agentiske arbejdsgange rapporterede Box 2× færre LLM-kald (7.1 vs 16.3) og 30% lavere AI-unit-forbrug for samme output—direkte oversat til besparelser i omkostninger og latenstid.

Hvorfor det betyder noget for udviklere: Du kan nu stole på, at Opus 4.7 håndterer “det sværeste kodningsarbejde”, der tidligere krævede supervision. Den følger instruktioner præcist, verificerer sine egne outputs og genbruger filsystemhukommelse på tværs af sessioner—perfekt til autonom refaktorering over flere dage.

Reelle resultater omfatter:

- Autonom Rust-tekst-til-tale-motor fra én prompt.

- Fix af race conditions og samtidighedsfejl, der stumpe tidligere modeller på Terminal-Bench 2.0 (+4.0 pp).

- 10–15% løft i Factory Droids-opgavesucces med ⅓ færre værktøjsfejl.

- Tocifrede forbedringer i kodekvalitet, testkvalitet og review-præcision (CodeRabbit, Qodo).

4.7 ved lav indsats matcher nu 4.6 ved mellem indsats i kvalitet, så du får mere gjort for samme (eller lavere) tokenforbrug.

Vision & multimodalt spring

Dette er den største enkeltopgradering. Maksimal billedopløsning hopper fra 1.15 MP (1568 px) til 3.75 MP (2576 px på længste led) — en 3.3× pixelstigning med 1:1-koordinatmapping. Ingen flere skalafaktorer for skærmbilleder eller diagrammer.

Resultater:

- Test af visuel skarphed: 98.5% vs 54.5% på 4.6.

- CharXiv-R (uden værktøjer): +13.4 pp; med værktøjer: +13.6 pp.

- Muliggør pixel-perfekte computerbrugsagenter, tæt skærmbilledeanalyse, parsing af kemiske strukturer og UI/UX-designreview.

Agentiske arbejdsgange, pålidelighed & instruktionsefterlevelse

Opus 4.7 introducerer indbygget selvverifikation—modellen planlægger, udfører, verificerer og rapporterer. Dette reducerer dramatisk selvsikre, men forkerte svar på opgaver med lang horisont. Forbedringer i filsystemhukommelse muliggør ægte fler-dages autonomi.

Instruktionsefterlevelse er strengere og mere bogstavelig. Prompter tunet til 4.6’s løsere stil kan kræve gennemgang—formuleringer som “overvej” behandles nu som hårde krav. Det er en fordel for præcisionskritisk arbejde, men kræver promptmigration.

Bemærkning om regressioner: Long-context needle retrieval (MRCR) faldt mærkbart (fx 91.9% → 59.2% ved 256K). Anthropic bemærker, at de udfaser sådanne syntetiske tests til fordel for anvendte GraphWalks-metrikker, hvor reel kodeforståelse forbliver stærk.

Nyt xhigh-indsatsniveau + opgavebudgetter

Opus 4.7 tilføjer xhigh mellem high og max for mere granular kontrol. Claude Code bruger nu som standard xhigh på tværs af planer. Den nye task_budget (public beta) lader modellen spore samlede tokens på tværs af en hel agentisk løkke og afslutte yndefuldt.

Instruktionsefterlevelse, selvverifikation & hukommelse

Opus 4.7 tolker prompts mere bogstaveligt—fremragende til præcision, men gamle, vage prompts kan kræve skarpere formulering. Den udtænker egne verifikationsskridt (Plan → Udfør → Verificer → Rapportér) og genbruger filsystemhukommelse på tværs af fler-session arbejde betydeligt bedre end 4.6. For teams, der bygger persistente agenter, er dette en af de mest nyttige opgraderinger, fordi det reducerer genforklaringer, genindlæsning og genplanlægning.

Tokenizer-opdatering

Ny tokenizer forbedrer kvaliteten, men kan forbruge 1.0–1.35× flere tokens (op til +35%). Endpoint til tokentælling returnerer nu andre tal. Nettoeffekt: højere kvalitet per opgave opvejer ofte stigningen, især ved lavere indsatsniveauer.

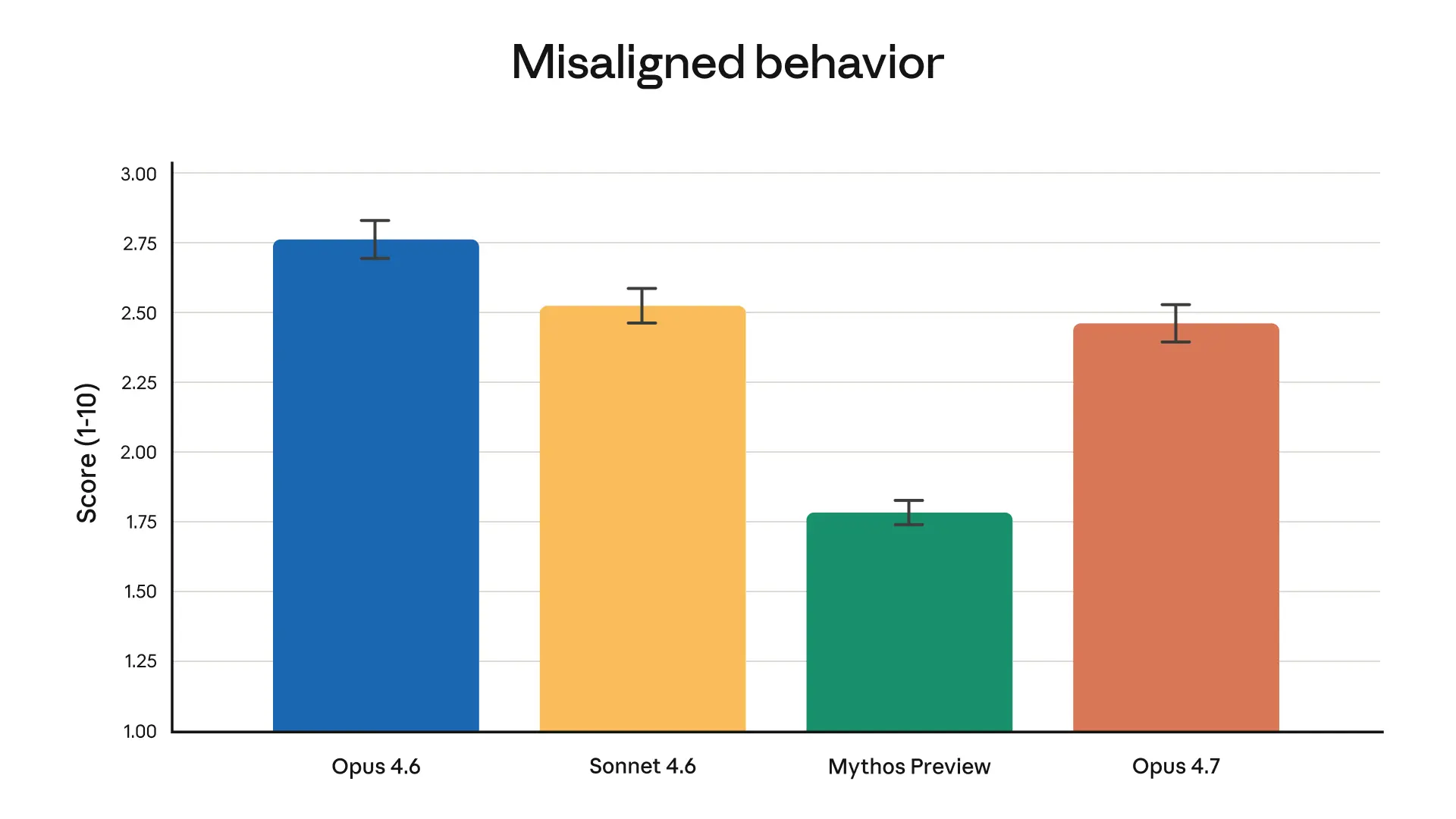

Sikkerhed, tilpasning & cybersikkerhed

Sikkerhedsprofilen ligner 4.6 (lav misalignment) med moderate forbedringer i ærlighed og modstand mod prompt-injektion.

Opus 4.7 leveres med Project Glasswing-sikkerhedsforanstaltninger: realtidsblokering af forbudte/højrisiko cyberanvendelser. CyberGym-score bevidst flad. Misaligned adfærd moderat forbedret over 4.6. Fuld systemrapport findes på Anthropics websted.

Priser, tokeneffektivitet & CometAPI-besparelser

Officielle priser er identiske, men den effektive pris per opgave falder, fordi 4.7 ved lav indsats ≈ 4.6 ved mellem indsats i kvalitet, og højere succesrater betyder færre forsøg. Den nye tokenizer øger inputtokens 0–35% for identisk tekst, men nettoforbrug er ofte gunstigt ved matchet kvalitet.

CometAPI-fordel: Adgang til begge modeller for $4 input / $20 output per million tokens—20% billigere end officielt—plus problemfri skift mellem 500+ modeller (GPT-5.4, Gemini 3.1, etc.) via et enkelt OpenAI-kompatibelt eller Anthropic Messages-endpoint. Ingen nedetid, hvis udbydere ændrer priser. Nul leverandørlåsning. Playground-testning og samlet fakturering gør migration ubesværet.

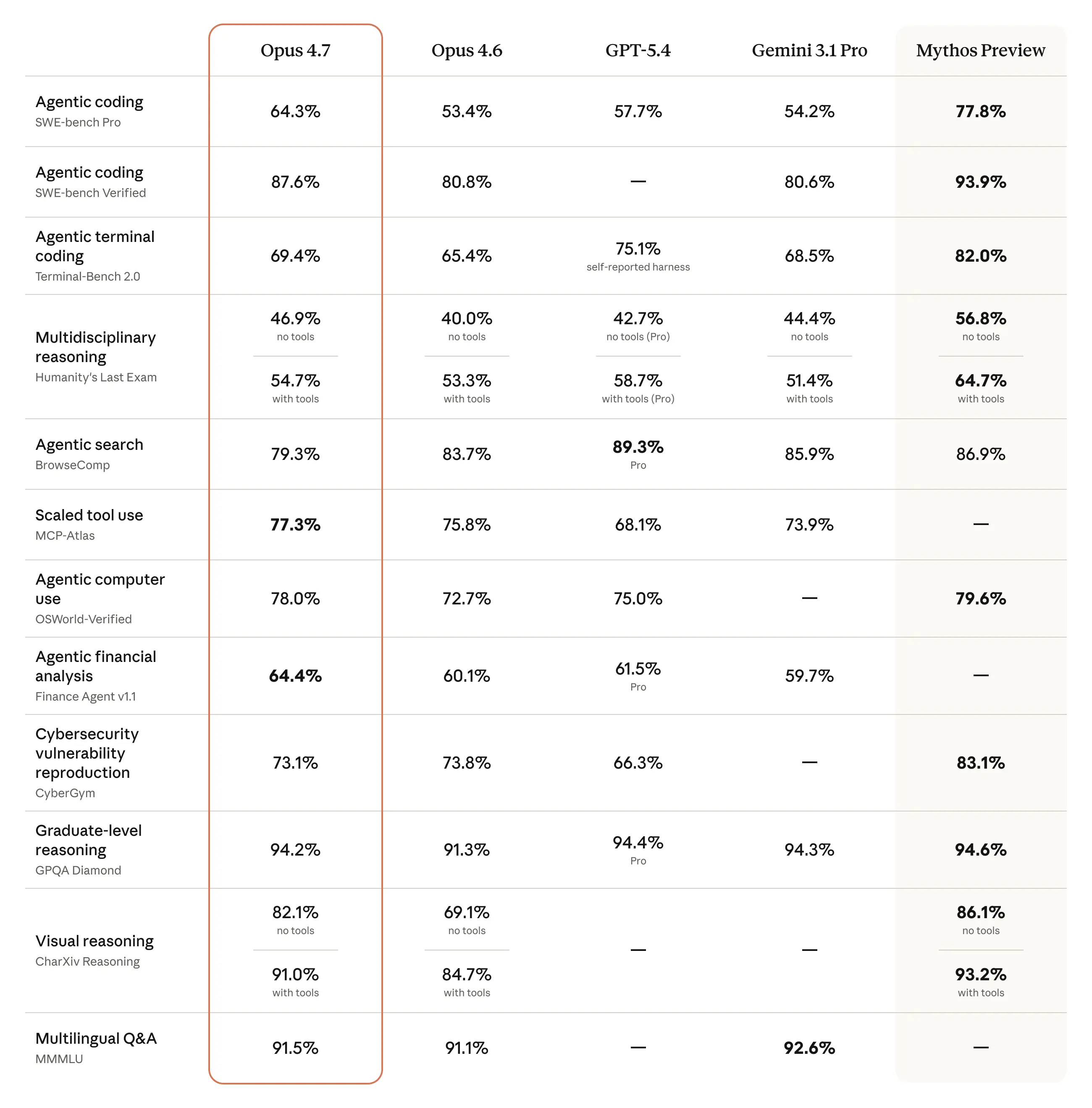

Dybdegående side-by-side-benchmark

Her er den komplette 14-benchmark head-to-head fra Anthropics lanceringsdata (verificeret af partnere):

Kodningsbenchmarks

- SWE-bench Verified: 80.8% → 87.6% (+6.8 pp)

- SWE-bench Pro: 53.4% → 64.3% (+10.9 pp)

- Terminal-Bench 2.0: 65.4% → 69.4% (+4.0 pp)

Agentisk & værktøjsbrug

- MCP-Atlas: 62.7% → 77.3% (+14.6 pp) — største enkelte spring

- OSWorld-Verified: 72.7% → 78.0% (+5.3 pp)

- Finance Agent: 60.7% → 64.4% (+3.7 pp)

Ræsonnering & viden

- GPQA Diamond: 91.3% → 94.2% (+2.9 pp)

- HLE (uden værktøjer): 40.0% → 46.9% (+6.9 pp)

- MMMLU: 91.1% → 91.5% (+0.4 pp)

Vision

- CharXiv-R (uden værktøjer): 68.7% → 82.1% (+13.4 pp)

- CharXiv-R (værktøjer): 77.4% → 91.0% (+13.6 pp)

Regressioner (åbent)

- BrowseComp: 84.0% → 79.3% (–4.7 pp) — afhænger af harness

- CyberGym: 73.8% → 73.1% (–0.7 pp) — bevidst af hensyn til sikkerhed

Intern research-agent-benchmark: 0.715 samlet (delt top-score), med Finance-modulet fra 0.767 til 0.813.

Ydeevne i praksis & anvendelsesområder

Box’ tests af agentiske arbejdsgange viste, at Opus 4.7 fuldførte opgaver med 7.1 LLM-kald vs 16.3 for 4.6 (2.3× færre) og 30% lavere AI Unit-forbrug. Median-latenstid faldt fra 242 s til 183 s.

Enterprisepartnere (Harvey, Databricks, Hebbia, Ramp, Genspark) rapporterer:

- 21% færre fejl i dokumentforståelse.

- Bedre multi-agent-koordinering over timer.

- Tættere integration af slides, regneark og kode.

Hvem bør opgradere med det samme?

- Software engineering-teams, der bruger Cursor/Claude Code.

- Agentbyggere, der har brug for pålidelig autonomi over lang horisont.

- Vision-tunge arbejdsgange (skærmbilleder, diagrammer, UI-review).

- Finans, jura og automatisering af vidensarbejde.

API-ændringer, migrationsguide & kodeeksempler

Bagudinkompatible ændringer (Messages API)

- Extended thinking budgets fjernet → brug

thinking: {"type": "adaptive"}. - Sampling-parametre (

temperature, etc.) accepteres ikke længere → brug prompting. - Thinking-indhold udelades som standard.

- Ny tokenizer kræver luft i

max_tokens.

Migrationsguide + kodeeksempler (CometAPI)

Trin 1: Opdater modelnavn til claude-opus-4-7 (eller CometAPI-alias).

Trin 2: Gennemgå prompts for bogstavelig fortolkning.

Trin 3: Test indsatsniveauer (start med xhigh til kodning).

Trin 4: Brug opgavebudgetter til at sætte et loft på forbrug.

Her er et kørbart Python-eksempel med CometAPI’s Anthropic-kompatible endpoint (virker også med det officielle SDK):

(Python)

import anthropic

import os

client = anthropic.Anthropic(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI sk- key

base_url="https://www.cometapi.com/console/" # CometAPI base

)

message = client.messages.create(

model="claude-opus-4-7", # or "claude-opus-4-6" for comparison

max_tokens=4096,

temperature=0.7,

effort="xhigh", # New level for deep reasoning

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Refactor this legacy Python module into clean, type-hinted, testable code. Follow instructions literally: use Pydantic v2, add comprehensive tests, no external deps beyond stdlib + pydantic. Verify your changes before responding."},

{"type": "image", "source": {"type": "base64", "media_type": "image/png", "data": "iVBORw0KGgoAAAANSUhEUg..."} } # High-res screenshot support

]

}

]

)

print(message.content[0].text)

Demoprompt for selvverifikation (fungerer markant bedre på 4.7):

(tekst):

Plan → Execute → Verify → Report:

1. Analyze the attached codebase.

2. Propose refactors.

3. Implement changes in a new file.

4. Run mental unit tests and edge cases.

5. Only output final verified code if all checks pass.

Kør A/B-tests på jeres egne workloads—de fleste teams ser 20–40% færre iterationer.

Bemærk:

For det første: Den nye tokenizer genererer flere tokens fra samme tekst. Opus 4.7 introducerede en ny tokenizer, der forbedrer, hvordan modellen behandler tekst. Afvejningen er, at samme input vil mappe til flere tokens; det præcise antal afhænger af indholdstypen, men ligger omtrent mellem 1.0 og 1.35 gange.

For det andet: Højere indsatsniveauer muliggør mere omfattende overvejelse, især i multi-turn agentscenarier.

Dette fører til bedre pålidelighed, men også flere outputtokens.

Den officielle løsning tilbyder tre tilgange:

- Justere indsatsniveauet med efficiency-parameteren

- Begrænse budgettet med task budgets

- Sige til modellen at “være mere kortfattet” i prompten.

Kendte begrænsninger og migrationsnoter

- Extended thinking budgets fjernet → brug

thinking: {"type": "adaptive"}.thinking: {type: "enabled", budget_tokens: N}understøttes ikke længere; brug adaptiv tænkning i stedet. - Sampling-parametre (

temperature, etc.) accepteres ikke længere → brug prompting.temperature,top_pogtop_kbør fjernes fra requests ved migration til Opus 4.7. - Modellen beskrives som mere bogstavelig og mere direkte end Opus 4.6, hvilket er nyttigt for præcision, men kan kræve skarpere prompts.

- Ny tokenizer kræver luft i

max_tokens. Anthropic anbefaler at genkontrollere headroom imax_tokens, fordi Opus 4.7 kan producere flere tokens for samme tekst. - Thinking-indhold udelades som standard.

Endelig vurdering & anbefaling

Claude Opus 4.7 er det klare valg til seriøse kodnings-, agentiske eller vision-arbejdsbelastninger i 2026. Gevinsterne er ikke inkrementelle—de er produktionstransformerende. Hvis du er på Opus 4.6, så migrér i denne uge. Kombinationen af højere kvalitet, færre kald og identisk (eller lavere via CometAPI) pris gør det til en no-brainer.

Handlingstrin:

- Test 4.7 i CometAPI’s playground med jeres reelle workloads.

- Opdater én tjeneste først (Cursor eller jeres agent-framework).

- Overvåg tokenforbruget den første uge.

- Skalér med ro i sindet, velvidende at I har samlet, billigere adgang på tværs af 500+ modeller.