Seedance 2.0 er ByteDances næste generation af AI-videogenereringsmodel, officielt lanceret i marts 2026. Den understøtter tekst-, billede-, lyd- og video-input, kan bruge op til 9 billeder, 3 videoklip og 3 lydklip som referencer, og er designet til instruktørniveau-kontrol, bevægelsesstabilitet og fælles lyd- og videogenerering. På Artificial Analysis’ aktuelle blind-afstemte ranglister fører Seedance 2.0 både kategorierne tekst-til-video og billede-til-video uden lyd med Elo-scorer på henholdsvis 1269 og 1351.

Hvad er Seedance 2.0?

Seedance 2.0 er ByteDance Seed’s ny generation af videokreationsmodel. Officielt er den bygget på en samlet multimodal arkitektur til fælles lyd- og videogenerering, der accepterer tekst-, billede-, lyd- og video-input, og den er positioneret som et skaberværktøj med usædvanligt brede reference- og redigeringsmuligheder. Seedance 2.0 er designet til industricertificerede arbejdsprocesser med stærkere fysisk nøjagtighed, realisme, kontrollerbarhed og stabilitet i komplekse bevægelsesscener end den tidligere 1.5-udgivelse. I modsætning til tidligere modeller, der primært fokuserede på tekst-til-video, introducerer Seedance 2.0 en fuldt samlet multimodal genereringspipeline, der muliggør:

- Tekst-til-video-generering

- Billede-til-video-animering

- Video-til-video-redigering

- Lydsynkroniseret output

Dette gør den til en af de mest omfattende AI-videokreationsplatforme i 2026.

Hvorfor er det vigtigt?

De fleste videogeneratorer er stadig optimeret til en relativt snæver arbejdsgang: prompt ind, klip ud. Seedance 2.0 går videre ved at behandle videogenerering mere som et instruktørens arbejdsrum. Ifølge ByteDance kan den bruge flere referencetyper på én gang, bevare motivkonsistens, følge detaljerede instruktioner mere trofast og endda planlægge kamerasprog på en mere “instruktøragtig” måde. Den kombination er vigtig, fordi de sværeste problemer i videogenerering ikke kun handler om æstetik, men om kontinuitet, bevægelseskoherens og kontrol over, hvad der sker over tid.

Hvad er nyt, og hvilke nøglefunktioner er der i Seedance 2.0?

Samlet multimodal generering

Den vigtigste funktion er modellens evne til at ræsonnere samlet over flere modaliteter. Seedance 2.0 understøtter op til 9 billeder, 3 videoer og 3 lydklip som referencer, sammen med instruktioner i naturligt sprog, og kan generere videoer på op til 15 sekunder. I praksis betyder det, at du ikke kun kan styre motiv og scene, men også bevægelsesstil, kamerabevægelser, special effects og lydsignaler i én genereringsproces.

Instruktørniveau-kontrol

Seedance 2.0 er også bygget op omkring det, ByteDance beskriver som instruktørniveau-kontrol. Skabere kan forme performance, lys, skygge og kamerabevægelse ved hjælp af referencebilleder, lyd og video. Modellen kan bevare stabil motividentitet, reproducere komplekse manuskripter nøjagtigt og vælge kamerasprog på en måde, der afspejler en slags indbygget “klippelogik”. For skabere er det et stort skridt ud over grundlæggende tekst-til-video.

Redigering og forlængelse, ikke kun generering

En anden bemærkelsesværdig opgradering er, at Seedance 2.0 ikke stopper ved generering. Seedance 2.0 tilføjer videoredigering og video-forlængelse, så du kan lave målrettede ændringer i specifikke scener, karakterer, handlinger eller plotpunkter og muliggøre kontinuerlige opfølgende optagelser. Udviklerartiklen forklarer også, at modellen kan bruges til at “fortsætte optagelsen” ved at forlænge et klip i stedet for at starte forfra. Det er vigtigt for workfloweffektivitet, fordi det reducerer behovet for at regenerere en hel scene for blot at rette ét segment.

Bedre håndtering af kompleks bevægelse

Seedance 2.0 er markant stærkere i scener med flere motiver, interaktioner og kompliceret bevægelse. Genereringskvaliteten er forbedret væsentligt fra version 1.5 med bedre fysisk nøjagtighed, realisme og kontrollerbarhed. Seedance 2.0’s brugbarhedsrate i vanskelige bevægelsesscener når et branchemæssigt SOTA-niveau i dens interne evalueringsramme, samtidig med at man anerkender, at der stadig er behov for forbedringer i stabilitet i fine detaljer, realisme og livlighed.

Ydelsesbenchmark

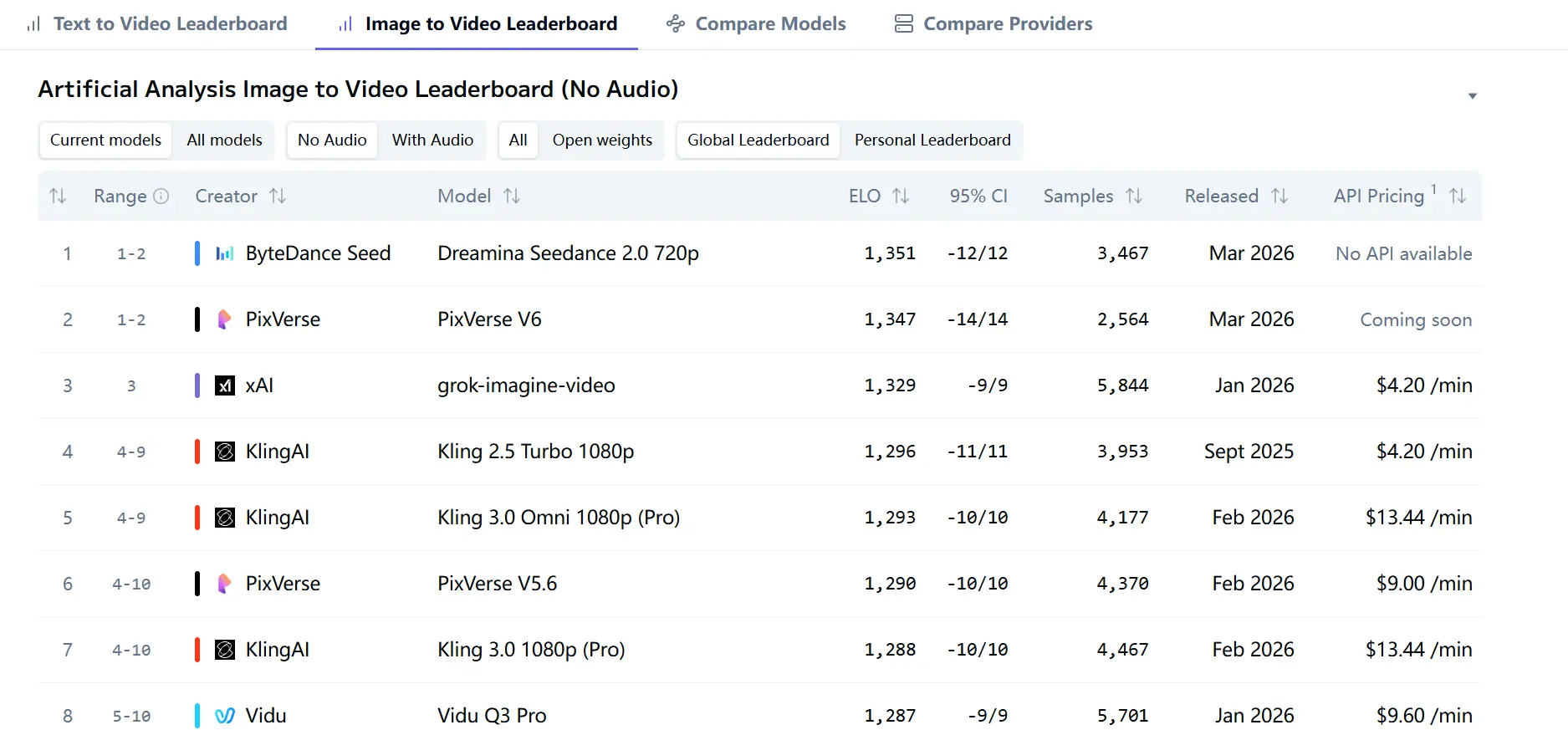

Det stærkeste tredjepartssignal i de gennemgåede kilder er Artificial Analysis Video Arena. På de aktuelle leaderboard-sider fører Dreamina Seedance 2.0 720p Image-to-Video Arena uden lyd med Elo 1351, og Text-to-Video Arena uden lyd med Elo 1269. Leaderboard-siderne angiver også, at rangeringer kommer fra blinde brugerstemmer, hvilket er vigtigt, fordi det måler menneskelig præference i skala frem for kun modelinterne metrikker.

Det er vigtigt, fordi det betyder, at Seedance 2.0 ikke kun markedsføres som kapabel; den foretrækkes aktuelt af brugere i head-to-head sammenligningstests på to store arenaer. I tekst-til-video uden lyd ligger den foran Kling 3.0 1080p (Pro), SkyReels V4, PixVerse V6 og Kling 3.0 Omni 1080p (Pro). I billede-til-video uden lyd slår den knebent PixVerse V6 og grok-imagine-video.

Seedance 2.0 – ydelsesoversigt

| Metrik | Seedance 2.0 |

|---|---|

| Billede-til-video-placering | Top 15 globalt |

| Elo-score | ~1258 |

| Tekst-til-video-placering | Top 25 |

| Pris | ~$1.56/min |

| Styrke | Balancen mellem pris og ydeevne |

👉 Fortolkning:

- Ikke altid nr. 1 i rå kvalitet

- Men en enestående forhold mellem pris og ydeevne

Hvor god er Seedance 2.0 egentlig?

Dets største styrker

Seedance 2.0’s største styrker er klare: den håndterer kompleks bevægelse bedre end mange videomodeller, den understøtter flere referencemodaliteter, den tilbyder redigering og forlængelse, og den fører aktuelt de mest synlige offentlige arena-rangeringer i tekst-til-video og billede-til-video uden lyd. Forbedringer i fysisk nøjagtighed, realisme og kontrollerbarhed er netop de egenskaber, der er afgørende, når en model går fra legetøjsdemoer til professionelle arbejdsgange.

Dets nuværende begrænsninger

Seedance præsenteres ikke af ByteDance som perfekt. Der er stadig plads til at forbedre detaljestabilitet, realisme og bevægelseslivlighed, og der nævnes fortsatte udfordringer med konsistens på tværs af flere motiver, præcision i tekstrendering og komplekse redigeringseffekter.

Min vurdering

Baseret på de gennemgåede kilder ligner Seedance 2.0 mindre en marginal opdatering og mere et seriøst skridt mod et produktionsklart videosystem. Dets stærkeste kort er ikke en enkelt prangende demo, men kombinationen af en bredere multimodal input-stack, direkte redigeringskontroller, klipforlængelse og troværdig offentlig leaderboard-føring. Det gør den til en af de vigtigste videomodeller på markedet i øjeblikket, især for teams der vægter kontrollerbarhed lige så højt som rå filmisk kvalitet.

Seedance 2.0 vs Sora 2 vs Veo 3.1

Sammenligningstabel (2026 AI-videoledere)

| Funktion | Seedance 2.0 | Sora 2 | Veo 3.1 |

|---|---|---|---|

| Udvikler | ByteDance | OpenAI | |

| Inputtyper | Tekst, billede, lyd, video | Tekst | Tekst + billede |

| Lydgenerering | ✅ Nativ | ❌ Begrænset | ✅ |

| Maks. videolængde | 15–20 sek | ~25 sek | ~8 sek (kan forlænges) |

| Redigeringskapacitet | ⭐ Avanceret (referencebaseret) | Moderat | Moderat |

| Elo-placering | Top 15–25 | Høj | Høj |

| Omkostningseffektivitet | ⭐ Høj | Medium | Medium |

| Kommerciel brug | Ja | Begrænset (vandmærke) | Ja |

| Unik styrke | Multimodal redigering | Lang storytelling | Visuel fidelitet |

Vigtigste pointer

- Seedance 2.0 = bedste redigering + multimodal fleksibilitet

- Sora 2 = bedst til lange fortællinger

- Veo 3.1 = bedste billede-til-video-fidelitet

På de aktuelle Artificial Analysis-rangeringer for tekst-til-video ligger Seedance 2.0 720p foran både Veo 3.1 og Sora 2 Pro i kategorien uden lyd. Det afgør ikke alle kvalitetsdebatter, fordi modellerne adskiller sig i arbejdsgang, sikkerhedsbegrænsninger og produktpakning, men det viser, at Seedance 2.0 har bevæget sig op i samme topniveau som de mest synlige vestlige tilbud.

Seedance 2.0’s mest åbenlyse fordel er bredden i input. ByteDance siger, at den kan behandle tekst, billede, lyd og video samlet og kan bruge op til 9 billeder, 3 videoer og 3 lydklip på én gang. OpenAI’s Sora 2-dokumentation angiver derimod tekst og billede som input og video plus lyd som output med adgang via Sora-appen og sora.com; Sora 2 Pro er også tilgængelig for ChatGPT Pro-brugere på nettet. Googles Veo 3.1 ligger et sted midt imellem: den er bygget omkring billedstyret skabelse og lydrig videogenerering med op til 3 referencebilleder, scene-forlængelse og kontrol over første og sidste frame.

Sådan får du adgang, og hvor du kan sammenligne

Hvis du vil tilgå Sora 2, Veo 3.1 og xx samtidig på én platform, anbefaler jeg CometAPI. CometAPI's Playground giver direkte videogenerering ved kun at bruge en simpel kommando eller nogle referencebilleder. Hvis du vil konfigurere din egen videogenererings-API programmatisk, er CometAPI endnu mere værd at overveje. Den tilbyder API’er til Sora 2, Veo 3.1 m.fl. og er i øjeblikket prissat med 20% rabat.

Sådan bruger du Seedance 2.0 med CometAPI

Tekst-til-video-generering

Skriv en beskrivelse af din scene. Jo mere specifik, desto bedre — inkluder kamerabevægelser, lys, stemning og stil. Seedance 2.0’s stærke prompt-adhærens betyder, at outputtet ligger tæt på din intention, hvilket gør den pålidelig til indholdsproduktion frem for trial-and-error.

I CometAPI Playground kan du indtaste prompts direkte og generere videoer med Seedance 2.0-modellen. Dette er især nyttigt til sociale medier (Reels, TikTok, YouTube Shorts), brandvideoer og korte narrative klip.

Sådan fungerer det:

- Åbn CometAPI

- Vælg modellen Seedance 2.0

- Indtast din prompt

- Juster parametre (varighed, opløsning, billedformat)

- Kør genereringsjobbet og vent på outputtet

Billede-til-video med CometAPI

Upload et statisk billede — som et produktfoto, en konceptillustration eller en designmockup — og brug Seedance 2.0’s billede-til-video-muligheder via CometAPI til at animere det.

Resultatet er glidende, kontekstbevidst bevægelse genereret ud fra dit visuelle input. Dette er ideelt for teams, der allerede har designaktiver og vil omsætte dem til video uden en fuld produktionsworkflow.

Sådan gør du:

- Brug

input_reference(eller det tilsvarende filupload-felt i Playground) - Tilføj en bevægelsesfokuseret prompt, der beskriver, hvordan scenen skal bevæge sig

Eksempel på prompt:

“Kameraet glider langsomt ind mod produktet, blødt studielys, subtile refleksioner, premium reklamefølelse”

Lyd- og videogenerering i ét gennemløb

I stedet for først at generere video og derefter separat tilføje lyd understøtter CometAPI Seedance 2.0’s native pipeline til fælles lyd- og videogenerering.

Ved at beskrive både det visuelle og lyden i en enkelt prompt kan du generere synkroniseret video og lyd i ét trin. Dette giver mere sammenhængende og intentionelle resultater og reducerer samtidig redigeringstiden.

Eksempel på prompt:

“En fredelig strand ved solopgang, blide bølger ruller ind, varm gylden belysning, blød ambient musik med havlyde”

Output omfatter:

- Genereret video

- Synkroniseret baggrundslyd

- Naturligt afstemt timing og stemning

Hvorfor bruge CometAPI til Seedance 2.0

- Direkte adgang via API eller Playground

- Nem parameterkontrol (varighed, opløsning, format)

- Understøtter både tekst-til-video og billede-til-video arbejdsgange

- Indbygget jobhåndtering til asynkron videogenerering

Konklusion

Seedance 2.0 ligner et ægte spring i AI-videogenerering: et multimodalt system, der kombinerer tekst-, billede-, lyd- og video-input; en leaderboard-leder i både tekst-til-video og billede-til-video; og en model bygget til instruktørstil-kontrol frem for tilfældig legetøjsbrug. Hvis du kun går op i rå oplevet kvalitet, siger den aktuelle evidens, at den er exceptionel.

Begynd at skabe med Seedance 2.0 på CometAPI i dag.