Die Entwicklererfahrung mit der Videoanalyse von ChatGPT stößt oft an eine Wand: Direkte YouTube-Links schlagen fehl, und MP4-Uploads führen zu „halluzinierten“ Zusammenfassungen, die visuelle Nuancen verfehlen. Das ist kein Bug — es ist eine architektonische Einschränkung. ChatGPT streamt keine Videos; es verarbeitet Sequenzen aus extrahierten Frames und Transkripttext. Sie haben also versucht, eine MP4-Datei hochzuladen, was auch irgendwie funktionierte. Die Zusammenfassung erwähnte das Audiotranskript, verfehlte aber den visuellen Witz in der dritten Szene, der das ganze Video verständlich machte.

ChatGPT kann Videos analysieren — aber nicht, indem es sie tatsächlich anschaut

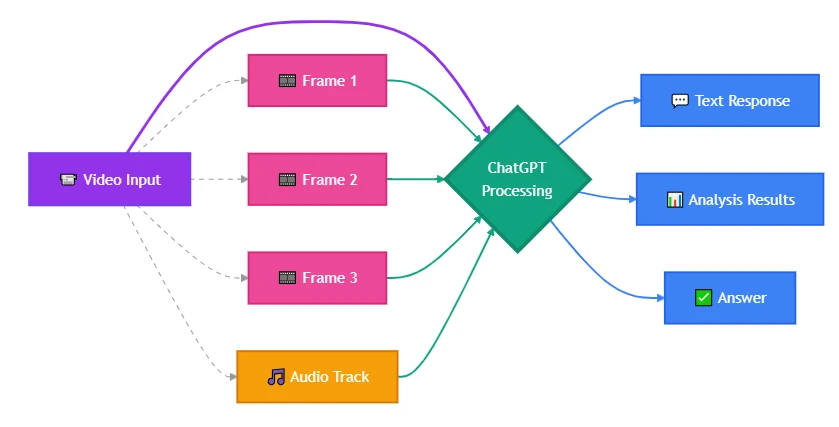

So läuft es tatsächlich: ChatGPT „schaut“ Videos nicht so, wie Sie es tun. Es drückt nicht auf Play, streamt den Inhalt und beobachtet Bewegungen über die Zeit. Stattdessen zerlegt es das Video in Bausteine, die es bereits beherrscht — Standbilder und Texttranskripte — und schließt dann aus diesen Teilen. Das Modell sieht Ihr Video wie ein Fotoalbum mit Sprechertext, nicht als kontinuierliche Erfahrung. Deshalb hat es die gesprochene Erklärung erfasst, aber die visuelle Pointe verpasst: Der Frame mit dem Witz war wahrscheinlich nicht in der Stichprobe.

Wenn jemand fragt „Kann ChatGPT Videos anschauen?“, meint er in der Regel eine von zwei Fragen: Kann es visuelle Inhalte wie ein menschlicher Beobachter streamen oder kann es Bedeutung aus Videodaten extrahieren und analysieren — Szenen, Dialoge, Zeitstempel, Aktionen auf dem Bildschirm? Funktional lautet die Antwort auf die zweite Frage ja, mit Einschränkungen, die bestimmte Anwendungsfälle vollständig aushebeln. Moderne ChatGPT-Varianten verarbeiten Video, indem sie es als Stichproben von Frames in Kombination mit Audiotranskription behandeln — entweder durch automatische Extraktion in der Weboberfläche oder indem sie vom Benutzer bereitgestellte Frames über die API annehmen. Das funktioniert für Zusammenfassungen, Szenenbeschreibungen und Textextraktion. Es versagt bei Bewegungsverfolgung, zeitkritischer Analyse oder allem, was erfordert, dass das Modell „sieht“, was zwischen den Frames passiert.

Die meisten Leitfäden begnügen sich damit, die Existenz der Fähigkeit zu bestätigen, ohne zu erklären, warum Ihre konkrete Implementierung nicht funktionierte — oder welche alternative Eingabemethode geeignet gewesen wäre.

ChatGPT Videofunktionen: Was das Modell tatsächlich sieht

ChatGPT lädt keine MP4-Datei und scrubbt sie Frame für Frame. Es hat eine Vision-Fähigkeit — die Fähigkeit, statische Bilder zu analysieren — und Audiotranskription über die Whisper-Integration. Wenn Sie ein Video über die ChatGPT-Web- oder Mobile-Oberfläche einreichen, extrahiert das System Keyframes, transkribiert die Audiospur separat und übergibt beides dem Modell als getrennte Eingaben. Das Modell beschreibt dann, was es in diesen Frames „gesehen“ und im Transkript „gehört“ hat.

Aus Ihrer Perspektive wirkt es wie Videoverständnis. Aus Sicht des Modells ist es Bildanalyse plus Textverarbeitung. Diese architektonische Unterscheidung bestimmt, welche Anwendungsfälle funktionieren und welche nicht.

Wenn Ihr Video auf Bewegung, subtilen Veränderungen zwischen Frames oder präzisem Timing beruht — etwa um genau zu erkennen, wann ein Objekt den Frame betritt, oder um nachzuverfolgen, wie sich ein UI-Element animiert — wird ein Keyframe-basierter Ansatz das verpassen. ChatGPT erkennt keinen zweisekündigen visuellen Hinweis, der zwischen den Stichproben liegt. Es wird auch keine Objekte über die Zeit verfolgen, es sei denn, Sie strukturieren die Eingabe explizit so, dass eine Abfolge erkennbar ist.

Aktuelle ChatGPT-Videofunktionen (Stand Anfang 2026):

- Bildbasierte Videoanalyse: Akzeptiert Videodateien oder extrahierte Frames; interpretiert visuelle Inhalte aus Stichprobenbildern

- Audiotranskription: Wandelt gesprochene Worte per Whisper in Text um; das Modell kann anschließend das Transkript zusammenfassen oder abfragen

- Szenenbeschreibung: Identifiziert Objekte, Handlungen, Umgebungen und sichtbaren Text in bereitgestellten Frames

- Zeitstempel-basierte Abfragen: Kann auf spezifische Momente Bezug nehmen, wenn Sie Frame-Zeitstempel liefern oder das Video manuell segmentieren

- Textextraktion: Liest On-Screen-Captions, UI-Beschriftungen oder Dokumente, die in den Frames sichtbar sind

Spezifische Frame-Abtastrate und automatisches Keyframe-Auswahlverhalten in der ChatGPT-Weboberfläche — bis zum Wissensstichtag nicht öffentlich dokumentiert

Was nicht enthalten ist:

- Echtzeit-Streaming von Videoeingaben über die API

- Frame-genaue Bewegungsverfolgung oder Objektpersistenz über die Zeit

- Native Unterstützung für Video-Codecs — die gesamte Verarbeitung erfolgt auf extrahierten Frames und Audio

- Automatische Szenenwechselerkennung ohne explizite Nutzeranweisung

Die Videokapazität wird durch Token-Limits und Dateigröße begrenzt, nicht durch die Dauer. Während 5–10 Minuten ein praktischer Richtwert sind, skalieren die tatsächlichen Grenzen dynamisch mit der visuellen Dichte.

Wenn Ihr Anwendungsfall diese Fähigkeiten erfordert, extrahieren Sie entweder die richtigen Frames vorab selbst oder wechseln zu einem Modell mit nativer Videounterstützung. Der nächste Abschnitt erläutert, welche Eingabemethode Sie für Ihr konkretes Szenario verwenden sollten.

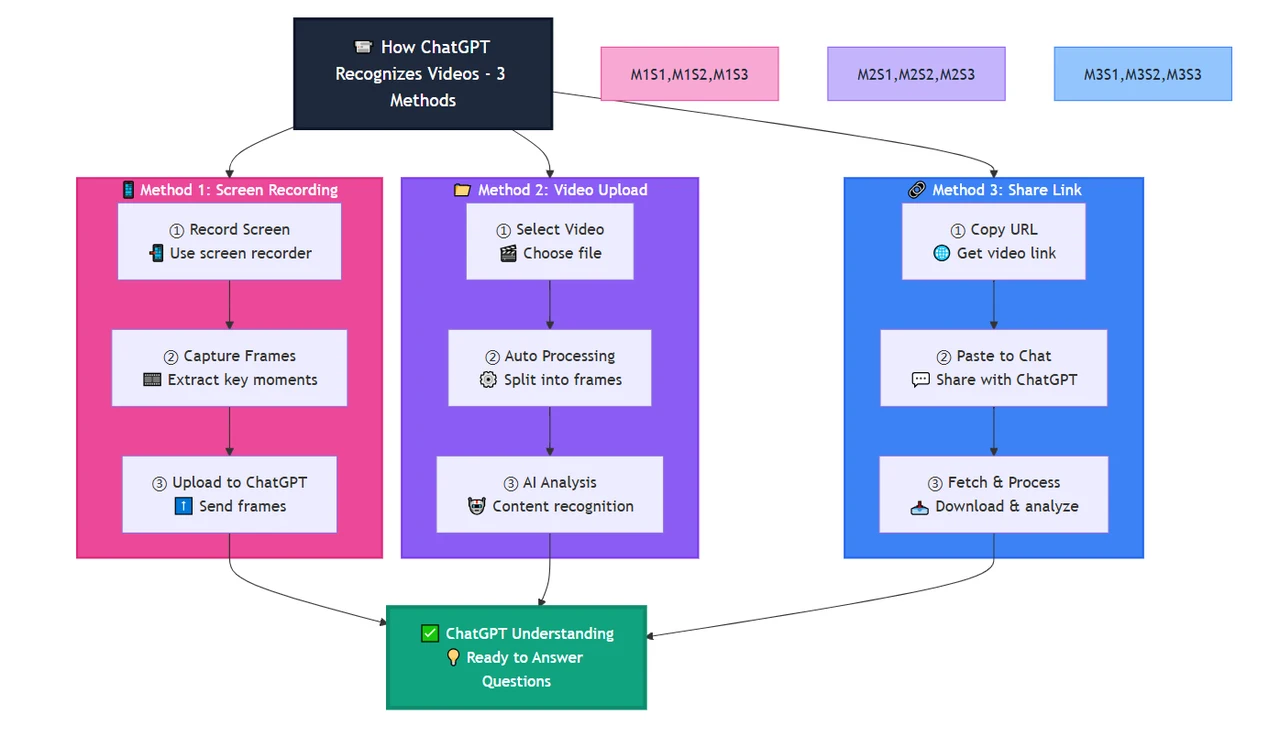

Wie ChatGPT Videos erkennt: Drei praxistaugliche Methoden

Es gibt nicht nur eine Art, Video an ChatGPT zu übergeben. Die von Ihnen gewählte Methode bestimmt, was das Modell analysieren kann und was es verpasst. Die meisten Implementierungsfehler entstehen, weil die bequeme Methode statt der richtigen gewählt wird.

Methode 1: Manuelle Frame-Extraktion + Bild-Upload

Extrahieren Sie die Frames selbst mit ffmpeg oder ähnlichen Tools und laden Sie diese spezifischen Frames dann als Bilder hoch. So behalten Sie die vollständige Kontrolle darüber, was ChatGPT analysiert.

Beispiel-Workflow (bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Diese Methode ermöglicht:

- Den Fokus auf spezifische Momente (Intro, Schlüsselaktion, Schluss) zu legen, ohne Kontext an irrelevante Abschnitte zu verschwenden

- Bewegung zu erfassen, indem Sie aufeinanderfolgende Frames mit Ihrer gewählten Abtastrate hochladen

- Dateigrößenlimits zu umgehen — Bilder sind kleiner als vollständige Videodateien

- Die Frame-Qualität zu erhalten, die bei automatischer Komprimierung leiden könnte

Der Trade-off:

Sie übernehmen die Vorverarbeitung selbst. Für die Analyse Hunderter Videos in großem Maßstab ist Automatisierung erforderlich. Für einmalige Tiefenanalysen oder das Debuggen spezifischer Szenen ist dies die zuverlässigste Methode.

Wann diese Methode sinnvoll ist:

- Sie benötigen framegenaue Analyse bestimmter Momente

- Die kritischen visuellen Informationen sind kurz oder treten zwischen typischen Keyframe-Intervallen auf

- Sie vergleichen visuelle Veränderungen über eine Sequenz hinweg (UI-Zustandswechsel, Animationsframes)

- Sie möchten verifizieren, was das Modell tatsächlich „gesehen“ hat, indem Sie die exakt hochgeladenen Frames prüfen

Methode 2: Direkter Datei-Upload über die ChatGPT-Oberfläche

Die ChatGPT-Web- und Mobile-Apps akzeptieren Video-Uploads direkt im Chat. Ziehen Sie eine MP4- oder MOV-Datei ins Eingabefeld; die Plattform übernimmt Frame-Extraktion und Transkription automatisch.

Was intern passiert:

- Der Dienst sampelt Frames in Intervallen (spezifische Rate nicht dokumentiert; basierend auf Beobachtungen ~1–2 Frames pro Sekunde)

- Audio wird über Whisper oder einen ähnlichen Dienst transkribiert

- Beide Ausgaben werden dem Modell als separate Kontexte übergeben

- Das Modell generiert Antworten basierend auf sichtbaren Frames und dem gehörten Transkript

Diese Methode funktioniert für:

- High-Level-Videokurzfassungen, bei denen Sie keine framegenauen Details benötigen

- Identifikation von Schlüsselobjekten, Personen oder Umgebungen, die über Szenen hinweg bestehen

- Extraktion gesprochener Inhalte oder von Bildschirminhalten (On-Screen-Text), die in mehreren Frames erscheinen

- Schnelle explorative Analysen ohne Vorverarbeitung

Diese Methode scheitert bei:

- Framegenauer Analyse — Sie kontrollieren nicht, welche Frames gesampelt werden

- Längeren Inhalten, die die komfortable Kontextkapazität des Modells überschreiten; ohne strategisches Chunking oder Vorverarbeitung kann die Qualität mit steigender visueller Dichte durch den Token-Verbrauch abnehmen

- Erkennung von Bewegung, Übergängen oder zeitkritischen Inhalten, die den Vergleich aufeinanderfolgender Frames erfordern

- Szenarien, in denen die kritischen visuellen Informationen nur kurz zwischen Stichproben erscheinen

Wenn Sie Kontrolle darüber benötigen, welche Momente analysiert werden, verwenden Sie Methode 1.

Methode 3: YouTube-Link + Transkriptabfrage

Einige ChatGPT-Plugins und Drittanbieter-Tools behaupten, „YouTube-Videos zu analysieren“. Tatsächlich rufen sie die öffentlichen Metadaten und das Transkript des Videos (falls verfügbar) ab und geben diesen Text an ChatGPT weiter.

Das funktioniert, wenn:

- Das Video über automatisch generierte oder vom Nutzer hochgeladene Untertitel verfügt

- Ihre Analyse nur gesprochene Inhalte erfordert, nicht visuelle Informationen

- Das Video öffentlich zugänglich ist (nicht privat, nicht gelistet oder regional beschränkt)

- Sie Vorlesungen, Podcasts oder Interviews zusammenfassen, bei denen die Audioebene den Großteil der Bedeutung trägt

Das funktioniert nicht, wenn:

- Sie visuelle Inhalte analysieren müssen (On-Screen-Demos, Diagramme, Mimik)

- Das Video kein Transkript oder keine Untertitel hat

- Kritische Informationen visuell erscheinen, ohne im Dialog erwähnt zu werden

- Sie mit privaten Videodateien oder Inhalten hinter Authentifizierung arbeiten

Häufiger Fehler: Entwickler erwarten vollständiges Videoverständnis (visuell + Audio), erhalten aber nur eine Transkript-Zusammenfassung. Für inhaltliche Analysen gesprochener Materie ist das in Ordnung. Für die Prüfung von Produktdemos, die Analyse visuellen Designs oder Szenarien, in denen das „Gesehene“ wichtiger ist als das Gesagte, ist es nutzlos.

Das Muster: Methode 2 für schnelle Zusammenfassungen, bei denen Präzision nicht entscheidend ist. Methode 1 für kontrollierte Analysen, wenn spezifische Frames benötigt werden. Methode 3 für Audio-zentrierte Inhalte, bei denen visuelle Informationen nachrangig oder nicht vorhanden sind. Wählen Sie auf Basis dessen, wo die kritischen Informationen Ihres Anwendungsfalls liegen — in Bewegung, in bestimmten Frames oder ausschließlich im Dialog.

ChatGPT-Video-Anwendungsszenarien: Was in der Praxis tatsächlich funktioniert

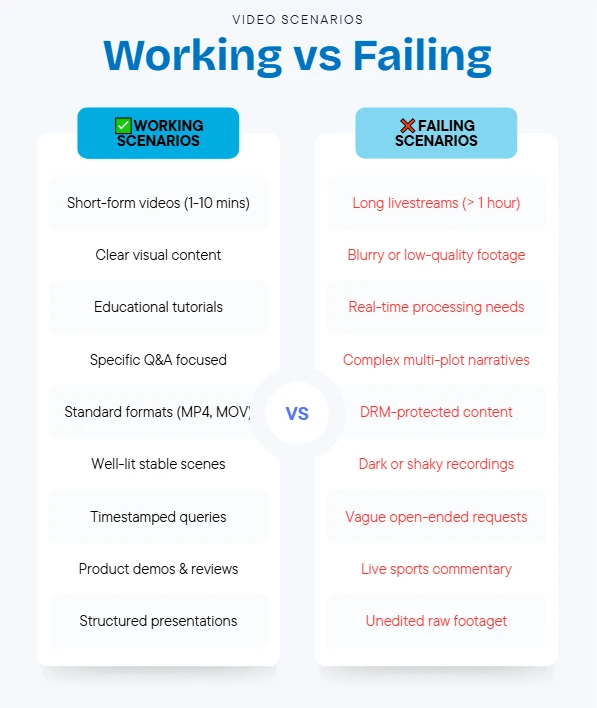

Zu wissen, dass ChatGPT Videokomponenten verarbeiten kann, beantwortet nicht, ob es die richtige Lösung für Ihr Problem ist. Diese Szenarien zeigen, wo die framebasierte Analyse gelingt — und wo die architektonischen Einschränkungen den Anwendungsfall brechen.

Szenario 1: Zusammenfassung von Lehrinhalten

Anwendungsfall: Sie haben ein 10-minütiges Tutorial-Video und benötigen eine strukturierte Zusammenfassung der wichtigsten Schritte, erwähnten Tools und gezeigten visuellen Beispiele.

Warum es funktioniert: Lehrvideos haben typischerweise klare Szenengrenzen, persistenten On-Screen-Text und eine Moderation, die mit den Visuals übereinstimmt. Der Sprecher beschreibt, was er zeigt, während es sichtbar ist. ChatGPT kann die Erklärung transkribieren, Tools oder Diagramme in den gesampelten Frames erkennen und beides in eine strukturierte Ausgabe kombinieren.

Implementierungsansatz: Laden Sie das Video über die ChatGPT-Oberfläche hoch oder extrahieren Sie 8–12 Keyframes an den wichtigsten thematischen Übergängen. Prompt: „Listen Sie die Hauptschritte in diesem Video auf und beziehen Sie sich sowohl auf die Moderation als auch auf sichtbare On-Screen-Texte, Diagramme oder Toolnamen.“

Wo es scheitert: Videos, die auf kontinuierlicher Bewegung beruhen — etwa ein Coding-Screencast, bei dem der Dozent schnell in mehrere Dateien tippt — werden zwischen den Frames fehlende Schritte aufweisen. Sie benötigen höhere Frame-Abtastraten oder konzentrieren sich ausschließlich auf das Audiotranskript.

Praxis-Tipp: Bei Vorlesungs- oder Tutorialinhalten kombinieren Sie den automatischen Upload (für das Transkript) mit manuell extrahierten Frames der 3–5 wichtigsten visuellen Momente. So erhalten Sie sowohl die umfassende Audioabdeckung als auch hochwertige Bilder der Schlüsselkonzepte.

Szenario 2: Analyse einer Produktdemo

Anwendungsfall: Sie prüfen die Produktdemo eines Mitbewerbers und möchten UI-Elemente, Funktionsnamen, Nutzerflows und Preisangaben extrahieren, die auf dem Bildschirm gezeigt werden.

Warum es funktioniert: Produktdemos halten jede Ansicht typischerweise lange genug, damit die Frame-Stichprobe statische UIs erfasst. Text-Overlays, Button-Beschriftungen, Menüstrukturen und Preistabellen bleiben über mehrere Frames sichtbar. Die Vision-Fähigkeit von ChatGPT kann diese Elemente lesen und beschreiben, selbst wenn sie in der Moderation nicht erwähnt werden.

Implementierungsansatz: Extrahieren Sie Frames an den wichtigsten Szenenwechseln (Intro-Folie, Feature-1-Demo, Feature-2-Demo, Preisseite, CTA). Laden Sie diese Frames hoch und prompten Sie: „Identifizieren Sie für jeden Frame alle sichtbaren UI-Elemente, Button-Beschriftungen, Funktionsnamen und alle dargestellten Preis- oder Produktinformationen.“

Wo es scheitert: Demos mit schnellen Bildschirmwechseln, Hover-States, die Informationen nur kurz offenbaren, oder interaktiven Elementen, die nur 1–2 Sekunden gezeigt werden, werden durch die Frame-Stichprobe nicht erfasst. Wenn der Wettbewerber kurz eine Feature-Vergleichstabelle einblendet, verpassen Sie sie, sofern genau dieser Moment nicht gesampelt wurde.

Praxis-Tipp: Scrubben Sie das Video zuerst manuell, um Zeitstempel wichtiger „Reveals“ zu identifizieren. Extrahieren Sie Frames zu genau diesen Zeitpunkten, statt sich auf automatische Abtastintervalle zu verlassen.

Szenario 3: Meeting- oder Interview-Transkription mit visuellem Kontext

Anwendungsfall: Sie haben einen Kundentermin aufgezeichnet und benötigen sowohl ein Transkript als auch Anmerkungen, wann bestimmte Dokumente, Folien oder Screenshares gezeigt wurden.

Warum es funktioniert: Die Audiotranskription erfasst die gesprochenen Dialoge. Wenn Teilnehmer ihre Bildschirme teilen oder Dokumente in die Kamera halten, erscheinen diese in den gesampelten Frames. ChatGPT kann neben dem Transkript anmerken: „Gegen [Zeitstempel] war ein Vertragsdokument auf dem Bildschirm sichtbar“ — nützlich für Protokolle, die sich auf visuelle Unterlagen beziehen.

Implementierungsansatz: Laden Sie das Video hoch und prompten Sie: „Transkribieren Sie dieses Meeting und vermerken Sie alle Momente, in denen Dokumente, Präsentationsfolien, Screenshares oder andere visuelle Referenzen erschienen. Beschreiben Sie für jedes visuelle Element, was gezeigt wurde.“

Wo es scheitert: Kurzzeitige Screenshares (unter 5–10 Sekunden) können zwischen den Stichproben liegen. Zu kleiner Text in komprimierten Frames ist nicht lesbar. Für juristische oder Compliance-Fälle, die wortgetreue Genauigkeit der gezeigten Dokumente erfordern, verifizieren Sie die Frame-Qualität und Sampling-Abdeckung, bevor Sie sich auf die Ausgabe verlassen.

Praxis-Tipp: Zeichnen Sie wichtige Meetings in höherer Auflösung auf und extrahieren Sie Frames manuell in Momenten, in denen jemand sagt „Ich zeige Ihnen dieses Dokument“ — ein Hinweis darauf, dass eine visuelle Referenz gleich erscheinen wird.

Szenario 4: Inhaltsmoderation oder Compliance-Prüfung

Anwendungsfall: Sie müssen nutzergenerierte Videos auf verbotene Inhalte prüfen — bestimmte Logos, Textmuster oder visuelle Elemente, die gegen Plattformrichtlinien verstoßen.

Warum es funktioniert: ChatGPT kann Frames auf sichtbaren Text, erkennbare Objekte oder beschriebene Szenen prüfen. Wenn Sie etwa kontrollieren „Zeigt eines dieser Videos ein Wettbewerber-Logo?“, erkennt die Frame-basierte Analyse Logos, die länger als ein bis zwei Sekunden sichtbar sind.

Implementierungsansatz: Extrahieren Sie Frames in regelmäßigen Intervallen (alle 3–5 Sekunden), laden Sie sie hoch und prompten Sie: „Prüfen Sie diese Frames und identifizieren Sie alle, die [spezifisches Logo, Markenname, verbotenes Symbol etc.] enthalten. Beschreiben Sie für jeden Treffer, wo im Frame es erscheint.“

Wo es scheitert: Audio-basierte Verstöße (urheberrechtlich geschützte Musik, verbotene Sprache) erfordern separate Audioanalyse. Bewegungsbasierte Verstöße (verbotene Gesten, Handlungen über mehrere Frames) werden durch Standbildanalyse nicht erkannt. Kurz eingeblendete verbotene Inhalte erscheinen möglicherweise nicht in den gesampelten Frames.

Praxis-Tipp: Kombinieren Sie das visuelle Scanning von ChatGPT mit dedizierten Audio-Fingerprinting-Services und höheren Frame-Abtastraten für risikoreiche Inhaltskategorien. Verwenden Sie ChatGPT als First-Pass-Filter, nicht als einzige Moderationsschicht.

Das Muster über erfolgreiche Szenarien hinweg: Bedeutungsvolle Inhalte liegen in diskreten, stabilen Frames und korrelieren mit Audio- oder Textelementen. Fehler treten auf, wenn kritische Informationen in Bewegung, Timing, Übergängen oder zu kurz erscheinen, um zuverlässig gesampelt zu werden.

Gemini-Videofunktionen vs. Claude-Videofunktionen vs. ChatGPT

Wenn ChatGPTs Frame-Sampling-Architektur nicht zu Ihrem Anwendungsfall passt, evaluieren Sie Alternativen. Gemini und Claude bieten unterschiedliche video-bezogene Fähigkeiten — und diese Unterschiede entscheiden, welches Modell für Ihre Implementierung funktioniert.

Geminis native Videoverarbeitung

Gemini-Modelle unterstützen native Videoeingaben auf API-Ebene. Sie übergeben eine Videodatei direkt, ohne sie vorab in Frames zu zerlegen. Das Modell verarbeitet Video als kontinuierlichen Strom, ermöglicht Bewegungsverfolgung, Szenenwechselerkennung und temporales Schließen, das ChatGPTs Frame-basierter Ansatz nicht leisten kann.

Beispielanwendungsfall, in dem Gemini gewinnt:

Sie müssen erkennen, wann ein bestimmtes Objekt in einem 30-Sekunden-Clip den Frame betritt und wieder verlässt, oder verfolgen, wie sich eine Person durch eine Szene bewegt. Gemini kann Objekte über Frames hinweg verfolgen und über Bewegung schlussfolgern. ChatGPT sieht das Objekt nur in den gesampelten Frames — der Eintritt oder Austritt könnte komplett fehlen.

Trade-offs:

- Geminis native API ist kosteneffizienter als OpenAIs Frame-basiertes Sampling. Durch das Vermeiden linearer Token-Overheads via Kontext-Caching skaliert Gemini besser für Langform-Analysen.

- Die Verarbeitung längerer Videos erzeugt höhere Latenz — das Modell muss die gesamte Datei ingestieren, bevor es antwortet

- Nicht alle Gemini-Varianten unterstützen Videoeingaben; erfordert spätere Gemini-Modelle

- Es gibt Längenlimits, die jedoch großzügiger sind als ChatGPTs kontextbasierte Beschränkungen

Wann Sie Gemini ChatGPT vorziehen sollten:

- Ihr Anwendungsfall erfordert Bewegungsverfolgung, Szenengrenzenerkennung oder Verständnis zeitlicher Zusammenhänge

- Kritische Informationen erscheinen und verschwinden schnell über die Zeit

- Sie analysieren Videos, bei denen der Verlauf der Ereignisse entscheidend ist (Sportaufnahmen, Überwachung, Animationsanalyse)

- Sie möchten auf manuelle Frame-Extraktion verzichten

Claudes aktuelle Videobeschränkungen

Stand Anfang 2026 unterstützen Claude-Modelle keine direkten Videoeingaben über die API. Sie können Bilder (einschließlich manuell extrahierter Video-Frames) hochladen, aber es gibt keine native Videofähigkeit, die mit Gemini vergleichbar wäre.

Was Claude kann:

- Sequenzen hochgeladener Frames analysieren, ähnlich wie bei ChatGPTs manueller Extraktionsmethode (Methode 2)

- Detaillierte Beschreibungen der visuellen Inhalte in jedem Frame liefern

- Über implizite Bewegung oder Änderungen zwischen Frames schlussfolgern, wenn explizit dazu aufgefordert

- Längere Bildsequenzen aufgrund eines erweiterten Kontextfensters verarbeiten (bis zu 1M Tokens in Claude Opus 4.7)

Was Claude nicht kann:

- Videodateien direkt über eine Oberfläche akzeptieren

- Bewegung oder Objekte automatisch über Frames hinweg verfolgen, ohne explizites Frame-für-Frame-Prompting

- Audio transkribieren — erfordert separate Vorverarbeitung mit Whisper oder einem ähnlichen Dienst und anschließende Übergabe des Transkripts an Claude

Wann Sie dennoch Claude wählen würden:

- Ihr Workflow umfasst die Frame-Extraktion ohnehin als Vorverarbeitungsschritt

- Sie analysieren lange Videos, die viele Frames erfordern, und benötigen Claudes größeres Kontextfenster

- Sie vergleichen die Qualität der visuellen Analyse und empfinden Claudes Frame-Beschreibungen für Ihre Domäne als genauer oder detaillierter (z. B. medizinische Bildgebung, technische Diagramme)

- Sie müssen die Analyse von Videoframes mit großen Mengen weiterer Kontextinformationen kombinieren

Fähigkeitsvergleichstabelle

| Feature | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Direkter Upload von Videodateien | ✓ (Web-/App-Oberfläche) | ✓ (API + Web-Oberfläche) | ✗ |

| Native Bewegungsverfolgung | ✗ | ✓ | ✗ |

| Audiotranskription | ✓ (Whisper-Integration) | ✓ (integriert) | ✗ (erfordert externes Tool) |

| Frame-basierte Analyse | ✓ | ✓ (auch kontinuierliche Verarbeitung) | ✓ (nur manuelle Extraktion) |

| Szenenwechselerkennung | ✗ (nur manuell) | ✓ (automatisch) | ✗ |

| Typische Handhabung der Videolänge | ~5-10 min (kontextbegrenzt) | ~1 hour (auflösungsabhängig) | N/A (Frame-Anzahl durch Kontext begrenzt) |

| Bester Anwendungsfall | Schnelle Zusammenfassungen, Frame-Level-Analyse mit etwas Kontrolle | Bewegungsverfolgung, temporales Schließen, kontinuierliches Video | Detaillierte Frame-für-Frame-Beschreibung bei großem Kontextbedarf |

| API-Videounterstützung | ✗ (nur Bilder) | ✓ | ✗ |

Entscheidungsrahmen:

- Wählen Sie ChatGPT, wenn: Sie schnelle Videozusammenfassungen benötigen, kritische Informationen über mehrere Frames hinweg bestehen, Sie mit kurzen Clips (unter 10 Minuten) arbeiten und keine Bewegungsverfolgung brauchen. Am besten für Lehrinhalte, statische Produktdemos, Meeting-Transkription.

- Wählen Sie Gemini, wenn: Ihr Anwendungsfall Bewegungsverfolgung, Szenenwechselerkennung oder temporales Schließen über zeitliche Abläufe erfordert. Kritisch für Überwachungsmaterial, Sportanalyse, Animationsprüfung oder jedes Szenario, in dem „was zwischen den Frames passiert“ wichtig ist.

- Wählen Sie Claude, wenn: Sie ohnehin Frames als Teil der Pipeline extrahieren, viele Frames mit umfangreichem Zusatzkontext analysieren müssen oder Claudes visuelle Beschreibungen für Ihre Domäne präziser finden. Erfordert die meiste Vorverarbeitung, bietet aber das größte Kontextfenster.

Für Entwickler, die mit mehreren Modellen arbeiten, bietet CometAPI eine einheitliche Schnittstelle, um die Videoverarbeitungsqualität über GPT-, Gemini- und Claude-Varianten zu testen, ohne Integrationscode neu zu schreiben — nützlich, wenn Sie die Ausgabequalität vergleichen, bevor Sie sich auf einen Anbieter festlegen.

Die tatsächliche Antwort auf „Kann ChatGPT Videos schauen?“ ist nicht binär. Sie lautet: „Ja, indem es Videos in Formate konvertiert, die es bereits beherrscht — mit Einschränkungen, die bestimmte Anwendungsfälle brechen.“ Die meisten Implementierungsfehlschläge resultieren aus architektonischen Fehlanpassungen, nicht aus Fähigkeitslücken. Das Modell funktioniert genau wie entworfen; die Entwickler haben nur ein anderes Design erwartet.

Wenn Sie Videoanalysefunktionen im großen Maßstab aufbauen, testen Sie Ihren Workflow zuerst an Edge-Cases: Laden Sie dasselbe Video per Direktdatei, mit manuell extrahierten Frames und nur mit Transkriptmethode hoch. Vergleichen Sie die Ausgaben. Die Methode, die das kritische Signal Ihres Anwendungsfalls erfasst — nicht die, die sich am schnellsten implementieren lässt — übersteht den Produktivbetrieb.

Bevor Sie sich für ChatGPT bei Video entscheiden:

- Ermitteln Sie, ob Ihre kritischen Informationen in stabilen Frames, in Bewegung oder im Audio liegen

- Testen Sie die Frame-Sampling-Abdeckung, indem Sie Frames in Ihren erwarteten Intervallen manuell extrahieren

- Verifizieren Sie, dass On-Screen-Text bei Ihrer Videoauflösung nach Komprimierung lesbar ist

- Bestätigen Sie, dass Ihre Videolänge innerhalb praktischer Kontextgrenzen für Ihren Abonnement-Tarif liegt

- Halten Sie einen Fallback bereit für Inhalte, die nur kurz oder zwischen Stichproben erscheinen

Für Entwickler, die mehrere KI-Anbieter für Videoworkloads evaluieren, bietet CometAPI eine einheitliche Playground-Umgebung, um ChatGPT, Gemini und Claude mit denselben Videoeingaben zu testen — so können Sie Ausgabequalität, Latenz und Kosten vergleichen, bevor Sie anbieterspezifische Integrationen bauen.

FAQ – Leitfaden zur KI-Videoanalyse

Schnelle Antworten auf häufige Fragen zur KI-Videoanalyse.

Kann ChatGPT Videos analysieren?

Ja, ChatGPT (GPT-4o und spätere) kann Videos analysieren, indem es Frames (~1 pro Sekunde) sampelt und Audio transkribiert. Es funktioniert gut für Meeting-Zusammenfassungen, Textextraktion aus Folien und das Identifizieren von Objekten. Es tut sich jedoch schwer mit Bewegungsverfolgung, Videos über 10 Minuten und Echtzeit-Streaming.

Wie lade ich Videos bei ChatGPT hoch?

Direkter URL-Upload (empfohlen): Laden Sie über eine öffentliche URL hoch für eine schnelle Analyse. Am besten für Videos unter 10 Minuten.

Manuelle Frame-Extraktion: Extrahieren Sie spezifische Frames für präzise Kontrolle. Am besten, wenn Sie bestimmte Momente analysieren oder Token-Kosten reduzieren möchten.

Was ist die maximale Videolänge, die ChatGPT verarbeiten kann?

ChatGPT verarbeitet zuverlässig Videos bis zu 5–10 Minuten. Darüber hinaus müssen Sie das Video segmentieren oder zu Gemini 2.5 Pro wechseln, das Videos bis zu 60 Minuten nativ unterstützt.

Was sind die Einschränkungen der Videoanalyse von ChatGPT?

- Kann keine kontinuierliche Bewegung verfolgen (Sport, Tanz)

- Unpräzise Zeitstempel (±1 Sekunde Genauigkeit)

- Verpasst Inhalte, die weniger als 1 Sekunde erscheinen

- Praktische Grenze bei 10 Minuten

- Keine Unterstützung für Echtzeit-Streaming

- Schwierigkeiten bei niedriger Qualität oder dunklen Videos

- Schwach bei zeitlichen Ursache-Wirkungs-Schlüssen *

Soll ich für Videoanalyse ChatGPT oder Gemini verwenden?

Verwenden Sie ChatGPT für:

- Videos unter 10 Minuten

- Überlegene Textschlüsse nach der Videoanalyse

- Frame-Level-Analyse (Folien, Screenshots)

Verwenden Sie Gemini für:

- Videos von 10–60 Minuten Länge

- Bewegungsverfolgung und Bewegungsanalyse

- Aufgaben mit temporalem Schließen

- Sport-, Tanz- oder Überwachungsmaterial *

Kann Claude Videos analysieren?

Nein, Claude unterstützt keine direkten Videoeingaben. Sie können jedoch Frames aus Videos extrahieren und mit Claude analysieren, das überlegene Textschlüsse und ein großes Kontextfenster für lange Analysen bietet.

Wie viel kostet Videoanalyse?

Die Kosten variieren je nach Modell und Videolänge:

- ChatGPT 4o: ~$0.05 pro Minute

- Gemini 2.5 Pro: ~$0.04 pro Minute

CometAPI bietet Startguthaben für neue Nutzer.