Claude Opus 4.7, veröffentlicht am 16. April 2026, ist ein bedeutendes Upgrade gegenüber Opus 4.6 in den Bereichen Coding, agentische Workflows, Vision und Befolgen von Anweisungen. Es erzielt +6.8pp auf SWE-bench Verified (87.6% vs 80.8%), +10.9pp auf SWE-bench Pro (64.3% vs 53.4%), +12pp auf CursorBench (70% vs 58%) und liefert 3,3× höhere Bildauflösung mit Selbstverifikationsschleifen, die Halluzinationen bei langen Aufgaben reduzieren. Die offiziellen Preise bleiben identisch ($5/$25 pro eine Million Token), aber 4.7 mit geringem Aufwand erreicht die Qualität von 4.6 mit mittlerem Aufwand, was die realen Kosten senkt.

Auf CometAPI erhalten Sie beide Modelle (Claude Opus 4.7 und Opus 4.6) für $4 Input / $20 Output mit OpenAI-kompatiblen Endpunkten und ohne Vendor-Lock-in. Upgraden Sie, wenn Sie produktive Coding-Agenten, komplexe Dokumentanalysen oder Multi-Session-Workflows betreiben—4.7 ist der neue Standard für Frontier-Arbeit.

Claude Opus 4.7 vs Opus 4.6: Kurzer Vergleich

Fazit: Opus 4.7 fühlt sich an wie „Opus 4.6, aber entriegelt und verfeinert“. Es entfernt Beschränkungen, die in 4.6 gelegentlich auftraten (z. B. vorzeitiges Abbrechen von Aufgaben, geringere visuelle Schärfe), und fügt Effizienz durch adaptives Reasoning hinzu. Nutzer berichten, es sei „meinungsfreudiger“ und kollaborativer—wie die Zusammenarbeit mit einem Senior Engineer, der seine eigene Arbeit doppelt überprüft.

Warum Claude Opus 4.7 im Jahr 2026 wichtig ist

Am 16. April 2026 brachte Anthropic still sein bisher leistungsfähigstes allgemein verfügbares Modell heraus: Claude Opus 4.7. Nur wenige Wochen nach der eingeschränkten Mythos Preview (ein cyberfokussiertes Kraftpaket) erobert Opus 4.7 die Krone für Produktions-Workloads zurück—bei exakt gleichen Preisen wie Opus 4.6.

Entwickler und Unternehmen müssen die schwierigsten Coding-Aufgaben nicht mehr babysitten. Nutzer berichten, dass sie Aufgaben „der Sorte, die zuvor enges Monitoring brauchten“ mit Zuversicht an 4.7 übergeben. Das Modell verifiziert Ausgaben selbst, folgt Anweisungen buchstabengetreu und hält mehrstündige agentische Läufe mit weniger Tool-Fehlern und besserer Fehlerbehebung durch.

Das Modell glänzt bei:

- Strengen Langläufer-Aufgaben mit eingebauter Selbstverifikation (Plan → Execute → Verify → Report).

- Wörtlicher Befolgung von Anweisungen—keine lockeren Interpretationen von „consider“ oder „you might“ mehr.

- Deutlich besserer Vision (bis zu 2,576 px lange Kante ≈ 3,75 MP, über 3× frühere Auflösung).

- Höherem Geschmack und Kreativität in professionellen Outputs wie Interfaces, Folien und Dokumenten.

- Verbesserter Dateisystem-Erinnerung für echte Multi-Session-Autonomie.

Neue Features umfassen ein xhigh Effort-Level (zwischen high und max), Task-Budgets auf der Platform API und die Integration des Claude Design Tools. Die Modell-ID lautet jetzt claude-opus-4-7. Die Preise bleiben offiziell unverändert, aber Effizienzverbesserungen bei Token senken häufig die effektiven Kosten pro Aufgabe.

Kernfähigkeits-Verbesserungen – Was sich tatsächlich geändert hat

Fortgeschrittene Software-Engineering- und agentische Coding-Fähigkeiten

Opus 4.7 glänzt bei den härtesten Problemen. Auf einem internen Coding-Benchmark mit 93 Aufgaben erzielte es einen 13%igen Zuwachs gegenüber 4.6 und löste vier Aufgaben, an denen weder 4.6 noch Sonnet 4.6 scheiterten. Rakuten-SWE-Bench zeigte 3× mehr produktionsreife Aufgaben ohne menschliches Eingreifen. CursorBench (reale IDE-Workflows) sprang +12 Punkte auf 70%.

Der interne 93-Aufgaben-Coding-Benchmark zeigte einen Zuwachs von 13% und löste vier Aufgaben, die weder 4.6 noch Sonnet 4.6 knacken konnten. In agentischen Workflows berichtete Box von 2× weniger LLM-Aufrufen (7.1 vs 16.3) und 30% geringerer AI-Unit-Nutzung für den gleichen Output—was direkt Kosten- und Latenzgewinne bedeutet.

Warum das für Entwickler wichtig ist: Sie können Opus 4.7 nun mit „der härtesten Coding-Arbeit“ betrauen, die zuvor Aufsicht brauchte. Es achtet präzise auf Anweisungen, verifiziert seine Ausgaben selbst und nutzt Dateisystem-Erinnerung über Sessions hinweg—perfekt für autonome Refactorings über Tage.

Erfolge aus der Praxis umfassen:

- Autonomer Rust-Text-zu-Sprache-Engine aus einem einzigen Prompt.

- Behebung von Race Conditions und Concurrency-Bugs, die frühere Modelle auf Terminal-Bench 2.0 nicht lösen konnten (+4.0 pp).

- 10–15% Zuwachs in der Factory Droids-Aufgabenerfolgsrate mit ⅓ weniger Tool-Fehlern.

- Zweistellige Verbesserungen bei Codequalität, Testqualität und Review-Genauigkeit (CodeRabbit, Qodo).

4.7 mit geringem Aufwand entspricht nun der Qualität von 4.6 mit mittlerem Aufwand, sodass Sie mehr für die gleichen (oder geringeren) Token-Ausgaben erreichen.

Vision & Multimodaler Sprung

Dies ist das größte Einzel-Upgrade. Die maximale Bildauflösung springt von 1,15 MP (1568 px) auf 3,75 MP (2576 px an der langen Kante)—ein 3,3× Pixelzuwachs mit 1:1-Koordinatenmapping. Keine Skalierungsfaktoren-Mathematik mehr für Screenshots oder Diagramme.

Ergebnisse:

- Visuelle-Schärfe-Benchmark: 98.5% vs 54.5% auf 4.6.

- CharXiv-R (ohne Tools): +13.4 pp; mit Tools: +13.6 pp.

- Ermöglicht pixelgenaue Computer-Use-Agenten, dichte Screenshot-Analysen, Parsing chemischer Strukturen und UI/UX-Design-Reviews.

Agentische Workflows, Zuverlässigkeit & Befolgen von Anweisungen

Opus 4.7 führt native Selbstverifikation ein—das Modell plant, führt aus, verifiziert und berichtet. Dies reduziert dramatisch selbstsichere, aber falsche Antworten bei langwierigen Aufgaben. Verbesserungen der Dateisystem-Erinnerung ermöglichen echte Autonomie über mehrere Tage.

Die Befolgung von Anweisungen ist strenger und wörtlicher. Für 4.6 abgestimmte, lockerere Prompts benötigen ggf. ein Audit—Formulierungen wie „consider“ werden nun als harte Anforderungen behandelt. Das ist für präzisionskritische Arbeit ein Vorteil, erfordert aber Prompt-Migration.

Hinweis zu Regressionen: Long-Context-Needle-Retrieval (MRCR) fiel deutlich (z. B. 91.9% → 59.2% bei 256K). Anthropic merkt an, dass solche synthetischen Tests zugunsten angewandter GraphWalks-Metriken auslaufen, bei denen das reale Code-Verständnis stark bleibt.

Neues xhigh Effort-Level + Task-Budgets

Opus 4.7 ergänzt xhigh zwischen high und max für feinere Steuerung. Claude Code setzt nun standardmäßig in Plänen auf xhigh. Das neue task_budget (Public Beta) erlaubt dem Modell, die Gesamt-Token über einen gesamten agentischen Loop zu verfolgen und sauber zu beenden.

Befolgen von Anweisungen, Selbstverifikation & Erinnerung

Opus 4.7 interpretiert Prompts wörtlicher—großartig für Präzision, aber alte vage Prompts müssen ggf. geschärft werden. Es entwickelt nun eigene Verifikationsschritte (Plan → Execute → Verify → Report) und nutzt Dateisystem-Erinnerung über Multi-Session-Arbeit deutlich besser als 4.6. Für Teams, die persistente Agenten bauen, ist dies eines der nützlichsten Upgrades, weil Wiedererklären, Reloaden und Neuplanen reduziert werden.

Tokenizer-Update

Der neue Tokenizer verbessert die Qualität, kann aber 1.0–1.35× mehr Token verbrauchen (bis zu +35%). Der Tokenzähl-Endpunkt liefert nun andere Zahlen. Nettoeffekt: Höhere Qualität pro Aufgabe kompensiert die Steigerung oft, insbesondere auf niedrigeren Effort-Levels.

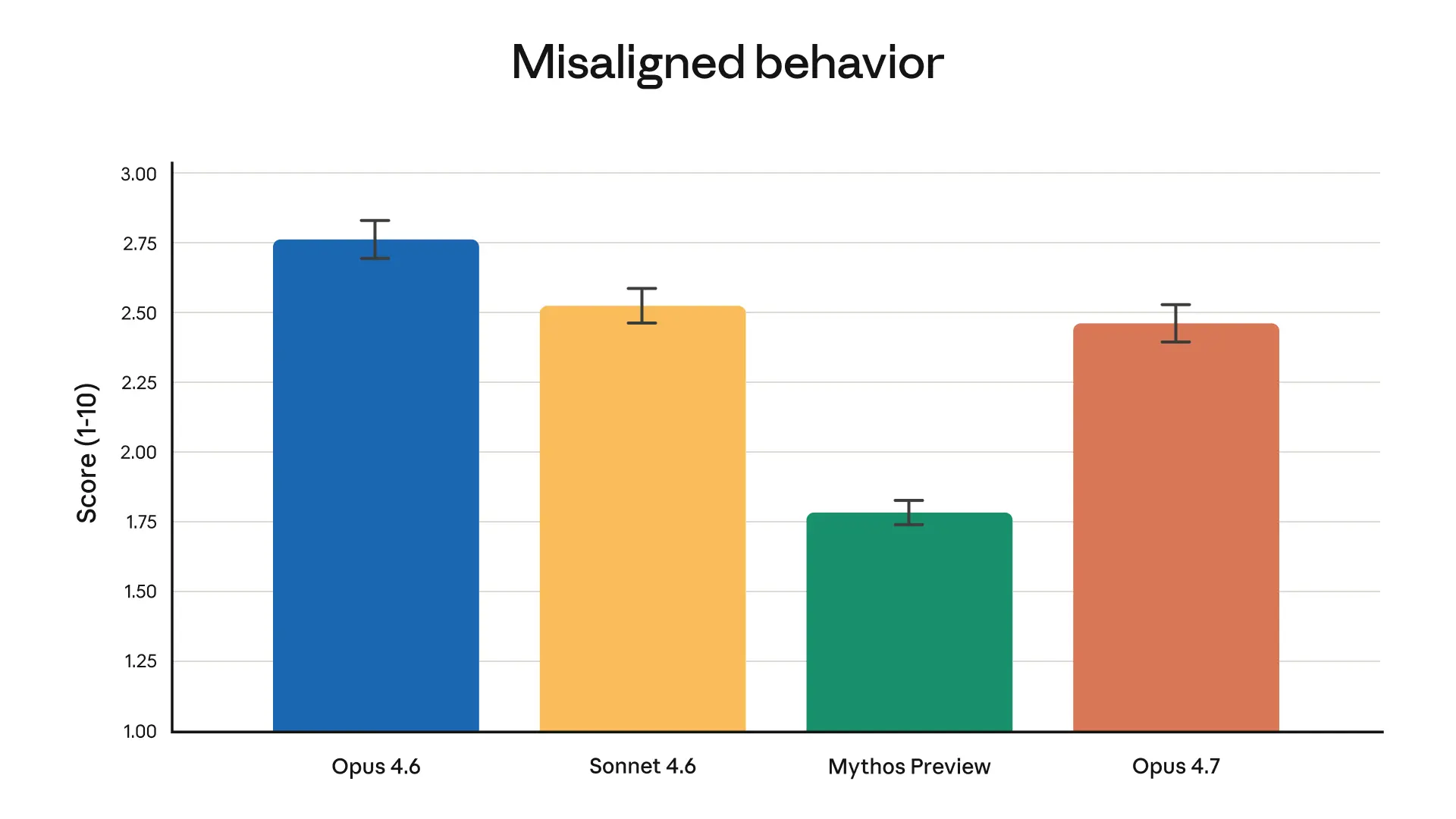

Sicherheit, Alignment & Cybersicherheit

Das Sicherheitsprofil ist ähnlich wie bei 4.6 (geringe Fehlanpassung), mit moderaten Verbesserungen bei Ehrlichkeit und Resistenz gegen Prompt-Injection.

Opus 4.7 liefert Project-Glasswing-Schutzmechanismen: Echtzeit-Blockierung verbotener/hochriskanter Cyber-Nutzungen. CyberGym-Score absichtlich unverändert. Fehlangepasstes Verhalten gegenüber 4.6 moderat verbessert. Vollständige Systemkarte auf der Anthropic-Website verfügbar.

Preise, Token-Effizienz & CometAPI-Ersparnis

Offizielle Preise sind identisch, aber die effektiven Kosten pro Aufgabe sinken, weil 4.7 mit geringem Aufwand ≈ 4.6 mit mittlerem Aufwand entspricht und höhere Erfolgsraten weniger Wiederholungen bedeuten. Der neue Tokenizer erhöht Input-Token um 0–35% für identischen Text, aber die Nettoneutzung ist bei gleicher Qualität oft günstiger.

CometAPI-Vorteil: Zugriff auf beide Modelle für $4 Input / $20 Output pro eine Million Token—20% günstiger als offiziell—plus nahtloses Umschalten zwischen 500+ Modellen (GPT-5.4, Gemini 3.1, etc.) über einen einzigen OpenAI-kompatiblen oder Anthropic Messages-Endpunkt. Keine Ausfallzeiten, wenn Anbieter Preise ändern. Kein Vendor-Lock-in. Playground-Tests und einheitliches Billing machen die Migration mühelos.

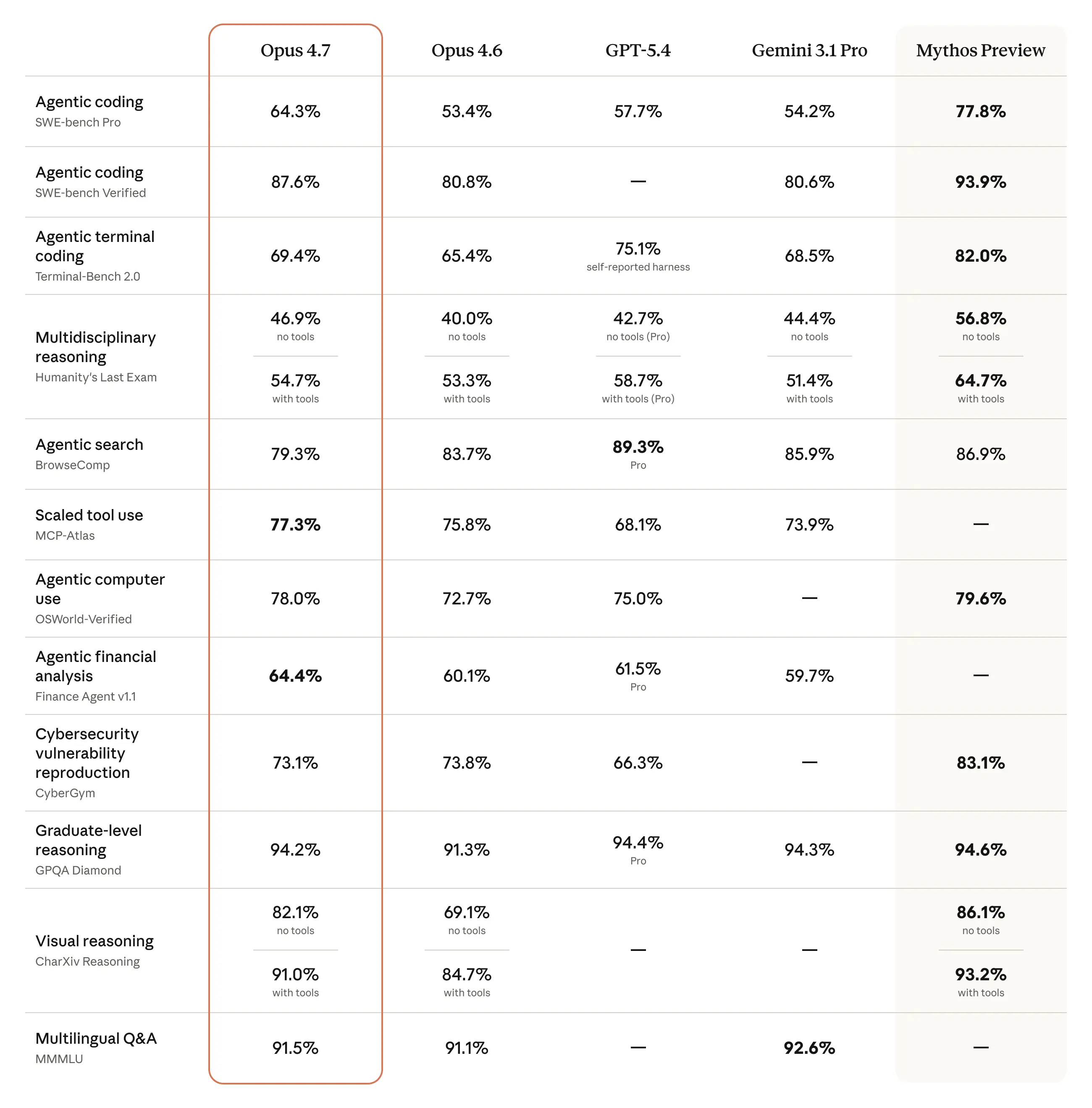

Side-by-Side Benchmark Deep Dive

Hier ist die komplette 14-Benchmark-Gegenüberstellung aus den Launch-Daten von Anthropic (von Partnern verifiziert):

Coding Benchmarks

- SWE-bench Verified: 80.8% → 87.6% (+6.8 pp)

- SWE-bench Pro: 53.4% → 64.3% (+10.9 pp)

- Terminal-Bench 2.0: 65.4% → 69.4% (+4.0 pp)

Agentic & Tool-Use

- MCP-Atlas: 62.7% → 77.3% (+14.6 pp) — größter Einzel-Sprung

- OSWorld-Verified: 72.7% → 78.0% (+5.3 pp)

- Finance Agent: 60.7% → 64.4% (+3.7 pp)

Reasoning & Wissen

- GPQA Diamond: 91.3% → 94.2% (+2.9 pp)

- HLE (ohne Tools): 40.0% → 46.9% (+6.9 pp)

- MMMLU: 91.1% → 91.5% (+0.4 pp)

Vision

- CharXiv-R (ohne Tools): 68.7% → 82.1% (+13.4 pp)

- CharXiv-R (Tools): 77.4% → 91.0% (+13.6 pp)

Regressionen (transparent)

- BrowseComp: 84.0% → 79.3% (–4.7 pp) — harness-sensitiv

- CyberGym: 73.8% → 73.1% (–0.7 pp) — absichtlich für Sicherheit

Interner Research-Agent-Benchmark: 0.715 insgesamt (geteilter Spitzenwert), wobei das Finanzmodul von 0.767 auf 0.813 sprang.

Performance in der Praxis & Anwendungsfälle

Die agentischen Workflow-Tests von Box zeigten, dass Opus 4.7 Aufgaben mit 7.1 LLM-Aufrufen vs 16.3 für 4.6 erledigte (2,3× weniger) und 30% geringerer AI-Unit-Nutzung. Die Latenz sank von median 242 s auf 183 s.

Enterprise-Partner (Harvey, Databricks, Hebbia, Ramp, Genspark) berichten:

- 21% weniger Fehler in der Dokumenten-Analyse.

- Bessere Multi-Agenten-Koordination über Stunden.

- Engere Integration von Foliensätzen, Tabellen und Code.

Wer sollte sofort upgraden?

- Software-Engineering-Teams, die Cursor/Claude Code nutzen.

- Agenten-Builder, die zuverlässige Autonomie über lange Horizonte brauchen.

- Vision-lastige Workflows (Screenshots, Diagramme, UI-Review).

- Finanz-, Rechts- und Wissensarbeitsautomatisierung.

API-Änderungen, Migrationsleitfaden & Codebeispiele

Breaking Changes (Messages API)

- Erweiterte Thinking-Budgets entfernt → nutzen Sie

thinking: {"type": "adaptive"}. - Sampling-Parameter (

temperature, etc.) werden nicht mehr akzeptiert → nutzen Sie Prompting. - Thinking-Content standardmäßig ausgelassen.

- Neuer Tokenizer erfordert Luft nach oben bei

max_tokens.

Migrationsleitfaden + Codebeispiele (CometAPI)

Schritt 1: Modellname auf claude-opus-4-7 aktualisieren (oder CometAPI-Alias).

Schritt 2: Prompts auf wörtliche Interpretation prüfen.

Schritt 3: Effort-Levels testen (für Coding mit xhigh starten).

Schritt 4: Task-Budgets nutzen, um Ausgaben zu begrenzen.

Hier ist ein sofort lauffähiges Python-Beispiel mit dem Anthropic-kompatiblen Endpunkt von CometAPI (funktioniert auch mit dem offiziellen SDK):

(Python)

import anthropic

import os

client = anthropic.Anthropic(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI sk- key

base_url="https://www.cometapi.com/console/" # CometAPI base

)

message = client.messages.create(

model="claude-opus-4-7", # or "claude-opus-4-6" for comparison

max_tokens=4096,

temperature=0.7,

effort="xhigh", # New level for deep reasoning

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Refactor this legacy Python module into clean, type-hinted, testable code. Follow instructions literally: use Pydantic v2, add comprehensive tests, no external deps beyond stdlib + pydantic. Verify your changes before responding."},

{"type": "image", "source": {"type": "base64", "media_type": "image/png", "data": "iVBORw0KGgoAAAANSUhEUg..."} } # High-res screenshot support

]

}

]

)

print(message.content[0].text)

Self-verification demo prompt (works far better on 4.7):

(text):

Plan → Execute → Verify → Report:

1. Analyze the attached codebase.

2. Propose refactors.

3. Implement changes in a new file.

4. Run mental unit tests and edge cases.

5. Only output final verified code if all checks pass.

Führen Sie A/B-Tests mit Ihren eigenen Workloads durch—die meisten Teams sehen 20–40% weniger Iterationen.

Note:

Erstens erzeugt der neue Tokenizer mehr Token aus demselben Text. Opus 4.7 führte einen neuen Tokenizer ein, der die Textverarbeitung des Modells verbessert. Der Trade-off ist, dass derselbe Input auf mehr Token abgebildet wird; die genaue Zahl hängt vom Inhaltstyp ab, liegt aber grob zwischen 1.0 und 1.35.

Zweitens ermöglichen höhere Effort-Levels eine umfassendere Abwägung, insbesondere in Multi-Turn-Agentenszenarien.

Dies führt zu höherer Zuverlässigkeit, aber auch zu mehr Output-Token.

Die offizielle Lösung bietet drei Ansätze:

- Anpassen des Effort-Levels mit dem

efficiencyParameter - Begrenzen des Budgets mit Task-Budgets

- Dem Modell im Prompt sagen, es solle „knapper“ antworten.

Bekannte Einschränkungen und Migrationshinweise

- Erweiterte Thinking-Budgets entfernt → nutzen Sie

thinking: {"type": "adaptive"}.thinking: {type: "enabled", budget_tokens: N}wird nicht mehr unterstützt; verwenden Sie stattdessen adaptives Thinking. - Sampling-Parameter (

temperature, etc.) werden nicht mehr akzeptiert → nutzen Sie Prompting.temperature,top_pundtop_ksollten bei der Migration zu Opus 4.7 aus Requests entfernt werden. - Das Modell wird als wörtlicher und direkter beschrieben als Opus 4.6, was für Präzision hilfreich ist, jedoch schärfere Prompts erfordern kann.

- Neuer Tokenizer erfordert Luft nach oben bei

max_tokens. Anthropic empfiehlt, diemax_tokens-Reserve erneut zu prüfen, da Opus 4.7 für denselben Text höhere Tokenzahlen erzeugen kann. - Thinking-Content standardmäßig ausgelassen.

Abschließendes Urteil & Empfehlung

Claude Opus 4.7 ist der klare Gewinner für jedes ernsthafte Coding-, agentische oder Vision-Workload im Jahr 2026. Die Fortschritte sind nicht inkrementell—sie transformieren die Produktion. Wenn Sie auf Opus 4.6 sind, migrieren Sie diese Woche. Die Kombination aus höherer Qualität, weniger Aufrufen und identischer (oder über CometAPI niedrigerer) Preisgestaltung macht die Entscheidung einfach.

Konkrete Schritte:

- Testen Sie 4.7 im CometAPI-Playground mit Ihren realen Workloads.

- Aktualisieren Sie zunächst einen Dienst (Cursor oder Ihr Agenten-Framework).

- Überwachen Sie die Token-Nutzung in der ersten Woche.

- Skalieren Sie mit der Gewissheit, dass Sie einheitlichen, günstigeren Zugriff auf über 500 Modelle haben.