TL;DR: Der jüngste Release von OpenClaw bietet erstklassige, zukunftskompatible Unterstützung für OpenAIs GPT-5.4 und führt eine „hot-swap-fähige“ Speicherarchitektur ein, mit der OpenClaw-Agenten zur Laufzeit mit minimaler Unterbrechung wechseln können, welches Modell und welcher Speicher-Store aktiv ist. Das ermöglicht Workflows mit großem Kontext (die erweiterten Kontextfenster von GPT-5.4), On-the-fly-Modellspezialisierung sowie Kosten-/Latenzoptimierungen für produktive Agenten. Das Upgrade ist in den OpenClaw-Releases und den zugehörigen Docs verfügbar; die folgenden Beispiele zeigen praktische Konfigurationen, Code-Snippets, Benchmark-Kontext und empfohlene Best Practices.

Was OpenClaws Update tatsächlich ausgeliefert hat (Kurzüberblick)

Am 9. März 2026 hat das Open-Source-Agentenframework, ein OpenAI-nahes Projekt namens OpenClaw, einen großen Core-Release (2026.3.7) veröffentlicht, der erstklassige Unterstützung für GPT-5.4 sowie einen neuartigen hot-swap-fähigen Speicher-Mechanismus in seiner Context Engine hinzufügt. Dieser Release macht aus einem weit verbreiteten experimentellen Agentenframework das, was die Maintainer als „Agent Operating System“ beschreiben — mit dem Ziel, produktionsreife Agenten-Workflows und Modellwechsel für Entwickler und Teams nahtlos zu gestalten.

3 praktische Punkte, die für Agenten-Builder zählen:

- Erstklassige GPT-5.4-Unterstützung — Modellaliase und Providermappings, die es Agenten ermöglichen, GPT-5.4 als primäres Ausführungsmodell auszuwählen (einschließlich Channel-Overrides und modellfester Zuweisungen pro Agent).

- Context Engine & verteiltes Channel-Binding — Verbesserungen dabei, wie OpenClaw lange Kontextfenster aus Speicher, Tool-Ausgaben und Channel-Historie zusammenstellt, sodass Modelle mit hoher Kapazität gut strukturierte Eingaben erhalten.

- Hot-swap-fähige Speicherarchitektur — klarere Memory-Plugin-Schnittstellen und Workflows, sodass Sie Speicher-Backends ersetzen oder Agenten aktualisieren können, ohne die „Identität“ zu verlieren oder den persistenten Zustand zu korrumpieren (der Speicher selbst bleibt die einzige Quelle der Wahrheit). OpenClaws Speicherkonzept (schlichte Markdown-Dateien, indizierte Suche, pluginisierte Retrievals) ist ein Teil dessen, was sicheres Hot-Swapping ermöglicht.

GPT-5.4 — Was GPT-5.4 ist und Durchbrüche in Benchmarks

GPT-5.4 ist das neueste Frontier-Modell von OpenAI, mit starkem Fokus auf professionelle Produktivität (Tabellenkalkulationen, Bearbeitung von Dokumenten und Präsentationen, mehrstufiges Reasoning und Tool-Steuerung). Laut OpenAI und unabhängiger Presseberichterstattung legt der Release den Schwerpunkt auf:

- Erweiterten Kontext: GPT-5.4 führt die nächste Stufe von Kontextfenstern ein, mit experimentellen 1M-Token und verbesserter Langkontexthandhabung über Codex-/Codex-kompatible Endpunkte — Konfigurationshebel wie

model_context_windowundmodel_auto_compact_token_limitwerden für Entwickler bereitgestellt. Das ermöglicht es, deutlich größere Gesprächszustände, Dokumente und Codebasen im aktiven Kontext zu halten. - Höhere Genauigkeit bei Tabellenkalkulation und Reasoning — OpenAI berichtet von deutlichen Verbesserungen bei Spreadsheet-Aufgaben (mittlere Scores ~87 % vs. ~68 % bei GPT-5.2 auf ihrem Banking/Analysten-Benchmark).

- Verbesserte Genauigkeit und Faktentreue: Frühe Reviews und QA zeigen eine ~33 % Reduktion von Halluzinationen und weniger fehleranfällige Outputs im Vergleich zu GPT-5.2, mit bemerkenswerten Zugewinnen beim Dokumententexten und in Tabellenkalkulationen. Reviewer nannten außerdem eine ~18 % Verringerung fehleranfälliger Antworten bei bestimmten Produktivitätsaufgaben.

- Integrierte Computerbedienung und Verbesserungen aus der Codex-Linie — GPT-5.4 umfasst Fähigkeiten aus der Codex-Linie, die Codegenerierung, interaktives Debugging und operative Tool-Steuerung (Maus/Tastatur/Screenshot-Automation in einigen Demos) verbessern. Das macht es besser im Write-Run-Inspect-Patch-Zyklus, der für Agentenschleifen typisch ist.

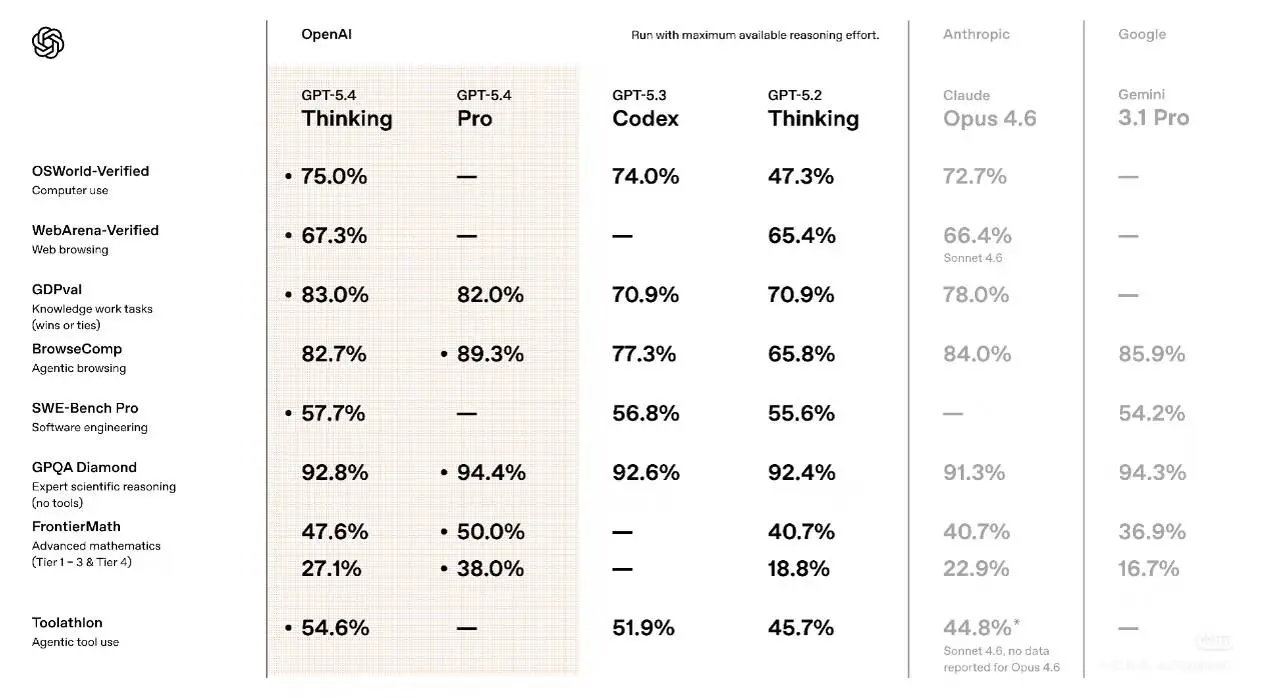

Benchmarks & Vergleichskontext (was die Zahlen bedeuten)

- Spreadsheet-Modellierung: OpenAIs interner Spreadsheet-Benchmark: ~87,3 % mittlerer Score für GPT-5.4 vs. ~68,4 % für GPT-5.2. Das ist die Headline, die der Anbieter nutzt, um aufgabenspezifische Zugewinne zu zeigen.

- Computerinteraktion (OSWorld / agentenartige Tests): Unabhängige Tester und Community-Runs zeigen, dass GPT-5.4 bei Agenten-Interaktionsaufgaben, die Desktop- oder simulierte UI-Manipulationen beinhalten, zulegt und in kleinen Margen mit jüngsten Anthropic-Varianten konkurriert (Unterschiede sind für Agenten relevant, aber nicht zwingend in jeder Workload entscheidend).

Interpretation: GPT-5.4 ist keine „Wunderwaffe“, die alles gewinnt. Es hat klare Stärken bei integrierter Tool-Nutzung, Codeausführungsmustern und Spreadsheet-Reasoning — genau die Workloads, die OpenClaw-Agenten oft ausführen. Für Agenten-Builder ist die Kombination aus verbesserter Executor-Zuverlässigkeit (Codex-Linie) + Planerkompetenz + besserer Langkontexthandhabung hochrelevant.

OpenClaw unterstützt GPT-5.4: Was sich geändert hat und warum es wichtig ist

Der OpenClaw-Release (siehe die Releases-Seite des Projekts) aktualisiert Model-Resolver und Runtime, um zukunftskompatibel mit GPT-5.4s erweitertem Kontext und Tokenlimits zu sein, und fügt die Fähigkeit zum „hot-swap-fähigen“ Speicher hinzu, damit Agenten Speicher-Backends oder Modelle zur Laufzeit wechseln können. Dies geschieht auf drei konkrete Arten: 1) Updates der Modellmetadaten und Resolver, um größere Kontext- und Tokenlimits zu akzeptieren; 2) Änderungen an der Agenten-Runtime, um reibungslose Modellwechsel und Cache-Warm-ups zu orchestrieren; 3) eine Memory-API, die mehrere Memory-Kanäle und Hot-Switch-Trigger erlaubt.

Die Unterstützung von GPT-5.4 in Version 2026.3.7 plus ein hot-swap-fähiges Design für den Speicher bringt zwei praktische, komplementäre Vorteile:

- Einfacher Upgrade-Pfad für Modelle. OpenClaw kann GPT-5.4 jetzt als auswählbare „Runtime“ für Agenten präsentieren, sodass Sie von älteren GPT-5.x-Modellen oder alternativen Anbietern wechseln können, ohne Ihre Agentenlogik neu zu entwickeln. Das OpenClaw-Update deklariert explizit eine stabile GPT-5.4-Integration im Core.

- Hot-Swapping von Speicher. Anstatt einen einzelnen linearen Speichersnapshot zu persistieren, erlaubt OpenClaws Context Engine das Abkoppeln, Austauschen oder Migrieren von Speicherpartitionen zur Laufzeit — z. B. einen hoch-recallfähigen Vektor-DB-Shard zum Debuggen einblenden oder für externe Audits auf eine DSGVO-bereinigte Speichervariante wechseln — ohne den Agenten zu stoppen. Das senkt das Störungsrisiko im Betrieb und ermöglicht anwendungsfallspezifische Speicherkonfigurationen (Debugging vs. Datenschutz vs. Performance).

praktische Leistungsdurchbrüche & Vorteile

OpenClaws Integration konzentriert sich auf drei praktische Bereiche, in denen GPT-5.4 glänzt:

- Hohe Treue bei Tool-Orchestrierung. GPT-5.4s verbesserte interne Toolsuche und Reasoning reduziert Tool-Call-Churn (weniger redundante Tool-Aufrufe und weniger Retries). Das führt zu weniger API-Calls und schnelleren Abschlüssen für komplexe Flows. Frühe Berichte deuten auf Verbesserungen bei Token- und Tool-Call-Effizienz im Vergleich zu älteren GPT-5.x-Modellen hin.

- Längere, reichhaltigere Kontexthandhabung. OpenClaw-Agenten können nun deutlich größere aktive Kontexte halten (einschließlich zugeschalteter Memory-Shards), wodurch sie lange Unterhaltungen, Multi-File-Projekte und iteratives Debugging verwalten können, ohne den Zustand zu verlieren.

- Besser deterministischer Code-Output. Für Workflows, die Code automatisch generieren (CI-Hooks, Funktionsstubs, Infrastruktur-Templates), produziert GPT-5.4 tendenziell konsistentere und ausführbare Outputs, was den manuellen Prüfaufwand reduziert. Unabhängige Tests zeigen bemerkenswerte Verbesserungen bei Codequalitätsmetriken gegenüber früheren GPT-5-Modellen.

- Speicherkontinuität — „hot-swap-fähiger Speicher“ ermöglicht das Ersetzen oder Erweitern von Speicher-Stores (Lokalcache, Vektor-DB, LLM-Memory), ohne Agentenzustand oder Kontext zu verlieren, und erlaubt A/B-Tests, Rolling Upgrades und Failover.

Im OOLONG-Benchmarktest erzielte die neue Version von OpenClaw zusammen mit dem lossless-claw-Plugin eine hohe Punktzahl von 74,8 und ließ Claude Code (70,3 Punkte) weit hinter sich. Besonders hervorzuheben ist, dass OpenClaw mit zunehmender Kontextlänge Stabilität und Genauigkeit bewies, was die vor Ort testenden Ingenieure zu der Aussage veranlasste, „zu konservativ ist zu sagen, dass es gut läuft“.

So konfigurieren und nutzen Sie GPT-5.4 in OpenClaw (Schritt für Schritt)

Ein einfacher OpenClaw-Workflow mit GPT 5.4:

- Eine typische Konfiguration ist unten dargestellt:

- Nutzer senden Nachrichten über Plattformen wie Discord oder Telegram.

- OpenClaw empfängt die Nachrichten über seinen Gateway-Server.

- Das Gateway leitet die Prompts über den AI-API-Provider an GPT 5.4 weiter.

- GPT 5.4 generiert eine Antwort oder löst eine Tool-Aktion aus.

- OpenClaw sendet das Endergebnis an den Nutzer zurück.

Im Folgenden finden Sie praxisnahe, kopierbare Konfigurationsbeispiele und Workflows, um GPT-5.4 in OpenClaw sicher und reproduzierbar zu betreiben. Diese sind bewusst konservativ: Aktivieren Sie das Modell zunächst in einem Test-Agenten und instrumentieren Sie alles für Metriken und Fehler.

Voraussetzungen- OpenClaw auf die Version aktualisiert, die GPT-5.4-Mappings enthält (siehe oben referenzierte Release Notes).

- Gültiger OpenAI-API-Schlüssel mit Zugriff auf GPT-5.4 (Ich wähle den CometAPI-Endpunkt mit günstigeren Preisen).

1) Modellauswahl & Resolver-Konfiguration (Json/ YAML / CLI)

Fügen Sie dies in ~/.openclaw/openclaw.json ein (oder mergen Sie es in Ihre bestehende Konfiguration). Passen Sie den Providernamen und den Token-Verweis an Ihre Umgebung an.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw verwendet einen Model-Resolver, um logische Modellnamen (z. B. openai/gpt-5.4) auf Endpunkte und Runtime-Konfiguration abzubilden. Fügen Sie Ihre Resolver-Datei hinzu oder aktualisieren Sie sie (Beispiel models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Oder setzen Sie es zur Laufzeit über die CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Hinweis: The

context_windowandmax

Hinweise

agents.defaults.model.primarylegt das Standardmodell fest. Verwenden Siechannels.modelByChannelfür Overrides pro Channel, sodass Sie kanalseitig wichtige Anfragen zu GPT-5.4 routen und weniger anspruchsvolle Kanäle auf günstigere Modelle legen können. Siehe OpenClaw-Dokumentation zur Modellwahl für die Reihenfolge der Auflösung.- Bitte konsultieren Sie die CometAPI-Modellseite für spezifische Modellnamen. Wenn Sie OpenAI verwenden möchten, ersetzen Sie die URL und den API-Schlüssel durch die von OpenAI.

- Die Schlüssel

context_windowundmax_output_tokensspiegeln die zukunftskompatiblen Änderungen im OpenClaw-Resolver wider, damit der Agent keine veralteten Codex-Limits voraussetzt.

2) So aktivieren und testen Sie „hot-swap-fähigen Speicher“

Das Speichersubsystem von OpenClaw basiert auf Dateien (Markdown-Dateien) plus Indexern/Such-Plugins, sodass Sie Backend-Plugins (z. B. SQLite-Vector, Milvus oder externe Memory-Services) sicher austauschen können, ohne die Rohspeicherdateien zu verlieren.

Ein gängiges Muster:

- Speicherort standardisieren: Verwenden Sie einen git-gestützten Workspace:

~/.openclaw/workspace/, in demMEMORY.mdundmemory/YYYY-MM-DD.mdmaßgeblich sind. - Memory-Plugin installieren & konfigurieren (Beispiel: sqlite-vec) und

plugins.slots.memoryim Config-File darauf zeigen lassen. - Migration testen: neues Plugin hinzufügen, einen Shadow-Indexlauf ausführen, Retrieval-Ergebnisse vergleichen und den Alias

plugins.slots.memoryauf das neue Plugin umschalten, sobald Sie zufrieden sind.

Beispiel-Aliaswechsel für ein Plugin (Bash-Pseudokommandos):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Warum dies „hot-swappable“ ist: Die Speicherdaten bleiben die Quelle der Wahrheit. Plugins implementieren Indexierungs- und Retrieval-Schichten; ihr Tausch reindiziert, ändert aber nicht die zugrundeliegenden .md-Dateien. Das erlaubt Modellwechsel ohne katastrophale Identitätsdrifts — der Agent liest weiterhin dieselben MEMORIES.

3) Beispiel: einen einzelnen Agenten auf GPT-5.4 pinnen (Override pro Agent)

Sie können Modelle pro Agent überschreiben; fügen Sie einen Eintrag wie folgt hinzu:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Falls der Community-Release oder Ihre spezielle OpenClaw-Version die CLI erfordert, können Sie auch ein Modells pro Session zur Laufzeit setzen:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Operationstipp: Pinning stellt deterministisches Verhalten für diesen Agenten sicher, während Sie A/B-Tests auf anderen durchführen.

Wenn Sie OpenAI verwenden möchten, ersetzen Sie die URL und den API-Schlüssel durch die von OpenAI.

4) Verwendung der Codex-1M-Kontextoptionen (API-Regler)

Wenn Ihre OpenClaw-Bereitstellung direkt auf OpenAI-Codex-Endpunkte zugreift, übergeben Sie Kontextoptionen:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Anfragen, die Standard-Kontextfenster überschreiten, können zu anderen Nutzungssätzen abgerechnet werden (OpenAI-Dokumente vermerken doppelte Verrechnung für Anfragen jenseits der Standardfenster in der Codex-Vorschau).

Best Practices: GPT-5.4s Stärken in OpenClaw maximieren

Kosten, Latenz & Modellmix

- Hybride Modellstrategie: Verwenden Sie ein kleineres, günstigeres Modell für kurze Anfragen und Stream-Processing; wechseln Sie per Hot-Swap zu GPT-5.4 für umfangreiche Analysen, Zusammenfassungen und Codegenerierung, die langen Kontext erfordern. So senken Sie die Gesamtkosten pro Token bei gleichbleibender Qualität. (Implementieren Sie dies über Trigger in der oben beschriebenen Memory-Konfiguration.)

- Tokenkompaktierung & Retrieval-Augmentation: Nutzen Sie Retrieval-augmented Pipelines, um die an das Modell gesendeten Tokens zu begrenzen — speichern Sie lange Dokumente in einer Vektor-DB, holen Sie relevante Segmente und fügen Sie nur die relevantesten Ausschnitte plus einen kompakten Plan ein. GPT-5.4s Toolsuche hilft dabei, hilfreiche Tools oder Dokumente automatisch zu finden.

- Warm-up & Cold Start: Führen Sie nach einem Modellwechsel ein kurzes Priming mit geringem Kontext durch, um Latenzspitzen bei der ersten Anfrage zu vermeiden. Kompilieren Sie Prompt-Templates vor und rehydrieren Sie kritische Memory-Kanäle. OpenClaws Rolling-Strategie (siehe Konfiguration) unterstützt Pre-Warming.

Zuverlässigkeit & Sicherheit

- Sanfter Fallback: Implementieren Sie Timeouts und Fallback-Pläne (z. B. Degradierung auf eine gecachte Antwort aus einer vorherigen Session), um API-Rate-Limits oder Kontingentfehler zu handhaben.

- Sicherheitslagen: Halten Sie Policy-Filter und einen Verifikationsschritt vor, wenn Outputs Entscheidungen beeinflussen. GPT-5.4 reduziert Halluzinationen statistisch, aber Verifikation bleibt bei risikoreichen Aufgaben wichtig.

Eval & Monitoring

- Reproduzieren Sie Ihre Benchmarks: Führen Sie Head-to-Head-Tests für Ihre Workloads (Code Completion, Multi-File-Refactor, Spreadsheet-Analyse) mit einem standardisierten Rubrum durch. Öffentliche Berichte weisen auf Stärken bei Tabellen und Produktivitätsaufgaben hin — validieren Sie mit Ihren Daten.

- Telemetrie: Überwachen Sie Tokenverbrauch, Modell-Latenz, Häufigkeit von Memory-Swaps und Antwortqualität (Human-Ratings/automatisierte Tests). Nutzen Sie die Telemetrie, um Swap-Schwellenwerte zu verfeinern.

Beispiel: Code-Review-Agent mit Hot-Swap

Ziel: Routine-Lint + Unit-Test-Zusammenfassung beim Push (günstiges Modell) und Eskalation auf GPT-5.4 für Refaktorvorschläge über mehrere Dateien, wenn Tests fehlschlagen oder Diffs > 10 Dateien sind.

Ablauf (High Level):

- Pre-Commit-Trigger führt

local/fast-small-coderaus, um eine Lint-Zusammenfassung zu erzeugen. - Wenn

test_failures > 0oderdiff_files > 10,hot_swapzuopenai/gpt-5.4auslösen.longterm_vectormit Repo-Historie promoten. - GPT-5.4-Prompt ausführen, der gesamte Fehlerspuren + relevante Code-Dateien in den Kontext zieht. Refaktor-Patch und Unit-Test-Anpassungen generieren.

- Menschlicher Reviewer bewertet den Output; Feedback aktualisiert den Speicher.

Prompt-Skelett (an GPT-5.4 gesendet nach Retrieval & Kompaktierung):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Dieser Use Case zeigt, warum großer Kontext + hot-swap-fähiger Speicher wertvoll ist: Sie können die vollständige Fehlerspur und mehrere Dateien auf einmal ins Modell bringen. Implementieren Sie Swap-Trigger konservativ, um die Kosten zu kontrollieren.

Abschließend: Wer GPT-5.4 in OpenClaw übernehmen sollte (und wann)

- Jetzt übernehmen, wenn Ihre Agenten mehrstufige Code-/Tool-Aufgaben, umfangreiche Tabellenkalkulationsautomatisierung oder komplexe Dokumentenbearbeitung durchführen, bei denen iterative Write-Run-Inspect-Zyklen die meiste Entwicklerzeit beanspruchen. Die Produktivitäts- und Zuverlässigkeitsgewinne sind hier am sichtbarsten.

- Sorgfältig übernehmen, wenn Sie in kostensensitiven, hochvolumigen Chat-Kanälen operieren, in denen einfaches Reasoning ausreicht; nutzen Sie Routing, um Kosteneffizienz zu bewahren.

- Nicht von einer Modell-Dominanz ausgehen: Benchmarken Sie mit Ihren Daten. GPT-5.4 ist ein starker Kandidat für Agenten-Workloads, aber die Modellauswahl muss datengetrieben sein.

Entwickler können auf GPT-5.4 über CometAPI (CometAPI ist eine One-Stop-Aggregationsplattform für große Modell-APIs wie GPT-APIs, Nano Banana APIs etc.) zugreifen. Um zu beginnen, erkunden Sie die Fähigkeiten des Modells im Playground und konsultieren Sie den Openclaw-Integrationsleitfaden für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bietet einen deutlich niedrigeren Preis als der offizielle, um Ihre Integration zu unterstützen.

Bereit? → Melden Sie sich noch heute bei OpenClaw an!

Wenn Sie weitere Tipps, Anleitungen und News zu KI erhalten möchten, folgen Sie uns auf VK, X und Discord!