DeepSeek ha presentado oficialmente V4 como una familia de modelos de código abierto, y el titular no es simplemente “otra actualización de modelo”. La compañía está posicionando V4 como un sistema de contexto largo y amigable para agentes, construido para cargas de trabajo reales: análisis con gran volumen documental, asistentes de programación, agentes de búsqueda y automatización de múltiples pasos. El lanzamiento está disponible en web, app y API, y la línea V4 introduce una ventana de contexto de 1M tokens de bajo costo en sus servicios oficiales.

Lo que hace que este lanzamiento sea especialmente relevante es la combinación de escala y eficiencia. DeepSeek afirma que V4‑Pro tiene 1.6T de parámetros totales con 49B activos, mientras que V4‑Flash tiene 284B de parámetros totales con 13B activos. En el informe técnico, DeepSeek también sostiene que la arquitectura de V4 usa atención híbrida, enrutamiento MoE y post‑entrenamiento diseñado para mejorar el comportamiento agéntico, a la vez que reduce la carga de cómputo del contexto ultralargo.

¿Qué es DeepSeek V4?

DeepSeek‑V4 es la última familia insignia en vista previa de la compañía, y el lanzamiento incluye dos variantes públicas: V4‑Pro y V4‑Flash. DeepSeek describe V4‑Pro como el modelo más fuerte en conocimiento del mundo, matemáticas, STEM, programación y codificación agéntica, mientras que V4‑Flash es la opción más receptiva y rentable que aún mantiene gran parte de la calidad de razonamiento y de contexto largo. V4‑Pro lidera los modelos abiertos actuales en codificación agéntica y conocimiento del mundo, mientras que V4‑Flash está diseñado para la velocidad y el despliegue económico.

V4 usa una arquitectura de atención híbrida que combina Compressed Sparse Attention (CSA) y Heavily Compressed Attention (HCA), además de Manifold‑Constrained Hyper‑Connections y el optimizador Muon. La compañía también afirma que los modelos fueron preentrenados con más de 32T tokens y que, con un contexto de 1M, V4‑Pro requiere solo 27% de los FLOPs de inferencia por token y 10% de la caché KV en comparación con DeepSeek‑V3.2. Esa historia de eficiencia es el verdadero titular detrás del lanzamiento.

DeepSeek‑V4‑Pro vs DeepSeek‑V4‑Flash

DeepSeek‑V4‑Pro

V4‑Pro es el modelo insignia para usuarios que priorizan la calidad. DeepSeek‑V4‑Pro ofrece un desempeño más sólido en codificación agéntica, conocimiento del mundo y razonamiento de nivel mundial, y lidera los modelos abiertos actuales, quedando solo por detrás de Gemini‑3.1‑Pro en conocimiento del mundo según la página de lanzamiento. En el informe técnico, V4‑Pro es el modelo más grande de la familia, y DeepSeek‑V4‑Pro está disponible a través de las mismas interfaces compatibles con OpenAI y con Anthropic que V4‑Flash.

DeepSeek‑V4‑Flash

V4‑Flash es el modelo que prioriza la eficiencia; sus capacidades de razonamiento se acercan mucho a V4‑Pro, y rinde a la par con V4‑Pro en tareas de agente simples, mientras usa un número menor de parámetros y ofrece tiempos de respuesta más rápidos. Admite modos con y sin pensamiento, con la misma longitud de contexto de 1M y las mismas funciones principales que Pro, pero a un costo mucho más bajo.

¿Cuál deberías elegir?

Usa V4‑Pro cuando la tarea sea de alto riesgo, intensiva en conocimiento o difícil de verificar: investigación empresarial, programación compleja, soporte de decisiones de múltiples pasos o tareas en las que quieras la respuesta más sólida posible. Usa V4‑Flash cuando el rendimiento, la latencia o el costo por token importen más que exprimir los últimos puntos de rendimiento en benchmarks. Esa elección es coherente con el posicionamiento oficial y con las brechas de benchmark reportadas entre ambos modelos.

| Ítem | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Parámetros totales | 284B | 1.6T |

| Parámetros activos | 13B | 49B |

| Longitud de contexto | 1M | 1M |

| Modos de razonamiento | Sin pensamiento + con pensamiento | Sin pensamiento + con pensamiento |

| Uso ideal | Inferencia rápida, apps de alto rendimiento, agentes sensibles al costo | Razonamiento de máxima capacidad, tareas más difíciles de programación y conocimiento |

| Precios oficiales de la API | Acierto de caché $0.028 / fallo de caché $0.14 / salida $0.28 por 1M tokens | Acierto de caché $0.145 / fallo de caché $1.74 / salida $3.48 por 1M tokens |

| Salida máxima | 384K | 384K |

CometAPI ofrece acceso a Deepseek v4 Pro y V4 Flash, —20% más barato que el oficial—, además de conmutación sin fricciones entre más de 500 modelos (GPT‑5.4, Gemini 3.1, etc.) mediante un único endpoint compatible con OpenAI o con Anthropic Messages.

Benchmark de rendimiento

DeepSeek‑V3.2 vs V4‑Flash vs V4‑Pro

En la tabla de comparación de modelos base, V4‑Flash y V4‑Pro superan a DeepSeek‑V3.2 en los benchmarks principales, con V4‑Pro liderando habitualmente. Por ejemplo, el informe lista las siguientes puntuaciones: AGIEval 82.6 / 83.1 frente al 80.1 de V3.2; MMLU 88.7 / 90.1 frente a 87.8; MMLU‑Pro 68.3 / 73.5 frente a 65.5; HumanEval 69.5 / 76.8 frente a 62.8; y LongBench‑V2 44.7 / 51.5 frente a 40.2 para V3.2, donde el número intermedio es V4‑Flash y el último es V4‑Pro.

| Benchmark | DeepSeek‑V3.2‑Base | DeepSeek‑V4‑Flash‑Base | DeepSeek‑V4‑Pro‑Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU‑Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench‑V2 (EM) | 40.2 | 44.7 | 51.5 |

Fuente: Informe técnico de DeepSeek‑V4, Tabla 1.

El patrón es claro: Flash reduce la brecha con Pro, pero Pro sigue siendo el modelo general más fuerte. Eso convierte a V4‑Flash en el valor por defecto práctico para muchos sistemas en producción, mientras que V4‑Pro es el modelo al que recurrir cuando la calidad de la respuesta importa más que el costo o la latencia.

Comparaciones con modelos occidentales: dónde encaja V4

En una evaluación humana sobre tareas de cuello blanco en chino, el informe afirma que DeepSeek‑V4‑Pro‑Max superó a Claude Opus 4.6‑Max, con una tasa de no pérdida del 63%. DeepSeek‑V4‑Pro “supera significativamente” a Claude Sonnet 4.5 y se acerca a Claude Opus 4.5 en un benchmark de programación de I+D.

| Área de evaluación | Resultado de DeepSeek | Comparación con modelos occidentales | Qué sugiere |

|---|---|---|---|

| Tareas de cuello blanco en chino | V4‑Pro‑Max, 63% tasa de no pérdida | vs Claude Opus 4.6‑Max | Desempeño sólido en tareas prácticas de estilo empresarial |

| Benchmark de programación de I+D | Tasa de aprobación de V4‑Pro‑Max: 67 | vs Claude Sonnet 4.5 con 47; Opus 4.5 con 70; Opus 4.6 Thinking con 80 | Competitivo frente a los modelos de frontera líderes, especialmente frente a sistemas de la categoría Sonnet |

No es “el número uno en todos los aspectos”, pero ya está en un nivel que “debe evaluarse seriamente”.

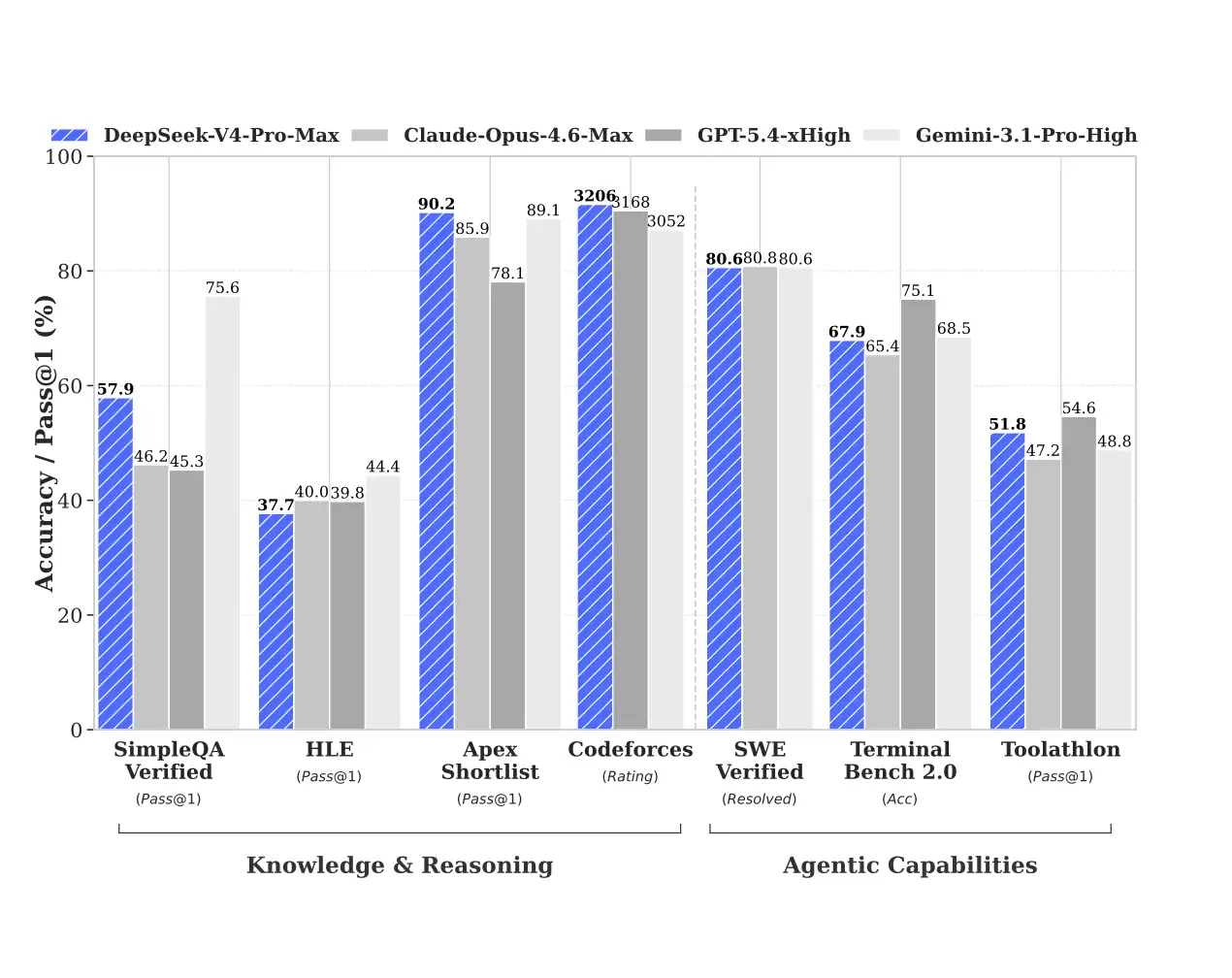

El informe técnico de DeepSeek compara V4‑Pro‑Max con Claude Opus 4.6 Max, GPT‑5.4 xHigh y Gemini 3.1 Pro High en la misma tabla. Los resultados no son simplistas: los modelos occidentales de código cerrado siguen siendo fuertes en algunos aspectos de conocimiento e inferencia; sin embargo, V4‑Pro‑Max tiene una presencia muy sólida en código, contextos largos y algunas tareas de agente. En otras palabras, ya no es una narrativa unidimensional de “alternativas domésticas”, sino que ha entrado en la etapa de “cuál es más adecuado para tu escenario”.

En términos de conocimiento y capacidad de razonamiento, está a la par de Opus 4.6 Max, GPT‑5.4 xHigh y Gemini 3.1 ProHigh. Sin embargo, queda ligeramente por detrás en capacidades agénticas, aunque la diferencia no es significativa.

DeepSeek‑V4‑Pro‑Max es muy competitivo en escenarios orientados al código y de contexto largo, mientras que los modelos occidentales siguen viéndose extremadamente fuertes en varios benchmarks de razonamiento puro y conocimiento. Esa es la forma correcta de leer el lanzamiento: DeepSeek V4 está firmemente en la conversación de frontera, pero el liderazgo en benchmarks depende de la tarea.

Cómo acceder a DeepSeek V4

1) Usar la web y la app oficiales

DeepSeek afirma que V4 Preview está disponible ahora mismo en web, app y API. Para los usuarios normales, el camino más simple sigue siendo la interfaz de chat oficial, donde se puede acceder al modelo a través de Expert Mode o Instant Mode.

2) Usar la API

Recomiendo encarecidamente CometAPI para acceder a DeepSeek V4, porque ofrece el mejor precio y ventajas de agregación.

Los nombres de los modelos son:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek también afirma que los nombres heredados

deepseek-chatydeepseek-reasonerse desaprobarán y actualmente se asignan a los modos sin pensamiento y con pensamiento de V4‑Flash hasta el 2026-07-24. Eso es importante para la planificación de migración si ya tienes integraciones más antiguas en producción.

- Regístrate en CometAPI y obtén tu clave de API.

- Usa el SDK estándar de Python de OpenAI (o cualquier cliente compatible) con una base URL personalizada:

Aquí tienes un ejemplo limpio usando el formato oficial compatible con OpenAI:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "Eres un asistente servicial."},

{"role": "user", "content": "Resume los beneficios de un contexto de un millón de tokens."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Ese patrón de solicitud sigue la guía de inicio rápido: establece la base URL, elige deepseek-v4-pro o deepseek-v4-flash, y habilita el pensamiento cuando necesites un razonamiento más profundo.

Cómo usar DeepSeek V4 de forma eficaz

Para flujos de trabajo con documentos largos, el patrón más sólido es mantener el contexto limpio y estructurado. La ventana de 1M tokens de V4 es una ventaja importante, pero el modelo sigue rindiendo mejor cuando la entrada está organizada en secciones, extractos de fuentes, instrucciones de tarea y restricciones de salida explícitas. Esa es la forma más natural de aprovechar la capacidad de contexto largo que DeepSeek está promocionando.

Para flujos de trabajo de código y agentes, comienza con V4‑Flash para iteración rápida y luego escala a V4‑Pro para la ejecución final o los pasos más difíciles. Ese enfoque encaja con el posicionamiento oficial: Flash es la opción eficiente, Pro es el modelo más fuerte, y ambos comparten la misma superficie de API y la misma longitud de contexto.

Palabras finales

DeepSeek‑V4 es notable porque combina cuatro cosas que el mercado ha estado pidiendo al mismo tiempo: contexto largo, razonamiento fuerte, disponibilidad abierta y precios agresivos. La historia real no es solo que DeepSeek lanzó otro modelo. Es que la compañía intenta hacer que la IA de frontera sea económicamente utilizable en producción. Para los equipos que evalúan dónde colocar su próxima apuesta en IA, esa es una señal que vale la pena probar, no ignorar.

Para equipos que construyen sobre múltiples proveedores, este es exactamente el tipo de lanzamiento que vale la pena evaluar con benchmarks dentro de tu propia pila. CometAPI puede ser la capa práctica para comparar DeepSeek‑V4 junto con otros modelos de frontera sin obligar a tu equipo de producto a rehacer la integración cada vez que el mercado cambie.