Gemini 3 Pro (Preview) es el modelo insignia multimodal de razonamiento más reciente de Google/DeepMind en la familia Gemini 3. Se posiciona como su “modelo más inteligente hasta ahora”, diseñado para razonamiento profundo, flujos de trabajo agénticos, programación avanzada y comprensión multimodal de largo contexto (texto, imágenes, audio, video, código e integraciones de herramientas).

Características clave

- Modalidades: Texto, imagen, video, audio, PDF (y salidas estructuradas de herramientas).

- Agéntico/herramientas: Invocación de funciones integrada, búsqueda como herramienta, ejecución de código, contexto de URL y compatibilidad para orquestar agentes de múltiples pasos. El mecanismo de firma de pensamiento preserva el razonamiento multi‑paso entre llamadas.

- Programación y “vibe coding”: Optimizado para generación de front‑end, generación de interfaces de usuario interactivas y programación agéntica (encabeza los rankings pertinentes reportados por Google). Se promociona como su modelo de “vibe‑coding” más potente hasta la fecha.

- Nuevos controles para desarrolladores:

thinking_level(low|high) para equilibrar coste/latencia frente a la profundidad de razonamiento, ymedia_resolutioncontrola la fidelidad multimodal por imagen o fotograma de video. Estos ayudan a equilibrar rendimiento, latencia y coste.

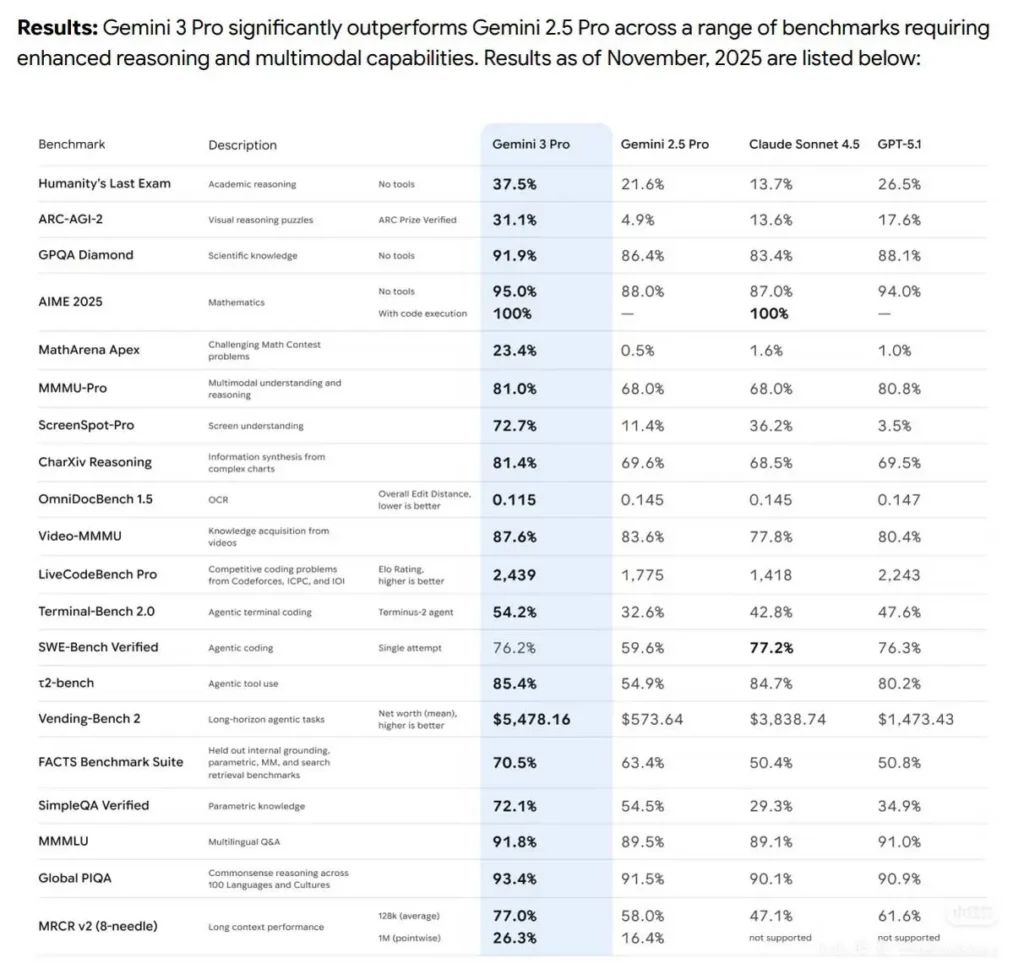

Rendimiento en benchmarks

- Gemini3Pro obtuvo el primer lugar en LMARE con una puntuación de 1501, superando los 1484 puntos de Grok-4.1-thinking y también por delante de Claude Sonnet 4.5 y Opus 4.1.

- También obtuvo el primer lugar en la arena de programación WebDevArena con una puntuación de 1487.

- En el examen académico de razonamiento Humanity’s Last Exam, logró 37.5% (sin herramientas); en GPQA Diamond (ciencia), 91.9%; y en la competencia de matemáticas MathArena Apex, 23.4%, estableciendo un nuevo récord.

- En capacidades multimodales, en MMMU-Pro logró 81%; y en comprensión de video Video-MMMU, 87.6%.

Detalles técnicos y arquitectura

- Parámetro “thinking level”: Gemini 3 expone un control

thinking_levelque permite a los desarrolladores intercambiar profundidad de razonamiento interno frente a latencia/coste. El modelo tratathinking_levelcomo una asignación relativa para el razonamiento interno multi‑paso en lugar de una garantía estricta de tokens. El valor predeterminado suele serhighpara Pro. Este es un nuevo control explícito para que los desarrolladores ajusten la planificación multi‑paso y la profundidad de la cadena de pensamiento. - Salidas estructuradas y herramientas: El modelo admite salidas JSON estructuradas y puede combinarse con herramientas integradas (Google Search grounding, contexto de URL, ejecución de código, etc.). Algunas funciones de salidas estructuradas + herramientas están solo en vista previa para

gemini-3-pro-preview. - Integraciones multimodales y agénticas: Gemini 3 Pro está creado explícitamente para flujos de trabajo agénticos (herramientas + múltiples agentes sobre código/terminales/navegador).

- Acepta entradas de texto, imagen, video, audio y PDF; salida de texto.

Limitaciones y advertencias conocidas

- Factualidad no perfecta: las alucinaciones siguen siendo posibles. A pesar de las mejoras de factualidad anunciadas por Google, la verificación fundamentada y la revisión humana siguen siendo necesarias en entornos de alto riesgo (legal, médico, financiero).

- El rendimiento en contextos largos varía según la tarea. La compatibilidad con una ventana de entrada de 1M es una capacidad dura, pero la efectividad empírica puede disminuir en algunos benchmarks en longitudes extremas (se observaron descensos puntuales en 1M en algunas pruebas de largo contexto).

- Compromisos de coste y latencia. Contextos grandes y valores

thinking_levelmás altos aumentan el cómputo, la latencia y el coste; se aplican niveles de precios según volúmenes de tokens. Utilizathinking_levely estrategias de “chunking” para gestionar costes. - Políticas de seguridad y filtros de contenido. Google sigue aplicando políticas de seguridad y capas de moderación; cierto contenido y acciones continúan restringidos o activarán modos de rechazo.

Cómo se compara Gemini 3 Pro Preview con otros modelos de primera línea

Comparación a alto nivel (vista previa → cualitativa):

Frente a Gemini 2.5 Pro: Mejoras de salto en razonamiento, uso agéntico de herramientas e integración multimodal; manejo de contextos mucho más grandes y mejor comprensión de textos largos. DeepMind muestra ganancias consistentes en razonamiento académico, programación y tareas multimodales.

Frente a GPT-5.1 y Claude Sonnet 4.5 (según lo informado): En el conjunto de benchmarks de Google/DeepMind, Gemini 3 Pro se presenta como líder en varias métricas agénticas, multimodales y de largo contexto (ver Terminal-Bench, MMMU-Pro, AIME). Los resultados comparativos varían por tarea.

Casos de uso típicos y de alto valor

- Resumen y P&R de documentos/libros grandes: el soporte de largo contexto lo hace atractivo para equipos legales, de investigación y cumplimiento.

- Comprensión y generación de código a escala de repositorio: la integración con toolchains de programación y el razonamiento mejorado ayuda en refactors de grandes bases de código y flujos de trabajo de revisión automatizada.

- Asistentes de producto multimodales: flujos de trabajo de imagen + texto + audio (atención al cliente que ingiere capturas de pantalla, fragmentos de llamadas y documentos).

- Generación y edición de medios (foto → video): funciones anteriores de la familia Gemini ahora incluyen capacidades estilo Veo / Flow de foto→video; la vista previa sugiere una generación multimedia más profunda para prototipos y flujos de trabajo de medios.

Cómo llamar a la API gemini-3-pro-preview desde CometAPI

Precios de Gemini 3 Pro Preview en CometAPI,20% menos que el precio oficial:

| Tokens de entrada | $1.60 |

| Tokens de salida | $9.60 |

Pasos necesarios

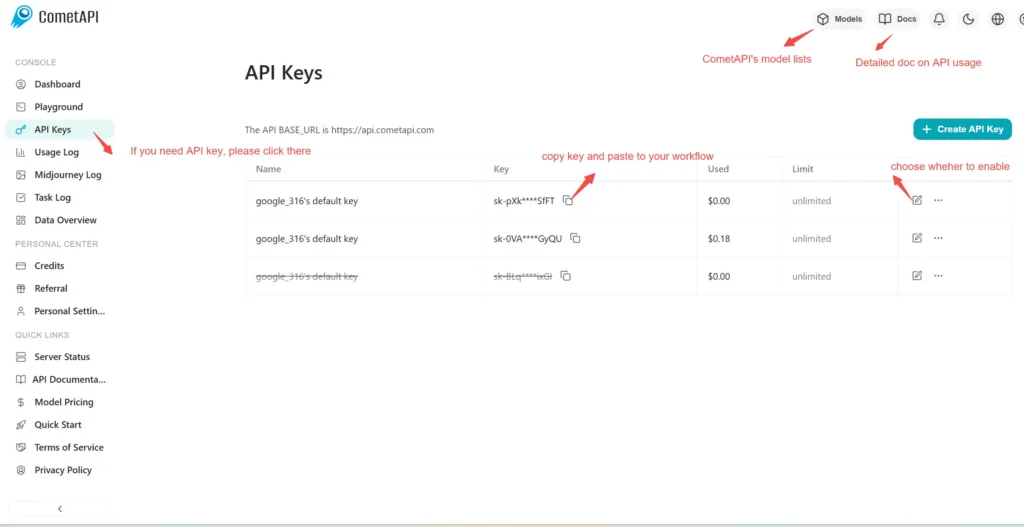

- Inicia sesión en cometapi.com. Si aún no eres usuario, regístrate primero.

- Accede a tu Consola de CometAPI.

- Obtén la credencial de acceso API key de la interfaz. Haz clic en “Add Token” en el token de API en el centro personal, obtén la clave del token: sk-xxxxx y envíala.

Método de uso

- Selecciona el endpoint “

gemini-3-pro-preview” para enviar la solicitud de API y establece el cuerpo de la solicitud. El método y el cuerpo de la solicitud se obtienen en la documentación de la API de nuestro sitio web. Nuestro sitio también proporciona pruebas en Apifox para tu comodidad. - Reemplaza <YOUR_API_KEY> por tu clave real de CometAPI de tu cuenta.

- Inserta tu pregunta o solicitud en el campo content: esto es lo que responderá el modelo.

- . Procesa la respuesta de la API para obtener la respuesta generada.

CometAPI proporciona una API REST totalmente compatible — para una migración sin fricciones. Detalles clave para Chat :

- URL base: v1/chat/completions

- Nombres de modelos:

gemini-3-pro-preview - Autenticación:

Bearer YOUR_CometAPI_API_KEYheader - Content-Type:

application/json.

See also GPT-5.1 API