Google DeepMind lanzó oficialmente Gemma 4 el 2 de abril de 2026, marcando un hito importante en la IA de código abierto. Esta familia de modelos ofrece inteligencia de vanguardia por parámetro, construida a partir de la misma investigación y tecnología que impulsa Gemini 3. A diferencia de versiones anteriores de Gemma con licencias personalizadas, Gemma 4 se distribuye bajo la licencia totalmente permisiva Apache 2.0, lo que permite uso comercial sin restricciones, modificación y redistribución.

Gemma 4 destaca por sus capacidades multimodales (entradas de texto + imagen en todos los tamaños, además de audio en los modelos para el borde), compatibilidad nativa con razonamiento avanzado y flujos de trabajo de agentes, ventanas de contexto largas de hasta 256K tokens y optimización para todo, desde smartphones y Raspberry Pi hasta GPU de gama alta. Admite más de 140 idiomas y enfatiza la eficiencia, haciendo que la IA potente sea accesible en hardware de consumo y de borde sin dependencia de la nube.

CometAPI ofrece excelentes API de modelos de código abierto y cerrado.

¿Qué es Gemma 4?

Gemma 4 es la última familia de modelos abiertos multimodales de gran tamaño (LLM) de Google DeepMind, diseñada específicamente para razonamiento avanzado, flujos de trabajo de agentes de IA y despliegue eficiente en dispositivo. Maximiza la “inteligencia por parámetro” aprovechando conocimientos de la investigación propietaria de Gemini 3, manteniéndose completamente de pesos abiertos y de código abierto.

Las principales mejoras respecto a modelos Gemma anteriores incluyen:

- Multimodalidad nativa: comprensión de texto + imagen (todos los modelos), con soporte de audio en variantes pequeñas para el borde.

- Modo de pensamiento configurable: razonamiento paso a paso con salida estructurada <|think|>.

- Llamada a funciones y uso de herramientas nativos: ideal para agentes autónomos.

- Contexto ampliado: hasta 256K tokens en modelos más grandes.

- Arquitectura de atención híbrida: combina ventana deslizante local y atención global para eficiencia y rendimiento en contextos largos.

- Embeddings por capa (PLE) en modelos pequeños y caché KV compartida para ahorro de memoria.

- Amplio soporte multilingüe: preentrenado con datos que cubren 140+ idiomas y sensibilidad cultural.

Publicado bajo Apache 2.0, Gemma 4 elimina las restricciones de licencia previas que limitaban la adopción empresarial. Los desarrolladores ahora pueden afinar, desplegar y comercializar sin fricciones, situándolo como competidor directo de ecosistemas plenamente abiertos como Llama y Qwen.

Gemma 4 apunta a hardware diverso: dispositivos de borde (teléfonos, IoT, Raspberry Pi, Jetson Nano) para IA sin conexión de baja latencia, y estaciones de trabajo/GPU para servidores locales de alto rendimiento. Este diseño “local-first” prioriza la privacidad, el ahorro de costes y la inferencia sin latencia.

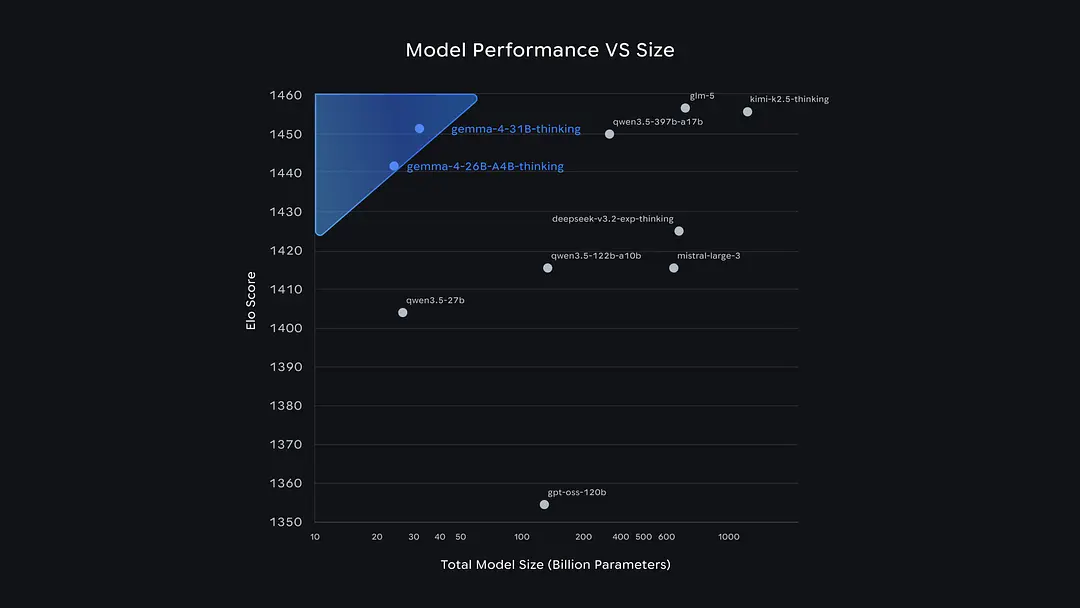

Los modelos de código abierto que la superan en la tabla de clasificación de Arena provienen principalmente de equipos chinos. Gemma 4 no es muy diferente de Qwen 3.5 y GLM-5, pero es significativamente diferente de GPT-OSS-120B de OpenAI.

Los desarrolladores ahora pueden encontrar GLM-5, Qwen 3.5, etc. en CometAPI.

Las cuatro versiones de Gemma 4

Google lanzó Gemma 4 en cuatro tamaños cuidadosamente optimizados, cada uno equilibrando rendimiento, eficiencia y escenarios de despliegue. Dos usan arquitecturas densas con innovadoras Per-Layer Embeddings (PLE) para eficiencia en el borde; uno es un Mixture-of-Experts (MoE) para alto rendimiento con bajo coste de parámetros activos; y uno es un modelo denso insignia.

| Modelo | Arquitectura | Parámetros totales | Parámetros activos (MoE) | Parámetros efectivos | Longitud de contexto | Modalidades | Hardware de destino |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Denso + PLE | ~5.1B (incl. embeddings) | N/A | 2.3B | 128K | Texto, Imagen, Audio | Smartphones, Raspberry Pi, IoT de borde |

| Gemma 4 E4B | Denso + PLE | ~8B (incl. embeddings) | N/A | 4.5B | 128K | Texto, Imagen, Audio | Dispositivos móviles, GPU ligeras, Jetson |

| Gemma 4 26B A4B | MoE (8 activos / 128 totales + 1 compartido) | 25.2B | 3.8B–4B | N/A | 256K | Texto, Imagen | Estaciones de trabajo, GPU de consumo, servidores locales |

| Gemma 4 31B | Denso | 30.7B | N/A | N/A | 256K | Texto, Imagen | GPU de gama alta (cabe en una sola H100/A100 en FP16) |

Gemma 4 E2B y E4B (optimizados para el borde): Usan PLE para añadir especialización por capa con sobrecarga mínima de parámetros. Ideales para dispositivos con batería o memoria limitada. El codificador de audio (Conformer estilo USM, ~300M de parámetros) habilita dictado y traducción de voz a texto.

Gemma 4 26B A4B (MoE): Activa solo ~4B parámetros durante la inferencia a pesar de los más de 25B totales. Ofrece un rendimiento cercano al de 31B con un coste computacional dramáticamente menor—perfecto para escalar con eficiencia de costes.

Gemma 4 31B (Denso): El insignia para capacidad máxima. Cabe en una sola GPU de 80GB en precisión completa y se sitúa entre los mejores modelos abiertos en clasificaciones.

Todos los modelos incluyen variantes ajustadas con instrucciones (“-it”) optimizadas para chat, razonamiento y uso de herramientas, además de versiones base preentrenadas para ajuste fino. Los dos modelos grandes adoptan enfoques distintos: el modelo denso de 31B persigue la máxima calidad y sirve como la mejor base para ajuste fino; el modelo MoE de 26B prioriza la velocidad, activando solo 3.8 mil millones de parámetros durante la inferencia, lo que resulta en una generación de palabras mucho más rápida, pero con una calidad general ligeramente inferior.

Los dos modelos pequeños, E2B y E4B, están diseñados específicamente para teléfonos móviles y dispositivos IoT: pueden ejecutarse completamente sin conexión, ahorrando memoria y energía. Además, estos modelos más pequeños poseen una capacidad que los modelos más grandes no tienen: entrada de audio nativa, que permite reconocimiento de voz directo.

Capacidades principales de Gemma 4

Gemma 4 sobresale en áreas clave para aplicaciones de IA del mundo real:

1. Razonamiento avanzado y modo de pensamiento

Razonamiento paso a paso configurable mediante prompts del sistema o enable_thinking=True. Produce etiquetas estructuradas <|think|> seguidas de respuestas finales. Mejora drásticamente el rendimiento en tareas complejas sin ajuste fino adicional.

2. Comprensión multimodal

- Visión: detección de objetos (cajas delimitadoras en JSON), OCR (multilingüe), análisis de documentos/PDF, comprensión de gráficos, comprensión de IU, reconocimiento de escritura a mano y manejo de imágenes de resolución variable (presupuestos de tokens: 70–1120 tokens).

- Vídeo: Hasta 60 segundos (procesamiento de fotogramas a 1 fps).

- Audio (solo E2B/E4B): reconocimiento automático del habla (ASR) y traducción de voz a texto (máx. 30 s).

- Entradas entrelazadas: mezclar texto, imágenes y audio en cualquier orden.

3. Flujos de trabajo de agentes y llamadas a funciones

El soporte nativo de uso de herramientas habilita agentes autónomos para planificación en múltiples pasos, llamadas a API, navegación por aplicaciones y finalización de tareas. Fuerte en τ2-bench (uso de herramientas por agentes).

4. Programación y herramientas para desarrolladores

Generación de código, autocompletado, depuración y comprensión a nivel de repositorio excepcionales. Admite salidas estructuradas en JSON para integración fluida. Alcanza 80.0% (31B) en LiveCodeBench v6, posicionándose como un asistente de programación de enfoque local adecuado para escenarios de desarrollo sin conexión.

5. Contexto largo y multilingüe

Maneja 128K–256K tokens de forma fiable (probado en MRCR needle-in-haystack). Preentrenado en datos diversos hasta la fecha de corte de enero de 2025, con fuerte rendimiento interlingüístico. No es solo traducción multilingüe; está entrenado de forma nativa y cubre más de 140 idiomas.

Datos de referencia: desglose del rendimiento de Gemma 4

Gemma 4 establece nuevos estándares para modelos abiertos. Las variantes 31B y 26B logran puntuaciones antes reservadas a sistemas propietarios mucho más grandes, mientras que los modelos para el borde superan al mayor predecesor Gemma 3.

Resultados completos de benchmarks (modelos ajustados con instrucciones)

| Benchmark | Categoría | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (sin think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Razonamiento y conocimiento | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Matemáticas | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Ciencia de nivel de posgrado | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Uso de herramientas por agentes | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Programación | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Programación competitiva | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Razonamiento multimodal | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Matemáticas + Visión | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Contexto largo | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Aspectos clave:

- Salto enorme respecto a Gemma 3: el modelo 31B mejora AIME (matemáticas) de 20.8% a 89.2% y LiveCodeBench de 29.1% a 80.0%.

- Eficiencia MoE: 26B A4B casi iguala a 31B utilizando mucha menos computación durante la inferencia.

- Dominio en el borde: E4B y E2B superan a Gemma 3 27B en muchas métricas a pesar de ser 6–10x más pequeños.

- Clasificaciones: 31B obtiene ~1452 en Arena AI (texto); 26B A4B ~1441. Según se informa, la variante 26B supera a modelos mucho más grandes como Qwen 3.5 397B en preferencia de usuarios y programación.

Los benchmarks de visión y audio confirman un rendimiento multimodal sólido desde el primer momento sin ajuste fino especializado.

Ecosistema y soporte de herramientas

Gemma 4 disfruta de una integración amplia e inmediata en el ecosistema:

- Hugging Face: compatibilidad desde el primer día con

transformers,pipeline("any-to-any"), GGUF, ONNX y procesadores multimodales. - Entornos locales: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon con TurboQuant), Mistral.rs (Rust), Transformers.js (inferencia en el navegador con WebGPU).

- Ajuste fino: TRL, Unsloth, PEFT, Vertex AI y compatibilidad total con conjuntos de datos multimodales.

- Optimización de hardware: NVIDIA RTX/DGX Spark/Jetson (mediante TensorRT-LLM), herramientas de Google AI Edge y despliegue en dispositivo en Android/iOS.

- Frameworks de agentes: OpenClaw, Hermes, Pi y pruebas de simulación CARLA.

- Nube/Studio: Google AI Studio para pruebas rápidas; Kaggle Models para descarga.

Este ecosistema hace que Gemma 4 pueda desplegarse en minutos en portátiles, servidores o dispositivos de borde.

Limitaciones y seguridad:

- Corte de datos de entrenamiento: enero de 2025 (sin conocimiento en tiempo real sin herramientas).

- Audio limitado al habla (no música); vídeo limitado a 60 s.

- El riesgo de alucinaciones persiste—use el modo de pensamiento y verificación.

- Seguridad: filtrado y evaluaciones rigurosas según los Principios de IA de Google; los desarrolladores deben añadir protecciones específicas de aplicación.

Por qué Gemma 4 es importante en 2026

Gemma 4 democratiza la IA de frontera. Al combinar inteligencia multimodal, capacidades de agentes y libertad Apache 2.0 con eficiencia independiente del hardware, permite a desarrolladores y empresas crear soluciones de IA seguras, privadas y rentables a escala. El avance en inteligencia por parámetro—especialmente evidente en los modelos para el borde que superan a los insignia abiertos de ayer—señala un cambio hacia una IA verdaderamente ubicua.

Ya sea ejecutando un modelo de 2B en un teléfono o un “potente” de 31B en local, Gemma 4 demuestra que la IA de código abierto ha alcanzado (y en muchos casos superado) a las alternativas cerradas en utilidad práctica.