GPT-5.5 Instant representa la última actualización de OpenAI para la inteligencia cotidiana que impulsa ChatGPT. Lanzado el 5 de mayo de 2026, reemplaza a GPT-5.3 Instant como el modelo predeterminado para cientos de millones de usuarios. Ofrece respuestas más inteligentes y precisas con una reducción significativa de alucinaciones, manteniendo la experiencia “instantánea” de baja latencia que los usuarios esperan.

Para desarrolladores, emprendedores, creadores de SaaS y equipos empresariales, esta actualización de modelo abre nuevas posibilidades para integrar IA confiable sin sacrificar velocidad ni disparar costos. Esta guía integral cubre desde el acceso rápido a ChatGPT hasta el uso de API de nivel producción, con ejemplos prácticos y estrategias de optimización.

Qué es GPT-5.5 Instant y por qué importa

GPT-5.5 Instant es la variante rápida y eficiente optimizada para interacciones diarias, respuestas aumentadas con búsqueda, análisis de imágenes y recuerdo de contexto personalizado. Impulsa la experiencia predeterminada de ChatGPT y ofrece mejoras medibles frente a su predecesor.

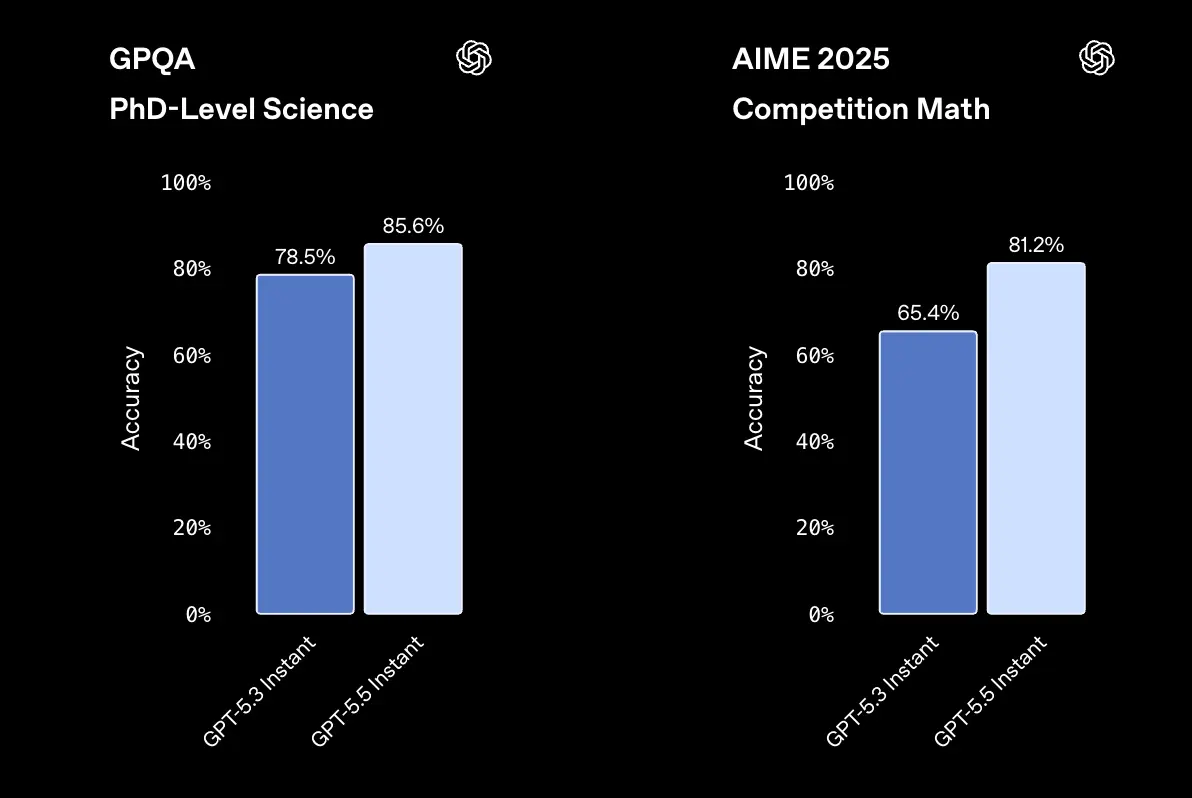

Mejoras clave (respaldadas por evaluaciones de OpenAI):

- GPT-5.5 Instant generó un 52.5% menos de afirmaciones alucinadas que GPT-5.3 Instant en prompts de alto riesgo

- Reducción del 37.3% en afirmaciones inexactas en conversaciones desafiantes.

- Rendimiento más sólido en análisis de fotos/imágenes, preguntas STEM y detección de cuándo invocar la búsqueda web.

- Respuestas más concisas, naturales y personalizadas, con mejor gestión de contexto a partir de chats previos, archivos y Gmail conectado.

A diferencia del más pesado GPT-5.5 (variantes Thinking/Pro) diseñado para razonamiento profundo y tareas agenticas complejas, GPT-5.5 Instant prioriza la velocidad y la fiabilidad para uso general, a la vez que ofrece mejoras sustanciales de capacidad.

GPT-5.5 Instant vs. GPT-5.5 vs. modelos anteriores: tabla comparativa

| Característica/Modelo | GPT-5.5 Instant (predeterminado) | GPT-5.5 (Completo/Thinking) | GPT-5.3 Instant (anterior) |

|---|---|---|---|

| Fortaleza principal | Velocidad + fiabilidad | Razonamiento profundo y agentes | Uso general |

| Latencia | Más baja | Más alta | Baja |

| Reducción de alucinaciones | 52.5% menos (alto riesgo) | Máxima | Referencia |

| Personalización | Excelente (búsqueda en memoria) | Sólida | Buena |

| Rendimiento en imagen/STEM | Mejorado significativamente | Superior | Buena |

| Precios de API (aprox.) | Competitivo a través de proveedores | $5/$30 por M tokens | Más bajo |

| Ideal para | Chat, tareas rápidas, apps | Flujos de trabajo complejos | Heredado |

Cuándo elegir Instant: Aplicaciones cotidianas, bots de atención al cliente, generación de contenido e interfaces sensibles a la latencia.

Esencialmente, GPT-5.5 Instant y GPT-5.5 Thinking comparten la misma arquitectura subyacente. La diferencia radica en la profundidad del razonamiento, no en el nivel de conocimiento. Los usuarios de pago pueden usar GPT-5.5 Thinking, mientras que los usuarios gratuitos pueden usar una cuota limitada de GPT-5.5 Instant en ChatGPT.

Para más información, consulta la visión general de GPT-5.5 y su mecanismo.

Cómo acceder a GPT-5.5 Instant en ChatGPT

Si usas ChatGPT directamente, GPT-5.5 Instant es el predeterminado para todos los usuarios que inician sesión. OpenAI indica que se está implementando para todos los usuarios de ChatGPT y reemplazando a GPT-5.3 Instant como el modelo por defecto. Esto significa que muchos usuarios no necesitan cambiar nada manualmente para beneficiarse de la nueva experiencia Instant.

Para los usuarios de pago, ChatGPT ofrece un selector de modelos que permite elegir manualmente GPT-5.5 Instant o GPT-5.5 Thinking (Para usuarios de pago, GPT‑5.3 Instant seguirá disponible durante tres meses). El centro de ayuda de OpenAI indica que los usuarios Plus, Pro y Business tienen acceso al selector, mientras que GPT-5.5 Pro está reservado para los planes Pro, Business, Enterprise y Edu.

Los usuarios gratuitos aún pueden usar GPT-5.5 en ChatGPT, pero existen límites de uso. OpenAI afirma que las cuentas del nivel Free pueden enviar hasta 10 mensajes con GPT-5.5 cada 5 horas, mientras que los usuarios Plus y Go pueden enviar hasta 160 mensajes cada 3 horas. Después de alcanzar el límite, los chats cambian a la versión mini de GPT-5.5 hasta que el límite se restablezca. Las ediciones Pro y Business no revertirán y pueden seguir usando GPT-5.5.

Si usas la edición Pro o Enterprise y quieres comparar el rendimiento de Instant y Thinking en una tarea real, abre dos pestañas lado a lado, fija una pestaña a cada uno e introduce los mismos prompts en ambas. La diferencia es especialmente notable en tareas con razonamiento multi-paso implícito, ya que Thinking explora diferentes ramas antes de responder. Para chat cotidiano, Instant es más rápido en las respuestas iniciales.

Flujo práctico de acceso a ChatGPT

Para la mayoría de usuarios, el flujo es simple:

- Inicia sesión en ChatGPT.

- Usa la experiencia Instant predeterminada.

- En planes de pago, abre el selector de modelo si quieres elegir manualmente GPT-5.5 Instant.

- Cambia a GPT-5.5 Thinking solo cuando la tarea realmente necesite razonamiento más profundo.

Ese es el camino orientado al usuario. Para los equipos de producto, la verdadera pregunta es cómo operacionalizar la misma calidad en tu propia aplicación. Ahí es donde la vía de API importa.

Funciones avanzadas

- Memoria y personalización: El modelo extrae de forma inteligente del historial de conversación, archivos subidos y Gmail (cuando está conectado). Decide cuándo la personalización aporta valor.

- Análisis de imágenes: Sube fotos para un razonamiento visual mejorado.

- Integración con búsqueda web: Automática cuando se necesita información actualizada.

Consejo profesional: Inicia chats nuevos para la experiencia predeterminada más limpia. Usa instrucciones personalizadas en la configuración para un tono y contexto consistentes entre sesiones.

Cómo acceder y usar GPT-5.5 Instant vía API

El acceso directo a la API de OpenAI usa alias de modelo como chat-latest . chat-latest apunta al último modelo Instant actualmente usado en ChatGPT. Muchos equipos prefieren proveedores unificados como CometAPI por costos más bajos, mayores límites de tasa e integración simplificada entre múltiples modelos.

En la API, GPT-5.5 Instant y GPT-5.5 Thinking se consolidan en un único identificador de modelo: gpt-5.5. No existe un endpoint separado gpt-5.5-instant. En su lugar, controlas la profundidad de razonamiento con el parámetro reasoning_effort, que acepta minimal, low, medium o high. Establecer reasoning_effort: "minimal" es el equivalente más cercano en la API a la experiencia Instant en ChatGPT.

GPT-5.5 llega en dos endpoints:

- Responses API (

/v1/responses): el endpoint recomendado para nuevos desarrollos, con soporte de primera clase para herramientas, salida estructurada y streaming. - Chat Completions API (

/v1/chat/completions): el endpoint heredado, mantenido por compatibilidad retroactiva.

Configuración paso a paso de la API con CometAPI (recomendada para la mayoría de equipos)

1. Regístrate y obtén tu clave de API

- Visita CometAPI.com y crea una cuenta.

- Ve a la consola/panel para generar una clave de API (empieza con

sk-).

2. Ejemplo de integración básica (Python)

from openai import OpenAI

import os

client = OpenAI(

api_key=os.getenv("COMETAPI_KEY"), # Tu clave de CometAPI

base_url="https://api.cometapi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5", # o un alias específico

messages=[

{"role": "system", "content": "Eres un asistente útil y conciso."},

{"role": "user", "content": "Explica cómo GPT-5.5 Instant mejora la factualidad."}

],

temperature=0.7,

max_tokens=500

)

print(response.choices[0].message.content)

3. Respuesta en streaming para una mejor experiencia de usuario

stream = client.chat.completions.create(

model="gpt-5.5",

messages=[...],

stream=True

)

for chunk in stream:

if chunk.choices[0].delta.content is not None:

print(chunk.choices[0].delta.content, end="")

Ejemplos en JavaScript, cURL y otros lenguajes siguen patrones similares de compatibilidad con el SDK de OpenAI.

Parámetros clave de la API para GPT-5.5 Instant

- temperature: 0.0–1.0 (más baja para tareas de factualidad).

- reasoning_effort (si está soportado en variantes): low/medium para un equilibrio.

- herramientas/llamadas a funciones: Compatibilidad total para flujos de trabajo agenticos.

- Vision: Pasa URLs de imagen o base64 para prompts multimodales.

Mejores prácticas para obtener mejores resultados

GPT-5.5 no es un modelo de “escribe un prompt vago y reza”. Recomiendo firmemente el prompting orientado al resultado: especifica el resultado esperado, los criterios de éxito, las restricciones, los efectos secundarios y el formato de salida. La documentación también aconseja reducir la guía paso a paso salvo que el proceso en sí sea un requisito del producto. En la práctica, significa que debes describir el destino, no microgestionar cada giro.

Las salidas estructuradas son otra palanca importante. OpenAI recomienda usarlas en lugar de describir el esquema en el prompt, especialmente para sistemas de producción que necesitan validación automática y un análisis posterior más confiable. Esto importa para productos SaaS porque cuanto menos tiempo pase tu app limpiando la salida del modelo, más estable será tu UX.

Lista de verificación de prompting para GPT-5.5 Instant

Escribe prompts que:

- Indiquen el objetivo con claridad.

- Definan criterios de aceptación.

- Mencionen el formato requerido.

- Limiten instrucciones innecesarias.

- Dejen margen para que el modelo elija el mejor camino.

Orientación sobre el esfuerzo de razonamiento

OpenAI dice que medium es la configuración predeterminada y recomendada por su equilibrio, low puede funcionar bien para muchas cargas, none es para trabajos críticos en latencia que no necesitan razonamiento, y high o xhigh deben reservarse para tareas donde la evaluación muestre una mejora de calidad medible. Ese consejo es sutil pero importante: más razonamiento no es automáticamente mejor, especialmente cuando la tarea tiene criterios de parada débiles o demasiado acceso abierto a herramientas.

Un patrón útil para producción

Para atención al cliente, asistentes internos de conocimiento y automatización de flujos, una configuración sólida es:

- Responses API para el estado de la conversación

- Salidas estructuradas para análisis predecible

- Esfuerzo de razonamiento ajustado al caso de uso

- Caché de prompts para prefijos repetidos

- Herramientas alojadas donde encajen en el flujo

Esa combinación es cuando GPT-5.5 empieza a parecer menos un modelo de chat y más un motor de producción.

Estrategias de optimización de costos

- Cachea prompts/respuestas comunes.

- Usa salidas estructuradas (modo JSON) para un análisis confiable.

- Monitorea el uso de tokens y elige niveles de esfuerzo con criterio.

- Enruta consultas simples a modelos más ligeros y escala a Instant/GPT-5.5 cuando sea necesario.

Ejemplos de implementación paso a paso

1) Flujo con ChatGPT

La forma más simple de usar GPT-5.5 Instant es dentro de ChatGPT. Inicia sesión, deja que la experiencia Instant predeterminada gestione el trabajo rutinario y, en niveles de pago, usa el selector de modelo si necesitas elegir manualmente GPT-5.5 Instant o GPT-5.5 Thinking. OpenAI dice que la experiencia Instant predeterminada ya está ajustada para preguntas de búsqueda de información, guías paso a paso, redacción técnica y traducción.

Esta es la opción adecuada para fundadores, operadores y product managers que necesitan respuestas rápidas sin desplegar código. También es el mejor lugar para evaluar si el tono y la factualidad de GPT-5.5 mejoran tus flujos típicos antes de invertir en integración.

2) Flujo directo con API

Para desarrollo de producto, usa la vía de API. La documentación de OpenAI indica actualizar el slug del modelo a gpt-5.5, usar Responses API para razonamiento y uso de herramientas, y configurar reasoning.effort de forma intencional. La documentación también señala el caché de prompts, salidas estructuradas y manejo multi-turno como partes centrales de una buena integración.

Una secuencia práctica de implementación se ve así:

- Empieza con una línea base de prompt nueva.

- Establece el modelo en

gpt-5.5. - Usa Responses API.

- Agrega salidas estructuradas si la app necesita respuestas legibles por máquina.

- Ajusta

reasoning.effortsegún objetivos de latencia y calidad. - Evalúa el comportamiento de extremo a extremo antes de lanzar.

3) Flujo con gateway unificado con CometAPI

CometAPI se posiciona como una plataforma de agregación de API unificada, estilo OpenAI, con acceso a más de 500 modelos de IA a través de una sola interfaz, una sola clave de API y facturación por uso. Hace hincapié en menor fricción de integración, una credencial y la capacidad de cambiar de modelos sin reautenticación ni grandes migraciones.

Para equipos que construyen productos multi-modelo, eso importa. En lugar de bloquear tu stack a la vía de integración de un proveedor, un enfoque de gateway te permite estandarizar el manejo de solicitudes, simplificar pruebas entre proveedores y reducir la carga de mantenimiento del despliegue de SDKs específicos de cada modelo.

CometAPI Ventajas: Precios significativamente más bajos (p. ej., ~20% de descuento frente al oficial), una clave de API para 500+ modelos, límites de tasa generosos y un playground para pruebas. Esto lo hace ideal para startups que escalan funciones de IA sin incurrir de inmediato en altas facturas de OpenAI.

Si quieres conocer los cambios de precio de GPT-5.5, aquí tienes un análisis detallado de los desgloses de precios de GPT-5.5.

Preguntas frecuentes

1. ¿Cómo accedo a GPT-5.5 Instant en ChatGPT?

GPT-5.5 Instant es el predeterminado para todos los usuarios con sesión iniciada, y los niveles de pago pueden seleccionar manualmente GPT-5.5 Instant o GPT-5.5 Thinking desde el selector de modelo.

2. ¿GPT-5.5 Instant está disponible en la API?

OpenAI dice que GPT-5.5 Instant se está desplegando en la API como chat-latest, mientras que la documentación del modelo de la API usa gpt-5.5 como el slug orientado a desarrolladores.

3. ¿Cuál es la diferencia entre GPT-5.5 Instant y GPT-5.5 Thinking?

GPT-5.5 Instant es el predeterminado rápido y de baja latencia optimizado para el uso diario y ChatGPT. Las variantes GPT-5.5 (y Pro) ofrecen razonamiento más profundo para tareas complejas y de múltiples pasos con mayor latencia y costo. OpenAI dice que Thinking lleva mejor el seguimiento de pasos previos y puede mostrar un breve preámbulo antes de empezar a razonar.

4. ¿Qué API debo usar con GPT-5.5?

OpenAI recomienda Responses API para razonamiento, llamadas a herramientas y casos de uso multi-turno.

5. ¿Con qué configuración de razonamiento debería empezar?

OpenAI recomienda empezar con medium, luego probar low para cargas sensibles a latencia o high y xhigh solo cuando la evaluación muestre una ganancia de calidad medible.

6. ¿Puede GPT-5.5 manejar flujos con muchas herramientas?

Sí. OpenAI dice que GPT-5.5 es especialmente útil en superficies de herramientas amplias, flujos de servicio multi-paso y tareas de agentes de larga duración, con mayor precisión en la selección de herramientas y uso de argumentos.

7. ¿Por qué un equipo usaría CometAPI en lugar de ir directo?

CometAPI se posiciona como un gateway unificado estilo OpenAI con una clave de API, acceso a 500+ modelos y menor fricción al cambiar de proveedor.

Conclusión y próximos pasos

GPT-5.5 Instant eleva el estándar de la IA accesible y confiable. Ya sea que mejores flujos en ChatGPT o construyas la próxima generación de productos potenciados por IA, dominar su acceso y uso es esencial.

¿Listo para integrar? Empieza con CometAPI para acceder al instante a GPT-5.5 Instant y a toda la familia GPT-5.5 con tarifas competitivas. Regístrate gratis, explora el playground y despliega en minutos con compatibilidad familiar con el SDK de OpenAI.