DeepSeek lanzó un experimental modelo llamado DeepSeek-V3.2-Exp on 29 de Septiembre de 2025, introduciendo un nuevo mecanismo de atención dispersa (DeepSeek Sparse Attention o DSA) que busca reducir significativamente los costos de inferencia para cargas de trabajo de contexto extenso. Simultáneamente, la compañía redujo los precios de la API aproximadamente a la mitad. Esta guía explica en qué consiste el modelo, su arquitectura y características destacadas, cómo acceder y usar la API (con ejemplos de código), cómo se compara con modelos anteriores de DeepSeek y cómo analizar y gestionar sus respuestas en producción.

¿Qué es DeepSeek-V3.2-Exp?

DeepSeek-V3.2-Exp es una iteración experimental en el desarrollo V3 de DeepSeek. El lanzamiento, anunciado a finales de septiembre de 2025, se posiciona como un paso intermedio que valida las optimizaciones arquitectónicas para longitudes de contexto extendidas, más que como un gran salto en la precisión bruta. Su principal innovación es Atención dispersa de DeepSeek (DSA), un patrón de atención que atiende selectivamente partes de una entrada larga para reducir los costos de cómputo y memoria mientras intenta mantener una calidad de salida comparable a V3.1-Terminus.

Por qué es importante en la práctica:

- Costo de las tareas de contexto largo: DSA se centra en el coste cuadrático de la atención, reduciendo el cómputo para entradas muy largas (como la recuperación de múltiples documentos, transcripciones extensas o mundos de juego extensos). Los costes de uso de la API son significativamente menores para casos de uso típicos de contexto largo.

- Compatibilidad y accesibilidad: La API de DeepSeek utiliza un formato de solicitud compatible con OpenAI, por lo que muchos flujos de trabajo de OpenAI SDK existentes se pueden adaptar rápidamente.

¿Cuáles son las principales características y arquitectura de DeepSeek V3.2-Exp?

¿Qué es DeepSeek Sparse Attention (DSA) y cómo funciona?

DSA es una atención dispersa de grano fino Esquema diseñado para atender selectivamente a tokens en lugar de computar la atención densa en todo el contexto. En resumen:

- El modelo selecciona dinámicamente subconjuntos de tokens a los que prestar atención en cada capa o bloque, lo que reduce los FLOP para longitudes de entrada largas.

- La selección está diseñada para preservar el contexto “importante” para las tareas de razonamiento, aprovechando una combinación de políticas de selección aprendidas y heurísticas de enrutamiento.

DSA, la innovación principal de la versión 3.2-Exp, busca mantener una calidad de salida similar a la de los modelos de atención densa, a la vez que reduce el coste de inferencia, especialmente cuando aumenta la longitud del contexto. Las notas de la versión y la página del modelo destacan que las configuraciones de entrenamiento se alinearon con la versión 3.1-Terminus, por lo que las diferencias en las métricas de referencia reflejan el mecanismo de atención dispersa y no un cambio general en el entrenamiento.

¿Qué otras arquitecturas/características vienen con V3.2-Exp?

- Modos híbridos (pensamiento vs. no pensamiento): DeepSeek expone dos identificadores de modelo:

deepseek-chat(sin pensar / respuestas más rápidas) ydeepseek-reasoner(Modo de pensamiento que permite exponer contenido de cadena de pensamiento o razonamiento intermedio). Estos modos permiten a los desarrolladores elegir entre velocidad y transparencia de razonamiento explícito. - Ventanas de contexto muy grandes: La familia V3.x admite contextos muy grandes (la línea V3 brinda a DeepSeek 128K opciones de contexto en las actualizaciones actuales), lo que la hace adecuada para flujos de trabajo de múltiples documentos, registros largos y agentes con gran cantidad de conocimiento.

- Salida JSON y llamada de función estricta (Beta): La API admite una

response_formatObjeto que puede forzar la salida JSON (y una beta estricta de llamadas a funciones). Esto es útil cuando se necesitan salidas predecibles y analizables por máquina para la integración de herramientas. - Tokens de transmisión y razonamiento: La API admite respuestas de transmisión y, para los modelos de razonamiento, tokens de contenido de razonamiento distintos (a menudo expuestos bajo

reasoning_content), que permite visualizar o auditar los pasos intermedios del modelo.

¿Cómo accedo y uso la API DeepSeek-V3.2-Exp a través de CometAPI?

DeepSeek mantiene intencionalmente un formato de API similar al de OpenAI, lo que permite redirigir los SDK de OpenAI existentes o las herramientas compatibles con una URL base diferente. Recomiendo usar CometAPI para acceder a DeepSeek-V3.2-Exp por su bajo costo y su función de puerta de enlace de agregación multimodal. DeepSeek expone nombres de modelos que se corresponden con el comportamiento de V3.2-Exp. Ejemplos:

DeepSeek-V3.2-Exp-thinking — modo de razonamiento/pensamiento asignado a V3.2-Exp.

DeepSeek-V3.2-Exp-thinking — modo de no razonamiento/chat asignado a V3.2-Exp.

¿Cómo me autentico y cuál es la URL base?

- Obtén una clave API desde la consola para desarrolladores de CometAPI (aplicar en su sitio).

- URL base: (

https://api.cometapi.comorhttps://api.cometapi.com/v1para rutas compatibles con OpenAI). La compatibilidad con OpenAI significa que muchos SDK de OpenAI pueden redireccionarse a DeepSeek con pequeños cambios.

¿Qué ID de modelo debo utilizar?

DeepSeek-V3.2-Exp-thinking— Modo de pensamiento, que expone contenido de cadena de pensamiento/razonamiento. Ambos se actualizaron a la versión 3.2-Exp en las últimas notas de la versión.DeepSeek-V3.2-Exp-nothinking— sin pensar, respuestas más rápidas, uso típico de chat/finalización.

Ejemplo: solicitud curl simple (finalización del chat)

curl -s https://api.cometapi.com/v1/chat/completions \

-H "Authorization: Bearer $cometapi_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "deepseek-v3.2-exp",

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the attached meeting transcript in 3 bullet points."}

],

"max_tokens": 512,

"stream": false

}'

Ejemplo: Python (patrón de cliente compatible con OpenAI)

Este patrón funciona tras apuntar un cliente OpenAI a la URL base de CometAPI (o usar el SDK de CometAPI). El siguiente ejemplo sigue el estilo de la documentación de DeepSeek:

import os

import requests

API_KEY = os.environ

url = "https://api.deepseek.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

payload = {

"model": "deepseek-v3.2-exp",

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Extract action items from the following notes..."}

],

"max_tokens": 800

}

r = requests.post(url, headers=headers, json=payload)

r.raise_for_status()

print(r.json())

No se requiere ningún SDK especial — pero si ya usas el SDK de OpenAI, a menudo puedes reconfigurarlo base_url y api_key y mantener los mismos patrones de llamada.

Uso avanzado: habilitar el razonamiento o reasoning_content

Si necesita la cadena de pensamiento interna del modelo (para auditoría, destilación o extracción de pasos intermedios), cambie a DeepSeek-V3.2-Exp-thinking. El reasoning_content El campo (y el flujo o tokens relacionados) está disponible en la respuesta para el modo de razonamiento; los documentos de la API proporcionan reasoning_content Como campo de respuesta para inspeccionar el CoT generado antes de la respuesta final. Nota: La exposición de estos tokens puede afectar la facturación, ya que forman parte de la salida del modelo.

Transmisión y actualizaciones parciales

- Use

"stream": trueen solicitudes para recibir deltas de tokens a través de SSE (eventos enviados por el servidor). stream_optionsyinclude_usagele permite ajustar cómo y cuándo aparecen los metadatos de uso durante una transmisión (útil para interfaces de usuario incrementales).

¿Cómo se compara DeepSeek-V3.2-Exp con los modelos DeepSeek anteriores?

V3.2-Exp frente a V3.1-Terminus

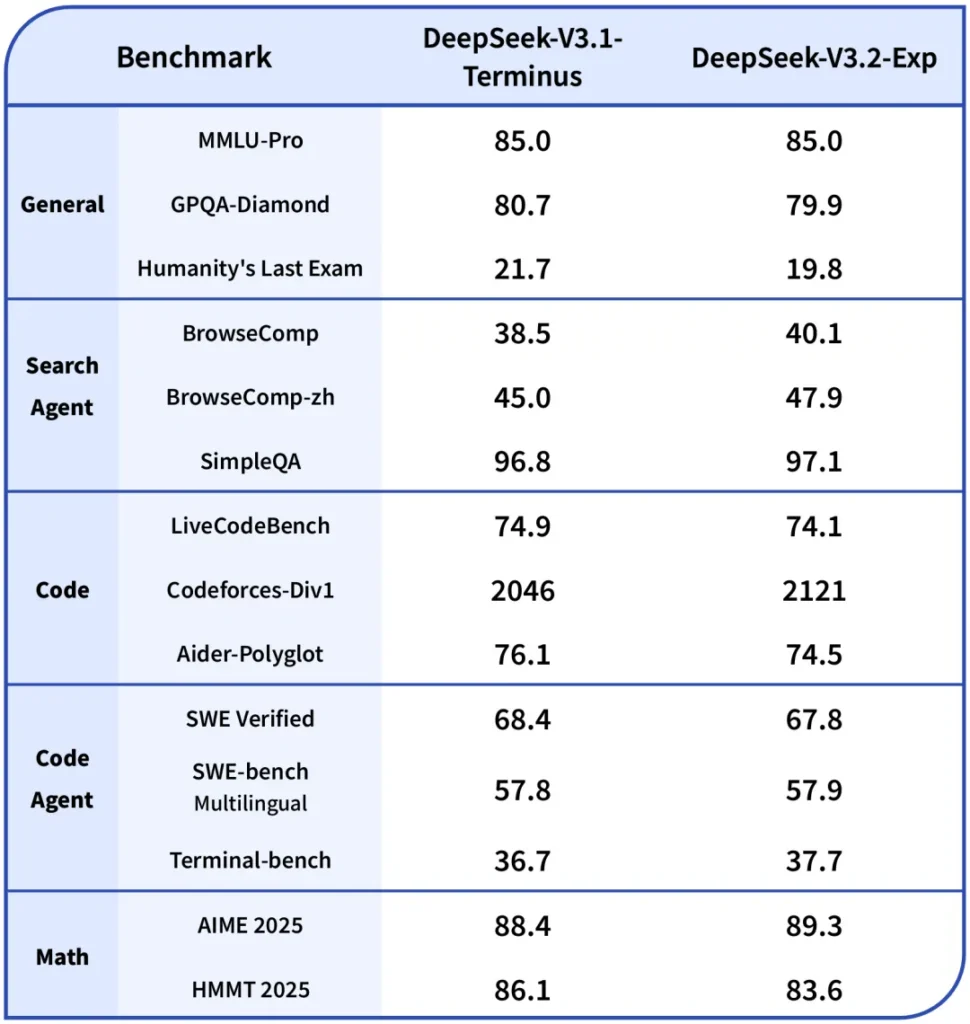

- Diferencia principal: La versión 3.2-Exp introduce el mecanismo de atención dispersa para reducir el cómputo en contextos largos, manteniendo el resto de la receta de entrenamiento alineada con la versión 3.1. Esto permitió a DeepSeek realizar una comparación más precisa y precisa de las mejoras de eficiencia. ()

- Puntos de referencia: Las notas públicas indican que V3.2-Exp funciona aproximadamente a la par de V3.1 en muchas tareas de razonamiento/codificación y al mismo tiempo es notablemente más económico en contextos largos; tenga en cuenta que las tareas específicas aún pueden tener regresiones menores dependiendo de cómo la escasez de atención interactúa con las interacciones de tokens requeridas.

V3.2-Exp vs R1 / Versiones anteriores

- Las líneas R1 y V3 siguen objetivos de diseño diferentes (históricamente, R1 se centraba en diferentes compensaciones arquitectónicas y capacidades multimodales en algunas ramas). V3.2-Exp es una mejora de la familia V3, enfocada en contextos largos y rendimiento. Si su carga de trabajo se centra en pruebas de referencia de precisión bruta de un solo turno, las diferencias pueden ser leves; si opera con pipelines multidocumento, el perfil de costos de V3.2-Exp probablemente sea más atractivo.

Dónde acceder a Claude Sonnet 4.5

CometAPI es una plataforma API unificada que integra más de 500 modelos de IA de proveedores líderes, como la serie GPT de OpenAI, Gemini de Google, Claude de Anthropic, Midjourney, Suno y más, en una única interfaz intuitiva para desarrolladores. Al ofrecer autenticación, formato de solicitudes y gestión de respuestas consistentes, CometAPI simplifica drásticamente la integración de las capacidades de IA en sus aplicaciones. Ya sea que esté desarrollando chatbots, generadores de imágenes, compositores musicales o canales de análisis basados en datos, CometAPI le permite iterar más rápido, controlar costos y mantenerse independiente del proveedor, todo mientras aprovecha los últimos avances del ecosistema de IA.

Los desarrolladores pueden acceder DeepSeek V3.2 Exp a través de CometAPI, la última versión del modelo Se actualiza constantemente con el sitio web oficial. Para empezar, explora las capacidades del modelo en el Playground y consultar el Guía de API Para obtener instrucciones detalladas, consulte la sección "Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y de haber obtenido la clave API". CometAPI Ofrecemos un precio muy inferior al oficial para ayudarte a integrarte.

¿Listo para ir?→ Regístrate en CometAPI hoy !

Conclusión

DeepSeek-V3.2-Exp es una versión experimental pragmática que busca abaratar y hacer más viable el trabajo en contextos extensos, a la vez que preserva la calidad de salida de la V3. Para equipos que trabajan con documentos extensos, transcripciones o razonamiento multidocumental, es recomendable realizar una prueba piloto: la API sigue una interfaz estilo OpenAI que facilita la integración y destaca tanto el mecanismo DSA como las importantes reducciones de precio que revolucionan el cálculo económico de la construcción a escala. Como con cualquier modelo experimental, la evaluación exhaustiva, la instrumentación y la implementación por etapas son esenciales.