En 2025–2026, el panorama de las herramientas de IA siguió consolidándose: las APIs pasarela (como CometAPI) se ampliaron para ofrecer acceso de estilo OpenAI a cientos de modelos, mientras que las aplicaciones LLM para usuarios finales (como AnythingLLM) continuaron mejorando su proveedor “Generic OpenAI” para permitir que las apps de escritorio y orientadas a lo local llamen a cualquier endpoint compatible con OpenAI. Esto hace que hoy sea sencillo enrutar el tráfico de AnythingLLM a través de CometAPI y obtener los beneficios de la elección de modelos, el enrutamiento por costos y la facturación unificada — manteniendo al mismo tiempo la interfaz local de AnythingLLM y sus funciones de RAG/agentes.

¿Qué es AnythingLLM y por qué querrías conectarlo a CometAPI?

¿Qué es AnythingLLM?

AnythingLLM es una aplicación de IA de código abierto, todo en uno, y un cliente local/nube para crear asistentes de chat, flujos de generación aumentada con recuperación (RAG) y agentes impulsados por LLM. Ofrece una interfaz pulida, una API para desarrolladores, funciones de espacios de trabajo/agentes y compatibilidad con LLMs locales y en la nube — diseñada para ser privada por defecto y extensible mediante plugins. AnythingLLM expone un proveedor Generic OpenAI que le permite comunicarse con APIs de LLM compatibles con OpenAI.

¿Qué es CometAPI?

CometAPI es una plataforma comercial de agregación de APIs que expone 500+ modelos de IA a través de una única interfaz REST al estilo OpenAI y facturación unificada. En la práctica, te permite invocar modelos de múltiples proveedores (OpenAI, Anthropic, variantes de Google/Gemini, modelos de imagen/audio, etc.) mediante los mismos endpoints https://api.cometapi.com/v1 y una sola clave de API (formato sk-xxxxx). CometAPI admite endpoints estándar al estilo OpenAI como /v1/chat/completions, /v1/embeddings, etc., lo que facilita adaptar herramientas que ya soportan APIs compatibles con OpenAI.

¿Por qué integrar AnythingLLM con CometAPI?

Tres razones prácticas:

- Elección de modelos y flexibilidad de proveedor: AnythingLLM puede usar “cualquier LLM compatible con OpenAI” a través de su contenedor Generic OpenAI. Apuntar ese contenedor a CometAPI brinda acceso inmediato a cientos de modelos sin cambiar la UI ni los flujos de AnythingLLM.

- Optimización de costos/operación: Usar CometAPI permite cambiar de modelos (o pasar a otros más económicos) de forma centralizada para controlar costos y mantener facturación unificada, en lugar de gestionar múltiples claves de proveedores.

- Experimentación más rápida: Puedes hacer A/B de distintos modelos (p. ej.,

gpt-4o,gpt-4.5, variantes de Claude u open-source multimodales) desde la misma UI de AnythingLLM — útil para agentes, respuestas RAG, resumen y tareas multimodales.

¿Qué entorno y condiciones debes preparar antes de integrar?

Requisitos de sistema y software (alto nivel)

- Escritorio o servidor con AnythingLLM (Windows, macOS, Linux) — instalación de escritorio o instancia autoalojada. Confirma que usas una versión reciente que exponga las opciones LLM Preferences / AI Providers.

- Cuenta de CometAPI y una clave de API (el secreto estilo

sk-xxxxx). Usarás este secreto en el proveedor Generic OpenAI de AnythingLLM. - Conectividad de red desde tu máquina a

https://api.cometapi.com(sin firewall que bloquee HTTPS saliente). - Opcional pero recomendado: un entorno moderno de Python o Node para pruebas (Python 3.10+ o Node 18+), curl y un cliente HTTP (Postman / HTTPie) para verificar CometAPI antes de conectarlo a AnythingLLM.

Condiciones específicas de AnythingLLM

El proveedor LLM Generic OpenAI es la vía recomendada para endpoints que imitan la superficie del API de OpenAI. La documentación de AnythingLLM advierte que este proveedor está orientado a desarrolladores y debes entender los parámetros que suministras. Si usas streaming o tu endpoint no lo admite, AnythingLLM incluye un ajuste para desactivar el streaming en Generic OpenAI.

Lista de verificación de seguridad y operaciones

- Trata la clave de CometAPI como cualquier otro secreto — no la subas a repos; guárdala en llaveros del SO o variables de entorno cuando sea posible.

- Si planeas usar documentos sensibles en RAG, asegúrate de que las garantías de privacidad del endpoint cumplan tus requisitos de cumplimiento (consulta la documentación/términos de CometAPI).

- Define límites de tokens máximos y de ventana de contexto para prevenir facturación descontrolada.

¿Cómo configuras AnythingLLM para usar CometAPI (paso a paso)?

A continuación se muestra una secuencia concreta — seguida de variables de entorno de ejemplo y fragmentos de código para probar la conexión antes de guardar los ajustes en la UI de AnythingLLM.

Paso 1 — Obtén tu clave de CometAPI

- Regístrate o inicia sesión en CometAPI.

- Ve a “API Keys” y genera una clave — obtendrás una cadena con aspecto

sk-xxxxx. Mantenla en secreto.

Paso 2 — Verifica que CometAPI funciona con una solicitud rápida

Usa curl o Python para llamar a un endpoint simple de chat completions y confirmar la conectividad.

Ejemplo con curl

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

Si esto devuelve 200 y una respuesta JSON con un array choices, tu clave y red están funcionando. (La documentación de CometAPI muestra la superficie y los endpoints al estilo OpenAI).

Ejemplo en Python (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

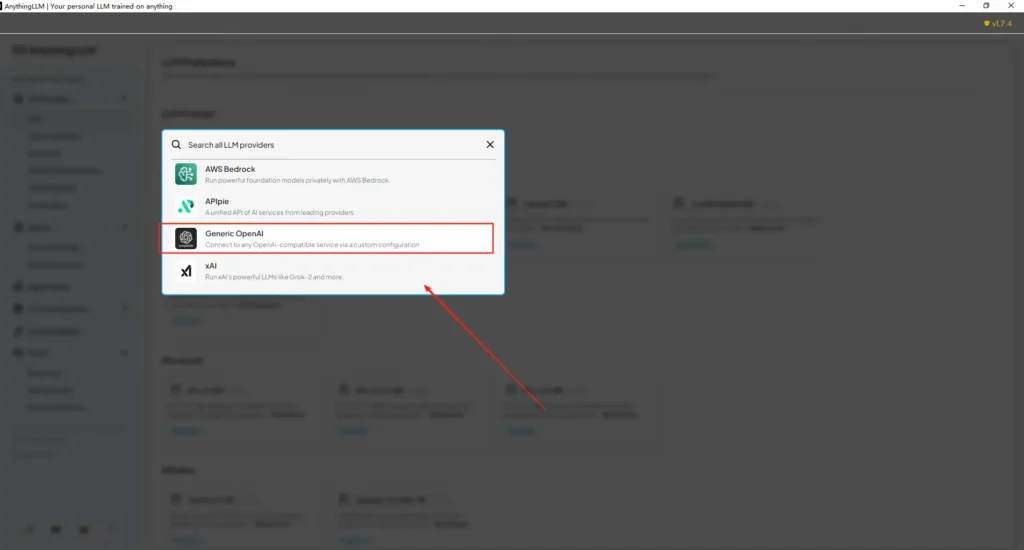

Paso 3 — Configura AnythingLLM (UI)

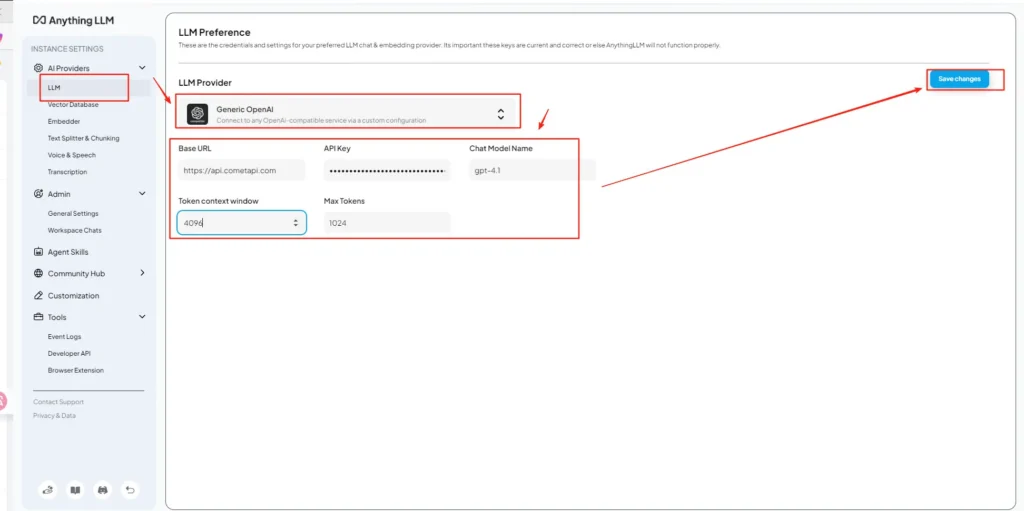

Abre AnythingLLM → Settings → AI Providers → LLM Preferences (o ruta similar en tu versión). Usa el proveedor Generic OpenAI y completa los campos así:

API Configuration (example)

• Entra al menú de ajustes de AnythingLLM, localiza LLM Preferences dentro de AI Providers.

• Selecciona Generic OpenAI como proveedor del modelo, introducehttps://api.cometapi.com/v1en el campo URL.

• Pega elsk-xxxxxde CometAPI en el campo de clave de API. Completa Token context window y Max Tokens según el modelo concreto. También puedes personalizar nombres de modelos en esta página, como añadir el modelogpt-4o.

Esto se alinea con la guía “Generic OpenAI” de AnythingLLM (wrapper para desarrolladores) y el enfoque de URL base compatible con OpenAI de CometAPI.

Paso 4 — Define nombres de modelo y límites de tokens

En la misma pantalla de ajustes, añade o personaliza los nombres de modelo exactamente como los publica CometAPI (p. ej., gpt-4o, minimax-m2, kimi-k2-thinking) para que la UI de AnythingLLM pueda presentarlos a los usuarios. CometAPI publica las cadenas de modelo para cada proveedor.

Paso 5 — Prueba en AnythingLLM

Inicia un chat nuevo o usa un espacio de trabajo existente, selecciona el proveedor Generic OpenAI (si tienes múltiples proveedores), elige uno de los nombres de modelo de CometAPI que agregaste y ejecuta un prompt simple. Si obtienes completions coherentes, la integración está lista.

Cómo usa AnythingLLM esas configuraciones internamente

El contenedor Generic OpenAI de AnythingLLM construye solicitudes al estilo OpenAI (/v1/chat/completions, /v1/embeddings), de modo que, una vez que indiques la URL base y proporciones la clave de CometAPI, AnythingLLM enrutará chats, llamadas de agentes y solicitudes de embeddings mediante CometAPI de forma transparente. Si usas agentes de AnythingLLM (los flujos @agent), heredarán el mismo proveedor.

¿Cuáles son las mejores prácticas y posibles escollos?

Mejores prácticas

- Usa configuraciones de contexto apropiadas al modelo: Alinea Token Context Window y Max Tokens de AnythingLLM con el modelo que elijas en CometAPI. Un desajuste provoca truncados inesperados o fallos.

- Protege tus claves de API: Guarda las claves de CometAPI en variables de entorno y/o gestores de secretos/Kubernetes; nunca las subas a git. AnythingLLM almacenará claves en sus ajustes locales si las introduces en la UI — trata ese almacenamiento del host como sensible.

- Empieza con modelos más baratos/pequeños para flujos de prueba: Usa CometAPI para probar modelos de menor costo en desarrollo y reserva los premium para producción. CometAPI anuncia explícitamente el cambio por costos y facturación unificada.

- Monitorea el uso y configura alertas: CometAPI ofrece paneles de uso — define presupuestos/alertas para evitar facturas sorpresa.

- Prueba agentes y herramientas en aislamiento: Los agentes de AnythingLLM pueden desencadenar acciones; pruébalos con prompts seguros y primero en instancias de staging.

Errores comunes

- Conflictos entre UI y

.env: Al autoalojar, los ajustes de la UI pueden sobrescribir cambios en.env(y viceversa). Revisa el/app/server/.envgenerado si algo vuelve al estado anterior tras reiniciar. La comunidad ha reportado reinicios deLLM_PROVIDER. - Desajustes en nombres de modelo: Usar un nombre de modelo no disponible en CometAPI provocará un 400/404 desde la pasarela. Confirma siempre los modelos disponibles en la lista de modelos de CometAPI.

- Límites de tokens y streaming: Si necesitas respuestas en streaming, verifica que el modelo de CometAPI lo soporte (y que tu versión de la UI de AnythingLLM también). Algunos proveedores difieren en la semántica de streaming.

¿Qué casos de uso reales habilita esta integración?

Generación aumentada con recuperación (RAG)

Usa los cargadores de documentos + base vectorial de AnythingLLM con LLMs de CometAPI para generar respuestas conscientes del contexto. Puedes experimentar con embeddings económicos + modelos de chat más costosos, o mantener todo en CometAPI para facturación unificada. Los flujos RAG de AnythingLLM son una de sus funciones principales.

Automatización con agentes

AnythingLLM admite flujos @agent (navegar páginas, llamar herramientas, ejecutar automatizaciones). Enrutar las llamadas LLM de los agentes mediante CometAPI te da elección de modelos para pasos de control/interpretación sin modificar el código del agente.

Pruebas A/B multimodelo y optimización de costos

Cambia de modelos por espacio de trabajo o función (p. ej., gpt-4o para respuestas en producción, gpt-4o-mini para desarrollo). CometAPI hace triviales los cambios de modelo y centraliza costos.

Flujos multimodales

CometAPI ofrece modelos de imagen, audio y especializados. La compatibilidad multimodal de AnythingLLM (vía proveedores) más los modelos de CometAPI permiten subtitulado de imágenes, resúmenes multimodales o transcripción de audio mediante la misma interfaz.

Conclusión

CometAPI sigue posicionándose como una pasarela multi-modelo (500+ modelos, API al estilo OpenAI), lo que lo convierte en un socio natural para apps como AnythingLLM que ya admiten un proveedor Generic OpenAI. Del mismo modo, el proveedor genérico y las opciones de configuración recientes de AnythingLLM hacen sencillo conectarse a estas pasarelas. Esta convergencia simplifica la experimentación y la migración a producción a finales de 2025.

Cómo empezar con CometAPI

CometAPI es una plataforma de API unificada que agrega más de 500 modelos de IA de proveedores líderes — como la serie GPT de OpenAI, Gemini de Google, Claude de Anthropic, Midjourney, Suno y más — en una única interfaz fácil para desarrolladores. Al ofrecer autenticación consistente, formateo de solicitudes y manejo de respuestas, CometAPI simplifica drásticamente la integración de capacidades de IA en tus aplicaciones. Ya estés creando chatbots, generadores de imágenes, compositores de música o pipelines analíticos basados en datos, CometAPI te permite iterar más rápido, controlar costos y mantenerte independiente del proveedor — mientras aprovechas los últimos avances en todo el ecosistema de IA.

Para comenzar, explora las capacidades de modelos deCometAPI en el Playground y consulta la guía de la API para instrucciones detalladas. Antes de acceder, asegúrate de haber iniciado sesión en CometAPI y haber obtenido la clave de API. CometAPI ofrece un precio muy inferior al oficial para ayudarte a integrar.

¿Listo para empezar?→ Regístrate en CometAPI hoy ¡

Si quieres conocer más consejos, guías y novedades sobre IA, síguenos en VK, X y Discord!