El 5 de febrero de 2026, Anthropic presentó Claude Opus 4.6, el nuevo buque insignia de la familia Claude. Opus 4.6 redobla su apuesta por el trabajo de conocimiento a largo plazo y los flujos de trabajo de software basados en agentes: se entrega con una ventana de contexto beta de 1,000,000 tokens, una coordinación refinada de múltiples agentes llamada Agent Teams, y un sistema de razonamiento adaptativo (Adaptive Thinking) gobernado por un control de effort. El modelo está disponible a través de la Claude Developer Platform y de APIs de agregadores de terceros (por ejemplo, CometAPI) y se presenta como una mejora de reemplazo directo para muchos casos de uso de Claude.

Qué es Claude Opus 4.6

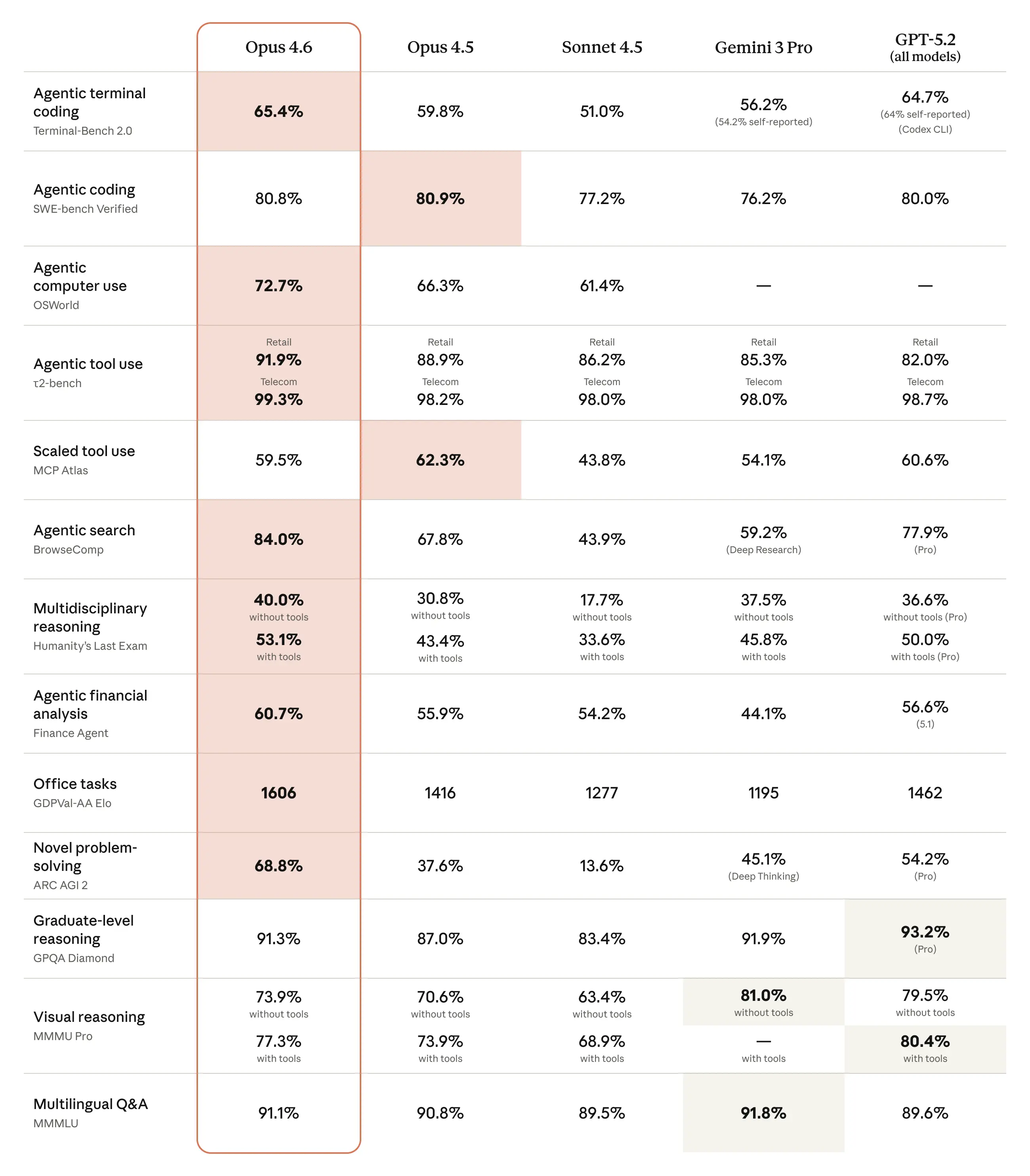

Claude Opus 4.6 es el modelo de clase Opus más reciente de Anthropic, posicionado como su modelo más capaz hasta la fecha para programación, flujos de trabajo basados en agentes y razonamiento con contexto largo. La publicación prioriza tareas “agénticas” de larga duración (piensa en migraciones de código por etapas, refactorizaciones de múltiples archivos o agentes de investigación coordinados), procesamiento intensivo de documentos e integraciones empresariales. Anthropic describe Opus 4.6 como una actualización casi de reemplazo directo respecto a 4.5, pero con varios cambios de comportamiento y capacidad que son importantes para los implementadores.

Capacidades clave de Claude Opus 4.6 que conviene conocer de inmediato

- Ventana de contexto de 1M tokens (beta): Opus 4.6 introduce una ventana de contexto muy grande (Anthropic la ofrece en beta), lo que permite al modelo ver y razonar sobre documentos extremadamente grandes o repositorios de código completos en una sola sesión. Esto hace que tareas como refactorizaciones de repositorios completos, revisiones legales extensas y síntesis multidocumento sean mucho más prácticas.

- Agent Teams: Opus 4.6 amplía las capacidades de agentes al habilitar grupos coordinados de agentes (Agent Teams): múltiples agentes Claude trabajando en paralelo en diferentes sub-tareas y compartiendo estado. Está diseñado para permitir que los sistemas descompongan problemas difíciles (p. ej., un agente centrado en la creación de pruebas, otro en la refactorización y un tercero en QA) y coordinen sus resultados.

- Adaptive Thinking (niveles de effort): En lugar de un interruptor binario de “thinking”, Opus 4.6 expone múltiples niveles de effort (p. ej., low/medium/high/max) que intercambian latencia y costo por cadenas de razonamiento más profundas y deliberación. Anthropic también expone mecanismos de control como la compacción de contexto para gestionar conversaciones largas de forma eficiente.

- Presupuesto de tokens de salida de 128K: Opus 4.6 duplica el presupuesto máximo de salida anterior (64K → 128K) para que el modelo pueda ofrecer salidas más largas y sostenidas sin truncamiento, útil para informes de varias partes o generación de código que abarque muchos archivos. Se recomienda el streaming para salidas tan grandes.

Otras mejoras prácticas incluyen mejores habilidades de codificación y depuración y opciones de modo/prioridad diseñadas para flujos de trabajo empresariales e integrados (la integración con Copilot ya se está desplegando en lugares como GitHub Copilot).

Por qué estas funciones importan (resumen rápido)

- La ventana de 1M tokens reduce la necesidad de ciclos de recuperación repetidos o de unir muchos documentos en múltiples llamadas: puedes mantener más contexto en una sola llamada, lo que simplifica la lógica de la aplicación para muchos flujos de trabajo intensivos en conocimiento.

- Agent Teams cambian la arquitectura: en lugar de un asistente monolítico, diseñas pequeños agentes especialistas que colaboran — más fácil paralelización, responsabilidades más claras y potencialmente mayor fiabilidad en tareas complejas.

- Adaptive Thinking te da controles previsibles para los intercambios entre tiempo y calidad. Eso es esencial para sistemas en producción donde la latencia, el determinismo y el costo son restricciones.

Cómo invocar Claude Opus 4.6 a través de CometAPI — paso a paso

Usando CometAPI para llamar a Opus 4.6

Muchos equipos prefieren una puerta de enlace unificada multi-modelo (cuando quieres normalizar el código cliente entre proveedores). CometAPI es uno de esos proveedores que expone muchos modelos de distintos fabricantes a través de una superficie compatible con OpenAI; y también se proporciona el formato de mensajes de Anthropic (cuando necesitas las capacidades específicas de compresión del API de Anthropic y quieres usar Claude Code vía CometAPI). Los ejemplos a continuación muestran patrones para uso en producción: autenticación, elección de modelo, habilitación de funciones de contexto largo, streaming y controles de costo. (Ajusta nombres y encabezados para que coincidan con el registro de modelos del proveedor si Comet cambia los identificadores de modelo).

Primeros pasos (lista de comprobación para desarrolladores)

- regístrate en CometAPI, obtén una

COMET_API_KEYy establece labase_urldel cliente ahttps://api.cometapi.com/v1(Comet ofrece clientes y ejemplos compatibles con OpenAI). La consola de Comet lista los modelos disponibles y cualquier bandera específica del proveedor que puedas pasar. - Decide las configuraciones de capacidades por adelantado:

thinking: {type: "adaptive"}, nivel deoutput_config.effort,max_tokens(presupuesto de salida), streaming para salidas grandes, y si se desea la compacción de contexto.

Claude API (pseudo estilo Python):

import anthropic

import os

# Get your CometAPI key from https://api.cometapi.com/console/token, and paste it here

COMETAPI_KEY = os.environ.get("COMETAPI_KEY") or "<YOUR_COMETAPI_KEY>"

BASE_URL = "https://api.cometapi.com"

client = anthropic.Anthropic(

base_url=BASE_URL,

api_key=COMETAPI_KEY,

)

message = client.messages.create(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "Hello, Claude"}],

)

print(message.content[0].text)

A través de CometAPI (ejemplo de shim compatible con OpenAI):

# Example using an OpenAI-like client pointed at CometAPI

from openai import OpenAI # or compatible client

client = OpenAI(api_key="COMET_KEY", base_url="https://api.cometapi.com/v1")

resp = client.responses.create(

model="claude-opus-4-6",

reasoning={"type":"adaptive"}, # if shim supports same param name

output_config={"effort":"medium"},

messages=[{"role":"user","content":"Generate a migration plan for this monorepo."}]

)

print(resp.output_text)

Nota: los nombres de parámetros en los wrappers de CometAPI varían según el SDK. CometAPI documenta un modelo de integración sencillo y comúnmente admite

model="claude-opus-4-6"; consulta la documentación de CometAPI para el mapeo exacto de campos y cualquier ajuste requerido en la forma de la solicitud.

Mejores prácticas y uso

Agent Teams: patrones de diseño y una receta breve

Cuándo usar Agent Teams: refactorizaciones de grandes bases de código, procesamiento de documentos en múltiples etapas y flujos de trabajo que se mapean de forma natural a agentes especialistas separados (p. ej., arquitecto, implementador, revisor).

Patrón sencillo de Agent Teams:

- Agente orquestador recibe la tarea general y la divide en sub-tareas.

- Agentes de trabajo (cada uno una instancia de Claude) se inician con prompts enfocados y criterios explícitos de éxito.

- Trabajo en paralelo: los workers se ejecutan en paralelo usando contextos independientes; los resultados se devuelven al orquestador.

- Fusión y revisión: el orquestador compacta las salidas, ejecuta una pasada de síntesis y una comprobación final de seguridad/revisión (usando

effort=maxpara la pasada final si es necesario).

Consejos prácticos:

- Da a cada subagente un prompt de sistema estricto y un

max_tokensacotado para evitar costos descontrolados. - Usa CometAPI o un framework de orquestación para gestionar llamadas paralelas y reintentos.

- Usa la compacción de contexto para el historial del orquestador, de modo que puedas preservar decisiones sin pagar por el historial literal completo.

Gestión del contexto: manejo de entradas grandes y la ventana de 1M tokens

- Prefiere la ingesta estructurada: alimenta documentos como piezas segmentadas (metadatos del documento + bloques de contenido). Mantén puntos de anclaje (títulos de documentos, índices) y pide al modelo que cite las fuentes por índice. Esto es más robusto que pegar archivos en bruto.

- Usa la compacción de contexto (donde esté disponible) para sesiones interactivas largas: deja que el modelo resuma los turnos más antiguos para no agotar el presupuesto de tokens, manteniendo los hechos relevantes. Anthropic ofrece la compacción como una capacidad beta.

- Si necesitas recuperación determinista, almacena artefactos canónicos en tu propia base de datos y haz referencia a ellos por ID en lugar de volver a empujar archivos completos en cada solicitud. Usa el modelo para resumir o extraer solo las partes que necesitas para un paso dado.

Intercambios entre costo, latencia y calidad — usando effort y otros controles

- Effort: el control más efectivo para equilibrar costo vs. capacidad. Empieza con

mediumpara sistemas en producción que requieren eficiencia; usahighomaxpara auditorías críticas, revisiones finales o tareas de síntesis complejas.lowes útil para recuperación rutinaria o preguntas y respuestas breves. Muchos equipos reportan excelentes ahorros de costo usandomediumpor defecto y elevandoeffortsolo cuando se requiere. - Batch y caché: usa caché de prompts para preguntas repetidas y procesamiento por lotes para muchas tareas pequeñas similares para reducir costos de reingesta de tokens. La plataforma de Anthropic y proveedores de terceros admiten modos de caché de prompts/por lotes.

- Streaming y salidas fragmentadas: cuando solicites salidas muy grandes (generación extensa de código, borradores de libros), usa streaming para reducir la presión de memoria y habilitar aceptación temprana/comportamiento de abortar.

Reflexiones finales — dónde Opus 4.6 cambia la ecuación del desarrollador

Opus 4.6 es un paso claro hacia la construcción de flujos de trabajo grandes, duraderos y agénticos sin tener que unir muchas solicitudes cortas. La ventana de 1M tokens y Agent Teams desbloquean nuevas clases de aplicaciones (automatización de grandes bases de código, revisiones legales/financieras extensas, asistentes de investigación multidocumento), pero también desplazan el énfasis del diseño desde micro-optimizaciones de prompt a diseño de sistemas: cómo almacenas artefactos, orquestas especialistas, mides y contienes el costo y supervisas el comportamiento de los agentes.

Los desarrolladores pueden acceder a Opus 4.6 a través de CometAPI ahora. Para comenzar, explora las capacidades del modelo en el Playground y consulta la Guía de la API para instrucciones detalladas. Antes de acceder, asegúrate de haber iniciado sesión en CometAPI y de haber obtenido la clave de API. CometAPI ofrece un precio muy inferior al oficial para ayudarte a integrar.

¿Listo para empezar?→ Regístrate en openclaw hoy !

Si quieres conocer más consejos, guías y noticias sobre IA, síguenos en VK, X y Discord!

.png&w=3840&q=75)