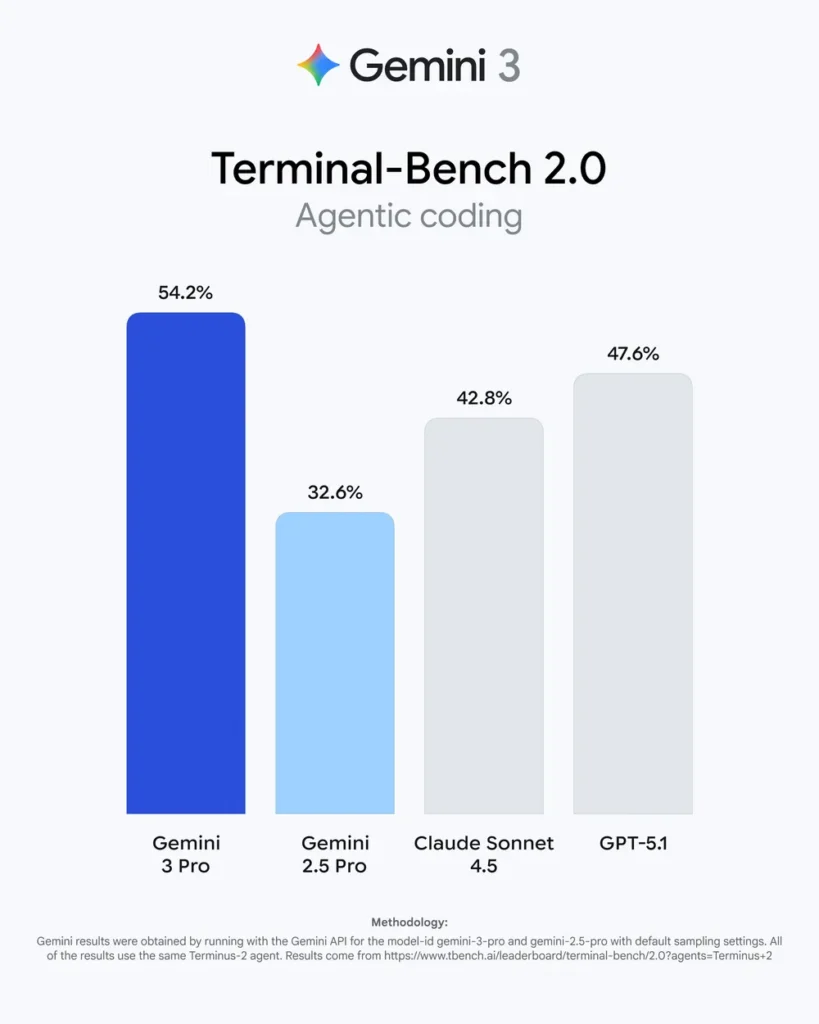

Google acaba de inaugurar la era de Gemini 3 con el lanzamiento en vista previa de Gemini 3 Pro, y las señales iniciales son inequívocas: es un gran paso adelante en razonamiento multimodal, agentes de programación y comprensión de contexto largo. El modelo se posiciona como el más capaz de Google en razonamiento y multimodalidad hasta la fecha, optimizado para flujos de trabajo basados en agentes, programación, tareas de contexto largo y comprensión multimodal. Incluye un nuevo modo de razonamiento “Deep Think”, presenta mejoras drásticas en benchmarks de agentes/código (Terminal-Bench 2.0 citado en 54.2%) y es utilizable de inmediato a través de Google AI Studio, la API (integraciones con Vertex AI) y herramientas para desarrolladores como Google Antigravity.

¿Qué es Gemini 3 Pro Preview?

Google presenta Gemini 3 como la nueva generación y el miembro más inteligente de la familia Gemini, centrado en un razonamiento más profundo, una comprensión multimodal más rica (texto, imágenes, video, audio, código) y un mejor comportamiento orientado a agentes (modelos que planifican y actúan con herramientas).

Características principales

- Comprensión multimodal nativa — diseñado para aceptar y razonar conjuntamente sobre texto, imágenes, audio y video (incluidos insumos largos/de video). Ideal para mezclar documentos, capturas de pantalla, transcripciones y video.

- Ventana de contexto enorme (hasta ~1,000,000 tokens) — puede ingerir/mantener en contexto documentos extremadamente largos, grandes bases de código u horas de transcripciones en una sola sesión. Es un punto clave de venta para investigación profunda, revisión de código y síntesis multi-documento.

- Capacidad para agentes y uso de herramientas — pensado para impulsar agentes autónomos que pueden invocar herramientas, operar terminales, gestionar planes de tareas y coordinar flujos de trabajo de múltiples pasos (usado en Google Antigravity y otras integraciones con IDE). Esto lo hace especialmente fuerte para programación, orquestación y automatización en múltiples pasos.

- Razonamiento y programación más sólidos — Google posiciona a Gemini 3 Pro como su mejor modelo “pensante” para tareas complejas de razonamiento, matemáticas y código (benchmarks mejorados y rendimiento superior en terminal/herramientas).

¿Qué hay de nuevo en Gemini 3 Pro frente a Gemini 2.5 Pro y otros?

¿Qué capacidades mejoraron más?

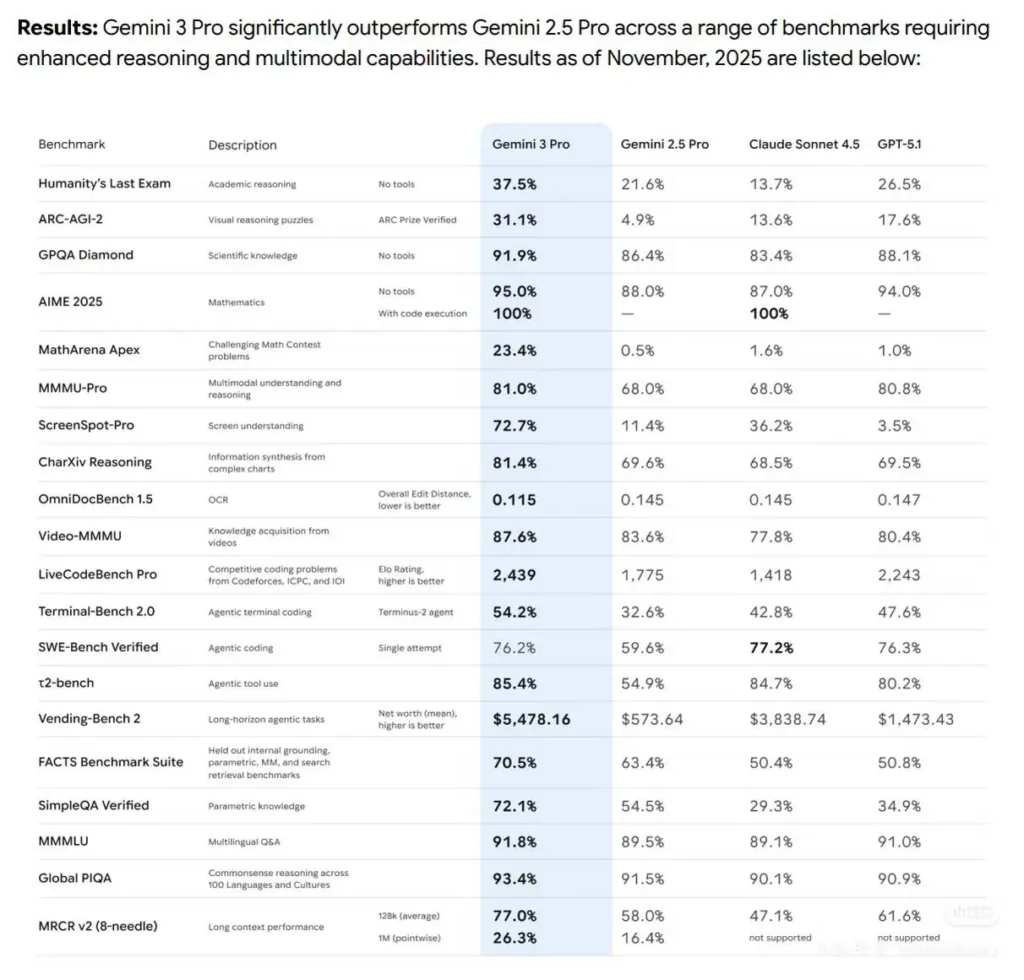

Se promociona Gemini 3 Pro como un gran avance en razonamiento (matemático y científico), razonamiento espacial/visual multimodal y uso de herramientas. Google destaca ganancias claras sobre Gemini 2.5 Pro en suites de benchmarks y en tareas agénticas del mundo real como programación y automatización por terminal. Métricas destacadas publicadas por el equipo incluyen:

| Benchmark / tarea | Gemini 3 Pro (reportado) | Gemini 2.5 Pro (reportado) | Brecha absoluta (pp) |

|---|---|---|---|

| Humanity’s Last Exam (razonamiento académico, sin herramientas) | 37.5% | 21.6% | +15.9. |

| GPQA Diamond (QA científica/factual) | 91.9% | 86.4% | +5.5. |

| AIME 2025 (matemáticas, sin herramientas) | 95.0% | 88.0% | +7.0. |

| AIME con ejecución de código | 100.0% | (2.5 Pro: — ) | — (3 Pro logra puntuación perfecta con ejecución). |

| ARC-AGI-2 (acertijos de razonamiento visual) | 31.1% | 4.9% | +26.2 — ganancia multimodal muy grande. |

| SimpleQA Verified (conocimiento paramétrico) | 72.1% | 54.5% | +17.6. |

Estos números indican que Gemini 3 Pro está optimizado para razonamiento de múltiples pasos, uso de herramientas complejo y tareas multimodales estrechamente integradas (p. ej., combinar fotogramas de video, razonamiento sobre gráficos y generación de código).

Herramientas de desarrollo centradas en agentes: Antigravity

Para demostrar flujos de trabajo agénticos, Google lanzó Antigravity — un IDE “agent-first” que utiliza Gemini 3 Pro como base para flujos de trabajo de programación con múltiples agentes. Antigravity permite que los agentes interactúen directamente con un editor, terminal y navegador, y produzcan “Artifacts” (listas de tareas, capturas de pantalla, registros del navegador) que documentan las acciones del agente, abordando la trazabilidad y reproducibilidad en el desarrollo agéntico. Esto hace que Gemini 3 Pro sea mucho más práctico para flujos de trabajo reales de desarrolladores que los modelos centrados únicamente en la generación de texto.

Mejor uso de herramientas y programación

Google informa mejoras notables en un benchmark centrado en terminal (Terminal-Bench 2.0) que mide la capacidad de un modelo para operar un computador vía terminal: Gemini 3 Pro obtiene 54.2% en esa prueba — un gran salto respecto a versiones anteriores de Gemini — lo que indica un progreso real en uso autónomo de herramientas y generación de código.

especialmente cuando se le pide ejecutar scripts, orquestar herramientas o gestionar tareas de desarrollo de múltiples pasos. En la práctica, eso significa menos alucinaciones al ejecutar comandos, mejor manejo de errores y mayor capacidad para recuperarse de pasos fallidos.

¿Cómo rinde Gemini 3 Pro en benchmarks?

Google publicó una amplia batería de comparaciones en la entrada del blog de Gemini 3 que abarcan razonamiento clásico de PLN, comprensión multimodal, generación de código y uso agéntico de herramientas. Cifras clave reportadas directamente por Google incluyen:

- LMArena: Gemini 3 Pro obtuvo 1501 Elo, una posición destacada en el ranking competitivo (mide razonamiento general/calidad de respuesta en enfrentamientos por pares).

- MMMU-Pro (benchmark multimodal): 81% — un aumento considerable frente a modelos anteriores.

- Video-MMMU: 87.6% en tareas multimodales con conciencia de video.

- SimpleQA Verified: 72.1%, lo que indica mejoras en QA factual para entradas complejas.

- WebDev Arena: 1487 Elo (desarrollo web/razonamiento de código).

- Terminal-Bench 2.0 & SWE-bench Verified: grandes saltos en uso agéntico de herramientas y rendimiento de agentes de programación.

- Deep Think: mejoras adicionales en las pruebas de mayor dificultad (p. ej., Humanity’s Last Exam subió de 37.5% a 41.0% en Deep Think en algunas métricas reportadas).

Todo esto indica un modelo afinado para la profundidad, más que para la mera generación superficial de texto.

Entonces: sí, Gemini 3 Pro se sitúa de forma consistente en el grupo superior en muchas pruebas actuales — pero “aplastar” depende de la tarea. Para generación de código pura, algunos competidores se mantienen codo a codo; para contexto largo, matemáticas y síntesis multimodal, con frecuencia se reporta que Gemini 3 Pro es el mejor de su clase en ejecuciones de inicios de noviembre/noviembre de 2025.

¿Cómo puedes acceder a Gemini 3 Pro Preview?

Vías oficiales de acceso

- Aplicación Gemini (consumidores / usuarios Pro): El modelo se está implementando en la aplicación Gemini como parte del lanzamiento de la era “Gemini 3”.

- Google AI Studio / Gemini Developer API: Los desarrolladores pueden experimentar a través de AI Studio y la API de Gemini. La API ofrece interfaces REST y SDK, y admite funciones avanzadas como llamadas a funciones y streaming.

- Vertex AI (Google Cloud): Empresas y equipos pueden acceder a Gemini 3 Pro mediante Vertex AI para flujos de trabajo de producción y MLOps. Vertex ofrece ejemplos en Python, Node, Java, Go y curl.

- Integraciones de terceros (CometAPI): CometAPI proporciona acceso a la API de Gemini 3 Pro, con el nombre de llamada gemini-3-pro-preview. CometAPI ofrece un precio muy inferior al oficial para ayudarte a integrar.

Inicio rápido: ejemplo en Python (patrón oficial del SDK)

A continuación se muestra un ejemplo mínimo y práctico, adaptado del inicio rápido de Gemini de Google, que demuestra cómo llamar a la API de Gemini mediante el cliente GenAI de Google. Sustituye GEMINI_API_KEY por tu clave de API obtenida en Google AI Studio o tu proyecto de GCP.

# Example: call Gemini 3 Pro Preview using Google GenAI Python SDK

# Requires: pip install google-generativeai

import os

from google import genai

# Set API key in environment:

# export GEMINI_API_KEY="YOUR_API_KEY"

client = genai.Client() # client picks up GEMINI_API_KEY from env

# Use the preview model identifier. The exact model ID may vary; use the ID listed in the API docs.

model_id = "gemini-3-pro-preview" # or "gemini-3-pro" depending on availability

prompt = """

You are an assistant that writes a short Python function to fetch JSON from a URL,

handle HTTP errors, and return parsed JSON or None on failure.

"""

resp = client.models.generate_content(model=model_id, contents=prompt)

print("MODEL RESPONSE:\n", resp.text)

Si eliges CometAPI, sustituye url por https://api.cometapi.com/v1/chat/completions y key por la clave que obtuviste de CometAPI.

Cómo obtener los mejores resultados — patrones de prompt y consejos

Usa el modo “thinking” para problemas difíciles

Si abordas razonamiento progresivo o tareas complejas de matemáticas/código, habilita la variante “thinking” de la vista previa (si está disponible): asigna más pasos internos de razonamiento y a menudo produce soluciones más fiables en tareas de múltiples etapas. Revisa los nombres de modelo para un sufijo -thinking en la consola.

Llamadas a funciones y orquestación de herramientas

Utiliza funciones declaradas (funcall en Vertex AI/GenAI) para obtener salidas estructuradas y reducir alucinaciones. Deja que el modelo proponga llamadas a función y ejecútalas de forma determinista en tu entorno. La documentación de llamadas a funciones incluye ejemplos de retorno de argumentos JSON tipados que puedes ejecutar con seguridad.

Grounding cuando necesitas hechos actualizados

Si tu aplicación depende de hechos actuales de la web, usa grounding, pero vigila los costos y límites de tasa de prompts con grounding. Grounding es potente — permite a Gemini consultar Search o Maps — pero cada prompt con grounding puede cambiar tu facturación y latencia.

Cómo se desempeña Gemini 3 Pro en tareas del mundo real (casos de uso)

Generación de código y productividad del desarrollador

Gemini 3 Pro mejora el razonamiento entre múltiples archivos, el contexto de repositorios grandes y la síntesis de pruebas/documentación junto con el código. Combinado con llamadas a funciones y un agente de terminal, puede estructurar y validar proyectos de tamaño medio más rápido que modelos anteriores. Las pruebas de la comunidad muestran puntuaciones elevadas en LiveCodeBench/Elo para programación.

Investigación y flujos de trabajo STEM

La capacidad Deep Think del modelo y un mayor presupuesto de razonamiento lo hacen adecuado para tareas de investigación que requieren derivaciones matemáticas de múltiples pasos, síntesis de conjuntos de datos o resumen de artículos de múltiples archivos. Los resultados tempranos en benchmarks lo sitúan en la cima o cerca de ella en muchos conjuntos STEM.

Diseño de contenido y flujos creativos multimodales

Las salidas multimodales de Gemini 3 Pro y su integración con Veo/Whisk/Flow lo convierten en una opción sólida para flujos de trabajo que mezclan texto, imágenes y video — desde guiones gráficos de marketing hasta borradores de video automatizados. Google agrupa ciertas herramientas para creadores en AI Ultra para quienes desean los límites más altos.

Conclusión: ¿Gemini 3 Pro aplasta a otros modelos?

Gemini 3 Pro Preview es un gran paso adelante. En una amplia gama de benchmarks y en pruebas tempranas del mundo real, con frecuencia lidera o empata con los mejores modelos disponibles a finales de 2025, particularmente en:

- Razonamiento complejo (matemáticas / STEM)

- Comprensión y síntesis multimodal

- Flujos de trabajo agénticos y llamadas a funciones

No obstante, el margen varía según la tarea. Para algunas tareas estrechamente definidas (ciertos estilos de escritura creativa o conocimiento de dominio muy especializado), otros modelos siguen siendo competitivos o preferibles según costo/latencia y ajuste al ecosistema. Los benchmarks y puntuaciones filtradas sugieren que Gemini 3 Pro suele situarse en el grupo superior, pero “aplastar” depende de la tarea; para muchos casos de uso empresariales y de desarrollo, Gemini 3 Pro es ahora el primer modelo a evaluar.

Cómo empezar con CometAPI

CometAPI es una plataforma de API unificada que agrega más de 500 modelos de IA de los principales proveedores — como la serie GPT de OpenAI, Gemini de Google, Claude de Anthropic, Midjourney, Suno y más — en una sola interfaz amigable para desarrolladores. Al ofrecer autenticación consistente, formato de solicitudes y manejo de respuestas uniformes, CometAPI simplifica drásticamente la integración de capacidades de IA en tus aplicaciones. Ya estés creando chatbots, generadores de imágenes, compositores de música o canalizaciones analíticas basadas en datos, CometAPI te permite iterar más rápido, controlar costos y mantenerte agnóstico del proveedor, aprovechando al mismo tiempo los últimos avances del ecosistema de IA.

Los desarrolladores pueden acceder a la API de vista previa de Gemini 3 Pro a través de CometAPI. Para comenzar, explora las capacidades del CometAPI en el Playground y consulta la guía de la API para instrucciones detalladas. Antes de acceder, asegúrate de haber iniciado sesión en CometAPI y de haber obtenido tu clave de API. CometAPI ofrece un precio muy inferior al oficial para ayudarte a integrar.

¿Listo para comenzar?→ Regístrate en CometAPI hoy mismo

Si quieres conocer más consejos, guías y noticias sobre IA, síguenos en VK, X y Discord.