Integrar CometAPI con n8n te permite potenciar tus automatizaciones con los modelos de IA más avanzados del mundo en solo tres pasos. Al usar una única credencial compatible con OpenAI, obtienes acceso instantáneo a más de 500 modelos, incluidos GPT 5.5, Claude Opus 4.7 y DeepSeek V4 Pro. Esta configuración es idéntica tanto para instancias de n8n en la nube como autoalojadas, proporcionando una base estable y de alta disponibilidad para tu automatización de flujos de trabajo de IA en n8n.

¿Qué es n8n y por qué importa?

n8n es una herramienta de automatización de flujos de trabajo de código abierto. Te permite conectar distintas apps, servicios y APIs para automatizar tareas, sin necesidad de escribir mucho código.

Qué hace

Piensa en n8n como una forma visual de construir automatizaciones:

- Creas flujos de trabajo con un editor de arrastrar y soltar

- Cada paso (llamado nodo) realiza una acción

- Los datos fluyen automáticamente de un paso al siguiente

Funciones clave

- Código abierto (puedes autoalojarlo)

- Compatible con cientos de integraciones (APIs, apps, bases de datos)

- Permite lógica JavaScript personalizada dentro de los flujos

- Puede ejecutarse en tu propio servidor o en el servicio en la nube en el sitio oficial de n8n

Por qué conectar n8n a CometAPI

Usar CometAPI como tu puerta de enlace central en n8n ofrece ventajas operativas significativas. Al reemplazar las claves separadas de OpenAI, Anthropic y Google por una sola credencial, tu equipo elimina la carga de gestionar múltiples cuentas de proveedores y ciclos de facturación complejos. Esta arquitectura garantiza cero dependencia de proveedor; puedes cambiar entre los últimos modelos de diferentes proveedores simplemente actualizando el nombre del modelo en la configuración del nodo, manteniendo tus flujos ágiles a medida que evoluciona el panorama de la IA.

CometAPI actúa como una API REST unificada que agrega más de 500 modelos para chat, imagen, video, audio (TTS/STT) y embeddings. Las ventajas clave incluyen:

- Endpoint compatible con OpenAI (

https://api.cometapi.com/v1): compatibilidad plug-and-play con nodos de OpenAI o solicitudes HTTP. - Precios un 20-40 % más bajos que los proveedores directos, con pago por uso, sin tarifas mensuales para lo básico y facturación unificada.

- Sin dependencia de proveedor: cambia de modelo con un solo parámetro.

- Funciones empresariales: enrutamiento con failover, analíticas, controles de privacidad (en algunas conversaciones se afirma que no se recopilan prompts) y acceso confiable.

Novedades (a mayo de 2026): CometAPI mantiene una integración verificada/partner en n8n.io, con un nodo comunitario dedicado (n8n-nodes-cometapi) disponible vía npm para instancias locales/autoalojadas. Los usuarios reportan compatibilidad fluida con los nodos de OpenAI y una adopción creciente para flujos multimodelo. Actualizaciones recientes de n8n mejoran las llamadas a herramientas y los nodos HTTP, haciendo las integraciones más robustas.

Primeros pasos: requisitos previos y configuración de la cuenta

Regístrate en CometAPI

Visita cometapi.com, crea una cuenta gratuita y genera una clave de API en el panel. Los nuevos usuarios suelen recibir créditos de prueba. Explora la lista de modelos y la página de precios.

Configura n8n

- Nube: n8n.cloud (gestionado, escalado sencillo).

- Autoalojado: Docker, npm o Kubernetes. Recomendado para privacidad de datos y ejecuciones ilimitadas. Guías recientes cubren la ejecución de nodos de CometAPI de forma local.

Actualiza a la última versión (p. ej., 2.20+ a mayo de 2026) para mejoras de IA y estabilidad.

Instala el nodo de CometAPI (opcional pero recomendado para self-hosted)

Usa el nodo de la comunidad:

npm install n8n-nodes-cometapi

Reinicia n8n. Aparecerá en el panel de nodos para una experiencia similar a la nativa.

Guía de configuración paso a paso

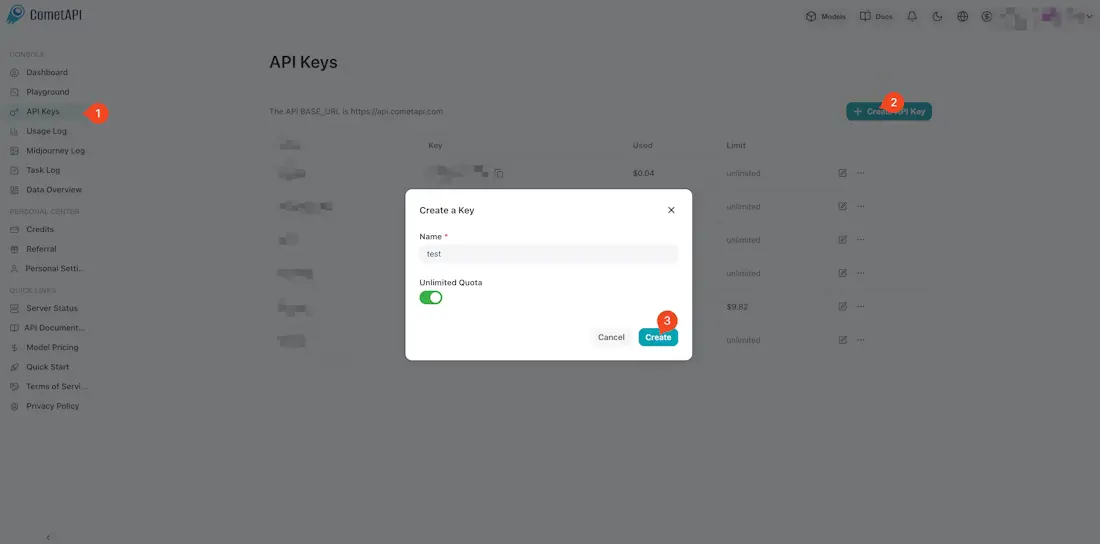

Paso 1: Obtén tu clave de API de CometAPI

Inicia sesión en el panel de CometAPI y navega a la sección API Token. Haz clic en Add API Key para generar tu credencial única.

Copia tu clave (normalmente con formato sk-xxxx) y ten a mano la Base URL: https://api.cometapi.com/v1.

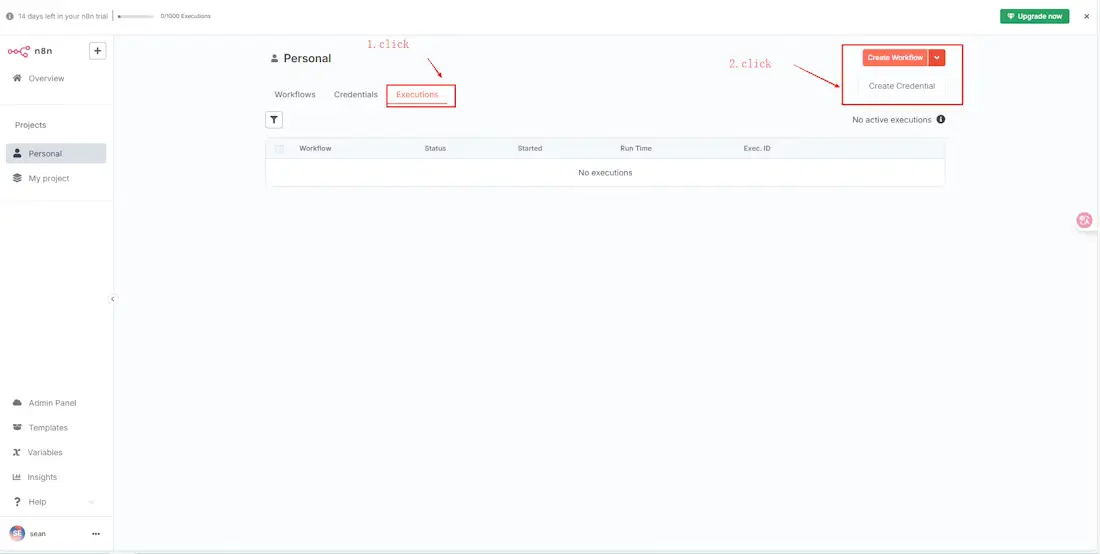

Paso 2: Crea una credencial de OpenAI en n8n

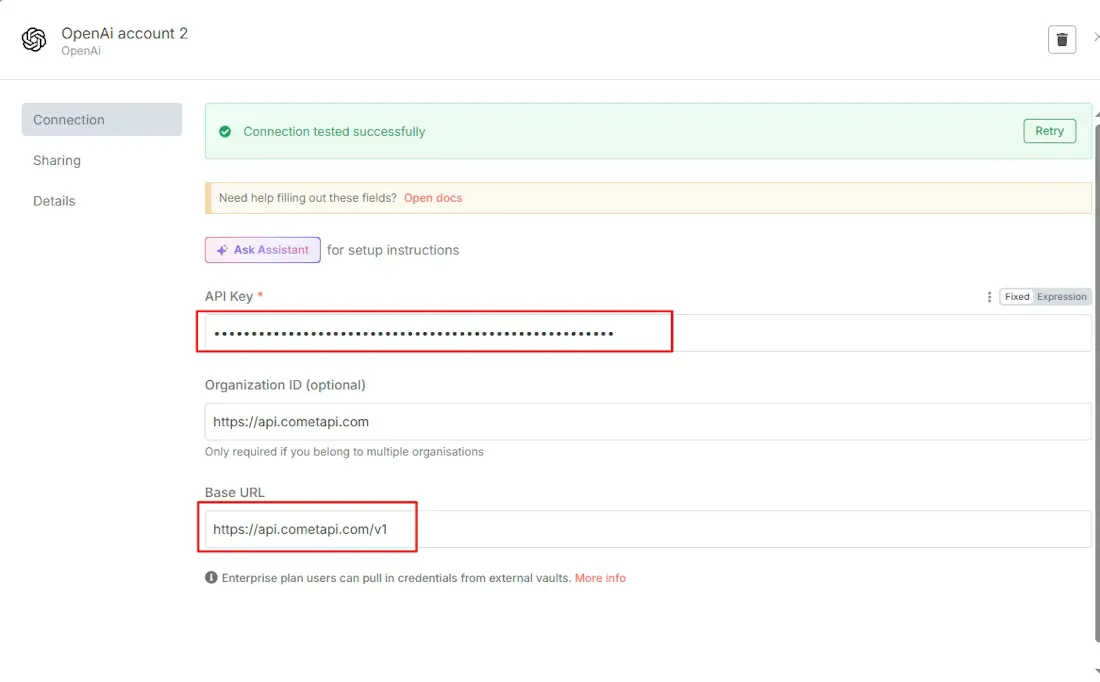

Abre tu instancia de n8n y navega a Credentials → Create Credential. Busca y selecciona el tipo de credencial OpenAI API.

- API Key: Pega aquí tu token de CometAPI.

- Base URL: Introduce

https://api.cometapi.com/v1.

Haz clic en Save para finalizar la configuración.

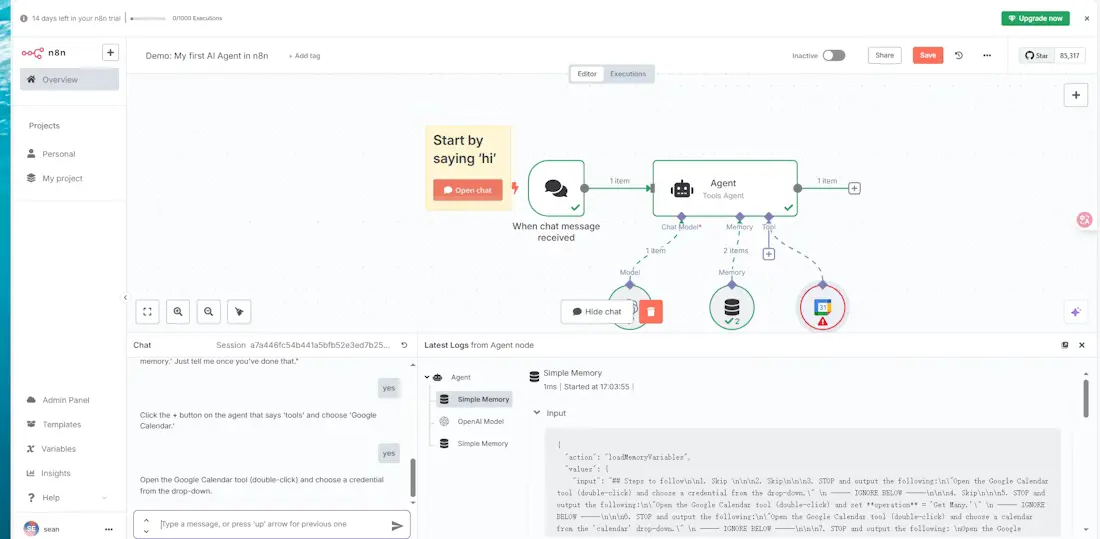

Paso 3: Prueba tu conexión

Crea un nuevo flujo de trabajo y añade un nodo de OpenAI (como el nodo Chat Model o AI Agent). Selecciona la credencial de CometAPI que acabas de crear. En el campo de modelo, ahora puedes introducir cualquier ID de modelo compatible, como gpt-5.5 o claude-opus-4-7. Ejecuta el nodo; una respuesta exitosa verifica que tu puente de API compatible con OpenAI en n8n está correctamente configurado.

Solución de problemas comunes

Si tu integración no funciona de inmediato, revisa estas tres áreas comunes:

La API devuelve un error 401 Unauthorized

Este error suele significar que n8n no puede autenticarse con la puerta de enlace. Primero, verifica que copiaste correctamente tu clave de API, sin espacios iniciales ni finales. Segundo, asegúrate de que tu Base URL incluye el sufijo /v1. Sin la ruta de versión, el endpoint puede rechazar la solicitud.

Nombre de modelo no reconocido

CometAPI aloja más de 500 modelos, y cada uno tiene un identificador específico. Si n8n devuelve un error "Model not found", asegúrate de usar el ID de modelo exacto de la documentación de CometAPI. Por ejemplo, usa gpt-5.5-pro en lugar de gpt-5-pro si ese es el identificador en el catálogo actual.

La velocidad de respuesta es lenta

Para aplicaciones en tiempo real donde la latencia es importante, ciertos modelos de razonamiento intensivo pueden tardar más. Si tu flujo requiere respuestas casi instantáneas, intenta cambiar a un modelo de alto rendimiento como Gemini 3.1 Flash-Lite o DeepSeek V4 Flash, optimizados para velocidad.

Qué modelos puedes usar en n8n vía CometAPI

| Categoría de modelo | Ejemplos | Ideal para |

|---|---|---|

| Texto/Chat | GPT 5.5, Claude Opus 4.7, Gemini 3.1 Pro | Razonamiento profesional y lógica compleja |

| Código | DeepSeek V4 Pro, GPT 5.3 Codex | Programación agentica y refactorizaciones a escala de repositorio |

| Imagen | GPT Image 2, Flux 2 Max | Contenido visual de alta fidelidad y diseño |

| Video | Sora 2, Doubao-Seedance 2.0 | Automatización cinematográfica y clips para redes sociales |

Plantillas de flujo de trabajo n8n listas para usar

Implementar CometAPI en n8n permite una lógica multimodelo sofisticada. Aquí tienes tres plantillas que puedes construir hoy.

Plantilla 1: Automatización de soporte al cliente

- Disparador: Un nodo Webhook recibe un ticket de soporte desde tu sitio web.

- Procesamiento: Un nodo CometAPI (OpenAI) usa Claude Opus 4.7 para analizar el texto del ticket.

- Lógica: Un nodo Switch evalúa la "severity" o "complexity" que devuelve la IA.

- Ramas: Consultas simples (p. ej., "¿Dónde está mi pedido?") se enrutan a un nodo de respuesta automatizada. Problemas técnicos complejos se enrutan a un nodo Slack o nodo Zendesk para intervención humana.

- Configuración del nodo: Configura el nodo de Claude en

thinking: {type: "adaptive"}para garantizar que dedique más tiempo al análisis de sentimientos en casos difíciles.

Plantilla 2: Pipeline de contenido automatizado

- Disparador: Un nodo RSS Feed detecta un nuevo artículo de tu industria.

- Procesamiento 1: Usa GPT 5.5 para leer el artículo y generar un resumen ejecutivo de 200 palabras para tu boletín interno.

- Procesamiento 2: Pasa ese resumen a DeepSeek V3 para generar cinco etiquetas y palabras clave optimizadas para SEO.

- Salida: El resumen y las etiquetas se publican en una base de datos de Notion o un nodo de WordPress.

- ¿Por qué este enfoque?: Al usar GPT 5.5 para el resumen de alta calidad y el más económico DeepSeek V3 para el etiquetado simple, mantienes la calidad alta mientras reduces significativamente el coste total de tokens.

Plantilla 3: Flujo de generación de imágenes

- Disparador: Un nodo de Google Sheets detecta una nueva fila con un nombre y descripción de producto.

- Procesamiento: La descripción se envía a un nodo CometAPI (OpenAI) usando el endpoint

/v1/images/generationscon el modelo Flux 2 Max. - Almacenamiento: La URL de la imagen generada se pasa a un nodo de Google Drive para subir y guardar el archivo.

- Configuración del nodo: Establece el parámetro

nen 1 y elige una resolución como1024x1024para maquetas de producto de alta calidad.

Consejos de optimización de costes para n8n + CometAPI

Para maximizar tu descuento del 20-40 %, sigue estas estrategias de arquitectura.

Usa modelos económicos para clasificación y enrutamiento

No uses GPT 5.5 Pro para decisiones simples de "Sí/No" o "Categoría A/B". Usa DeepSeek V4 Flash o GPT 5.4 nano para estas tareas. Estos modelos cuestan una fracción de los buques insignia y suelen ser más rápidos, lo que significa que tu flujo de n8n se ejecuta con mayor eficiencia.

Configura selección condicional de modelos en n8n

Usa un nodo Switch o nodo If para elegir el modelo en función de la longitud de entrada o la prioridad. Por ejemplo, si un documento tiene menos de 1,000 palabras, rútalo a un modelo estándar. Si es un repositorio masivo de 500,000 tokens, rútalo a un modelo de contexto largo como Grok 4.20 o Claude Opus 4.7.

Procesamiento por lotes vs. en tiempo real

Si tu flujo en n8n no requiere respuestas inmediatas (p. ej., un informe de fin de día), utiliza un nodo Wait o un nodo Schedule para recopilar entradas y procesarlas en un solo lote. CometAPI admite alta concurrencia, pero reducir la frecuencia de llamadas pequeñas y separadas puede ayudarte a mantenerte dentro de límites de tasa más bajos y simplificar tus registros de uso.

Tabla comparativa: n8n + CometAPI vs. alternativas

| Características | n8n + CometAPI | Zapier + Multiple AIs | Make.com + APIs directas | Código a medida (Python/Node) |

|---|---|---|---|---|

| Coste | Bajo (ahorro del 20-40 % + n8n gratis/self-host) | Alto (por tarea + por API) | Medio | Variable (tiempo de dev) |

| Facilidad de uso | Visual, low-code | Muy fácil | Visual | Requiere mucha programación |

| Flexibilidad | Ilimitada (HTTP + más de 400 nodos) | Plantillas limitadas | Buena | Máxima |

| Acceso a modelos | 500+ unificados | Fragmentado | Depende | Manual |

| Autoalojamiento/Privacidad de datos | Excelente | Limitado | Enfocado a la nube | Control total |

| Escalabilidad | Alta (modos de cola, workers) | Límites por precios basados en uso | Buena | Depende de la infraestructura |

| Mantenimiento | Bajo (una integración) | Alto (múltiples conexiones) | Medio | Alto |

| Compatibilidad con agentes de IA | Nativo + herramientas | Básico | En crecimiento | Personalizado |

Veredicto: n8n + CometAPI gana para equipos que necesitan potencia, control y eficiencia de costes.

Perspectivas futuras y consejos de optimización

A medida que los modelos de IA proliferan en 2026, plataformas unificadas como CometAPI combinadas con orquestadores flexibles como n8n se vuelven esenciales. Espera nodos más nativos, mejores integraciones MCP/servidor y capacidades avanzadas de agentes.

Optimización en Cometapi.com:

- Controla el uso de tokens en todos los flujos para analizar el ROI.

- Aprovecha las analíticas de CometAPI + los datos de ejecuciones de n8n.

- Experimenta con modelos más nuevos (p. ej., DeepSeek-V4) para tareas especializadas a menor coste.

- Combina con otras herramientas de CometAPI para soluciones de IA de extremo a extremo.

Guía rápida: Crea hoy un flujo simple de resumen. Escala a operaciones completas de IA mañana.

¿Listo para empezar? Dirígete a CometAPI por tu clave de API gratuita y créditos. Autoalojado o en la nube, conecta n8n con los pasos anteriores y transforma tus automatizaciones. Para flujos personalizados o consultoría empresarial, explora las opciones en Cometapi.com.

Esta integración no es solo técnica: es un multiplicador estratégico de productividad e innovación en la era de la IA.

Preguntas frecuentes

P: ¿Necesito una credencial separada para cada modelo de IA?

R: No. Una credencial de CometAPI proporciona acceso a más de 500 modelos en n8n, desde GPT y Claude hasta DeepSeek y Kimi.

P: ¿Es CometAPI más barato que usar OpenAI directamente en n8n?

R: Sí. Los precios de CometAPI están entre un 20 % y un 40 % por debajo de las tarifas oficiales minoristas para los mismos modelos.

P: ¿Esto funciona con n8n autoalojado?

R: Sí. El proceso de configuración es idéntico tanto para n8n Cloud como para las versiones Docker autoalojadas.

P: ¿Qué nodos de n8n funcionan con CometAPI?

R: Cualquier nodo que acepte credenciales de OpenAI funciona, incluidos los nodos AI Agent, Chat Model y los nodos estándar de completado.

P: ¿Puedo cambiar de modelo sin reconfigurar n8n?

R: Sí. Simplemente actualiza la cadena del nombre del modelo en la configuración del nodo (p. ej., cambia gpt-5.5 por claude-opus-4-7); la credencial subyacente sigue siendo válida para todos los proveedores.