En un emocionante evento transmitido en vivo el jueves 27, OpenAI Se reveló una vista previa de investigación de GPT-4.5, la última versión de su modelo insignia de lenguaje de gran tamaño. Los representantes de la compañía elogiaron esta nueva versión como su modelo de chat más potente y versátil hasta la fecha. Inicialmente, estará disponible para desarrolladores de software y usuarios con suscripciones a ChatGPT Pro.

El lanzamiento de GPT-4.5 marcará el fin de una era para OpenAI. En una publicación en X a principios de este mes, Sam Altman, CEO de OpenAI, afirmó que este modelo sería el último que la compañía presentara sin utilizar potencia de procesamiento adicional para analizar las consultas antes de responder.

¿Qué es GPT 4.5?

GPT 4.5 es el modelo más grande de OpenAI hasta el momento. Los expertos han estimado que GPT-4 podría tener hasta 1.8 billones de parámetros, los valores que se modifican cuando se entrena un modelo. Al escalar el aprendizaje no supervisado, GPT 4.5 mejora su capacidad para reconocer patrones, establecer conexiones y generar conocimientos creativos sin razonar.

GPT 4.5 es un ejemplo de cómo escalar el aprendizaje no supervisado mediante la ampliación de la computación y los datos, junto con innovaciones en arquitectura y optimización. Además, GPT-4.5 ofrece una interacción más natural con el usuario, abarca un espectro más amplio de conocimientos y puede comprender y responder mejor a sus intenciones, lo que se traduce en una reducción de las alucinaciones y una mayor fiabilidad en una amplia gama de temas.

¿Cuáles son las actualizaciones de GPT 4.5 y sus características?

Actualización del ecualizador:

La característica más destacada de GPT-4.5 es su inteligencia emocional (IE) mejorada, que proporciona una experiencia de conversación más natural, cálida y fluida. Sam Altman, director ejecutivo de OpenAI, compartió en redes sociales: «Esta es la primera vez que siento que la IA habla con una persona reflexiva. Realmente proporciona consejos valiosos, e incluso me hizo reclinar en la silla varias veces, sorprendido de que la IA pueda dar respuestas tan excelentes».

En la prueba de preferencia humana, los usuarios generalmente consideran que las respuestas de GPT 4.5 se ajustan mejor a los hábitos de comunicación humanos que las de GPT-4o. En concreto, el nuevo modelo obtuvo puntuaciones más altas en inteligencia creativa (56.8%), asuntos profesionales (63.2%) y asuntos cotidianos (57.0%).

Alucinaciones reducidas:

A través del “aprendizaje no supervisado” a gran escala, GPT 4.5 ha logrado avances significativos en la precisión del conocimiento y la reducción de las “alucinaciones” (información falsa):

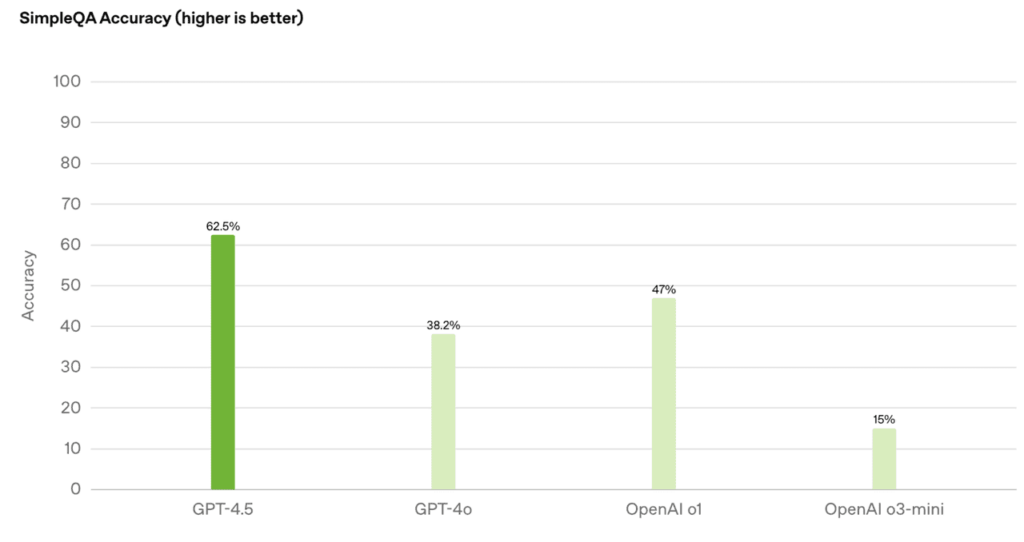

- Al alcanzar una precisión del 62.5% en la evaluación de SimpleQA, la tasa de alucinaciones se redujo al 37.1%.

- Logrando una precisión de 0.78 en el conjunto de datos PersonQA, mucho mejor que GPT-4o (0.28) y o1 (0.55)

Ampliación de la base de conocimientos y actualización de expresiones

La eficiencia aumentó drásticamenteEl consumo de energía computacional se redujo 10 veces, la base de conocimientos se duplicó, pero el costo fue mayor (los usuarios Pro tienen prioridad por $200 al mes). Además, GPT 4.5 se ha optimizado en arquitectura e innovación, mejorando la controlabilidad, la comprensión de los matices y las capacidades de conversación natural, y es especialmente adecuado para escribir, programar, resolver problemas prácticos y escenarios interactivos que requieren un alto grado de empatía.

Aspectos destacados de la arquitectura técnica

Mejora de la potencia informática: Basado en la capacitación en supercomputación de Microsoft Azure, la potencia computacional es 10 veces mayor que la de GPT-40, la eficiencia computacional se mejora en más de 10 veces y se admite la capacitación distribuida entre centros de datos.

Optimización de la seguridad: Integre el ajuste fino supervisado tradicional (SFT) y RLHF, introduzca nueva tecnología de supervisión y reduzca el riesgo de salida dañina.

Limitaciones multimodales: Aún no se admite voz ni video, pero se agregó comprensión de imágenes para ayudar al diseño de animación SVG y a la generación de música libre de derechos de autor.

Temas relacionados:Comparación de los 8 modelos de IA más populares de 2025

Explicación de los precios de la API GPT 4.5: ¿Realmente vale la pena?

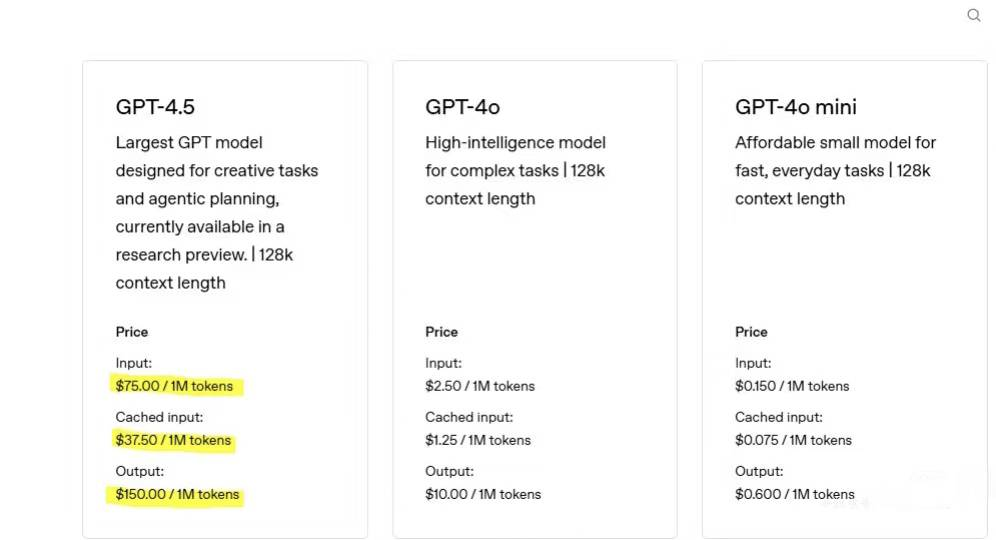

GPT‑4.5 se basa en una arquitectura colosal con 12.8 billones de parámetros y una ventana de contexto de 128 750 tokens. Esta enorme escala y diseño de alto consumo de recursos de computación conllevan un precio elevado. Por ejemplo, una carga de trabajo con 250 147 tokens de entrada y 30 34 tokens de salida puede costar alrededor de 4 $, aproximadamente entre XNUMX XNUMX y XNUMX XNUMX más que modelos anteriores como GPT‑XNUMXo.

Comparación de precios de la serie GPT

El nuevo modelo ya está disponible para vista previa de investigación para los usuarios de ChatGPT Pro y se implementará para los usuarios de Plus, Team, Enterprise y Education en las próximas dos semanas.

GPT 4.5 frente a otros modelos de lenguaje

La intuición estética de la escritura de diseño se ha mejorado, haciéndolo más adecuado para el trabajo creativo y la interacción emocional que otros modelos. El razonamiento se ha reducido y se ha abandonado claramente el posicionamiento de "modelo más sólido". Su capacidad de razonamiento está por debajo de la de sus competidores. GPT-4.5 ha elevado el estándar de la IA conversacional, pero su elevado precio lo convierte en una herramienta profesional en lugar de una solución para el mercado masivo.

Comparación completa de precios de API entre los principales modelos de IA

| Modelo | Costo de entrada (por cada millón de tokens) | Costo de salida (por cada millón de tokens) | Ventana de contexto | Comentarios |

| GPT‑4.5 | 75 | 150 | 128k fichas | Precios premium para capacidades emocionales y conversacionales avanzadas |

| GPT‑4o | 2.5 | 10 | 128k fichas | Línea de base rentable con soporte multimodal rápido |

| Soneto de Claudio 3.7 | 3 | 15 | 200k fichas | Excepcionalmente económico; admite tanto texto como imágenes. |

| Búsqueda profunda R1 | ~ $ 0.55 | ~ $ 2.19 | 64k fichas | Precios agresivos; el almacenamiento en caché puede reducir aún más los costos para casos de uso de gran volumen |

| Flash de Google Gemini 2.0 | ~ $ 0.15 | ~ $ 0.60 | Hasta 1 millón de tokens | Costo ultrabajo con capacidad de contexto masiva; ideal para tareas de gran volumen |

Capacidades técnicas y compensaciones de costos

Contexto y multimodalidad:

**GPT‑4.5:**Admite un contexto de token de 128k pero es solo texto.

Soneto de Claude 3.7: Ofrece una ventana de token más grande de 200k y procesamiento de imágenes para un rendimiento mejorado en contexto largo.

**Flash de Google Gemini 2.0:**Cuenta con una impresionante ventana de token de 1M, ideal para el procesamiento de contenido extenso (aunque la calidad del texto puede variar).

Tareas especializadas:

**Puntos de referencia de codificación:**GPT-4.5 logra una precisión de alrededor del 38% en tareas de codificación (por ejemplo, SWE-Bench), mientras que Claude 3.7 Sonnet ofrece una rentabilidad y un rendimiento significativamente mejores en tareas técnicas.

**Inteligencia emocional:**GPT-4.5 se destaca por brindar un diálogo matizado y emocionalmente rico, lo que lo hace ideal para aplicaciones de soporte y coaching al cliente.

Conclusión

GPT-4.5 es el "último modelo de no inferencia". Su capacidad de aprendizaje no supervisado se integrará con la tecnología de razonamiento de la serie o, allanando el camino para el GPT-5, que se lanzará a finales de mayo. El lanzamiento de GPT-4.5 no solo supone una actualización tecnológica, sino también una reconstrucción del modelo de colaboración hombre-máquina. Si bien su elevado precio y la limitación de la potencia de cálculo resultan controvertidos, sus avances en resonancia emocional y practicidad ofrecen un nuevo paradigma para la integración de la IA en la educación, la atención médica y otros campos. ¡La IA tiene un potencial de desarrollo ilimitado!

Preguntas frecuentes sobre GPT 4.5

¿Cuáles son sus limitaciones?

Carece de razonamiento en cadena y puede ser más lento debido a su tamaño. Tampoco produce una salida multimodal como audio o video.

¿Puede producir respuestas totalmente precisas el 100% del tiempo?

No. Si bien GPT-4.5 generalmente alucina menos que los modelos anteriores, los usuarios aún deben verificar las salidas importantes o sensibles.

¿GPT-4.5 admite imágenes?

Sí, GPT-4.5 acepta entradas de imágenes, puede generar imágenes SVG en línea y generar imágenes a través de DALL·E.

¿GPT-4.5 admite búsquedas en la web?

Sí, GPT-4.5 tiene acceso a la información más reciente y actualizada mediante búsqueda.

¿Con qué archivos y tipos de archivos funciona?

GPT-4.5 admite todos los archivos y tipos de archivos.