El 28 de abril de 2025, Alibaba Cloud presentó Qwen 3, la última versión de su familia de modelos de lenguaje grande (LLM). Esta versión marca un hito importante en la evolución de la IA de código abierto, ofreciendo un conjunto de modelos que se adaptan a diversas aplicaciones y necesidades de los usuarios. Ya sea desarrollador, investigador o empresa, comprender cómo acceder y utilizar Qwen 3 puede abrir nuevas posibilidades en el procesamiento del lenguaje natural y más allá.

¿Qué es Qwen 3?

Qwen 3 es la tercera generación de LLM de código abierto de Alibaba Cloud, que se basa en las bases de sus predecesores. Lanzado el 28 de abril de 2025, Qwen 3 presenta una gama de modelos con diferentes tamaños de parámetros, incluyendo arquitecturas densas y dispersas. Estos modelos se han entrenado con un extenso conjunto de datos de 36 billones de tokens en 119 idiomas y dialectos, lo que posiciona a Qwen 3 como una herramienta versátil para aplicaciones globales.

Características principales de Qwen 3

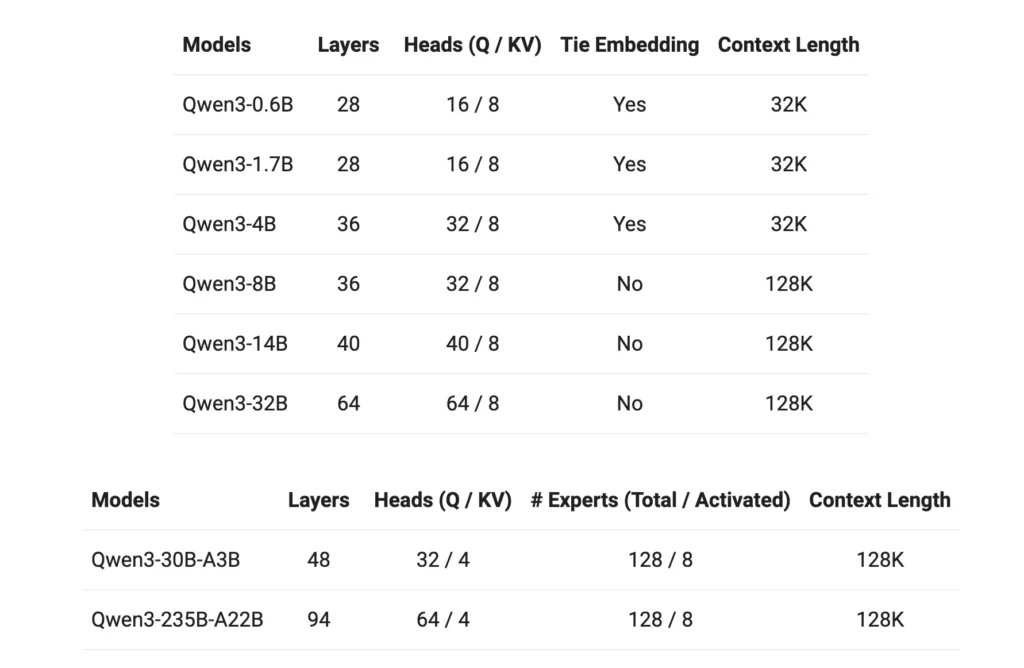

- Variantes de modelo:Qwen 3 ofrece modelos densos con parámetros de 0.6B, 1.7B, 4B, 8B, 14B y 32B, así como modelos dispersos con 30B (parámetros activados de 3B) y 235B (parámetros activados de 22B).

- Ventana de contexto extendida:La mayoría de los modelos admiten una ventana de contexto de token de 128K, lo que facilita el procesamiento de contenido de formato largo.

- Capacidades de razonamiento:Las funciones de razonamiento mejoradas se pueden activar y desactivar a través del tokenizador, lo que permite un rendimiento adaptable en función de tareas específicas.

- Competencia multilingüeCon datos de entrenamiento que abarcan 119 idiomas y dialectos, Qwen 3 está equipado para diversas aplicaciones lingüísticas.

- LicenciasTodos los modelos se publican bajo la licencia Apache 2.0, lo que promueve la colaboración y la innovación de código abierto.

¿Cómo puedes acceder a Qwen3?

Acceder a Qwen 3, la suite más reciente de modelos de lenguaje de gran tamaño (LLM) de Alibaba Cloud, es sencillo y versátil. Tanto si eres un desarrollador que busca integrar capacidades avanzadas de IA en tus aplicaciones como un investigador que explora modelos de vanguardia, Qwen 3 ofrece múltiples puntos de acceso para satisfacer diversas necesidades.

1. A través de la interfaz web de QwenChat

Para una interacción inmediata sin necesidad de configuración, QwenChat ofrece una interfaz web fácil de usar:

- Visita QwenChat: Navegue hasta la sección de Plataforma QwenChat.

- Seleccione un modelo:Elija entre los modelos disponibles como Qwen3-8B, Qwen3-14B o Qwen3-32B según sus necesidades.

- Empezar a chatear:Interactúe con el modelo directamente a través de la interfaz de chat para tareas como preguntas y respuestas, generación de contenido o asistencia con la codificación.

2. Acceso a la API a través de Alibaba Cloud

Integre Qwen 3 en sus aplicaciones utilizando los servicios API de Alibaba Cloud:

Obtener credenciales API:Regístrese en Alibaba Cloud y adquiera su clave API.

Elija el método de acceso:

- API compatible con OpenAI:Utilice el punto final compatible con OpenAI para una integración perfecta.

bashPOST https://dashscope-intl.aliyuncs.com/compatible-mode/v1/chat/completions

- SDK de DashScope:Alternativamente, utilice el SDK DashScope para interacciones más personalizadas.

- Configurar el entorno:Configure su entorno de desarrollo estableciendo la clave API como una variable de entorno e instalando los SDK necesarios.

3. Acceso mediante Hugging Face y ModelScope

Para desarrolladores que prefieren plataformas de código abierto:

- Abrazando la cara:Acceda a los modelos Qwen 3 a través de la organización Qwen en Hugging Face.

pythonfrom transformers import AutoTokenizer, AutoModelForCausalLM tokenizer = AutoTokenizer.from_pretrained("Qwen/Qwen3-14B") model = AutoModelForCausalLM.from_pretrained("Qwen/Qwen3-14B")

- Alcance del modelo:Explore los modelos en ModelScope, que ofrece una gama de variantes de Qwen 3.

4. Opciones de implementación local

Implemente modelos Qwen 3 localmente para un mejor control y personalización:

Ollama:Una plataforma que simplifica la gestión de modelos locales.

- Instalación: Descargue e instale Ollama desde ollama.com.

- Despliegue del modelo:Utilice la CLI de Ollama para ejecutar modelos Qwen 3 localmente.

bashollama run qwen3-14b

vllmOptimizado para servicio de alto rendimiento y baja latencia.

- Instalación:Instalar vLLM usando pip.

bashpip install -U vllm

- Servicio modelo:Servir a los modelos Qwen 3 con capacidades de razonamiento.

bashvllm serve Qwen/Qwen3-30B-A3B \ --enable-reasoning \ --reasoning-parser deepseek_r1

Interacción:Acceda al modelo a través del servidor API predeterminado en http://localhost:8000.

5. Plataformas de terceros: CometAPI

Utilice Qwen 3 a través de CometAPI ofreciendo acceso gratuito:

- CometAPI:Regístrese para obtener una clave API gratuita y seleccione entre modelos como Qwen3-8B, Qwen3-30B o Qwen3-235B para integrarlos en sus proyectos.

Cómo empezar a usar Qwen 3

Para comenzar a utilizar Qwen 3:

- Determine su caso de uso:Identifique si necesita una interfaz web, integración de API o implementación local.

- Seleccione el modelo apropiado:Elija una variante de modelo que se alinee con sus recursos computacionales y la complejidad de la tarea.

- Configurar el entorno:Siga los pasos de instalación y configuración según el método de acceso elegido.

- Integrar y probar:Incorpore Qwen 3 a sus aplicaciones y realice pruebas para garantizar un rendimiento óptimo.

Siguiendo estos pasos, podrá aprovechar eficazmente las capacidades de Qwen 3 para mejorar sus proyectos y esfuerzos de investigación.

Implementación de Qwen 3: Consideraciones prácticas

Requisitos del sistema

La implementación de modelos Qwen 3, especialmente las variantes más grandes, requiere recursos computacionales considerables. Los usuarios deben asegurarse de tener acceso a capacidades de GPU y memoria adecuadas para adaptarse al tamaño de los modelos y las demandas de procesamiento.

Integración y Personalización

El código abierto de Qwen 3 permite una amplia personalización. Los desarrolladores pueden ajustar los modelos con datos específicos del dominio, ajustar los parámetros para optimizar el rendimiento e integrarlos en sistemas existentes para mejorar la funcionalidad.

Comunidad y apoyo

Interactuar con la comunidad de Qwen 3 a través de foros, debates en GitHub y otras plataformas colaborativas puede aportar información valiosa y apoyo. Compartir experiencias y soluciones contribuye al avance colectivo de la tecnología.

Conclusión

Qwen 3 representa un avance significativo en el campo de los modelos de lenguaje de código abierto de gran tamaño. Con su diversa oferta de modelos, amplio soporte lingüístico y plataformas accesibles, proporciona un conjunto de herramientas robusto para una amplia gama de aplicaciones. Al comprender cómo acceder e implementar Qwen 3, los usuarios pueden aprovechar sus capacidades para impulsar la innovación y la eficiencia en sus respectivos dominios.

Primeros Pasos

Los desarrolladores pueden acceder Qwen 3 API a través de CometAPIPara comenzar, explore las capacidades del modelo en el Playground y consulte la Guía de API Para obtener instrucciones detalladas, tenga en cuenta que algunos desarrolladores podrían necesitar verificar su organización antes de usar el modelo.