Resumen: La versión reciente de OpenClaw añade compatibilidad de primera clase y con visión de futuro para GPT-5.4 de OpenAI e introduce una arquitectura de “memoria intercambiable en caliente” que permite a los agentes de OpenClaw cambiar qué modelo y qué almacén de memoria están activos en tiempo de ejecución con una mínima interrupción. Esto desbloquea flujos de trabajo de gran contexto (las ventanas de contexto ampliadas de GPT-5.4), especialización de modelos sobre la marcha y optimizaciones de coste/latencia para agentes en producción. La actualización está disponible en las versiones y documentación de OpenClaw; los ejemplos siguientes muestran configuración práctica, fragmentos de código, contexto de benchmark y prácticas recomendadas.

Qué envió realmente la actualización de OpenClaw (resumen rápido)

El 9 de marzo de 2026, el proyecto de framework de agentes de código abierto adyacente a OpenAI, OpenClaw, publicó una versión principal del núcleo (2026.3.7) que añade compatibilidad de primera clase con GPT-5.4 y un novedoso mecanismo de memoria intercambiable en caliente en su motor de contexto. Esta versión convierte un framework de agentes experimental ampliamente usado en lo que sus mantenedores describen como un “Sistema Operativo de Agentes”, con el objetivo de hacer que los flujos de trabajo de agentes de nivel producción y el cambio de modelo sean fluidos para desarrolladores y equipos.

3 elementos prácticos que importan para constructores de agentes:

- Compatibilidad de primera clase con GPT-5.4: alias de modelos y mapeos de proveedores que permiten a los agentes seleccionar GPT-5.4 como modelo de ejecución principal (incluyendo reemplazos por canal y fijaciones de modelo por agente).

- Motor de Contexto y enlace de canales distribuido: mejoras en cómo OpenClaw ensambla ventanas de contexto largas a partir de memoria, salidas de herramientas e historial de canal, de modo que los modelos de alta capacidad reciban entradas bien estructuradas.

- Arquitectura de memoria intercambiable en caliente: superficies de plugin de memoria y flujos de trabajo más claros para que puedas reemplazar backends de memoria o actualizar agentes sin perder la “identidad” ni corromper el estado persistido (la memoria en sí permanece como la fuente única de la verdad). El diseño de memoria de OpenClaw (archivos Markdown planos, búsqueda indexada, recuperación mediante plugins) es parte de lo que posibilita el intercambio en caliente de forma segura.

GPT-5.4 — Qué es GPT-5.4 y avances en benchmarks

GPT-5.4 es la última versión de frontera de OpenAI, centrada fuertemente en la productividad profesional (hojas de cálculo, edición de documentos y presentaciones, razonamiento multi-paso y manejo de herramientas). Según OpenAI y coberturas de prensa independientes, la versión enfatiza:

- Contexto ampliado: GPT-5.4 introduce el siguiente nivel de ventanas de contexto, con 1M de tokens experimental y una mejora en el manejo de contexto largo disponible a través de endpoints Codex/compatibles con Codex — se exponen para desarrolladores controles como

model_context_windowymodel_auto_compact_token_limit. Esto te permite mantener un estado de conversación, documentos y bases de código mucho más grandes en contexto activo. - Mayor precisión en hojas de cálculo y razonamiento: OpenAI reporta una mejora importante en tareas de modelado de hojas de cálculo (puntuaciones medias ~87% vs ~68% para GPT-5.2 en su benchmark de hojas de cálculo bancarias/analistas).

- Mejoras en precisión y factualidad: Revisiones y QA tempranos muestran una reducción de ~33% en alucinaciones y menos salidas propensas a errores respecto a GPT-5.2, con avances notables en redacción de documentos y trabajo con hojas de cálculo. Revisores también citaron una disminución de ~18% en respuestas propensas a errores en ciertas tareas de productividad.

- Uso de ordenador integrado y mejoras del linaje Codex: GPT-5.4 incluye capacidades heredadas del linaje Codex que mejoran la generación de código, la depuración interactiva y el manejo operativo de herramientas (automatización de ratón/teclado/capturas en algunas demostraciones). Esto lo hace mejor en el ciclo escribir-ejecutar-inspeccionar-corregir típico de los bucles de agentes.

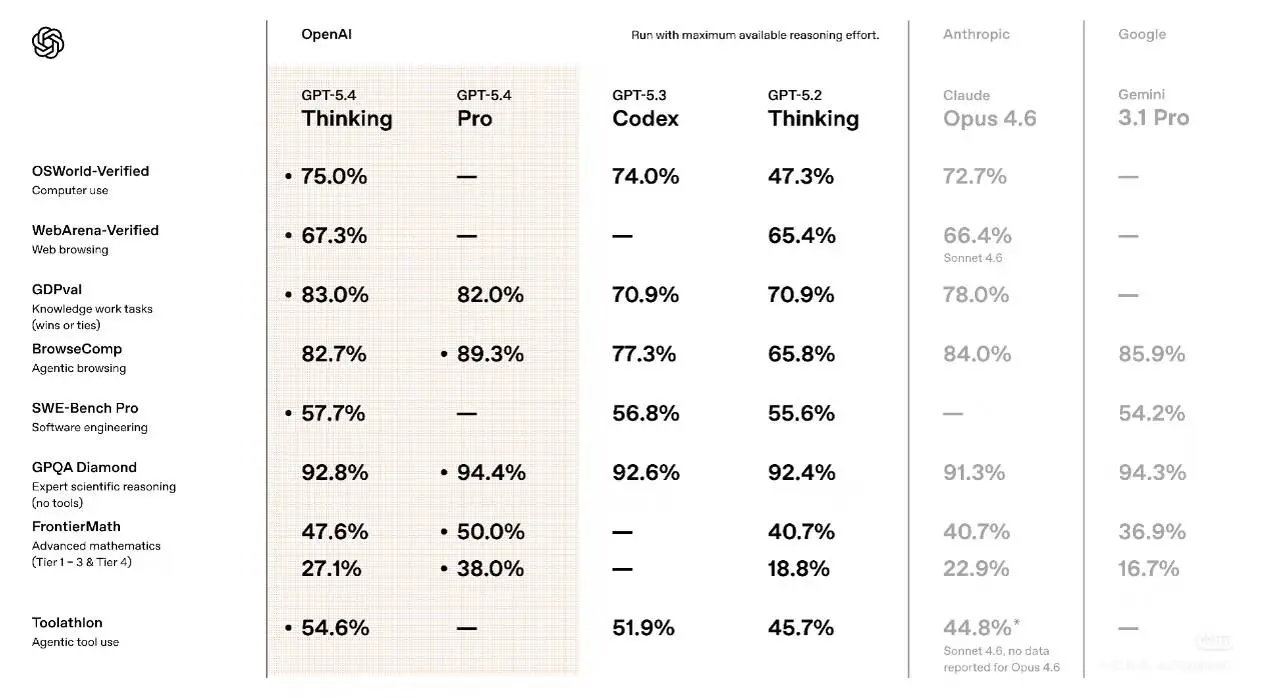

Benchmarks y contexto comparativo (qué significan los números)

- Modelado de hojas de cálculo: benchmark interno de hojas de cálculo de OpenAI: ~87.3% puntuación media para GPT-5.4 vs ~68.4% para GPT-5.2. Este es el titular que el proveedor usa para mostrar las ganancias específicas por tarea.

- Interacción con ordenador (OSWorld / pruebas estilo agente): testers independientes y ejecuciones de la comunidad muestran que GPT-5.4 mejora en tareas de interacción de agentes que implican manipulación de escritorio o UI simulada, a veces superando por poco variantes recientes de modelos de Anthropic en estos conjuntos de tareas (diferencias significativas para agentes, aunque no necesariamente decisivas en todas las cargas).

Interpretación: GPT-5.4 no es una “bala mágica” que gane en todo. Tiene fortalezas claras en uso integrado de herramientas, patrones de ejecución de código y razonamiento en hojas de cálculo, que son exactamente las cargas que ejecutan a menudo los agentes de OpenClaw. Para constructores de agentes, la combinación de mayor fiabilidad como ejecutor (linaje Codex) + competencia como planificador + mejor manejo de contexto largo es altamente relevante.

OpenClaw es compatible con GPT-5.4: qué cambió y por qué importa

La versión de OpenClaw (ver la página de lanzamientos del proyecto) actualiza los resolutores de modelos y el runtime para ser compatibles hacia adelante con el contexto ampliado y los límites de tokens de GPT-5.4 y añade la capacidad de “memoria intercambiable en caliente” para que los agentes puedan cambiar backends de memoria o modelos en tiempo de ejecución. Esto se hace de tres maneras concretas: 1) actualizaciones de metadatos de modelo y del resolutor para aceptar el contexto más grande y los límites de tokens; 2) cambios en el runtime del agente para orquestar cambios de modelo con gracia y calentamiento de caché; 3) una API de memoria que permite múltiples canales de memoria y disparadores de cambio en caliente.

La compatibilidad de la versión 2026.3.7 con GPT-5.4 junto con un diseño de memoria intercambiable en caliente proporciona dos ventajas prácticas y complementarias:

- Vía de actualización de modelo sencilla. OpenClaw ahora puede presentar GPT-5.4 como un “runtime” seleccionable para los agentes, permitiéndote cambiar desde modelos GPT-5.x más antiguos o proveedores alternativos sin rehacer la lógica de tu agente. La actualización de OpenClaw declara explícitamente la integración estable de GPT-5.4 en el núcleo.

- Intercambio en caliente de memoria. En lugar de persistir una única instantánea de memoria lineal, el Motor de Contexto de OpenClaw permite que particiones de memoria se desacoplen, intercambien o migren en tiempo de ejecución — p. ej., intercambiar un shard de vector DB de alta recuperación para depuración o cambiar a una variante de memoria saneada para RGPD para auditorías externas — sin detener el agente. Eso reduce el riesgo de interrupción en producción y habilita configuraciones de memoria específicas de caso de uso (depuración vs. privacidad vs. rendimiento).

avances prácticos en rendimiento y ventajas

La integración de OpenClaw se centra en tres áreas prácticas donde GPT-5.4 destaca:

- Fidelidad en la orquestación de herramientas. La mejora en la búsqueda interna de herramientas y el razonamiento de GPT-5.4 reduce el churn de llamadas a herramientas (menos llamadas redundantes y menos reintentos). Eso se traduce en menos llamadas a API y finalizaciones más rápidas en flujos complejos. Informes tempranos indican mejoras en eficiencia de tokens y de llamadas a herramientas en comparación con modelos GPT-5.x anteriores.

- Manejo de contextos más largos y ricos. Los agentes de OpenClaw ahora pueden mantener contextos activos mucho mayores (incluyendo shards de memoria intercambiados), lo que les permite gestionar conversaciones largas, proyectos con múltiples archivos y depuración iterativa sin perder estado.

- Mejor salida de código determinista. Para flujos que generan código automáticamente (hooks de CI, stubs de funciones, plantillas de infraestructura), GPT-5.4 tiende a producir salidas más consistentes y ejecutables, reduciendo la carga de revisión humana. Pruebas independientes muestran mejoras notables en métricas de calidad de código frente a modelos GPT-5 previos.

- Continuidad de memoria — la “memoria intercambiable en caliente” te permite reemplazar o ampliar almacenes de memoria (caché local, vector DB, memoria del LLM) sin perder el estado o contexto del agente, habilitando pruebas A/B, actualizaciones continuas y failover.

En la prueba de referencia OOLONG, la nueva versión de OpenClaw, junto con el plugin lossless-claw, alcanzó una alta puntuación de 74.8, dejando a Claude Code (70.3 puntos) muy atrás. En particular, OpenClaw demostró estabilidad y precisión a medida que aumentaba la longitud del contexto, lo que llevó a los ingenieros que realizaban las pruebas in situ a exclamar que “decir que funciona bien es demasiado conservador”.

Cómo configurar y usar GPT-5.4 en OpenClaw (paso a paso)

Un flujo de trabajo simple de OpenClaw usando GPT 5.4:

- Una configuración típica se muestra a continuación:

- Los usuarios envían mensajes a través de plataformas como Discord o Telegram.

- OpenClaw recibe los mensajes a través de su servidor gateway.

- El gateway reenvía los prompts a GPT 5.4 a través del proveedor de API de IA.

- GPT 5.4 genera una respuesta o desencadena una acción de herramienta.

- OpenClaw envía el resultado final de vuelta al usuario.

A continuación se muestran ejemplos de configuración prácticos y listos para pegar y flujos de trabajo para ejecutar GPT-5.4 en OpenClaw de forma segura y reproducible. Estos son intencionalmente conservadores: habilita primero el modelo en un agente de prueba e instrumenta todo para métricas y errores.

Requisitos previos

- OpenClaw actualizado a la versión que incluye los mapeos de GPT-5.4 (las notas de la versión referenciadas arriba).

- Clave de API válida de OpenAI con acceso a GPT-5.4 (yo elijo el endpoint de CometAPI con mejor precio).

1) Selección de modelo y configuración del resolutor (Json/ YAML / CLI)

Coloca esto en ~/.openclaw/openclaw.json (o fusiónalo con tu configuración existente). Ajusta el nombre del proveedor y la referencia del token según lo requiera tu entorno.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw utiliza un resolutor de modelos para mapear nombres de modelo lógicos (p. ej., openai/gpt-5.4) a endpoints y configuración de runtime. Añade o actualiza tu archivo del resolutor (ejemplo models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

O establécelo en tiempo de ejecución vía CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Nota: Los

context_windowymax

Notas

agents.defaults.model.primaryelige el modelo predeterminado. Usachannels.modelByChannelpara reemplazos por canal y así enrutar canales de alto impacto a GPT-5.4 y canales menos exigentes a modelos más baratos. Consulta la documentación de selección de modelos de OpenClaw sobre la semántica de orden.- Consulta la página de modelo de CometAPI para nombres de modelo específicos. Si deseas usar OpenAI, reemplaza la URL y la clave de API por las de OpenAI.

- Las claves

context_windowymax_output_tokensreflejan los cambios de compatibilidad hacia adelante en el resolutor de OpenClaw para que el agente no intente usar límites de Codex obsoletos.

2) Cómo habilitar y probar el “intercambio en caliente de memoria”

El subsistema de memoria de OpenClaw se basa en archivos (archivos Markdown) más indexadores/plugins de búsqueda, por lo que puedes cambiar de forma segura los plugins del backend (p. ej., vector SQLite, Milvus, o servicios de memoria externos) sin perder los archivos de memoria en bruto.

Un patrón común:

- Estandariza la ubicación de la memoria: usa un workspace respaldado por git:

~/.openclaw/workspace/dondeMEMORY.mdymemory/YYYY-MM-DD.mdson la autoridad. - Instala y configura un plugin de memoria (ejemplo: sqlite-vec) y apunta

plugins.slots.memorya él en la configuración. - Prueba la migración: añade un nuevo plugin, ejecuta un job de indexado en sombra, compara resultados de recuperación y luego cambia el alias

plugins.slots.memoryal nuevo plugin cuando estés satisfecho.

Ejemplo de intercambio de alias de plugin (pseudo-comandos bash):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Por qué esto es “intercambiable en caliente”: los archivos de memoria siguen siendo la fuente de la verdad. Los plugins implementan capas de indexado y recuperación; cambiarlos reindexa pero no altera los archivos .md subyacentes. Esto permite cambios de modelo sin una deriva de identidad catastrófica: el agente sigue leyendo las mismas MEMORIAS.

3) Ejemplo: fijar un agente individual a GPT-5.4 (anulación por agente)

Puedes anular modelos por agente; añade una entrada de agente como:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Si la versión comunitaria o tu versión particular de OpenClaw requiere CLI, también puedes establecer un modelo por sesión en tiempo de ejecución:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Consejo operativo: fijar garantiza un comportamiento determinista para ese agente mientras ejecutas pruebas A/B en otros.

Si deseas usar OpenAI, reemplaza la URL y la clave de API por las de OpenAI.

4) Uso de opciones de contexto de 1M en Codex (controles de API)

Si tu despliegue de OpenClaw accede a endpoints de OpenAI Codex directamente, pasa opciones de contexto:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Las solicitudes que superan las ventanas de contexto estándar pueden contabilizarse a tasas de uso diferentes (la documentación de OpenAI señala cómputo doble para solicitudes más allá de las ventanas estándar en la vista previa de Codex).

Mejores prácticas: maximizar las fortalezas de GPT-5.4 en OpenClaw

Coste, latencia y mezcla de modelos

- Estrategia híbrida de modelos: usa un modelo más pequeño y barato para consultas cortas y procesamiento en streaming; cambia en caliente a GPT-5.4 para análisis pesados, resúmenes y generación de código que requieran contexto largo. Esto reduce el coste total de tokens preservando la calidad. (Implementa mediante disparadores en la configuración de memoria anterior).

- Compactación de tokens y aumento por recuperación: utiliza pipelines con recuperación aumentada para limitar los tokens enviados al modelo — almacena documentos largos en una base vectorial, recupera segmentos relevantes e incluye solo los fragmentos más pertinentes junto con un plan compacto. La búsqueda de herramientas de GPT-5.4 ayuda localizando herramientas o documentos útiles automáticamente.

- Calentamiento e inicio en frío: tras un cambio de modelo, calienta el modelo con una breve ejecución de “priming” de contexto para evitar picos de latencia en la primera solicitud. Precompila cualquier plantilla de prompt y rehidrata canales de memoria críticos. La estrategia de rolling de OpenClaw (ver configuración) admite pre-calentamiento.

Fiabilidad y seguridad

- Retirada gradual con gracia: implementa timeouts y planes de fallback (p. ej., degradar a una respuesta en caché de una sesión previa) para manejar límites de tasa de API o errores de cuota.

- Capas de seguridad: mantén filtros de política y un paso de verificación cuando las salidas afecten decisiones. GPT-5.4 reduce alucinaciones estadísticamente, pero la verificación sigue siendo importante en tareas de alto impacto.

Evaluación y monitorización

- Reproduce tus benchmarks: ejecuta pruebas cara a cara para tus cargas (completado de código, refactorización multiarchivo, análisis de hojas de cálculo) usando una rúbrica estándar. Informes públicos indican fortalezas en tareas de productividad y hojas de cálculo — valida con tus datos.

- Telemetría: monitoriza consumo de tokens, latencia del modelo, frecuencia de intercambios de memoria y calidad de respuestas (valoraciones humanas/pruebas automatizadas). Usa la telemetría para afinar los umbrales de intercambio.

Ejemplo: agente de revisión de código que intercambia en caliente

Objetivo: Ejecutar un resumen rutinario de lint + pruebas unitarias en cada push (modelo barato) y escalar a GPT-5.4 para sugerencias de refactorización multiarchivo cuando fallen pruebas o los diffs superen 10 archivos.

Flujo (alto nivel):

- El trigger de pre-commit ejecuta

local/fast-small-coderpara generar un resumen de lint. - Si

test_failures > 0odiff_files > 10, disparahot_swapaopenai/gpt-5.4. Promocionalongterm_vectorque contiene el historial del repositorio. - Ejecuta un prompt de GPT-5.4 que incluye todas las trazas de fallo + archivos de código relevantes incorporados en contexto. Genera el parche de refactorización y cambios de pruebas unitarias.

- Un revisor humano califica la salida; el feedback actualiza la memoria.

Esqueleto de prompt (enviado a GPT-5.4 tras recuperación y compactación):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Este caso de uso resalta por qué el gran contexto + el intercambio de memoria en caliente es valioso: puedes aportar a la vez la traza de fallo completa y múltiples archivos al modelo. Implementa disparadores de intercambio de forma conservadora para controlar costes.

Finalmente: quién debería adoptar GPT-5.4 en OpenClaw (y cuándo)

- Adopta ahora si tus agentes realizan tareas de código/herramientas de múltiples pasos, automatización pesada de hojas de cálculo o edición compleja de documentos donde los ciclos iterativos de escribir-ejecutar-inspeccionar dominan el tiempo del desarrollador. Las ganancias de productividad y fiabilidad son más visibles aquí.

- Adopta con cuidado si operas canales de chat de alto volumen y sensibles al coste donde un razonamiento simple basta; usa enrutamiento para preservar la eficiencia de coste.

- No asumas la dominancia de un único modelo: haz benchmarks con tus datos. GPT-5.4 es un competidor fuerte para cargas de agentes, pero la elección del modelo debe basarse en evidencia.

Los desarrolladores pueden acceder a GPT-5.4 a través de CometAPI (CometAPI es una plataforma integral de agregación para APIs de modelos grandes como APIs de GPT, APIs de Nano Banana, etc.) ahora. Para comenzar, explora las capacidades del modelo en el Playground y consulta la guía de integración de Openclaw para instrucciones detalladas. Antes de acceder, asegúrate de haber iniciado sesión en CometAPI y obtenido la clave de API. CometAPI ofrece un precio muy inferior al oficial para ayudarte a integrar.

¿Listo para empezar? → Regístrate en openclaw hoy

Si quieres conocer más consejos, guías y noticias sobre IA, síguenos en VK, X y Discord.