DeepSeek ha lanzado DeepSeek V3.2 como sucesor de su línea V3.x y una variante complementaria DeepSeek-V3.2-Speciale que la compañía presenta como una edición de alto rendimiento, centrada en el razonamiento, para uso con agentes/herramientas. V3.2 se basa en trabajo experimental (V3.2-Exp) e introduce una mayor capacidad de razonamiento, una edición Speciale optimizada para un rendimiento de “nivel oro” en matemáticas/programación competitiva, y lo que DeepSeek describe como un sistema de doble modo “thinking + tool” pionero en su tipo, que integra estrechamente el razonamiento interno paso a paso con la invocación de herramientas externas y los flujos de trabajo de agentes.

¿Qué es DeepSeek V3.2 y en qué se diferencia V3.2-Speciale?

DeepSeek-V3.2 es el sucesor oficial de la rama experimental V3.2-Exp de DeepSeek. DeepSeek lo describe como una familia de modelos “reasoning-first” creada para agentes, es decir, modelos ajustados no solo para una calidad conversacional natural, sino específicamente para la inferencia de múltiples pasos, la invocación de herramientas y un razonamiento fiable de estilo chain-of-thought al operar en entornos que incluyen herramientas externas (API, ejecución de código, conectores de datos).

Qué es DeepSeek-V3.2 (base)

- Se posiciona como el sucesor principal de producción de la línea experimental V3.2-Exp; está destinado a una amplia disponibilidad a través de la app/web/API de DeepSeek.

- Mantiene un equilibrio entre eficiencia computacional y razonamiento sólido para tareas agentivas.

Qué es DeepSeek-V3.2-Speciale

DeepSeek-V3.2-Speciale es una variante que DeepSeek comercializa como una “Edición Especial” de mayor capacidad, ajustada para razonamiento de nivel competitivo, matemáticas avanzadas y rendimiento de agentes. Se promociona como una variante de mayor capacidad que “lleva los límites de las capacidades de razonamiento más allá”. Actualmente, DeepSeek expone Speciale solo como un modelo vía API con enrutamiento de acceso temporal; los primeros benchmarks sugieren que está posicionado para competir con modelos cerrados de gama alta en benchmarks de razonamiento y programación.

¿Qué linaje y decisiones de ingeniería llevaron a V3.2?

V3.2 hereda un linaje de ingeniería iterativa que DeepSeek hizo público a lo largo de 2025: V3 → V3.1 (Terminus) → V3.2-Exp (un paso experimental) → V3.2 → V3.2-Speciale. El V3.2-Exp experimental introdujo DeepSeek Sparse Attention (DSA), un mecanismo de atención dispersa de grano fino orientado a reducir los costes de memoria y computación para longitudes de contexto muy extensas, preservando al mismo tiempo la calidad de salida. Esa investigación sobre DSA y el trabajo de reducción de costes sirvieron como un peldaño técnico para la familia oficial V3.2.

¿Qué hay de nuevo en DeepSeek 3.2 oficial?

1) Capacidad de razonamiento mejorada: ¿cómo mejora el razonamiento?

DeepSeek comercializa V3.2 como “reasoning-first”. Eso significa que la arquitectura y el ajuste fino se centran en realizar de manera fiable inferencias de múltiples pasos, mantener cadenas internas de pensamiento y respaldar los tipos de deliberación estructurada que los agentes necesitan para usar herramientas externas correctamente.

En concreto, las mejoras incluyen:

- Entrenamiento y RLHF (u otros procedimientos de alineación similares) ajustados para fomentar una resolución de problemas explícita y paso a paso, así como estados intermedios estables (útiles para razonamiento matemático, generación de código en múltiples pasos y tareas de lógica).

- Decisiones arquitectónicas y de función de pérdida que preservan ventanas de contexto más largas y permiten que el modelo haga referencia a pasos de razonamiento anteriores con fidelidad.

- Modos prácticos (véase “doble modo” más abajo) que permiten que el mismo modelo opere ya sea en un modo más rápido de estilo “chat” o en un modo deliberativo “thinking” en el que trabaja intencionadamente los pasos intermedios antes de actuar.

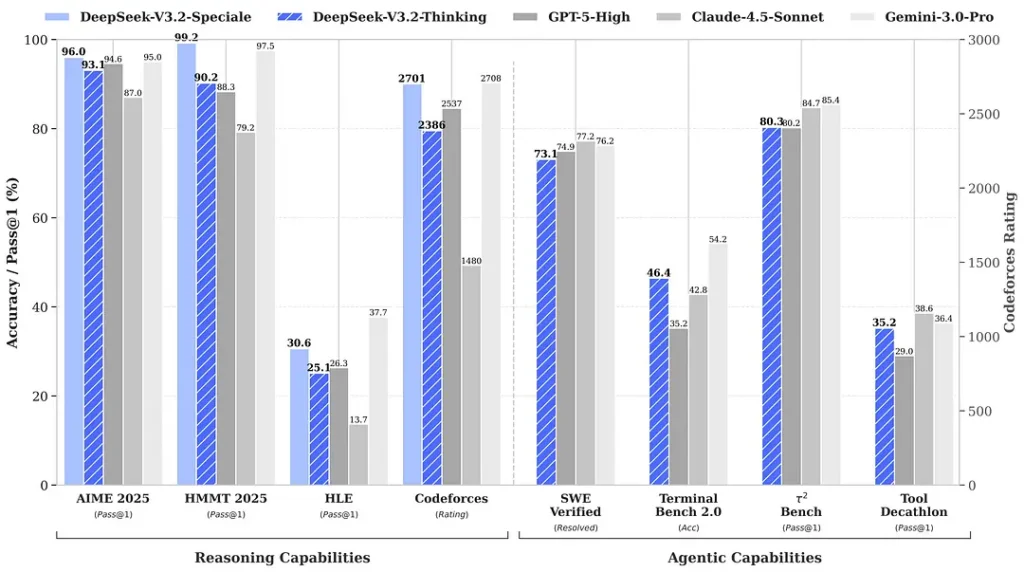

Los benchmarks citados en torno al lanzamiento afirman mejoras notables en suites de matemáticas y razonamiento; los primeros benchmarks independientes de la comunidad también informan puntuaciones impresionantes en conjuntos de evaluación competitivos:

2) Rendimiento revolucionario en la Edición Especial: ¿cuánto mejor?

Se afirma que DeepSeek-V3.2-Speciale ofrece un salto en precisión de razonamiento y orquestación de agentes en comparación con el V3.2 estándar. El proveedor presenta Speciale como un nivel de rendimiento dirigido a cargas de trabajo intensivas en razonamiento y tareas de agentes exigentes; actualmente es solo API y se ofrece como un endpoint temporal de mayor capacidad (DeepSeek indicó que la disponibilidad de Speciale será limitada al principio). La versión Speciale integra el modelo matemático previo DeepSeek-Math-V2; puede demostrar teoremas matemáticos y verificar razonamientos lógicos por sí sola; ha logrado resultados notables en múltiples competiciones de clase mundial:

- 🥇 IMO (Olimpiada Internacional de Matemáticas) Medalla de Oro

- 🥇 CMO (Olimpiada Matemática China) Medalla de Oro

- 🥈 ICPC (Concurso Internacional Universitario de Programación) Segundo Lugar (Concurso Humano)

- 🥉 IOI (Olimpiada Internacional de Informática) Décimo Lugar (Concurso Humano)

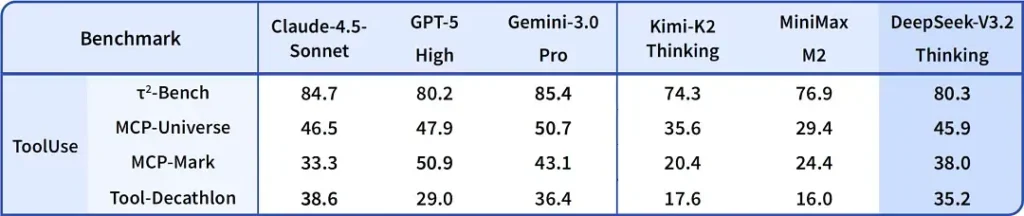

| Benchmark | GPT-5 High | Gemini-3.0 Pro | Kimi-K2 Thinking | DeepSeek-V3.2 Thinking | DeepSeek-V3.2 Speciale |

|---|---|---|---|---|---|

| AIME 2025 | 94.6 (13k) | 95.0 (15k) | 94.5 (24k) | 93.1 (16k) | 96.0 (23k) |

| HMMT Feb 2025 | 88.3 (16k) | 97.5 (16k) | 89.4 (31k) | 92.5 (19k) | 99.2 (27k) |

| HMMT Nov 2025 | 89.2 (20k) | 93.3 (15k) | 89.2 (29k) | 90.2 (18k) | 94.4 (25k) |

| IMOAnswerBench | 76.0 (31k) | 83.3 (18k) | 78.6 (37k) | 78.3 (27k) | 84.5 (45k) |

| LiveCodeBench | 84.5 (13k) | 90.7 (13k) | 82.6 (29k) | 83.3 (16k) | 88.7 (27k) |

| CodeForces | 2537 (29k) | 2708 (22k) | — | 2386 (42k) | 2701 (77k) |

| GPQA Diamond | 85.7 (8k) | 91.9 (8k) | 84.5 (12k) | 82.4 (7k) | 85.7 (16k) |

| HLE | 26.3 (15k) | 37.7 (15k) | 23.9 (24k) | 25.1 (21k) | 30.6 (35k) |

3) Primera implementación de un sistema de doble modo “thinking + tool”

Una de las afirmaciones más interesantes en la práctica de V3.2 es un flujo de trabajo de doble modo que separa (y permite elegir entre) una operación conversacional rápida y un modo deliberativo más lento “thinking” que se integra estrechamente con el uso de herramientas.

- Modo “Chat / fast”: Diseñado para chat de cara al usuario y de baja latencia, con respuestas concisas y menos rastros internos de razonamiento; bueno para ayuda ocasional, preguntas y respuestas breves, y aplicaciones sensibles a la velocidad.

- Modo “Thinking / reasoner”: Optimizado para chain-of-thought riguroso, planificación paso a paso y orquestación de herramientas externas (API, consultas a bases de datos, ejecución de código). Cuando opera en modo thinking, el modelo produce pasos intermedios más explícitos, que pueden inspeccionarse o utilizarse para impulsar llamadas a herramientas seguras y correctas en sistemas agentivos.

Este patrón (un diseño de dos modos) estaba presente en ramas experimentales anteriores, y DeepSeek lo ha integrado más profundamente en V3.2 y Speciale; actualmente, Speciale admite exclusivamente el modo thinking (de ahí su limitación vía API). La capacidad de alternar entre velocidad y deliberación es valiosa desde el punto de vista de ingeniería porque permite a los desarrolladores elegir el equilibrio adecuado entre latencia y fiabilidad al crear agentes que deben interactuar con sistemas del mundo real.

Por qué es destacable: Muchos sistemas modernos ofrecen o bien un modelo fuerte de chain-of-thought (para explicar el razonamiento) o bien una capa separada de orquestación de agentes/herramientas. El planteamiento de DeepSeek sugiere un acoplamiento más estrecho: el modelo puede “pensar” y luego llamar herramientas de forma determinista, usando las respuestas de las herramientas para informar el razonamiento posterior, lo cual resulta más fluido para los desarrolladores que crean agentes autónomos.

Dónde conseguir DeepSeek v3.2

Respuesta corta: puedes conseguir DeepSeek v3.2 de varias maneras según lo que necesites:

- Web/app oficial (usar en línea) — prueba la interfaz web de DeepSeek o la app móvil para usar V3.2 de forma interactiva.

- Acceso API — DeepSeek expone V3.2 a través de su API (la documentación incluye nombres de modelo /

base_urly precios). Regístrate para obtener una clave API y llama al endpoint v3.2. - Pesos descargables/abiertos (Hugging Face) — el modelo (variantes V3.2 / V3.2-Exp) está publicado en Hugging Face y se puede descargar (open-weight). Usa

huggingface-hubotransformerspara obtener los archivos. - CometAPI — Una plataforma de agregación de API de IA proporciona endpoints alojados de V3.2-Exp. El precio es más barato que el precio oficial.

Un par de notas prácticas:

- Si quieres pesos para ejecutar localmente, ve a la página del modelo en Hugging Face (acepta cualquier licencia o condición de acceso allí) y usa

huggingface-cliotransformerspara descargar; el repositorio de GitHub normalmente muestra los comandos exactos. - Si quieres uso en producción vía API, sigue la plataforma que desees, como la documentación de la API de cometapi, para los nombres de endpoint y el

base_urlcorrecto de la variante V3.2.

DeepSeek-V3.2-Speciale:* Abierto solo para uso de investigación, admite diálogo en “Thinking Mode”, pero no admite llamadas a herramientas.

- La salida máxima puede alcanzar 128K tokens (cadena de pensamiento ultralarga).

- Actualmente se puede probar gratis hasta el 15 de diciembre de 2025.

Reflexiones finales

DeepSeek-V3.2 representa un paso significativo en la maduración de los modelos centrados en el razonamiento. Su combinación de mejor razonamiento de múltiples pasos, ediciones especializadas de alto rendimiento (Speciale) y una integración productivizada de “thinking + tool” es notable para cualquiera que esté creando agentes avanzados, asistentes de programación o flujos de trabajo de investigación que deban intercalar deliberación con acciones externas.

Los desarrolladores pueden acceder a DeepSeek V3.2 a través de CometAPI. Para comenzar, explora las capacidades del modelo de CometAPI en el Playground y consulta la guía de la API para obtener instrucciones detalladas. Antes de acceder, asegúrate de haber iniciado sesión en CometAPI y de haber obtenido la clave API. CometAPI ofrece un precio muy inferior al precio oficial para ayudarte con la integración.

¿Listo para empezar?→ Regístrate en CometAPI hoy !

Si quieres conocer más consejos, guías y noticias sobre IA, síguenos en VK, X y Discord.