El 28 de julio de 2025, la startup con sede en Beijing Zhipu AI presentó oficialmente su serie GLM‑4.5 de grandes modelos de lenguaje de código abierto, marcando su lanzamiento más potente hasta la fecha y orientado a aplicaciones avanzadas de agentes inteligentes. El anuncio—realizado mediante un evento en línea en vivo tras la World Artificial Intelligence Conference (WAIC)—mostró dos variantes: el GLM‑4.5 a escala completa con 355 mil millones de parámetros totales (32 mil millones activos) y el más compacto GLM‑4.5‑Air con 106 mil millones de parámetros totales (12 mil millones activos). Ambos modelos emplean una arquitectura de razonamiento híbrida de "pensante" y "no pensante" diseñada para equilibrar la inferencia profunda con la respuesta rápida, y ofrecen una ventana de contexto de 128,000 tokens para casos de uso conversacionales y orientados a tareas de gran alcance.

El lanzamiento de GLM‑4.5 llega en medio de una creciente carrera nacional de IA. Según la agencia estatal Xinhua de China, los desarrolladores chinos han publicado 1,509 grandes modelos de lenguaje a julio de 2025, liderando el total global de 3,755 modelos, lo que evidencia la escala y la velocidad de la expansión del ecosistema de IA en China.

Licencia de código abierto de GLM-4.5

En una clara ruptura con los paradigmas propietarios cerrados, Z.ai está publicando GLM‑4.5 bajo una licencia de código abierto de estilo MIT y totalmente auditable, otorgando a las empresas total transparencia sobre los pesos del modelo y el código de entrenamiento. Las organizaciones pueden desplegar GLM‑4.5 en las instalaciones, ajustarlo finamente con conjuntos de datos propietarios o integrarlo mediante servicios de inferencia autoalojados, evitando así la dependencia del proveedor y estructuras opacas de precios de API.

La disponibilidad tanto de GLM‑4.5 para tareas agénticas generales como de GLM‑4.5‑Air, una variante ligera optimizada para entornos con menos recursos, garantiza un amplio espectro de casos de uso, desde despliegues a gran escala en centros de datos hasta escenarios de inferencia en dispositivos de borde.

Desde el punto de vista estratégico, el enfoque de código abierto de Zhipu posiciona a la empresa frente a los incumbentes occidentales de código cerrado como OpenAI. Al democratizar el acceso a un modelo comparable a GPT‑4 bajo la licencia MIT, Zhipu aspira a cultivar una comunidad sólida de desarrolladores aguas abajo y a establecer referencias técnicas para las capacidades de IA agéntica. Observadores de la industria señalan que este movimiento sigue una tendencia más amplia entre los "Tigres de la IA" de China, incluidas Moonshot AI y Step AI, que también han abierto grandes modelos para acelerar los ciclos de innovación.

Benchmarks de rendimiento y análisis comparativo

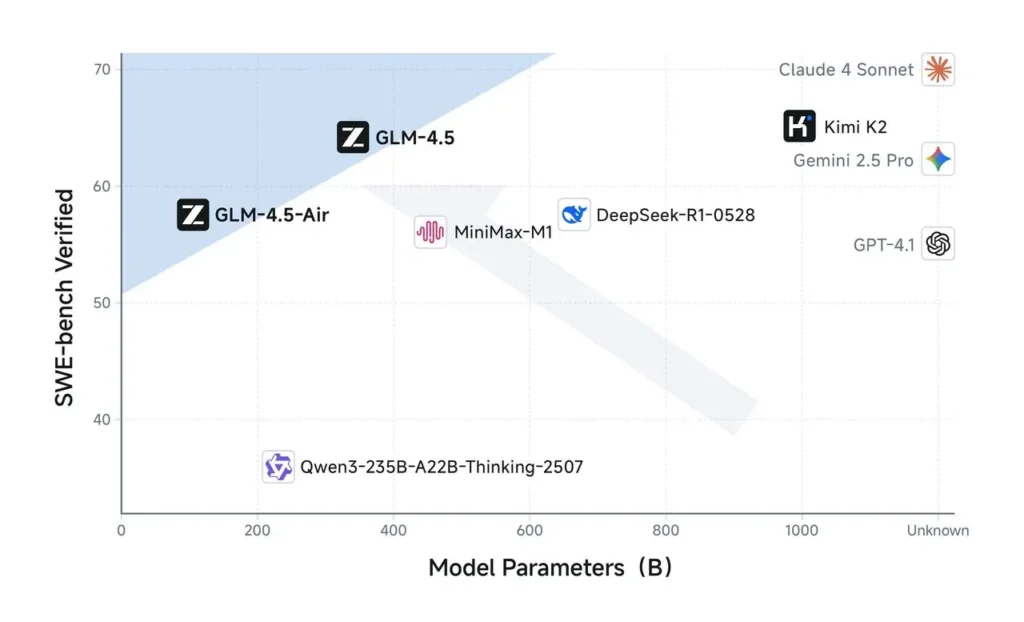

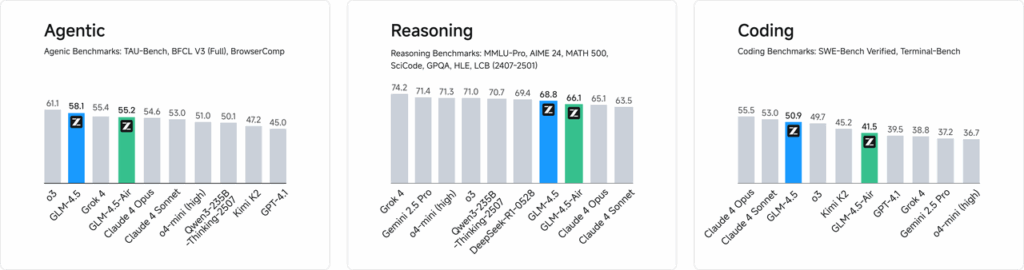

Los benchmarks preliminares proporcionados por Zhipu AI indican que GLM‑4.5 alcanza una puntuación agregada de 63.2 en 12 conjuntos de evaluación estándar del sector, ubicándolo en tercer lugar entre modelos de código abierto y propietarios, mientras que el simplificado GLM‑4.5‑Air obtiene 59.8, equilibrando eficiencia y alta precisión. Evaluaciones internas de codificación demuestran además que GLM‑4.5 supera a rivales importantes, logrando una tasa de victorias del 53.9 por ciento frente a Kimi K2 y una tasa de éxito del 80.8 por ciento frente a Qwen3‑Coder en 52 tareas de programación diversas.

Las demostraciones durante el evento en vivo subrayaron las capacidades agénticas de GLM‑4.5: el modelo realizó de forma autónoma investigaciones web—recuperando y sintetizando información de múltiples fuentes—e interactuó con entornos simulados de redes sociales y desarrollo para generar publicaciones, ejecutar fragmentos de código y manipular elementos de la interfaz de usuario en tiempo real. Los usuarios interesados pueden probar de inmediato el modelo a escala completa de forma gratuita a través del portal Qingyan de Zhipu y la plataforma CometAPI, mientras que los desarrolladores pueden acceder a endpoints de API en el servicio BigModel de CometAPI o descargar los pesos completos del modelo desde Hugging Face y ModelScope bajo una licencia MIT.

La eficiencia de costos es una piedra angular de la estrategia de Z.ai. Entrenado con un corpus de 15 billones de tokens, GLM‑4.5 aprovecha rutas de inferencia optimizadas para ofrecer un rendimiento de 100–200 tokens por segundo—hasta ocho veces más rápido que rivales nacionales comparables—con un precio anunciado de solo $0.11 por millón de tokens, superando a modelos como DeepSeek‑R1 y los últimos lanzamientos de Alibaba. Bajo la permisiva licencia MIT, todos los pesos del modelo, el código y la documentación están disponibles gratuitamente a través de Hugging Face, con el objetivo de fomentar una comunidad vibrante de desarrolladores e investigadores en todo el mundo.

"GLM‑4.5 encarna nuestro compromiso de democratizar el acceso a la tecnología de IA de primer nivel", dijo Zhang Peng, CEO de Z.ai, en una entrevista con CNBC. "Al abrir un modelo que sobresale en razonamiento, codificación y funciones agénticas, capacitamos a organizaciones de cualquier tamaño para innovar sin las restricciones de API propietarias ni costos prohibitivos".

Primeros pasos

CometAPI es una plataforma de API unificada que agrega más de 500 modelos de IA de proveedores líderes—como la serie GPT de OpenAI, Gemini de Google, Claude de Anthropic, Midjourney, Suno y más—en una única interfaz amigable para desarrolladores. Al ofrecer autenticación coherente, formateo de solicitudes y manejo de respuestas, CometAPI simplifica drásticamente la integración de capacidades de IA en sus aplicaciones. Ya esté creando chatbots, generadores de imágenes, compositores de música o canalizaciones analíticas impulsadas por datos, CometAPI le permite iterar más rápido, controlar costos y mantenerse agnóstico al proveedor, al tiempo que aprovecha los últimos avances del ecosistema de IA.

Los desarrolladores pueden acceder a la API de GLM‑4.5 a través de CometAPI, y las versiones más recientes de los modelos Claude enumeradas corresponden a la fecha de publicación del artículo. Para comenzar, explore las capacidades del modelo en el Playground y consulte la guía de la API para obtener instrucciones detalladas. Antes de acceder, asegúrese de haber iniciado sesión en CometAPI y de haber obtenido la clave de API. CometAPI ofrece un precio muy inferior al oficial para ayudarle en la integración.