L’expérience des développeurs avec l’analyse vidéo par ChatGPT se heurte souvent à un mur : les liens YouTube directs échouent, et les téléchargements MP4 renvoient des résumés « hallucinés » qui manquent les nuances visuelles. Ce n’est pas un bug — c’est une contrainte architecturale. ChatGPT ne diffuse pas de vidéo ; il traite des séquences d’images extraites et du texte de transcription. Vous avez donc essayé de téléverser un fichier MP4, ce qui a fonctionné… en quelque sorte. Le résumé mentionnait la transcription audio mais a complètement raté la blague visuelle dans la troisième scène qui donnait tout son sens à la vidéo.

ChatGPT peut analyser des vidéos — mais pas en les regardant réellement

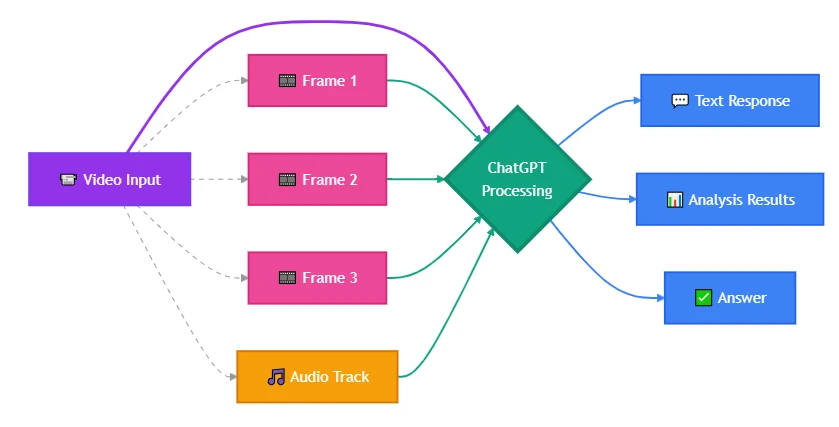

Voici ce qui se passe réellement : ChatGPT ne « regarde » pas les vidéos comme vous. Il ne lance pas la lecture, ne diffuse pas le contenu et n’observe pas le mouvement au fil du temps. Il découpe la vidéo en composants qu’il sait déjà traiter — des images fixes et une transcription —, puis raisonne sur ces éléments indépendamment. Le modèle voit votre vidéo comme un album photo avec narration, pas comme une expérience continue. C’est pourquoi il a capté l’explication verbale mais a manqué la chute visuelle : l’image contenant la blague n’était probablement pas dans l’échantillon de frames.

Quand quelqu’un demande « ChatGPT peut-il regarder des vidéos ? », il pose généralement l’une de deux questions : peut-il diffuser du contenu visuel comme un observateur humain, ou peut-il extraire et analyser le sens à partir de données vidéo — scènes, dialogues, horodatages, actions à l’écran ? La réponse fonctionnelle est oui à la deuxième question, avec des contraintes qui invalident complètement certains cas d’usage. Les variantes modernes de ChatGPT traitent la vidéo en la considérant comme un ensemble d’images échantillonnées combinées à une transcription audio, soit via une extraction automatisée dans l’interface web, soit via des images fournies par l’utilisateur via l’API. Cela fonctionne pour la synthèse, la description de scènes et l’extraction de texte. Cela échoue pour le suivi de mouvement, l’analyse dépendante du timing, ou tout ce qui exige que le modèle « voie » ce qui se passe entre les images.

La plupart des guides se contentent de confirmer que la capacité existe sans expliquer pourquoi votre implémentation spécifique n’a pas fonctionné — ni quelle méthode d’entrée alternative utiliser.

ChatGPT Capacités vidéo : ce que le modèle voit réellement

ChatGPT ne charge pas un MP4 pour le parcourir image par image. Il dispose d’une capacité de vision — la capacité à analyser des images statiques — et d’une transcription audio via l’intégration de Whisper. Lorsque vous soumettez une vidéo via l’interface web ou mobile de ChatGPT, le système extrait des images clés, transcrit l’audio séparément et alimente les deux au modèle comme entrées distinctes. Le modèle décrit alors ce qu’il a « vu » dans ces images et ce qu’il a « entendu » dans la transcription.

De votre point de vue, cela ressemble à de la compréhension vidéo. Du point de vue du modèle, c’est de l’analyse d’images plus du traitement de texte. Cette distinction architecturale détermine les cas d’usage qui fonctionnent et ceux qui ne fonctionnent pas.

Si votre vidéo repose sur le mouvement, de subtils changements d’une image à l’autre, ou un timing précis — comme détecter exactement quand un objet entre dans le cadre, ou suivre comment un élément d’interface s’anime —, une approche basée sur des images clés passera à côté. ChatGPT ne détectera pas un indice visuel de deux secondes qui tombe entre les images échantillonnées. Il ne suivra pas non plus des objets dans le temps à moins que vous ne structuriez explicitement l’entrée pour montrer une progression.

Capacités vidéo actuelles de ChatGPT (début 2026) :

- Analyse vidéo basée sur l’image : accepte des fichiers vidéo ou des images extraites ; interprète le contenu visuel à partir d’images échantillonnées

- Transcription audio : convertit les paroles en texte via Whisper ; le modèle peut ensuite résumer ou interroger la transcription

- Description de scène : identifie les objets, actions, environnements et textes visibles dans les images fournies

- Requêtes basées sur les horodatages : peut référencer des moments spécifiques si vous fournissez des horodatages d’images ou segmentez manuellement la vidéo

- Extraction de texte : lit les sous-titres à l’écran, étiquettes d’interface ou documents visibles dans les images

Taux d’échantillonnage des images et comportement de sélection automatique des images clés dans l’interface web de ChatGPT — non documentés publiquement à la date de clôture des connaissances

Ce qui n’est pas inclus :

- Entrée vidéo en streaming en temps réel via l’API

- Suivi de mouvement « au frame près » ou persistance d’objets dans le temps

- Prise en charge native des codecs vidéo — tout le traitement se fait sur des images extraites et de l’audio

- Détection automatique des changements de scène sans consignes explicites

La capacité vidéo est bornée par les limites de jetons et la taille des fichiers, pas par la durée. Bien que 5–10 minutes soit une heuristique pratique, les limites réelles évoluent dynamiquement avec la densité visuelle.

Si votre cas d’usage exige ces capacités, soit vous prétraitez la vidéo vous-même pour extraire les bonnes images, soit vous passez à un modèle avec prise en charge native de la vidéo. La section suivante détaille quelle méthode d’entrée utiliser pour votre scénario.

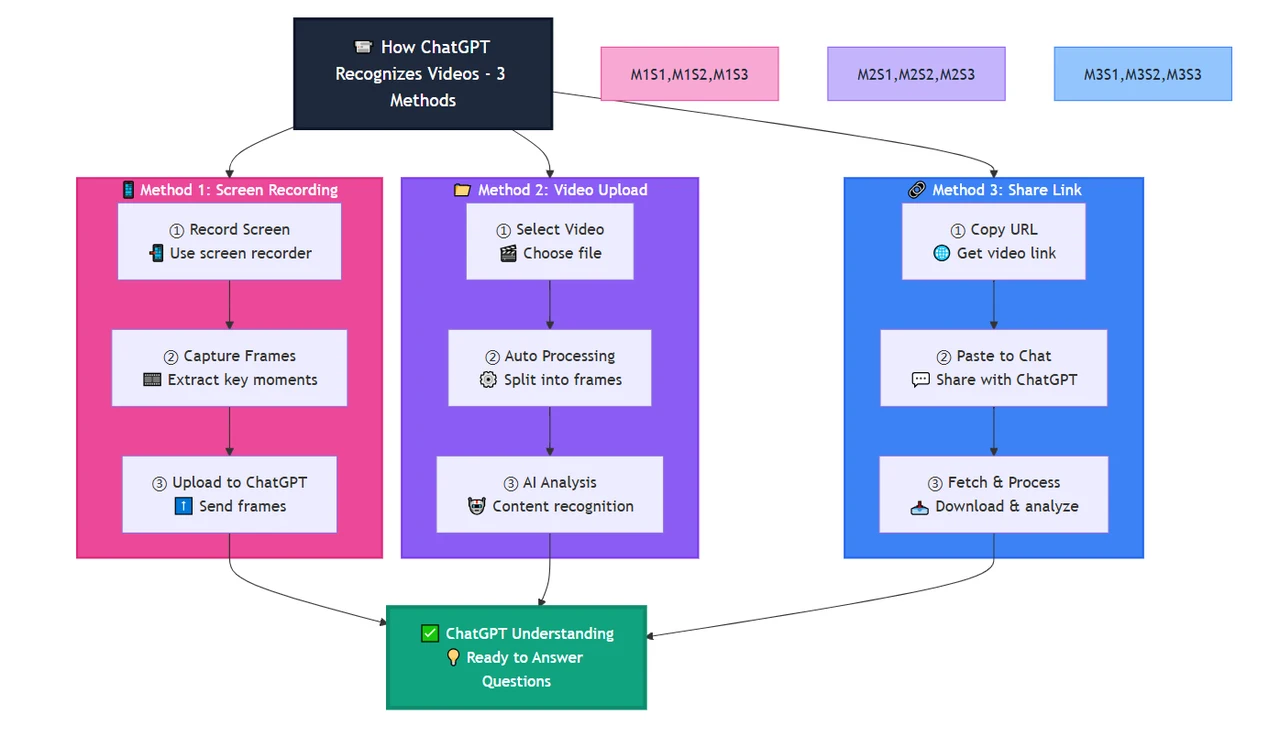

Comment ChatGPT reconnaît les vidéos : trois méthodes pratiques

Il n’existe pas qu’une seule façon de soumettre une vidéo à ChatGPT. La méthode choisie détermine ce que le modèle peut analyser et ce qui lui échappera. La plupart des échecs d’implémentation proviennent du choix de la méthode la plus pratique plutôt que de la plus adaptée.

Méthode 1 : extraction manuelle des images + téléversement d’images

Extrayez vous-même des images avec ffmpeg ou des outils similaires, puis téléversez ces images spécifiques. Vous contrôlez ainsi exactement ce que ChatGPT analyse.

Exemple de workflow (bash) :

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Cette approche vous permet de :

- Concentrer l’analyse sur des moments spécifiques (intro, action clé, conclusion) sans gaspiller le contexte sur des sections non pertinentes

- Capturer le mouvement en téléversant des images consécutives selon votre cadence d’échantillonnage

- Contourner les limites de taille de fichier — les images sont plus petites que les vidéos complètes

- Préserver la qualité des images qui pourrait se dégrader lors de la compression automatique

Le compromis :

Vous gérez vous-même le prétraitement. Pour analyser des centaines de vidéos à grande échelle, cela nécessite de l’automatisation. Pour une analyse ponctuelle approfondie ou le débogage de scènes spécifiques, c’est la méthode la plus fiable.

Quand utiliser cette méthode :

- Vous avez besoin d’une analyse au niveau de l’image pour des moments précis

- L’information visuelle critique est brève ou survient entre des intervalles d’images typiques

- Vous comparez des changements visuels sur une séquence (changements d’état d’UI, images d’animation)

- Vous voulez vérifier ce que le modèle a réellement « vu » en inspectant exactement les images téléversées

Méthode 2 : téléversement direct de fichier via l’interface ChatGPT

L’application web et mobile de ChatGPT accepte les téléversements vidéo directement dans la conversation. Déposez un fichier MP4 ou MOV dans le champ de saisie ; le système gère automatiquement l’extraction des images et la transcription.

Ce qui se passe en interne :

- Le service échantillonne des images à intervalles réguliers (taux non documenté ; estimé à 1–2 images par seconde d’après les observations)

- L’audio est transcrit via Whisper ou un service similaire

- Les deux sorties sont passées au modèle comme des entrées de contexte distinctes

- Le modèle génère des réponses à partir des images visibles et de la transcription entendue

Cette méthode fonctionne pour :

- Des résumés vidéo de haut niveau où la précision image par image n’est pas nécessaire

- L’identification d’objets, de personnes ou d’environnements présents de manière persistante dans les scènes

- L’extraction de contenu parlé ou de texte à l’écran apparaissant dans plusieurs images

- Une analyse exploratoire rapide sans prétraitement

Cette méthode échoue pour :

- L’analyse au frame près — vous ne contrôlez pas quelles images sont échantillonnées

- Pour des contenus vidéo étendus dépassant la capacité contextuelle confortable du modèle, une segmentation logique est requise. Sans découpage stratégique ou prétraitement, les modèles peuvent se dégrader ou tronquer à mesure que la consommation de jetons s’accélère avec une forte densité visuelle

- La détection du mouvement, des transitions, ou de contenus dépendant du timing qui exigent la comparaison d’images consécutives

- Les scénarios où l’information visuelle critique apparaît brièvement entre des images échantillonnées

Si vous avez besoin de contrôler les moments analysés, utilisez la Méthode 1.

Méthode 3 : lien YouTube + récupération de transcription

Certains plugins ChatGPT et outils tiers prétendent « analyser des vidéos YouTube ». En réalité, ils récupèrent les métadonnées publiques et la transcription de la vidéo (si disponible), puis transmettent ce texte à ChatGPT.

Cela fonctionne quand :

- La vidéo dispose de sous-titres auto-générés ou téléversés par l’utilisateur

- Votre analyse ne requiert que le contenu parlé, pas l’information visuelle

- La vidéo est publiquement accessible (pas privée, non répertoriée ou restreinte par région)

- Vous résumez des cours, podcasts ou interviews où l’audio porte l’essentiel du sens

Cela ne fonctionne pas quand :

- Vous devez analyser le contenu visuel (démonstrations à l’écran, schémas, expressions faciales)

- La vidéo n’a pas de transcription ni de sous-titres

- L’information critique apparaît visuellement sans être mentionnée dans le dialogue

- Vous travaillez avec des fichiers vidéo privés ou du contenu derrière authentification

Erreur courante : Les développeurs s’attendent à une compréhension vidéo complète (visuel + audio) mais ne reçoivent qu’un résumé de transcription. C’est acceptable pour l’analyse de contenu parlé. C’est inutile pour passer en revue des démos produit, analyser un design visuel, ou tout scénario où ce que l’on voit compte plus que ce qui est dit.

Le schéma récurrent : Méthode 2 pour des résumés rapides où la précision importe peu. Méthode 1 pour une analyse maîtrisée quand vous avez besoin d’images spécifiques. Méthode 3 pour des contenus centrés sur l’audio où l’information visuelle est secondaire ou absente. Choisissez en fonction de l’endroit où se situe le signal critique de votre cas d’usage — dans le mouvement, dans des images spécifiques, ou uniquement dans le dialogue.

Scénarios d’application vidéo de ChatGPT : ce qui fonctionne réellement en production

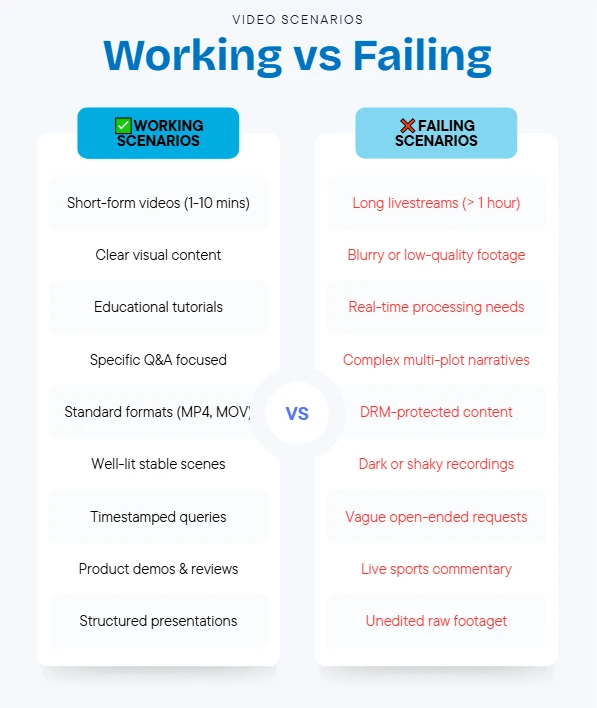

Savoir que ChatGPT peut traiter des composants vidéo ne dit pas si c’est l’outil adapté à votre problème. Ces scénarios montrent où l’analyse basée sur des images réussit — et où les contraintes architecturales cassent le cas d’usage.

Scénario 1 : synthèse de contenu éducatif

Cas d’usage : Vous avez une vidéo tutorielle de 10 minutes et vous avez besoin d’un résumé structuré des étapes clés, des outils mentionnés et des exemples visuels montrés.

Pourquoi ça marche : Les vidéos éducatives ont généralement des frontières de scènes claires, du texte à l’écran persistant et une narration alignée avec les visuels. L’intervenant décrit ce qu’il montre pendant que c’est visible. ChatGPT peut transcrire l’explication, identifier des outils ou schémas dans les images échantillonnées, et combiner les deux dans un résultat structuré.

Approche d’implémentation : Téléversez la vidéo via l’interface ChatGPT ou extrayez 8–12 images clés aux grandes transitions de sujets. Prompt : « Dresse les étapes principales expliquées dans cette vidéo, en référant à la narration ainsi qu’à tout texte à l’écran, schéma ou nom d’outil que tu vois. »

Où ça casse : Les vidéos qui reposent sur un mouvement continu — comme une capture vidéo d’écran de code où l’instructeur tape rapidement à travers plusieurs fichiers — auront des étapes manquantes entre les images. Il vous faudra des cadences d’échantillonnage plus élevées ou vous concentrer uniquement sur la transcription audio.

Astuce pratique : Pour les cours ou tutoriels, combinez le téléversement automatique (pour la transcription) avec des images extraites manuellement des 3–5 moments visuels les plus importants. Vous obtenez ainsi une couverture audio complète et des images de haute qualité pour les concepts clés.

Scénario 2 : analyse de démo produit

Cas d’usage : Vous examinez la démo d’un concurrent et voulez extraire les éléments d’interface, noms de fonctionnalités, parcours utilisateur et informations tarifaires affichées à l’écran.

Pourquoi ça marche : Les démos produit maintiennent généralement chaque écran suffisamment longtemps pour que l’échantillonnage capture l’UI statique. Les incrustations de texte, libellés de boutons, structures de menus et tableaux de prix restent visibles sur plusieurs images. La vision de ChatGPT peut lire et décrire ces éléments même s’ils ne sont pas mentionnés dans la narration.

Approche d’implémentation : Extrayez des images aux grands changements de scène (diapo d’intro, démo de la fonctionnalité 1, fonctionnalité 2, écran de tarification, CTA). Téléversez ces images et utilisez le prompt : « Pour chaque image, identifie tous les éléments d’interface visibles, libellés de boutons, noms de fonctionnalités et toute information tarifaire ou produit affichée. »

Où ça casse : Les démos avec des transitions rapides, des états au survol qui n’apparaissent que brièvement, ou des éléments interactifs montrés seulement 1–2 secondes ne seront pas capturés par l’échantillonnage. Si le concurrent affiche rapidement un tableau de comparaison, vous le manquerez sauf si ce moment précis a été échantillonné.

Astuce pratique : Parcourez d’abord la vidéo manuellement pour repérer les horodatages des révélations importantes. Extrayez des images à ces moments spécifiques plutôt que de compter sur des intervalles d’échantillonnage automatiques.

Scénario 3 : transcription de réunion ou d’entretien avec contexte visuel

Cas d’usage : Vous avez enregistré un appel client et avez besoin à la fois d’une transcription et d’annotations indiquant quand des documents, diapos ou partages d’écran spécifiques sont apparus.

Pourquoi ça marche : La transcription audio couvre les dialogues. Lorsque des participants partagent leur écran ou montrent des documents, ceux-ci apparaissent dans les images échantillonnées. ChatGPT peut annoter « vers [horodatage], un document contractuel était visible à l’écran » aux côtés de la transcription — utile pour des comptes-rendus qui référencent des supports visuels.

Approche d’implémentation : Téléversez la vidéo et utilisez le prompt : « Transcris cette réunion et note tout moment où des documents, des diapositives de présentation, des partages d’écran ou d’autres références visuelles sont apparus. Pour chaque élément visuel, décris ce qui était montré. »

Où ça casse : Des partages d’écran brefs (moins de 5–10 secondes) peuvent tomber entre les images échantillonnées. Un texte trop petit à lire dans des images compressées ne sera pas extractible. Pour des besoins juridiques ou de conformité exigeant l’exactitude verbatim des documents affichés, vérifiez la qualité des images et la couverture d’échantillonnage avant de vous y fier.

Astuce pratique : Pour les réunions importantes, enregistrez en plus haute résolution et extrayez manuellement des images aux moments où quelqu’un dit « laissez-moi vous montrer ce document » — signal d’une référence visuelle imminente.

Scénario 4 : modération de contenu ou revue de conformité

Cas d’usage : Vous devez analyser des vidéos envoyées par des utilisateurs afin d’y détecter des contenus interdits — logos spécifiques, motifs de texte ou éléments visuels violant les politiques de la plateforme.

Pourquoi ça marche : ChatGPT peut analyser les images pour repérer du texte visible, des objets reconnaissables ou des scènes décrites. Si vous vérifiez « est-ce que l’une de ces vidéos montre le logo d’un concurrent », l’analyse image par image détecte les logos persistants à l’écran plus d’une seconde ou deux.

Approche d’implémentation : Extrayez des images à intervalles réguliers (toutes les 3–5 secondes), téléversez-les, et utilisez le prompt : « Passe en revue ces images et identifie celles contenant [logo spécifique, nom de marque, symbole interdit, etc.]. Pour chaque correspondance, décris où il apparaît dans l’image. »

Où ça casse : Les violations audio (musique sous copyright, discours prohibé) exigent une analyse audio dédiée. Les violations basées sur le mouvement (gestes interdits, actions s’étalant sur plusieurs images) ne seront pas capturées par l’analyse d’images fixes. Un contenu interdit brièvement affiché peut ne pas apparaître dans les images échantillonnées.

Astuce pratique : Combinez l’analyse visuelle de ChatGPT avec des services d’empreinte audio dédiés et des cadences d’échantillonnage plus élevées pour les catégories à haut risque. Utilisez ChatGPT comme filtre de premier passage, pas comme unique couche de modération.

Le trait commun des scénarios réussis : le contenu significatif existe dans des images stables et se corrèle à l’audio ou au texte. Les échecs surviennent lorsque l’information critique réside dans le mouvement, le timing, les transitions, ou apparaît trop brièvement pour être échantillonnée de manière fiable.

Capacités vidéo de Gemini vs. Claude vs. ChatGPT

Si l’architecture d’échantillonnage d’images de ChatGPT ne convient pas à votre cas d’usage, évaluez des alternatives. Gemini et Claude offrent des capacités vidéo différentes — et ces différences déterminent quel modèle fonctionne pour votre implémentation.

Traitement vidéo natif de Gemini

Les modèles Gemini prennent en charge l’entrée vidéo native au niveau de l’API. Vous passez un fichier vidéo directement, sans prétraitement en images. Le modèle traite la vidéo comme un flux continu, permettant le suivi de mouvement, la détection de changements de scène et le raisonnement temporel que l’approche d’images de ChatGPT ne peut pas gérer.

Cas d’usage où Gemini l’emporte :

Vous devez détecter quand un objet spécifique entre et sort du cadre sur un clip de 30 secondes, ou suivre le déplacement d’une personne dans une scène. Gemini peut suivre des objets d’une image à l’autre et raisonner sur le mouvement. ChatGPT ne verrait l’objet que dans les images échantillonnées — risquant de manquer l’entrée ou la sortie.

Compromis :

- L’API native de Gemini est plus économique qu’un échantillonnage image par image côté OpenAI. En évitant la surcharge linéaire de jetons via la mise en cache de contexte, Gemini passe mieux à l’échelle pour l’analyse longue durée.

- Le traitement de vidéos plus longues induit une latence plus élevée — le modèle doit ingérer tout le fichier avant de répondre

- Toutes les variantes de Gemini ne prennent pas en charge l’entrée vidéo ; nécessite des modèles Gemini ultérieurs

- Des limites de durée existent mais sont plus généreuses que les contraintes de contexte de ChatGPT

Quand choisir Gemini plutôt que ChatGPT :

- Votre cas d’usage exige du suivi de mouvement, la détection de frontières de scène ou la compréhension des relations temporelles

- L’information critique apparaît et disparaît rapidement d’une image à l’autre

- Vous analysez des vidéos où la progression des événements compte (séquences sportives, surveillance, analyse d’animation)

- Vous souhaitez éviter l’extraction manuelle d’images en prétraitement

Limitations vidéo actuelles de Claude

Début 2026, les modèles Claude ne prennent pas en charge l’entrée vidéo directe via l’API. Vous pouvez téléverser des images (y compris des images extraites manuellement d’une vidéo), mais il n’y a pas de capacité de traitement vidéo native comparable à celle de Gemini.

Ce que Claude peut faire :

- Analyser des séquences d’images téléversées, similaire à la méthode d’extraction manuelle (Méthode 2)

- Fournir des descriptions détaillées du contenu visuel de chaque image

- Raisonner sur le mouvement implicite ou les changements entre images si on le lui demande explicitement

- Gérer des séquences plus longues d’images grâce à une fenêtre de contexte étendue (jusqu’à 1M de jetons dans Claude Opus 4.7)

Ce que Claude ne peut pas faire :

- Accepter des fichiers vidéo directement via une interface

- Suivre automatiquement le mouvement ou des objets dans le temps sans consignes image par image

- Transcrire l’audio — nécessite un prétraitement séparé avec Whisper ou un service similaire, puis transmettre la transcription à Claude

Quand choisir quand même Claude :

- Votre flux de travail inclut déjà l’extraction d’images en prétraitement

- Vous analysez de longues vidéos nécessitant beaucoup d’images et avez besoin de la grande fenêtre de contexte de Claude

- Vous comparez la qualité de l’analyse visuelle et trouvez les descriptions de Claude plus précises pour votre domaine (ex. imagerie médicale, schémas techniques)

- Vous devez combiner l’analyse d’images avec de grandes quantités d’autres informations contextuelles

Tableau de comparaison des capacités

| Fonctionnalité | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Téléversement direct de vidéo | ✓ (interface web/app) | ✓ (API + interface web) | ✗ |

| Suivi de mouvement natif | ✗ | ✓ | ✗ |

| Transcription audio | ✓ (intégration Whisper) | ✓ (intégrée) | ✗ (outil externe requis) |

| Analyse basée sur l’image | ✓ | ✓ (et traitement continu) | ✓ (extraction manuelle uniquement) |

| Détection de changements de scène | ✗ (manuelle uniquement) | ✓ (automatique) | ✗ |

| Durée vidéo typique gérée | ~5–10 min | ~1 heure (selon la résolution) | N/A (nombre d’images limité par le contexte) |

| Cas d’usage idéal | Résumés rapides, analyse au niveau de l’image avec un certain contrôle | Suivi de mouvement, raisonnement temporel, vidéo continue | Description image par image approfondie avec grands besoins de contexte |

| Prise en charge vidéo via API | ✗ (images uniquement) | ✓ | ✗ |

Cadre de décision :

- Choisissez ChatGPT quand : vous avez besoin de résumés rapides, l’information critique persiste sur plusieurs images, vous travaillez avec de courts clips (moins de 10 minutes) et vous n’avez pas besoin de suivi de mouvement. Idéal pour le contenu éducatif, les démos statiques, la transcription de réunions.

- Choisissez Gemini quand : votre cas d’usage exige du suivi de mouvement, la détection de scènes ou un raisonnement temporel sur l’évolution des éléments. Indispensable pour la surveillance, l’analyse sportive, la revue d’animation, ou tout scénario où « ce qui se passe entre les images » compte.

- Choisissez Claude quand : vous extrayez déjà des images dans votre pipeline, devez analyser de nombreuses images avec un contexte étendu, ou trouvez les descriptions visuelles de Claude plus précises pour votre domaine. Requiert le plus de prétraitement mais offre la plus grande fenêtre de contexte.

Pour les développeurs travaillant avec plusieurs modèles, CometAPI fournit une interface unifiée pour tester la qualité de traitement vidéo des variantes GPT, Gemini et Claude sans réécrire le code d’intégration — utile pour comparer la qualité avant de s’engager avec un fournisseur spécifique.

La vraie réponse à « ChatGPT peut-il regarder des vidéos ? » n’est pas binaire. C’est « oui, en convertissant la vidéo en formats qu’il sait déjà traiter — avec des limitations qui cassent des cas d’usage spécifiques ». La plupart des échecs d’implémentation proviennent de décalages architecturaux, pas de lacunes de capacité. Le modèle fonctionne exactement comme conçu ; les développeurs s’attendaient simplement à une conception différente.

Si vous construisez des fonctionnalités d’analyse vidéo à l’échelle, testez d’abord votre flux avec des cas limites : téléversez la même vidéo via fichier direct, images extraites manuellement et méthode « transcription seule ». Comparez les sorties. La méthode qui capture le signal critique de votre cas d’usage — pas la plus rapide à implémenter — est celle qui résiste au trafic de production.

Avant d’adopter ChatGPT pour la vidéo :

- Identifiez si votre information critique réside dans des images stables, le mouvement ou l’audio

- Testez la couverture d’échantillonnage en extrayant manuellement des images selon vos intervalles attendus

- Vérifiez que le texte à l’écran est lisible à la résolution de votre vidéo après compression

- Confirmez que la durée de votre vidéo respecte les limites pratiques de contexte de votre niveau d’abonnement

- Prévoyez un repli pour le contenu apparaissant brièvement ou entre des images échantillonnées

Pour les développeurs évaluant plusieurs fournisseurs d’IA pour des charges vidéo, CometAPI propose un bac à sable unifié pour tester ChatGPT, Gemini et Claude avec les mêmes entrées vidéo — afin de comparer la qualité, la latence et le coût avant de créer des intégrations spécifiques.

FAQ - Guide d’analyse vidéo par IA

Des réponses rapides aux questions fréquentes sur l’analyse vidéo par IA.

ChatGPT peut-il analyser des vidéos ?

Oui, ChatGPT (GPT-4o et ultérieurs) peut analyser des vidéos en échantillonnant des images (~1 par seconde) et en transcrivant l’audio. Cela fonctionne bien pour les résumés de réunions, l’extraction de texte à partir de diapositives et l’identification d’objets. En revanche, il est en difficulté pour le suivi de mouvement, les vidéos de plus de 10 minutes et le streaming en temps réel.

Comment téléverser des vidéos dans ChatGPT ?

Téléversement via URL directe (recommandé) : Téléversez via une URL publique pour une analyse rapide. Idéal pour des vidéos de moins de 10 minutes.

Extraction manuelle d’images : Extrayez des images spécifiques pour un contrôle précis. Idéal lorsque vous devez analyser des moments particuliers ou réduire les coûts en jetons.

Quelle est la durée maximale de vidéo que ChatGPT peut traiter ?

ChatGPT gère de manière fiable des vidéos jusqu’à 5–10 minutes. Au-delà, segmentez la vidéo ou passez à Gemini 2.5 Pro, qui prend en charge nativement des vidéos jusqu’à 60 minutes.

Quelles sont les limites de l’analyse vidéo de ChatGPT ?

- Incapacité à suivre le mouvement continu (sports, danse)

- Horodatages imprécis (±1 seconde)

- Contenu manqué s’il apparaît moins d’1 seconde

- Limite pratique de 10 minutes

- Pas de support de streaming en temps réel

- Difficultés avec des vidéos de faible qualité ou sombres

- Faible en raisonnement temporel de cause à effet *

Dois-je utiliser ChatGPT ou Gemini pour l’analyse vidéo ?

Utilisez ChatGPT pour :

- Des vidéos de moins de 10 minutes

- Un raisonnement textuel supérieur après l’analyse vidéo

- Une analyse au niveau de l’image (diapositives, captures d’écran)

Utilisez Gemini pour :

- Des vidéos de 10–60 minutes

- Le suivi de mouvement et l’analyse des déplacements

- Les tâches de raisonnement temporel

- Les sports, la danse ou des vidéos de surveillance *

Claude peut-il analyser des vidéos ?

Non, Claude ne prend pas en charge l’entrée vidéo directe. Toutefois, vous pouvez extraire des images des vidéos et les analyser avec Claude, qui offre un raisonnement textuel et une fenêtre de contexte supérieurs pour des analyses longues.

Combien coûte l’analyse vidéo ?

Les coûts varient selon le modèle et la longueur de la vidéo :

- ChatGPT 4o** :** ~0,05 $ par minute

- Gemini 2.5 Pro** :** ~0,04 $ par minute

CometAPI offre des crédits aux nouveaux utilisateurs pour démarrer.