Claude Opus 4.7, publié le 16 avril 2026, est une mise à niveau majeure par rapport à Opus 4.6 en codage, workflows agentiques, vision et suivi des instructions. Il obtient +6.8pp sur SWE-bench Verified (87.6% vs 80.8%), +10.9pp sur SWE-bench Pro (64.3% vs 53.4%), +12pp sur CursorBench (70% vs 58%), et offre une vision 3,3× plus haute résolution avec des boucles d’auto-vérification qui réduisent les hallucinations sur les tâches longues. La tarification officielle reste identique ($5/$25 par million de tokens), mais l’effort faible de 4.7 atteint la qualité de l’effort moyen de 4.6, réduisant les coûts réels.

Sur CometAPI, vous obtenez les deux modèles (Claude Opus 4.7 et Opus 4.6) à $4 input / $20 output avec des endpoints compatibles OpenAI et zéro verrouillage fournisseur. Mettez à niveau si vous exécutez des agents de codage en production, une analyse de documents complexe ou des workflows multi-session — 4.7 est le nouveau défaut pour le travail de pointe.

Claude Opus 4.7 vs Opus 4.6 : Comparaison rapide

En bref : Opus 4.7 donne l’impression d’être « Opus 4.6 mais débridé et affiné ». Il supprime des limitations qui apparaissaient parfois en 4.6 (par ex., abandon prématuré de tâches, acuité visuelle moindre) tout en ajoutant de l’efficacité via un raisonnement adaptatif. Les utilisateurs rapportent qu’il est plus « opinionated » et collaboratif — comme travailler avec un ingénieur senior qui se relit.

Pourquoi Claude Opus 4.7 compte en 2026

Le 16 avril 2026, Anthropic a discrètement publié son modèle le plus capable généralement disponible à ce jour : Claude Opus 4.7. Quelques semaines après le Mythos Preview restreint (une puissance axée sur le cyber), Opus 4.7 reprend la couronne pour les workloads de production tout en conservant exactement la même tarification qu’Opus 4.6.

Les développeurs et les entreprises n’ont plus besoin de surveiller de près les tâches de codage les plus difficiles. Les utilisateurs disent confier « celles qui nécessitaient auparavant une supervision étroite » à 4.7 en toute confiance. Le modèle auto-vérifie ses sorties, suit les instructions à la lettre et maintient des exécutions agentiques de plusieurs heures avec moins d’erreurs d’outils et une meilleure récupération d’erreurs.

Le modèle excelle à :

- Tâches longues rigoureuses avec auto-vérification intégrée (Plan → Execute → Verify → Report).

- Suivi littéral des instructions — fini les interprétations vagues de « consider » ou « you might ».

- Vision nettement meilleure (jusqu’à 2 576 px sur la grande dimension ≈ 3,75 MP, plus de 3× la résolution précédente).

- Goût et créativité supérieurs dans des livrables professionnels comme interfaces, slides et documents.

- Mémoire du système de fichiers améliorée pour une véritable autonomie multi-session.

Parmi les nouveautés : un niveau d’effort xhigh (entre high et max), des budgets de tâches sur la Platform API, et l’intégration de l’outil Claude Design. L’ID du modèle est désormais claude-opus-4-7. La tarification ne change pas officiellement, mais les améliorations d’efficacité des tokens réduisent souvent le coût effectif par tâche.

Améliorations de capacités clés – Ce qui a réellement changé

Ingénierie logicielle avancée & codage agentique

Opus 4.7 brille sur les problèmes les plus difficiles. Sur un benchmark interne de 93 tâches de codage, il a obtenu une hausse de résolution de 13% par rapport à 4.6, résolvant quatre tâches que ni 4.6 ni Sonnet 4.6 ne pouvaient débloquer. Rakuten-SWE-Bench a montré 3× plus de tâches de qualité production résolues sans intervention humaine. CursorBench (workflows réels d’IDE) a bondi de +12 points à 70%.

Le benchmark interne de 93 tâches de codage a montré une hausse de 13%, résolvant quatre tâches que ni 4.6 ni Sonnet 4.6 ne pouvaient débloquer. Dans les workflows agentiques, Box a rapporté 2× moins d’appels LLM (7.1 vs 16.3) et une réduction de 30% de l’utilisation d’unités IA pour le même résultat — se traduisant directement par des gains de coût et de latence.

Pourquoi c’est important pour les développeurs : Vous pouvez désormais faire confiance à Opus 4.7 pour « le travail de codage le plus difficile » nécessitant auparavant une supervision. Il prête une attention précise aux instructions, vérifie ses propres sorties et réutilise la mémoire du système de fichiers à travers les sessions — idéal pour un refactoring autonome sur plusieurs jours.

Gains concrets :

- Moteur TTS Rust autonome à partir d’un seul prompt.

- Correction de conditions de course et de bugs de concurrence qui bloquaient les modèles précédents sur Terminal-Bench 2.0 (+4.0 pp).

- +10–15% de réussite des tâches Factory Droids avec ⅓ d’erreurs d’outils en moins.

- Améliorations à deux chiffres de la qualité du code, de la qualité des tests et de la précision des reviews (CodeRabbit, Qodo).

L’effort faible de 4.7 atteint désormais la qualité de l’effort moyen de 4.6, ce qui permet d’en faire plus pour la même (ou une moindre) dépense en tokens.

Saut en vision & multimodal

C’est la plus grande mise à niveau unique. La résolution d’image maximale passe de 1,15 MP (1568 px) à 3,75 MP (2576 px sur la grande dimension) — une augmentation de 3,3× en pixels avec un mappage de coordonnées 1:1. Fini les facteurs d’échelle pour les captures d’écran ou les diagrammes.

Résultats :

- Benchmark d’acuité visuelle : 98.5% vs 54.5% sur 4.6.

- CharXiv-R (sans outils) : +13.4 pp ; avec outils : +13.6 pp.

- Déverrouille des agents d’utilisation d’ordinateur pixel-perfect, l’analyse dense de captures d’écran, le parsing de structures chimiques, et la revue UI/UX.

Workflows agentiques, fiabilité & suivi des instructions

Opus 4.7 introduit une auto-vérification native — le modèle planifie, exécute, vérifie, puis rapporte. Cela réduit drastiquement les réponses confiantes mais erronées sur les tâches de long horizon. Les améliorations de la mémoire système de fichiers permettent une autonomie véritable sur plusieurs jours.

Le suivi des instructions est plus strict et plus littéral. Les prompts calibrés pour le style plus souple de 4.6 peuvent nécessiter un audit — des phrases comme « consider » sont désormais traitées comme des exigences strictes. C’est une fonctionnalité utile pour le travail de précision, mais elle demande une migration des prompts.

Note sur les régressions : La récupération d’aiguille en long contexte (MRCR) a chuté notablement (par ex., 91.9% → 59.2% à 256K). Anthropic indique qu’ils abandonnent ces tests synthétiques au profit de métriques GraphWalks appliquées, où la compréhension de code réelle reste solide.

Nouveau niveau d’effort xhigh + budgets de tâches

Opus 4.7 ajoute xhigh entre high et max pour un contrôle plus granulaire. Claude Code utilise désormais par défaut xhigh dans les plans. Le nouveau task_budget (beta publique) permet au modèle de suivre le total de tokens sur l’ensemble d’une boucle agentique et de terminer proprement.

Suivi des instructions, auto‑vérification & mémoire

Opus 4.7 interprète les prompts plus littéralement — excellent pour la précision, mais d’anciens prompts vagues peuvent nécessiter un resserrement. Il conçoit désormais ses propres étapes de vérification (Plan → Execute → Verify → Report) et réutilise bien mieux la mémoire du système de fichiers au fil du travail multi-session que 4.6. Pour les équipes qui construisent des agents persistants, c’est l’une des améliorations les plus utiles car elle réduit les ré-explications, rechargements et re‑planifications.

Mise à jour du tokenizer

Le nouveau tokenizer améliore la qualité mais peut consommer 1,0–1,35× plus de tokens (jusqu’à +35%). L’endpoint de comptage de tokens retourne désormais des nombres différents. Effet net : une qualité supérieure par tâche compense souvent l’augmentation, surtout aux niveaux d’effort plus bas.

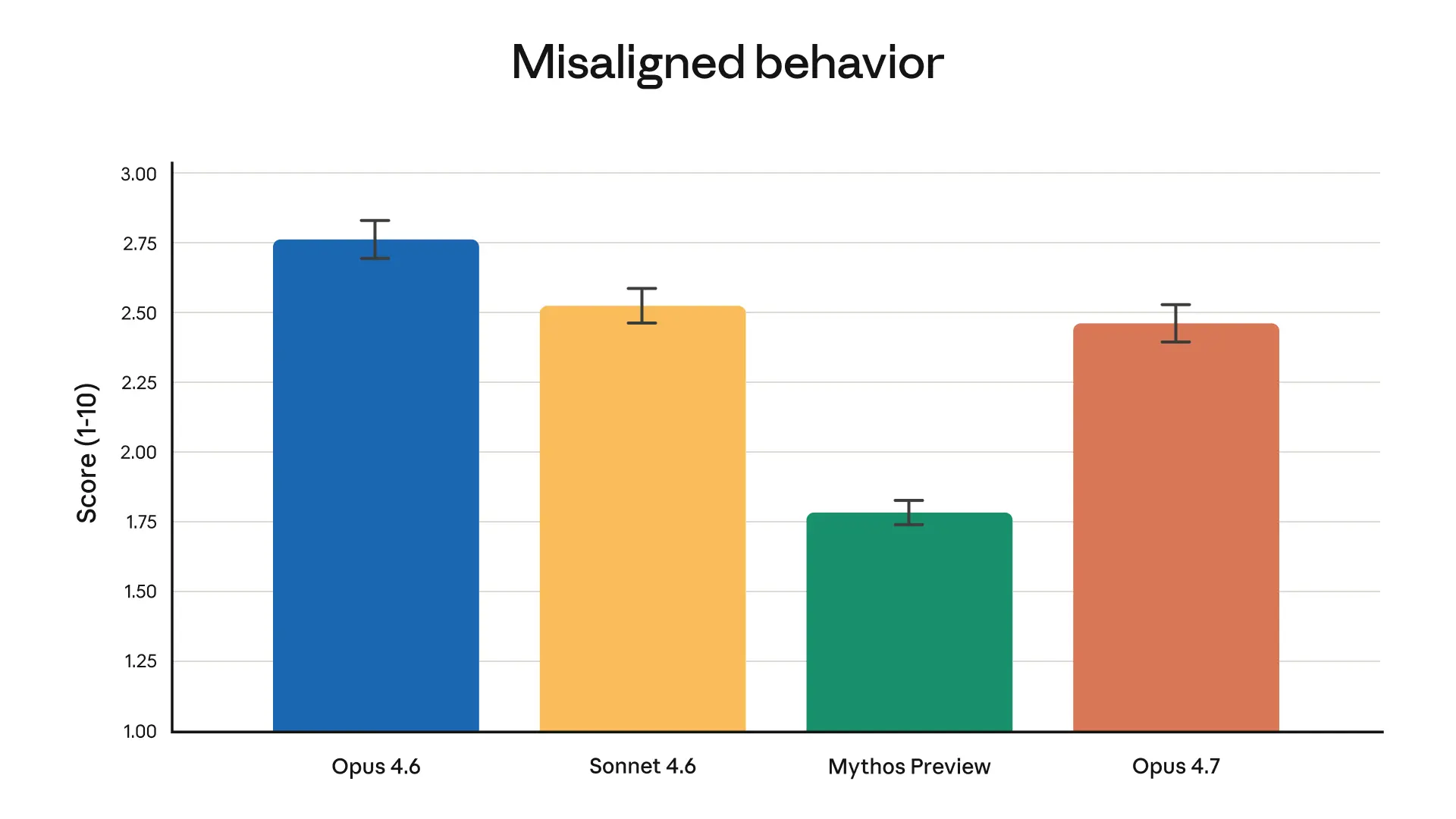

Sécurité, alignement & cybersécurité

Le profil de sécurité est similaire à 4.6 (faible désalignement), avec des améliorations modestes en honnêteté et résistance aux prompt-injections.

Opus 4.7 intègre les garde‑fous Project Glasswing : blocage en temps réel des usages cyber interdits/à haut risque. Score CyberGym volontairement stable. Comportement désaligné modestement amélioré par rapport à 4.6. Carte système complète disponible sur le site d’Anthropic.

Tarification, efficacité des tokens & économies CometAPI

La tarification officielle est identique, mais le coût effectif par tâche baisse parce que 4.7 en effort faible ≈ la qualité de 4.6 en effort moyen, et les taux de réussite plus élevés signifient moins de reprises. Le nouveau tokenizer augmente les tokens d’entrée de 0–35% pour un texte identique, mais l’usage net est souvent favorable à qualité équivalente.

Avantage CometAPI : Accédez aux deux modèles à $4 input / $20 output par million de tokens — 20% moins cher qu’officiel — plus un basculement fluide entre 500+ modèles (GPT-5.4, Gemini 3.1, etc.) via un endpoint OpenAI-compatible ou Anthropic Messages unique. Aucune interruption si les fournisseurs changent les prix. Les tests Playground et la facturation unifiée rendent la migration sans effort.

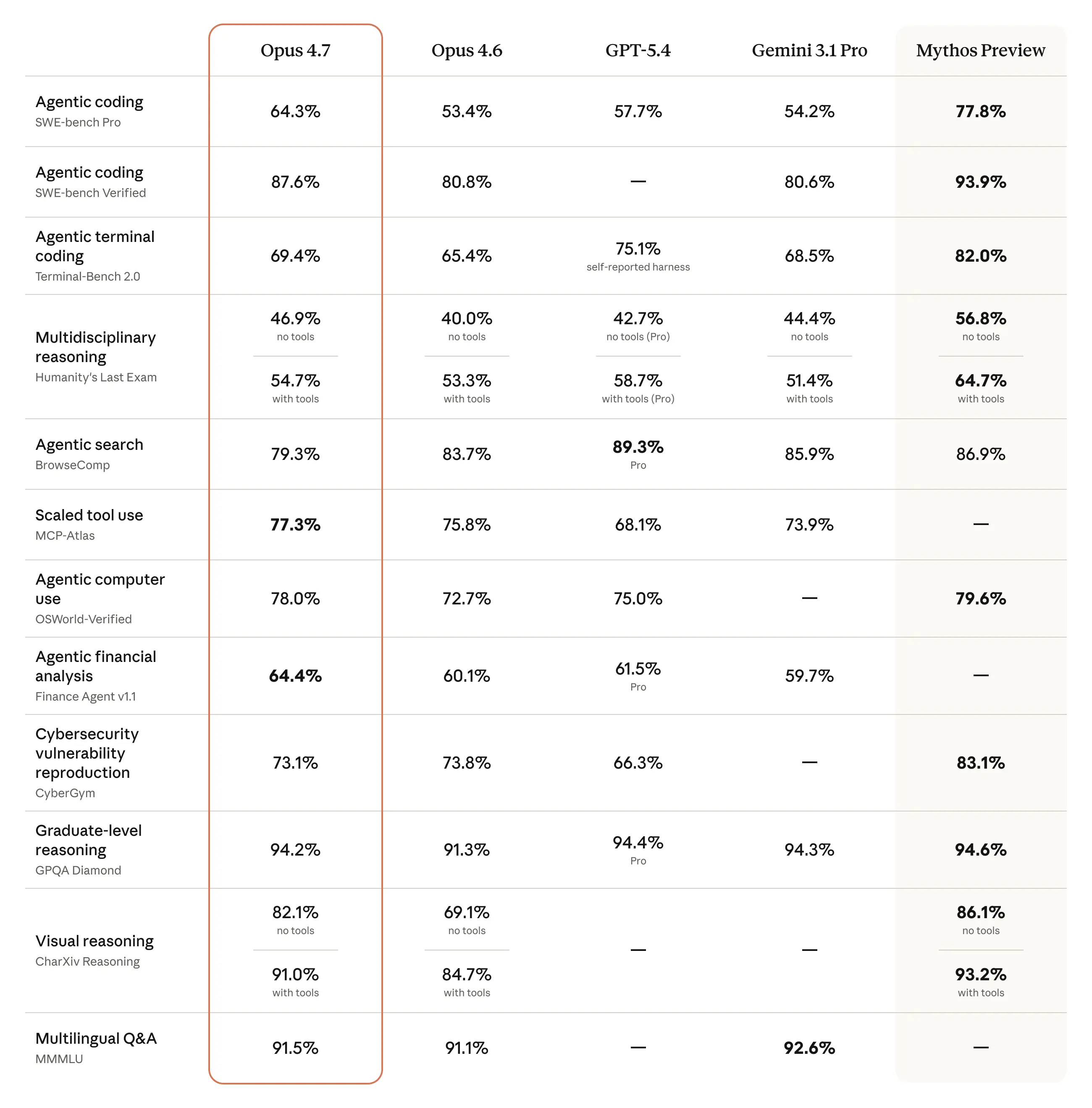

Analyse approfondie des benchmarks côte à côte

Voici l’ensemble des 14 benchmarks face-à-face issu des données de lancement d’Anthropic (vérifié par des partenaires) :

Benchmarks de codage

- SWE-bench Verified : 80.8% → 87.6% (+6.8 pp)

- SWE-bench Pro : 53.4% → 64.3% (+10.9 pp)

- Terminal-Bench 2.0 : 65.4% → 69.4% (+4.0 pp)

Agentique & utilisation d’outils

- MCP-Atlas : 62.7% → 77.3% (+14.6 pp) — plus grand saut unique

- OSWorld-Verified : 72.7% → 78.0% (+5.3 pp)

- Finance Agent : 60.7% → 64.4% (+3.7 pp)

Raisonnement & connaissance

- GPQA Diamond : 91.3% → 94.2% (+2.9 pp)

- HLE (sans outils) : 40.0% → 46.9% (+6.9 pp)

- MMMLU : 91.1% → 91.5% (+0.4 pp)

Vision

- CharXiv-R (sans outils) : 68.7% → 82.1% (+13.4 pp)

- CharXiv-R (outils) : 77.4% → 91.0% (+13.6 pp)

Régressions (transparentes)

- BrowseComp : 84.0% → 79.3% (–4.7 pp) — sensible au harness

- CyberGym : 73.8% → 73.1% (–0.7 pp) — intentionnel pour la sécurité

Benchmark interne Research-Agent : 0.715 global (score top à égalité), avec le module Finance passant de 0.767 à 0.813.

Performances réelles & cas d’usage

Les tests de workflows agentiques de Box ont montré qu’Opus 4.7 terminait des tâches avec 7.1 appels LLM vs 16.3 pour 4.6 (2,3× moins) et 30% d’utilisation d’unités IA en moins. La latence médiane a chuté de 242 s à 183 s.

Des partenaires entreprise (Harvey, Databricks, Hebbia, Ramp, Genspark) rapportent :

- 21% d’erreurs en moins dans le raisonnement documentaire.

- Meilleure coordination multi-agent sur des heures.

- Intégration plus serrée des présentations, feuilles de calcul et code.

Qui doit mettre à niveau immédiatement ?

- Équipes d’ingénierie logicielle utilisant Cursor/Claude Code.

- Constructeurs d’agents IA ayant besoin d’une autonomie fiable sur long horizon.

- Workflows riches en vision (captures d’écran, diagrammes, revue UI).

- Automatisation finance, juridique et travail de connaissance.

Changements d’API, guide de migration & exemples de code

Breaking Changes (Messages API)

- Extended thinking budgets removed → use

thinking: {"type": "adaptive"}. - Sampling params (

temperature, etc.) no longer accepted → use prompting. - Thinking content omitted by default.

- New tokenizer requires headroom in

max_tokens.

Guide de migration + exemples de code (CometAPI)

Step 1: Update model name to claude-opus-4-7 (or CometAPI alias).

Step 2: Audit prompts for literal interpretation.

Step 3: Test effort levels (start with xhigh for coding).

Step 4: Use task budgets to cap spend.

Voici un exemple Python prêt à l’emploi utilisant l’endpoint compatible Anthropic de CometAPI (fonctionne aussi avec le SDK officiel) :

(Python)

import anthropic

import os

client = anthropic.Anthropic(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI sk- key

base_url="https://www.cometapi.com/console/" # CometAPI base

)

message = client.messages.create(

model="claude-opus-4-7", # or "claude-opus-4-6" for comparison

max_tokens=4096,

temperature=0.7,

effort="xhigh", # New level for deep reasoning

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Refactor this legacy Python module into clean, type-hinted, testable code. Follow instructions literally: use Pydantic v2, add comprehensive tests, no external deps beyond stdlib + pydantic. Verify your changes before responding."},

{"type": "image", "source": {"type": "base64", "media_type": "image/png", "data": "iVBORw0KGgoAAAANSUhEUg..."} } # High-res screenshot support

]

}

]

)

print(message.content[0].text)

Self-verification demo prompt (works far better on 4.7):

(texte) :

Plan → Execute → Verify → Report:

1. Analyze the attached codebase.

2. Propose refactors.

3. Implement changes in a new file.

4. Run mental unit tests and edge cases.

5. Only output final verified code if all checks pass.

Lancez des tests A/B sur vos propres workloads — la plupart des équipes voient 20–40% d’itérations en moins.

Remarque :

Premièrement, le nouveau tokenizer génère plus de tokens à partir du même texte. Opus 4.7 a introduit un nouveau tokenizer, améliorant la façon dont le modèle traite le texte. Le compromis est que la même entrée se mappe sur plus de tokens ; le nombre exact dépend du type de contenu, mais se situe approximativement entre 1.0 et 1.35 fois.

Deuxièmement, des niveaux d’effort plus élevés permettent une considération plus exhaustive, en particulier dans des scénarios agentiques multi‑tours.

Cela conduit à une meilleure fiabilité, mais aussi à plus de tokens de sortie.

La solution officielle propose trois approches :

- Adjusting the effort level using the

efficiencyparameter - Limiting the budget using task budgets

- Telling the model to "be more concise" in the prompt.

Limitations connues et notes de migration

- Extended thinking budgets removed → use

thinking: {"type": "adaptive"}.thinking: {type: "enabled", budget_tokens: N}is no longer supported; use adaptive thinking instead. - Sampling params (

temperature, etc.) no longer accepted → use prompting.temperature,top_p, andtop_kshould be removed from requests when migrating to Opus 4.7. - The model is described as more literal and more direct than Opus 4.6, which is useful for precision but may require sharper prompts.

- New tokenizer requires headroom in

max_tokens. Anthropic recommends re-checkingmax_tokensheadroom because Opus 4.7 can produce higher token counts for the same text. - Thinking content omitted by default.

Verdict final & recommandation

Claude Opus 4.7 est le grand gagnant pour tout workload sérieux de codage, agentique ou vision en 2026. Les gains ne sont pas incrémentaux — ils transforment la production. Si vous êtes sur Opus 4.6, migrez cette semaine. La combinaison de qualité supérieure, de moins d’appels et d’une tarification identique (ou inférieure via CometAPI) en fait une évidence.

Actions à entreprendre :

- Testez 4.7 sur le playground de CometAPI avec vos workloads réels.

- Mettez à jour un service d’abord (Cursor ou votre framework d’agent).

- Surveillez l’usage de tokens la première semaine.

- Évoluez en toute confiance sachant que vous avez un accès unifié et moins cher à plus de 500 modèles.