DeepSeek telah resmi memperkenalkan pratayang V4 sebagai keluarga model open-source, dan tajuknya bukan sekadar “pembaruan model lainnya.” Perusahaan memosisikan V4 sebagai sistem berkonteks panjang yang ramah agen, dibangun untuk beban kerja nyata: analisis yang berat dokumen, asisten pengodean, agen pencarian, dan otomasi multi-langkah. Rilisnya sudah tersedia di web, aplikasi, dan API, dan lini V4 menghadirkan jendela konteks 1M token yang hemat biaya di seluruh layanan resminya.

Yang membuat peluncuran ini sangat patut diperhatikan adalah kombinasi skala dan efisiensi. DeepSeek menyebut V4-Pro memiliki 1,6T total parameter dengan 49B aktif, sedangkan V4-Flash memiliki 284B total parameter dengan 13B aktif. Dalam laporan teknis, DeepSeek juga menyatakan arsitektur V4 menggunakan hybrid attention, MoE routing, dan pascapelatihan yang dirancang untuk meningkatkan perilaku agen sembari memangkas beban komputasi untuk konteks ultra-panjang.

Apa itu DeepSeek V4?

DeepSeek-V4 adalah keluarga flagship pratayang terbaru perusahaan, dan rilisnya mencakup dua varian publik: V4-Pro dan V4-Flash. DeepSeek menggambarkan V4-Pro sebagai model yang lebih kuat untuk pengetahuan dunia, matematika, STEM, pengodean, dan pengodean berbasis agen, sedangkan V4-Flash adalah opsi yang lebih responsif dan hemat biaya yang tetap mempertahankan banyak kualitas penalaran dan kemampuan konteks panjang. V4-Pro memimpin model open-source saat ini dalam pengodean berbasis agen dan pengetahuan dunia, sementara V4-Flash dirancang untuk kecepatan dan penerapan yang ekonomis.

V4 menggunakan arsitektur attention hibrida yang mengombinasikan Compressed Sparse Attention (CSA) dan Heavily Compressed Attention (HCA), plus Manifold-Constrained Hyper-Connections dan Muon optimizer. Perusahaan juga mengatakan model-model tersebut diprapelajari pada lebih dari 32T token dan bahwa, pada konteks 1M, V4-Pro hanya memerlukan 27% FLOPs inferensi per token tunggal dan 10% cache KV dibandingkan DeepSeek-V3.2. Cerita efisiensi inilah yang menjadi tajuk utama di balik rilis ini.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro adalah model flagship bagi pengguna yang paling mengutamakan kualitas. DeepSeek-V4-Pro menghadirkan kinerja pengodean berbasis agen yang lebih kuat, pengetahuan dunia yang lebih kaya, dan penalaran kelas dunia, serta memimpin model open-source saat ini sambil hanya berada di belakang Gemini-3.1-Pro dalam pengetahuan dunia menurut halaman peluncuran. Dalam laporan teknis, V4-Pro adalah model yang lebih besar dalam keluarga, dan DeepSeek-V4-Pro tersedia melalui antarmuka yang kompatibel dengan OpenAI dan Anthropic yang sama seperti V4-Flash.

DeepSeek-V4-Flash

V4-Flash adalah model yang mengutamakan efisiensi; kemampuan penalarannya mendekati V4-Pro, dan ia berkinerja setara dengan V4-Pro pada tugas agen sederhana, sambil menggunakan jejak parameter yang lebih kecil dan waktu respons yang lebih cepat. Model ini mendukung mode thinking dan non-thinking, dengan panjang konteks 1M yang sama dan fitur inti yang sama seperti Pro, tetapi dengan biaya jauh lebih rendah.

Mana yang harus Anda pilih?

Gunakan V4-Pro ketika tugas berisiko tinggi, sarat pengetahuan, atau sulit diverifikasi: riset tingkat perusahaan, pengodean kompleks, dukungan keputusan multi-langkah, atau tugas di mana Anda menginginkan jawaban sekuat mungkin. Gunakan V4-Flash ketika throughput, latensi, atau biaya token lebih penting daripada mengejar beberapa poin terakhir pada tolok ukur. Pilihan itu konsisten dengan penempatan resmi dan celah tolok ukur yang dilaporkan antara kedua model.

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | Non-think + think | Non-think + think |

| Best fit | Inferensi cepat, aplikasi throughput tinggi, agen sensitif biaya | Penalaran berkemampuan tertinggi, tugas coding dan pengetahuan yang lebih sulit |

| Official API pricing | Cache hit $0.028 / cache miss $0.14 / output $0.28 per 1M tokens | Cache hit $0.145 / cache miss $1.74 / output $3.48 per 1M tokens |

| Max output | 384K | 384K |

CometAPI menyediakan akses ke Deepseek v4 Pro dan V4 Flash,—20% lebih murah daripada resmi—serta peralihan mulus di antara 500+ model (GPT-5.4, Gemini 3.1, dll.) melalui satu endpoint OpenAI-compatible atau Anthropic Messages.

Tolok ukur kinerja

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

Pada tabel perbandingan model dasar, V4-Flash dan V4-Pro sama-sama melampaui DeepSeek-V3.2 di tolok ukur inti, dengan V4-Pro biasanya memimpin. Misalnya, laporan mencantumkan skor berikut: AGIEval 82.6 / 83.1 vs 80.1 milik V3.2; MMLU 88.7 / 90.1 vs 87.8; MMLU-Pro 68.3 / 73.5 vs 65.5; HumanEval 69.5 / 76.8 vs 62.8; dan LongBench-V2 44.7 / 51.5 vs 40.2 untuk V3.2, di mana angka tengah adalah V4-Flash dan yang terakhir adalah V4-Pro.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Sumber: Laporan teknis DeepSeek-V4, Tabel 1.

Polanya sederhana: Flash memperkecil jarak ke Pro, tetapi Pro tetap model umum yang lebih kuat. Itu membuat V4-Flash menjadi default yang praktis untuk banyak sistem produksi, sementara V4-Pro adalah model yang dipilih ketika kualitas jawaban lebih penting daripada biaya atau latensi.

Perbandingan dengan model Barat: posisi V4

Dalam satu evaluasi manusia pada tugas kantor berbahasa Mandarin, laporan menyebut DeepSeek-V4-Pro-Max melampaui Claude Opus 4.6-Max, dengan rasio non-kekalahan 63%. DeepSeek-V4-Pro “secara signifikan melampaui” Claude Sonnet 4.5 dan mendekati Claude Opus 4.5 pada tolok ukur pengodean R&D.

| Area evaluasi | Hasil DeepSeek | Perbandingan model Barat | Apa yang disarankan |

|---|---|---|---|

| Tugas kantor berbahasa Mandarin | V4-Pro-Max, 63% non-loss rate | vs Claude Opus 4.6-Max | Tampil kuat pada tugas bergaya bisnis yang praktis |

| Tolok ukur pengodean R&D | V4-Pro-Max pass rate 67 | vs Claude Sonnet 4.5 pada 47; Opus 4.5 pada 70; Opus 4.6 Thinking pada 80 | Kompetitif dengan model frontier terdepan, terutama melawan sistem setara Sonnet |

Ini bukan “nomor satu dalam setiap aspek,” tetapi sudah berada pada level yang “harus dievaluasi secara serius.”

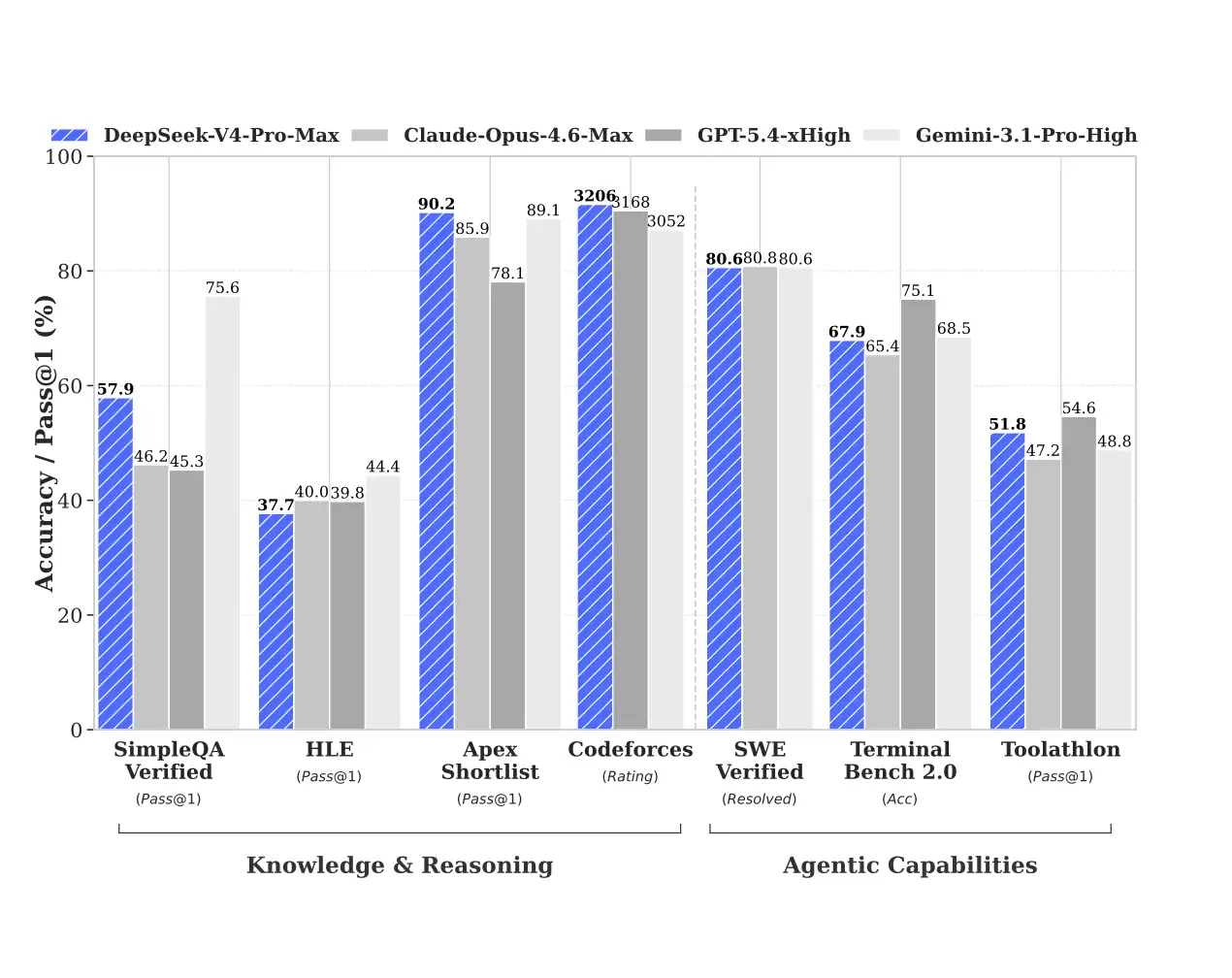

Laporan teknis DeepSeek membandingkan V4-Pro-Max dengan Claude Opus 4.6 Max, GPT-5.4 xHigh, dan Gemini 3.1 Pro High dalam tabel yang sama. Hasilnya tidak simplistis: model Barat tertutup masih berkinerja kuat pada beberapa aspek pengetahuan dan inferensi; namun, V4-Pro-Max sangat kuat dalam kode, konteks panjang, dan beberapa tugas agen. Dengan kata lain, ini bukan lagi narasi berdimensi rendah “alternatif domestik,” melainkan telah memasuki tahap “mana yang lebih cocok untuk skenario Anda.”

Dalam hal kemampuan pengetahuan dan penalaran, model ini seimbang dengan Opus 4.6 Max, GPT-5.4 xHigh, dan Gemini 3.1 ProHigh. Namun, sedikit tertinggal dalam kemampuan agen, meski perbedaannya tidak signifikan.

DeepSeek-V4-Pro-Max sangat kompetitif dalam skenario berorientasi kode dan konteks panjang, sementara model Barat masih tampak sangat kuat pada beberapa tolok ukur penalaran murni dan pengetahuan. Itulah cara membaca rilis ini: DeepSeek V4 berada kokoh dalam percakapan frontier, tetapi kepemimpinan tolok ukur tetap bergantung pada tugas.

Cara mengakses DeepSeek V4

1) Gunakan web dan aplikasi resmi

DeepSeek mengatakan V4 Preview tersedia saat ini di web, aplikasi, dan API. Untuk pengguna biasa, jalur termudah tetap antarmuka chat resmi, di mana model dapat diakses melalui Expert Mode atau Instant Mode.

2) Gunakan API

Saya sangat merekomendasikan CometAPI untuk mengakses deepseek V4, karena menawarkan harga terbaik dan keunggulan agregasi.

Nama modelnya adalah:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek juga mengatakan nama lama

deepseek-chatdandeepseek-reasonerakan dihentikan dan saat ini memetakan ke mode non-thinking dan thinking dari V4-Flash hingga 2026-07-24. Itu penting untuk perencanaan migrasi jika Anda sudah memiliki integrasi lama di produksi.

- Daftar di CometAPI dan dapatkan kunci API Anda.

- Gunakan OpenAI Python SDK standar (atau klien kompatibel apa pun) dengan base URL kustom:

Berikut contoh bersih menggunakan format yang kompatibel dengan OpenAI resmi:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "Anda adalah asisten yang membantu."},

{"role": "user", "content": "Ringkas manfaat dari konteks sejuta token."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Pola permintaan itu mengikuti panduan quick start: setel base URL, pilih deepseek-v4-pro atau deepseek-v4-flash, dan aktifkan thinking saat Anda memerlukan penalaran yang lebih dalam.

Cara menggunakan DeepSeek V4 secara efektif

Untuk alur kerja dokumen panjang, pola terkuat adalah menjaga konteks tetap bersih dan terstruktur. Jendela 1M token V4 adalah keunggulan utama, tetapi model tetap berkinerja terbaik ketika input diorganisasi ke dalam bagian-bagian, kutipan sumber, instruksi tugas, dan batasan output yang eksplisit. Itulah cara paling alami untuk memanfaatkan kemampuan konteks panjang yang diiklankan DeepSeek.

Untuk alur kerja kode dan agen, mulailah dengan V4-Flash untuk iterasi cepat, lalu naikkan ke V4-Pro untuk run final atau langkah yang paling sulit. Pendekatan itu sesuai dengan penempatan resmi: Flash adalah opsi efisien, Pro adalah model yang lebih kuat, dan keduanya berbagi permukaan API dan panjang konteks yang sama.

Penutup

DeepSeek-V4 menonjol karena menggabungkan empat hal yang diminta pasar secara bersamaan: konteks panjang, penalaran kuat, ketersediaan terbuka, dan harga agresif. Cerita sebenarnya bukan sekadar DeepSeek merilis model lain. Ini tentang upaya perusahaan menjadikan AI kelas frontier secara ekonomis dapat digunakan di produksi. Bagi tim yang mengevaluasi ke mana menaruh taruhan AI berikutnya, itu adalah sinyal yang layak diuji, bukan diabaikan.

Bagi tim yang membangun di berbagai penyedia, ini adalah jenis rilis yang layak dibenchmark di dalam stack Anda sendiri. CometAPI dapat menjadi lapisan praktis untuk membandingkan DeepSeek-V4 berdampingan dengan model frontier lain tanpa memaksa tim produk Anda membangun ulang integrasi setiap kali pasar bergeser.