Google DeepMind secara resmi merilis Gemma 4 pada 2 April 2026, menandai tonggak besar dalam AI open-source. Keluarga model ini menghadirkan kecerdasan tingkat terdepan per parameter, dibangun dari riset dan teknologi yang sama yang mendasari Gemini 3. Berbeda dengan versi Gemma sebelumnya yang berlisensi kustom, Gemma 4 dirilis di bawah lisensi Apache 2.0 yang sepenuhnya permisif, memungkinkan penggunaan, modifikasi, dan redistribusi komersial tanpa batasan.

Gemma 4 menonjol dengan kapabilitas multimodal (masukan teks + gambar di semua ukuran, plus audio pada model edge), dukungan native untuk penalaran lanjutan dan alur kerja agen, jendela konteks panjang hingga 256K token, serta optimisasi untuk segala hal mulai dari smartphone dan Raspberry Pi hingga GPU kelas atas. Model ini mendukung lebih dari 140 bahasa dan menekankan efisiensi, sehingga AI bertenaga tinggi dapat diakses di perangkat konsumen dan edge tanpa ketergantungan pada cloud.

CometAPI menyediakan API model open-source dan closed-source yang sangat baik.

Apa itu Gemma 4?

Gemma 4 adalah keluarga terbaru model bahasa besar (LLM) multimodal terbuka dari Google DeepMind, yang dibangun khusus untuk penalaran lanjutan, alur kerja AI berbasis agen, dan penyebaran efisien di perangkat. Model ini memaksimalkan “kecerdasan-per-parameter” dengan memanfaatkan wawasan dari riset proprietary Gemini 3 sekaligus tetap sepenuhnya open-weight dan open-source.

Peningkatan utama dibanding model Gemma sebelumnya meliputi:

- Multimodal native: Pemahaman teks + gambar (semua model), dengan dukungan audio pada varian edge yang lebih kecil.

- Mode berpikir yang dapat dikonfigurasi: Penalaran langkah demi langkah dengan keluaran <|think|> terstruktur.

- Pemanggilan fungsi dan penggunaan alat native: Ideal untuk agen otonom.

- Konteks diperpanjang: Hingga 256K token pada model yang lebih besar.

- Arsitektur atensi hibrida: Menggabungkan jendela geser lokal dan atensi global untuk efisiensi dan kinerja konteks panjang.

- Embedding Per-Lapisan (PLE) pada model lebih kecil dan cache KV bersama untuk penghematan memori.

- Dukungan multibahasa luas: Pra-latih pada data yang mencakup 140+ bahasa dengan kesadaran nuansa budaya.

Dirilis di bawah Apache 2.0, Gemma 4 menghapus pembatasan lisensi sebelumnya yang membatasi adopsi perusahaan. Pengembang kini dapat fine-tune, menerapkan, dan melakukan komersialisasi tanpa hambatan—menjadikannya pesaing langsung bagi ekosistem sepenuhnya terbuka seperti Llama dan Qwen.

Gemma 4 menargetkan beragam perangkat keras: perangkat edge (ponsel, IoT, Raspberry Pi, Jetson Nano) untuk AI offline latensi rendah, serta workstation/GPU untuk server lokal berkinerja tinggi. Desain “local-first” ini memprioritaskan privasi, penghematan biaya, dan inferensi tanpa latensi.

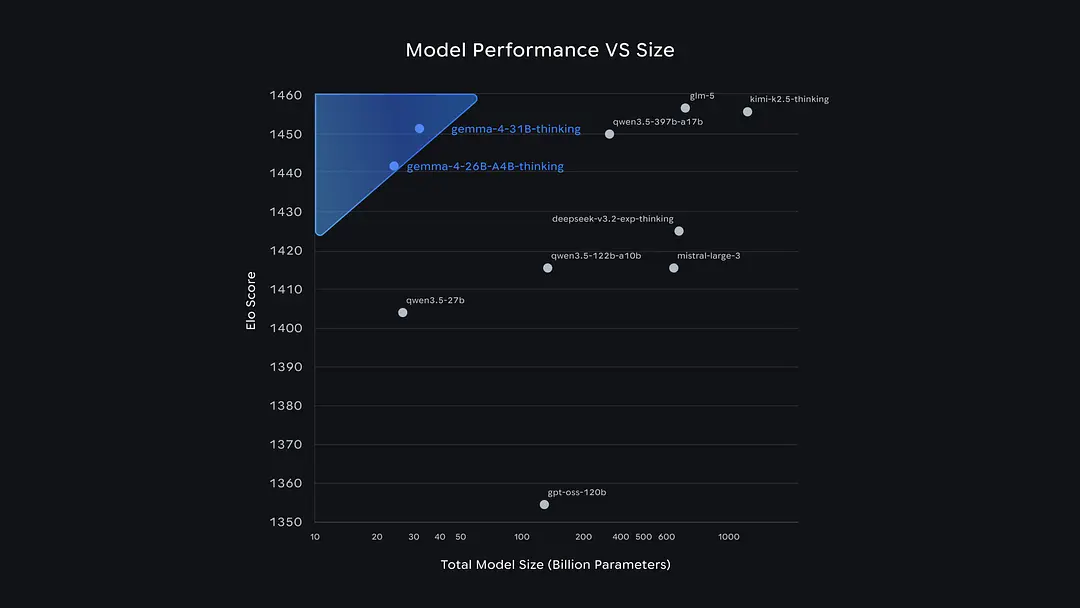

Model open-source yang berada di atasnya pada leaderboard Arena sebagian besar berasal dari tim Tiongkok. Gemma 4 tidak jauh berbeda dari Qwen 3.5 dan GLM-5, tetapi berbeda secara signifikan dari GPT-OSS-120B milik OpenAI.

Pengembang kini dapat menemukan GLM-5, Qwen 3.5, dan lainnya di CometAPI.

Empat Versi Gemma 4

Google merilis Gemma 4 dalam empat ukuran yang dioptimalkan dengan cermat, masing-masing menyeimbangkan kinerja, efisiensi, dan skenario penerapan. Dua di antaranya menggunakan arsitektur padat (dense) dengan Embedding Per-Lapisan (PLE) inovatif untuk efisiensi di edge; satu adalah Mixture-of-Experts (MoE) untuk kinerja tinggi dengan biaya parameter aktif rendah; dan satu adalah model padat andalan.

| Model | Architecture | Total Params | Active Params (MoE) | Effective Params | Context Length | Modalities | Target Hardware |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Padat + PLE | ~5.1B (termasuk embedding) | N/A | 2.3B | 128K | Teks, Gambar, Audio | Smartphone, Raspberry Pi, IoT edge |

| Gemma 4 E4B | Padat + PLE | ~8B (termasuk embedding) | N/A | 4.5B | 128K | Teks, Gambar, Audio | Perangkat mobile, GPU ringan, Jetson |

| Gemma 4 26B A4B | MoE (8 aktif / 128 total + 1 bersama) | 25.2B | 3.8B–4B | N/A | 256K | Teks, Gambar | Workstation, GPU konsumen, server lokal |

| Gemma 4 31B | Padat | 30.7B | N/A | N/A | 256K | Teks, Gambar | GPU kelas atas (muat pada satu H100/A100 dalam FP16) |

Gemma 4 E2B dan E4B (dioptimalkan untuk edge): Menggunakan PLE untuk menambah spesialisasi per lapisan dengan overhead parameter minimal. Ideal untuk perangkat bertenaga baterai atau dengan memori terbatas. Encoder audio (Conformer bergaya USM, ~300M parameter) memungkinkan pengenalan ucapan-ke-teks dan penerjemahan.

Gemma 4 26B A4B (MoE): Mengaktifkan hanya ~4B parameter saat inferensi meski ukuran total 25B+. Menghadirkan kinerja mendekati 31B dengan biaya komputasi yang jauh lebih rendah—sempurna untuk penskalaan hemat biaya.

Gemma 4 31B (Padat): Andalan untuk kapabilitas maksimum. Muat pada satu GPU 80GB dalam presisi penuh dan berada di antara model terbuka papan atas pada leaderboard.

Semua model menyertakan varian instruction-tuned (“-it”) yang dioptimalkan untuk chat, penalaran, dan penggunaan alat, serta versi dasar pra-latih untuk fine-tuning. Dua model besar mengambil pendekatan berbeda: model 31B Padat mengejar kualitas tertinggi dan menjadi fondasi terbaik untuk fine-tuning; model 26B MoE memprioritaskan kecepatan, mengaktifkan hanya 3,8 miliar parameter saat inferensi, menghasilkan kecepatan generasi kata yang jauh lebih cepat, namun dengan kualitas keseluruhan sedikit lebih rendah.

Dua model lebih kecil, E2B dan E4B, dirancang khusus untuk ponsel dan perangkat IoT: keduanya dapat berjalan sepenuhnya offline, menghemat memori dan daya. Selain itu, model kecil ini memiliki kemampuan yang tidak dimiliki model besar: masukan audio native, yang memungkinkan pengenalan ucapan langsung.

Kapabilitas Inti Gemma 4

Gemma 4 unggul pada area yang paling penting bagi aplikasi AI dunia nyata:

1. Penalaran Lanjutan & Mode Berpikir

Penalaran bertahap yang dapat dikonfigurasi melalui prompt sistem atau enable_thinking=True. Menghasilkan tag <|think|> terstruktur diikuti jawaban akhir. Secara drastis meningkatkan kinerja pada tugas kompleks tanpa fine-tuning tambahan.

2. Pemahaman Multimodal

- Visi: Deteksi objek (kotak pembatas JSON), OCR (multibahasa), pemrosesan dokumen/PDF, pemahaman bagan, pemahaman UI, pengenalan tulisan tangan, dan penanganan gambar beresolusi variabel (anggaran token: 70–1120 token).

- Video: Hingga 60 detik (pemrosesan 1 fps).

- Audio (hanya E2B/E4B): Pengenalan ucapan otomatis (ASR) dan terjemahan ucapan-ke-teks (maks 30 detik).

- Input terselang: Menggabungkan teks, gambar, dan audio dalam urutan apa pun.

3. Alur Kerja Agen & Pemanggilan Fungsi

Dukungan native untuk penggunaan alat memungkinkan agen otonom melakukan perencanaan multi-langkah, pemanggilan API, navigasi aplikasi, dan penyelesaian tugas. Kuat pada τ2-bench (penggunaan alat agentik).

4. Pengodean & Alat Pengembang

Generasi kode, pelengkapan, debugging, dan pemahaman tingkat repositori yang unggul. Mendukung keluaran terstruktur JSON untuk integrasi mulus. Skor 80,0% (31B) pada LiveCodeBench v6, menempatkannya sebagai asisten pemrograman berorientasi lokal yang cocok untuk skenario pengembangan offline.

5. Konteks Panjang & Multibahasa

Menangani 128K–256K token secara andal (teruji pada MRCR needle-in-haystack). Pra-latih pada data beragam hingga cutoff Januari 2025, dengan performa lintas bahasa yang kuat. Ini bukan sekadar penerjemahan multibahasa; melainkan dilatih secara native dan mencakup lebih dari 140 bahasa.

Data Benchmark: Rincian Kinerja Gemma 4

Gemma 4 menetapkan standar baru untuk model terbuka. Varian 31B dan 26B menghadirkan skor yang dulu hanya dicapai sistem proprietary yang jauh lebih besar, sementara model edge melampaui pendahulunya, Gemma 3 yang lebih besar.

Hasil Benchmark Lengkap (Model Disetel-Instruksi)

| Benchmark | Category | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (tanpa think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Penalaran & Pengetahuan | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (tanpa alat) | Matematika | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Sains tingkat pascasarjana | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (rata-rata) | Penggunaan Alat Agentik | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Pengodean | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Pengodean Kompetitif | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Penalaran Multimodal | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Matematika + Visi | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Konteks Panjang | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Wawasan Kunci:

- Lompatan besar dari Gemma 3: Model 31B meningkatkan matematika AIME dari 20,8% menjadi 89,2% dan LiveCodeBench dari 29,1% menjadi 80,0%.

- Efisiensi MoE: 26B A4B hampir menyamai 31B sambil menggunakan komputasi jauh lebih sedikit saat inferensi.

- Dominasi edge: E4B dan E2B melampaui Gemma 3 27B pada banyak metrik meski berukuran 6–10x lebih kecil.

- Peringkat leaderboard: 31B meraih ~1452 pada Arena AI (teks); 26B A4B ~1441. Varian 26B dilaporkan melampaui model jauh lebih besar seperti Qwen 3.5 397B dalam preferensi pengguna dan pengodean.

Benchmark visi dan audio mengonfirmasi kinerja multimodal yang kuat sejak awal tanpa fine-tuning khusus.

Ekosistem dan Dukungan Alat

Gemma 4 menikmati integrasi ekosistem yang luas dan segera:

- Hugging Face: Dukungan hari pertama dengan

transformers,pipeline("any-to-any"), GGUF, ONNX, dan prosesor multimodal. - Local Runtimes: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon dengan TurboQuant), Mistral.rs (Rust), Transformers.js (inferensi browser WebGPU).

- Fine-Tuning: TRL, Unsloth, PEFT, Vertex AI, dan dukungan dataset multimodal penuh.

- Optimisasi Perangkat Keras: NVIDIA RTX/DGX Spark/Jetson (via TensorRT-LLM), Google AI Edge tools, serta penerapan on-device Android/iOS.

- Kerangka Agen: OpenClaw, Hermes, Pi, dan pengujian simulasi CARLA.

- Cloud/Studio: Google AI Studio untuk uji cepat; Kaggle Models untuk unduhan.

Ekosistem ini membuat Gemma 4 dapat diterapkan dalam hitungan menit di laptop, server, atau perangkat edge.

Keterbatasan & Keamanan:

- Cutoff data pelatihan: Januari 2025 (tanpa pengetahuan real-time tanpa alat).

- Audio terbatas pada ucapan (bukan musik); video dibatasi hingga 60 detik.

- Risiko halusinasi tetap ada—gunakan mode berpikir dan verifikasi.

- Keamanan: Penyaringan dan evaluasi ketat sesuai Google AI Principles; pengembang harus menambahkan pengaman khusus aplikasi.

Mengapa Gemma 4 Penting pada 2026

Gemma 4 mendemokratisasi AI frontier. Dengan menggabungkan kecerdasan multimodal, kapabilitas agen, dan kebebasan Apache 2.0 dengan efisiensi yang agnostik terhadap perangkat keras, model ini memberdayakan pengembang dan perusahaan untuk membangun solusi AI yang aman, privat, dan hemat biaya dalam skala besar. Terobosan kecerdasan-per-parameter—terutama terlihat pada model edge yang melampaui model andalan terbuka kemarin—menandai pergeseran menuju AI yang benar-benar ubiquitous.

Baik menjalankan model 2B di ponsel maupun mesin 31B secara lokal, Gemma 4 membuktikan bahwa AI open-source telah menyamai (dan dalam banyak kasus melampaui) alternatif tertutup dalam kegunaan praktis.