Pada 2025–2026, lanskap perkakas AI terus terkonsolidasi: API gateway (seperti CometAPI) berkembang untuk menyediakan akses bergaya OpenAI ke ratusan model, sementara aplikasi LLM untuk pengguna akhir (seperti AnythingLLM) terus menyempurnakan penyedia “Generic OpenAI” agar aplikasi desktop dan local-first dapat memanggil endpoint yang kompatibel dengan OpenAI mana pun. Ini membuat alur untuk mengarahkan trafik AnythingLLM melalui CometAPI menjadi mudah saat ini dan memperoleh manfaat dari pilihan model, perutean biaya, dan penagihan terpadu — sambil tetap menggunakan UI lokal AnythingLLM serta fitur RAG/agen.

Apa itu AnythingLLM dan mengapa Anda ingin menghubungkannya ke CometAPI?

Apa itu AnythingLLM?

AnythingLLM adalah aplikasi AI serba-ada sumber terbuka dan klien lokal/cloud untuk membangun asisten chat, alur kerja retrieval-augmented generation (RAG), dan agen berbasis LLM. Ia menyediakan UI yang apik, API pengembang, fitur workspace/agen, serta dukungan untuk LLM lokal dan cloud — dirancang privat secara default dan dapat diperluas melalui plugin. AnythingLLM mengekspose penyedia Generic OpenAI yang memungkinkannya berkomunikasi dengan API LLM yang kompatibel dengan OpenAI.

Apa itu CometAPI?

CometAPI adalah platform agregasi API komersial yang mengekspose 500+ model AI melalui satu antarmuka REST ala OpenAI dan penagihan terpadu. Secara praktik, ini memungkinkan Anda memanggil model dari berbagai vendor (OpenAI, Anthropic, varian Google/Gemini, model gambar/audio, dll.) melalui endpoint yang sama https://api.cometapi.com/v1 dan satu kunci API (format sk-xxxxx). CometAPI mendukung endpoint standar ala OpenAI seperti /v1/chat/completions, /v1/embeddings, dan sebagainya, sehingga memudahkan adaptasi alat yang sudah mendukung API kompatibel OpenAI.

Mengapa mengintegrasikan AnythingLLM dengan CometAPI?

Tiga alasan praktis:

- Pilihan model & fleksibilitas vendor: AnythingLLM dapat menggunakan LLM “apa pun yang kompatibel dengan OpenAI” melalui wrapper Generic OpenAI. Mengarahkan wrapper tersebut ke CometAPI memberi akses instan ke ratusan model tanpa mengubah UI atau alur AnythingLLM.

- Optimisasi biaya/ops: Menggunakan CometAPI memungkinkan Anda mengganti model (atau menurunkan ke yang lebih murah) secara terpusat untuk kontrol biaya, dan menjaga penagihan terpadu alih-alih mengelola banyak kunci penyedia.

- Eksperimentasi lebih cepat: Anda dapat A/B berbagai model (mis.

gpt-4o,gpt-4.5, varian Claude, atau model multimodal open-source) melalui UI AnythingLLM yang sama — berguna untuk agen, respons RAG, rangkuman, dan tugas multimodal.

Lingkungan dan prasyarat yang perlu Anda siapkan sebelum integrasi

Persyaratan sistem & perangkat lunak (tingkat tinggi)

- Desktop atau server yang menjalankan AnythingLLM (Windows, macOS, Linux) — instalasi desktop atau instance self-hosted. Pastikan Anda menggunakan build terbaru yang menampilkan pengaturan LLM Preferences / AI Providers.

- Akun CometAPI dan kunci API (rahasia bergaya

sk-xxxxx). Anda akan menggunakannya di penyedia Generic OpenAI milik AnythingLLM. - Konektivitas jaringan dari mesin Anda ke

https://api.cometapi.com(tidak ada firewall yang memblokir HTTPS keluar). - Opsional namun direkomendasikan: lingkungan Python atau Node modern untuk pengujian (Python 3.10+ atau Node 18+), curl, dan klien HTTP (Postman / HTTPie) guna sanity-check CometAPI sebelum menghubungkannya ke AnythingLLM.

Kondisi khusus AnythingLLM

Penyedia LLM Generic OpenAI adalah rute yang direkomendasikan untuk endpoint yang meniru permukaan API OpenAI. Dokumentasi AnythingLLM memperingatkan bahwa penyedia ini berfokus pada pengembang dan Anda harus memahami input yang diberikan. Jika Anda menggunakan streaming atau endpoint Anda tidak mendukung streaming, AnythingLLM menyertakan pengaturan untuk menonaktifkan streaming untuk Generic OpenAI.

Daftar periksa keamanan & operasional

- Perlakukan kunci CometAPI seperti rahasia lainnya — jangan commit ke repo; simpan di keychain OS atau variabel lingkungan jika memungkinkan.

- Jika Anda berencana menggunakan dokumen sensitif dalam RAG, pastikan jaminan privasi endpoint memenuhi kebutuhan kepatuhan Anda (periksa dokumen/syarat CometAPI).

- Tentukan batas token maksimum dan jendela konteks untuk mencegah tagihan membengkak.

Bagaimana mengonfigurasi AnythingLLM untuk menggunakan CometAPI (langkah demi langkah)?

Di bawah ini urutan langkah konkret — diikuti variabel lingkungan dan snippet kode untuk menguji koneksi sebelum Anda menyimpan pengaturan di UI AnythingLLM.

Langkah 1 — Dapatkan kunci CometAPI Anda

- Daftar atau masuk ke CometAPI.

- Buka “API Keys” dan buat kunci — Anda akan menerima string yang terlihat seperti

sk-xxxxx. Jaga kerahasiaannya.

Langkah 2 — Verifikasi CometAPI berfungsi dengan permintaan cepat

Gunakan curl atau Python untuk memanggil endpoint chat completion sederhana guna mengonfirmasi konektivitas.

Contoh curl

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

Jika ini mengembalikan 200 dan respons JSON dengan array choices, kunci dan jaringan Anda berfungsi. (Dokumentasi CometAPI menunjukkan permukaan dan endpoint ala OpenAI).

Contoh Python (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

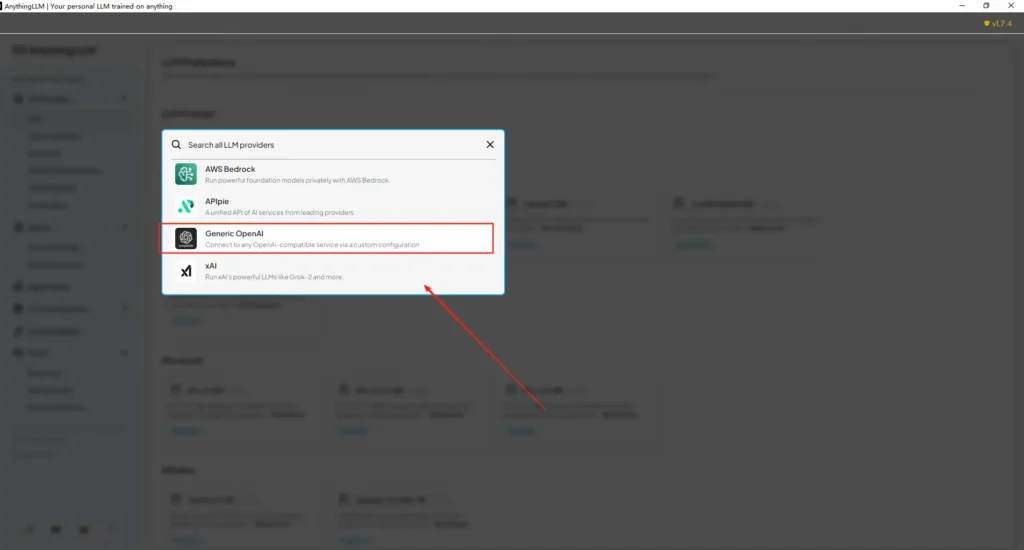

Langkah 3 — Konfigurasikan AnythingLLM (UI)

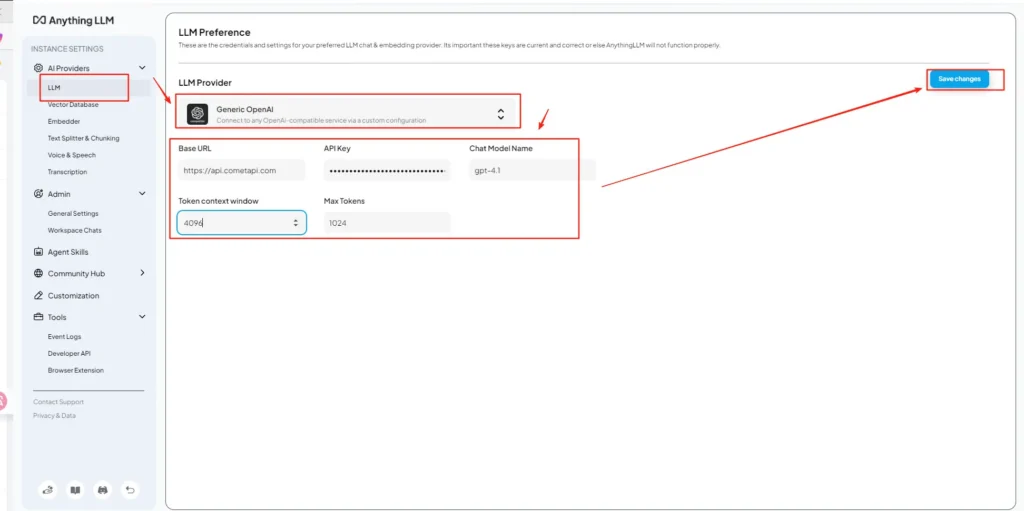

Buka AnythingLLM → Settings → AI Providers → LLM Preferences (atau jalur serupa di versi Anda). Gunakan penyedia Generic OpenAI dan isi kolom sebagai berikut:

API Configuration (example)

• Masuk menu pengaturan AnythingLLM, temukan LLM Preferences di bawah AI Providers.

• Pilih Generic OpenAI sebagai penyedia model, masukkanhttps://api.cometapi.com/v1di kolom URL.

• Tempelsk-xxxxxdari CometAPI di kotak input kunci API. Isi Token context window dan Max Tokens sesuai model yang digunakan. Anda juga dapat menyesuaikan nama model di halaman ini, misalnya menambahkan modelgpt-4o.

Ini selaras dengan panduan “Generic OpenAI” AnythingLLM (wrapper pengembang) dan pendekatan base URL kompatibel OpenAI milik CometAPI.

Langkah 4 — Atur nama model & batas token

Pada layar pengaturan yang sama, tambahkan atau sesuaikan nama model persis seperti yang dipublikasikan CometAPI (mis., gpt-4o, minimax-m2, kimi-k2-thinking) sehingga UI AnythingLLM dapat menampilkan model tersebut kepada pengguna. CometAPI memublikasikan string model untuk setiap vendor.

Langkah 5 — Uji di AnythingLLM

Mulai obrolan baru atau gunakan workspace yang ada, pilih penyedia Generic OpenAI (jika Anda memiliki beberapa penyedia), pilih salah satu nama model CometAPI yang Anda tambahkan, dan jalankan prompt sederhana. Jika Anda mendapatkan completion yang koheren, integrasi berhasil.

Bagaimana AnythingLLM menggunakan pengaturan tersebut secara internal

Wrapper Generic OpenAI milik AnythingLLM menyusun permintaan ala OpenAI (/v1/chat/completions, /v1/embeddings), jadi setelah Anda mengarahkan base URL dan memberikan kunci CometAPI, AnythingLLM akan meneruskan obrolan, panggilan agen, dan permintaan embedding melalui CometAPI secara transparan. Jika Anda menggunakan agen AnythingLLM (alur @agent), mereka akan mewarisi penyedia yang sama.

Apa praktik terbaik dan potensi jebakannya?

Praktik terbaik

- Gunakan pengaturan konteks yang sesuai model: Cocokkan Token Context Window dan Max Tokens di AnythingLLM dengan model yang Anda pilih di CometAPI. Ketidakcocokan dapat menyebabkan pemotongan tak terduga atau kegagalan panggilan.

- Amankan kunci API Anda: Simpan kunci CometAPI di variabel lingkungan dan/atau pengelola rahasia/Kubernetes; jangan pernah memasukkannya ke git. AnythingLLM akan menyimpan kunci di pengaturan lokal jika Anda memasukkannya melalui UI — perlakukan penyimpanan host sebagai sensitif.

- Mulai dengan model yang lebih murah/kecil untuk alur eksperimen: Gunakan CometAPI untuk mencoba model berbiaya rendah selama pengembangan, simpan model premium untuk produksi. CometAPI secara eksplisit menawarkan pengalihan biaya dan penagihan terpadu.

- Pantau penggunaan & atur peringatan: CometAPI menyediakan dasbor penggunaan — atur anggaran/peringatan untuk menghindari tagihan tak terduga.

- Uji agen dan tool secara terpisah: Agen AnythingLLM dapat memicu aksi; uji dengan prompt yang aman dan di instance staging terlebih dahulu.

Jebakan umum

- Konflik UI vs

.env: Saat self-hosting, pengaturan UI dapat menimpa perubahan.env(dan sebaliknya). Periksa/app/server/.envyang dihasilkan jika pengaturan berubah setelah restart. Isu komunitas melaporkan resetLLM_PROVIDER. - Ketidakcocokan nama model: Menggunakan nama model yang tidak tersedia di CometAPI akan menyebabkan 400/404 dari gateway. Selalu konfirmasi model yang tersedia pada daftar model CometAPI.

- Batas token & streaming: Jika Anda memerlukan respons streaming, pastikan model CometAPI mendukung streaming (dan versi UI AnythingLLM Anda mendukungnya). Beberapa penyedia berbeda dalam semantik streaming.

Kasus penggunaan dunia nyata apa yang dibuka oleh integrasi ini?

Retrieval-Augmented Generation (RAG)

Gunakan pemuat dokumen + basis data vektor AnythingLLM dengan LLM CometAPI untuk menghasilkan jawaban yang sadar konteks. Anda dapat bereksperimen dengan embedding murah + model chat mahal, atau menjaga semuanya di CometAPI demi penagihan terpadu. Alur RAG AnythingLLM adalah fitur bawaan utama.

Otomatisasi agen

AnythingLLM mendukung alur kerja @agent (menjelajah halaman, memanggil tool, menjalankan automasi). Mengarahkan panggilan LLM agen melalui CometAPI memberi Anda pilihan model untuk langkah kontrol/interpretasi tanpa mengubah kode agen.

Pengujian A/B multi-model dan optimisasi biaya

Ganti model per workspace atau fitur (mis., gpt-4o untuk jawaban produksi, gpt-4o-mini untuk dev). CometAPI memudahkan pertukaran model dan memusatkan biaya.

Pipeline multimodal

CometAPI menyediakan model gambar, audio, dan khusus. Dukungan multimodal AnythingLLM (melalui penyedia) ditambah model CometAPI memungkinkan alur pembuatan keterangan gambar, rangkuman multimodal, atau transkripsi audio melalui antarmuka yang sama.

Kesimpulan

CometAPI terus memosisikan diri sebagai gateway multi-model (500+ model, API ala OpenAI) — sehingga menjadi mitra alami bagi aplikasi seperti AnythingLLM yang sudah mendukung penyedia Generic OpenAI. Demikian pula, penyedia Generic AnythingLLM dan opsi konfigurasi terbaru memudahkan koneksi ke gateway semacam itu. Konvergensi ini menyederhanakan eksperimen dan migrasi produksi di akhir 2025.

Cara memulai dengan Comet API

CometAPI adalah platform API terpadu yang mengagregasi lebih dari 500 model AI dari penyedia terkemuka—seperti seri GPT dari OpenAI, Gemini dari Google, Claude dari Anthropic, Midjourney, Suno, dan lainnya—ke dalam satu antarmuka yang ramah pengembang. Dengan menawarkan autentikasi, pemformatan permintaan, dan penanganan respons yang konsisten, CometAPI secara drastis menyederhanakan integrasi kapabilitas AI ke aplikasi Anda. Baik Anda membangun chatbot, generator gambar, komposer musik, atau pipeline analitik berbasis data, CometAPI memungkinkan Anda beriterasi lebih cepat, mengendalikan biaya, dan tetap netral terhadap vendor—sembari memanfaatkan terobosan terbaru di ekosistem AI.

Untuk memulai, jelajahi kemampuan model dariCometAPI di Playground dan baca panduan API untuk instruksi terperinci. Sebelum mengakses, pastikan Anda telah masuk ke CometAPI dan memperoleh kunci API. CometAPI menawarkan harga yang jauh lebih rendah daripada harga resmi untuk membantu Anda berintegrasi.

Siap jalan?→ Sign up for CometAPI today !

Jika Anda ingin mengetahui lebih banyak tips, panduan, dan berita tentang AI, ikuti kami di VK, X dan Discord!