Membangun aplikasi AI tingkat produksi pada 2026 memerlukan lebih dari sekadar satu model; dibutuhkan strategi untuk orkestrasi model, pengelolaan biaya, dan fleksibilitas vendor. Dengan mengintegrasikan CometAPI dengan LangChain, pengembang dapat mengakses lebih dari 500 model terdepan—termasuk GPT 5.5, Claude Opus 4.7, dan DeepSeek V4 Pro—melalui satu gerbang yang kompatibel dengan OpenAI. Panduan ini menyediakan langkah demi langkah komprehensif bagi pengembang Python yang ingin membangun aplikasi LangChain yang dapat diskalakan dan memiliki ketersediaan tinggi sekaligus mengurangi pengeluaran API sebesar 20% hingga 40%.

LangChain: Kerangka Kerja yang Menggerakkan Aplikasi LLM

LangChain menyederhanakan pembuatan aplikasi dengan LLM melalui komponen seperti:

- Model Chat / LLM

- Templat Prompt

- Rantai & LCEL (LangChain Expression Language)

- Agen & Alat

- Memori & Retriever (RAG)

- Callback & Pelacakan

Ini mengabstraksikan perbedaan antarpemberi layanan, sehingga ideal untuk strategi multi-model—tepat di sinilah CometAPI unggul.

LangChain adalah kerangka kerja populer untuk membangun aplikasi bertenaga LLM. CometAPI sepenuhnya kompatibel dengan langchain-openai — cukup arahkan ke base URL kami.

Mengapa Menggunakan CometAPI dengan LangChain

CometAPI bertindak sebagai satu endpoint yang kompatibel dengan OpenAI yang mengumpulkan model-model terdepan (seri GPT-5, Claude Opus/Sonnet, Gemini, Grok, DeepSeek, Qwen, dan alat multimodal untuk gambar/video) dengan biaya 20-40% lebih rendah daripada penyedia langsung, tanpa biaya bulanan dan penagihan pay-as-you-go.

Stack AI modern bergerak menuju "Model Swarms" dan alur kerja agensik terspesialisasi di mana tugas yang berbeda diarahkan ke model yang paling efisien. Menggunakan CometAPI sebagai lapisan infrastruktur Anda dalam LangChain menawarkan tiga manfaat mendasar:

Ini menghilangkan beban operasional untuk mengelola puluhan SDK penyedia individual. Alih-alih memasang dan memelihara langchain-anthropic, langchain-google-genai, dan langchain-mistralai, Anda hanya memerlukan paket standar langchain-openai.

CometAPI memanfaatkan daya beli institusional untuk memberikan diskon permanen yang umumnya tidak tersedia bagi pengembang individual. Baik Anda memanggil model penalaran flagship maupun model efisiensi ber-throughput tinggi, biaya Anda diatur 20% hingga 40% di bawah harga ritel resmi. Ini memungkinkan tim memperpanjang runway operasional secara signifikan selama fase penskalaan.

CometAPI menyediakan lapisan keandalan penting. Agen LangChain dapat dikonfigurasi untuk beralih model secara instan jika penyedia utama mengalami gangguan, tanpa memerlukan refactor kode atau alur autentikasi baru. Setiap permintaan didukung oleh SLA Ketersediaan Layanan 99.9% dan perutean multi-region cerdas

Prasyarat

Sebelum memulai implementasi, pastikan lingkungan pengembangan Anda disiapkan dengan hal berikut:

- Python 3.8 atau lebih tinggi.

- Akun CometAPI aktif dengan kunci API yang valid (pengguna baru menerima kredit uji coba gratis saat mendaftar).

- Paket integrasi langchain-openai.

Pasang pustaka yang diperlukan menggunakan pip:

pip install langchain-openai langchain-community faiss-cpu

Bagaimana LangChain Terintegrasi dengan CometAPI: Metode Inti

Ada dua metode utama untuk mengonfigurasi integrasi CometAPI LangChain, bergantung pada strategi deployment Anda.

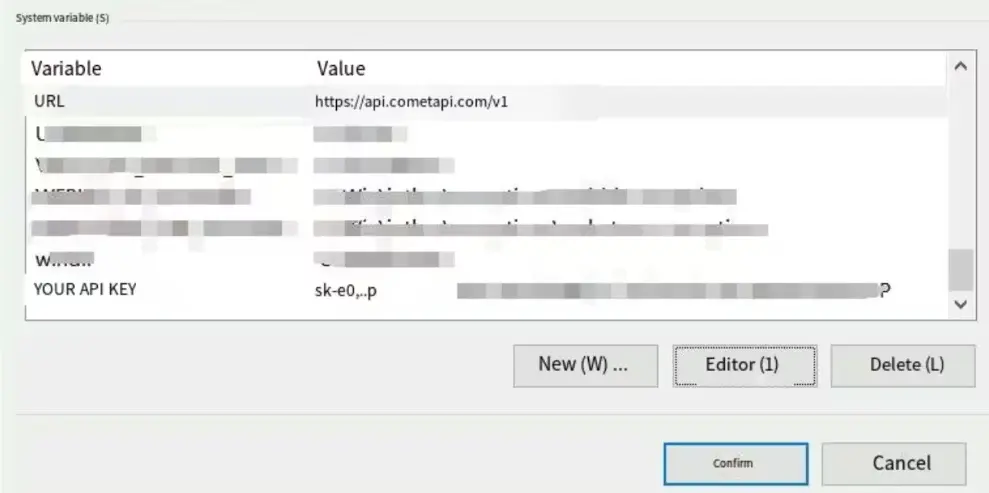

Opsi A: Variabel Lingkungan (Disarankan)

Ini adalah metode yang disukai untuk lingkungan produksi karena menjaga kredensial di luar kode sumber Anda dan memungkinkan LangChain mengarahkan trafik ke gateway CometAPI secara otomatis.

# Set your unique CometAPI key from the dashboard

export OPENAI_API_KEY=<YOUR_COMETAPI_KEY>

# Redirect standard OpenAI traffic to the CometAPI v1 endpoint

export OPENAI_API_BASE=https://api.cometapi.com/v1

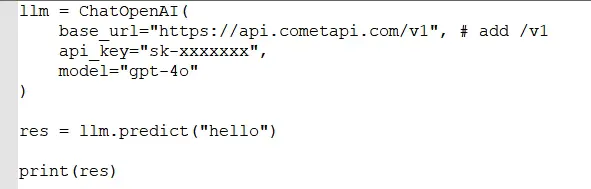

Opsi B: Konfigurasi Inline

Untuk pengujian, prototipe, atau aplikasi yang perlu beralih antar beberapa kunci, Anda dapat menentukan parameter secara langsung saat menginisialisasi kelas ChatOpenAI.

Asumsi, kode, dan proses:

from langchain_openai import ChatOpenAI

# Initialize the client pointing at the CometAPI gateway

model = ChatOpenAI(

# Specify any model ID from the 500+ catalog

model="gpt-5.5",

# Use the unified CometAPI base URL

base_url="https://api.cometapi.com/v1",

# Pass your CometAPI key

api_key="sk-xxxx",

# Enable streaming for real-time responses

streaming=True

)

# Validate the connection with a simple call

response = model.invoke("Analyze the impact of 2M-token context windows.")

print(response.content)

Beralih Antarmodel

Salah satu fitur paling kuat dari integrasi CometAPI LangChain adalah kemampuan untuk menukar model hanya dengan mengubah satu string. Anda tidak lagi perlu melakukan autentikasi ulang atau mengimpor pustaka berbeda untuk berpindah dari OpenAI ke Anthropic atau DeepSeek.

llm = ChatOpenAI(

model="gpt-5.4", # or "claude-3-7-sonnet-latest", "gemini-3-1-pro", etc.

base_url="https://api.cometapi.com/v1",

temperature=0.7,

max_tokens=1024

)

response = llm.invoke([HumanMessage(content="Explain how LangChain integrates with CometAPI in detail.")])

print(response.content)

Ini berfungsi untuk model apa pun yang didukung. Ubah string model untuk beralih seketika (misalnya, dari Claude yang unggul dalam penalaran ke DeepSeek yang cepat).

Ini berfungsi untuk model apa pun yang didukung. Ubah string `model` untuk beralih seketika (misalnya, dari Claude yang unggul dalam penalaran ke DeepSeek yang cepat).

**Parameter Lanjutan:** Gunakan `extra_headers`, `timeout` khusus, atau streaming.

Uji koneksi

Jalankan chain sederhana (misalnya, sebuah prompt yang menanyakan tanggal saat ini). Respons yang berhasil mengonfirmasi CometAPI telah terhubung.

Menggunakan dengan Perkakas Ekosistem LangChain

- LlamaIndex: Pembungkus khusus

llama_index.llms.cometapi.CometAPI. - Langflow: Dukungan native di branch utama.

- FlowiseAI: Node drag-and-drop

ChatCometAPIdengan penyiapan kredensial.

CometAPI vs. Penyedia Langsung vs. Alternatif

| Aspek | CometAPI | Langsung (OpenAI/Anthropic) | OpenRouter / Aggregator Lain | Bawaan LangChain (Multiple) |

|---|---|---|---|---|

| Jumlah Model | 500+ (Teks, Gambar, Video) | Khusus penyedia | Ratusan | Bervariasi |

| Penghematan Harga | 20-40% lebih rendah | Dasar | Variabel | N/A (bayar per penyedia) |

| Kunci API Diperlukan | 1 | Banyak | 1 | Banyak |

| Upaya Integrasi | SDK OpenAI (ubah 1 baris) | Native | Serupa | Lebih tinggi |

| Keterikatan Vendor | Tidak ada | Tinggi | Rendah | Sedang |

| Observabilitas | Dasbor Terpadu | Per penyedia | Baik | LangSmith |

| Dukungan Multimodal | Sangat baik (terpadu) | Terfragmentasi | Baik | Memerlukan orkestrasi |

| Terbaik untuk LangChain | Tinggi (mulus) | Baik | Baik | Fleksibel namun kompleks |

Contoh Dunia Nyata

Contoh 1: RAG (OpenAIEmbeddings + ChatOpenAI)

Dalam sistem Retrieval-Augmented Generation ber-volume tinggi, mengelola biaya embedding dan inferensi sangat penting. CometAPI memberikan penghematan 20% di seluruh pipeline.

from langchain_openai import OpenAIEmbeddings, ChatOpenAI

# Initialize embeddings via CometAPI

embeddings = OpenAIEmbeddings(

model="text-embedding-3-small",

base_url="https://api.cometapi.com/v1"

)

# Use an efficient reasoner for the final answer

# DeepSeek V4 Flash provides 1M context at a very low rate

llm = ChatOpenAI(

model="deepseek-v4-flash",

base_url="https://api.cometapi.com/v1"

)

# Standard LangChain RAG logic continues here

# The 20% discount applies to both embedding and completion steps

Contoh 2: Agen Multi-Model (Logika Router)

Anda dapat membangun router yang mengirim kueri sederhana ke model murah dan logika kompleks ke model flagship, semuanya dalam SDK yang sama.

# Router detects complexity

# Routing to DeepSeek V4 Flash for 20% less than official rates

cheap_model = ChatOpenAI(model="deepseek-v4-flash", base_url="https://api.cometapi.com/v1")

# Routing to GPT 5.5 Pro for mission-critical steps

premium_model = ChatOpenAI(model="gpt-5.5-pro", base_url="https://api.cometapi.com/v1")

# Logic: If query involves complex math or coding, use premium_model

# otherwise, use cheap_model to save costs

Contoh 3: Streaming (streaming=True)

Streaming penting untuk aplikasi chat yang berhadapan dengan pengguna. CometAPI mendukung streaming gaya OpenAI standar untuk lebih dari 500 model.

from langchain_openai import ChatOpenAI

model = ChatOpenAI(

model="claude-opus-4-7",

base_url="https://api.cometapi.com/v1",

streaming=True

)

# Stream the response chunk by chunk

for chunk in model.stream("Write a research summary on 2026 AI trends."):

print(chunk.content, end="|", flush=True)

Tips Optimasi Biaya untuk LangChain + CometAPI

Untuk memaksimalkan nilai integrasi Anda, terapkan tiga strategi arsitektur ini:

- Perutean Hirarki Model: Gunakan model paling terjangkau yang dapat menyelesaikan tugas dengan andal. Misalnya, gunakan DeepSeek V4 Flash ($0.12/M tokens) untuk klasifikasi atau deteksi intent, dan sisihkan GPT 5.5 Pro ($24/M tokens) untuk pembuatan keluaran final.

- Dukungan Prompt Caching: Banyak model yang tersedia melalui CometAPI, seperti seri Claude dan DeepSeek, mendukung prompt caching. Saat membangun aplikasi LangChain dengan jendela konteks besar (seperti RAG), susun prompt Anda untuk memanfaatkan cache-hit guna mengurangi latensi dan biaya token input.

- Metode

batch(): Untuk tugas background seperti pemrosesan data batch atau pengindeksan dokumen, gunakan fungsi.batch()milik LangChain. Infrastruktur throughput tinggi CometAPI menangani permintaan bersamaan secara efisien, memungkinkan Anda memproses jutaan token tanpa terkena batas laju standar penyedia.

Pemecahan Masalah Umum

AuthenticationError atau 401 Unauthorized

Ini hampir selalu disebabkan oleh base_url yang salah atau kesalahan trailing slash. Pastikan URL Anda persis https://api.cometapi.com/v1. Beberapa framework menambahkan path mereka sendiri, jadi periksa kembali bahwa /v1 dicantumkan secara eksplisit.

Sensitivitas Huruf Besar/Kecil pada ID Model

ID model harus cocok dengan katalog CometAPI secara persis. Misalnya, menggunakan GPT-5.5 alih-alih gpt-5.5 dapat menghasilkan error "Model not found" tergantung versi SDK. Selalu gunakan pengenal huruf kecil yang ada di dasbor.

Persistensi Variabel Lingkungan

Jika Anda menyetel OPENAI_API_BASE di satu jendela terminal, pastikan variabel tersebut dipersistenkan ke file .env atau pengelola rahasia cloud Anda. Kesalahan umum adalah menjalankan skrip dalam proses yang tidak memiliki akses ke variabel lingkungan yang telah diubah.

Kesimpulan: Mulai dengan LangChain dan CometAPI Hari Ini

Mengintegrasikan LangChain dengan CometAPI mengubah pengembangan AI yang terfragmentasi menjadi mesin yang ramping dan dioptimalkan biayanya. Satu integrasi membuka ratusan model, penghematan dramatis, dan fleksibilitas tak tertandingi—sempurna untuk prototipe, startup, dan perusahaan.

Kunjungi CometAPI untuk mendapatkan kunci API gratis dan kredit uji coba Anda. Uji cuplikan kode di atas, lalu skala dengan analitik dasbor mereka. Untuk implementasi kustom atau dukungan enterprise, jelajahi dokumentasinya dan hubungi tim.

Langkah Berikutnya yang Direkomendasikan di Cometapi.com:

- Daftar dan uji model-model teratas (Claude Sonnet 4.6, GPT-5.4, varian Gemini).

- Tinjau halaman harga untuk kasus penggunaan Anda.

- Bergabunglah dengan komunitas untuk pola khusus LangChain.

- Pantau changelog untuk model baru (misalnya, promo DeepSeek-V4).

Integrasi ini bukan sekadar teknis—ini adalah keunggulan strategis. Mulailah membangun aplikasi AI yang lebih pintar, lebih murah, dan lebih cepat sekarang.

FAQ

T: Apakah saya memerlukan paket LangChain khusus untuk Claude atau Gemini?

J: Tidak. Karena CometAPI menyatukan semua model ke dalam format OpenAI, Anda hanya memerlukan langchain-openai.

T: Apakah Claude 4.7 dan Gemini 3.1 Pro benar-benar didukung?

J: Ya. CometAPI menyediakan dukungan dual-protocol penuh, artinya Anda dapat memanggil model-model ini melalui format OpenAI via LangChain dengan segera.

T: Apakah streaming berfungsi di semua 500+ model?

J: Ya. Streaming adalah fitur inti dari gateway CometAPI dan sepenuhnya kompatibel dengan .stream() milik LangChain dan parameter streaming=True.

T: Dapatkah saya menggunakan CometAPI untuk embeddings yang kompatibel dengan OpenAI?

J: Tentu. Gunakan kelas OpenAIEmbeddings dan arahkan base_url ke CometAPI untuk menghemat 20% pada pengindeksan vektor.

T: Apakah CometAPI kompatibel dengan LangGraph?

J: Ya. LangGraph menggunakan instance ChatModel standar LangChain. Cukup berikan objek ChatOpenAI yang dikonfigurasi CometAPI Anda ke node-node LangGraph.