TL;DR: Rilis terbaru OpenClaw menambahkan dukungan kelas satu dan kompatibel ke depan untuk GPT-5.4 dari OpenAI serta memperkenalkan arsitektur “memory hot-swappable” yang memungkinkan agen OpenClaw mengganti model dan penyimpanan memori yang aktif saat runtime dengan gangguan minimal. Ini membuka alur kerja berkonteks besar (jendela konteks yang diperluas di GPT-5.4), spesialisasi model secara on-the-fly, serta optimisasi biaya/latensi untuk agen produksi. Peningkatan ini tersedia di rilis OpenClaw dan dokumentasi pendamping; contoh di bawah menunjukkan konfigurasi praktis, cuplikan kode, konteks benchmark, dan praktik terbaik yang direkomendasikan.

Apa yang sebenarnya dikirimkan pembaruan OpenClaw (ringkasan cepat)

Pada 9 Maret 2026, kerangka agen open-source yang berdekatan dengan OpenAI, OpenClaw, meluncurkan rilis inti besar (2026.3.7) yang menambahkan dukungan kelas satu untuk GPT-5.4 dan mekanisme baru bernama memory hot-swappable pada mesin konteksnya. Rilis ini mengubah kerangka agen eksperimental yang banyak digunakan menjadi apa yang digambarkan para maintainer sebagai “Agent Operating System” — bertujuan menjadikan alur kerja agen tingkat produksi serta pergantian model mulus bagi pengembang dan tim.

3 hal praktis yang penting bagi pembangun agen:

- Dukungan kelas satu untuk GPT-5.4 — alias model dan pemetaan penyedia yang memungkinkan agen memilih GPT-5.4 sebagai model eksekusi utama (termasuk override per saluran dan pin model per-agen).

- Context Engine & distributed channel binding — peningkatan cara OpenClaw menyusun jendela konteks panjang dari memori, keluaran tool, dan riwayat saluran agar model berkapasitas tinggi menerima masukan yang tertata rapi.

- Arsitektur memory hot-swappable — antarmuka plugin memori dan alur kerja yang lebih jelas sehingga Anda dapat mengganti backend memori atau meningkatkan agen tanpa kehilangan “identitas” atau merusak status persisten (memori itu sendiri tetap menjadi single source of truth). Desain memori OpenClaw (berkas Markdown polos, pencarian terindeks, pengambilan berbasis plugin) adalah bagian yang memungkinkan hot-swapping yang aman.

GPT-5.4 — Apa itu GPT-5.4 dan terobosan benchmark

GPT-5.4 adalah rilis frontier terbaru OpenAI yang berfokus kuat pada produktivitas profesional (spreadsheet, pengeditan dokumen dan presentasi, penalaran multi-langkah dan pengendalian tool). Menurut OpenAI dan liputan pers independen, rilis ini menekankan:

- Expanded context: GPT-5.4 memperkenalkan tingkat berikutnya dari jendela konteks, dengan 1M token eksperimental dan penanganan konteks panjang yang ditingkatkan tersedia melalui endpoint Codex/kompatibel Codex — knob konfigurasi seperti

model_context_windowdanmodel_auto_compact_token_limitdiekspos untuk pengembang. Ini memungkinkan Anda menyimpan keadaan percakapan, dokumen, dan basis kode jauh lebih besar dalam konteks aktif. - Akurasi spreadsheet dan penalaran yang lebih tinggi — OpenAI melaporkan peningkatan besar pada tugas pemodelan spreadsheet (skor rata-rata ~87% vs ~68% untuk GPT-5.2 pada benchmark spreadsheet perbankan/analis milik mereka).

- Peningkatan akurasi dan faktualitas: Ulasan awal dan QA menunjukkan pengurangan halusinasi ~33% dan keluaran yang lebih sedikit rawan kesalahan dibanding GPT-5.2, dengan kenaikan mencolok pada pekerjaan drafting dokumen dan spreadsheet. Pengulas juga mencatat penurunan ~18% pada respons yang rawan kesalahan untuk tugas produktivitas tertentu.

- Peningkatan computer-use terintegrasi dan garis keturunan Codex — GPT-5.4 menyertakan kapabilitas dari garis keturunan Codex yang meningkatkan generasi kode, debugging interaktif, dan pengendalian alat operasional (otomasi mouse/keyboard/screenshot dalam beberapa demo). Ini membuatnya lebih baik pada siklus tulis-jalankan-inspeksi-tambal yang khas pada loop agen.

Benchmark & konteks perbandingan (arti angka-angka tersebut)

- Pemodelan spreadsheet: Benchmark spreadsheet internal OpenAI: skor rata-rata ~87,3% untuk GPT-5.4 vs ~68,4% untuk GPT-5.2. Ini adalah tajuk utama yang digunakan vendor untuk menunjukkan keuntungan tugas-spesifik.

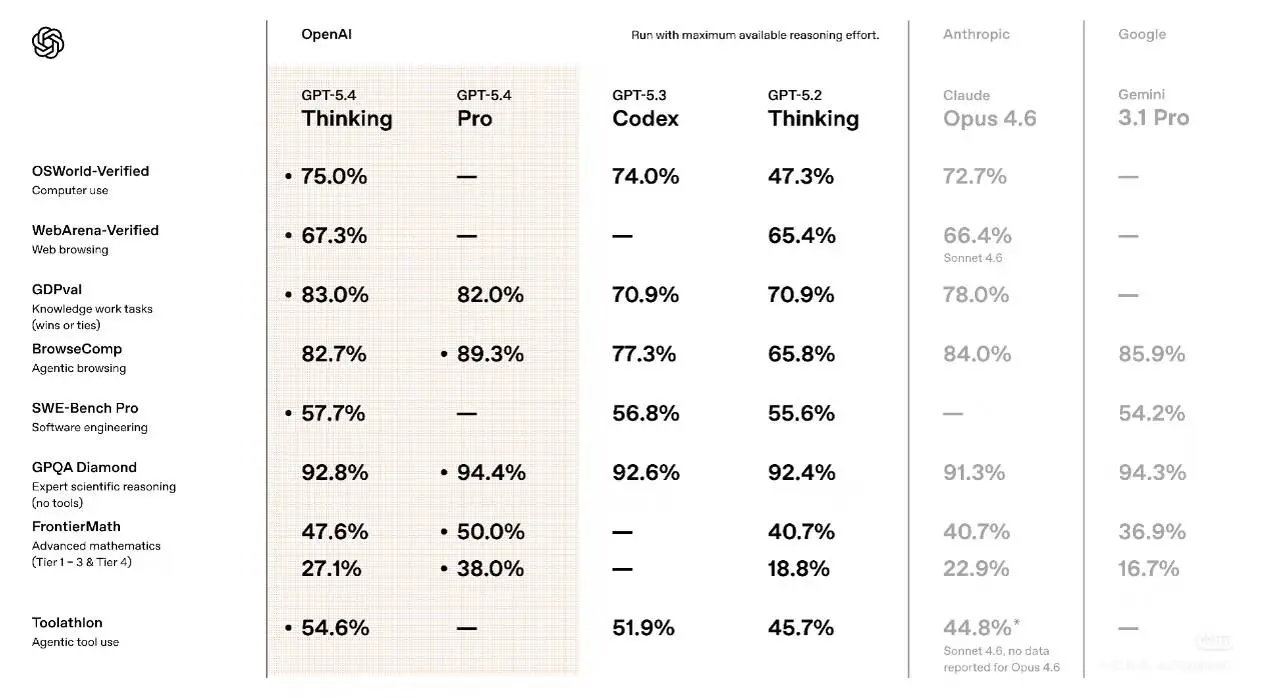

- Interaksi komputer (OSWorld / uji gaya agen): penguji independen dan uji komunitas menunjukkan GPT-5.4 meningkat pada tugas interaksi agen yang melibatkan manipulasi desktop atau UI tersimulasikan, terkadang melampaui varian model Anthropic terbaru dengan selisih kecil pada suite tugas ini (perbedaan bermakna untuk agen, namun tidak selalu menentukan di setiap beban kerja).

Interpretasi: GPT-5.4 bukan “peluru ajaib” yang menang di semua hal. Ia memiliki kekuatan jelas dalam penggunaan alat terintegrasi, pola eksekusi kode, dan penalaran spreadsheet — yang persis merupakan beban kerja yang sering dijalankan agen OpenClaw. Bagi pembangun agen, kombinasi reliabilitas eksekutor yang membaik (garis keturunan Codex) + kompetensi perencana + penanganan konteks panjang yang lebih baik sangat relevan.

OpenClaw mendukung GPT-5.4: apa yang berubah dan mengapa ini penting

Rilis OpenClaw (lihat halaman rilis proyek) memperbarui resolver model dan runtime agar kompatibel ke depan dengan konteks dan batas token yang diperluas milik GPT-5.4 serta menambahkan kapabilitas “memory hot-swappable” sehingga agen dapat mengganti backend memori atau model saat runtime. Hal ini dilakukan dalam tiga cara konkret: 1) pembaruan metadata model dan resolver untuk menerima konteks dan batas token yang lebih besar; 2) perubahan runtime agen untuk mengorkestrasi pergantian model yang mulus dan pemanasan cache; 3) API memori yang memungkinkan banyak saluran memori dan pemicu hot switch.

Dukungan versi 2026.3.7 untuk GPT-5.4 ditambah desain memory hot-swappable memberikan dua keuntungan praktis yang saling melengkapi:

- Jalur peningkatan model yang mudah. OpenClaw kini dapat menyajikan GPT-5.4 sebagai “runtime” yang dapat dipilih untuk agen, memungkinkan Anda beralih dari model GPT-5.x yang lebih lama atau vendor alternatif tanpa mengubah logika agen. Pembaruan OpenClaw secara eksplisit menyatakan integrasi GPT-5.4 yang stabil di inti.

- Memory Hot-Swapping. Alih-alih menyimpan snapshot memori linear tunggal, Context Engine OpenClaw memungkinkan partisi memori dilepas, ditukar, atau dimigrasikan saat runtime — misalnya, menukar shard vector DB dengan recall tinggi untuk debugging atau menukar ke varian memori yang disanitasi sesuai GDPR untuk audit eksternal — tanpa menghentikan agen. Ini menurunkan risiko gangguan di produksi dan memungkinkan konfigurasi memori khusus use case (debugging vs privasi vs performa).

terobosan kinerja praktis & keunggulan

Integrasi OpenClaw berfokus pada tiga area praktis tempat GPT-5.4 unggul:

- Fidelitas orkestrasi tool. Pencarian tool internal dan penalaran GPT-5.4 yang lebih baik mengurangi churn pemanggilan tool (lebih sedikit pemanggilan tool yang redundan dan retry). Ini berarti lebih sedikit panggilan API dan penyelesaian lebih cepat untuk alur kompleks. Laporan awal menunjukkan peningkatan efisiensi token dan pemanggilan tool dibanding model GPT-5.x sebelumnya.

- Penanganan konteks yang lebih panjang dan kaya. Agen OpenClaw kini dapat menyimpan konteks aktif jauh lebih besar (termasuk shard memori yang ditukar masuk), memungkinkan mereka menangani percakapan panjang, proyek multi-berkas, dan debugging iteratif tanpa kehilangan keadaan.

- Keluaran kode yang lebih deterministik. Untuk alur kerja yang menghasilkan kode otomatis (hook CI, stub fungsi, templat infrastruktur), GPT-5.4 cenderung menghasilkan keluaran yang lebih konsisten dan dapat dijalankan, mengurangi beban tinjauan manusia. Uji independen menunjukkan peningkatan mencolok pada metrik kualitas kode dibanding model GPT-5 sebelumnya.

- Kontinuitas memori — “memory hot-swappable” memungkinkan Anda mengganti atau menambah penyimpanan memori (cache lokal, vector DB, memori LLM) tanpa kehilangan keadaan atau konteks agen, memungkinkan A/B testing, rolling upgrades, dan failover.

Dalam uji benchmark OOLONG, versi baru OpenClaw, bersama plugin lossless-claw, mencapai skor tinggi 74,8, meninggalkan Claude Code (70,3 poin) jauh tertinggal. Secara khusus, OpenClaw menunjukkan stabilitas dan akurasi seiring peningkatan panjang konteks, membuat para engineer yang melakukan pengujian di tempat berseru bahwa “mengatakan ini berjalan baik itu terlalu konservatif.”

Cara mengonfigurasi dan menggunakan GPT-5.4 di OpenClaw (langkah demi langkah)

Alur kerja OpenClaw sederhana menggunakan GPT 5.4:

- Konfigurasi tipikal ditunjukkan di bawah:

- Pengguna mengirim pesan melalui platform seperti Discord atau Telegram.

- OpenClaw menerima pesan melalui server gateway-nya.

- Gateway meneruskan prompt ke GPT 5.4 melalui penyedia API AI.

- GPT 5.4 menghasilkan respons atau memicu aksi tool.

- OpenClaw mengirim hasil akhir kembali ke pengguna.

Di bawah ini adalah contoh konfigurasi dan alur kerja yang praktis dan siap ditempel untuk menjalankan GPT-5.4 di OpenClaw secara aman dan dapat direproduksi. Ini sengaja konservatif: aktifkan model terlebih dahulu di agen uji dan instrumentasikan semuanya untuk metrik dan error.

Prasyarat

- OpenClaw ditingkatkan ke rilis yang menyertakan pemetaan GPT-5.4 (catatan rilis dirujuk di atas).

- Kunci API OpenAI yang valid dengan akses ke GPT-5.4 (Saya memilih endpoint CometAPI dengan harga lebih murah).

1) Pemilihan model & konfigurasi resolver (JSON/YAML/CLI)

Letakkan ini di ~/.openclaw/openclaw.json (atau gabungkan ke dalam konfigurasi Anda yang ada). Sesuaikan nama penyedia dan referensi token sesuai lingkungan Anda.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw menggunakan resolver model untuk memetakan nama model logis (misalnya, openai/gpt-5.4) ke endpoint dan konfigurasi runtime. Tambahkan atau perbarui berkas resolver Anda (contoh models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Atau atur saat runtime melalui CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Catatan:

context_windowdanmax

Catatan

agents.defaults.model.primarymemilih model default. Gunakanchannels.modelByChanneluntuk override per saluran sehingga Anda dapat merutekan saluran berdampak tinggi ke GPT-5.4 dan saluran yang kurang menuntut ke model yang lebih murah. Lihat dokumentasi pemilihan model OpenClaw untuk semantik pengurutan.- Silakan merujuk ke halaman model CometAPI untuk nama model spesifik. Jika Anda ingin menggunakan OpenAI, ganti URL dan kunci API dengan milik OpenAI.

- Kunci

context_windowdanmax_output_tokensmencerminkan perubahan kompatibilitas ke depan di resolver OpenClaw sehingga agen tidak mencoba menggunakan batas Codex yang usang.

2) Cara mengaktifkan dan menguji “memory hot-swapping”

Subsistem memori OpenClaw berbasis berkas (berkas Markdown) plus pengindeks/pencarian plugin sehingga Anda dapat dengan aman menukar plugin backend (misalnya, vektor SQLite, Milvus, atau layanan memori eksternal) tanpa kehilangan berkas memori mentah.

Pola umum:

- Standarkan lokasi memori: gunakan workspace berbasis git:

~/.openclaw/workspace/di manaMEMORY.mddanmemory/YYYY-MM-DD.mdbersifat otoritatif. - Instal & konfigurasikan plugin memori (contoh: sqlite-vec) dan arahkan

plugins.slots.memoryke sana dalam konfigurasi. - Uji migrasi: tambahkan plugin baru, jalankan pekerjaan pengindeksan bayangan, bandingkan hasil pengambilan, lalu alihkan alias

plugins.slots.memoryke plugin baru saat puas.

Contoh pertukaran alias plugin (perintah pseudo bash):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Mengapa ini “hot-swappable”: berkas memori tetap menjadi sumber kebenaran. Plugin mengimplementasikan lapisan pengindeksan dan pengambilan; menukarnya memicu pengindeksan ulang tetapi tidak mengubah berkas .md yang mendasarinya. Ini memungkinkan pergantian model tanpa drift identitas yang katastrofik — agen tetap membaca MEMORIES yang sama.

3) Contoh: pin satu agen ke GPT-5.4 (override per-agen)

Anda dapat override model per agen; tambahkan entri agen seperti:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Jika rilis komunitas atau versi OpenClaw Anda memerlukan CLI, Anda juga dapat mengatur model per-sesi saat runtime:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Kiat operasional: pinning memastikan perilaku deterministik untuk agen tersebut sementara Anda menjalankan uji A/B pada agen lain.

Jika Anda ingin menggunakan OpenAI, ganti URL dan kunci API dengan milik OpenAI.

4) Menggunakan opsi konteks 1M Codex (parameter API)

Jika deployment OpenClaw Anda mengakses endpoint OpenAI Codex secara langsung, teruskan opsi konteks:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Permintaan yang melampaui jendela konteks standar mungkin dihitung dengan tarif penggunaan berbeda (dokumen OpenAI mencatat perhitungan ganda untuk permintaan di luar jendela standar pada pratinjau Codex).

Praktik terbaik: memaksimalkan keunggulan GPT-5.4 di OpenClaw

Biaya, latensi & campuran model

- Strategi model hibrida: Gunakan model yang lebih kecil dan murah untuk kueri singkat dan pemrosesan streaming; hot-swap ke GPT-5.4 untuk analisis berat, peringkasan, generasi kode dengan konteks panjang. Ini mengurangi biaya token keseluruhan sambil menjaga kualitas. (Terapkan melalui pemicu di konfigurasi memori di atas.)

- Kompaksi token & augmentasi pengambilan: Gunakan pipeline RAG untuk membatasi token yang dikirim ke model — simpan dokumen panjang dalam vector DB, ambil segmen relevan, dan sertakan hanya potongan paling relevan ditambah rencana ringkas. Pencarian tool GPT-5.4 membantu menemukan tool atau dokumen yang berguna secara otomatis.

- Pemanasan & cold start: Setelah pergantian model, panaskan model dengan run priming konteks singkat untuk menghindari lonjakan latensi permintaan pertama. Pra-kompilasi templat prompt dan rehidrasi saluran memori kritis. Strategi rolling OpenClaw (lihat konfigurasi) mendukung pre-warming.

Keandalan & keamanan

- Fallback yang mulus: Terapkan batas waktu dan rencana fallback (misalnya, turunkan ke jawaban cache dari sesi sebelumnya) untuk menangani batasan laju API atau error kuota.

- Lapisan keamanan: Pertahankan filter kebijakan dan langkah verifikasi saat keluaran memengaruhi keputusan. GPT-5.4 secara statistik mengurangi halusinasi, namun verifikasi tetap penting untuk tugas berisiko tinggi.

Evaluasi & pemantauan

- Reproduksi benchmark Anda: Jalankan uji head-to-head untuk beban kerja Anda (pelengkapan kode, refaktor multi-berkas, analisis spreadsheet) menggunakan rubric standar. Laporan publik menunjukkan kekuatan pada tugas spreadsheet dan produktivitas — validasi dengan data Anda.

- Telemetri: Pantau konsumsi token, latensi model, frekuensi swap memori, dan kualitas jawaban (penilaian manusia/uji otomatis). Gunakan telemetri untuk menyempurnakan ambang swap.

Contoh: agen code review yang melakukan hot-swap

Tujuan: Jalankan ringkasan lint + unit test rutin saat push (model murah) dan tingkatkan ke GPT-5.4 untuk saran refaktor multi-berkas ketika tes gagal atau diff melebihi 10 berkas.

Alur (tingkat tinggi):

- Pemicu pre-commit menjalankan

local/fast-small-coderuntuk menghasilkan ringkasan lint. - Jika

test_failures > 0ataudiff_files > 10, picuhot_swapkeopenai/gpt-5.4. Promosikanlongterm_vectoryang berisi riwayat repo. - Jalankan prompt GPT-5.4 yang memuat seluruh jejak stack yang gagal + berkas kode relevan yang dimasukkan ke konteks. Hasilkan patch refaktor dan perubahan unit test.

- Peninjau manusia menilai keluaran; umpan balik memperbarui memori.

Kerangka prompt (dikirim ke GPT-5.4 setelah pengambilan & pemadatan):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Kasus penggunaan ini menyoroti mengapa konteks besar + memory hot-swap berharga: Anda dapat membawa seluruh jejak kegagalan dan banyak berkas sekaligus ke dalam model. Terapkan pemicu swap secara konservatif untuk mengendalikan biaya.

Terakhir: siapa yang sebaiknya mengadopsi GPT-5.4 di OpenClaw (dan kapan)

- Adopsi sekarang jika agen Anda melakukan tugas kode/alur alat multi-langkah, otomasi spreadsheet berat, atau pengeditan dokumen kompleks di mana siklus tulis-jalankan-inspeksi iteratif mendominasi waktu pengembang. Keuntungan produktivitas dan reliabilitas paling terlihat di sini.

- Adopsi dengan hati-hati jika Anda beroperasi di saluran chat berbiaya sensitif dan volume tinggi di mana penalaran sederhana sudah cukup; gunakan perutean untuk menjaga efisiensi biaya.

- Jangan berasumsi satu model dominan: benchmark dengan data Anda. GPT-5.4 adalah penantang kuat untuk beban kerja agen, namun pemilihan model harus berbasis bukti.

Pengembang dapat mengakses GPT-5.4 melalui CometAPI (CometAPI adalah platform agregasi satu atap untuk API model besar seperti GPT API, Nano Banana API, dll) sekarang. Untuk memulai, jelajahi kapabilitas model di Playground dan lihat Openclaw intergration guide untuk instruksi terperinci. Sebelum mengakses, pastikan Anda telah masuk ke CometAPI dan memperoleh kunci API. CometAPI menawarkan harga jauh lebih rendah daripada harga resmi untuk membantu Anda melakukan integrasi.

Siap mulai?→ Daftar OpenClaw hari ini!

Jika Anda ingin mengetahui lebih banyak tips, panduan, dan berita tentang AI ikuti kami di VK, X dan Discord!