Risposta rapida: quale modello di IA dovrebbero privilegiare gli sviluppatori nel 2026?

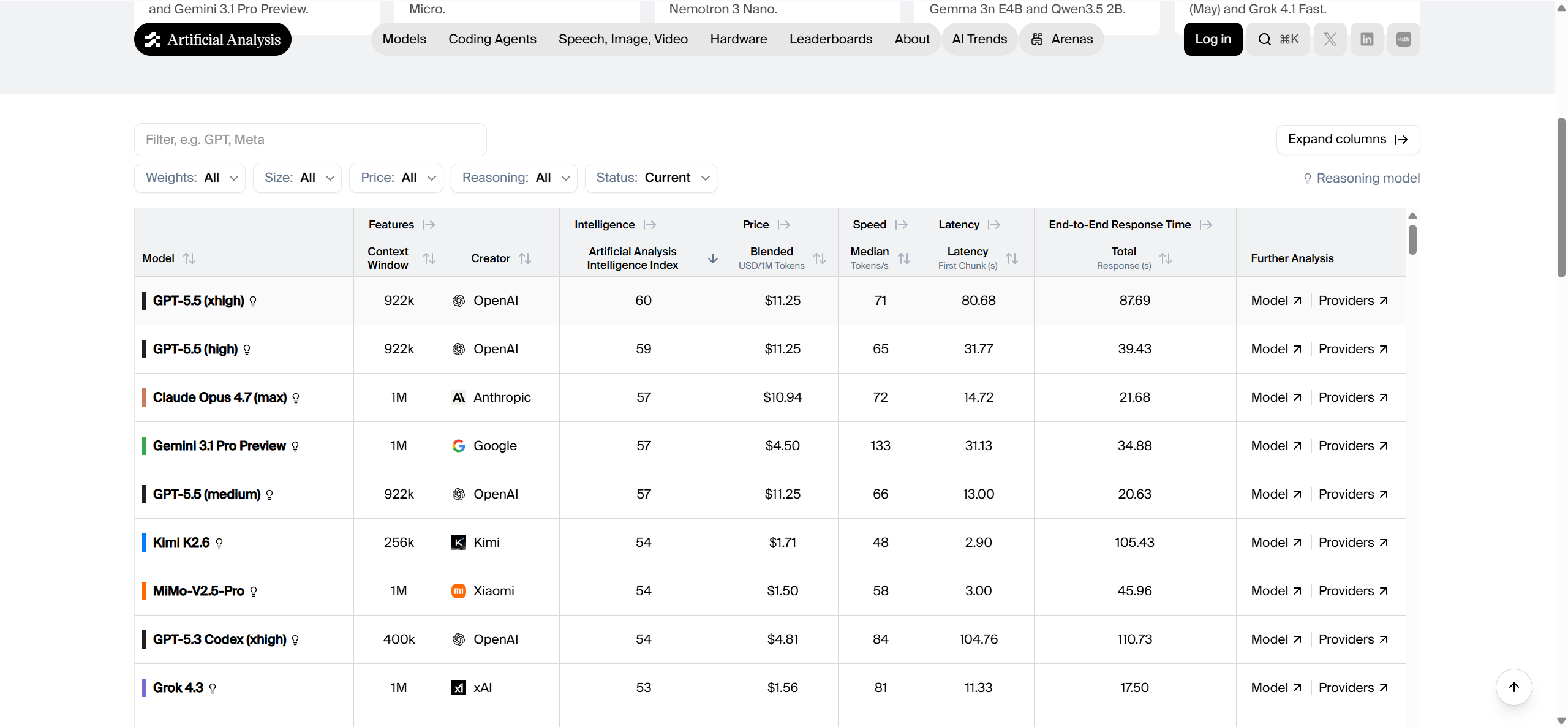

Per attività che richiedono massimo ragionamento autonomo e minime allucinazioni, gli sviluppatori dovrebbero scegliere GPT-5.5 (xhigh), che guida il mercato con un Indice di Intelligenza pari a 60. Le applicazioni che richiedono interattività in tempo reale dovrebbero utilizzare Mercury 2, l’attuale leader in velocità con circa 859 token al secondo. Per la produzione su larga scala in cui il budget è un vincolo primario, DeepSeek V4 Pro e Kimi K2.6 offrono un’intelligenza quasi d’avanguardia a circa il 10% del costo dei modelli proprietari di punta.

L’Indice di Intelligenza: classifica dei modelli di frontiera

Il panorama dell’IA del 2026 è passato dall’inseguire il numero di parametri all’ottimizzazione della densità di “pensiero”. L’Artificial Analysis Intelligence Index v4.0 funge da standard di settore per quantificare la capacità dei modelli su dieci dimensioni specializzate, tra cui programmazione a livello professionale e deduzione logica estrema.

| Modello | Indice di Intelligenza | Finestra di contesto | Caso d'uso migliore |

|---|---|---|---|

| GPT-5.5 (xhigh) | 60 | 922K | Ricerca scientifica e logica |

| GPT-5.5 (high) | 59 | 922K | Programmazione a livello professionale |

| Claude Opus 4.7 (max) | 57 | 1M | Agenti autonomi e pianificazione |

| Gemini 3.1 Pro | 57 | 1M - 2M | Sintesi di dati multimodali |

| Kimi K2.6 | 54 | 256K | Lavoro agentico basato su terminale |

| MiMo-V2.5-Pro | 54 | 1M | Ingegneria software full-stack |

| DeepSeek V4 Pro (Max) | 52 | 1M | Workflow di ragionamento scalabili |

| GLM-5.1 | 51 | 200K | Attività autonome a lungo orizzonte |

Come leggere questa tabella

Tra i primi cinque modelli, tre sono modelli GPT-5.5, GPT-5.5 Medium, Claude Opus 4.7 e Gemini 3.1 Pro. Questi tre modelli occidentali di punta sono testa a testa, mentre Kimi K2 e mimo-v2.5 pro, due modelli cinesi, offrono prestazioni paragonabili ai migliori modelli occidentali a prezzi estremamente competitivi.

L’Artificial Analysis Intelligence Index è una metrica normalizzata derivata da valutazioni indipendenti come Terminal-Bench Hard e IFBench. Un singolo punto di differenza rappresenta un divario statisticamente significativo nella “soglia di autonomia” di un modello. Ad esempio, il divario di 3 punti tra GPT-5.5 (60) e Claude Opus 4.7 (57) spesso si traduce nella differenza tra un modello che richiede intervento umano ogni pochi passaggi e uno che può completare autonomamente una catena logica complessa. Un punteggio più alto dell’indice è generalmente associato a tassi di successo più elevati nell’“Humanity's Last Exam” e a una riduzione degli errori di chiamata strumenti in ambienti agentici.

I riflessi: latenza e velocità di generazione

Per i software interattivi—dagli assistenti IDE live agli agenti vocali rivolti ai clienti—l’intelligenza grezza è secondaria rispetto a Time to First Token (TTFT) e Generation Throughput.

Top 5 modelli più veloci (throughput)

Il throughput misura la velocità con cui un modello genera testo dopo la fase di elaborazione iniziale. Un throughput elevato è essenziale per la generazione di contenuti lunghi e il refactoring rapido del codice.

- Mercury 2: Circa 859 token/s

- Granite 4.0 H Small: Circa 407 token/s

- Granite 3.3 8B: Circa 365 token/s

- Gemini 3.1 Flash-Lite**** : Circa 331 token/s

- Qwen3.5 0.8B: Circa 287 token/s

Top 5 modelli con la latenza più bassa (TTFT)

La latenza indica il ritardo prima che il primo token raggiunga l’utente. Questa è la metrica critica per la “vibe” e la reattività percepita in UI/UX.

- NVIDIA Nemotron 3 Nano: Circa 0,40s

- Ministral 3 3B: Circa 0,47s

- Qwen3.5 0.8B: Circa 0,52s

- LFM2 24B A2B: Circa 0,55s

- Grok 3 mini Reasoning: Circa 0,58s

Come scegliere il modello nel 2026

La selezione di un modello richiede di bilanciare il rapporto “intelligenza per dollaro” con i requisiti specifici di uptime della tua applicazione. Il mercato nel 2026 si è diviso in tre distinti percorsi architetturali.

Sviluppatori indipendenti e team sensibili al budget

Per sviluppatori singoli o piccoli team che eseguono migliaia di loop agentici sperimentali, DeepSeek V4 Pro è la scelta strategica ottimale. Utilizza un’enorme architettura Mixture-of-Experts (MoE) da 1,6T parametri in cui solo 49B parametri sono attivati per token, consentendo prestazioni di livello flagship a circa $0.416 per milione di token. Un’altra ottima opzione per attività specifiche di coding è Kimi K2.6, specializzato in workflow “terminal-first”. Questi modelli forniscono quasi il 90% della capacità di ragionamento dei modelli premium pur costando circa il 70-80% in meno, estendendo efficacemente la runway di una startup.

Ambienti di produzione enterprise

Per distribuzioni a livello aziendale in cui la stabilità e l’aderenza a prompt di sistema complessi sono imprescindibili, lo standard di settore rimane GPT-5.5 Pro e Claude Opus 4.7. GPT-5.5 Pro è progettato per una precisione ad altissima posta in gioco, eccellendo in aree come la modellazione nell’investment banking e l’esplorazione scientifica, dove il costo di un errore supera il costo della chiamata API. Claude Opus 4.7 è preferito dai team che richiedono affidabilità sostenuta in progetti di più giorni, poiché mostra un tasso di allucinazioni significativamente più basso in ambienti terminal rispetto alla più ampia famiglia GPT. Le imprese utilizzano tipicamente CometAPI per integrare questi modelli tramite un unico gateway, garantendo il 99.9% di uptime e failover immediato se un provider primario sperimenta picchi di latenza regionali.

Applicazioni interattive in tempo reale

Applicazioni come bot di assistenza clienti in tempo reale o sottotitolazione video istantanea richiedono un’IA “fluida” che sembri istantanea. In questa categoria, Mercury 2 e Gemini 3.1 Flash-Lite sono le scelte superiori. Mercury 2 offre un throughput quasi dieci volte superiore ai modelli di ragionamento standard, rendendolo ideale per la redazione di documenti in tempo reale. Gemini 3.1 Flash-Lite offre una capacità multimodale bilanciata, elaborando testo, audio e immagini all’interno di un contesto unificato a circa 2.5x la velocità delle generazioni precedenti, supportando al contempo una finestra di contesto da 1 milione di token.

Finestra di contesto: dagli snippet ai repository interi

La finestra di contesto funge da “memoria a breve termine” del modello. Nel 2026, il settore si è diviso tra finestre standard (128K) e capacità a scala repository (1M-10M).

- Llama 4 Scout: 10,000,000 token

- Grok 4.20: 2,000,000 token

- Gemini 3.1 Pro: Circa 1,048,576 token

- DeepSeek V4 Pro: 1,000,000 token

- GPT-5.5 Pro: 1,050,000 token

Quando conta la dimensione del contesto?

Una finestra di contesto da 128K—standard per modelli come DeepSeek-V3.2—è ormai la base per chat conversazionali e per riassumere singoli articoli. Tuttavia, l’ingegneria software professionale richiede una consapevolezza “di sistema intero”.

Una finestra da 1 milione di token consente a un agente IA di ingerire un intero repository software, includendo tutti i file sorgente, la documentazione e i log storici, in un’unica passata in avanti. Ciò evita il “drift di memoria” associato ai tradizionali sistemi RAG, in cui i dati rilevanti potrebbero essere persi durante il “chunking”. Un esempio concreto è il refactoring di una codebase: un modello con 1M token può comprendere come una modifica in uno schema di database core influisca su cinquanta diversi endpoint API su file separati, mentre un modello più piccolo potrebbe “vedere” solo pochi file alla volta, causando dipendenze interrotte.

Confronto economico: prezzo unitario per 1 milione di token

La seguente tabella utilizza una metrica USD/1M token “blended”, assumendo un rapporto 3:1 tra token di input e di output per riflettere i modelli d’uso nel mondo reale.

| Modello | Prezzo "blended" (per 1M) | Valore relativo | Sconto tramite CometAPI |

|---|---|---|---|

| GPT-5.5 (xhigh) | Circa $11.25 | Premium | 20% OFF |

| Claude Opus 4.7 (max) | Circa $10.00 | Alto | 20% OFF |

| Gemini 3.1 Pro | Circa $4.50 | Bilanciato | 20% OFF |

| Kimi K2.6 | Circa $1.71 | Alto valore | 20% OFF |

| DeepSeek V4 Pro | Circa $0.53 | Valore estremo | 20% OFF |

| Qwen3.5 0.8B | Circa $0.02 | Utilità | 20% OFF |

Tutte le tariffe verificate a maggio 2026. Le tariffe ufficiali dei vendor sono tipicamente superiori del 20% rispetto alle tariffe scontate offerte tramite gateway unificati.

Strategia di ottimizzazione dei costi

Per supportare la pianificazione architetturale, abbiamo stimato le spese mensili per tre comuni livelli di crescita.

- Piccolo team di sviluppo (10M token/mese): Team che utilizzano principalmente Kimi K2.6 per la realizzazione di funzionalità e DeepSeek V4 Flash per logiche semplici vedranno una spesa mensile nell’ordine di $15 - $40. Ciò consente un prototyping aggressivo con un onere finanziario non superiore a un tipico abbonamento SaaS.

- SaaS di medie dimensioni (100M token/mese): Una startup che scala una piattaforma di automazione guidata dall’IA usando Claude Sonnet 4.6 e Gemini 3.1 Flash può aspettarsi costi mensili tra $250 e $550. Sfruttando il prompt caching disponibile su questi modelli, il costo effettivo spesso scende di un ulteriore 15%.

- Grande impresa (1B token/mese): Aziende globali che eseguono workflow agentici ad alta concorrenza con GPT-5.5 e Claude Opus 4.7 probabilmente spenderanno tra $3,000 e $6,500 al mese. A questa scala, l’integrazione tramite un gateway API unificato diventa essenziale per la fatturazione centralizzata ed evitare l’overhead di gestire contratti separati con più vendor.

Conclusione: scegliere il proprio percorso nel 2026

L’era del “modello tuttofare” è finita. L’architettura IA moderna richiede l’orchestrazione di una flotta di modelli specializzati: GPT-5.5 per il ragionamento ad alta computazione, Mercury 2 per l’interattività e DeepSeek V4 per l’esecuzione ad alto volume. Integrando una sola volta con CometAPI, gli sviluppatori ottengono la portabilità per sostituire i modelli man mano che i benchmark evolvono, assicurandosi al contempo uno sconto permanente del 20-40% su ogni richiesta.

FAQ

Qual è attualmente il modello di IA più intelligente?

Secondo l’Artificial Analysis Intelligence Index v4.0, GPT-5.5 (xhigh) è il modello più intelligente attualmente disponibile, con un punteggio di 60. È seguito da vicino da GPT-5.5 (high) a 59 e Claude Opus 4.7 (max) a 57.

Qual è il modello di IA più veloce per applicazioni in tempo reale?

Mercury 2 è il campione di velocità del 2026, con circa 859.1 token al secondo. Per la bassa latenza (TTFT), NVIDIA Nemotron 3 Nano guida con un tempo di risposta di circa 0.40 secondi.

Quanto deve essere alto un punteggio dell’Indice di Intelligenza per agenti in produzione?

Per automazione di base o classificazione, è spesso sufficiente un punteggio tra 30 e 40 (come GPT-5.4 nano). Tuttavia, per l’“Agentic Engineering”, in cui l’IA gestisce codebase o intere sessioni browser, si raccomanda un punteggio superiore a 54 (come Kimi K2.6 o GPT-5.5) per garantire coerenza nella pianificazione a lungo orizzonte.

A parità di prezzo, dovrei scegliere GPT-5.5 o Claude Opus 4.7?

Se il tuo workflow implica esecuzione su terminale e “Vibe Coding”, GPT-5.5 eccelle generalmente in quei benchmark specifici. Tuttavia, se richiedi massima coerenza per scrittura professionale, ricerca legale o cicli agentici di più giorni con basse allucinazioni, Claude Opus 4.7 è il leader documentato in tali categorie.

Qual è il reale divario prestazionale tra modelli open-weights (DeepSeek) e modelli proprietari?

Nel 2026, il divario si è ridotto a circa il 10-15% nei benchmark di ragionamento grezzo. Sebbene i flagship proprietari come GPT-5.5 (xhigh) restino in testa nella logica “peak” (Indice 60), modelli a pesi aperti come DeepSeek V4 Pro (Indice 52) e Kimi K2.6 (Indice 54) forniscono oltre l’85% della capacità a circa 1/10 del costo.

Come posso ridurre i costi complessivi di API per questi modelli?

Utilizzare un livello API unificato come CometAPI consente di accedere all’intero catalogo a tariffe inferiori del 20% - 40% rispetto ai prezzi ufficiali dei vendor, grazie ad acquisti in volume e instradamento intelligente.

Quale modello ha la finestra di contesto più ampia per documenti lunghi?

Llama 4 Scout supporta attualmente la finestra di contesto più ampia sul mercato con 10 milioni di token. Grok 4.20 segue con 2 milioni di token, mentre GPT-5.5 Pro, Gemini 3.1 Pro e DeepSeek V4 Pro supportano tutti circa 1 milione di token.

Esiste un modo per testare questi benchmark senza un elevato costo iniziale?

Sì. Puoi registrarti per un account gratuito su CometAPI per ricevere crediti di prova senza carta di credito, così da eseguire test comparativi di performance su oltre 500 modelli nel Playground integrato.