L’esperienza degli sviluppatori con l’analisi video di ChatGPT spesso si scontra con un muro: i link diretti a YouTube non funzionano e i caricamenti MP4 restituiscono riepiloghi “allucinati” che ignorano le sfumature visive. Non è un bug: è un vincolo architetturale. ChatGPT non riproduce video in streaming; elabora sequenze di fotogrammi estratti e il testo della trascrizione. Così hai provato a caricare un file MP4, che ha funzionato… in un certo senso. Il riepilogo menzionava la trascrizione audio ma ha completamente ignorato la gag visiva nella terza scena che dava senso all’intero video.

ChatGPT può analizzare i video — ma non “guardandoli” davvero

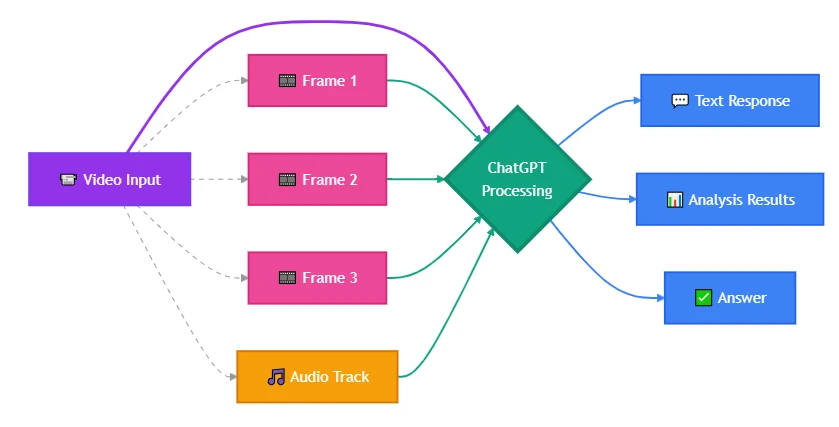

Ecco cosa succede realmente: ChatGPT non “guarda” i video come fai tu. Non preme play, non esegue lo streaming del contenuto e non osserva il movimento nel tempo. Quello che fa è scomporre il video in componenti che sa già gestire — immagini statiche e trascrizioni testuali — quindi ragionare su questi pezzi in modo indipendente. Il modello vede il tuo video come un album fotografico con narrazione, non come un’esperienza continua. Ecco perché ha colto la spiegazione parlata ma ha mancato il colpo di scena visivo: il fotogramma con la battuta probabilmente non era nel set campionato.

Quando qualcuno chiede “ChatGPT può guardare i video?”, in genere intende due cose: può trasmettere contenuti visivi come farebbe un osservatore umano oppure può estrarre e analizzare significato dai dati video — scene, dialoghi, timestamp, azioni su schermo? La risposta funzionale alla seconda domanda è sì, con vincoli che in certi casi d’uso la rompono del tutto. Le varianti moderne di ChatGPT elaborano video trattandoli come fotogrammi campionati combinati con la trascrizione audio, tramite estrazione automatica nell’interfaccia web o accettando fotogrammi forniti dall’utente via API. Questo funziona per il riassunto, la descrizione delle scene e l’estrazione di testo. Fallisce per il tracciamento del movimento, l’analisi dipendente dal timing o tutto ciò che richiede al modello di “vedere” cosa accade tra i fotogrammi.

La maggior parte delle guide si limita a confermare che la capacità esiste senza spiegare perché la tua implementazione specifica non ha funzionato — o quale metodo di input alternativo sarebbe stato adatto.

ChatGPT Capacità video: ciò che il modello vede realmente

ChatGPT non carica un MP4 né lo scorre fotogramma per fotogramma. Ha la capacità di visione — l’abilità di analizzare immagini statiche — e la trascrizione audio tramite integrazione con Whisper. Quando invii un video tramite l’interfaccia web o mobile di ChatGPT, il sistema estrae i keyframe, trascrive l’audio separatamente e fornisce entrambi al modello come input distinti. Il modello quindi descrive ciò che ha “visto” in quei fotogrammi e ciò che ha “sentito” nella trascrizione.

Dal tuo punto di vista, sembra comprensione del video. Dal punto di vista del modello, è analisi di immagini più elaborazione di testo. Questa distinzione architetturale determina quali casi d’uso funzionano e quali no.

Se il tuo video si basa su movimento, cambiamenti sottili da fotogramma a fotogramma o tempistiche precise — ad esempio rilevare esattamente quando un oggetto entra nell’inquadratura, o tracciare come si anima un elemento UI — un approccio basato su keyframe lo perderà. ChatGPT non coglierà un indizio visivo di due secondi che cade tra i fotogrammi campionati. Non seguirà nemmeno oggetti nel tempo a meno che tu non strutturi esplicitamente l’input per mostrare la progressione.

Capacità video attuali di ChatGPT (a inizio 2026):

- Analisi video basata su immagini: accetta file video o fotogrammi estratti; interpreta il contenuto visivo da immagini campionate

- Trascrizione audio: converte le parole pronunciate in testo tramite Whisper; il modello può poi riassumere o interrogare la trascrizione

- Descrizione delle scene: identifica oggetti, azioni, ambienti e testo visibile nei fotogrammi forniti

- Query basate su timestamp: può riferirsi a momenti specifici se fornisci timestamp dei fotogrammi o segmenti manualmente il video

- Estrazione di testo: legge sottotitoli su schermo, etichette UI o documenti visibili nei fotogrammi

Frequenza specifica di campionamento dei fotogrammi e comportamento di selezione automatica dei keyframe nell’interfaccia web di ChatGPT — non documentati pubblicamente alla data del cutoff di conoscenza

Cosa non include:

- Input di video in streaming in tempo reale tramite API

- Tracciamento perfetto del movimento o persistenza degli oggetti nel tempo

- Supporto nativo per codec video — tutta l’elaborazione avviene su fotogrammi estratti e audio

- Rilevamento automatico dei cambi di scena senza prompting esplicito

La capacità video è limitata dal numero di token e dalla dimensione del file, non dalla durata. Sebbene 5–10 minuti siano una euristica pratica, i limiti reali scalano dinamicamente con la densità visiva.

Se il tuo caso d’uso richiede tali capacità, o pre-processi il video tu stesso per estrarre i fotogrammi giusti, oppure passi a un modello con supporto video nativo. La prossima sezione illustra quale metodo di input usare per il tuo scenario specifico.

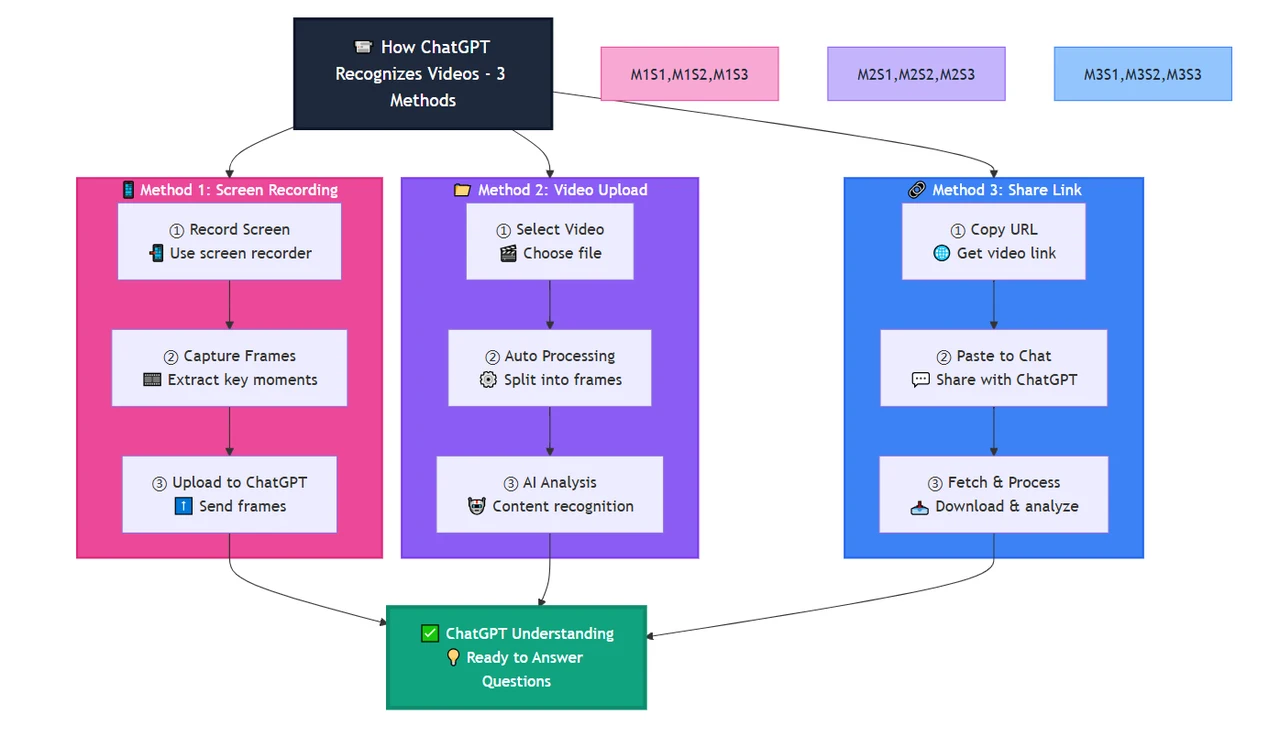

Come ChatGPT riconosce i video: tre metodi pratici

Non esiste un solo modo per inviare video a ChatGPT. Il metodo scelto determina cosa il modello può analizzare e cosa perdonerà. La maggior parte dei fallimenti di implementazione deriva dalla scelta del metodo più comodo invece di quello corretto.

Metodo 1: Estrazione manuale dei fotogrammi + upload di immagini

Estrai tu stesso i fotogrammi usando ffmpeg o strumenti simili, quindi carica quei fotogrammi specifici come immagini. Così controlli completamente ciò che ChatGPT analizza.

Esempio di workflow(bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Questo approccio ti consente di:

- Concentrarti su momenti specifici (introduzione, azione chiave, conclusione) senza sprecare contesto su sezioni irrilevanti

- Catturare il movimento caricando fotogrammi consecutivi alla frequenza di campionamento scelta

- Aggirare i limiti di dimensione del file — le immagini sono più piccole dei video completi

- Preservare la qualità dei fotogrammi, che potrebbe degradarsi durante la compressione automatica

Il compromesso:

Gestisci il pre-processing da solo. Per analizzare centinaia di video su larga scala, serve automazione. Per un’analisi approfondita una tantum o il debug di scene specifiche, è il metodo più affidabile.

Quando usare questo metodo:

- Ti serve un’analisi accurata al fotogramma di momenti specifici

- Le informazioni visive critiche sono brevi o si verificano tra intervalli tipici di keyframe

- Stai confrontando cambiamenti visivi lungo una sequenza (cambi di stato UI, fotogrammi di un’animazione)

- Vuoi verificare cosa il modello ha effettivamente “visto” ispezionando i fotogrammi caricati

Metodo 2: Caricamento diretto del file tramite interfaccia ChatGPT

Le app web e mobile di ChatGPT accettano caricamenti video direttamente nella chat. Trascina un file MP4 o MOV nel campo di input e il sistema gestisce automaticamente l’estrazione dei fotogrammi e la trascrizione.

Cosa accade internamente:

- Il servizio campiona i fotogrammi a intervalli (frequenza non documentata; stimata a 1–2 fotogrammi al secondo in base a comportamenti osservati)

- L’audio viene trascritto tramite Whisper o servizio simile

- Entrambi gli output sono passati al modello come input separati

- Il modello genera risposte in base ai fotogrammi visibili e a quanto “ascoltato” nella trascrizione

Questo metodo funziona per:

- Riepiloghi video a livello alto, dove non serve dettaglio al fotogramma

- Identificare oggetti, persone o ambienti che persistono nelle scene

- Estrarre contenuti parlati o testo su schermo che appare in più fotogrammi

- Analisi esplorative rapide senza pre-processing

Questo metodo fallisce per:

- Analisi al fotogramma — non controlli quali fotogrammi vengono campionati

- Per contenuti video estesi oltre la capacità di contesto gestibile del modello, è necessaria una segmentazione logica. Senza uno spezzettamento strategico o pre-processing, i modelli possono degradare o troncare man mano che il consumo di token accelera con dati visivi ad alta densità

- Rilevare movimento, transizioni o contenuti dipendenti dal timing che richiedono il confronto di fotogrammi consecutivi

- Scenari in cui l’informazione visiva critica appare brevemente tra i fotogrammi campionati

Se ti serve controllo sui momenti analizzati, usa il Metodo 1.

Metodo 3: Link YouTube + recupero trascrizione

Alcuni plugin di ChatGPT e strumenti di terze parti affermano di “analizzare i video di YouTube”. Ciò che fanno davvero è recuperare i metadati pubblici del video e la trascrizione (se disponibile), quindi passare quel testo a ChatGPT.

Funziona quando:

- Il video ha sottotitoli caricati o auto-generati

- La tua analisi richiede solo il contenuto parlato, non informazioni visive

- Il video è pubblicamente accessibile (non privato, non non in elenco, non soggetto a restrizioni geografiche)

- Stai riassumendo lezioni, podcast o interviste in cui l’audio veicola la maggior parte del significato

Non funziona quando:

- Devi analizzare il contenuto visivo (dimostrazioni su schermo, diagrammi, espressioni facciali)

- Il video non ha trascrizione o sottotitoli

- Informazioni critiche appaiono visivamente senza essere menzionate nel dialogo

- Lavori con file video privati o contenuti dietro autenticazione

Errore comune: Gli sviluppatori si aspettano una comprensione completa del video (visivo + audio) ma ricevono solo un riassunto della trascrizione. Va bene per analisi del contenuto parlato. È inutile per rivedere demo di prodotto, analizzare design visivo o qualsiasi scenario in cui ciò che si vede conta più di ciò che si dice.

Lo schema: Metodo 2 per riepiloghi rapidi dove la precisione non importa. Metodo 1 per analisi controllata quando servono fotogrammi specifici. Metodo 3 per contenuti orientati all’audio dove l’informazione visiva è secondaria o assente. Scegli in base a dove si trova il segnale critico del tuo caso d’uso — nel movimento, in fotogrammi specifici o puramente nel dialogo.

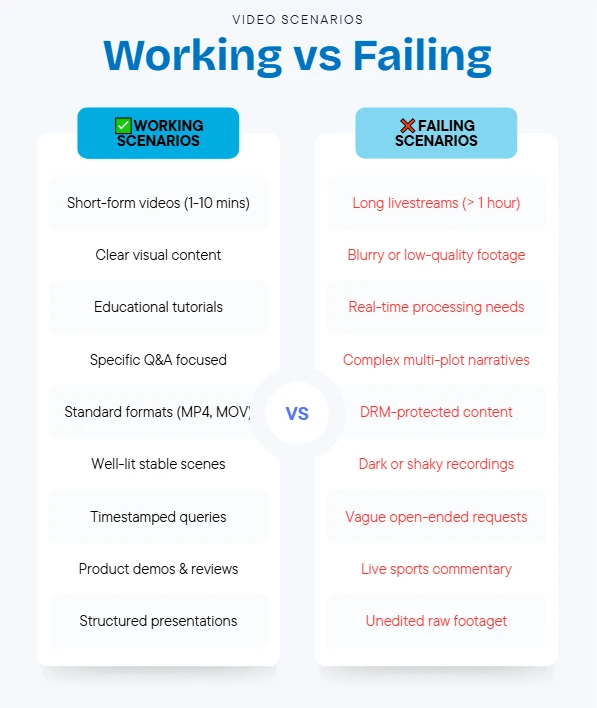

Scenari applicativi video di ChatGPT: cosa funziona davvero in produzione

Sapere che ChatGPT può elaborare componenti video non ti dice se è lo strumento giusto per il tuo problema. Questi scenari mostrano dove l’analisi basata su fotogrammi ha successo — e dove i vincoli architetturali la compromettono.

Scenario 1: Riassunto di contenuti educativi

Caso d’uso: Hai un video tutorial di 10 minuti e ti serve un riepilogo strutturato dei passaggi chiave, degli strumenti menzionati e degli esempi visivi mostrati.

Perché funziona: I video educativi hanno in genere confini di scena chiari, testo su schermo persistente e narrazione che si allinea ai visual. Il speaker descrive ciò che mostra mentre è visibile. ChatGPT può trascrivere la spiegazione, identificare strumenti o diagrammi nei fotogrammi campionati e combinare entrambi in un output strutturato.

Approccio di implementazione: Carica il video tramite interfaccia ChatGPT o estrai 8–12 keyframe alle principali transizioni di argomento. Prompt: “Elenca i passaggi principali spiegati in questo video, facendo riferimento sia alla narrazione sia a eventuali testi su schermo, diagrammi o nomi di strumenti che vedi.”

Dove fallisce: Video che dipendono dal movimento continuo — come uno screencast di codice in cui l’istruttore digita rapidamente su più file — avranno passaggi mancanti tra i fotogrammi. Servono frequenze di campionamento più alte o concentrarsi solo sulla trascrizione audio.

Suggerimento pratico: Per lezioni o tutorial, combina il caricamento automatico (per la trascrizione) con fotogrammi estratti manualmente dei 3–5 momenti visivi più importanti. Ottieni così copertura audio completa e immagini di alta qualità dei concetti chiave.

Scenario 2: Analisi di demo di prodotto

Caso d’uso: Stai esaminando la demo di un concorrente e vuoi estrarre elementi UI, nomi delle funzionalità, flussi utente e dettagli di pricing mostrati a schermo.

Perché funziona: Le demo di prodotto in genere mantengono ogni schermata abbastanza a lungo da far catturare l’UI statica dal campionamento dei fotogrammi. Sovraimpressioni testuali, etichette dei pulsanti, strutture dei menu e tabelle prezzi restano visibili su più fotogrammi. La capacità visiva di ChatGPT può leggere e descrivere questi elementi anche se non sono menzionati nella narrazione.

Approccio di implementazione: Estrai fotogrammi ai principali cambi scena (slide introduttiva, demo funzionalità 1, demo funzionalità 2, schermata prezzi, CTA). Carica quei fotogrammi e prompta: “Per ogni fotogramma, identifica tutti gli elementi UI visibili, le etichette dei pulsanti, i nomi delle funzionalità e qualsiasi informazione di prodotto o pricing visualizzata.”

Dove fallisce: Demo con transizioni rapide, stati hover che rivelano informazioni brevemente o elementi interattivi mostrati per solo 1–2 secondi non verranno catturati dal campionamento. Se il concorrente mostra velocemente una tabella comparativa, la perderai a meno che quel momento preciso non sia stato campionato.

Suggerimento pratico: Scorri manualmente il video per identificare i timestamp dei momenti importanti. Estrai i fotogrammi in quei momenti specifici invece di affidarti a intervalli di campionamento automatici.

Scenario 3: Trascrizione di riunioni o interviste con contesto visivo

Caso d’uso: Hai registrato una call con un cliente e ti serve sia la trascrizione sia annotazioni che indicano quando sono apparsi documenti, slide o condivisioni schermo.

Perché funziona: La trascrizione audio gestisce il dialogo parlato. Quando i partecipanti condividono lo schermo o mostrano documenti, questi appaiono nei fotogrammi campionati. ChatGPT può annotare “a circa [timestamp], un documento contrattuale era visibile a schermo” accanto alla trascrizione — utile per verbali che fanno riferimento a materiali visivi.

Approccio di implementazione: Carica il video e prompta: “Trascrivi questa riunione e annota i momenti in cui sono apparsi documenti, slide di presentazione, condivisioni schermo o altri riferimenti visivi. Per ogni elemento visivo, descrivi cosa è stato mostrato.”

Dove fallisce: Condivisioni schermo brevi (meno di 5–10 secondi) possono cadere tra i fotogrammi campionati. Testo troppo piccolo in fotogrammi compressi non sarà leggibile. Per casi legali o di compliance che richiedono accuratezza verbatim dei documenti visualizzati, verifica qualità e copertura del campionamento prima di fare affidamento sull’output.

Suggerimento pratico: Per riunioni importanti, registra ad alta risoluzione ed estrai manualmente fotogrammi nei momenti in cui qualcuno dice “vi mostro questo documento” — segnalando che sta per apparire un riferimento visivo.

Scenario 4: Moderazione dei contenuti o revisione di compliance

Caso d’uso: Devi esaminare video caricati dagli utenti alla ricerca di contenuti vietati — loghi specifici, pattern testuali o elementi visivi che violano le policy della piattaforma.

Perché funziona: ChatGPT può scansionare fotogrammi alla ricerca di testo visibile, oggetti riconoscibili o scene descritte. Se cerchi “questi video mostrano il logo di un concorrente?”, l’analisi per fotogrammi rileva loghi che persistono a schermo per più di uno o due secondi.

Approccio di implementazione: Estrai fotogrammi a intervalli regolari (ogni 3–5 secondi), caricali e prompta: “Esamina questi fotogrammi e individua quelli che contengono [logo specifico, nome brand, simbolo vietato, ecc.]. Per ogni corrispondenza, descrivi dove appare nel fotogramma.”

Dove fallisce: Violazioni basate sull’audio (musica protetta, discorsi vietati) richiedono analisi audio dedicate. Violazioni basate sul movimento (gesti vietati, azioni che si estendono su più fotogrammi) non saranno catturate dall’analisi di immagini fisse. Contenuti vietati lampeggiati brevemente potrebbero non comparire nei fotogrammi campionati.

Suggerimento pratico: Combina la scansione visiva di ChatGPT con servizi di fingerprinting audio e frequenze di campionamento più elevate per categorie ad alto rischio. Usa ChatGPT come filtro di primo livello, non come unico livello di moderazione.

Il pattern nei casi di successo: contenuti significativi esistono in fotogrammi discreti e stabili e correlano con elementi audio o testuali. I fallimenti avvengono quando l’informazione critica vive nel movimento, nel timing, nelle transizioni o appare troppo brevemente per essere campionata in modo affidabile.

Capacità video di Gemini vs. Claude vs. ChatGPT

Se l’architettura di campionamento dei fotogrammi di ChatGPT non si adatta al tuo caso d’uso, valuterai alternative. Gemini e Claude offrono diverse capacità legate ai video — e tali differenze determinano quale modello funziona per la tua implementazione.

Elaborazione video nativa di Gemini

I modelli Gemini supportano l’input video nativo a livello di API. Passi un file video direttamente senza pre-processing in fotogrammi. Il modello elabora il video come un flusso continuo, abilitando tracciamento del movimento, rilevamento dei cambi scena e ragionamento temporale che l’approccio basato su fotogrammi di ChatGPT non può gestire.

Caso d’uso in cui Gemini vince:

Devi rilevare quando un oggetto specifico entra ed esce dall’inquadratura in una clip di 30 secondi, o tracciare come una persona si muove in una scena. Gemini può seguire gli oggetti tra i fotogrammi e ragionare sul movimento. ChatGPT vedrebbe l’oggetto solo nei fotogrammi che capitano nel campionamento — rischiando di perdere ingresso o uscita.

Compromessi:

- L’API nativa di Gemini è più conveniente di quella di OpenAI basata sul campionamento dei fotogrammi. Evitando l’overhead lineare di token tramite caching del contesto, Gemini scala meglio per analisi long-form.

- L’elaborazione di video più lunghi comporta maggiore latenza — il modello deve acquisire l’intero file prima di rispondere

- Non tutte le varianti di Gemini supportano l’input video; richiede modelli Gemini più recenti

- Esistono limiti sulla lunghezza del video ma sono più generosi dei vincoli basati sul contesto di ChatGPT

Quando scegliere Gemini rispetto a ChatGPT:

- Il tuo caso d’uso richiede tracciamento del movimento, rilevamento dei confini di scena o comprensione delle relazioni temporali

- Informazioni critiche appaiono e scompaiono rapidamente tra i fotogrammi

- Stai analizzando video in cui la progressione degli eventi conta (riprese sportive, revisione di sorveglianza, analisi di animazioni)

- Vuoi evitare il pre-processing di estrazione fotogrammi

Limitazioni attuali di Claude per i video

A inizio 2026, i modelli Claude non supportano l’input video diretto via API. Puoi caricare immagini (inclusi fotogrammi estratti manualmente), ma non c’è una capacità nativa di elaborazione video paragonabile a Gemini.

Cosa può fare Claude:

- Analizzare sequenze di fotogrammi caricati, simile al metodo di estrazione manuale di ChatGPT (Metodo 2)

- Fornire descrizioni dettagliate del contenuto visivo in ciascun fotogramma

- Ragionare su movimento implicito o cambiamenti tra fotogrammi se richiesto esplicitamente

- Gestire sequenze di immagini più lunghe grazie a una finestra di contesto estesa (fino a 1M token in Claude Opus 4.7)

Cosa non può fare Claude:

- Accettare file video direttamente tramite qualsiasi interfaccia

- Tracciare automaticamente il movimento o oggetti tra fotogrammi senza prompting fotogramma per fotogramma

- Trascrivere audio — richiede pre-processing separato con Whisper o simili, quindi passare la trascrizione a Claude

Quando scegliere comunque Claude:

- Il tuo workflow include già l’estrazione dei fotogrammi come passaggio di pre-processing

- Stai analizzando video lunghi che richiedono molti fotogrammi e ti serve la finestra di contesto più ampia di Claude

- Stai confrontando la qualità dell’analisi visiva e trovi le descrizioni di Claude più accurate per il tuo dominio (es. imaging medico, diagrammi tecnici)

- Devi combinare l’analisi dei fotogrammi con grandi quantità di altre informazioni contestuali

Tabella di confronto delle capacità

| Funzionalità | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Upload diretto file video | ✓ (interfaccia web/app) | ✓ (API + interfaccia web) | ✗ |

| Tracciamento nativo del moto | ✗ | ✓ | ✗ |

| Trascrizione audio | ✓ (integrazione Whisper) | ✓ (integrata) | ✗ (richiede strumento esterno) |

| Analisi basata su fotogrammi | ✓ | ✓ (anche elaborazione continua) | ✓ (solo estrazione manuale) |

| Rilevamento dei cambi scena | ✗ (solo manuale) | ✓ (automatico) | ✗ |

| Gestione lunghezza video tipica | ~5–10 min (limitata dal contesto) | ~1 ora (dipende dalla risoluzione) | N/D (numero di fotogrammi limitato dal contesto) |

| Caso d’uso ideale | Riepiloghi rapidi, analisi a livello di fotogramma con un certo controllo | Tracciamento del moto, ragionamento temporale, video continuo | Descrizione fotogramma-per-fotogramma con grandi esigenze di contesto |

| Supporto video via API | ✗ (solo immagini) | ✓ | ✗ |

Quadro decisionale:

- Scegli ChatGPT quando: Ti servono riepiloghi video rapidi, l’informazione critica persiste su più fotogrammi, lavori con clip brevi (meno di 10 minuti) e non ti serve il tracciamento del movimento. Ideale per contenuti educativi, demo statiche di prodotto, trascrizioni di riunioni.

- Scegli Gemini quando: Il tuo caso richiede tracciamento del movimento, rilevamento dei cambi scena o ragionamento temporale su come gli elementi si muovono o cambiano nel tempo. Fondamentale per filmati di sorveglianza, analisi sportive, revisione di animazioni o qualsiasi scenario in cui “cosa accade tra i fotogrammi” conta.

- Scegli Claude quando: Stai già estraendo i fotogrammi nella tua pipeline, devi analizzare molti fotogrammi con ampio contesto aggiuntivo o trovi le descrizioni visive di Claude più accurate per il tuo dominio. Richiede più pre-processing ma offre la finestra di contesto più grande.

Per sviluppatori che lavorano con più modelli, CometAPI offre un’interfaccia unificata per testare la qualità dell’elaborazione video tra varianti GPT, Gemini e Claude senza riscrivere il codice d’integrazione — utile quando confronti la qualità dell’output prima di impegnarti con un provider specifico.

La vera risposta a “ChatGPT può guardare i video” non è binaria. È “sì, convertendo il video in formati che sa già gestire — con limitazioni che rompono casi d’uso specifici”. La maggior parte dei fallimenti di implementazione nasce da disallineamenti architetturali, non da lacune di capacità. Il modello funziona esattamente come progettato; gli sviluppatori si aspettavano un design diverso.

Se stai costruendo funzionalità di analisi video su larga scala, testa il tuo workflow con i casi limite prima: carica lo stesso video tramite file diretto, fotogrammi estratti manualmente e solo trascrizione. Confronta gli output. Il metodo che cattura il segnale critico del tuo caso d’uso — non quello più rapido da implementare — è quello che sopravvive al traffico di produzione.

Prima di scegliere ChatGPT per il video:

- Identifica se l’informazione critica vive in fotogrammi stabili, nel movimento o nell’audio

- Verifica la copertura del campionamento dei fotogrammi estraendoli manualmente agli intervalli previsti

- Assicurati che il testo su schermo sia leggibile alla risoluzione del tuo video dopo la compressione

- Conferma che la lunghezza del video rientri nei limiti pratici di contesto per il tuo livello di abbonamento

- Prevedi un fallback per contenuti che appaiono brevemente o tra i fotogrammi campionati

Per sviluppatori che valutano più provider di IA per carichi video, CometAPI offre un playground unificato per testare ChatGPT, Gemini e Claude con gli stessi input video — consentendo di confrontare qualità dell’output, latenza e costi prima di sviluppare integrazioni specifiche per provider.

FAQ - Guida all’analisi video con IA

Risposte rapide alle domande comuni sull’analisi video con IA.

ChatGPT può analizzare i video?

Sì, ChatGPT (GPT-4o e successivi) può analizzare i video campionando i fotogrammi (~1 al secondo) e trascrivendo l’audio. Funziona bene per riepiloghi di riunioni, estrazione di testo da slide e identificazione di oggetti. Tuttavia, ha difficoltà con il tracciamento del movimento, i video oltre i 10 minuti e lo streaming in tempo reale.

Come carico i video su ChatGPT?

Caricamento tramite URL diretto (Consigliato): Carica tramite un URL pubblico per un’analisi rapida. Ideale per video sotto i 10 minuti.

Estrazione manuale dei fotogrammi: Estrai fotogrammi specifici per un controllo preciso. Ideale quando devi analizzare momenti particolari o ridurre i costi in token.

Qual è la lunghezza massima di video che ChatGPT può gestire?

ChatGPT gestisce in modo affidabile video fino a 5–10 minuti. Oltre, dovrai segmentare il video o passare a Gemini 2.5 Pro, che supporta nativamente video fino a 60 minuti.

Quali sono le limitazioni dell’analisi video di ChatGPT?

- Non può tracciare movimento continuo (sport, danza)

- Timestamp imprecisi (precisione di ±1 secondo)

- Perde contenuti che appaiono per meno di 1 secondo

- Limite pratico di 10 minuti

- Nessun supporto per streaming in tempo reale

- Difficoltà con video di bassa qualità o scuri

- Debole nel ragionamento temporale causa-effetto *

Devo usare ChatGPT o Gemini per l’analisi video?

Usa ChatGPT per:

- Video sotto i 10 minuti

- Migliore capacità di ragionamento testuale dopo l’analisi video

- Analisi a livello di fotogramma (slide, screenshot)

Usa Gemini per:

- Video di 10–60 minuti

- Tracciamento del movimento e analisi del movimento

- Compiti di ragionamento temporale

- Riprese sportive, danza o sorveglianza *

Claude può analizzare i video?

No, Claude non supporta l’input video diretto. Tuttavia, puoi estrarre fotogrammi dai video e analizzarli con Claude, che offre capacità di ragionamento testuale e finestra di contesto superiori per analisi lunghe.

Quanto costa l’analisi video?

I costi variano in base al modello e alla lunghezza del video:

- ChatGPT 4o: ~$0,05 al minuto

- Gemini 2.5 Pro: ~$0,04 al minuto

CometAPI offre crediti per i nuovi utenti per iniziare.