Claude Opus 4.7, rilasciato il 16 aprile 2026, è un aggiornamento significativo rispetto a Opus 4.6 in ambito coding, workflow agentici, visione e aderenza alle istruzioni. Segna +6,8 pp su SWE-bench Verified (87,6% vs 80,8%), +10,9 pp su SWE-bench Pro (64,3% vs 53,4%), +12 pp su CursorBench (70% vs 58%), e offre una visione a risoluzione 3,3× superiore con cicli di auto-verifica che riducono le allucinazioni su attività lunghe. I prezzi restano ufficialmente identici ($5/$25 per milione di token), ma il livello di sforzo basso di 4.7 eguaglia la qualità del livello medio di 4.6, riducendo i costi reali.

Su CometAPI ottieni entrambi i modelli (Claude Opus 4.7 e Opus 4.6) a $4 input / $20 output con endpoint compatibili con OpenAI e zero vendor lock-in. Aggiorna se esegui agenti di coding in produzione, analisi di documenti complesse o workflow multi-sessione—4.7 è il nuovo default per lavori di frontiera.

Claude Opus 4.7 vs Opus 4.6: Confronto rapido

In sintesi: Opus 4.7 sembra “Opus 4.6 ma non limitato e raffinato.” Rimuove limitazioni che occasionalmente comparivano in 4.6 (ad es., abbandono prematuro dei task, minore acutezza visiva) aggiungendo efficienza tramite ragionamento adattivo. Gli utenti riferiscono che è più “opinionato” e collaborativo—come lavorare con un ingegnere senior che ricontrolla il proprio lavoro.

Perché Claude Opus 4.7 è importante nel 2026

Il 16 aprile 2026, Anthropic ha rilasciato in sordina il suo modello più capace generalmente disponibile: Claude Opus 4.7. A poche settimane dall’anteprima ristretta Mythos (una potenza focalizzata sul cyber), Opus 4.7 riconquista la corona per i carichi di lavoro in produzione mantenendo esattamente lo stesso prezzo di Opus 4.6.

Sviluppatori e imprese non devono più sorvegliare i task di coding più difficili. Gli utenti riferiscono di affidare con fiducia a 4.7 “quelli che prima richiedevano stretta supervisione”. Il modello ora auto-verifica gli output, segue le istruzioni alla lettera e sostiene esecuzioni agentiche di più ore con meno errori di tool e migliore recupero degli errori.

Il modello eccelle in:

- Task rigorosi e di lunga durata con auto-verifica integrata (Plan → Execute → Verify → Report).

- Aderenza letterale alle istruzioni—niente più interpretazioni lasche di “considera” o “potresti”.

- Visione sostanzialmente migliore (fino a 2.576 px sul lato lungo ≈ 3,75 MP, oltre 3× la precedente risoluzione).

- Maggiore gusto e creatività in output professionali come interfacce, slide e documenti.

- Memoria del file system migliorata per una vera autonomia multi-sessione.

Le nuove funzionalità includono un livello di sforzo xhigh (tra high e max), budget di task sulla Platform API e integrazione con lo strumento Claude Design. L’ID del modello è ora claude-opus-4-7. Il prezzo è invariato ufficialmente, ma i miglioramenti di efficienza sui token spesso riducono il costo effettivo per task.

Miglioramenti delle capacità principali – Cosa è cambiato davvero

Ingegneria del software avanzata e coding agentico

Opus 4.7 brilla sui problemi più difficili. Su un benchmark interno di coding con 93 task, ha ottenuto un +13% di risoluzione rispetto a 4.6, risolvendo quattro task che né 4.6 né Sonnet 4.6 riuscivano a sbloccare. Rakuten-SWE-Bench ha mostrato 3× più task di livello production risolti senza intervento umano. CursorBench (workflow reali in IDE) è salito +12 punti fino al 70%.

Il benchmark interno da 93 task ha mostrato un incremento del 13%, risolvendo quattro task che né 4.6 né Sonnet 4.6 riuscivano a sbloccare. Nei workflow agentici, Box ha riportato 2× meno chiamate LLM (7,1 vs 16,3) e un 30% in meno di utilizzo di AI unit per lo stesso output—traducendosi direttamente in vantaggi di costo e latenza.

Perché conta per gli sviluppatori: Ora puoi affidare a Opus 4.7 “il lavoro di coding più difficile” che in precedenza necessitava supervisione. Presta attenzione precisa alle istruzioni, verifica i propri output e riutilizza la memoria del file system tra le sessioni—perfetto per refactoring autonomi nell’arco di giorni.

Risultati reali includono:

- Motore di text-to-speech in Rust autonomo da un singolo prompt.

- Correzione di race condition e bug di concorrenza che bloccavano i modelli precedenti su Terminal-Bench 2.0 (+4,0 pp).

- Aumento del 10–15% nel successo dei task di Factory Droids con ⅓ di errori di tool in meno.

- Miglioramenti a doppia cifra in qualità del codice, qualità dei test e accuratezza delle revisioni (CodeRabbit, Qodo).

Il livello di sforzo basso di 4.7 ora corrisponde alla qualità del livello medio di 4.6, quindi ottieni di più con lo stesso (o inferiore) consumo di token.

Visione e salto multimodale

Questo è il più grande singolo upgrade. La risoluzione massima delle immagini passa da 1,15 MP (1.568 px) a 3,75 MP (2.576 px sul lato lungo) — un incremento di pixel di 3,3× con mappatura delle coordinate 1:1. Niente più calcoli di fattori di scala per screenshot o diagrammi.

Risultati:

- Benchmark di acutezza visiva: 98,5% vs 54,5% su 4.6.

- CharXiv-R (senza strumenti): +13,4 pp; con strumenti: +13,6 pp.

- Sblocca agenti di uso del computer pixel-perfect, analisi densa di screenshot, parsing di strutture chimiche e revisione di UI/UX.

Workflow agentici, affidabilità e aderenza alle istruzioni

Opus 4.7 introduce la auto-verifica nativa—il modello pianifica, esegue, verifica e poi riporta. Questo riduce drasticamente risposte sicure ma errate su task a lungo orizzonte. I miglioramenti alla memoria del file system abilitano una vera autonomia multi-day.

L’aderenza alle istruzioni è più rigida e letterale. I prompt ottimizzati per lo stile più lasco di 4.6 potrebbero necessitare di revisione—frasi come “considera” sono ora trattate come requisiti stringenti. È una caratteristica per lavori critici in precisione ma richiede migrazione dei prompt.

Nota sulle regressioni: Il long-context needle retrieval (MRCR) è calato in modo significativo (ad es., 91,9% → 59,2% a 256K). Anthropic nota che sta abbandonando tali test sintetici a favore di metriche GraphWalks applicate, dove la comprensione del codice reale resta solida.

Nuovo livello di sforzo xhigh + budget di task

Opus 4.7 aggiunge xhigh tra high e max per un controllo granulare. Claude Code ora predefinisce xhigh in tutti i piani. Il nuovo task_budget (public beta) consente al modello di tracciare i token totali lungo l’intero loop agentico e terminare in modo ordinato.

Aderenza alle istruzioni, auto-verifica e memoria

Opus 4.7 interpreta i prompt in modo più letterale—ottimo per la precisione, ma i vecchi prompt vaghi potrebbero dover essere affinati. Ora definisce propri passaggi di verifica (Plan → Execute → Verify → Report) e riutilizza molto meglio la memoria del file system tra sessioni rispetto a 4.6. Per i team che costruiscono agenti persistenti, questo è uno degli upgrade più utili perché riduce ri-spiegazioni, ri-caricamenti e ri-pianificazioni.

Aggiornamento del tokenizer

Il nuovo tokenizer migliora la qualità ma può consumare 1,0–1,35× più token (fino a +35%). L’endpoint di conteggio token ora restituisce numeri diversi. Effetto netto: qualità per task più alta spesso compensa l’aumento, soprattutto a livelli di sforzo più bassi.

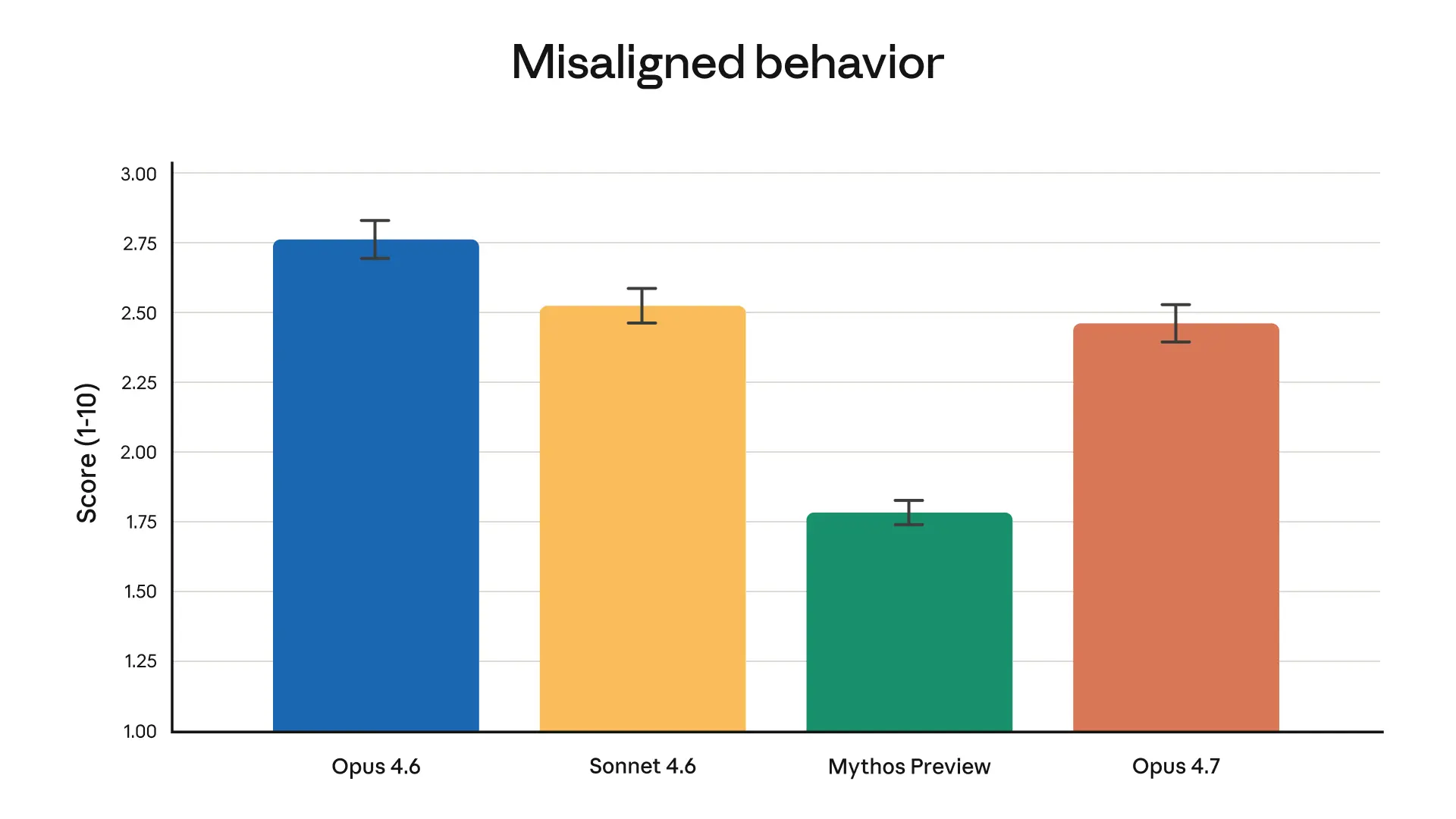

Sicurezza, allineamento e cybersecurity

Il profilo di sicurezza è simile a 4.6 (basso disallineamento), con miglioramenti modesti in onestà e resistenza alla prompt-injection.

Opus 4.7 include le salvaguardie di Project Glasswing: blocco in tempo reale di usi cyber vietati/ad alto rischio. Il punteggio CyberGym volutamente stabile. Comportamenti disallineati modestamente migliorati rispetto a 4.6. Scheda di sistema completa disponibile sul sito di Anthropic.

Prezzi, efficienza dei token e risparmi con CometAPI

Il prezzo ufficiale è identico, ma il costo effettivo per task scende perché 4.7 a basso sforzo ≈ qualità 4.6 a sforzo medio, e tassi di successo più alti significano meno retry. Il nuovo tokenizer aumenta i token in input dello 0–35% per lo stesso testo, ma l’uso netto è spesso favorevole a qualità equivalente.

Vantaggio CometAPI: Accesso a entrambi i modelli a $4 input / $20 output per milione di token—20% più economico dell’ufficiale—più switching senza soluzione di continuità tra oltre 500 modelli (GPT-5.4, Gemini 3.1, ecc.) tramite un singolo endpoint compatibile con OpenAI o Anthropic Messages. Nessun downtime se i provider cambiano prezzi. Zero vendor lock-in. Playground per test e fatturazione unificata rendono la migrazione senza sforzo.

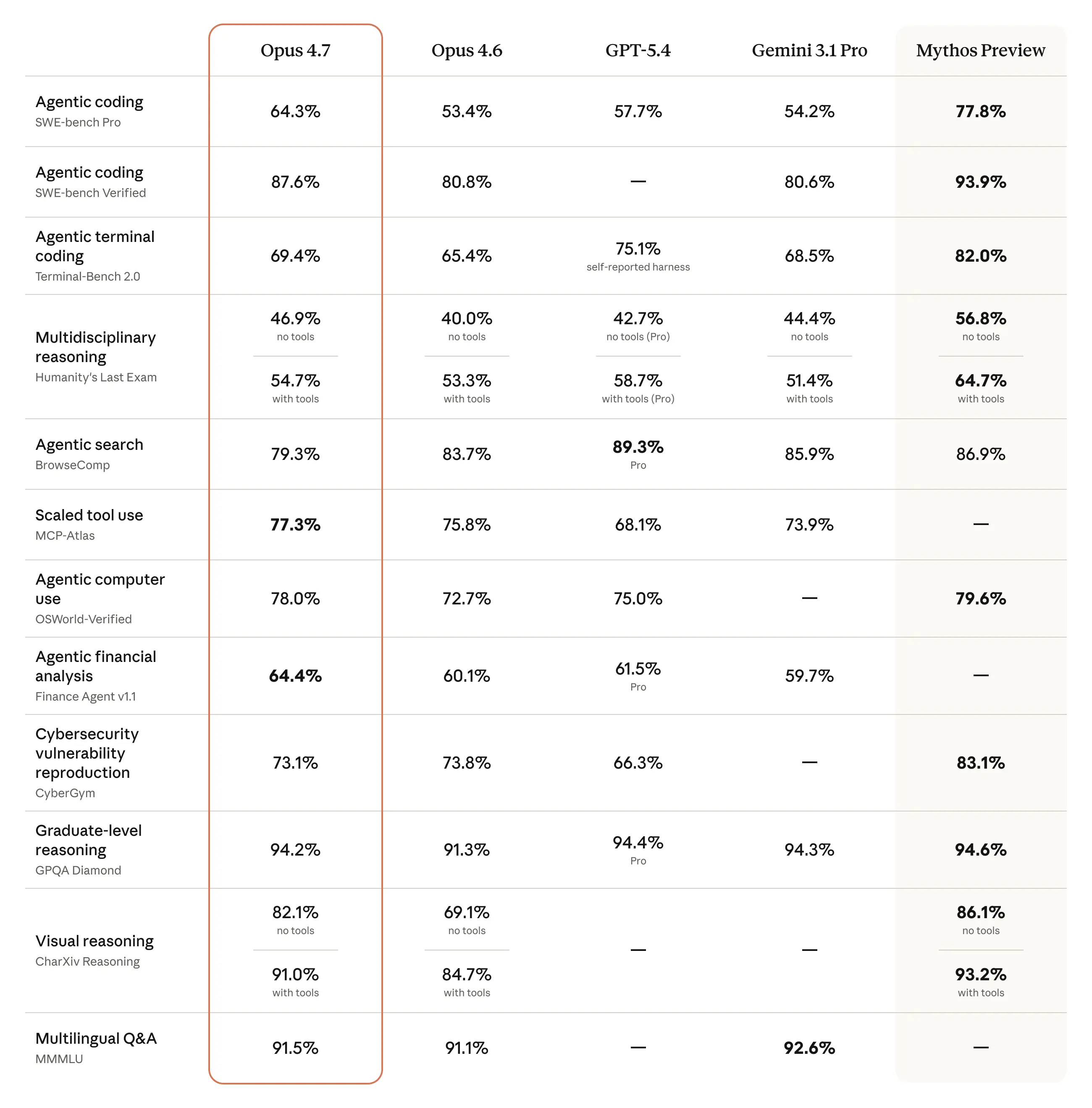

Approfondimento benchmark side-by-side

Ecco il confronto completo su 14 benchmark dai dati di lancio di Anthropic (verificati dai partner):

Benchmark di coding

- SWE-bench Verified: 80,8% → 87,6% (+6,8 pp)

- SWE-bench Pro: 53,4% → 64,3% (+10,9 pp)

- Terminal-Bench 2.0: 65,4% → 69,4% (+4,0 pp)

Agentic & tool-use

- MCP-Atlas: 62,7% → 77,3% (+14,6 pp) — il salto singolo più grande

- OSWorld-Verified: 72,7% → 78,0% (+5,3 pp)

- Finance Agent: 60,7% → 64,4% (+3,7 pp)

Ragionamento e conoscenza

- GPQA Diamond: 91,3% → 94,2% (+2,9 pp)

- HLE (no tools): 40,0% → 46,9% (+6,9 pp)

- MMMLU: 91,1% → 91,5% (+0,4 pp)

Visione

- CharXiv-R (no tools): 68,7% → 82,1% (+13,4 pp)

- CharXiv-R (tools): 77,4% → 91,0% (+13,6 pp)

Regressioni (trasparenti)

- BrowseComp: 84,0% → 79,3% (–4,7 pp) — sensibile all’harness

- CyberGym: 73,8% → 73,1% (–0,7 pp) — intenzionale per la sicurezza

Internal Research-Agent Benchmark: 0,715 complessivo (punteggio massimo a pari merito), con il modulo Finance che sale da 0,767 a 0,813.

Prestazioni reali e casi d’uso

I test dei workflow agentici di Box hanno mostrato che Opus 4.7 completa i task con 7,1 chiamate LLM vs 16,3 per 4.6 (2,3× in meno) e un 30% di AI Unit in meno. Latenza mediana scesa da 242 s a 183 s.

Partner enterprise (Harvey, Databricks, Hebbia, Ramp, Genspark) riportano:

- 21% di errori in meno nel ragionamento sui documenti.

- Miglior coordinamento multi-agente per ore.

- Integrazione più stretta di slide, fogli di calcolo e codice.

Chi dovrebbe aggiornare subito?

- Team di ingegneria del software che usano Cursor/Claude Code.

- Costruttori di agenti AI che necessitano autonomia affidabile su lunghe durate.

- Workflow ad alta componente visiva (screenshot, diagrammi, revisione UI).

- Automazione in finanza, legale e knowledge work.

Modifiche API, guida alla migrazione ed esempi di codice

Breaking Changes (Messages API)

- Extended thinking budgets rimossi → usa

thinking: {"type": "adaptive"}. - Sampling params (

temperature, ecc.) non più accettati → usa il prompting. - Thinking content omesso per default.

- Il nuovo tokenizer richiede margine in

max_tokens.

Guida alla migrazione + esempi di codice (CometAPI)

Step 1: Aggiorna il nome modello a claude-opus-4-7 (o alias CometAPI).

Step 2: Verifica i prompt per interpretazione letterale.

Step 3: Prova i livelli di sforzo (inizia con xhigh per il coding).

Step 4: Usa i task budget per limitare la spesa.

Ecco un esempio Python pronto all’uso che utilizza l’endpoint compatibile Anthropic di CometAPI (funziona anche con l’SDK ufficiale):

(Python)

import anthropic

import os

client = anthropic.Anthropic(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI sk- key

base_url="https://www.cometapi.com/console/" # CometAPI base

)

message = client.messages.create(

model="claude-opus-4-7", # or "claude-opus-4-6" for comparison

max_tokens=4096,

temperature=0.7,

effort="xhigh", # New level for deep reasoning

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Refactor this legacy Python module into clean, type-hinted, testable code. Follow instructions literally: use Pydantic v2, add comprehensive tests, no external deps beyond stdlib + pydantic. Verify your changes before responding."},

{"type": "image", "source": {"type": "base64", "media_type": "image/png", "data": "iVBORw0KGgoAAAANSUhEUg..."} } # High-res screenshot support

]

}

]

)

print(message.content[0].text)

Prompt demo di auto-verifica (funziona molto meglio su 4.7):

(testo):

Plan → Execute → Verify → Report:

1. Analyze the attached codebase.

2. Propose refactors.

3. Implement changes in a new file.

4. Run mental unit tests and edge cases.

5. Only output final verified code if all checks pass.

Esegui test A/B sui tuoi carichi reali—la maggior parte dei team vede il 20–40% di iterazioni in meno.

Note:

Primo, il nuovo tokenizer genera più token dallo stesso testo. Opus 4.7 ha introdotto un nuovo tokenizer, migliorando come il modello elabora il testo. Il compromesso è che lo stesso input mappa a più token; il numero esatto dipende dal tipo di contenuto, ma è approssimativamente tra 1,0 e 1,35 volte.

Secondo, livelli di sforzo più elevati consentono un’analisi più completa, soprattutto in scenari agentici multi-turn.

Questo porta a una migliore affidabilità, ma anche a più token in output.

La soluzione ufficiale fornisce tre approcci:

- Regolare il livello di sforzo usando il parametro

efficiency - Limitare il budget usando i task budget

- Dire al modello di “essere più conciso” nel prompt.

Limitazioni note e note di migrazione

- Extended thinking budgets rimossi → usa

thinking: {"type": "adaptive"}.thinking: {type: "enabled", budget_tokens: N}non è più supportato; usa invece il thinking adattivo. - Sampling params (

temperature, ecc.) non più accettati → usa il prompting.temperature,top_petop_kdevono essere rimossi dalle richieste quando migri a Opus 4.7. - Il modello è descritto come più letterale e diretto rispetto a Opus 4.6, utile per la precisione ma potrebbe richiedere prompt più nitidi.

- Il nuovo tokenizer richiede margine in

max_tokens. Anthropic raccomanda di ricontrollare il marginemax_tokensperché Opus 4.7 può produrre conteggi di token più alti per lo stesso testo. - Thinking content omesso per default.

Verdetto finale e raccomandazione

Claude Opus 4.7 è il chiaro vincitore per qualsiasi carico di lavoro serio di coding, agentico o visivo nel 2026. I guadagni non sono incrementali—sono trasformativi per la produzione. Se usi Opus 4.6, migra questa settimana. La combinazione di qualità più alta, meno chiamate e prezzi identici (o inferiori via CometAPI) lo rende una scelta ovvia.

Prossimi passi:

- Prova 4.7 nel playground di CometAPI con i tuoi carichi reali.

- Aggiorna prima un servizio (Cursor o il tuo framework di agenti).

- Monitora l’uso dei token per la prima settimana.

- Scala con fiducia sapendo di avere accesso unificato e più economico a oltre 500 modelli.