DeepSeek ha presentato ufficialmente V4 come una famiglia di modelli open source, e la notizia non è semplicemente “un altro aggiornamento del modello”. L’azienda posiziona V4 come un sistema a lungo contesto, adatto agli agenti e pensato per carichi reali: analisi pesanti su documenti, assistenti di coding, agent di ricerca e automazione multi-step. Il rilascio è disponibile su web, app e API, e la linea V4 introduce una conveniente finestra di contesto da 1M token attraverso i suoi servizi ufficiali.

Ciò che rende questo lancio particolarmente degno di nota è la combinazione di scala ed efficienza. DeepSeek afferma che V4-Pro ha 1,6T parametri totali con 49B attivi, mentre V4-Flash ha 284B parametri totali con 13B attivi. Nel report tecnico, DeepSeek dichiara inoltre che l’architettura V4 usa attenzione ibrida, instradamento MoE e post-training progettati per migliorare il comportamento agentico riducendo al contempo l’onere computazionale del contesto ultra-lungo.

Che cos’è DeepSeek V4?

DeepSeek-V4 è l’ultima famiglia di punta in anteprima dell’azienda, e il rilascio include due varianti pubbliche: V4-Pro e V4-Flash. DeepSeek descrive V4-Pro come il modello più forte per conoscenza del mondo, matematica, STEM, coding e coding agentico, mentre V4-Flash è l’opzione più reattiva ed economica che mantiene gran parte della qualità di ragionamento e la capacità di lungo contesto. V4-Pro guida i modelli open attuali nel coding agentico e nella conoscenza del mondo, mentre V4-Flash è progettato per velocità e distribuzione economica.

V4 utilizza un’architettura di attenzione ibrida che combina Compressed Sparse Attention (CSA) e Heavily Compressed Attention (HCA), oltre a Manifold-Constrained Hyper-Connections e all’ottimizzatore Muon. L’azienda afferma anche che i modelli sono stati pre-addestrati su oltre 32T token e che, su contesto da 1M, V4-Pro richiede solo il 27% dei FLOPs di inferenza per token singolo e il 10% della KV cache rispetto a DeepSeek-V3.2. Questa efficienza è il vero titolo del rilascio.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro è il modello di punta per gli utenti che danno priorità alla qualità. DeepSeek-V4-Pro offre prestazioni superiori nel coding agentico, una conoscenza del mondo più ricca e un ragionamento di livello mondiale, e guida i modelli open attuali rimanendo dietro solo a Gemini-3.1-Pro per la conoscenza del mondo secondo la pagina di lancio. Nel report tecnico, V4-Pro è il modello più grande della famiglia ed è disponibile tramite le stesse interfacce compatibili con OpenAI e Anthropic di V4-Flash.

DeepSeek-V4-Flash

V4-Flash è il modello orientato all’efficienza: le sue capacità di ragionamento si avvicinano a quelle di V4-Pro, e ottiene prestazioni alla pari con V4-Pro sui task agent semplici, pur utilizzando un numero di parametri attivi inferiore e tempi di risposta più rapidi. Supporta sia le modalità thinking sia non-thinking, con la stessa lunghezza di contesto da 1M e le stesse funzionalità di base del Pro, ma a un costo molto più basso.

Quale scegliere?

Usa V4-Pro quando il compito è ad alto impatto, ricco di conoscenza o difficile da verificare: ricerca enterprise, coding complesso, supporto decisionale multi-step o attività in cui desideri la risposta più solida possibile. Usa V4-Flash quando throughput, latenza o costo dei token contano più che spremere gli ultimi punti di performance nei benchmark. Questa scelta è coerente con il posizionamento ufficiale e con i gap riportati nei benchmark tra i due modelli.

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | Non-think + think | Non-think + think |

| Best fit | Inferenza rapida, app ad alto throughput, agent sensibili al costo | Ragionamento alla massima capacità, coding e compiti di conoscenza più difficili |

| Official API pricing | Cache hit $0.028 / cache miss $0.14 / output $0.28 per 1M tokens | Cache hit $0.145 / cache miss $1.74 / output $3.48 per 1M tokens |

| Max output | 384K | 384K |

CometAPI offre accesso a Deepseek v4 Pro e V4 Flash, —20% più economico rispetto all’ufficiale— oltre a uno switching senza attriti tra oltre 500 modelli (GPT-5.4, Gemini 3.1, ecc.) tramite un singolo endpoint compatibile con OpenAI o Anthropic Messages.

Benchmark delle prestazioni

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

Nella tabella di confronto dei modelli base, V4-Flash e V4-Pro superano entrambi DeepSeek-V3.2 sui benchmark principali, con V4-Pro generalmente in testa. Ad esempio, il report elenca i seguenti punteggi: AGIEval 82,6 / 83,1 vs 80,1 di V3.2; MMLU 88,7 / 90,1 vs 87,8; MMLU-Pro 68,3 / 73,5 vs 65,5; HumanEval 69,5 / 76,8 vs 62,8; e LongBench-V2 44,7 / 51,5 vs 40,2 per V3.2, dove il numero centrale è V4-Flash e l’ultimo è V4-Pro.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Fonte: Report tecnico DeepSeek-V4, Tabella 1.

Il pattern è semplice: Flash riduce il divario con Pro, ma Pro resta il modello generale più forte. Questo rende V4-Flash la scelta pratica per molti sistemi in produzione, mentre V4-Pro è il modello a cui ricorrere quando la qualità della risposta è più importante di costo o latenza.

Confronti con modelli occidentali: dove si colloca V4

In una valutazione umana su compiti da impiegato in cinese, il report afferma che DeepSeek-V4-Pro-Max ha superato Claude Opus 4.6-Max, con un tasso di non-perdita del 63%. DeepSeek-V4-Pro “supera significativamente” Claude Sonnet 4.5 e si avvicina a Claude Opus 4.5 in un benchmark di coding R&D.

| Area di valutazione | Risultato DeepSeek | Confronto con modelli occidentali | Cosa suggerisce |

|---|---|---|---|

| Compiti white-collar cinesi | V4-Pro-Max, tasso di non-perdita 63% | vs Claude Opus 4.6-Max | Ottima prova in compiti pratici in ambito business |

| Benchmark di coding R&D | V4-Pro-Max tasso di superamento 67 | vs Claude Sonnet 4.5 a 47; Opus 4.5 a 70; Opus 4.6 Thinking a 80 | Competitivo con i modelli di frontiera leader, soprattutto rispetto ai sistemi di livello Sonnet |

Non è “il numero uno in ogni aspetto”, ma è già a un livello che “va valutato seriamente”.

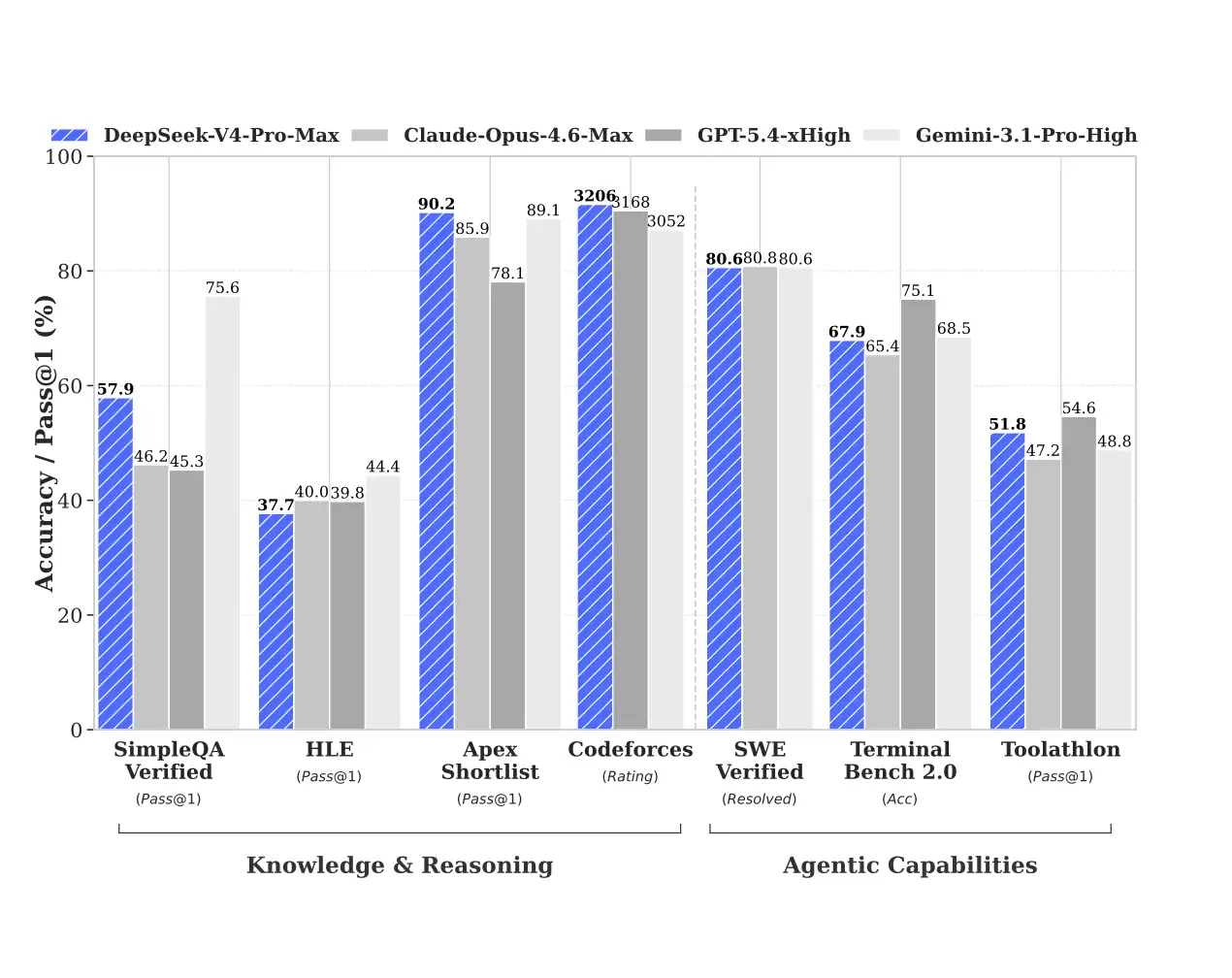

Il report tecnico di DeepSeek confronta V4-Pro-Max con Claude Opus 4.6 Max, GPT-5.4 xHigh e Gemini 3.1 Pro High nella stessa tabella. I risultati non sono semplicistici: i modelli occidentali closed-source restano molto forti in alcuni aspetti di conoscenza e inferenza; tuttavia, V4-Pro-Max ha una presenza molto forte nel codice, nei contesti lunghi e in alcuni task da agente. In altre parole, non è più una narrativa unidimensionale di “alternative domestiche”, ma si è passati alla fase del “quale è più adatto al tuo scenario”.

In termini di conoscenza e capacità di ragionamento, è alla pari con Opus 4.6 Max, GPT-5.4 xHigh e Gemini 3.1 Pro High. Tuttavia, è leggermente indietro nelle capacità agentiche, anche se la differenza non è significativa.

DeepSeek-V4-Pro-Max è altamente competitivo negli scenari orientati al codice e a lungo contesto, mentre i modelli occidentali restano estremamente forti in diversi benchmark di puro ragionamento e conoscenza. È così che va letto il rilascio: DeepSeek V4 è saldamente nella conversazione di frontiera, ma la leadership nei benchmark dipende dal task.

Come accedere a DeepSeek V4

1) Usa il web e l’app ufficiali

DeepSeek afferma che V4 Preview è disponibile subito su web, app e API. Per gli utenti normali, il percorso più semplice resta l’interfaccia chat ufficiale, dove il modello è accessibile tramite Expert Mode o Instant Mode.

2) Usa le API

Consiglio vivamente CometAPI per accedere a deepseek V4, perché offre il miglior prezzo e vantaggi di aggregazione.

I nomi dei modelli sono:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek afferma anche che i nomi legacy

deepseek-chatedeepseek-reasonersaranno deprecati e attualmente mappano alle modalità non-thinking e thinking di V4-Flash fino al 2026-07-24. Questo è importante per la pianificazione della migrazione se hai già integrazioni più vecchie in produzione.

- Registrati su CometAPI e ottieni la tua chiave API.

- Usa l’SDK Python standard di OpenAI (o qualsiasi client compatibile) con un base URL personalizzato:

Ecco un esempio pulito usando il formato compatibile con OpenAI ufficiale:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "Sei un assistente disponibile."},

{"role": "user", "content": "Riassumi i vantaggi del contesto da un milione di token."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Questo schema di richiesta segue le linee guida del quick-start: imposta l’URL di base, scegli deepseek-v4-pro o deepseek-v4-flash e abilita il thinking quando serve un ragionamento più profondo.

Come usare DeepSeek V4 in modo efficace

Per i workflow su documenti lunghi, il pattern più solido è mantenere il contesto pulito e strutturato. La finestra da 1M token di V4 è un grande vantaggio, ma il modello funziona ancora meglio quando l’input è organizzato in sezioni, estratti di sorgente, istruzioni di task e vincoli espliciti di output. È il modo più naturale per sfruttare la capacità di lungo contesto che DeepSeek sta evidenziando.

Per i workflow di codice e agent, parti con V4-Flash per iterazioni rapide, quindi passa a V4-Pro per l’esecuzione finale o i passaggi più difficili. Questo approccio è in linea con il posizionamento ufficiale: Flash è l’opzione efficiente, Pro è il modello più forte, e entrambi condividono la stessa superficie API e la stessa lunghezza di contesto.

Considerazione finale

DeepSeek-V4 è notevole perché combina quattro elementi richiesti dal mercato nello stesso momento: lungo contesto, forte ragionamento, disponibilità open e prezzi aggressivi. La storia vera non è solo che DeepSeek ha rilasciato un altro modello. È che l’azienda sta cercando di rendere l’AI di frontiera economicamente utilizzabile in produzione. Per i team che valutano dove puntare la prossima scommessa sull’AI, è un segnale da testare, non da ignorare.

Per i team che costruiscono su più provider, questo è esattamente il tipo di rilascio da benchmarkare nel proprio stack. CometAPI può essere lo strato pratico per confrontare DeepSeek-V4 accanto ad altri modelli di frontiera senza costringere il team di prodotto a ricostruire l’integrazione ogni volta che il mercato cambia.