TL;DR: L’ultima release di OpenClaw aggiunge supporto di prima classe, forward-compatible, per GPT-5.4 di OpenAI e introduce un’architettura “memory hot-swappable” che consente agli agent di OpenClaw di cambiare a runtime quale modello e quale archivio di memoria siano attivi con un’interruzione minima. Questo sblocca workflow a contesto esteso (le finestre di contesto ampliate di GPT-5.4), specializzazione del modello al volo e ottimizzazioni di costo/latenza per agent in produzione. L’upgrade è disponibile nelle release di OpenClaw e nella documentazione di accompagnamento; gli esempi qui sotto mostrano configurazioni pratiche, snippet di codice, contesto dei benchmark e best practice consigliate.

Cosa ha effettivamente rilasciato OpenClaw (riassunto rapido)

Il 9 marzo 2026, il progetto open-source di framework per agent, adiacente a OpenAI, OpenClaw ha rilasciato una major core release (2026.3.7) che aggiunge supporto di prima classe per GPT-5.4 e un meccanismo innovativo di memory hot-swappable nel suo motore di contesto. Questa release trasforma un framework sperimentale per agent ampiamente usato in quello che i maintainer descrivono come un “Sistema Operativo per Agent” — con l’obiettivo di rendere fluide per sviluppatori e team le pipeline di agent di livello produttivo e il model switching.

3 elementi pratici importanti per chi costruisce agent:

- Supporto di prima classe a GPT-5.4 — alias di modello e mapping del provider che consentono agli agent di selezionare GPT-5.4 come modello di esecuzione primario (inclusi override per canale e pin del modello per singolo agent).

- Context Engine & binding distribuito dei canali — miglioramenti nel modo in cui OpenClaw assembla finestre di contesto lunghe da memoria, output degli strumenti e cronologia dei canali, così che i modelli ad alta capacità ricevano input ben strutturati.

- Architettura di memoria hot-swappable — interfacce dei plugin di memoria e workflow più chiari, così puoi sostituire backend di memoria o aggiornare gli agent senza perdere “identità” o corrompere lo stato persistito (la memoria stessa resta la fonte di verità). Il design della memoria di OpenClaw (file Markdown in chiaro, ricerca indicizzata, retrieval pluginizzato) è ciò che abilita l’hot swapping in sicurezza.

GPT-5.4 — Cos’è GPT-5.4 e quali benchmark sblocca

GPT-5.4 è l’ultimo modello frontier di OpenAI, focalizzato fortemente sulla produttività professionale (fogli di calcolo, editing di documenti e presentazioni, ragionamento multi-step e controllo di tool). Secondo OpenAI e la stampa indipendente, la release enfatizza:

- Contesto ampliato: GPT-5.4 introduce il livello successivo di finestre di contesto, con 1M token sperimentale e gestione migliorata del long-context disponibile tramite endpoint Codex/compatibili con Codex — per gli sviluppatori sono esposte manopole di configurazione come

model_context_windowemodel_auto_compact_token_limit. Questo consente di mantenere in contesto attivo stati conversazionali, documenti e codebase molto più grandi. - Maggiore accuratezza su fogli di calcolo e ragionamento — OpenAI riporta un miglioramento sostanziale sui task di modellazione in spreadsheet (punteggi medi ~87% vs ~68% per GPT-5.2 sul loro benchmark bancario/analista).

- Miglioramenti di accuratezza e factualità: prime recensioni e QA mostrano una riduzione ~33% delle allucinazioni e una minore tendenza all’errore rispetto a GPT-5.2, con progressi notevoli nella stesura di documenti e nel lavoro su spreadsheet. I revisori hanno anche citato una riduzione ~18% delle risposte inclini all’errore su alcuni task di produttività.

- Uso del computer integrato e progressi della linea Codex — GPT-5.4 incorpora capacità ereditate dalla linea Codex che migliorano generazione di codice, debugging interattivo e controllo operativo degli strumenti (automazione mouse/tastiera/screenshot in alcune dimostrazioni). Ciò lo rende migliore nel ciclo scrivi-esegui-ispeziona-correggi tipico dei loop degli agent.

Benchmark & contesto comparativo (cosa significano i numeri)

- Modellazione su spreadsheet: benchmark interno di OpenAI sui fogli di calcolo: ~87.3% punteggio medio per GPT-5.4 vs ~68.4% per GPT-5.2. È il titolo che il vendor usa per mostrare i guadagni specifici per task.

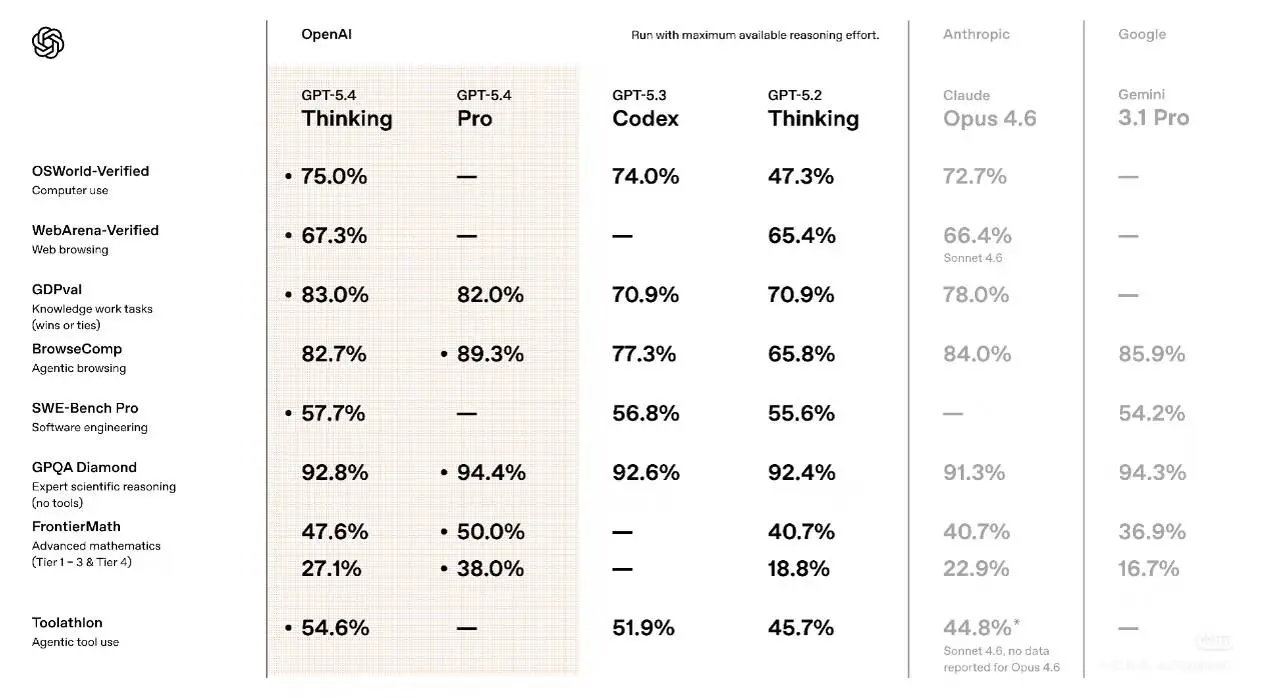

- Interazione con il computer (OSWorld / test in stile agent): tester indipendenti e run della community mostrano che GPT-5.4 migliora nei task di interazione agent che implicano manipolazione di desktop o UI simulate, talvolta superando di poco varianti recenti dei modelli Anthropic in questi suite di task (differenze significative per gli agent, ma non necessariamente decisive in ogni workload).

Interpretazione: GPT-5.4 non è una “bacchetta magica” che vince ovunque. Ha punti di forza chiari nell’uso integrato degli strumenti, nell’esecuzione del codice e nel ragionamento su spreadsheet — esattamente i workload tipici degli agent OpenClaw. Per i costruttori di agent, la combinazione di maggiore affidabilità come esecutore (linea Codex) + competenza come planner + migliore gestione del long-context è altamente rilevante.

OpenClaw supporta GPT-5.4: cosa è cambiato e perché conta

La release di OpenClaw (vedi la pagina delle release del progetto) aggiorna i resolver dei modelli e il runtime per essere forward-compatible con il contesto ampliato e i limiti di token di GPT-5.4 e aggiunge la capacità “memory hot-swappable” così che gli agent possano cambiare backend di memoria o modelli a runtime. Questo è realizzato in tre modi concreti: 1) aggiornamenti ai metadata dei modelli e ai resolver per accettare i limiti più ampi di contesto e token; 2) modifiche al runtime degli agent per orchestrare swap di modelli graduali e warm-up della cache; 3) un’API di memoria che consente più canali di memoria e trigger per lo switch a caldo.

Il supporto alla versione 2026.3.7 per GPT-5.4 insieme a un design memory hot-swappable offre due vantaggi pratici e complementari:

- Percorso di upgrade del modello semplice. OpenClaw può ora presentare GPT-5.4 come “runtime” selezionabile per gli agent, consentendoti di passare da modelli GPT-5.x più vecchi o da vendor alternativi senza dover rielaborare la logica dell’agent. L’aggiornamento di OpenClaw dichiara esplicitamente l’integrazione stabile di GPT-5.4 nel core.

- Memory Hot-Swapping. Invece di persistere un singolo snapshot lineare della memoria, il Context Engine di OpenClaw permette di staccare, scambiare o migrare partizioni di memoria a runtime — ad esempio, inserire uno shard di vector DB ad alto richiamo per il debugging o passare a una variante di memoria conforme al GDPR per audit esterni — senza interrompere l’agent. Questo riduce il rischio di discontinuità in produzione e abilita configurazioni di memoria specifiche per use-case (debugging vs privacy vs performance).

progressi pratici in prestazioni & vantaggi

L’integrazione di OpenClaw si concentra su tre aree pratiche in cui GPT-5.4 eccelle:

- Fedeltà nell’orchestrazione degli strumenti. Il migliorato tool-search interno e il ragionamento di GPT-5.4 riducono il churn nelle chiamate agli strumenti (meno chiamate ridondanti e meno retry). Questo si traduce in meno chiamate API e tempi di completamento più rapidi per flussi complessi. Prime evidenze indicano miglioramenti di efficienza su token e tool-call rispetto ai modelli GPT-5.x precedenti.

- Gestione di contesti più lunghi e ricchi. Gli agent di OpenClaw possono ora mantenere contesti attivi molto più grandi (inclusi shard di memoria scambiati), permettendo di gestire conversazioni lunghe, progetti multi-file e debugging iterativo senza perdere stato.

- Output di codice più deterministici. Per workflow che generano codice automaticamente (hook CI, stub di funzioni, template di infrastruttura), GPT-5.4 tende a produrre output più coerenti ed eseguibili, riducendo l’onere di revisione umana. Test indipendenti mostrano miglioramenti notevoli nelle metriche di qualità del codice rispetto ai modelli GPT-5 precedenti.

- Continuità della memoria — il “memory hot-swappable” ti consente di sostituire o integrare archivi di memoria (cache locale, vector DB, memoria LLM) senza perdere lo stato o il contesto dell’agent, abilitando A/B test, upgrade progressivi e failover.

Nel OOLONG benchmark test, la nuova versione di OpenClaw, in combinazione con il plugin lossless-claw, ha ottenuto un punteggio elevato di 74.8, lasciando molto indietro Claude Code (70.3 punti). In particolare, OpenClaw ha dimostrato stabilità e accuratezza all’aumentare della lunghezza del contesto, spingendo gli ingegneri che conducevano i test in loco a esclamare che "è troppo conservativo dire che funziona bene".

Come configurare e usare GPT-5.4 in OpenClaw (step-by-step)

Un workflow semplice di OpenClaw che usa GPT 5.4:

- Una configurazione tipica è mostrata di seguito:

- Gli utenti inviano messaggi tramite piattaforme come Discord o Telegram.

- OpenClaw riceve i messaggi attraverso il suo gateway server.

- Il gateway inoltra i prompt a GPT 5.4 tramite il provider di API di IA.

- GPT 5.4 genera una risposta o attiva un’azione di tool.

- OpenClaw invia il risultato finale all’utente.

Qui sotto trovi esempi di configurazione pragmatici e copiabili e workflow per eseguire GPT-5.4 in OpenClaw in modo sicuro e riproducibile. Questi sono intenzionalmente conservativi: abilita prima il modello in un agent di test e strumenta tutto per metriche ed errori.

Prerequisiti- OpenClaw aggiornato alla release che include i mapping per GPT-5.4 (le release note citate sopra).

- Chiave API OpenAI valida con accesso a GPT-5.4 (io scelgo l’endpoint CometAPI con prezzo più basso).

1) Selezione del modello & configurazione del resolver (Json/ YAML / CLI)

Inserisci questo in ~/.openclaw/openclaw.json (o uniscilo alla tua config esistente). Regola il nome del provider e il riferimento al token in base al tuo ambiente.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw utilizza un model resolver per mappare nomi logici di modello (ad es. openai/gpt-5.4) a endpoint e configurazione runtime. Aggiungi o aggiorna il tuo file di resolver (esempio models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Oppure impostalo a runtime via CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Nota: The

context_windowandmax

Note

agents.defaults.model.primaryseleziona il modello di default. Usachannels.modelByChannelper override per canale così puoi instradare i canali a impatto elevato a GPT-5.4 e quelli meno impegnativi a modelli più economici. Consulta la documentazione sulla selezione dei modelli di OpenClaw per la semantica dell’ordinamento.- Consulta la pagina del modello su CometAPI per i nomi specifici dei modelli. Se desideri utilizzare OpenAI, sostituisci l’URL e la chiave API con quelli di OpenAI.

- Le chiavi

context_windowemax_output_tokensriflettono le modifiche di forward-compatibility nel resolver di OpenClaw, in modo che l’agent non tenti di usare limiti Codex obsoleti.

2) Come abilitare e testare il “memory hot-swapping”

Il sottosistema di memoria di OpenClaw è basato su file (file Markdown) più indicizzatori/plugin di ricerca, così puoi sostituire in sicurezza i plugin di backend (ad es. SQLite vector, Milvus o servizi di memoria esterni) senza perdere i file di memoria grezzi.

Un pattern comune:

- Standardizza la posizione della memoria: usa un workspace sotto git:

~/.openclaw/workspace/doveMEMORY.mdememory/YYYY-MM-DD.mdsono autorevoli. - Installa & configura un plugin di memoria (esempio: sqlite-vec) e punta

plugins.slots.memorya esso nella config. - Test di migrazione: aggiungi un nuovo plugin, esegui un job di indicizzazione in ombra, confronta i risultati di retrieval, poi cambia l’alias

plugins.slots.memoryal nuovo plugin quando sei soddisfatto.

Esempio di swap dell’alias del plugin (pseudo-comandi bash):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Perché è “hot-swappable”: i file di memoria restano la fonte di verità. I plugin implementano livelli di indicizzazione e retrieval; sostituirli reindicizza ma non modifica i file .md sottostanti. Questo consente swap di modelli senza derive catastrofiche di identità — l’agent legge comunque le stesse MEMORIE.

3) Esempio: fissare un singolo agent su GPT-5.4 (override per agent)

Puoi eseguire override dei modelli per singolo agent; aggiungi una voce di agent come:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Se la release community o la tua specifica versione di OpenClaw richiede la CLI, puoi anche impostare un modello per sessione a runtime:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Suggerimento operativo: fissare un modello garantisce un comportamento deterministico per quell’agent mentre esegui A/B test sugli altri.

Se desideri utilizzare OpenAI, sostituisci l’URL e la chiave API con quelli di OpenAI.

4) Uso delle opzioni di contesto 1M di Codex (manopole API)

Se il tuo deployment di OpenClaw accede direttamente agli endpoint OpenAI Codex, passa le opzioni di contesto:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Le richieste che superano le finestre di contesto standard possono essere conteggiate con tariffe d’uso diverse (i documenti OpenAI notano una doppia contabilizzazione per richieste oltre le finestre standard in anteprima Codex).

Best practice: massimizzare i punti di forza di GPT-5.4 in OpenClaw

Costo, latenza & mix di modelli

- Strategia ibrida di modelli: Usa un modello più piccolo ed economico per query brevi e stream processing; passa a caldo a GPT-5.4 per analisi pesante, sintesi, generazione di codice con contesto lungo. Questo riduce il costo complessivo dei token preservando la qualità. (Implementa tramite trigger nella configurazione di memoria sopra.)

- Compattazione dei token & retrieval augmentation: Usa pipeline con retrieval per limitare i token inviati al modello — archivia documenti lunghi in un vector DB, recupera i segmenti rilevanti e includi solo i chunk più pertinenti più un piano compatto. Il tool search di GPT-5.4 aiuta qui individuando automaticamente tool o documenti utili.

- Warm-up & cold start: Dopo uno swap di modello, riscalda il modello con una breve esecuzione di priming del contesto per evitare picchi di latenza alla prima richiesta. Precompila eventuali template di prompt e reidrata i canali di memoria critici. La strategia rolling di OpenClaw (vedi config) supporta il pre-warming.

Affidabilità & sicurezza

- Fallback graduale: Implementa timeout e piani di fallback (ad es., degrada a una risposta in cache da una sessione precedente) per gestire rate limit API o errori di quota.

- Layer di sicurezza: Mantieni filtri di policy e un passaggio di verifica quando gli output influenzano decisioni. GPT-5.4 riduce statisticamente le allucinazioni, ma la verifica resta importante per task ad alto impatto.

Valutazione & monitoraggio

- Riproduci i tuoi benchmark: Esegui test testa-a-testa per i tuoi workload (completamento di codice, refactor multi-file, analisi spreadsheet) usando una rubrica standard. I report pubblici indicano punti di forza in task di produttività e spreadsheet — valida con i tuoi dati.

- Telemetria: Monitora consumo di token, latenza del modello, frequenza di swap di memoria e qualità delle risposte (valutazioni umane/test automatizzati). Usa la telemetria per affinare le soglie di swap.

Esempio: Agent di code review che effettua hot-swap

Obiettivo: Eseguire un riepilogo di lint + unit test di routine al push (modello economico) ed escalare a GPT-5.4 per suggerimenti di refactor multi-file quando i test falliscono o i diff superano 10 file.

Flusso (alto livello):

- Il trigger pre-commit esegue

local/fast-small-coderper generare il riepilogo di lint. - Se

test_failures > 0odiff_files > 10, attivahot_swapversoopenai/gpt-5.4. Promuovilongterm_vectorcontenente la storia del repo. - Esegui un prompt di GPT-5.4 che include l’intero stack trace dei fallimenti + file di codice rilevanti portati in contesto. Genera la patch di refactor e le modifiche ai test unitari.

- Un revisore umano valuta l’output; il feedback aggiorna la memoria.

Struttura del prompt (inviato a GPT-5.4 dopo retrieval & compaction):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Questo caso d’uso evidenzia perché contesto ampio + memoria hot-swap sono preziosi: puoi portare nello stesso momento l’intero trace dei fallimenti e più file nel modello. Implementa trigger di swap in modo conservativo per controllare i costi.

Infine: chi dovrebbe adottare GPT-5.4 in OpenClaw (e quando)

- Adotta ora se i tuoi agent eseguono task multi-step di codice/tool, forte automazione su spreadsheet o editing di documenti complessi in cui cicli iterativi scrivi-esegui-ispeziona dominano il tempo degli sviluppatori. I guadagni di produttività e affidabilità sono più visibili qui.

- Adotta con cautela se operi in canali chat ad alto volume e sensibili ai costi dove basta un ragionamento più semplice; usa il routing per preservare l’efficienza dei costi.

- Non presumere la dominanza di un singolo modello: fai benchmark sui tuoi dati. GPT-5.4 è un forte contendente per i workload degli agent, ma la scelta del modello deve essere guidata dall’evidenza.

Gli sviluppatori possono accedere a GPT-5.4 tramite CometAPI (CometAPI è una piattaforma di aggregazione one-stop per API di grandi modelli come GPT API, Nano Banana API ecc.) già da ora. Per iniziare, esplora le capacità del modello nel Playground e consulta la intergration guide di Openclaw per istruzioni dettagliate. Prima di accedere, assicurati di aver effettuato l’accesso a CometAPI e di aver ottenuto la chiave API. CometAPI offre un prezzo molto inferiore rispetto al prezzo ufficiale per aiutarti a integrare.

Pronto a partire? → Sign up fo openclaw today !

Se vuoi conoscere altri suggerimenti, guide e notizie sull’IA seguici su VK, X e Discord!