ChatGPT による動画解析の開発者体験は、しばしば壁に突き当たります。YouTube への直接リンクは失敗し、MP4 をアップロードしても、視覚的なニュアンスを見落とした「幻覚」気味の要約が返ってきます。これはバグではなく、アーキテクチャ上の制約です。ChatGPT は動画をストリーミングしません。抽出されたフレームの列とトランスクリプトを処理します。つまり、あなたが MP4 をアップロードしたところ、うまくいった……ように見えましたが、完全ではありませんでした。要約は音声の書き起こしには言及したものの、動画の意味を決定づける第3シーンの視覚的なジョークを完全に見逃していました。

ChatGPT は動画を解析できる — ただし実際に「視聴」しているわけではない

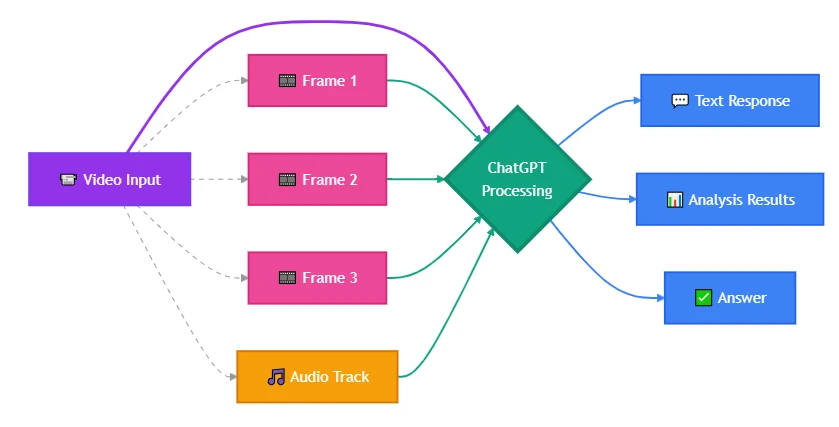

実際に起きているのはこうです。ChatGPT はあなたのように動画を「観て」いません。再生ボタンを押して、時間の経過に沿って動きを観察するわけではありません。モデルは、動画を自分がすでに扱える要素、すなわち静止画像とテキストのトランスクリプトに分解し、それぞれを独立に推論します。モデルにとって動画は、ナレーション付きの写真アルバムであって、連続体験ではありません。だからこそ、話し言葉の説明は捉えたのに視覚的なオチを逃したのです。ジョークのあるフレームがおそらくサンプリング集合に入っていなかったからです。

「ChatGPT は動画を視聴できるのか」と尋ねる人が実際に聞いているのは、概ね2つのどちらかです。人間の観察者のように視覚コンテンツをストリーミングできるのか、それとも動画データから意味(シーン、セリフ、タイムスタンプ、画面上のアクション)を抽出・解析できるのか。機能的な答えは、後者に対しては「はい」ですが、いくつかの制約があり、特定のユースケースは完全に破綻します。最新の ChatGPT 系列は、動画をサンプリングしたフレームと音声の書き起こしとして扱い、Web インターフェースでの自動抽出または API によるユーザー提供フレームを受け取って処理します。これは要約、シーン記述、テキスト抽出には有効ですが、動きの追跡、タイミング依存の解析、フレーム間で「何が起こったか」を見る必要があるものには失敗します。

多くのガイドは、機能があることを確認するだけで、あなたの実装がなぜうまくいかなかったのか、またどの代替入力方法を使うべきだったのかを説明しません。

ChatGPT の動画機能: モデルが実際に「見ている」もの

ChatGPT は MP4 を読み込み、フレーム単位でスクラブするわけではありません。ChatGPT は「画像認識」という静止画の解析能力と、Whisper 統合による音声書き起こしを持ちます。動画を ChatGPT の Web やモバイルのインターフェースから送信すると、システムはキーフレームを抽出し、音声を別途書き起こし、両者を独立した入力としてモデルに与えます。モデルはそこで「見た」フレームと「聞いた」トランスクリプトに基づいて内容を記述します。

あなたの視点では動画理解に見えますが、モデルの視点では画像解析とテキスト処理です。このアーキテクチャ上の違いが、どのユースケースが機能し、どれが機能しないかを決めます。

動画が動き、微細なフレーム間変化、あるいは正確なタイミングに依存している場合(例: 物体がいつフレームに入るかの検出、UI 要素のアニメーションの追跡)、キーフレーム方式では見落とします。サンプリングされたフレームの間にある 2 秒間の視覚的合図は捉えられません。また、進行を明示的に示すよう入力を構造化しない限り、時間に沿ったオブジェクト追跡もできません。

現在の ChatGPT の動画機能(2026年初頭時点)

- 画像ベースの動画解析: 動画ファイルまたは抽出フレームを受け取り、サンプリング画像から視覚内容を解釈

- 音声書き起こし: Whisper により話し言葉をテキスト化し、そのトランスクリプトを要約・照会可能

- シーン記述: 提供されたフレームに見える物体、行為、環境、テキストを特定

- タイムスタンプに基づくクエリ: フレームのタイムスタンプや手動セグメントを提供すれば、特定の瞬間を参照可能

- テキスト抽出: 画面上のキャプション、UI ラベル、文書に写っているテキストを読み取り

ChatGPT の Web インターフェースにおける具体的なフレームサンプリングレートと自動キーフレーム選択の挙動は、ナレッジカットオフ時点では非公開

含まれないもの

- API を通じたリアルタイム動画ストリーミング入力

- フレーム精度の動き追跡や時間にわたるオブジェクトの持続性把握

- 動画コーデックのネイティブ対応(処理はすべて抽出フレームと音声で実施)

- 明示的な指示なしの自動シーンチェンジ検出

動画処理能力は長さではなく、トークン上限とファイルサイズに制約されます。実務上は 5〜10 分が目安ですが、実際の上限は視覚情報の密度に応じて動的に変わります。

この能力が必要なら、適切なフレームを自前で抽出して前処理するか、ネイティブに動画を扱えるモデルへ切り替えることになります。次のセクションでは、ユースケース別に適切な入力方法を解説します。

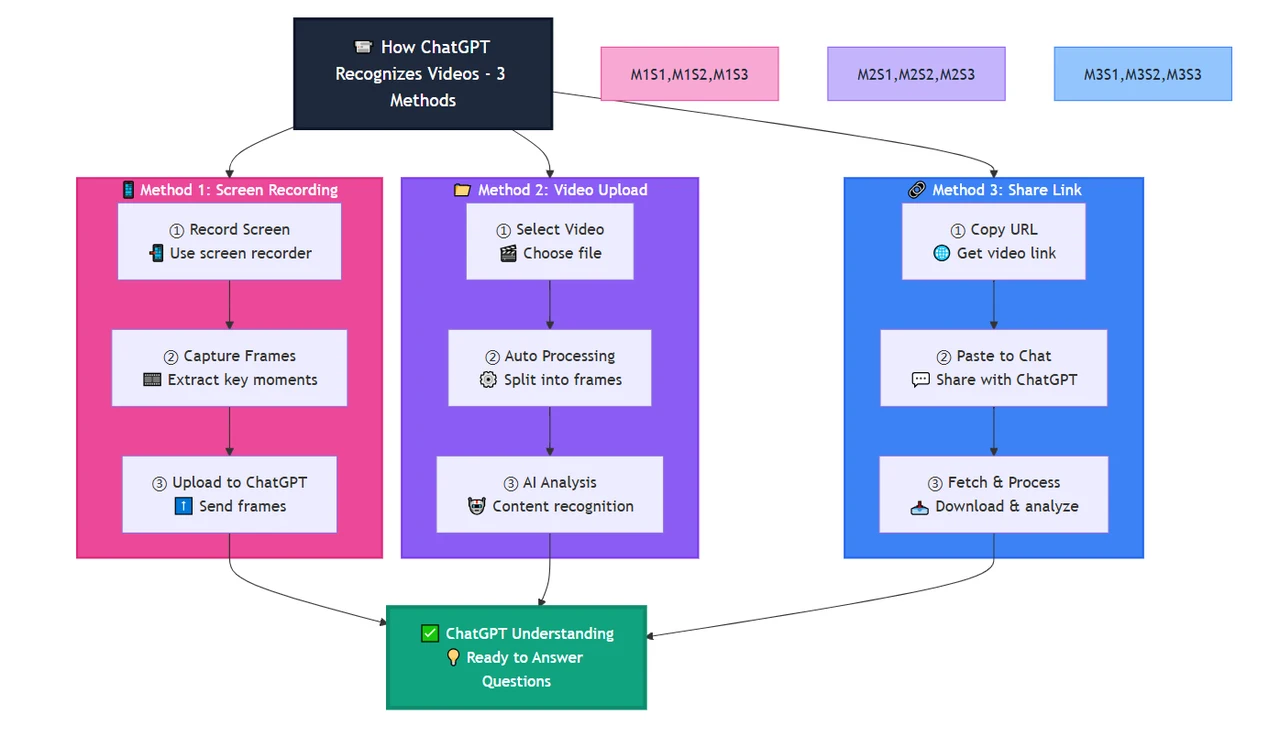

ChatGPT が動画を認識する方法: 実践的な 3 つの手段

ChatGPT に動画を渡す方法は1つではありません。どの方法を選ぶかで、モデルが解析できること・見落とすことが決まります。多くの実装失敗は、正しい方法ではなく便利な方法を選んでしまうことが原因です。

方法 1: 手動でフレーム抽出して画像をアップロード

ffmpeg などを用いて自前でフレームを抽出し、その画像をアップロードします。モデルが何を解析するかを完全に制御できます。

例: ワークフロー(bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

この方法でできること:

- 文脈を無駄にせず、特定の瞬間(イントロ、主要アクション、結末)に解析を集中できる

- 任意のサンプリングレートで連続フレームをアップロードし、動きを捉えられる

- ファイルサイズ制限の回避に役立つ(画像は動画全体より小さい)

- 自動圧縮で劣化しがちなフレーム品質を保持できる

トレードオフ:

前処理を自分で行う必要があります。数百本をスケールして解析するには自動化が要ります。一方、単発の深い分析や特定シーンのデバッグには最も信頼できる方法です。

この方法を使うべきとき:

- 特定の瞬間をフレーム精度で解析する必要がある

- 重要な視覚情報が短時間で、通常のキーフレーム間隔の合間に現れる

- 連続比較で視覚的変化を追う(UI 状態変化、アニメーションの各段)

- 実際にモデルが「見た」ものを、アップロードしたフレームで検証したい

方法 2: ChatGPT インターフェースからファイルを直接アップロード

ChatGPT の Web/モバイルアプリは、チャット欄へ動画を直接アップロードできます。MP4 や MOV をドロップすれば、フレーム抽出と書き起こしをシステムが自動処理します。

内部で起きていること:

- 一定間隔でフレームをサンプリング(具体的なレートは未公開、観測上は 1〜2 fps 程度と推定)

- 音声は Whisper 等で書き起こし

- 両方の出力がモデルへ別々のコンテキスト入力として渡される

- モデルは、見えたフレームと聞こえたトランスクリプトに基づいて応答を生成

この方法が有効なケース:

- フレーム単位の厳密さを要しない高レベルの動画要約

- シーンを通じて持続する主要な物体、人、環境の特定

- 音声や複数フレームにわたり可視な画面上テキストの抽出

- 前処理なしで手早く探索的に分析

この方法が失敗するケース:

- フレーム精度の分析 — どのフレームがサンプリングされるか制御できない

- 長尺でモデルの快適なコンテキスト容量を超えるコンテンツでは、論理的な分割が必要。戦略的な分割や前処理がなければ、視覚情報が高密度なほどトークン消費が加速し、品質劣化や切り捨てが起こり得る

- 連続フレーム比較を要する動き、遷移、タイミング依存の内容の検出

- 重要な視覚情報が 1〜2 秒だけ表示されるなど、サンプリングの合間に現れる場合

どの瞬間を解析するか制御したいなら、方法 1 を使ってください。

方法 3: YouTube リンク+トランスクリプト取得

ChatGPT の一部プラグインやサードパーティツールは「YouTube 動画を解析」すると称しますが、実際には動画の公開メタデータとトランスクリプト(利用可能な場合)を取得し、そのテキストを ChatGPT に渡しているだけです。

有効なとき:

- 動画に自動生成またはユーザー提供の字幕がある

- 解析対象が話し言葉の内容で、視覚情報を必要としない

- 動画が公開されている(非公開、限定公開、地域制限でない)

- 音声中心のコンテンツ(講義、ポッドキャスト、インタビュー)を要約する

無効なとき:

- 視覚コンテンツの解析が必要(画面上のデモ、図、表情)

- トランスクリプトや字幕がない

- 重要な情報が台詞に現れず、視覚的にのみ提示される

- 私的ファイルや認証が必要なコンテンツを扱う

よくある誤解: 開発者が(視覚+音声の)完全な動画理解を期待しているのに、トランスクリプト要約しか得られない。これは話し言葉中心のコンテンツ分析には問題ありませんが、プロダクトデモのレビュー、ビジュアルデザインの分析など「見えるもの」が重要な場面では役に立ちません。

パターンはこうです。精度が不要なクイック要約なら方法 2、特定フレームを確実に解析したいなら方法 1、視覚情報が二次的で音声中心なら方法 3。あなたのユースケースで重要な信号が「動き」「特定フレーム」「純粋に対話」にあるのかに基づいて選択してください。

ChatGPT の動画アプリケーション・シナリオ: 本番で実際に機能するもの

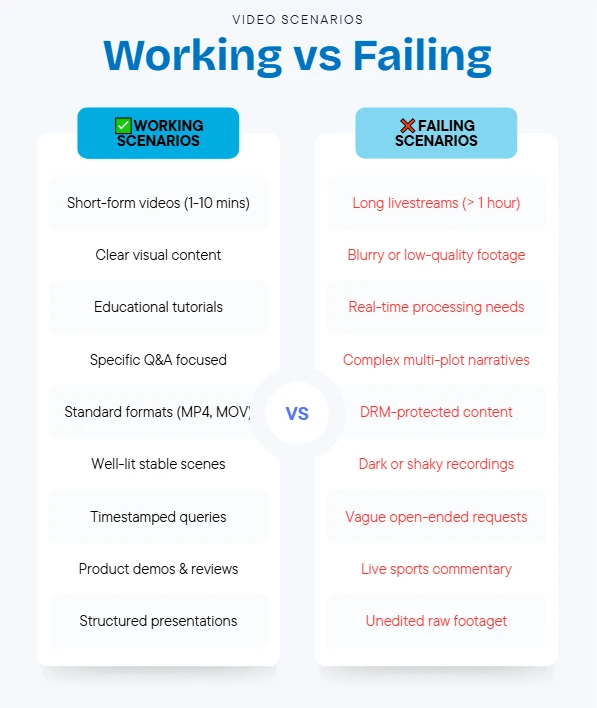

ChatGPT が動画コンポーネントを処理できるとわかっても、あなたの課題に適切かは別問題です。以下はフレームベース分析が成功する場面と、アーキテクチャ制約で破綻する場面の例です。

シナリオ 1: 教育コンテンツの要約

ユースケース: 10 分のチュートリアル動画から、主要ステップ、言及されたツール、提示された視覚例の構造化要約が必要。

なぜ機能するか: 教育動画は、明確なシーン境界、持続する画面上テキスト、視覚と整合するナレーションがあることが多い。話者は提示中に内容を説明します。ChatGPT は説明をトランスクリプト化し、サンプリングフレームからツールや図を特定し、両者を組み合わせて構造化出力を生成できます。

実装アプローチ: ChatGPT から動画をアップロードするか、主要トピックの遷移で 8〜12 枚のキーフレームを抽出。プロンプト例: 「この動画で説明された主な手順を、ナレーションと画面上のテキスト・図・ツール名の両方を参照しながら列挙してください。」

破綻する場面: 連続動作に依存する動画(例: 講師が複数ファイルにわたり高速入力するコーディングスクリーンキャスト)では、フレーム間の手順が欠落します。より高いサンプリングレートか、音声トランスクリプトに重点を置く必要があります。

実務的ヒント: 講義やチュートリアルでは、自動アップロード(トランスクリプト用)と、最重要の視覚モーメント 3〜5 箇所の手動抽出フレームを組み合わせると良い。音声を包括しつつ、重要概念の高品質画像を得られます。

シナリオ 2: プロダクトデモの分析

ユースケース: 競合のプロダクトデモから、UI 要素、機能名、ユーザーフロー、画面上の価格情報を抽出したい。

なぜ機能するか: プロダクトデモは、静的 UI が十分に長く表示され、フレームサンプリングで捕捉されやすい。テキストオーバーレイ、ボタンラベル、メニュー構造、価格表は複数フレームにわたり可視で、ナレーションになくても ChatGPT の視覚機能で読み取り・記述できます。

実装アプローチ: 主要シーン変更(イントロ、機能1、機能2、価格、CTA)でフレームを抽出し、プロンプト: 「各フレームについて、見える UI 要素、ボタンラベル、機能名、および表示されている価格や製品情報をすべて特定してください。」

破綻する場面: 急速な画面遷移、短時間のホバー表示、1〜2 秒だけ出るインタラクティブ要素は捕捉されない可能性。比較表を一瞬だけ見せると、ちょうどその瞬間をサンプリングしない限り見逃します。

実務的ヒント: まず動画を手動でスクラブし、重要な開示のタイムスタンプを特定。一定間隔ではなく、その瞬間のフレームを抽出しましょう。

シナリオ 3: 会議・インタビューの書き起こし+視覚コンテキスト

ユースケース: クライアントとの通話を録画し、トランスクリプトと、特定の文書・スライド・画面共有が表示されたタイミングの注釈が必要。

なぜ機能するか: 音声書き起こしが発話を処理し、画面共有や書類掲示はサンプリングフレームに現れます。ChatGPT はトランスクリプトと併せ、「おおよそ [timestamp] に契約書類が表示された」と注釈できます。視覚資料を参照する議事録に有用です。

実装アプローチ: 動画をアップロードし、プロンプト: 「この会議を文字起こしし、文書・プレゼンテーションスライド・画面共有・その他の視覚的参照が現れた瞬間を注記してください。各視覚要素について何が表示されたかを説明してください。」

破綻する場面: 5〜10 秒未満の短い画面共有はサンプリングの合間に抜け落ちる可能性。圧縮で文字が小さすぎると読み取れません。法務・コンプライアンス用途で表示文書の逐語精度が必要な場合、フレーム品質とサンプリングのカバレッジを検証してください。

実務的ヒント: 重要会議では高解像度で録画し、「この文書を見せます」などの発話直後のフレームを手動抽出しましょう。

シナリオ 4: コンテンツモデレーション/コンプライアンス審査

ユースケース: ユーザー投稿動画に禁止コンテンツ(特定ロゴ、テキストパターン、視覚要素)が含まれるかスキャンしたい。

なぜ機能するか: ChatGPT はフレームから可視テキスト、認識可能な物体、シーンを検出できます。複数秒にわたり表示されるロゴなら、フレームベース分析で検出可能です。

実装アプローチ: 3〜5 秒ごとにフレームを抽出してアップロードし、プロンプト: 「これらのフレームを確認し、[特定ロゴ/ブランド名/禁止シンボルなど] を含むものを特定してください。一致したフレームごとに、フレーム内のどこにあるか説明してください。」

破綻する場面: 音声由来の違反(著作権音楽、禁止発話)は別の音声解析が必要。動作由来の違反(禁止ジェスチャー、複数フレームにまたがる行為)は静止画では捉えられません。一瞬だけフラッシュする違反要素もサンプリングから漏れます。

実務的ヒント: ChatGPT による視覚スキャンに、専用の音声フィンガープリントサービスや高頻度サンプリングを組み合わせてハイリスクカテゴリに対応。ChatGPT は一次フィルターであって、唯一のモデレーション層にしないでください。

成功パターンの共通点は、有意味な内容が離散的で安定したフレームに存在し、音声やテキスト要素と相関していること。失敗は、重要情報が動き・タイミング・遷移に依存するか、サンプリングで捉えにくいほど短く現れるときに起きます。

Gemini の動画機能 vs. Claude の動画機能 vs. ChatGPT

ChatGPT のフレームサンプリング方式がユースケースに合わないなら、代替を検討します。Gemini と Claude は異なる動画関連機能を提供し、その違いが実装に最適なモデルを決めます。

Gemini のネイティブ動画処理

Gemini は API レベルで動画入力をネイティブ対応しています。前処理でフレームに分解することなく動画ファイルを直接渡せます。モデルは動画を連続ストリームとして処理し、動きの追跡、シーン変化検出、時間的推論を可能にします。これは ChatGPT のフレーム方式ではできません。

Gemini が勝るユースケースの例:

30 秒のクリップで、特定の物体がフレームに入退出するタイミングを検出、あるいは人物の動きを追跡したい。Gemini はフレームをまたいで物体を追えます。ChatGPT はサンプリングされたフレームにたまたま映っているときしか見えず、入退出を見逃す可能性があります。

トレードオフ:

- Gemini のネイティブ API は OpenAI のフレームサンプリングよりコスト効率が高い。コンテキストキャッシングにより線形なトークン増加を回避し、長尺分析でもスケールしやすい

- 長尺動画では遅延が増える — 応答前にファイル全体の取り込みが必要

- すべての Gemini バリアントが動画入力をサポートするわけではない(後発モデルが必要)

- 動画長の上限はあるが、ChatGPT のコンテキスト制約より寛容

ChatGPT より Gemini を選ぶべきとき:

- 動き追跡、シーン境界検出、時間的関係の理解が必要

- 重要情報がフレームをまたいで短時間に出現・消失する

- 事象の進行が重要(スポーツ映像、監視映像、アニメーション解析)

- 手動のフレーム抽出前処理を避けたい

Claude の現在の動画制限

2026 年初頭時点で、Claude は API による動画入力を直接サポートしていません。画像(手動抽出した動画フレームを含む)はアップロードできますが、Gemini のようなネイティブ動画処理機能はありません。

Claude ができること:

- ChatGPT の手動抽出法(方法 2)と同様に、フレーム列を解析

- 各フレームの視覚内容を詳細に記述

- 明示的なプロンプトがあれば、フレーム間の変化や暗黙の動きについて推論

- 拡張コンテキストウィンドウ(Claude Opus 4.7 は最大 1M トークン)により多数の画像列を扱える

Claude ができないこと:

- いかなるインターフェースからも動画ファイルを直接受け付けない

- 明示的なフレームごとの誘導なしに、時間に沿った動きやオブジェクトを自動追跡しない

- 音声を書き起こしできない — Whisper 等で別途前処理し、トランスクリプトを Claude に渡す必要

それでも Claude を選ぶ場面:

- ワークフローにフレーム抽出の前処理が組み込まれている

- 長尺動画で多数のフレームを扱い、さらに大量のコンテキスト情報と併せて解析したい

- 特定領域(医用画像、技術図面など)で、Claude の視覚記述の精度が高いと判断できる

- 動画フレーム分析と大量の周辺コンテキスト統合が必要

機能比較表

| 機能 | ChatGPT | Gemini | Claude |

|---|---|---|---|

| 動画ファイルの直接アップロード | ✓(Web/アプリ インターフェース) | ✓(API+Web インターフェース) | ✗ |

| ネイティブな動き追跡 | ✗ | ✓ | ✗ |

| 音声書き起こし | ✓(Whisper 統合) | ✓(統合) | ✗(外部ツールが必要) |

| フレームベース解析 | ✓ | ✓(連続処理も可能) | ✓(手動抽出のみ) |

| シーンチェンジ検出 | ✗(手動のみ) | ✓(自動) | ✗ |

| 対応できる動画の長さの目安 | 約 5〜10 分(コンテキスト制約) | 約 1 時間(解像度依存) | N/A(フレーム数はコンテキストに依存) |

| 最適な用途 | クイック要約、ある程度制御可能なフレームレベル分析 | 動き追跡、時間的推論、連続動画 | 大規模コンテキストが必要な詳細フレーム記述 |

| API での動画サポート | ✗(画像のみ) | ✓ | ✗ |

意思決定フレームワーク:

- ChatGPT を選ぶとき: クイックな動画要約が必要で、重要情報が複数フレームにわたり可視、短尺クリップ(10 分未満)を扱い、動き追跡が不要。教育コンテンツ、静的プロダクトデモ、会議書き起こしに最適。

- Gemini を選ぶとき: 動き追跡、シーンチェンジ検出、時間的推論が必要。監視映像、スポーツ解析、アニメーションレビューなど、フレーム間で起こることが重要。

- Claude を選ぶとき: 前処理でフレーム抽出を行い、多数フレーム+広大なコンテキストを扱いたい、または特定領域で Claude の視覚記述が優れると判断。前処理の手間は最大だが、最大のコンテキストウィンドウを活用可能。

複数モデルを横断して作業する開発者向けに、CometAPI は GPT、Gemini、Claude の各バリアントを同一入力で試せる統一インターフェースを提供し、特定プロバイダにコミットする前の品質比較に役立ちます。

「ChatGPT は動画を視聴できるのか」の答えは二者択一ではありません。「はい、モデルがすでに扱える形式へ変換することで — ただし特定のユースケースを破綻させる制約付きで」というのが正解です。多くの実装失敗は、能力不足ではなくアーキテクチャの不整合に由来します。モデルは設計どおりに動いています。期待した設計が異なっていただけです。

スケールで動画分析機能を構築するなら、まずエッジケースでワークフローを検証しましょう。同一動画を、ファイル直接アップロード、手動抽出フレーム、トランスクリプトのみ、の 3 方法で投入。出力を比較してください。プロダクションで生き残るのは、実装が最も簡単な方法ではなく、ユースケースの本質的な信号を捉える方法です。

ChatGPT を動画用途に採用する前に:

- 重要情報が「安定したフレーム」「動き」「音声」のどこにあるか特定する

- 想定サンプリング間隔でフレームを手動抽出し、カバレッジを検証する

- 圧縮後の解像度で、画面上テキストが可読か確認する

- 動画長がサブスクリプションの実用的コンテキスト上限に収まるか確認する

- サンプリングの合間に短時間だけ現れる内容へのフォールバックを用意する

動画ワークロードのために複数プロバイダを評価する開発者向けに、CometAPI は同一動画入力で ChatGPT、Gemini、Claude を試せる統一プレイグラウンドを提供し、ビルド前に出力品質、レイテンシ、コストを比較できます。

FAQ - AI 動画分析ガイド

AI 動画分析に関するよくある質問へのクイックアンサー。

ChatGPT は動画を解析できますか?

はい。ChatGPT(GPT-4o 以降)は、約 1 秒ごとにフレームをサンプリングし、音声を文字起こしして解析します。会議の要約、スライドからのテキスト抽出、物体の特定に適しています。ただし、動きの追跡、10 分超の動画、リアルタイムストリーミングは苦手です。

ChatGPT に動画をアップロードする方法は?

URL からの直接アップロード(推奨): 公開 URL 経由でアップロードして素早く分析。10 分未満の動画に最適。

手動フレーム抽出: 特定フレームを抽出して精密に制御。特定の瞬間を解析したい場合やトークンコスト削減に最適。

ChatGPT が扱える動画の最大長は?

安定して扱えるのはおおむね 5〜10 分です。それ以上は動画を分割するか、最大 60 分の動画をネイティブ対応する Gemini 2.5 Pro への切り替えを検討してください。

ChatGPT の動画分析の制限は?

- 連続した動きの追跡ができない(スポーツ、ダンス)

- タイムスタンプが不正確(±1 秒程度)

- 1 秒未満しか表示されない内容を見落とす

- 実用上の上限は 10 分

- リアルタイムストリーミング非対応

- 低品質・暗所の動画が苦手

- 時間的な因果関係の推論が弱い*

動画分析には ChatGPT と Gemini のどちらを使うべき?

ChatGPT を使う場合:

- 10 分未満の動画

- 動画分析後のテキスト推論が優れている

- フレームレベル分析(スライド、スクリーンショット)

Gemini を使う場合:

- 10〜60 分の動画

- 動きの追跡と移動解析

- 時間的推論タスク

- スポーツ、ダンス、監視映像*

Claude は動画を解析できますか?

いいえ。Claude は動画の直接入力をサポートしていません。ただし、動画からフレームを抽出して Claude に渡せば解析可能で、長文の推論や大きなコンテキストウィンドウを活用した詳細分析に強みがあります。

動画分析のコストはどれくらい?

モデルや動画長によって異なります。

- ChatGPT 4o: 約 $0.05/分

- Gemini 2.5 Pro: 約 $0.04/分

CometAPI では新規ユーザー向けクレジットを提供しています。