Claude Opus 4.7は2026年4月16日にリリースされ、コーディング、エージェント型ワークフロー、ビジョン、指示遵守の面でOpus 4.6から大幅なアップグレードとなりました。SWE-bench Verifiedで**+6.8pp(87.6% vs 80.8%)、SWE-bench Proで+10.9pp(64.3% vs 53.4%)、CursorBenchで+12pp(70% vs 58%)**を記録し、長時間タスクにおける幻覚を減らす自己検証ループとともに、視覚解像度を3.3倍に向上させます。公式の価格は同一($5/$25 per million tokens)ですが、低エフォートの4.7が中エフォートの4.6と同等の品質に達するため、実運用コストが下がります。

CometAPIでは、両モデル(Claude Opus 4.7 と Opus 4.6)を**$4 input / $20 output**で、OpenAI互換エンドポイントとベンダーロックインなしで利用できます。プロダクションのコーディングエージェント、複雑な文書解析、マルチセッションのワークフローを運用している場合はアップグレードを推奨—4.7は先端業務の新たなデフォルトです。

Claude Opus 4.7 vs Opus 4.6: 早見比較

要点: Opus 4.7は「制限が外れ洗練されたOpus 4.6」という感触です。4.6で時折見られた制限(例:タスクの早期放棄、視覚精度の低さ)を取り除き、適応的推論により効率性を追加します。ユーザーからは、より“意見を持ち”、協働的で、自分の作業をダブルチェックするシニアエンジニアと働いているようだとの報告があります。

2026年にClaude Opus 4.7が重要な理由

2026年4月16日、Anthropicは最も能力の高い一般提供モデルであるClaude Opus 4.7を静かにリリースしました。制限付きのMythos Preview(サイバー領域に特化した強力モデル)からわずか数週間後、Opus 4.7はOpus 4.6と同一価格を維持しながら、プロダクションのワークロードで王座を取り戻します。

開発者や企業は、最難のコーディングタスクを付きっきりで監督する必要がなくなりました。以前は厳密な監督が必要だった種類のタスクを4.7に安心して任せられる、とのユーザー報告があります。モデルは出力を自己検証し、指示を文字通りに従い、ツールエラーを減らしつつエラー回復を改善し、複数時間にわたるエージェント運用を維持します。

このモデルが卓越する分野:

- 厳密な長時間タスク(計画→実行→検証→報告の組み込み自己検証)

- 文字通りの指示遵守—「consider」や「you might」の緩い解釈がなくなる

- 大幅に向上したビジョン(長辺最大2,576 px ≈ 3.75 MP、従来比3倍超の解像度)

- プロフェッショナル出力の美意識と創造性の向上(インターフェース、スライド、ドキュメントなど)

- ファイルシステムメモリの改善による真のマルチセッション自律性

新機能として、xhigh のエフォートレベル(highとmaxの間)、Platform APIでのタスク予算、Claude Designツールの統合が追加されています。モデルIDはclaude-opus-4-7に変更。公式価格は不変ですが、トークン効率の改善によりタスク当たりの実効コストが下がることが多いです。

中核能力の改善 — 実際に何が変わったのか

高度なソフトウェアエンジニアリングとエージェント型コーディング

Opus 4.7は最難関の問題で際立ちます。93タスクの社内コーディングベンチマークで13%の解決率向上を達成し、4.6やSonnet 4.6でも解けなかった4つのタスクを解決しました。Rakuten-SWE-Benchでは、人手なしでプロダクション級タスクの解決が3倍。実IDEワークフローのCursorBenchは**+12ポイントの70%**へジャンプ。

社内の93タスクコーディングベンチマークでは13%の向上が見られ、4.6やSonnet 4.6でも解けなかった4つのタスクを解決しました。エージェント型ワークフローでは、Boxが同等の出力に対してLLM呼び出し回数が2倍少ない(7.1 vs 16.3)ことと、AIユニット使用量が30%低下したことを報告—コストとレイテンシの直接的な改善につながります。

開発者にとっての意義: 以前は監督が必要だった「最難のコーディング作業」を、Opus 4.7に安心して任せられるようになります。指示に厳密に注意を払い、出力を自己検証し、セッション間でファイルシステムメモリを再利用—日をまたぐ自律的リファクタリングに最適です。

実世界での成果例:

- 単一プロンプトからの自律的なRustテキスト読み上げエンジン

- 以前のモデルが躓いたTerminal-Bench 2.0での競合状態や並行性バグの修正(+4.0 pp)

- Factory Droidsのタスク成功率が10–15%向上、ツールエラーは1/3減

- コード品質、テスト品質、レビュー精度の二桁改善(CodeRabbit、Qodo)

低エフォートの4.7が中エフォートの4.6品質に一致するため、同じ(または低い)トークン消費でより多くを達成できます。

ビジョンとマルチモーダルの飛躍

これが最大の単一アップグレードです。最大画像解像度は1.15 MP(1568 px)から**3.75 MP(長辺2576 px)**へ—ピクセル数が3.3倍で、1:1の座標マッピングに対応。スクリーンショットや図表でスケールファクター計算は不要です。

結果:

- 視覚精度ベンチマーク:98.5% vs 54.5%(4.6比)

- CharXiv-R(ツールなし):+13.4 pp;ツールあり:+13.6 pp

- ピクセルパーフェクトなコンピュータ利用エージェント、密度の高いスクリーンショット解析、化学構造のパース、UI/UXデザインレビューを解禁

エージェント型ワークフロー、信頼性、指示遵守

Opus 4.7はネイティブな自己検証を導入—モデルが計画し、実行し、検証し、報告します。これにより、長期タスクでの自信満々だが誤った回答が大幅に減少。ファイルシステムメモリの改善により、真の複数日自律性が実現します。

指示遵守はより厳密で文字通りになりました。4.6の緩めのスタイルに合わせたプロンプトは見直しが必要—「consider」のような語は、今や厳格な要件として扱われます。精密さが重要な作業には利点ですが、プロンプトの移行が必要です。

回帰についての注記: 長文コンテキストでのneedle retrieval(MRCR)は顕著に低下(例:256Kで91.9% → 59.2%)。Anthropicは、こうした合成テストを廃し、実践的なGraphWalks指標を重視する方針で、実際のコード理解は強固なままだと述べています。

新しい xhigh エフォートレベル + タスク予算

Opus 4.7は、highとmaxの間のxhighを追加し、粒度の高い制御を可能にします。Claude Codeは計画全体でデフォルトをxhighに変更。新しいtask_budget(パブリックベータ)は、エージェントループ全体のトークン合計をモデルが追跡し、穏当に完了させます。

指示遵守、自己検証、メモリ

Opus 4.7はプロンプトをより文字通りに解釈します—精度に有益ですが、従来の曖昧なプロンプトは引き締めが必要です。モデルは独自の検証ステップ(計画→実行→検証→報告)を策定し、マルチセッション作業でファイルシステムメモリを再利用します。永続的なエージェントを構築するチームにとって、再説明・再読み込み・再計画が減るので特に有用なアップグレードです。

トークナイザーの更新

新しいトークナイザーにより品質が向上しますが、トークン消費が1.0–1.35倍(最大+35%)になる可能性があります。トークンカウントのエンドポイントは異なる値を返すようになります。ネット効果として、特に低エフォートレベルでは、タスク当たりの品質向上が増加分を相殺することが多いです。

セーフティ、アラインメント、サイバーセキュリティ

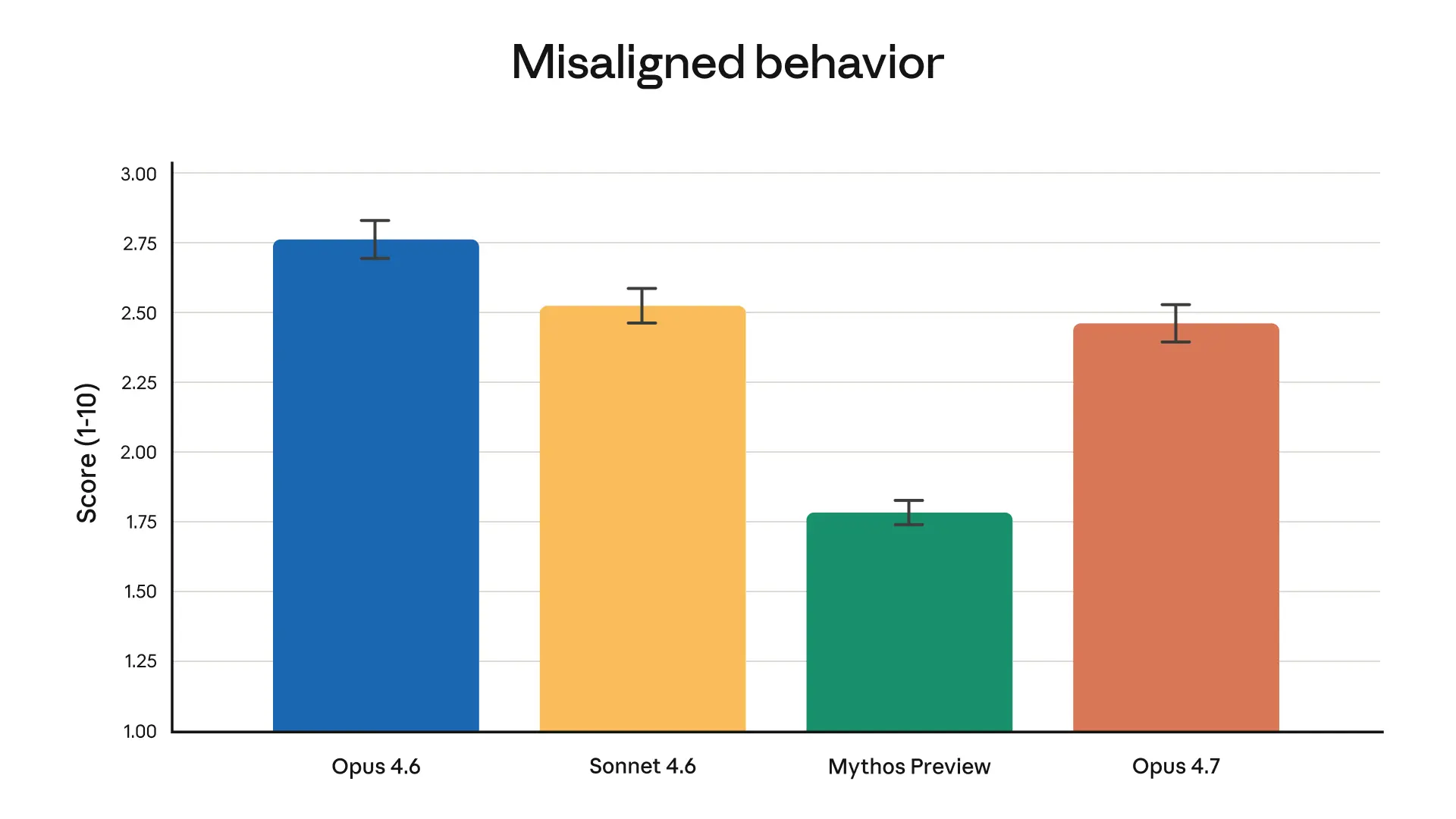

セーフティプロファイルは4.6と同様(低ミスアラインメント)で、誠実性やプロンプトインジェクション耐性が小幅に改善。

Opus 4.7はProject Glasswingのセーフガードを搭載:禁止・高リスクのサイバー用途をリアルタイムでブロック。CyberGymスコアは意図的に横ばい。4.6比でミスアラインドな挙動は小幅改善。完全なシステムカードはAnthropicのサイトで公開されています。

価格、トークン効率、CometAPIによる節約

公式価格は同一ですが、タスク当たりの実効コストは低下します。低エフォートの4.7 ≈ 中エフォートの4.6品質であり、成功率の上昇により再試行が減るためです。新しいトークナイザーは同一テキストでも入力トークンを0–35%増やしますが、同等品質でのネット使用量は有利になることが多いです。

CometAPIの利点: 両モデルに**$4 input / $20 output per million tokens**—公式より20%安価—でアクセス可能。さらに、単一のOpenAI互換またはAnthropic Messagesエンドポイントで500以上のモデル(GPT-5.4、Gemini 3.1など)をシームレスに切替。プロバイダの価格変更でもダウンタイムなし。プレイグラウンドでのテストと統合請求により移行が容易。

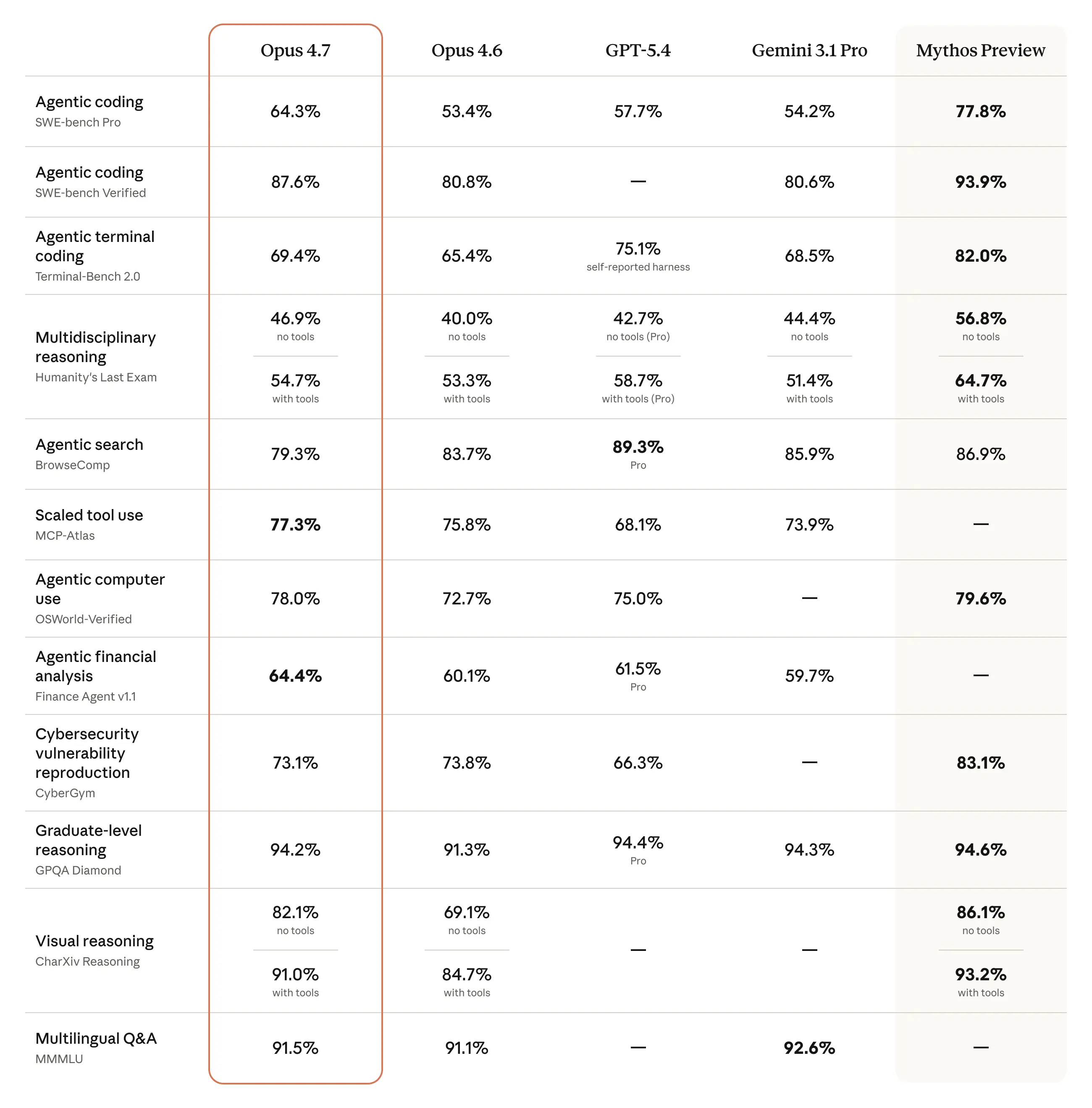

ベンチマーク徹底比較(サイドバイサイド)

Anthropicのローンチデータ(パートナー検証済み)による完全な14ベンチマークのヘッド・トゥ・ヘッド比較:

コーディングベンチマーク

- SWE-bench Verified: 80.8% → 87.6%(+6.8 pp)

- SWE-bench Pro: 53.4% → 64.3%(+10.9 pp)

- Terminal-Bench 2.0: 65.4% → 69.4%(+4.0 pp)

エージェント・ツール利用

- MCP-Atlas: 62.7% → 77.3%(+14.6 pp)—単独最大のジャンプ

- OSWorld-Verified: 72.7% → 78.0%(+5.3 pp)

- Finance Agent: 60.7% → 64.4%(+3.7 pp)

推論・知識

- GPQA Diamond: 91.3% → 94.2%(+2.9 pp)

- HLE(ツールなし): 40.0% → 46.9%(+6.9 pp)

- MMMLU: 91.1% → 91.5%(+0.4 pp)

ビジョン

- CharXiv-R(ツールなし): 68.7% → 82.1%(+13.4 pp)

- CharXiv-R(ツールあり): 77.4% → 91.0%(+13.6 pp)

回帰(透明性)

- BrowseComp: 84.0% → 79.3%(–4.7 pp)—ハーネスに敏感

- CyberGym: 73.8% → 73.1%(–0.7 pp)—安全性のため意図的

社内Research-Agentベンチマーク: 総合0.715(トップタイ)。Financeモジュールは0.767から0.813へジャンプ。

実運用での性能とユースケース

Boxのエージェント型ワークフロー試験では、4.7が同じタスクを**7.1回のLLM呼び出しで完了(4.6は16.3回)**し、AIユニット使用量が30%低下。レイテンシは中央値で242秒から183秒へ短縮。

エンタープライズパートナー(Harvey、Databricks、Hebbia、Ramp、Genspark)からの報告:

- 文書推論のエラーが21%減

- 複数エージェントの数時間にわたる協調が改善

- スライド、スプレッドシート、コードの統合がより緊密に

すぐにアップグレードすべき対象

- Cursor/Claude Codeを利用するソフトウェアエンジニアリングチーム

- 長期自律性を必要とするAIエージェント構築者

- スクリーンショット、図表、UIレビューなどビジョン中心のワークフロー

- ファイナンス、法務、知的業務の自動化

APIの変更点、移行ガイド、コード例

Breaking Changes(Messages API)

- Extended thinking budgetsは削除 →

thinking: {"type": "adaptive"}を使用 - サンプリングパラメータ(

temperatureなど)は受け付けられない → プロンプトで制御 - Thinkingコンテンツはデフォルトで省略

- 新トークナイザーにより

max_tokensに余裕が必要

移行ガイド + コード例(CometAPI)

Step 1: モデル名を claude-opus-4-7(またはCometAPIのエイリアス)に更新

Step 2: 指示の文字通り解釈に備えてプロンプトを監査

Step 3: エフォートレベルをテスト(コーディングにはxhighから開始)

Step 4: タスク予算で支出を上限設定

(Python)

import anthropic

import os

client = anthropic.Anthropic(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI sk- key

base_url="https://www.cometapi.com/console/" # CometAPI base

)

message = client.messages.create(

model="claude-opus-4-7", # or "claude-opus-4-6" for comparison

max_tokens=4096,

temperature=0.7,

effort="xhigh", # New level for deep reasoning

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "Refactor this legacy Python module into clean, type-hinted, testable code. Follow instructions literally: use Pydantic v2, add comprehensive tests, no external deps beyond stdlib + pydantic. Verify your changes before responding."},

{"type": "image", "source": {"type": "base64", "media_type": "image/png", "data": "iVBORw0KGgoAAAANSUhEUg..."} } # High-res screenshot support

]

}

]

)

print(message.content[0].text)

自己検証のデモプロンプト(4.7で大幅に機能向上):

(text):

Plan → Execute → Verify → Report:

1. Analyze the attached codebase.

2. Propose refactors.

3. Implement changes in a new file.

4. Run mental unit tests and edge cases.

5. Only output final verified code if all checks pass.

自分のワークロードでA/Bテストを実行してください—多くのチームが反復回数の20–40%減を確認しています。

注記:

第一に、新しいトークナイザーは同じテキストからより多くのトークンを生成します。Opus 4.7は新トークナイザーを導入し、テキスト処理の品質を改善しました。その代償として同一入力がより多くのトークンにマップされます。正確な数はコンテンツタイプに依存しますが、おおむね1.0〜1.35倍です。

第二に、より高いエフォートレベルは、特に多回ターンのエージェントシナリオで、より包括的な検討を可能にします。

これは信頼性の向上につながりますが、出力トークンも増えます。

公式の解決策は次の3つです:

efficiencyパラメータでエフォートレベルを調整- タスク予算で予算を制限

- プロンプトで「より簡潔に」とモデルに指示

既知の制限と移行メモ

- Extended thinking budgetsは削除 →

thinking: {"type": "adaptive"}を使用。thinking: {type: "enabled", budget_tokens: N}はサポートされません。適応思考を使用してください。 - サンプリングパラメータ(

temperature、top_p、top_k)は受け付けられなくなりました → Opus 4.7へ移行する際はリクエストから削除し、プロンプトで制御。 - モデルはOpus 4.6よりも文字通り・直接的に解釈されるため、精密さに有用ですが、よりシャープなプロンプトが必要になる場合があります。

- 新トークナイザーにより

max_tokensの余裕が必要。Opus 4.7は同一テキストでもより多くのトークンを生成しうるため、ヘッドルームの再確認が推奨されます。 - Thinkingコンテンツはデフォルトで省略。

最終結論と推奨

Claude Opus 4.7は明確な勝者であり、2026年の厳格なコーディング、エージェント型、ビジョン系ワークロードに最適です。向上は漸進的ではなく、プロダクションを変革するレベル。Opus 4.6を使用中なら、今週中に移行してください。より高品質、呼び出し回数の削減、同一(またはCometAPI経由でより低い)価格の組み合わせは、選ばない理由がありません。

アクションステップ:

- CometAPIのプレイグラウンドで自分の実ワークロードを4.7でテスト

- まず1つのサービス(Cursorまたは自社エージェントフレームワーク)を更新

- 初週はトークン使用量をモニタリング

- 500以上のモデルへ統合的かつ安価にアクセスできることを前提に、自信を持ってスケールしてください。