DeepSeek가 V4를 오픈소스 모델 패밀리로 공식 프리뷰 공개했으며, 이번 발표의 핵심은 단순한 “또 다른 모델 업데이트”가 아니다. 이 회사는 V4를 문서 중심 분석, 코딩 어시스턴트, 검색 에이전트, 다단계 자동화 같은 실제 워크로드를 위해 설계된 긴 컨텍스트, 에이전트 친화적 시스템으로 포지셔닝하고 있다. 출시는 웹, 앱, API에서 이미 라이브이며, V4 라인은 공식 서비스 전반에 비용 효율적인 1M-token 컨텍스트 윈도우를 도입한다.

이번 출시가 특히 주목할 만한 이유는 규모와 효율의 결합이다. DeepSeek는 V4-Pro가 1.6T total parameters with 49B active이며, V4-Flash는 284B total parameters with 13B active라고 말한다. 기술 보고서에서 DeepSeek는 V4 아키텍처가 하이브리드 어텐션, MoE 라우팅, 초장문맥의 연산 부담을 줄이면서 에이전트적 행동을 개선하도록 설계된 사후 학습을 사용한다고 주장한다.

What is DeepSeek V4?

DeepSeek-V4는 회사의 최신 프리뷰 플래그십 패밀리이며, 출시에는 두 가지 공개 변형인 V4-Pro와 V4-Flash가 포함된다. DeepSeek는 V4-Pro를 세계 지식, 수학, STEM, 코딩, 에이전트 코딩에서 더 강한 모델로 설명하며, V4-Flash는 응답성이 더 높고 비용 효율적인 옵션이지만 여전히 상당한 추론 품질과 장문맥 능력을 유지한다고 말한다. V4-Pro는 에이전트 코딩과 세계 지식에서 현재 공개 모델을 선도하며, V4-Flash는 속도와 경제적 배포를 지향하도록 설계됐다.

V4는 **Compressed Sparse Attention (CSA)**와 **Heavily Compressed Attention (HCA)**를 결합한 하이브리드 어텐션 아키텍처에 더해 Manifold-Constrained Hyper-Connections와 Muon optimizer를 사용한다. 또한 회사는 모델이 32T tokens 이상으로 사전학습되었으며, 1M 컨텍스트에서 V4-Pro가 DeepSeek-V3.2 대비 **single-token inference FLOPs의 27%**와 **KV 캐시의 10%**만 필요하다고 밝힌다. 이 효율성 스토리가 이번 출시의 진짜 헤드라인이다.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro는 품질을 최우선으로 하는 사용자를 위한 플래그십 모델이다. DeepSeek-V4-Pro는 더 강한 에이전트 코딩 성능, 더 풍부한 세계 지식, 세계적 수준의 추론을 제공하며, 출시 페이지에 따르면 세계 지식에서는 Gemini-3.1-Pro에만 소폭 뒤진다. 기술 보고서에서 V4-Pro는 패밀리 내 더 큰 모델이며, DeepSeek-V4-Pro는 V4-Flash와 동일한 OpenAI 호환 및 Anthropic 호환 인터페이스를 통해 이용 가능하다.

DeepSeek-V4-Flash

V4-Flash는 효율 우선 모델로, 추론 능력은 V4-Pro에 근접하며 단순한 에이전트 작업에서는 V4-Pro와 동등한 성능을 보인다. 더 작은 파라미터 풋프린트와 더 빠른 응답 시간을 사용하면서, 동일한 1M 컨텍스트 길이와 동일한 핵심 기능을 유지한 채 비용을 크게 낮추었고, 사고 모드와 비사고 모드를 모두 지원한다.

Which one should you choose?

작업이 중요도가 높고 지식 의존적이거나 검증이 어려운 경우, 즉 엔터프라이즈 리서치, 복잡한 코딩, 다단계 의사결정 지원, 최강의 답변이 필요한 작업에는 V4-Pro를 사용하라. 처리량, 지연 시간, 토큰 비용이 벤치마크의 마지막 몇 점보다 더 중요하다면 V4-Flash를 사용하라. 이 선택은 공식 포지셔닝과 두 모델 간 보고된 벤치마크 격차와 일치한다.

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | 비사고 + 사고 | 비사고 + 사고 |

| Best fit | 빠른 추론, 고처리량 앱, 비용 민감 에이전트 | 최고 수준의 추론, 어려운 코딩 및 지식 작업 |

| Official API pricing | Cache hit $0.028 / cache miss $0.14 / output $0.28 per 1M tokens | Cache hit $0.145 / cache miss $1.74 / output $3.48 per 1M tokens |

| Max output | 384K | 384K |

CometAPI는 Deepseek v4 Pro와 V4 Flash에 접근을 제공하며 —공식보다 20% 저렴—, 단일 OpenAI 호환 또는 Anthropic Messages 엔드포인트를 통해 500+ 모델(GPT-5.4, Gemini 3.1 등) 간의 손쉬운 전환을 지원한다.

Performance benchmark

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

기본 모델 비교 표에서, V4-Flash와 V4-Pro는 핵심 벤치마크 전반에서 모두 DeepSeek-V3.2를 앞서며, 대체로 V4-Pro가 선두를 차지한다. 예를 들어 보고서에는 다음 점수가 나열되어 있다: AGIEval 82.6 / 83.1 vs V3.2의 80.1; MMLU 88.7 / 90.1 vs 87.8; MMLU-Pro 68.3 / 73.5 vs 65.5; HumanEval 69.5 / 76.8 vs 62.8; LongBench-V2 44.7 / 51.5 vs 40.2, 여기서 가운데 숫자는 V4-Flash, 마지막은 V4-Pro다.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

출처: DeepSeek-V4 기술 보고서, 표 1.

패턴은 명확하다: Flash는 Pro와의 격차를 좁이지만, Pro는 여전히 더 강한 범용 모델이다. 이는 V4-Flash가 많은 프로덕션 시스템에서 실용적인 기본값이 되게 하고, V4-Pro는 비용이나 지연보다 답변 품질이 더 중요한 경우 선택해야 할 모델이 된다.

Western model comparisons: where V4 fits

한 중국 사무직 과제에 대한 인간 평가에서, 보고서는 DeepSeek-V4-Pro-Max가 Claude Opus 4.6-Max를 상회했으며, 63% 무패율을 기록했다고 말한다. DeepSeek-V4-Pro는 Claude Sonnet 4.5를 “현저히 앞서며” R&D 코딩 벤치마크에서 Claude Opus 4.5에 근접한다.

| Evaluation area | DeepSeek result | Western model comparison | What it suggests |

|---|---|---|---|

| Chinese white-collar tasks | V4-Pro-Max, 63% 무패율 | vs Claude Opus 4.6-Max | 실무형 비즈니스 과제에서 강한 성과 |

| R&D coding benchmark | V4-Pro-Max 통과율 67 | vs Claude Sonnet 4.5 at 47; Opus 4.5 at 70; Opus 4.6 Thinking at 80 | 최전선 모델과 경쟁력, 특히 Sonnet급 시스템 대비 강점 |

“모든 면에서 1위”는 아니지만, 이미 “진지하게 평가해야 할” 수준에 도달했다.

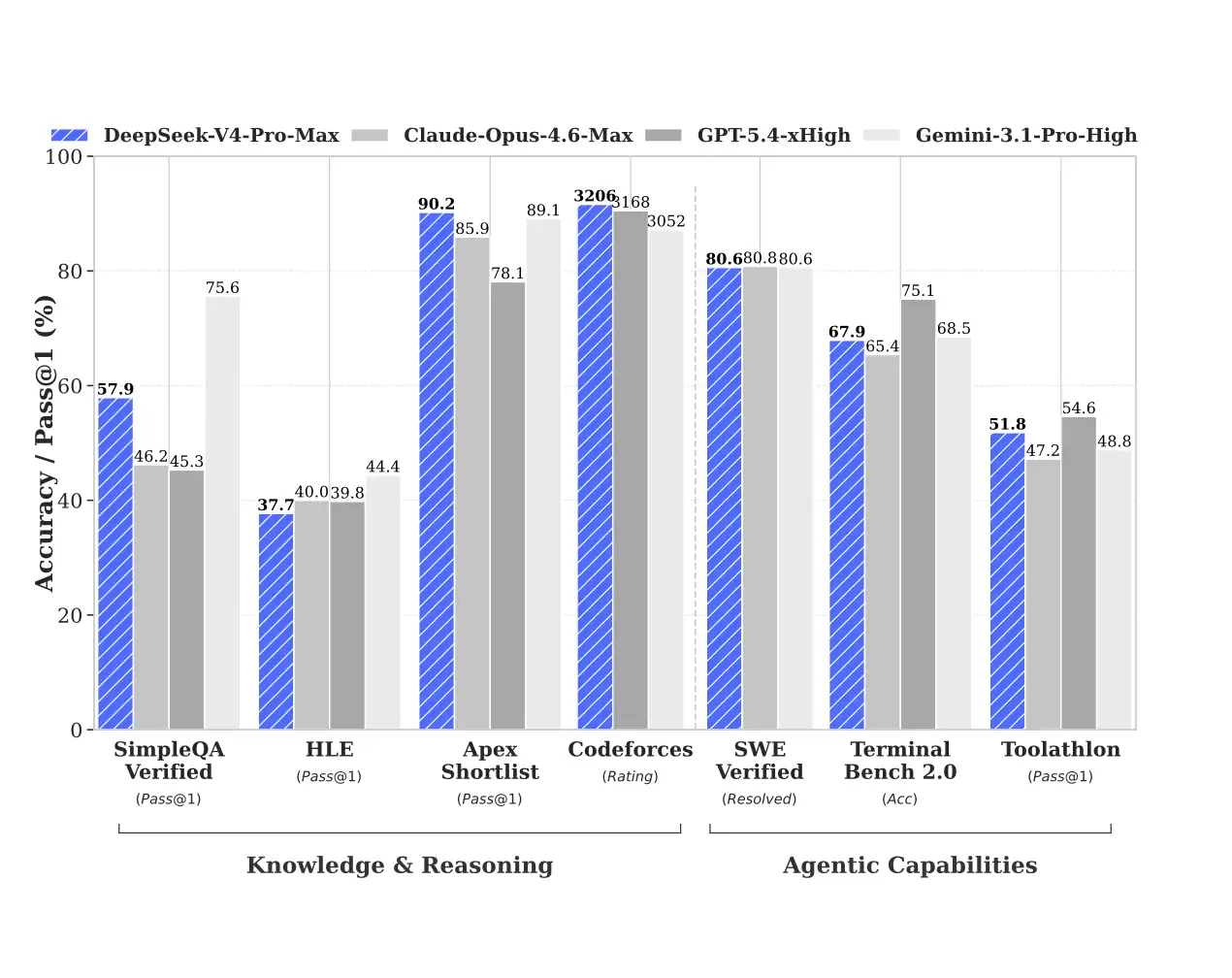

DeepSeek의 기술 보고서는 같은 표에서 V4-Pro-Max를 Claude Opus 4.6 Max, GPT-5.4 xHigh, Gemini 3.1 Pro High와 비교한다. 결과는 단순하지 않다: 서구의 클로즈드소스 모델들은 일부 지식과 추론 측면에서 여전히 강력하게 성능을 내고 있다; 그러나 V4-Pro-Max는 코드, 장문맥, 일부 에이전트 작업에서 매우 강한 존재감을 보인다. 다시 말해, 더 이상 “국내 대안”의 저차원 서사가 아니라, “당신의 시나리오에 더 적합한가”의 단계로 진입했다.

지식과 추론 능력 측면에서, 이는 Opus 4.6 Max, GPT-5.4 xHigh, Gemini 3.1 ProHigh와 대등한 수준이다. 다만 에이전트 역량에서는 약간 뒤처지지만, 그 차이는 크지 않다.

DeepSeek-V4-Pro-Max는 코드 지향 및 장문맥 시나리오에서 매우 경쟁력이 높으며, 서구 모델들은 일부 순수 추론과 지식 벤치마크에서 여전히 매우 강력하다. 이번 출시를 읽는 올바른 방식은 다음과 같다: DeepSeek V4는 확실히 프런티어 대화의 한 축이지만, 벤치마크 리더십은 과제에 따라 달라진다.

How to access DeepSeek V4

1) Use the official web and app

DeepSeek는 V4 Preview가 웹, 앱, API에서 지금 바로 이용 가능하다고 말한다. 일반 사용자에게는 여전히 공식 채팅 인터페이스가 가장 간단한 경로이며, 여기서 모델은 Expert Mode 또는 Instant Mode를 통해 접근할 수 있다.

2) Use the API

DeepSeek V4에 접근하기 위해 CometAPI를 강력히 추천한다. 가격과 집계 측면에서 최적의 장점을 제공한다.

모델 이름은 다음과 같다:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek는 기존 이름인

deepseek-chat과deepseek-reasoner가 더 이상 사용되지며 현재 2026-07-24까지 V4-Flash의 비사고 및 사고 모드에 매핑된다고 말한다. 이는 이미 프로덕션에서 구형 통합을 운영 중이라면 마이그레이션 계획에 중요하다.

- CometAPI에 가입하고 API 키를 받는다.

- 커스텀 base URL로 표준 OpenAI Python SDK(또는 호환 클라이언트)를 사용한다:

다음은 공식 OpenAI 호환 형식을 사용하는 깔끔한 예시다:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

이 요청 패턴은 빠른 시작 가이드를 따른다: base URL을 설정하고, deepseek-v4-pro 또는 deepseek-v4-flash를 선택한 뒤, 더 깊은 추론이 필요할 때 thinking을 활성화한다.

How to use DeepSeek V4 effectively

장문서 워크플로우에서는 컨텍스트를 깔끔하고 구조화해 두는 것이 가장 강력한 패턴이다. V4의 1M 토큰 윈도우는 큰 장점이지만, 입력이 섹션, 소스 발췌, 작업 지시, 명확한 출력 제약으로 구성될 때 모델이 가장 잘 작동한다. 이것이 DeepSeek가 광고하는 장문맥 능력을 가장 자연스럽게 활용하는 방법이다.

코드 및 에이전트 워크플로우에서는 빠른 반복을 위해 먼저 V4-Flash로 시작한 뒤, 최종 실행이나 가장 어려운 단계에서는 V4-Pro로 상향하라. 이 접근은 공식 포지셔닝과도 맞아떨어진다: Flash는 효율적인 옵션이고, Pro는 더 강한 모델이며, 둘은 동일한 API 표면과 컨텍스트 길이를 공유한다.

Final word

DeepSeek-V4는 시장이 한동안 요구해 온 네 가지를 동시에 결합했다: 긴 컨텍스트, 강한 추론, 공개 접근성, 공격적인 가격 책정. 진짜 이야기는 DeepSeek가 또 하나의 모델을 내놓았다는 것이 아니다. 이 회사가 프런티어급 AI를 프로덕션에서 경제적으로 사용 가능하게 만들려 한다는 점이다. 다음 AI 베팅의 위치를 평가하는 팀에게 이는 무시할 수 없는, 반드시 테스트해야 할 신호다.

여러 제공사를 걸쳐 빌드하는 팀에게, 이번 출시야말로 자체 스택에서 벤치마킹할 가치가 있다. CometAPI는 시장이 변할 때마다 제품 팀이 통합을 매번 재구축하지 않고도 DeepSeek-V4를 다른 프런티어 모델과 나란히 비교할 수 있는 실용적 레이어가 될 수 있다.