as of 2025년 12월 15일 the public facts show Google’s Gemini 3 Pro (프리뷰) and OpenAI’s GPT-5.2 both set new frontiers in reasoning, multimodality and long-context work — but they take different engineering routes (Gemini → sparse MoE + huge context; GPT-5.2 → dense/“routing” designs, compaction and x-high reasoning modes) and therefore trade off peak benchmark wins vs. engineering predictability, tooling, and ecosystem. Which is “better” depends on your primary need: 극단적 컨텍스트, 멀티모달 에이전트형 애플리케이션은 Gemini 3 Pro 쪽으로, 안정적인 엔터프라이즈 개발자 툴링, 예측 가능한 비용, 즉시 사용 가능한 API는 GPT-5.2가 유리하다.

GPT-5.2는 무엇이며 주요 기능은 무엇인가요?

GPT-5.2는 OpenAI가 2025년 12월 11일에 공개한 GPT-5 패밀리(variants: Instant, Thinking, Pro)의 릴리스다. 스프레드시트, 프레젠테이션, 장기 컨텍스트 추론, 도구 호출, 코드 생성, 비전 작업에 최적화된 “전문 지식 업무”용 최고 성능 모델로 포지셔닝되었다. GPT-5.2는 유료 ChatGPT 사용자와 OpenAI API(Responses API / Chat Completions)를 통해 gpt-5.2, gpt-5.2-chat-latest, gpt-5.2-pro 등의 모델명으로 제공된다.

모델 변형 및 사용 의도

- gpt-5.2 / GPT-5.2 (Thinking) — 복잡한 다단계 추론에 최적(Responses API에서 기본 “Thinking” 패밀리 변형).

- gpt-5.2-chat-latest / Instant — 낮은 지연의 일상형 어시스턴트와 채팅용.

- gpt-5.2-pro / Pro — 가장 어려운 문제를 위한 최고 충실도/신뢰성(추가 연산,

reasoning_effort: "xhigh"지원).

핵심 기술 기능(사용자 관점)

- Vision & 멀티모달 개선 — 이미지에서의 공간 추론 강화, 코드 도구(Python tool)와 결합 시 동영상 이해 향상, 코드 인터프리터 스타일 도구로 스니펫 실행 지원.

- 구성 가능한 추론 강도 (

reasoning_effort: none|minimal|low|medium|high|xhigh)로 지연/비용과 깊이를 트레이드오프.xhigh는 GPT-5.2에서 새롭게 도입(Pro에서 지원). - 향상된 장기 컨텍스트 처리 및 컴팩션 기능으로 수십만 토큰에 걸친 추론을 지원(OpenAI는 MRCRv2/장기 컨텍스트 지표에서 강력한 성능을 보고).

- 고도화된 도구 호출 & 에이전트형 워크플로우 — 멀티턴 조정 강화, 단일 메가-에이전트 스타일 아키텍처 전반에서의 도구 오케스트레이션 개선(OpenAI는 Tau2-bench 도구 성능을 강조).

Gemini 3 Pro Preview란?

Gemini 3 Pro Preview는 2025년 11월에 공개된 더 넓은 Gemini 3 패밀리의 일부로, Google이 선보인 가장 진보된 생성형 AI 모델이다. 텍스트, 이미지, 동영상, 오디오를 이해하고 종합하는 멀티모달 이해에 중점을 두었고, 방대한 문서나 코드베이스를 처리하기 위한 큰 컨텍스트 윈도우(~100만 토큰)를 갖춘 것이 특징이다.

Google은 Gemini 3 Pro를 추론의 깊이와 미묘함에서 최첨단으로 포지셔닝하며, Google AI Studio, Vertex AI, Google Antigravity 같은 에이전트 개발 플랫폼 등 다양한 개발자 및 엔터프라이즈 도구의 핵심 엔진으로 제공한다.

현재 Gemini 3 Pro는 프리뷰 단계로, 기능과 접근성은 계속 확대되는 중이지만, 이미 논리·멀티모달 이해·에이전트형 워크플로우 전반의 벤치마크에서 높은 성능을 보여준다.

핵심 기술 & 제품 기능

- 컨텍스트 윈도우: Gemini 3 Pro Preview는 1,000,000-토큰 입력(input) 컨텍스트 윈도우(및 최대 64k 토큰 출력)를 지원하여, 매우 큰 문서, 서적, 동영상 트랜스크립트를 단일 요청으로 처리하는 실질적 이점을 제공한다.

- API 기능: 지연과 추론 깊이를 절충하기 위한

thinking_level파라미터(low/high), 멀티모달 충실도와 토큰 사용량을 제어하는media_resolution설정, 검색 그라운딩, 파일/URL 컨텍스트, 코드 실행 및 함수 호출 지원. Thought signatures와 컨텍스트 캐싱으로 멀티콜 워크플로우 전반의 상태 유지를 돕는다. - Deep Think 모드/고차 추론: “Deep Think” 옵션은 까다로운 벤치마크에서 점수를 끌어올리기 위해 추가 추론 패스를 제공. Google은 복잡한 문제용 고성능 경로로 Deep Think를 별도 공개.;

- 네이티브 멀티모달 지원: 텍스트, 이미지, 오디오, 동영상 입력과 검색 및 제품 통합에 대한 견고한 그라운딩(Video-MMMU 등 멀티모달 벤치마크에서 강점).

빠른 미리보기 — GPT-5.2 vs Gemini 3 Pro

가장 중요한 사실을 담은 간결한 비교 표(출처 기재).

| Aspect | GPT-5.2 (OpenAI) | Gemini 3 Pro (Google / DeepMind) |

|---|---|---|

| Vendor / positioning | OpenAI — 전문 지식 업무, 코딩, 에이전트형 워크플로우에 초점을 둔 GPT-5.x 플래그십 업그레이드. | Google DeepMind / Google AI — 초장문맥 멀티모달 추론과 도구 통합에 초점을 둔 Gemini 플래그십 세대. |

| Main model flavors | Instant, Thinking, Pro(및 자동 전환). Pro는 더 높은 추론 강도 제공. | Gemini 3 패밀리(Gemini 3 Pro와 Deep-Think 모드 포함); 멀티모달/에이전트 초점. |

| Context window (input / output) | ~400,000 토큰 총 입력 용량; 최대 128,000 출력/추론 토큰(매우 긴 문서와 코드베이스용으로 설계). | 최대 ~1,000,000 토큰 입력/컨텍스트 윈도우(1M) 및 최대 64K-토큰 출력 |

| Key strengths / focus | 장기 컨텍스트 추론, 에이전트형 도구 호출, 코딩, 구조화된 업무(스프레드시트, 프레젠테이션); 신뢰성을 강조하는 안전/시스템 카드 업데이트. | 대규모 멀티모달 이해, 추론 + 이미지 합성, 매우 큰 컨텍스트 + “Deep Think” 추론 모드, Google 에코시스템과의 강력한 도구/에이전트 통합. |

| Multimodal & image capabilities | 비전 및 멀티모달 그라운딩 강화; 도구 사용과 문서 분석에 최적화. | 고충실도 이미지 생성 + 추론 강화 합성, 다중 참조 이미지 편집과 가독성 있는 텍스트 렌더링. |

| Latency / interactivity | 공급사는 이전 GPT-5.x 대비 더 빠른 추론과 프롬프트 반응성(낮은 지연)을 강조; 여러 티어(Instant / Thinking / Pro). | Google은 최적화된 “Flash”/서빙과 많은 플로우에서 동급의 인터랙티브 속도를 강조; Deep Think 모드는 더 깊은 추론을 위해 지연과 맞바꿈. |

| Notable features / differentiators | 추론 강도 수준(medium/high/xhigh), 향상된 도구 호출, 고품질 코드 생성, 엔터프라이즈 워크플로우를 위한 높은 토큰 효율. | 1M 토큰 컨텍스트, 강력한 네이티브 멀티모달 인제스트(비디오/오디오), “Deep Think” 추론 모드, Google 제품과의 긴밀한 통합(Docs/Drive/NotebookLM). |

| Typical best uses (short) | 장문서 분석, 에이전트형 워크플로우, 복잡한 코딩 프로젝트, 엔터프라이즈 자동화(스프레드시트/리포트). | 극대형 멀티모달 프로젝트, 1M-토큰 컨텍스트가 필요한 장기 지평선 에이전트 워크플로우, 고급 이미지 + 추론 파이프라인. |

GPT-5.2와 Gemini 3 Pro는 아키텍처 측면에서 어떻게 비교되나요?

코어 아키텍처

- 벤치마크/실제 업무 평가: GPT-5.2 Thinking은 GDPval(44개 직종 지식 업무 평가)에서 70.9% 승/무를 기록하고, 이전 GPT-5 변형 대비 엔지니어링과 수학 벤치마크에서 큰 향상을 보였다. 코딩(SWE-Bench Pro)과 도메인 과학 QA(GPQA Diamond)에서 큰 개선. 일부 GDPval 작업에서 인간 전문가 대비 11배 속도 / <1% 비용을 보였고(경제적 가치의 잠재력 지표, 70.9% vs. 이전 ~38.8%), 스프레드시트 모델링에서도 유의미한 개선을 시연(GPT-5.1 대비 주니어 IB 작업 +9.3% 등).

- Gemini 3 Pro: 희소 Mixture-of-Experts Transformer(MoE). 토큰당 소수의 전문가만 활성화하여, 토큰당 연산을 아끼면서도 매우 큰 총 파라미터 용량을 가능하게 한다. Google은 Sparse MoE 설계가 성능 향상의 핵심 기여자임을 모델 카드에 명시. 이 아키텍처로 추론 비용을 선형적으로 늘리지 않고도 모델 용량을 훨씬 높일 수 있다.

- GPT-5.2 (OpenAI): OpenAI는 GPT-5 패밀리에서 라우팅/컴팩션 전략을 갖춘 Transformer 기반 아키텍처를 지속(“router”가 Instant vs Thinking 같은 모드를 트리거하며, 장기 과업을 위한 컴팩션/토큰 관리 기법을 문서화). GPT-5.2는 대규모 희소 MoE 공개 대신, 답변 전 사고(think before answering)와 장기 과업용 컴팩션에 초점을 맞춘 학습/평가를 강조.

아키텍처의 함의

- 지연 및 비용 트레이드오프: Gemini 3 Pro 같은 MoE 모델은 토큰당 일부 전문가만 실행되므로, 많은 작업에서 추론 비용을 낮추면서도 토큰당 최고 능력을 제공할 수 있다. 다만 서빙/스케줄링 복잡성(콜드스타트 전문가 밸런싱, IO)이 늘 수 있다. GPT-5.2의 접근(컴팩션이 포함된 덴스/라우팅)은 예측 가능한 지연과 개발자 경험에 유리—특히 Responses, Realtime, Assistants, 배치 API 같은 OpenAI 도구에 통합될 때 강점.

- 장기 컨텍스트 스케일링: Gemini의 1M 입력 토큰 능력은 매우 긴 문서와 멀티모달 스트림을 네이티브로 투입 가능하게 한다. GPT-5.2의 ~400k 결합 컨텍스트(입력+출력)도 거대하며 대부분 엔터프라이즈 요구를 충족하지만, 수치상 Gemini의 1M보다 작다. 대규모 코퍼스나 수시간 분량의 동영상 트랜스크립트에는 Gemini의 스펙이 분명한 기술적 이점.

툴링, 에이전트, 멀티모달 파이프라인

- OpenAI: 도구 호출, Python 실행, “Pro” 추론 모드, 유료 에이전트 생태계(ChatGPT Agents/엔터프라이즈 도구 통합)에 깊이 통합. 코드 중심 워크플로우와 스프레드시트/슬라이드 생성을 1급 산출물로 강조.

- Google / Gemini: Google Search 그라운딩(선택 과금), 코드 실행, URL/파일 컨텍스트, 시각적 충실도와 토큰을 절충하는 명시적 미디어 해상도 제어를 내장. API는

thinking_level등 비용/지연/품질을 조정할 수 있는 옵션 제공.

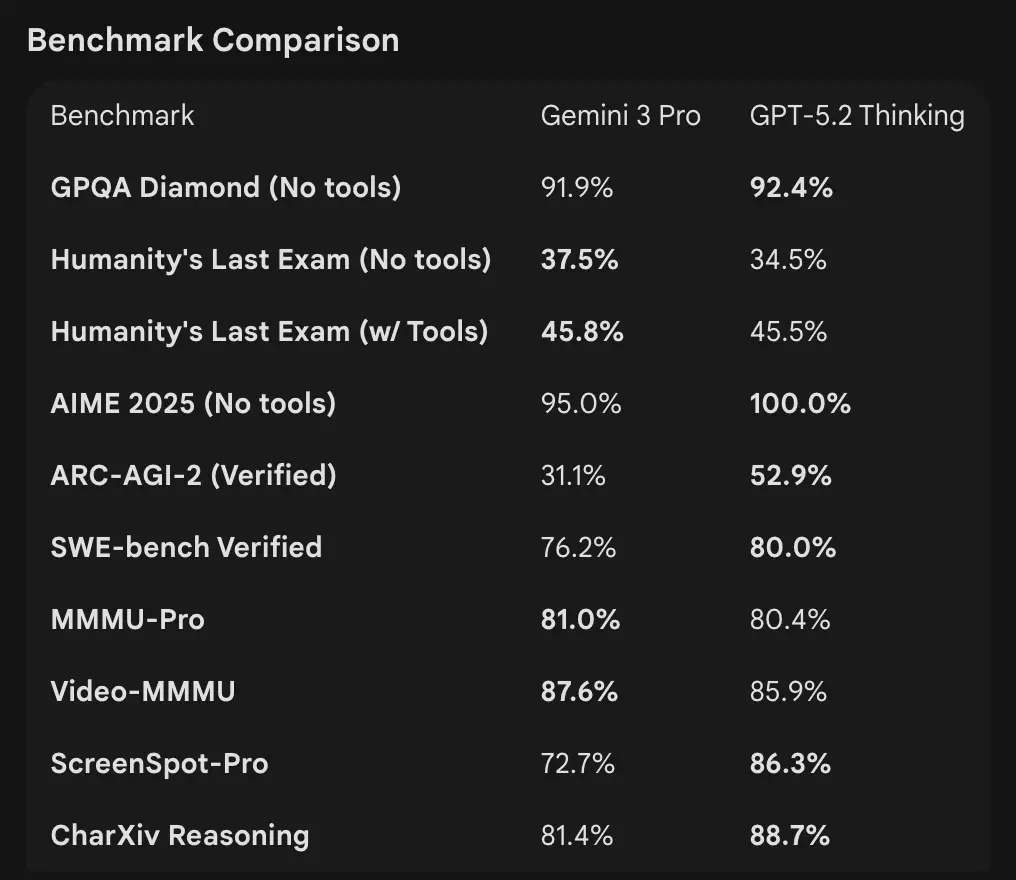

벤치마크 수치는 어떻게 비교되나요

컨텍스트 윈도우와 토큰 처리

- Gemini 3 Pro Preview: 1,000,000 입력 토큰 / 64k 출력 토큰(Pro 프리뷰 모델 카드). 지식 컷오프: 2025년 1월(Google).

- GPT-5.2: OpenAI는 장기 컨텍스트 성능(MRCRv2에서 4k–256k 니들 태스크의 다수 설정에서 >85–95% 범위)과 컴팩션 기능을 시연; API 사용 시 변형별 윈도우를 명시하고(단일 1M 수치보다 컴팩션을 강조)

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-pro모델명이 제공된다.

추론 및 에이전트형 벤치마크

- OpenAI(선별): Tau2-bench Telecom 98.7%(GPT-5.2 Thinking), 다단계 도구 사용과 에이전트형 작업에서 강한 향상(OpenAI는 다중 에이전트 시스템을 “메가-에이전트”로 수렴하는 사례를 강조). GPQA Diamond와 ARC-AGI에서 GPT-5.1 대비 단계적 상승.

- Google(선별): Gemini 3 Pro: LMArena 1501 Elo, MMMU-Pro 81%, Video-MMMU 87.6%, 높은 GPQA와 Humanity’s Last Exam 점수; 장기 계획 수립을 통한 에이전트형 예시도 강력.

툴링 & 에이전트:

GPT-5.2: 도구 호출, Python 실행, 에이전트형 워크플로우(문서 검색, 파일 분석, 데이터 사이언스 에이전트)에 대한 강력한 기본 지원. 일부 GDPval 작업에서 인간 전문가 대비 11배 속도 / <1% 비용(경제적 가치 지표, 70.9% vs. 이전 ~38.8%), 스프레드시트 모델링에서도 구체적 향상(GPT-5.1 대비 +9.3%)을 보임.

해석: 벤치마크는 상호 보완적이다 — OpenAI는 실제 지식 업무 벤치마크(GDPval)를 강조하여 GPT-5.2가 스프레드시트, 슬라이드, 긴 에이전트 시퀀스 같은 프로덕션 과업에 뛰어남을 보여준다. Google은 원시 추론 리더보드와 매우 큰 단일 요청 컨텍스트 윈도우를 강조한다. 무엇이 더 중요한지는 워크로드에 달려 있다: 에이전트형, 장문서 엔터프라이즈 파이프라인은 GPT-5.2의 검증된 GDPval 성과가 유리하고, 거대한 원시 컨텍스트(예: 전체 동영상 코퍼스/서적을 한 번에 투입)는 Gemini의 1M 입력 윈도우가 매력적이다.

멀티모달 역량은 어떻게 비교되나요?

입력 & 출력

- Gemini 3 Pro Preview: 텍스트, 이미지, 동영상, 오디오, PDF 입력과 텍스트 출력을 지원; Google은 멀티모달 작업의 비용-충실도 절충을 위한 세밀한

media_resolution제어와thinking_level파라미터를 제공. 출력 토큰 상한 64k; 입력은 최대 1M 토큰. - GPT-5.2: 풍부한 비전 및 멀티모달 워크플로우를 지원; 이미지 내 공간 추론(컴포넌트 경계 추정 라벨) 개선, 동영상 이해(Video MMMU 점수) 및 도구 기반 비전(비전 작업에서 Python tool 사용 시 점수 향상)을 강조. 복잡한 비전+코드 과업은 도구 지원(Python 코드 실행)이 활성화될 때 크게 이득.

실무상 차이

세분화 vs. 범위: Gemini는 미디어 유형별로 비용-품질 절충을 조정하게 하는(media_resolution, thinking_level) 멀티모달 노브를 제공한다. GPT-5.2는 비전, 코드, 데이터 변환 과업을 결합하기 위한 통합 도구 사용(루프 내 Python 실행)을 강조한다. 동영상+이미지 분석이 매우 크고 컨텍스트가 극단적으로 긴 경우엔 Gemini의 1M 컨텍스트가 설득력 있고, 워크플로우에서 루프 내 코드 실행(데이터 변환, 스프레드시트 생성)이 필수라면 GPT-5.2의 코드 툴링과 에이전트 친화성이 더 편리할 수 있다.

API 접근, SDK, 가격은 어떤가요?

OpenAI GPT-5.2(API & 가격)

- API: Responses API / Chat Completions를 통해

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-pro. 성숙한 SDK(Python/JS), cookbook 가이드, 탄탄한 생태계. - 가격(공개): $1.75 / 100만 입력 토큰, $14 / 100만 출력 토큰; 캐시된 입력에 대해 90% 캐싱 할인으로 반복 데이터의 실효 비용 절감. OpenAI는 토큰 효율성(토큰 단가는 높아도 목표 품질 도달까지 총비용은 낮음)을 강조.

Gemini 3 Pro Preview(API & 가격)

- API: Google GenAI SDK와 Vertex AI/GenerativeLanguage 엔드포인트를 통한

gemini-3-pro-preview. 새로운 파라미터(thinking_level,media_resolution)와 Google 그라운딩/도구 통합. - 가격(공개 프리뷰): 대략 $2 / 100만 입력 토큰, $12 / 100만 출력 토큰(200k 토큰 이하 프리뷰 티어 기준); Search 그라운딩, Maps 등 Google 서비스는 추가 과금 가능(Search 그라운딩 과금은 2026년 1월 5일 시작).

CometAPI를 통해 GPT-5.2와 Gemini 3를 함께 사용

CometAPI는 게이트웨이/집계형 API로, 단일 OpenAI-스타일 REST API 엔드포인트에서 다양한 벤더의 수백 개 모델(LLM, 이미지/동영상 모델, 임베딩 모델 등)에 통합 접근을 제공한다. 다수의 벤더 SDK를 따로 통합하는 대신, 친숙한 OpenAI 형식(chat/completions/embeddings/images)으로 호출하면서 백엔드 모델이나 벤더를 전환할 수 있도록 한다.

개발자는 CometAPI 를 통해 두 회사의 플래그십 모델을 동시에 활용할 수 있고, API 가격은 더 합리적이며 일반적으로 20% 저렴하다.

예시: 빠른 API 스니펫(복사-붙여넣기 실행)

아래는 최소 예시로, 벤더 공개 퀵스타트를 반영(OpenAI Responses API + Google GenAI client). $OPENAI_API_KEY / $GEMINI_API_KEY를 본인 키로 교체하세요.

GPT-5.2 — Python(OpenAI Responses API, 난제용 reasoning을 xhigh로 설정)

# Python (requires openai SDK that supports responses API)from openai import OpenAIclient = OpenAI(api_key="YOUR_OPENAI_API_KEY")resp = client.responses.create( model="gpt-5.2-pro", # gpt-5.2 or gpt-5.2-pro input="Summarize this 50k token company report and output a 10-slide presentation outline with speaker notes.", reasoning={"effort": "xhigh"}, # deeper reasoning max_output_tokens=4000)print(resp.output_text) # or inspect resp to get structured outputs / tokens

참고: reasoning.effort로 비용과 깊이를 절충할 수 있다. 일상 채팅 스타일은 gpt-5.2-chat-latest 사용. OpenAI 문서에 responses.create 예시가 있다.

GPT-5.2 — curl(간단)

curl https://api.openai.com/v1/responses \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-5.2", "input": "Write a Python function that converts a PDF with tables into a normalized CSV with typed columns.", "reasoning": {"effort":"high"} }'

(JSON에서 output_text 또는 구조화 출력 확인.)

Gemini 3 Pro Preview — Python(Google GenAI client)

# Python (google genai client) — example from Google docsfrom google import genaiclient = genai.Client(api_key="YOUR_GEMINI_API_KEY")response = client.models.generate_content( model="gemini-3-pro-preview", contents="Find the race condition in this multi-threaded C++ snippet: <paste code here>", config={ "thinkingConfig": {"thinking_level": "high"} })print(response.text)

참고: thinking_level은 모델의 내부 심층 사고를 제어한다; 이미지/동영상에는 media_resolution 설정 가능. REST와 JS 예시는 Google의 Gemini 개발자 가이드를 참고.;

Gemini 3 Pro — curl(REST)

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-preview:generateContent" \ -H "x-goog-api-key: $GEMINI_API_KEY" \ -H "Content-Type: application/json" \ -X POST \ -d '{ "contents": [{ "parts": [{"text": "Explain the race condition in this C++ code: ..."}] }], "generationConfig": {"thinkingConfig": {"thinkingLevel": "high"}} }'

Google 문서에는 멀티모달 예시(인라인 이미지 데이터, media_resolution)가 포함되어 있다.

어느 모델이 “더 낫나” — 실무 가이드

범용 “승자”는 없다; 대신 사용 사례와 제약에 따라 선택하라. 아래는 간단한 의사결정 매트릭스다.

다음과 같다면 GPT-5.2를 선택

- 코드 실행 도구(OpenAI의 interpreter/도구 생태계)와의 긴밀한 통합이 필요할 때: 프로그램형 데이터 파이프라인, 스프레드시트 생성, 에이전트형 코드 워크플로우. OpenAI는 Python tool 개선과 메가-에이전트 사용을 강조.

- 벤더 주장 기준 토큰 효율성을 중시하고, 캐시된 입력에 대한 대규모 할인(90%)이 있는 예측 가능한 OpenAI 토큰 과금을 원할 때(배치/프로덕션 워크플로우에 유리).

- OpenAI 생태계(ChatGPT 제품 통합, Azure/마이크로소프트 파트너십, Responses API와 Codex 주변 툴링)를 원할 때.

다음과 같다면 Gemini 3 Pro를 선택

- **극단적 멀티모달 입력(동영상 + 이미지 + 오디오 + PDF)**이 필요하고, 1,000,000 토큰 입력 윈도우로 이 모든 입력을 네이티브로 받는 단일 모델을 원할 때. Google은 긴 동영상, 대형 문서+동영상 파이프라인, 인터랙티브 Search/AI Mode 사용 사례를 명시적으로 마케팅.&

- Google Cloud / Vertex AI에 구축하고 Google 검색 그라운딩, Vertex 프로비저닝, GenAI 클라이언트 API와의 긴밀한 통합을 원할 때. Google 제품 통합(Search AI Mode, AI Studio, Antigravity 에이전트 툴링) 혜택을 볼 수 있다.

결론: 2026년에 어느 쪽이 더 나은가?

GPT-5.2 vs. Gemini 3 Pro Preview의 승자는 맥락에 따라 달라진다:

- GPT-5.2는 전문 지식 업무, 분석적 깊이, 구조화된 워크플로우에서 앞선다.

- Gemini 3 Pro Preview는 멀티모달 이해, 통합 생태계, 대형 컨텍스트 과업에서 뛰어나다.

보편적 “우위”는 없다 — 두 모델의 강점은 서로 다른 실제 요구를 보완한다. 현명한 도입자는 구체적 사용 사례, 예산 제약, 에코시스템 정합성에 맞춰 모델을 선택해야 한다.

2026년에 분명한 점은 AI 프런티어가 크게 전진했다는 것이며, GPT-5.2와 Gemini 3 Pro 모두 엔터프라이즈와 그 너머에서 지능형 시스템의 한계를 넓히고 있다는 사실이다.

바로 사용해 보고 싶다면 GPT-5.2와 Gemini 3 Pro의 기능을 CometAPI의 Playground에서 체험하고, 자세한 지침은 API 가이드를 참고하세요. 액세스 전에 CometAPI에 로그인하고 API 키를 발급받았는지 확인하세요. CometAPI는 통합을 돕기 위해 공식 가격보다 훨씬 낮은 가격을 제공합니다.

Ready to Go?→ GPT-5.2 및 Gemini 3 Pro 무료 체험 !

If you want to