2026년 2월 5일 Anthropic은 Claude 제품군의 최신 플래그십인 Claude Opus 4.6을 공개했습니다. Opus 4.6은 장기 지향적 지식 작업과 에이전트형 소프트웨어 워크플로에 더욱 집중했으며, 베타 1,000,000 token 컨텍스트 윈도우, Agent Teams라 불리는 정교해진 멀티 에이전트 조정, 그리고 effort 컨트롤로 제어되는 adaptive reasoning 시스템(Adaptive Thinking)을 탑재했습니다. 이 모델은 Claude Developer Platform과 서드파티 애그리게이터 API(예: CometAPI)를 통해 제공되며, 많은 Claude 사용 사례에서 드롭인 업그레이드로 제시됩니다.

What it is Claude Opus 4.6

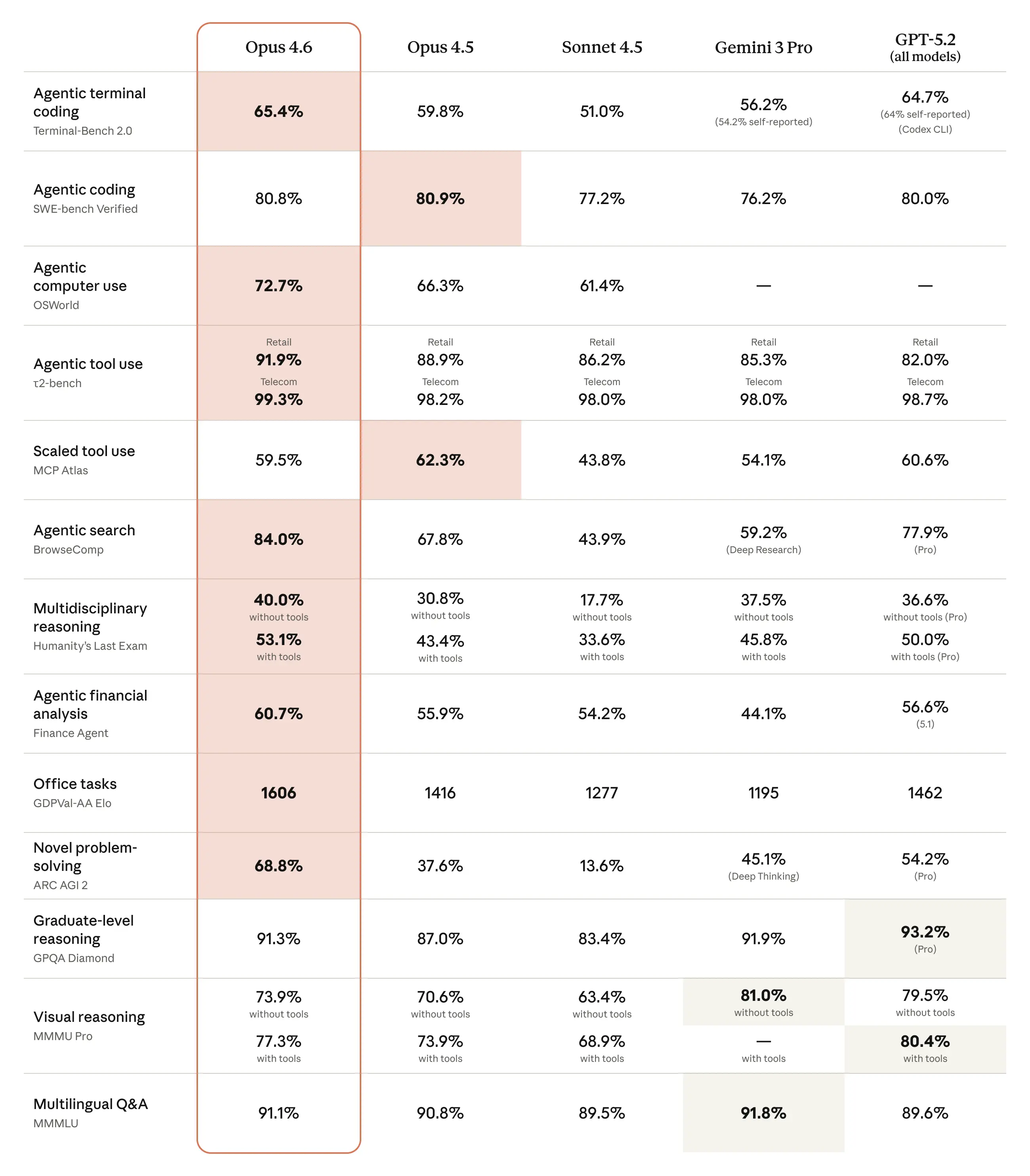

Claude Opus 4.6은 Anthropic의 최신 Opus급 모델로, 코딩, 에이전트형 워크플로, 장문 컨텍스트 추론에서 지금까지 중 가장 강력한 모델로 포지셔닝되어 있습니다. 이번 릴리스는 장기간 유지되는 “agentic” 작업(단계적 코드 마이그레이션, 다중 파일 리팩터링, 조정된 리서치 에이전트 등), 대용량 문서 처리, 엔터프라이즈 통합을 우선시합니다. Anthropic은 Opus 4.6을 4.5에서 거의 드롭인 업그레이드라고 설명하지만, 구현자에게 중요한 여러 동작 및 기능 변화가 포함되어 있습니다.

Key capabilities of Claude Opus 4.6 to know right away

- 1M token context window (beta): Opus 4.6은 매우 큰 컨텍스트 윈도우(Anthropic이 베타로 제공)를 도입하여, 하나의 세션에서 매우 큰 문서나 전체 코드베이스를 보고 추론할 수 있게 합니다. 그 결과, 저장소 전체 리팩터링, 장문의 법률 검토, 다문서 종합과 같은 작업이 훨씬 실용적이 됩니다.

- Agent Teams: Opus 4.6은 여러 Claude 에이전트가 서로 다른 하위 작업을 병렬로 수행하고 상태를 공유하는 에이전트 그룹(Agent Teams)을 통해 에이전트 기능을 확장합니다. 이를 통해 시스템이 어려운 문제를 분해(예: 한 에이전트는 테스트 생성, 다른 에이전트는 리팩터링, 세 번째는 QA)하고 출력을 조정할 수 있도록 설계되었습니다.

- Adaptive Thinking (effort levels): 이젠 이분법적 “thinking” 토글 대신, 지연 시간과 비용을 더 깊은 chain-of-thought과 더 숙고된 추론으로 교환하는 다중 effort 수준(예: low/medium/high/max)을 제공합니다. Anthropic은 또한 긴 대화를 효율적으로 관리하기 위한 컨텍스트 압축 같은 제어 메커니즘도 노출합니다.

- 128K Output Token Budget: Opus 4.6은 이전 최대 출력 예산(64K → 128K)을 두 배로 늘려, 모델이 잘리지 않고 더 길고 지속적인 출력을 제공할 수 있도록 합니다. 다중 파트 보고서나 다수 파일에 걸친 코드 생성에 유용합니다. 이처럼 큰 출력에는 스트리밍을 권장합니다.

기타 실용적 개선 사항으로는 향상된 코딩 및 디버깅 능력, 그리고 엔터프라이즈 및 통합 워크플로를 위한 모드/우선순위 옵션이 포함됩니다(GitHub Copilot 등의 환경에서 Copilot 통합이 이미 롤아웃 중).

Why these features matter (quick take)

- 1M token 윈도우는 반복적인 검색 사이클이나 여러 문서를 여러 호출로 이어붙일 필요를 줄입니다. 단일 호출에 더 많은 컨텍스트를 유지할 수 있어, 많은 지식 집약적 워크플로의 애플리케이션 로직을 단순화합니다.

- Agent Teams는 아키텍처를 바꿉니다. 단일 모놀리식 어시스턴트 대신, 협업하는 소규모 전문 에이전트를 설계합니다. 더 쉬운 병렬화, 명확한 책임, 복잡한 작업에서 잠재적으로 더 높은 신뢰성을 제공합니다.

- Adaptive Thinking은 시간 대비 품질의 트레이드오프를 예측 가능하게 조절할 수 있는 노브를 제공합니다. 이는 지연, 결정성, 비용이 제약인 프로덕션 시스템에서 필수적입니다.

How to call Claude Opus 4.6 via CometAPI — step-by-step

Using CometAPI to call Opus 4.6

여러 벤더에 걸쳐 클라이언트 코드를 표준화하려는 경우, 통합 멀티 모델 게이트웨이를 선호하는 팀이 많습니다. CometAPI는 단일 OpenAI 호환 인터페이스를 통해 많은 벤더 모델을 노출하는 제공업체 중 하나이며, Anthropic의 메시지 포맷도 제공합니다(Anthropic의 API 고유 압축 기능이 필요하고 CometAPI를 통해 Claude Code를 사용하려는 경우). 아래 예시는 프로덕션 사용을 위한 패턴을 보여줍니다: 인증, 모델 선택, 장문 컨텍스트 기능 활성화, 스트리밍, 비용 제어. (Comet가 모델 식별자를 변경하는 경우 제공업체의 모델 레지스트리에 맞게 이름과 헤더를 조정하세요.)

Getting started (developer checklist)

- CometAPI에 등록하고

COMET_API_KEY를 발급받은 뒤, 클라이언트의base_url을https://api.cometapi.com/v1로 설정합니다(Comet는 OpenAI 호환 클라이언트와 예제를 제공합니다). Comet 콘솔에서 사용 가능한 모델과 전달 가능한 공급자별 플래그를 확인할 수 있습니다. - 사전에 기능 설정을 결정하세요:

thinking: {type: "adaptive"},output_config.effort수준,max_tokens(출력 예산), 대용량 출력 시 스트리밍 여부, 그리고 컨텍스트 압축 사용 여부.

Claude API (Python-style pseudo):

import anthropic

import os

# Get your CometAPI key from https://api.cometapi.com/console/token, and paste it here

COMETAPI_KEY = os.environ.get("COMETAPI_KEY") or "<YOUR_COMETAPI_KEY>"

BASE_URL = "https://api.cometapi.com"

client = anthropic.Anthropic(

base_url=BASE_URL,

api_key=COMETAPI_KEY,

)

message = client.messages.create(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "Hello, Claude"}],

)

print(message.content[0].text)

Via CometAPI (OpenAI-compatible shim example):

# Example using an OpenAI-like client pointed at CometAPI

from openai import OpenAI # or compatible client

client = OpenAI(api_key="COMET_KEY", base_url="https://api.cometapi.com/v1")

resp = client.responses.create(

model="claude-opus-4-6",

reasoning={"type":"adaptive"}, # if shim supports same param name

output_config={"effort":"medium"},

messages=[{"role":"user","content":"Generate a migration plan for this monorepo."}]

)

print(resp.output_text)

참고: CometAPI 래퍼의 파라미터 이름은 SDK마다 다를 수 있습니다. CometAPI는 간단한 통합 모델을 문서화하고 있으며, 일반적으로

model="claude-opus-4-6"를 지원합니다. 정확한 필드 매핑과 필요한 요청 형태 조정은 CometAPI 문서를 확인하세요.

Best Practice and Usage

Agent Teams: design patterns and a short recipe

Agent Teams를 사용할 때: 대규모 코드베이스 리팩터링, 다단계 문서 처리, 그리고 자연스럽게 전문 에이전트로 분리되는 워크플로(예: 아키텍트, 구현자, 리뷰어).

Simple Agent Teams pattern:

- Orchestrator agent가 전체 작업을 수신하고 하위 작업으로 분할합니다.

- Worker agents(각각 하나의 Claude 인스턴스)는 집중된 프롬프트와 명확한 성공 기준으로 실행됩니다.

- Parallel work: 워커는 독립 컨텍스트에서 병렬로 실행되며, 결과는 오케스트레이터로 반환됩니다.

- Merge & review: 오케스트레이터가 출력을 압축하고 종합 패스를 수행한 뒤 최종 안전성/리뷰 검사를 진행합니다(필요 시 최종 패스에

effort=max사용).

Practical tips:

- 각 하위 에이전트에 엄격한 시스템 프롬프트와 제한된

max_tokens를 부여하여 비용 폭주를 방지하세요. - CometAPI 또는 오케스트레이션 프레임워크로 병렬 호출과 재시도를 관리하세요.

- 오케스트레이터 히스토리에 컨텍스트 압축을 사용하여, 전체 원문 히스토리를 그대로 유지하지 않고도 결정을 보존하세요.

Context management: handling large inputs and the 1M token window

- 구조화된 인제스트 권장: 문서를 분절된 조각(문서 메타데이터 + 콘텐츠 블록)으로 제공하세요. 앵커 포인트(문서 제목, 인덱스)를 유지하고, 모델이 출처를 인덱스로 인용하도록 요청하세요. 원본 파일을 그대로 붙여넣는 것보다 견고합니다.

- 컨텍스트 압축 사용: 긴 대화형 세션에서는 컨텍스트 압축을 사용해 오래된 턴을 요약하여 핵심 사실을 유지하면서 토큰 예산 소모를 줄이세요. Anthropic은 압축 기능을 베타로 제공합니다.

- 결정적 회상을 원한다면 전체 파일을 매 요청마다 다시 푸시하기보다, 표준 산출물을 자체 DB에 저장하고 ID로 참조하세요. 필요한 단계에서만 요약 또는 발췌를 수행하도록 모델을 사용하세요.

Cost, latency and quality tradeoffs — using effort and other knobs

- Effort: 비용 대비 역량을 균형 있게 맞추는 데 가장 효과적인 컨트롤입니다. 효율이 필요한 프로덕션 시스템에서는

medium을 기본으로 시작하고, 중요 감사, 최종 리뷰, 복잡한 종합 작업에 한해high또는max를 사용하세요.low는 일상적 검색이나 짧은 Q&A에 유용합니다. 많은 팀이medium을 기본으로 하고 필요할 때만effort를 올려 상당한 비용 절감 효과를 보고합니다. - 배치와 캐시: 반복 질문에는 프롬프트 캐싱을, 많은 소규모 유사 작업에는 배치 처리를 사용하여 토큰 재인제스트 비용을 줄이세요. Anthropic 플랫폼과 서드파티 제공업체는 프롬프트 캐싱/배치 모드를 지원합니다.

- 스트리밍 및 청크 출력: 매우 큰 출력(긴 코드 생성, 서적 초안)을 요청할 때는 스트리밍을 사용하여 메모리 압박을 줄이고 조기 수락/중단을 가능하게 하세요.

Final thoughts — where Opus 4.6 changes the developer calculus

Opus 4.6은 많은 짧은 요청을 이어붙이지 않고도 크고 지속 가능한 에이전트형 워크플로를 구축하는 방향으로 분명한 한 걸음을 내딛었습니다. 1M 토큰 윈도우와 Agent Teams는 대규모 코드베이스 자동화, 장문의 법률/재무 검토, 다문서 리서치 어시스턴트 같은 새로운 애플리케이션 범주를 열어주지만, 동시에 설계의 초점을 프롬프트 엔지니어링의 미세 최적화에서 시스템 설계로 이동시킵니다: 산출물을 어떻게 저장하고, 전문가를 어떻게 오케스트레이션하며, 비용을 어떻게 측정/억제하고, 에이전트 행동을 어떻게 모니터링할 것인가.

개발자는 지금 Opus 4.6을 CometAPI를 통해 액세스할 수 있습니다. 시작하려면 Playground에서 모델의 기능을 탐색하고 자세한 지침은 API guide를 참고하세요. 액세스 전에 CometAPI에 로그인하고 API 키를 발급받았는지 확인하십시오. CometAPI는 통합을 돕기 위해 공식 가격보다 훨씬 낮은 가격을 제공합니다.

Ready to Go?→ 지금 openclaw에 가입하세요 !

.png&w=3840&q=75)