Luma AI의 Uni-1은 단순한 새로운 텍스트-투-이미지 모델을 넘어선다. Luma의 자체 프레이밍에 따르면, 이것은 “픽셀을 생성할 수 있는 멀티모달 추론 모델”이며, “Unified Intelligence”를 바탕으로 의도를 이해하고, 지시에 응답하며, “함께 생각한다.” 회사의 기술 보고서는 텍스트와 이미지가 단일 교차 시퀀스로 표현되는 디코더 전용 자기회귀 트랜스포머를 사용하며, Uni-1이 이미지 합성 전과 도중에 구조화된 내부 추론을 수행할 수 있다고 밝힌다. 이러한 조합이 Uni-1을 2026년 가장 흥미로운 이미지 모델 출시 중 하나로 만든다.

UNI-1 이미지 모델이란 무엇인가?

Uni-1은 이해와 생성이 하나의 시스템에서 모두 필요한 작업을 위한 Luma AI의 새로운 이미지 모델이다. Luma는 이를 고전적인 확산 전용 이미지 엔진이 아닌 멀티모달 추론 모델로 제시한다. 이는 모델이 단지 보기 좋게 렌더링된 출력을 만드는 것을 넘어, 지시를 해석하고, 레퍼런스 제약을 유지하며, 생성 과정에서 장면 논리를 추론하도록 설계되었다는 점에서 중요하다. 회사의 기술 보고서는 Uni-1을 멀티모달 범용 지능으로 가는 길에서 최초의 통합 이해-생성 모델로 설명한다.

Uni-1이 다른 점

기존 파이프라인에는 한계가 있다. 이해 없이 이루어지는 이미지 생성은 그 수준이 제한적일 수밖에 없다. Uni-1은 언어, 지각, 상상, 계획, 실행이 하나의 아키텍처 안에서 처리되는 “통합 지능”을 향한 한 걸음으로 제시된다. 이는 단순한 브랜딩을 넘어선다. Uni-1은 단순한 시각적 유사성에서 의도적 구성, 개연성, 장면 논리로 이동할 수 있다.

더 큰 흐름은 이미지 모델이 더 에이전트적으로 변하고 있다는 점이다. Google의 최신 이미지 스택은 대화형 편집, 검색 그라운딩, 다중 이미지 융합, 캐릭터 일관성에 방점을 찍고 있고, OpenAI의 GPT Image 계열은 네이티브 멀티모달리티와 지시 준수를 강조한다. Uni-1도 그 흐름에 합류하지만, 이미지를 그리기 전에 모델이 이미지에 대해 “생각”해야 한다는 발상에 더 강하게 기운다. 이것은 시각적 매력만큼이나 정밀성과 재현성이 중요한 워크플로에서 Uni-1을 특히 흥미롭게 만든다.

Uni-1은 실제로 어떻게 작동하는가?

🔬 토크나이제이션 프로세스

- 텍스트 → 토큰 시퀀스

- 이미지 → 토큰화된 패치

- 이를 단일 교차 시퀀스로 결합

🔁 생성 프로세스

- 입력 프롬프트 + 레퍼런스

- 모델이 내부 추론 수행

- 구성을 계획

- 토큰을 순차적으로 생성

수식적으로: P(x1,...,xn)=∏P(xi∣x1,...,xi−1)P(x_1,...,x_n) = \prod P(x_i | x_1,...,x_{i-1})P(x1,...,xn)=∏P(xi∣x1,...,xi−1)

🧠 내부 추론 레이어

Uni-1:

- 지시를 분해

- 제약을 해소

- 렌더링 전에 레이아웃을 계획

👉 이것은 확산 모델 대비 큰 도약이다.

디코더 전용 자기회귀 생성

가장 중요한 기술적 디테일은 Uni-1이 확산 기반이 아니라 자기회귀 방식이라는 점이다. Luma의 기술 보고서에 따르면 이는 디코더 전용 자기회귀 트랜스포머이며, 텍스트와 이미지가 단일 교차 시퀀스로 인코딩된다. 쉽게 말해, 모델은 단지 노이즈에서 시작해 점진적으로 “디노이즈”하여 이미지를 얻는 것이 아니라, 토큰을 한 단계씩 생성함으로써 렌더링 이전과 도중에 프롬프트를 추론하고, 제약을 해소하며, 구성을 계획할 수 있게 한다.

🔬 토크나이제이션 프로세스

- 텍스트 → 토큰 시퀀스

- 이미지 → 토큰화된 패치

- 이를 단일 교차 시퀀스로 결합

확산 vs 자기회귀

| 기능 | 확산 모델 | Uni-1 (자기회귀) |

|---|---|---|

| 생성 | 노이즈 → 이미지 | 토큰 단위 |

| 추론 | 제한적 | 강함 |

| 편집 | 약함 | 다중 턴 |

| 텍스트 렌더링 | 취약 | 강함 |

| 제어 | 낮음 | 높음 |

코어 아키텍처

Uni-1은:

- 디코더 전용 자기회귀 트랜스포머

- 텍스트 + 이미지에 대한 공용 토큰 공간

이 아키텍처는 프롬프트가 복잡할 때 모델이 일관성을 유지할 수 있게 해 주기 때문에 중요하다. Luma는 Uni-1이 지시를 분해하고, 상충하는 제약을 해결하며, 렌더링이 시작되기 전에 이미지를 계획할 수 있다고 말한다. 이는 구조화된 장면 완성, 다수 피사체 배치, 다중 턴 정교화, 레퍼런스 이미지에 충실하면서 새로운 지시도 따르는 편집 같은 작업에 특히 유용하다.

모델이 더 잘하도록 설계된 부분

이미지를 생성하는 학습은 이해를 향상시킨다. Luma에 따르면 이미지 생성 학습은 특히 영역, 객체, 레이아웃에 대한 미세 수준 시각 이해를 실질적으로 개선한다. 그래서 Uni-1은 단방향 생성기가 아니라, 생성과 이해가 서로를 강화하는 통합 시스템으로 제시된다. 추론 관점에서 이는 Uni-1이 “보기”와 “만들기” 사이의 간극을 좁히려 한다는 의미다. 이것은 확산 모델 대비 큰 도약이다.

Generation Process:

- 입력 프롬프트 + 레퍼런스

- 모델이 내부 추론 수행

- 구성을 계획

- 토큰을 순차적으로 생성

수식적으로: P(x1,...,xn)=∏P(xi∣x1,...,xi−1)P(x_1,...,x_n) = \prod P(x_i | x_1,...,x_{i-1})P(x1,...,xn)=∏P(xi∣x1,...,xi−1)

Uni-1은 어떤 기능과 핵심 장점을 제공하나?

강력한 지시 준수와 직접 조정 가능성

Uni-1의 가장 큰 강점은 제어력이다. 모델은 정밀 편집, 구조화된 레퍼런스 활용, 재현 가능한 워크플로를 위해 구축되었다. 크리에이터에게 이는 프롬프트 운에 의존하는 대신 더 재현 가능한 출력을 의미한다.

실용적인 장점 중 하나는 제어된 반복을 위해 설계되었다는 점이다. 시드는 사용자가 결과를 재현할 수 있게 해 주고, 레퍼런스 역할은 이미지가 캐릭터 정체성, 분위기, 팔레트, 혹은 구성을 안내해야 하는지를 모델이 알게 해 준다. 이는 순수히 프롬프트 중심의 모델보다 지휘하기 더 쉬우며, 특히 광고, 스토리보드, 제품 목업, 브랜드 에셋처럼 일관성이 중요한 팀에 적합하다.

정체성을 보존하는 레퍼런스 기반 생성

큰 장점은 레퍼런스 처리다. Luma는 Uni-1이 소스 그라운딩된 제어를 사용하며, 하나 이상의 레퍼런스에서 정체성, 구성, 핵심 시각적 제약을 보존할 수 있다고 명시한다. 이는 브랜드 캐릭터, 제품 목업, 캠페인 에셋, 그리고 변형 전반에서 피사체가 인지 가능하게 유지되어야 하는 모든 프로젝트 등 상용 워크플로에 매력적이다. 이것은 보다 순수하게 미학 중심의 이미지 시스템과 Uni-1을 구분하는 가장 명확한 지점 중 하나다.

문화적 유창성과 폭넓은 스타일

Luma는 문화 인지적 생성도 강조한다. “Cultured” 섹션에는 밈, 망가, 영화적 룩, 캐주얼 사진, 스포츠, 동물 이미지가 제시되어 있으며, 이는 모델이 하나의 범용 스타일이 아닌 시각적 언어 전반에서 작동하도록 의도되었음을 보여 준다. 이는 현대의 우수한 이미지 모델이 단지 사실적인 장면을 렌더링하는 것뿐 아니라, 인터넷 문화, 에디토리얼 디자인, 스타일화된 일러스트레이션, 소셜 콘텐츠의 시각적 관습도 이해해야 한다는 점에서 중요하다.

설계 선택으로서의 멀티모달적 사고

진정한 차별점은 단지 Uni-1이 이미지를 생성한다는 사실이 아니라, Luma가 이미지 생성을 추론 작업으로 틀 짓는다는 점이다. Uni-1은 구조화된 내부 추론을 수행할 수 있으며, 이미지를 생성하는 학습이 영역, 객체, 레이아웃에 대한 미세 수준 시각 이해를 개선한다. 이는 모델이 단순히 통계적으로 프롬프트를 근사하는 것이 아니라, 렌더링 이전에 장면을 이해하도록 설계되었음을 시사한다.

성능 벤치마크

Luma의 자체 인간 선호도 결과

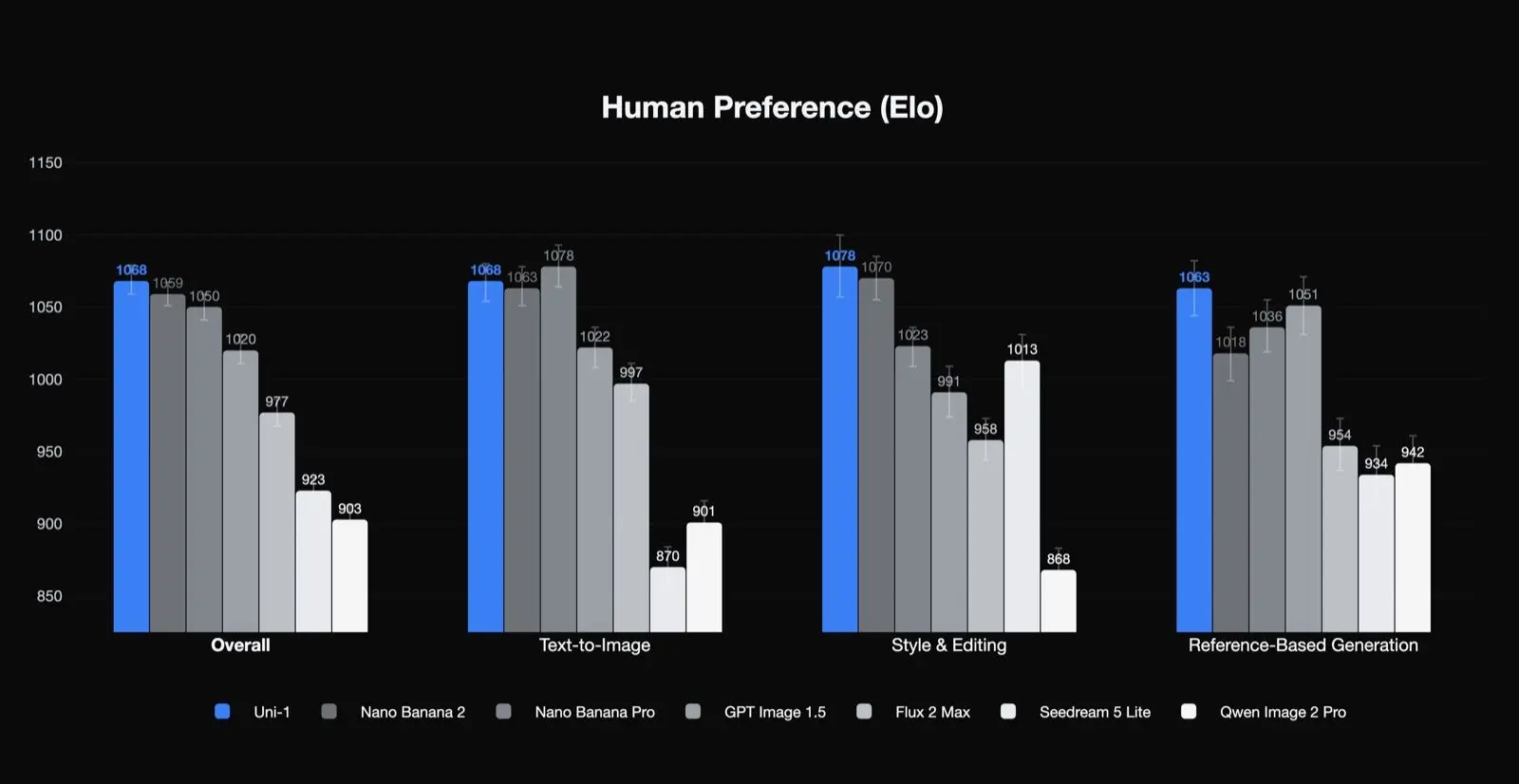

Uni-1은 인간 선호 Elo에서 종합 품질, 스타일 및 편집, 레퍼런스 기반 생성 1위, 텍스트-투-이미지 2위를 기록한다. 이는 모델이 프로덕션 팀이 중요하게 여기는 과제—편집, 일관성, 가이드된 변환—에 특히 강하다는 의미 있는 결과다. 또한 최적의 활용 사례가 단순한 원샷 텍스트-투-이미지 생성만은 아닐 수 있음을 시사한다.

RISEBench: 추론 기반 시각 편집

가장 주목을 끄는 벤치마크는 RISEBench로, 시간적, 인과적, 공간적, 논리적 추론 전반의 추론 기반 시각 편집을 평가한다. Luma의 출시 관련 서드파티 리포팅에 따르면 Uni-1은 전체 RISEBench 점수 0.51로, Google의 Nano Banana 2(0.50), Nano Banana Pro(0.49), OpenAI의 GPT Image 1.5(0.46)보다 앞선다. 공간적 추론에서 Uni-1은 0.58로 보고되며 Nano Banana 2의 0.47을 상회한다. 논리적 추론에서는 Uni-1이 0.32로 보고되어 GPT Image 1.5의 0.15의 두 배 이상이다. 전체적으로 격차가 아주 크지는 않지만, 가장 어려운 추론 카테고리에서 매우 크다.

ODinW-13와 “생성이 이해를 향상”한다는 주장

Uni-1은 개방 어휘 밀집 검출 벤치마크인 ODinW-13에서도 강력한 성능을 보인다. Luma의 기술 데이터에 대한 리포팅에 따르면 전체 모델은 46.2 mAP를 기록하여 Google의 Gemini 3 Pro의 46.3에 거의 근접한다. 같은 리포팅에 따르면 이해 전용 변형은 43.9 mAP를 기록하며, 이는 생성 학습이 이해를 2.3포인트 개선한다는 것을 의미한다. 이는 Luma의 핵심 논지를 뒷받침하는 주목할 만한 발견이다. 즉, 이미지 생성과 이미지 이해는 상호 보완적일 수 있다.

Uni-1 API 가격

| 입력 가격 (텍스트) | $0.50 |

|---|---|

| 입력 가격 (이미지) | $1.20 |

| 출력 가격 (텍스트 및 사고) | $3.00 |

| 출력 가격 (이미지) | $45.45 |

소비자 측면에서, Luma의 가격 페이지는 Plus $30/월, Pro $90/월, Ultra $300/월로 표기되어 있으며, 모든 플랜에 무료 체험 크레딧이 포함된다. 이는 플랫폼을 위한 소비자 멤버십과 프로덕션 용도의 모델 레벨 API 가격이라는 두 겹의 가격 체계를 고려해야 함을 의미한다.

현재 CometAPI의 Uni-1 API는 곧 제공 예정이며, 출시 시 할인 혜택이 약속되어 있다. 현재 CometAPI는 Midjourney와 Nano Banana 2 같은 우수한 원시 이미지 모델도 제공한다.

Uni-1 vs GPT Image 1.5 vs Nano Banana 2

Uni-1 vs Google의 Nano Banana 2

Nano Banana 2는 레퍼런스 처리 범위와 생태계 통합에서 더 강해 보인다. Google은 이미지 검색 그라운딩, 대화형 반복, 최대 14개 레퍼런스를 활용하는 레퍼런스 중심 워크플로를 강조한다. 반면 Uni-1은 통합 모델 아키텍처에서 추론, 장면 개연성, 정밀 편집을 보다 명확히 중심에 둔다. 실용적으로, Google은 속도, 대중적 프로덕션 규모, 네이티브 Google 그라운딩에 최적화된 반면, Luma는 구조화된 시각적 추론과 직접 조정 가능한 이미지 편집에 최적화된 것으로 보인다.

Uni-1에 대한 공개 비교에서 트레이드오프는 명확하다. Nano Banana 2는 순수 텍스트-투-이미지 품질과 속도에서 여전히 매우 강한 반면, Uni-1은 추론 중심 편집, 레퍼런스 제어, 지시 충실도에 더 강하게 기운다.

Uni-1 vs OpenAI의 GPT Image

벤치마크 리포팅에서 Uni-1은 RISEBench 전체에서 GPT Image 1.5를 근소하게 앞서고, 논리적 추론에서는 더 결정적으로 앞선다. OpenAI의 GPT Image 계열과 비교하면, Uni-1은 시각적 추론과 제어된 편집에 보다 좁고 공격적으로 포지셔닝되어 있다. OpenAI의 문서는 세계 지식, 멀티모달 이해, 문맥 인지를 강조하는 반면, Luma의 문서는 구조화된 내부 추론, 레퍼런스 그라운딩 제어, 벤치마크된 시각 편집 능력을 강조한다. 즉, 둘 다 멀티모달이지만 Uni-1은 더 명백한 “이미지 전문가형 추론 모델”이고, GPT Image는 이미지를 매우 잘 생성하는 일반 멀티모달 시스템으로 읽힌다.

세 모델의 가격 비교

가격은 출력 크기와 제품 티어에 따라 달라져 완전히 동일 선상 비교는 어렵다. Uni-1의 공개된 2048px 등가 가격은 이미지당 약 $0.0909이다. Google의 최신 이미지 모델 가격 페이지는 최신 Gemini 이미지 프리뷰에 대해 1K/2K 이미지당 $0.134, 4K 이미지당 $0.24를 제시하며, OpenAI의 GPT Image 가격 페이지는 1024x1024 기준 저품질 출력 이미지당 $0.011, 중간 품질 $0.042, 고품질 $0.167, 더 큰 고품질 출력은 $0.25로 제시한다. 즉, 저가 구간에서는 OpenAI가 훨씬 저렴할 수 있고, Google은 속도와 규모에서 공격적인 가격을 제시하며, Uni-1은 강력한 2K 지향 가격-성능 프로파일로 중간 지점에 위치한다.

철학적 차이

| 모델 | 접근법 |

|---|---|

| Uni-1 | 통합 멀티모달 지능 |

| GPT Image | LLM + 이미지 생성 |

| Nano Banana 2 | 최적화된 프로덕션 확산 |

상세 비교 표

| 기능 | Uni-1 | GPT Image 1.5 | Nano Banana 2 |

|---|---|---|---|

| 아키텍처 | 자기회귀 | 하이브리드 | 확산 |

| 멀티모달 통합 | ✅ 네이티브 | 부분적 | ❌ |

| 추론 능력 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ |

| 이미지 품질 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| 텍스트 렌더링 | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐ |

| 편집 워크플로 | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐⭐ |

| 속도 | 중간 | 빠름 | 빠름 |

| 제어 | 높음 | 중간 | 중간 |

CometAPI는 GPT Image 1.5, Nano Banana 2 및 곧 출시될 Uni-1을 위한 인터랙티브 원시 이미지와 API 프로그래밍을 제공한다. 할인된 가격과 사용량 기반 요금제로 개발자들의 선호 플랫폼이 되고 있다.

Uni-1이 가장 잘하는 것

Uni-1은 재현성, 캐릭터 일관성, 다중 레퍼런스 제어가 필요한 경우에 특히 강해 보인다. 여기에는 브랜드 캠페인, 제품 목업, 에디토리얼 콘셉트, 스토리보드, 지역화 버전, 구성은 유지하되 스타일이나 환경을 변경해야 하는 이미지 편집이 포함된다. Luma의 자체 예시도 이러한 사용 사례에 크게 기울며, 모델의 “Create vs Modify” 구분은 흔한 프로덕션의 고충에 대한 직접적인 해답과 같다.

작업이 대부분 “단일 프롬프트로 예쁜 것을 만들어라”라면 차별점이 덜 극적으로 느껴질 수 있다. 그러나 워크플로가 “연관된 버전 5개를 만들되, 동일한 캐릭터를 유지하고, 프레이밍을 보존하고, 조명을 바꾸고, 다음 주에도 재현 가능하게 하라”라면, Uni-1의 설계가 크게 와닿기 시작한다. 이는 추론이지만 Luma가 강조하는 제어 기능에서 자연스럽게 도출되는 결론이다.

Uni-1에서 더 나은 결과를 얻는 모범 사례

먼저 올바른 모드를 사용하라. Luma의 가이드는 간단하다: 새로운 장면이 필요할 때는 Create, 기존 장면을 보존하려면 Modify. 의도를 섞으면 출력이 불안정해진다.

프로처럼 레퍼런스 라벨을 사용하라. Luma는 “Use IMAGE1 as a STYLE reference”나 “Use IMAGE2 as LIGHTING” 같은 문구를 권장한다. 각 레퍼런스가 구체적인 역할을 갖출 때, 막연한 “영감”보다 모델이 더 잘한다.

좋은 것을 찾으면 시드를 고정하라. Luma는 먼저 시드 없이 탐색한 다음 강한 결과를 얻으면 시드를 저장하라고 명시적으로 권장한다. 이후에는 한 번에 하나의 변수만 변경하라. 이것이 생성을 제어된 프로덕션 시스템으로 전환하는 가장 쉬운 방법이다.

구체적이고 명확하라. Luma는 “아름답다”나 “놀랍다” 같은 모호한 표현을 경계하며, “1970년대 이탈리아 지알로 영화 포스터” 같은 명시적 미학이나 정확한 카메라 스타일 신호를 권장한다. 실제로 구체적인 프롬프트가 시적인 프롬프트보다 대체로 더 뛰어난데, 모델이 실제 구조에 앵커링할 수 있기 때문이다.

Create → Modify 체인을 사용하라. Luma는 이것을 가장 강력한 워크플로 중 하나로 명시한다: Create에서 탐색하고, Modify에서 정제하라. 이는 본격적인 프로덕션 작업의 스위트 스폿으로, 되돌림을 줄이고 구성의 좋은 부분을 보존하면서 디테일을 조인다.

최종 평가

Uni-1은 이미지 생성이 “프롬프트 입력, 그림 출력”에서 추론이 안내하는 시각적 창작으로 이동하고 있음을 보여 주는 Luma의 가장 분명한 선언이다. 공개된 강점은 제어, 레퍼런스 처리, 재현성, 그리고 언어와 픽셀을 같은 시스템 안에 유지하는 모델 아키텍처다.

높은 임팩트의 시각 출력, 일관된 캐릭터, 정밀 편집, 고해상도 가격 명확성을 중시하는 크리에이터와 팀에게 Uni-1은 매우 주목할 만한 모델이다. API 론치가 매끄럽게 진행된다면, 2026년 Google의 Nano Banana 2와 OpenAI의 GPT Image 1.5에 대한 가장 흥미로운 대안 중 하나가 될 수 있다.

원시 이미지 생성을 시작할 계획인가? 멀티모달 모델 API를 한데 모은 원스톱 애그리게이션 플랫폼 CometAPI가 당신을 환영한다!