Pengalaman pembangun dengan analisis video ChatGPT sering tersekat: pautan YouTube terus gagal, dan muat naik MP4 menghasilkan ringkasan “halusinasi” yang terlepas nuansa visual. Ini bukan pepijat—ia ialah batasan seni bina. ChatGPT tidak menstrim video; ia memproses jujukan bingkai yang diekstrak dan teks transkrip. Jadi anda cuba memuat naik fail MP4, yang berfungsi… lebih kurang. Ringkasan menyebut transkrip audio tetapi langsung terlepas jenaka visual dalam adegan ketiga yang membuat keseluruhan video itu masuk akal.

ChatGPT Boleh Menganalisis Video — Tetapi Bukan dengan “Menontonnya” Secara Sebenar

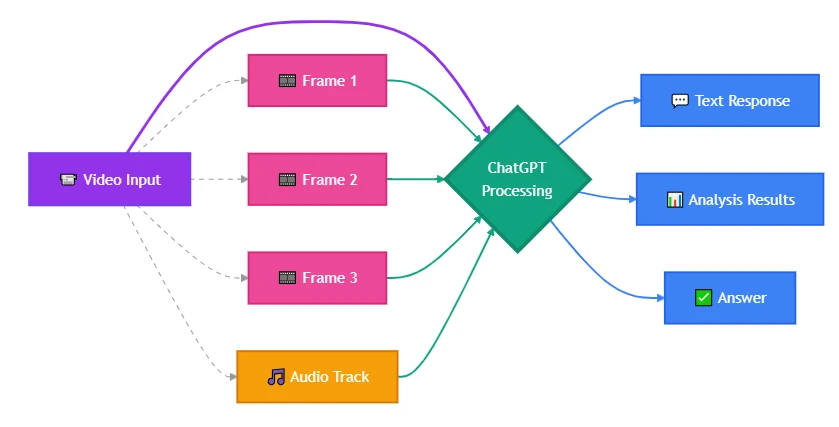

Beginilah yang sebenarnya berlaku: ChatGPT tidak “menonton” video seperti anda. Ia tidak menekan main, menstrim kandungan, dan memerhati pergerakan sepanjang masa. Apa yang dilakukannya ialah memecahkan video kepada komponen yang sudah diketahui cara ditanganinya — imej pegun dan transkrip teks — kemudian membuat penaakulan tentang bahagian-bahagian tersebut secara berasingan. Model melihat video anda sebagai album foto dengan narasi, bukan pengalaman berterusan. Itulah sebabnya ia menangkap penjelasan yang diucapkan tetapi terlepas punchline visual: bingkai yang mengandungi jenaka itu mungkin tidak termasuk dalam set sampel.

Apabila seseorang bertanya “bolehkah ChatGPT menonton video,” mereka biasanya bertanya salah satu daripada dua soalan: Bolehkah ia menstrim kandungan visual seperti pemerhati manusia, atau bolehkah ia mengekstrak dan menganalisis makna daripada data video — adegan, dialog, cap masa, tindakan pada skrin? Jawapan fungsinya ialah ya untuk soalan kedua, dengan kekangan yang merosakkan sesetengah kegunaan sama sekali. Varian ChatGPT moden memproses video dengan memperlakukannya sebagai bingkai yang disampel digabungkan dengan transkripsi audio, sama ada melalui pengektrakan automatik dalam antara muka web atau dengan menerima bingkai yang dibekalkan pengguna melalui API. Ini berfungsi untuk peringkasan, penerangan adegan, dan pengekstrakan teks. Ia gagal untuk penjejakan pergerakan, analisis bergantung masa, atau apa-apa yang memerlukan model “melihat” apa yang berlaku antara bingkai.

Kebanyakan panduan berhenti pada mengesahkan keupayaan wujud tanpa menerangkan mengapa pelaksanaan khusus anda tidak berjaya — atau kaedah input alternatif mana yang patut digunakan.

ChatGPT Keupayaan Video: Apa yang Sebenarnya Dilihat oleh Model

ChatGPT tidak memuatkan MP4 dan melungsurinya bingkai demi bingkai. Ia mempunyai keupayaan visi — keupayaan untuk menganalisis imej statik — dan transkripsi audio melalui integrasi Whisper. Apabila anda menyerahkan video melalui antara muka web atau mudah alih ChatGPT, sistem mengekstrak bingkai utama, menyalin audio secara berasingan, dan memberikan kedua-duanya kepada model sebagai input yang berbeza. Model kemudian menerangkan apa yang “dilihatnya” dalam bingkai tersebut dan apa yang “didengarnya” dalam transkrip.

Daripada perspektif anda, ini kelihatan seperti kefahaman video. Daripada perspektif model, ia adalah analisis imej ditambah pemprosesan teks. Perbezaan seni bina itu menentukan kes penggunaan mana yang berfungsi dan mana yang tidak.

Jika video anda bergantung pada pergerakan, perubahan kecil antara bingkai, atau masa yang tepat — seperti mengesan bila tepat objek memasuki bingkai, atau menjejak bagaimana elemen UI dianimasikan — pendekatan berasaskan bingkai utama akan terlepas. ChatGPT tidak akan menangkap petunjuk visual dua saat yang jatuh di antara bingkai sampel. Ia juga tidak akan menjejak objek merentasi masa melainkan anda menyusun input dengan jelas untuk menunjukkan progresi.

Keupayaan video ChatGPT semasa (seawal 2026):

- Analisis video berasaskan imej: Menerima fail video atau bingkai yang diekstrak; mentafsir kandungan visual daripada imej sampel

- Transkripsi audio: Menukar pertuturan kepada teks melalui Whisper; model kemudian boleh merumus atau menyoal transkrip

- Penerangan adegan: Mengenal pasti objek, tindakan, persekitaran, dan teks yang kelihatan dalam bingkai yang disediakan

- Pertanyaan berasaskan cap masa: Boleh merujuk saat tertentu jika anda menyediakan cap masa bingkai atau membahagi video secara manual

- Pengekstrakan teks: Membaca kapsyen pada skrin, label UI, atau dokumen yang kelihatan dalam bingkai

Kadar pensampelan bingkai khusus dan gelagat pemilihan bingkai utama automatik dalam antara muka web ChatGPT — tidak didokumenkan secara umum sehingga tarikh potongan pengetahuan

Apa yang tidak termasuk:

- Input video penstriman masa nyata melalui API

- Penjejakan pergerakan tepat bingkai atau kekekalan objek merentasi masa

- Sokongan asli untuk codec video — semua pemprosesan berlaku pada bingkai yang diekstrak dan audio

- Pengesanan perubahan adegan automatik tanpa pemintaan eksplisit daripada pengguna

Kapasiti video dihadkan oleh had token dan saiz fail, bukan durasi. Walaupun 5–10 minit ialah heuristik praktikal, had sebenar berskala secara dinamik dengan ketumpatan visual.

Jika kes penggunaan anda memerlukan keupayaan tersebut, sama ada anda pra-memproses video sendiri untuk mengekstrak bingkai yang betul, atau beralih kepada model dengan sokongan video asli. Bahagian seterusnya menghurai kaedah input mana yang harus digunakan untuk senario khusus anda.

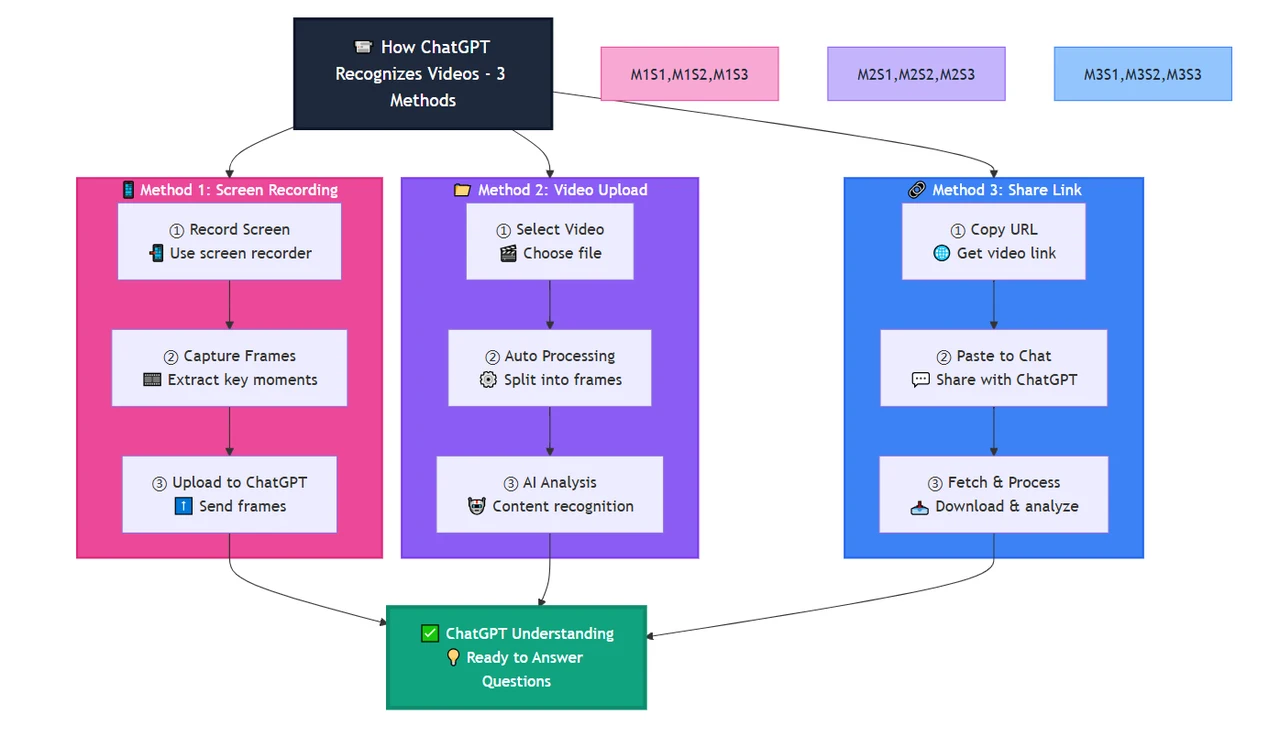

Cara ChatGPT Mengenali Video: Tiga Kaedah Praktikal

Tiada satu cara untuk menyerahkan video kepada ChatGPT. Kaedah yang anda pilih mengawal apa yang boleh dianalisis model dan apa yang akan terlepas. Kebanyakan kegagalan pelaksanaan datang daripada memilih kaedah yang mudah daripada yang betul.

Kaedah 1: Pengekstrakan bingkai manual + muat naik imej

Ekstrak bingkai sendiri menggunakan ffmpeg atau alat serupa, kemudian muat naik bingkai tertentu tersebut sebagai imej. Ini memberi anda kawalan penuh ke atas apa yang ChatGPT analisis.

Contoh aliran kerja(bash):

# Extract one frame every 5 seconds from a video

ffmpeg -i input.mp4 -vf fps=1/5 frame_%04d.png

# Or extract frames only at scene changes

ffmpeg -i input.mp4 -vf "select='gt(scene,0.3)'" -vsync vfr frame_%04d.png

Pendekatan ini membolehkan anda:

- Fokuskan analisis pada saat tertentu (pengenalan, aksi utama, penutup) tanpa membazir konteks pada bahagian yang tidak berkaitan

- Tangkap pergerakan dengan memuat naik bingkai berturutan pada kadar pensampelan pilihan anda

- Mengatasi had saiz fail — imej lebih kecil daripada fail video penuh

- Mengekalkan kualiti bingkai yang mungkin merosot semasa pemampatan automatik

Pertukaran:

Anda mengendalikan pra-pemprosesan sendiri. Untuk menganalisis ratusan video pada skala, ini memerlukan automasi. Untuk analisis mendalam sekali-sekala atau penyahpepijatan adegan tertentu, ini ialah kaedah yang paling boleh dipercayai.

Bila hendak gunakan kaedah ini:

- Anda perlukan analisis tepat bingkai bagi saat tertentu

- Maklumat visual kritikal adalah singkat atau berlaku di antara sela bingkai utama tipikal

- Anda membandingkan perubahan visual merentasi jujukan (perubahan keadaan UI, bingkai animasi)

- Anda mahu mengesahkan apa yang model sebenarnya “lihat” dengan memeriksa bingkai tepat yang anda muat naik

Kaedah 2: Muat naik fail terus melalui antara muka ChatGPT

Aplikasi web ChatGPT dan aplikasi mudah alih menerima muat naik video terus dalam chat. Seret masuk fail MP4 atau MOV ke medan input, dan sistem akan mengendalikan pengekstrakan bingkai dan transkripsi secara automatik.

Apa yang berlaku di belakang tabir:

- Perkhidmatan mensampel bingkai pada sela (kadar khusus tidak didokumenkan; dianggarkan 1–2 bingkai sesaat berdasarkan pemerhatian)

- Audio ditranskripsi melalui Whisper atau perkhidmatan serupa

- Kedua-dua output diberikan kepada model sebagai input konteks berasingan

- Model menjana respons berdasarkan bingkai yang kelihatan dan transkrip yang didengar

Kaedah ini berfungsi untuk:

- Ringkasan video peringkat tinggi di mana anda tidak memerlukan perincian tepat bingkai

- Mengenal pasti objek utama, orang, atau persekitaran yang kekal merentasi adegan

- Mengekstrak kandungan pertuturan atau teks pada skrin yang muncul dalam banyak bingkai

- Analisis penerokaan pantas tanpa pra-pemprosesan

Kaedah ini gagal untuk:

- Analisis tepat bingkai — anda tidak mengawal bingkai mana yang disampel

- Untuk kandungan video lanjutan melebihi kapasiti konteks yang selesa model, segmentasi logik diperlukan. Tanpa penggumpalan strategik atau pra-pemprosesan, model mungkin mengalami degradasi atau pemotongan apabila penggunaan token meningkat dengan data visual berkepadatan tinggi

- Mengesan pergerakan, transisi, atau kandungan bergantung masa yang memerlukan perbandingan bingkai berturutan

- Senario di mana maklumat visual kritikal muncul sebentar antara bingkai sampel

Jika anda perlukan kawalan ke atas saat yang dianalisis, gunakan Kaedah 1.

Kaedah 3: Pautan YouTube + pengambilan transkrip

Sesetengah plugin ChatGPT dan alat pihak ketiga mendakwa “menganalisis video YouTube.” Apa yang sebenarnya mereka lakukan ialah mendapatkan metadata awam dan transkrip video (jika tersedia), kemudian menyerahkan teks itu kepada ChatGPT.

Ini berfungsi apabila:

- Video mempunyai kapsyen automatik atau yang dimuat naik pengguna

- Analisis anda hanya memerlukan kandungan pertuturan, bukan maklumat visual

- Video boleh diakses secara umum (bukan peribadi, tidak tersenarai, atau disekat wilayah)

- Anda merumus kuliah, podcast, atau temubual di mana audio membawa sebahagian besar makna

Ini tidak berfungsi apabila:

- Anda perlu menganalisis kandungan visual (demonstrasi pada skrin, rajah, ekspresi muka)

- Video tiada transkrip atau kapsyen

- Maklumat kritikal muncul secara visual tanpa disebut dalam dialog

- Anda bekerja dengan fail video peribadi atau kandungan di sebalik pengesahan

Kesilapan biasa: Pembangun menjangkakan kefahaman video penuh (visual + audio) tetapi hanya menerima ringkasan transkrip. Ini baik untuk analisis kandungan pertuturan. Ia tidak berguna untuk menyemak demo produk, menganalisis reka bentuk visual, atau mana-mana senario di mana apa yang anda lihat lebih penting daripada apa yang diperkatakan.

Polanya: Kaedah 2 untuk ringkasan pantas apabila ketepatan tidak penting. Kaedah 1 untuk analisis terkawal apabila anda perlukan bingkai tertentu. Kaedah 3 untuk kandungan berfokus audio apabila maklumat visual sekunder atau tidak wujud. Pilih berdasarkan lokasi maklumat kritikal kes penggunaan anda — dalam pergerakan, dalam bingkai tertentu, atau semata-mata dalam dialog.

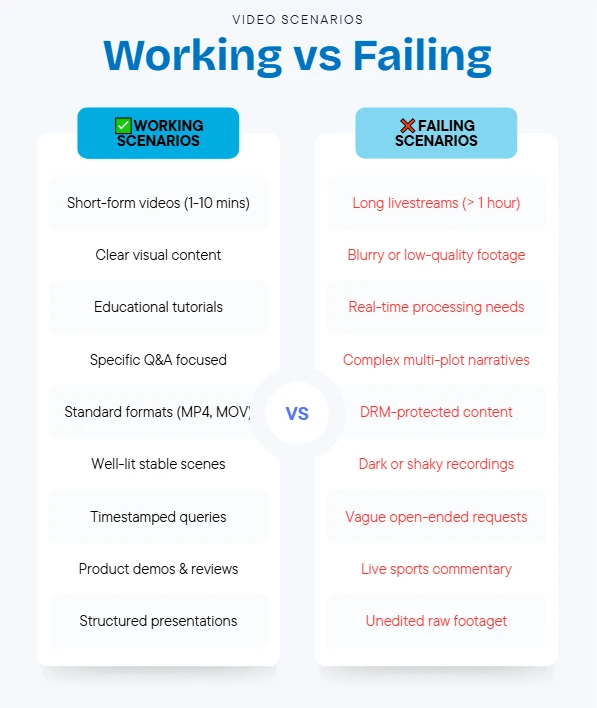

Senario Aplikasi Video ChatGPT: Apa yang Sebenarnya Berfungsi dalam Produksi

Mengetahui ChatGPT boleh memproses komponen video tidak memberitahu anda sama ada ia alat yang sesuai untuk masalah anda. Senario ini menunjukkan di mana analisis berasaskan bingkai berjaya — dan di mana kekangan seni bina merosakkan kes penggunaan.

Senario 1: Peringkasan kandungan pendidikan

Kes penggunaan: Anda mempunyai video tutorial 10 minit dan memerlukan ringkasan berstruktur tentang langkah utama, alat yang disebut, dan contoh visual yang ditunjukkan.

Mengapa ia berfungsi: Video pendidikan lazimnya mempunyai sempadan adegan yang jelas, teks pada skrin yang berterusan, dan narasi yang sejajar dengan visual. Penceramah menerangkan apa yang mereka tunjukkan semasa ia kelihatan. ChatGPT boleh menyalin penjelasan, mengenal pasti alat atau rajah dalam bingkai yang disampel, dan menggabungkan kedua-duanya ke dalam output berstruktur.

Pendekatan pelaksanaan: Muat naik video melalui antara muka ChatGPT atau ekstrak 8–12 bingkai utama pada transisi topik utama. Arahan: “Senaraikan langkah utama yang diterangkan dalam video ini, merujuk kedua-dua narasi dan sebarang teks pada skrin, rajah, atau nama alat yang anda lihat.”

Di mana ia gagal: Video yang bergantung pada pergerakan berterusan — seperti screencast pengkodan di mana pengajar menaip pantas merentasi banyak fail — akan mempunyai langkah yang hilang antara bingkai. Anda perlukan kadar pensampelan bingkai lebih tinggi atau fokus pada transkrip audio sahaja.

Tip praktikal: Untuk kuliah atau kandungan tutorial, gabungkan muat naik automatik (untuk transkrip) dengan bingkai yang diekstrak secara manual bagi 3–5 momen visual paling penting. Ini memberi anda liputan audio komprehensif dan imej berkualiti tinggi bagi konsep utama.

Senario 2: Analisis demo produk

Kes penggunaan: Anda menyemak demo produk pesaing dan mahu mengekstrak elemen UI, nama ciri, aliran pengguna, dan butiran harga yang ditunjukkan pada skrin.

Mengapa ia berfungsi: Demo produk lazimnya menahan setiap skrin cukup lama untuk pensampelan bingkai menangkap UI statik. Tindanan teks, label butang, struktur menu, dan jadual harga kekal kelihatan merentasi pelbagai bingkai. Keupayaan visi ChatGPT boleh membaca dan menerangkan elemen ini walaupun ia tidak disebut dalam narasi.

Pendekatan pelaksanaan: Ekstrak bingkai pada perubahan adegan utama (slaid pengenalan, demo ciri 1, demo ciri 2, skrin harga, CTA). Muat naik bingkai tersebut dan arahan: “Untuk setiap bingkai, kenal pasti semua elemen UI yang kelihatan, label butang, nama ciri, dan sebarang maklumat harga atau produk yang dipaparkan.”

Di mana ia gagal: Demo dengan transisi skrin pantas, keadaan hover yang mendedahkan maklumat sebentar, atau elemen interaktif yang ditunjukkan hanya 1–2 saat tidak akan ditangkap oleh pensampelan bingkai. Jika pesaing pantas memaparkan jadual perbandingan ciri, anda akan terlepas melainkan saat itu disampel.

Tip praktikal: Selak video secara manual dahulu untuk mengenal pasti cap masa pendedahan penting. Ekstrak bingkai pada saat tersebut dan bukan bergantung pada sela pensampelan automatik.

Senario 3: Transkripsi mesyuarat atau temubual dengan konteks visual

Kes penggunaan: Anda merakam panggilan klien dan memerlukan transkrip serta anotasi yang menyatakan bila dokumen tertentu, slaid, atau perkongsian skrin muncul.

Mengapa ia berfungsi: Transkripsi audio mengendalikan dialog pertuturan. Apabila peserta berkongsi skrin atau mengangkat dokumen, itu muncul dalam bingkai yang disampel. ChatGPT boleh menganotasi “sekitar [timestamp], dokumen kontrak kelihatan pada skrin” bersama transkrip — berguna untuk minit mesyuarat yang merujuk bahan visual.

Pendekatan pelaksanaan: Muat naik video dan arahkan: “Transkrip mesyuarat ini dan catat sebarang saat di mana dokumen, slaid pembentangan, perkongsian skrin, atau rujukan visual lain muncul. Untuk setiap elemen visual, terangkan apa yang ditunjukkan.”

Di mana ia gagal: Perkongsian skrin sekejap (di bawah 5–10 saat) mungkin jatuh antara bingkai sampel. Teks yang terlalu kecil untuk dibaca dalam bingkai video termampat tidak dapat diekstrak. Untuk kes undang-undang atau pematuhan yang memerlukan ketepatan verbatim dokumen yang dipaparkan, sahkan kualiti bingkai dan liputan pensampelan sebelum bergantung pada output.

Tip praktikal: Untuk mesyuarat penting, rakam pada resolusi lebih tinggi dan ekstrak bingkai secara manual pada saat seseorang berkata “biar saya tunjuk dokumen ini” — menunjukkan rujukan visual akan muncul.

Senario 4: Moderasi kandungan atau semakan pematuhan

Kes penggunaan: Anda perlu mengimbas video yang dimuat naik pengguna untuk kandungan terlarang — logo tertentu, corak teks, atau elemen visual yang melanggar dasar platform.

Mengapa ia berfungsi: ChatGPT boleh mengimbas bingkai untuk teks yang kelihatan, objek yang boleh dikenali, atau adegan yang diterangkan. Jika anda memeriksa “adakah mana-mana video ini menunjukkan logo pesaing,” analisis berasaskan bingkai mengesan logo yang kekal di skrin lebih daripada satu atau dua saat.

Pendekatan pelaksanaan: Ekstrak bingkai pada sela tetap (setiap 3–5 saat), muat naik, dan arahkan: “Semak bingkai ini dan kenal pasti mana-mana yang mengandungi [logo, nama jenama, simbol terlarang tertentu, dsb.]. Untuk setiap padanan, terangkan di mana dalam bingkai ia muncul.”

Di mana ia gagal: Pelanggaran berasaskan audio (muzik berhak cipta, pertuturan terlarang) memerlukan analisis audio berasingan. Pelanggaran berasaskan pergerakan (isyarat terlarang, tindakan merentasi beberapa bingkai) tidak akan ditangkap oleh analisis imej pegun. Kandungan terlarang yang dipaparkan sekejap mungkin tidak muncul dalam bingkai sampel.

Tip praktikal: Gabungkan pengimbasan visual ChatGPT dengan perkhidmatan cap jari audio khusus dan kadar pensampelan bingkai lebih tinggi untuk kategori kandungan berisiko tinggi. Gunakan ChatGPT sebagai penapis tahap pertama, bukan satu-satunya lapisan moderasi.

Pola merentasi senario berjaya: kandungan bermakna wujud dalam bingkai diskret, stabil dan berkorelasi dengan elemen audio atau teks. Kegagalan berlaku apabila maklumat kritikal hidup dalam pergerakan, masa, transisi, atau muncul terlalu seketika untuk disampel dengan boleh dipercayai.

Keupayaan Video Gemini vs. Keupayaan Video Claude vs. ChatGPT

Jika seni bina pensampelan bingkai ChatGPT tidak sesuai dengan kes penggunaan anda, anda sedang menilai alternatif. Gemini dan Claude menawarkan keupayaan berkaitan video yang berbeza — dan perbezaan itu menentukan model mana yang berfungsi untuk pelaksanaan khusus anda.

Pemprosesan video asli Gemini

Model Gemini menyokong input video asli pada peringkat API. Anda menghantar fail video terus tanpa pra-pemprosesan kepada bingkai. Model memproses video sebagai aliran berterusan, membolehkan penjejakan pergerakan, pengesanan perubahan adegan, dan penaakulan temporal yang pendekatan berasaskan bingkai ChatGPT tidak dapat tangani.

Contoh kes penggunaan di mana Gemini menang:

Anda perlu mengesan bila objek tertentu masuk dan keluar dari bingkai merentasi klip 30 saat, atau menjejak bagaimana seseorang bergerak melalui adegan. Gemini boleh mengikuti objek merentasi bingkai dan membuat penaakulan tentang pergerakan. ChatGPT hanya akan melihat objek dalam mana-mana bingkai yang disampel — berpotensi terlepas kemasukan atau keluarnya.

Pertukaran:

- API asli Gemini lebih cekap kos berbanding pensampelan berasaskan bingkai OpenAI. Dengan mengelakkan lebihan token linear melalui cache konteks, Gemini berskala lebih baik untuk analisis bentuk panjang.

- Memproses video lebih panjang menanggung kependaman lebih tinggi — model mesti mengingest keseluruhan fail sebelum memberi respons

- Tidak semua varian Gemini menyokong input video; memerlukan model Gemini yang lebih baharu

- Had panjang video wujud tetapi lebih murah hati daripada kekangan berasaskan konteks ChatGPT

Bila memilih Gemini berbanding ChatGPT:

- Kes penggunaan anda memerlukan penjejakan pergerakan, pengesanan sempadan adegan, atau pemahaman hubungan temporal

- Maklumat kritikal muncul dan hilang dengan cepat merentasi bingkai

- Anda menganalisis video di mana progresi peristiwa penting (rakaman sukan, semakan pengawasan, analisis animasi)

- Anda mahu mengelakkan pra-pemprosesan pengekstrakan bingkai manual

Had video semasa Claude

Seawal 2026, model Claude tidak menyokong input video langsung melalui API. Anda boleh memuat naik imej (termasuk bingkai video yang diekstrak secara manual), tetapi tiada keupayaan pemprosesan video asli sebanding dengan Gemini.

Apa yang Claude boleh lakukan:

- Menganalisis jujukan bingkai yang dimuat naik, serupa dengan kaedah pengekstrakan manual ChatGPT (Kaedah 2)

- Menyediakan penerangan terperinci tentang kandungan visual dalam setiap bingkai

- Membuat penaakulan tentang pergerakan tersirat atau perubahan antara bingkai jika diarahkan secara eksplisit

- Mengendalikan jujukan imej lebih panjang kerana tetingkap konteks yang diperluas (sehingga 1M token dalam Claude Opus 4.7)

Apa yang Claude tidak boleh lakukan:

- Menerima fail video secara langsung melalui mana-mana antara muka

- Menjejak pergerakan atau objek merentasi bingkai secara automatik tanpa arahan bingkai demi bingkai yang eksplisit

- Menyalin audio — memerlukan pra-pemprosesan berasingan dengan Whisper atau perkhidmatan serupa, kemudian menyerahkan transkrip kepada Claude

Bila anda masih memilih Claude:

- Aliran kerja anda sudah termasuk pengekstrakan bingkai sebagai langkah pra-pemprosesan

- Anda menganalisis video panjang yang memerlukan banyak bingkai dan memerlukan tetingkap konteks besar Claude

- Anda membandingkan kualiti analisis visual dan mendapati penerangan bingkai Claude lebih tepat atau terperinci untuk domain anda (cth., pengimejan perubatan, rajah teknikal)

- Anda perlu menggabungkan analisis bingkai video dengan sejumlah besar maklumat kontekstual lain

Jadual perbandingan keupayaan

| Ciri | ChatGPT | Gemini | Claude |

|---|---|---|---|

| Muat naik fail video terus | ✓ (antara muka web/app) | ✓ (API + antara muka web) | ✗ |

| Penjejakan pergerakan asli | ✗ | ✓ | ✗ |

| Transkripsi audio | ✓ (integrasi Whisper) | ✓ (terintegrasi) | ✗ (memerlukan alat luaran) |

| Analisis berasaskan bingkai | ✓ | ✓ (juga pemprosesan berterusan) | ✓ (pengekstrakan manual sahaja) |

| Pengesanan perubahan adegan | ✗ (manual sahaja) | ✓ (automatik) | ✗ |

| Pengendalian panjang video biasa | ~5–10 minit (terhad konteks) | ~1 jam (bergantung resolusi) | N/A (bilangan bingkai terhad oleh konteks) |

| Kes penggunaan terbaik | Ringkasan pantas, analisis peringkat bingkai dengan sedikit kawalan | Penjejakan pergerakan, penaakulan temporal, video berterusan | Penerangan bingkai demi bingkai mendalam dengan keperluan konteks besar |

| Sokongan video melalui API | ✗ (imej sahaja) | ✓ | ✗ |

Rangka kerja keputusan:

- Pilih ChatGPT apabila: Anda perlukan ringkasan video pantas, maklumat kritikal kekal merentasi berbilang bingkai, anda bekerja dengan klip pendek (di bawah 10 minit), dan anda tidak perlukan penjejakan pergerakan. Terbaik untuk kandungan pendidikan, demo produk statik, transkripsi mesyuarat.

- Pilih Gemini apabila: Kes penggunaan anda memerlukan penjejakan pergerakan, pengesanan perubahan adegan, atau penaakulan temporal tentang bagaimana elemen bergerak atau berubah merentasi masa. Kritikal untuk rakaman pengawasan, analisis sukan, semakan animasi, atau mana-mana senario di mana “apa yang berlaku di antara bingkai” penting.

- Pilih Claude apabila: Anda sudah mengekstrak bingkai sebagai sebahagian daripada talian paip, perlu menganalisis banyak bingkai dengan konteks tambahan yang luas, atau mendapati penerangan visual Claude lebih tepat untuk domain visual khusus anda. Memerlukan kerja pra-pemprosesan paling banyak tetapi menawarkan tetingkap konteks terbesar.

Untuk pembangun yang bekerja merentasi pelbagai model, CometAPI menyediakan antara muka bersatu untuk menguji kualiti pemprosesan video merentasi GPT, Gemini, dan Claude tanpa menulis semula kod integrasi — berguna apabila anda membandingkan kualiti output sebelum komited kepada penyedia tertentu.

Jawapan sebenar kepada “bolehkah ChatGPT menonton video” bukan binari. Ia “ya, dengan menukar video ke format yang sudah ditanganinya — dengan batasan yang merosakkan kes penggunaan tertentu.” Kebanyakan kegagalan pelaksanaan datang daripada ketidakpadanan seni bina, bukan jurang keupayaan. Model berfungsi tepat seperti yang direka; pembangun hanya menjangkakan reka bentuk yang berbeza.

Jika anda membina ciri analisis video pada skala, uji aliran kerja anda dengan kes pinggir dahulu: muat naik video yang sama melalui fail terus, bingkai yang diekstrak secara manual, dan kaedah transkrip sahaja. Bandingkan output. Kaedah yang menangkap isyarat kritikal kes penggunaan anda — bukan yang paling pantas dilaksanakan — ialah yang bertahan trafik produksi.

Sebelum komited kepada ChatGPT untuk video:

- Kenal pasti sama ada maklumat kritikal anda wujud dalam bingkai stabil, pergerakan, atau audio

- Uji liputan pensampelan bingkai dengan mengekstrak bingkai secara manual pada sela yang anda jangkakan

- Sahkan bahawa teks pada skrin boleh dibaca pada resolusi video anda selepas pemampatan

- Sahkan panjang video anda sesuai dalam had konteks praktikal untuk peringkat langganan anda

- Sediakan pelan sandaran untuk kandungan yang muncul seketika atau di antara bingkai yang disampel

Untuk pembangun yang menilai pelbagai penyedia AI bagi beban kerja video, CometAPI menawarkan taman permainan bersatu untuk menguji ChatGPT, Gemini, dan Claude dengan input video yang sama — membolehkan anda membandingkan kualiti output, kependaman, dan kos sebelum membina integrasi khusus penyedia.

FAQ - Panduan Analisis Video AI

Jawapan pantas kepada soalan lazim tentang analisis video AI.

Bolehkah ChatGPT menganalisis video?

Ya, ChatGPT (GPT-4o dan versi kemudian) boleh menganalisis video dengan mensampel bingkai (~1 per saat) dan menyalin audio. Ia berfungsi baik untuk ringkasan mesyuarat, mengekstrak teks daripada slaid, dan mengenal pasti objek. Namun, ia bergelut dengan penjejakan pergerakan, video melebihi 10 minit, dan penstriman masa nyata.

Bagaimana cara memuat naik video ke ChatGPT?

Muat Naik URL Terus (Disyorkan): Muat naik melalui URL awam untuk analisis pantas. Terbaik untuk video di bawah 10 minit.

Pengekstrakan Bingkai Manual: Ekstrak bingkai khusus untuk kawalan tepat. Terbaik apabila anda perlu menganalisis momen tertentu atau mengurangkan kos token.

Apakah panjang video maksimum yang boleh ditangani ChatGPT?

ChatGPT boleh mengendalikan video sehingga 5–10 minit dengan boleh dipercayai. Melebihi itu, anda perlu membahagi video atau beralih kepada Gemini 2.5 Pro, yang menyokong video sehingga 60 minit secara asli.

Apakah had analisis video ChatGPT?

- Tidak boleh menjejak pergerakan berterusan (sukan, tarian)

- Cap masa tidak tepat (ketepatan ±1 saat)

- Terlepas kandungan yang muncul kurang daripada 1 saat

- Had praktikal 10 minit

- Tiada sokongan penstriman masa nyata

- Bergelut dengan video berkualiti rendah atau gelap

- Lemah dalam penaakulan sebab-akibat temporal *

Patut saya gunakan ChatGPT atau Gemini untuk analisis video?

Gunakan ChatGPT untuk:

- Video di bawah 10 minit

- Penaakulan teks unggul selepas analisis video

- Analisis peringkat bingkai (slaid, tangkapan skrin)

Gunakan Gemini untuk:

- Video 10–60 minit

- Penjejakan pergerakan dan analisis pergerakan

- Tugas penaakulan temporal

- Rakaman sukan, tarian, atau pengawasan *

Bolehkah Claude menganalisis video?

Tidak, Claude tidak menyokong input video langsung. Walau bagaimanapun, anda boleh mengekstrak bingkai daripada video dan menganalisisnya dengan Claude, yang menawarkan penaakulan teks unggul dan tetingkap konteks untuk analisis panjang.

Berapakah kos analisis video?

Kos berbeza mengikut model dan panjang video:

- ChatGPT 4o: ~$0.05 per minit

- Gemini 2.5 Pro: ~$0.04 per minit

CometAPI menawarkan kredit untuk pengguna baharu memulakan penggunaan.