TL;DR: Keluaran terbaharu OpenClaw menambah sokongan kelas pertama yang serasi ke hadapan untuk GPT-5.4 daripada OpenAI dan memperkenalkan seni bina “memory hot-swappable” yang membolehkan ejen OpenClaw menukar model dan stor memori yang aktif pada waktu jalan dengan gangguan minimum. Ini membuka kunci aliran kerja konteks besar (tetingkap konteks diperluas GPT-5.4), pengkhususan model secara serta-merta, serta pengoptimuman kos/kelewatan untuk ejen produksi. Naik taraf tersedia dalam keluaran dan dokumentasi OpenClaw; contoh di bawah menunjukkan konfigurasi praktikal, petikan kod, konteks penanda aras, dan amalan terbaik yang disyorkan.

Apa sebenarnya yang dihantar oleh kemas kini OpenClaw (ringkasan pantas)

Pada 9 Mac 2026, projek sumber terbuka bersebelahan OpenAI — OpenClaw — mengeluarkan teras utama (2026.3.7) yang menambah sokongan kelas pertama untuk GPT-5.4 dan mekanisme baharu “memory hot-swappable” dalam enjin konteksnya. Keluaran ini menukarkan rangka kerja ejen eksperimen yang banyak digunakan menjadi apa yang penyenggara gambarkan sebagai “Sistem Pengendalian Ejen” — bertujuan menjadikan aliran kerja ejen gred produksi dan pertukaran model berjalan lancar untuk pembangun dan pasukan.

3 perkara praktikal yang penting untuk pembina ejen:

- Sokongan GPT-5.4 kelas pertama — alias model dan pemetaan penyedia yang membolehkan ejen memilih GPT-5.4 sebagai model pelaksanaan utama (termasuk penggantian saluran dan pin model per ejen).

- Context Engine & pengikatan saluran teragih — penambahbaikan cara OpenClaw menyusun tetingkap konteks panjang daripada memori, keluaran alat, dan sejarah saluran supaya model berkapasiti tinggi menerima input yang tersusun baik.

- Seni bina “memory hot-swappable” — permukaan plugin memori dan aliran kerja yang lebih jelas supaya anda boleh menggantikan backend memori atau menaik taraf ejen tanpa kehilangan “identiti” atau merosakkan keadaan berterusan (memori itu sendiri kekal sebagai sumber kebenaran tunggal). Reka bentuk memori OpenClaw (fail Markdown biasa, carian berindeks, pengambilan berplugin) ialah sebahagian daripada apa yang membolehkan hot-swapping yang selamat.

GPT-5.4 — Apa itu GPT-5.4 dan terobosan penanda aras

GPT-5.4 ialah keluaran model barisan hadapan terbaharu OpenAI yang memberi tumpuan kuat pada produktiviti profesional (hamparan, penyuntingan dokumen dan pembentangan, penaakulan berbilang langkah dan pemanduan alat). Menurut OpenAI dan liputan media bebas, keluaran ini menekankan:

- Konteks diperluas: GPT-5.4 memperkenalkan peringkat seterusnya tetingkap konteks, dengan 1M token eksperimen dan pengendalian konteks panjang yang dipertingkat tersedia melalui titik akhir Codex/serasi Codex — tetapan seperti

model_context_windowdanmodel_auto_compact_token_limitdidedahkan untuk pembangun. Ini membolehkan anda mengekalkan keadaan perbualan, dokumen, dan pangkalan kod yang jauh lebih besar dalam konteks aktif. - Ketepatan hamparan dan penaakulan lebih tinggi — OpenAI melaporkan peningkatan utama pada tugasan pemodelan hamparan (skor min ~87% vs ~68% untuk GPT-5.2 pada penanda aras hamparan perbankan/penganalisis mereka).

- Peningkatan ketepatan dan kefaktualan: Ulasan awal dan QA menunjukkan pengurangan ~33% halusinasi dan output kurang cenderung ralat berbanding GPT-5.2, dengan peningkatan ketara dalam penulisan dokumen dan kerja hamparan. Pengulas turut menyebut ~18% penurunan respons mudah ralat pada tugasan produktiviti tertentu.

- Penambahbaikan penggunaan komputer dan salasilah Codex terintegrasi — GPT-5.4 termasuk keupayaan daripada salasilah Codex yang memperbaiki penjanaan kod, nyahpepijat interaktif, dan pemanduan alat operasi (automasi tetikus/papan kekunci/tangkapan skrin dalam beberapa demonstrasi). Ini menjadikannya lebih baik untuk kitaran tulis-jalankan-periksa-tampal yang tipikal dalam gelung ejen.

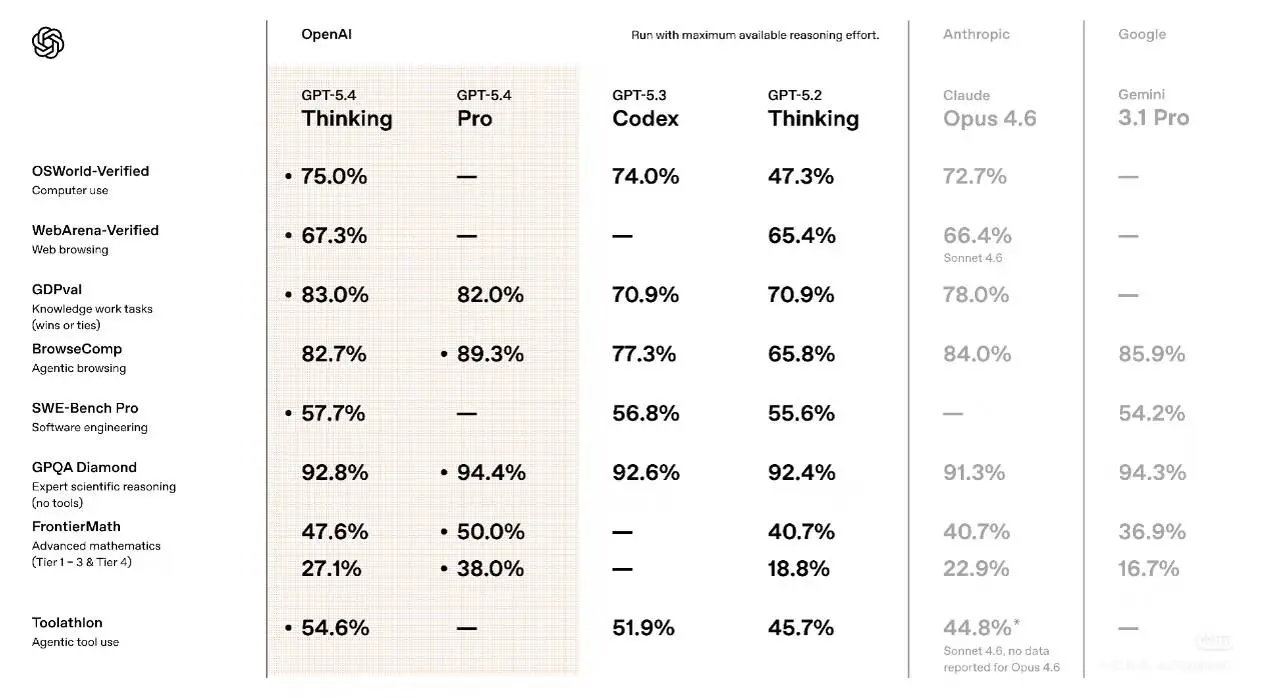

Penanda aras & konteks perbandingan (apa maksud angka)

- Pemodelan hamparan: Penanda aras hamparan dalaman OpenAI: skor min ~87.3% untuk GPT-5.4 vs ~68.4% untuk GPT-5.2. Ini tajuk utama vendor untuk menunjukkan keuntungan tugas khusus.

- Interaksi komputer (OSWorld / ujian gaya ejen): penguji bebas dan jaluran komuniti menunjukkan GPT-5.4 bertambah baik pada tugasan interaksi ejen yang melibatkan manipulasi desktop atau UI simulasi, kadangkala mengatasi varian model Anthropic terkini dengan margin kecil pada suite tugas ini (perbezaan bermakna untuk ejen, tetapi tidak semestinya penentu dalam setiap beban kerja).

Tafsiran: GPT-5.4 bukan “peluru ajaib” yang memenangi segala-galanya. Ia mempunyai kekuatan jelas dalam penggunaan alat bersepadu, pola pelaksanaan kod, dan penaakulan hamparan — yang tepatnya beban kerja yang sering dijalankan oleh ejen OpenClaw. Bagi pembina ejen, gabungan kebolehpercayaan pelaksana yang bertambah baik (salasilah Codex) + kecekapan perancang + pengendalian konteks panjang yang lebih baik adalah sangat relevan.

OpenClaw menyokong GPT-5.4: apa yang berubah dan mengapa penting

Keluaran OpenClaw (lihat halaman keluaran projek) mengemas kini penyelesai model dan runtime supaya serasi ke hadapan dengan konteks dan had token GPT-5.4 yang diperluas dan menambah keupayaan “memory hot-swappable” supaya ejen boleh menukar backend memori atau model pada waktu jalan. Ini dilakukan dalam tiga cara konkrit: 1) kemas kini metadata model dan penyelesai untuk menerima konteks dan had token yang lebih besar; 2) perubahan runtime ejen untuk mengorchestrakan pertukaran model yang lancar dan pemanasan cache; 3) API memori yang membenarkan berbilang saluran memori dan pencetus pertukaran panas.

Sokongan versi 2026.3.7 untuk GPT-5.4 ditambah reka bentuk “memory hot-swappable” memberikan dua kelebihan praktikal yang saling melengkapi:

- Laluan naik taraf model yang mudah. OpenClaw kini boleh membentangkan GPT-5.4 sebagai “runtime” boleh pilih untuk ejen, membolehkan anda bertukar daripada model GPT-5.x yang lebih lama atau vendor alternatif tanpa mengubah semula logik ejen anda. Kemas kini OpenClaw secara jelas mengisytiharkan integrasi GPT-5.4 yang stabil dalam teras.

- Memory Hot-Swapping. Daripada mengekalkan snapshot memori linear tunggal, Context Engine OpenClaw membolehkan partisi memori dinyahganding, ditukar atau dimigrasi pada waktu jalan — cth., tukar masuk shard pangkalan data vektor kadar recall tinggi untuk penyahpepijatan atau tukar ke varian memori yang disanitasi GDPR untuk audit luaran — tanpa menghentikan ejen. Itu menurunkan risiko gangguan dalam produksi dan membolehkan konfigurasi memori khusus kes guna (nyahpepijatan vs privasi vs prestasi).

terobosan prestasi praktikal & kelebihan

Integrasi OpenClaw memfokus pada tiga bidang praktikal di mana GPT-5.4 menonjol:

- Ketepatan orkestrasi alat. Carian alat dalaman dan penaakulan GPT-5.4 yang dipertingkat mengurangkan churn panggilan alat (lebih sedikit panggilan alat berlebihan dan lebih sedikit cuba semula). Itu diterjemah kepada panggilan API lebih rendah dan penyiapan lebih pantas untuk aliran kompleks. Laporan awal menunjukkan peningkatan kecekapan token dan panggilan alat berbanding model GPT-5.x yang lebih lama.

- Pengendalian konteks yang lebih panjang dan kaya. Ejen OpenClaw kini boleh mengekalkan konteks aktif yang jauh lebih besar (termasuk shard memori yang ditukar masuk), membolehkan mereka mengurus perbualan panjang, projek berbilang fail, dan nyahpepijatan berulang tanpa kehilangan keadaan.

- Output kod lebih deterministik. Untuk aliran kerja yang menjana kod secara automatik (hook CI, rangka fungsi, templat infrastruktur), GPT-5.4 cenderung menghasilkan output yang lebih konsisten dan boleh dijalankan, mengurangkan beban semakan manusia. Ujian bebas menunjukkan peningkatan ketara dalam metrik kualiti kod berbanding model GPT-5 terdahulu.

- Kesinambungan memori — “memory hot-swappable” membolehkan anda mengganti atau menambah stor memori (cache setempat, pangkalan data vektor, memori LLM) tanpa kehilangan keadaan atau konteks ejen, membolehkan A/B test, naik taraf bergilir, dan failover.

Dalam ujian penanda aras OOLONG, versi baharu OpenClaw, bersama plugin lossless-claw, mencapai skor tinggi 74.8, meninggalkan Claude Code (70.3 mata) jauh di belakang. Khususnya, OpenClaw menunjukkan kestabilan dan ketepatan apabila panjang konteks meningkat, mendorong jurutera yang menjalankan ujian di tempat untuk berseru bahawa "mengatakan ia berjalan dengan baik adalah terlalu konservatif."

Cara mengkonfigurasi dan menggunakan GPT-5.4 dalam OpenClaw (langkah demi langkah)

Aliran Kerja OpenClaw Ringkas Menggunakan GPT 5.4:

- Konfigurasi tipikal ditunjukkan di bawah:

- Pengguna menghantar mesej melalui platform seperti Discord atau Telegram.

- OpenClaw menerima mesej melalui pelayan gerbangnya.

- Gerbang meneruskan prompt kepada GPT 5.4 melalui penyedia API AI.

- GPT 5.4 menjana respons atau mencetuskan tindakan alat.

- OpenClaw menghantar hasil akhir kembali kepada pengguna.

Di bawah ialah contoh konfigurasi dan aliran kerja yang praktikal dan boleh salin-tampal untuk menjalankan GPT-5.4 dalam OpenClaw dengan selamat dan boleh diulang. Ini sengaja bersifat konservatif: dayakan model terlebih dahulu dalam ejen ujian dan instrumentkan semuanya untuk metrik dan ralat.

Prasyarat

- OpenClaw dinaik taraf kepada keluaran yang merangkumi pemetaan GPT-5.4 (nota keluaran dirujuk di atas).

- Kunci API OpenAI yang sah dengan akses kepada GPT-5.4 (saya memilih titik akhir CometAPI dengan harga lebih murah).

1) Pemilihan model & konfigurasi penyelesai (Json/ YAML / CLI)

Letakkan ini dalam ~/.openclaw/openclaw.json (atau gabungkan ke dalam konfigurasi sedia ada anda). Laraskan nama penyedia dan rujukan token mengikut persekitaran anda.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw menggunakan penyelesai model untuk memetakan nama model logik (cth., openai/gpt-5.4) kepada titik akhir dan konfigurasi runtime. Tambah atau kemas kini fail penyelesai anda (contoh models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Atau tetapkan pada waktu jalan melalui CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Nota:

context_windowdanmax

Nota

agents.defaults.model.primarymemilih model lalai. Gunakanchannels.modelByChanneluntuk penggantian per saluran supaya anda boleh merutekan saluran berimpak tinggi ke GPT-5.4 dan saluran kurang menuntut ke model yang lebih murah. Lihat dokumentasi pemilihan model OpenClaw untuk semantik pengurutan.- Sila rujuk halaman model CometAPI untuk nama model khusus. Jika anda ingin menggunakan OpenAI, gantikan URL dan kunci API dengan milik OpenAI.

- Kekunci

context_windowdanmax_output_tokensmencerminkan perubahan serasi ke hadapan dalam penyelesai OpenClaw agar ejen tidak cuba menggunakan had Codex yang lapuk.

2) Cara mendayakan dan menguji “memory hot-swapping”

Subsistem memori OpenClaw adalah berasaskan fail (fail Markdown) ditambah pengindeks/pemalam carian supaya anda boleh menukar plugin backend (cth., vektor SQLite, Milvus, atau perkhidmatan memori luaran) dengan selamat tanpa kehilangan fail memori mentah.

Pola lazim:

- Menyeragamkan lokasi memori: gunakan ruang kerja berasaskan git:

~/.openclaw/workspace/di manaMEMORY.mddanmemory/YYYY-MM-DD.mdadalah autoritatif. - Pasang & konfigurasikan plugin memori (contoh: sqlite-vec) dan halakan

plugins.slots.memorykepadanya dalam konfigurasi. - Uji migrasi: tambah plugin baharu, jalankan tugas pengindeksan bayangan, bandingkan hasil pengambilan, kemudian tukar alias

plugins.slots.memorykepada plugin baharu apabila berpuas hati.

Pertukaran alias plugin contoh (pseudo-perintah bash):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Mengapa ini “hot-swappable”: fail memori kekal sebagai sumber kebenaran. Plugin melaksanakan lapisan pengindeksan dan pengambilan; menukarnya akan mengindeks semula tetapi tidak mengubah fail .md asas. Ini membolehkan pertukaran model tanpa hanyut identiti yang teruk — ejen masih membaca MEMORI yang sama.

3) Contoh: pin ejen individu kepada GPT-5.4 (timpaan per ejen)

Anda boleh menimpa model per ejen; tambah entri ejen seperti:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Jika keluaran komuniti atau versi OpenClaw anda memerlukan CLI, anda juga boleh menetapkan model per sesi pada waktu jalan:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Petua operasi: pin memastikan tingkah laku deterministik untuk ejen itu sementara anda menjalankan ujian A/B pada ejen lain.

Jika anda ingin menggunakan OpenAI, gantikan URL dan kunci API dengan milik OpenAI.

4) Menggunakan pilihan konteks 1M Codex (tetapan API)

Jika penyebaran OpenClaw anda mengakses titik akhir OpenAI Codex secara langsung, hantarkan pilihan konteks:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Permintaan yang melebihi tetingkap konteks standard mungkin dikira pada kadar penggunaan berbeza (dokumentasi OpenAI menyatakan pengiraan berganda untuk permintaan di luar tetingkap standard dalam pratonton Codex).

Amalan terbaik: memaksimumkan kekuatan GPT-5.4 dalam OpenClaw

Kos, kelewatan & campuran model

- Strategi model hibrid: Gunakan model yang lebih kecil dan murah untuk pertanyaan pendek dan pemprosesan strim; hot-swap kepada GPT-5.4 untuk analisis berat, penjumlahan, penjanaan kod yang memerlukan konteks panjang. Ini mengurangkan kos token keseluruhan sambil mengekalkan kualiti. (Laksanakan melalui pencetus dalam konfigurasi memori di atas.)

- Pemedatan token & pengayaan pengambilan: Gunakan saluran paip berasaskan pengambilan untuk mengehadkan token yang dihantar ke model — simpan dokumen panjang dalam pangkalan data vektor, ambil segmen yang relevan, dan sertakan hanya cebisan paling relevan serta pelan ringkas. Carian alat GPT-5.4 membantu di sini dengan mencari alat atau dokumen yang berguna secara automatik.

- Pemanasan & permulaan sejuk: Selepas pertukaran model, panaskan model dengan larian pemfaktoran konteks pendek untuk mengelakkan lonjakan kelewatan permintaan pertama. Prakompil mana-mana templat prompt dan rehidrasi saluran memori kritikal. Strategi bergilir OpenClaw (lihat konfigurasi) menyokong pemanasan awal.

Kebolehpercayaan & keselamatan

- Fallback yang lancar: Laksanakan had masa dan pelan fallback (cth., turun taraf kepada jawapan cache daripada sesi sebelumnya) untuk mengendalikan had kadar API atau ralat kuota.

- Lapisan keselamatan: Kekalkan penapis dasar dan langkah pengesahan apabila output mempengaruhi keputusan. GPT-5.4 secara statistik mengurangkan halusinasi, tetapi pengesahan masih penting untuk tugasan berisiko tinggi.

Penilaian & pemantauan

- Reproduksi penanda aras anda: Jalankan ujian bersemuka untuk beban kerja anda (pelengkapan kod, pembaikan semula berbilang fail, analisis hamparan) menggunakan rubrik standard. Laporan awam menunjukkan kekuatan dalam tugasan hamparan dan produktiviti — sahkan dengan data anda.

- Telemetri: Pantau penggunaan token, kelewatan model, kekerapan pertukaran memori, dan kualiti jawapan (penarafan manusia/ujian automatik). Gunakan telemetri untuk memperhalus ambang pertukaran.

Contoh : Ejen semakan kod yang melakukan hot-swap

Matlamat: Jalankan ringkasan lint + ujian unit rutin pada push (model murah) dan eskalasi ke GPT-5.4 untuk cadangan pembaikan semula berbilang fail apabila ujian gagal atau diff melebihi 10 fail.

Aliran (tahap tinggi):

- Pencetus pra-komit menjalankan

local/fast-small-coderuntuk menghasilkan ringkasan lint. - Jika

test_failures > 0ataudiff_files > 10, pencetushot_swapkeopenai/gpt-5.4. Naikkanlongterm_vectoryang mengandungi sejarah repo. - Jalankan prompt GPT-5.4 yang mempunyai keseluruhan jejak timbunan kegagalan + fail kod relevan yang dimasukkan ke dalam konteks. Jana tampalan pembaikan semula dan perubahan ujian unit.

- Pengulas manusia menilai output; maklum balas mengemas kini memori.

Rangka prompt (dihantar kepada GPT-5.4 selepas pengambilan & pemedatan):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Kes guna ini menyerlahkan mengapa konteks besar + memory hot-swap bernilai: anda boleh membawa keseluruhan jejak kegagalan dan berbilang fail ke dalam model sekaligus. Laksanakan pencetus pertukaran secara konservatif untuk mengawal kos.

Akhir sekali: siapa yang patut mengguna pakai GPT-5.4 dalam OpenClaw (dan bila)

- Guna pakai sekarang jika ejen anda menjalankan tugasan kod/alat berbilang langkah, automasi hamparan berat, atau penyuntingan dokumen kompleks di mana kitaran tulis-jalankan-periksa mendominasi masa pembangun. Keuntungan produktiviti dan kebolehpercayaan paling ketara di sini.

- Guna pakai dengan berhati-hati jika anda beroperasi dalam saluran sembang volum tinggi sensitif kos di mana penaakulan ringkas memadai; gunakan perutean untuk mengekalkan kecekapan kos.

- Jangan anggap satu model menguasai: tandaaraskan pada data anda. GPT-5.4 ialah pencabar kukuh untuk beban kerja ejen, tetapi pilihan model mesti didorong oleh bukti.

Pembangun boleh mengakses GPT-5.4 melalui CometAPI sekarang. Untuk bermula, terokai keupayaan model dalam Playground dan rujuk panduan integrasi OpenClaw untuk arahan terperinci. Sebelum mengakses, pastikan anda telah log masuk ke CometAPI dan memperoleh kunci API. CometAPI menawarkan harga jauh lebih rendah daripada harga rasmi untuk membantu anda berintegrasi.

Sedia untuk bermula?→ Daftar untuk OpenClaw hari ini!

Jika anda ingin mengetahui lebih banyak tip, panduan dan berita tentang AI ikuti kami di VK, X dan Discord!