DeepSeek heeft V4 officieel als een open-source modelfamilie gepresenteerd, en de headline is niet zomaar ‘weer een modelupdate’. Het bedrijf positioneert V4 als een systeem met lange context, agentvriendelijk en gebouwd voor echte workloads: documentintensieve analyses, codeerassistenten, zoekagenten en meerstapsautomatisering. De release is live op web, app en API, en de V4-lijn introduceert een kostenefficiënt contextvenster van 1M tokens in al zijn officiële diensten.

Wat deze lancering bijzonder opmerkelijk maakt, is de combinatie van schaal en efficiëntie. DeepSeek zegt dat V4-Pro 1.6T totale parameters heeft met 49B actief, terwijl V4-Flash 284B totale parameters heeft met 13B actief. In het technische rapport stelt DeepSeek ook dat de V4-architectuur hybride attention, MoE-routing en natraining toepast die bedoeld zijn om agentgedrag te verbeteren terwijl de rekenlast van ultralange context wordt teruggebracht.

Wat is DeepSeek V4?

DeepSeek-V4 is de nieuwste preview-vlaggenschipfamilie van het bedrijf, en de release omvat twee publieke varianten: V4-Pro en V4-Flash. DeepSeek beschrijft V4-Pro als het sterkere model voor wereldkennis, wiskunde, STEM, coderen en agentmatig coderen, terwijl V4-Flash de responsievere, kostenefficiënte optie is die toch veel van de redeneerkwaliteit en lange-contextcapaciteit behoudt. V4-Pro loopt voor op huidige open modellen in agentmatig coderen en wereldkennis, terwijl V4-Flash is ontworpen voor snelheid en voordelige uitrol.

V4 gebruikt een hybride attention-architectuur die Compressed Sparse Attention (CSA) en Heavily Compressed Attention (HCA) combineert, plus Manifold-Constrained Hyper-Connections en de Muon-optimizer. Het bedrijf zegt ook dat de modellen zijn voorgetraind op meer dan 32T tokens en dat V4-Pro bij 1M context slechts 27% van de FLOPs voor single-token-inferentie en 10% van de KV-cache nodig heeft vergeleken met DeepSeek-V3.2. Dat efficiëntieverhaal is de echte headline achter de release.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro is het vlaggenschipmodel voor gebruikers die vooral om kwaliteit geven. DeepSeek-V4-Pro levert sterker agentmatig codeerprestaties, rijkere wereldkennis en redeneervermogen van wereldklasse, en het loopt voor op huidige open modellen terwijl het volgens de launchpagina slechts achter Gemini-3.1-Pro aanloopt op wereldkennis. In het technische rapport is V4-Pro het grotere model in de familie, en DeepSeek-V4-Pro is beschikbaar via dezelfde OpenAI-compatibele en Anthropic-compatibele interfaces als V4-Flash.

DeepSeek-V4-Flash

V4-Flash is het model waarbij efficiëntie vooropstaat; de redeneercapaciteiten benaderen die van V4-Pro, en het presteert vergelijkbaar met V4-Pro op eenvoudige agenttaken, terwijl het een kleinere parameterfootprint en snellere responstijden gebruikt. Het ondersteunt zowel thinking- als non-thinking-modi, met dezelfde contextlengte van 1M en dezelfde kernfuncties als Pro, maar tegen veel lagere kosten.

Which one should you choose?

Gebruik V4-Pro wanneer de taak hoog-risico, kennisintensief of moeilijk te verifiëren is: ondernemingsonderzoek, complexe code, meerstapsbesluitvorming of taken waarbij u het sterkst mogelijke antwoord wilt. Gebruik V4-Flash wanneer doorvoer, latentie of tokenkosten belangrijker zijn dan de laatste paar punten benchmarkprestatie eruit persen. Die keuze is consistent met de officiële positionering en met de gerapporteerde benchmarkverschillen tussen de twee modellen.

| Onderdeel | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Totaal aantal parameters | 284B | 1.6T |

| Actieve parameters | 13B | 49B |

| Contextlengte | 1M | 1M |

| Redeneermodi | Non-think + think | Non-think + think |

| Beste toepassing | Snelle inferentie, apps met hoge doorvoer, kostengevoelige agenten | Redeneren met hoogste capaciteiten, zwaardere codeer- en kennistaken |

| Officiële API-prijzen | Cache-treffer $0.028 / cache-misser $0.14 / output $0.28 per 1M tokens | Cache-treffer $0.145 / cache-misser $1.74 / output $3.48 per 1M tokens |

| Maximale output | 384K | 384K |

CometAPI biedt toegang tot Deepseek v4 Pro en V4 Flash,—20% goedkoper dan officieel—plus naadloos schakelen tussen 500+ modellen (GPT-5.4, Gemini 3.1, enz.) via één OpenAI-compatibel of Anthropic Messages-endpoint.

Prestatiebenchmark

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

In de vergelijkingstabel voor basismodellen presteren V4-Flash en V4-Pro beide beter dan DeepSeek-V3.2 op kernbenchmarks, waarbij V4-Pro meestal de leiding neemt. Zo vermeldt het rapport de volgende scores: AGIEval 82.6 / 83.1 vs 80.1 voor V3.2; MMLU 88.7 / 90.1 vs 87.8; MMLU-Pro 68.3 / 73.5 vs 65.5; HumanEval 69.5 / 76.8 vs 62.8; en LongBench-V2 44.7 / 51.5 vs 40.2 voor V3.2, waarbij het middelste getal V4-Flash is en het laatste V4-Pro.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Bron: DeepSeek-V4 technisch rapport, Tabel 1.

Het patroon is duidelijk: Flash verkleint de kloof met Pro, maar Pro is nog steeds het sterkere algemene model. Dat maakt V4-Flash de praktische standaardkeuze voor veel productiesystemen, terwijl V4-Pro het model is voor situaties waarin antwoordkwaliteit belangrijker is dan kosten of latentie.

Vergelijkingen met westerse modellen: waar V4 past

In één menselijke evaluatie van Chinese witteboordentaken zegt het rapport dat DeepSeek-V4-Pro-Max beter presteerde dan Claude Opus 4.6-Max, met een niet-verliespercentage van 63%. DeepSeek-V4-Pro “overtreft aanzienlijk” Claude Sonnet 4.5 en benadert Claude Opus 4.5 op een R&D-codeerbenchmark.

| Evaluatiegebied | DeepSeek-resultaat | Vergelijking met westers model | Wat dit suggereert |

|---|---|---|---|

| Chinese witteboordentaken | V4-Pro-Max, 63% niet-verliespercentage | vs Claude Opus 4.6-Max | Sterke prestaties in praktische, bedrijfsgerichte taken |

| R&D-codeerbenchmark | V4-Pro-Max slagingspercentage 67 | vs Claude Sonnet 4.5 op 47; Opus 4.5 op 70; Opus 4.6 Thinking op 80 | Concurrerend met toonaangevende modellen, vooral vergeleken met systemen van het Sonnet-segment |

Het is niet ‘op alle fronten nummer één’, maar het zit al op een niveau dat ‘serieus geëvalueerd moet worden’.

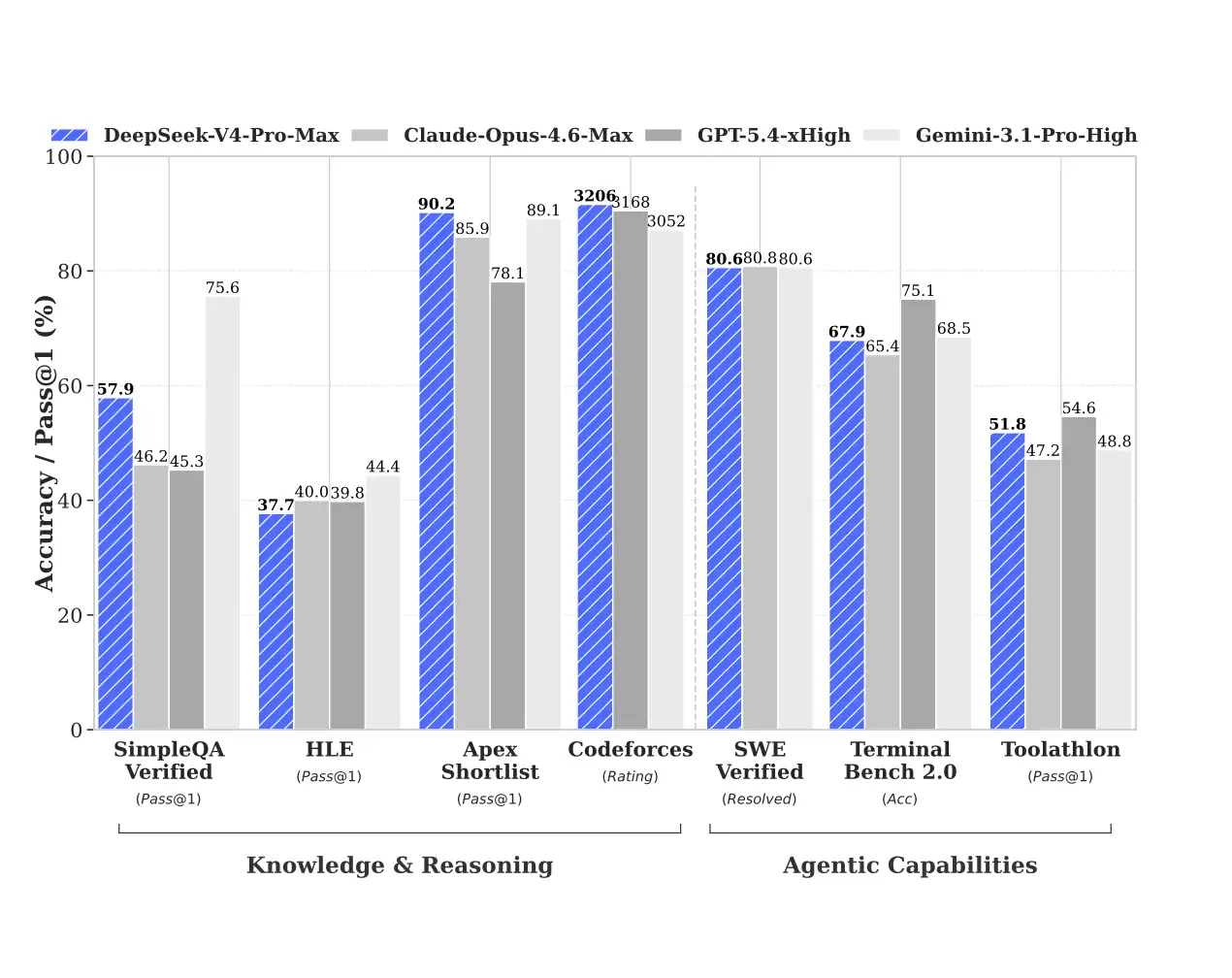

Het technische rapport van DeepSeek vergelijkt V4-Pro-Max met Claude Opus 4.6 Max, GPT-5.4 xHigh en Gemini 3.1 Pro High in dezelfde tabel. De resultaten zijn niet zwart-wit: westerse gesloten modellen presteren nog steeds sterk op sommige kennis- en inferentieaspecten; V4-Pro-Max is daarentegen zeer sterk in code, lange contexten en bepaalde agenttaken. Met andere woorden, het is niet langer een eenvoudig verhaal van ‘binnenlandse alternatieven’, maar heeft de fase bereikt waarin de vraag is: ‘welk model past beter bij uw scenario?’

Qua kennis en redeneervermogen staat het op één lijn met Opus 4.6 Max, GPT-5.4 xHigh en Gemini 3.1 ProHigh. Het blijft echter iets achter op agentcapaciteiten, al is het verschil niet groot.

DeepSeek-V4-Pro-Max is zeer concurrerend in codegerichte en lange-contextscenario’s, terwijl de westerse modellen nog steeds uiterst sterk zijn op verschillende benchmarks voor puur redeneren en kennis. Dat is de juiste lezing van de release: DeepSeek V4 staat stevig in de voorhoede, maar benchmarkleiderschap blijft taakafhankelijk.

Hoe krijg je toegang tot DeepSeek V4

1) Gebruik de officiële web- en appkanalen

DeepSeek zegt dat V4 Preview nu beschikbaar is op web, app en API. Voor gewone gebruikers is de eenvoudigste weg nog steeds de officiële chatinterface, waar het model kan worden benaderd via Expert Mode of Instant Mode.

2) Gebruik de API

Ik raad CometAPI sterk aan om DeepSeek V4 te gebruiken, omdat het de beste prijs en aggregatievoordelen biedt.

De modelnamen zijn:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek zegt ook dat de verouderde namen

deepseek-chatendeepseek-reasonerworden uitgefaseerd en tot 2026-07-24 momenteel mappen naar respectievelijk de non-thinking- en thinking-modus van V4-Flash. Dat is belangrijk voor migratieplanning als u al oudere integraties in productie heeft.

- Meld u aan bij CometAPI en haal uw API-sleutel op.

- Gebruik de standaard OpenAI Python SDK (of een compatibele client) met een aangepaste base URL:

Hier is een clean voorbeeld met het officiële OpenAI-compatibele formaat:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Dat aanroeppatroon volgt de snelstart-handleiding: stel de base URL in, kies deepseek-v4-pro of deepseek-v4-flash, en schakel thinking in wanneer u diepere redenering nodig heeft.

Hoe DeepSeek V4 effectief te gebruiken

Voor workflows met lange documenten is het sterkste patroon om de context schoon en gestructureerd te houden. Het 1M-tokenvenster van V4 is een groot voordeel, maar het model presteert nog steeds het best wanneer de input is georganiseerd in secties, broncitaten, takeninstructies en expliciete outputbeperkingen. Dat is de meest natuurlijke manier om de lang-contextcapaciteit te benutten die DeepSeek adverteert.

Voor code- en agentworkflows: begin met V4-Flash voor snelle iteratie en schaal op naar V4-Pro voor de eindrun of de moeilijkste stappen. Die aanpak past bij de officiële positionering: Flash is de efficiënte optie, Pro is het sterkere model, en beide delen hetzelfde API-oppervlak en dezelfde contextlengte.

Slotwoord

DeepSeek-V4 is opmerkelijk omdat het vier zaken tegelijk combineert waar de markt om vroeg: lange context, sterk redeneren, open beschikbaarheid en agressieve prijzen. Het echte verhaal is niet simpelweg dat DeepSeek weer een model heeft uitgebracht. Het is dat het bedrijf probeert voorhoede-AI economisch bruikbaar te maken in productie. Voor teams die evalueren waar ze hun volgende AI-inzet plaatsen, is dat een signaal dat het testen waard is, niet iets om te negeren.

Voor teams die over meerdere aanbieders bouwen, is dit precies het soort release dat het waard is om binnen uw eigen stack te benchmarken. CometAPI kan de praktische laag zijn om DeepSeek-V4 naast andere voorhoedemodellen te vergelijken, zonder uw productteam te dwingen de integratie telkens opnieuw te bouwen wanneer de markt verschuift.