GPT-5.4 Mini en GPT-5.4 Nano zijn OpenAI’s nieuwe compacte varianten van de GPT-5.4-frontierfamilie: Mini richt zich op een toonaangevende balans tussen prestaties en latentie voor coderen, multimodale UI-taken en subagent-workloads; Nano richt zich op ultralage kosten en latentie voor classificatie, extractie, ranking en grootschalig parallelle subagenten. Mini biedt bijna-frontiernauwkeurigheid op veel ontwikkelaarsbenchmarks en draait daarbij >2× sneller dan eerdere mini’s; Nano is aanzienlijk goedkoper per token en ideaal waar doorvoer en responsiviteit het belangrijkst zijn. Deze modellen zijn live in de API (GPT 5.4 Mini en Nano zijn beschikbaar in CometAPI).

Wat zijn GPT-5.4 Mini en GPT-5.4 Nano?

Korte definitie: GPT-5.4 Mini en GPT-5.4 Nano zijn compacte, speciaal ontwikkelde varianten van de GPT-5.4-familie, ontworpen om de kernsterktes van de grote GPT-5.4 (redeneren, coderen, multimodale perceptie, toolgebruik) naar snellere modellen met lagere kosten te brengen, gericht op workloads met hoog volume en lage latentie. De modellen werden door OpenAI aangekondigd als onderdeel van de uitrol van GPT-5.4.

- GPT-5.4 Mini — Een krachtig klein model dat “de prestaties van GPT-5.4 op verschillende evaluaties benadert”, terwijl het is geoptimaliseerd voor snelheid en lagere kosten. Het wordt specifiek uitgelicht voor coderen, redeneren, multimodale UI-interpretatie (screenshots) en als subagent in agentische systemen. OpenAI meldt dat het meer dan 2× sneller draait dan eerdere “mini”-varianten.

- GPT-5.4 Nano — De kleinste en goedkoopste GPT-5.4-variant; aanbevolen voor classificatie, extractie, ranking en “ondersteunende” subagenten die smalle, repetitieve taken met zeer hoge doorvoer afhandelen. Het ruilt dieper redeneren in voor latentie- en kostenbesparing.

Beschikbaarheid en prijs

OpenAI geeft twee concrete datapunten waarmee je de kosten kunt vergelijken:

- GPT-5.4 (volledig vlaggenschip) API-invoerprijs: $2.50 / 1M tokens (en hogere uitvoerprijzen voor het vlaggenschip).

- GPT-5.4 mini API-invoerprijs: $0.75 / 1M tokens en uitvoer $4.50 / 1M tokens.

- GPT-5.4 nano API-invoerprijs: $0.20 / 1M en uitvoer $1.25 / 1M.

Naast elkaar gezet: de invoertokenprijs van mini (0.75) is 30% van die van het vlaggenschip (2.50), dus ongeveer een derde van de invoerkosten; de uitvoerprijs van mini (4.50) is ongeveer 32% van een vlaggenschip-uitvoerprijs die in de API-prijstabel wordt genoemd, dus ook ongeveer een derde. Nano is nog goedkoper: de invoerkosten bedragen ongeveer 8% van de invoerkosten van het vlaggenschip, en de uitvoerkosten liggen onder 10% van de uitvoerkosten van het vlaggenschip. Deze verhoudingen zijn precies waarom OpenAI mini/nano positioneert als “ongeveer een derde” (mini) en “een fractie van” (nano) van de kosten van het gebruik van de grootste modellen voor taken met hoog volume. De prijs van de nano-token steeg van $0.05 naar $0.20, en de prijs van de mini-token steeg van $0.25 naar $0.75 (voor invoertokens).

Op het OpenAI-platform

GPT-5.4 mini is op drie plekken beschikbaar: de OpenAI API, Codex (OpenAI’s ontwikkelaars-IDE/app-platform) en ChatGPT (beschikbaar voor Free- en Go-gebruikers via de optie “Thinking” en als rate-limit-terugvaloptie voor betaalde niveaus). In de API ondersteunt het tekst- en beeldinvoer, toolgebruik (function calling), web-/bestandszoekopdrachten, computergebruik en skills — en het biedt een zeer groot contextvenster (400k tokens) voor documentzware en multi-screenshot-workflows. De prijs voor de API is $0.75 per 1M invoertokens en $4.50 per 1M uitvoertokens.

GPT-5.4 nano is alleen beschikbaar via de API. De catalogusprijzen zijn $0.20 per 1M invoertokens en $1.25 per 1M uitvoertokens — waarmee het de instapoptie met de laagste kosten in de GPT-5.4-familie is. Het nano-model ruilt bewust capaciteit in voor kosten en snelheid.

Op een platform van derden

CometAPI is een multimodaal AI-API-aggregatieplatform dat nu de GPT 5.4 Series API heeft gelanceerd, inclusief GPT 5.4 Mini en GPT 5.4 Nano, met 20% korting op de OpenAI-prijs.

GPT 5.4 Nano:

| Comet-prijs (USD / M tokens) | Officiële prijs (USD / M tokens) |

|---|---|

| Invoer:$0.16/M; Uitvoer:$1/M | Invoer:$0.2/M; Uitvoer:$1.25/M |

GPT 5.4 Nano:

| Comet-prijs (USD / M tokens) | Officiële prijs (USD / M tokens) |

|---|---|

| Invoer:$0.6/M; Uitvoer:$3.6/M | Invoer:$0.75/M; Uitvoer:$4.5/M |

Belangrijkste functies en wat er nieuw is

Hieronder staan de belangrijkste mogelijkheden — waarom engineers en productteams erom zullen geven.

Encoding en ondersteuning voor lange context

Contextvenster: GPT-5.4 mini ondersteunt een contextvenster van 400k tokens (OpenAI vermeldt expliciet een context van 400k voor mini). Dit is groot genoeg voor codebases met meerdere bestanden, uitgebreide documenten of multi-turn-agentsessies waarbij context belangrijk is. De context van Nano is kleiner dan die van de volledige GPT-5.4, maar nog steeds aanzienlijk voor snelle korte taken.

Redeneren

Niveaus van redeneren: OpenAI biedt instelbare reasoning_effort (none → xhigh); mini en nano kunnen met verschillende niveaus van inspanning draaien, maar mini verkleint bij hogere inspanning de kloof met de volledige GPT-5.4 op veel redeneerbenchmarks. Op verschillende intelligentiebenchmarks (bijv. GPQA Diamond) behaalt mini een score van 88.0% tegenover 93.0% voor GPT-5.4, en nano scoort 82.8%, wat wijst op respectabel redeneren voor een klein model. Dit zijn de resultaten die OpenAI in hun lanceringsbericht publiceerde.

Multimodaal begrip (vision en UI)

Visuele perceptie en UI-taken: GPT-5.4 mini laat zeer sterke multimodale prestaties zien voor UI-taken (screenshots, dichte documentafbeeldingen). Op OSWorld-Verified (een benchmark voor computergebruik) scoort mini 72.1%, veel dichter bij GPT-5.4’s 75.0% en ruim boven eerdere mini’s — daarom wordt mini gepositioneerd voor screenshot-gestuurde automatiseringen en responsieve multimodale assistenten. Nano presteert lager op visuele benchmarks, maar is nog steeds bruikbaar voor eenvoudigere beeldtaken.

Toolaanroepen en computergebruik

Native tool-/klikmogelijkheden: GPT-5.4 introduceert en breidt native tooling voor computergebruik uit; mini erft de mogelijkheid om tools aan te roepen, function calls te doen, screenshots te interpreteren en subagenten te orkestreren. Benchmarks voor toolaanroepen (Toolathlon, MCP Atlas) laten zien dat mini en nano respectabele scores behalen (Toolathlon: mini 42.9%, nano 35.5%) — dit kwantificeert hun vermogen om externe tools aan te roepen en te coördineren. Deze statistieken komen uit de aankondiging van OpenAI.

Hallucinatie / feitelijkheid / foutpercentages

OpenAI meldt dat GPT-5.4 het “meest feitelijke model tot nu toe” is en minder hallucinaties vertoont dan GPT-5.2; mini en nano laten lagere absolute feitelijkheid zien dan het volledige model (bijv. HLE w/ tools: GPT-5.4 52.1%, mini 41.5%, nano 37.7%), wat wijst op een grotere noodzaak tot verificatie wanneer kleinere modellen worden gebruikt voor feitelijk gevoelige taken. Gebruik verificatie op basis van tools (tool calls, citation recall) wanneer correctheid belangrijk is.

Snelheid

OpenAI meldt dat GPT-5.4 mini meer dan 2× sneller draait dan de eerdere GPT-5 mini op typische productielatentieschattingen (gebaseerd op gesimuleerd productiegedrag dat tool call-duur en bemonsterde tokens omvat). Deze snelheidswinst is een centrale claim voor de nieuwe familie en maakt het mogelijk mini te gebruiken als responsieve subagent binnen interactieve apps zoals code-assistenten.

Hoe presteren mini en nano — benaderen ze de volledige GPT-5.4?

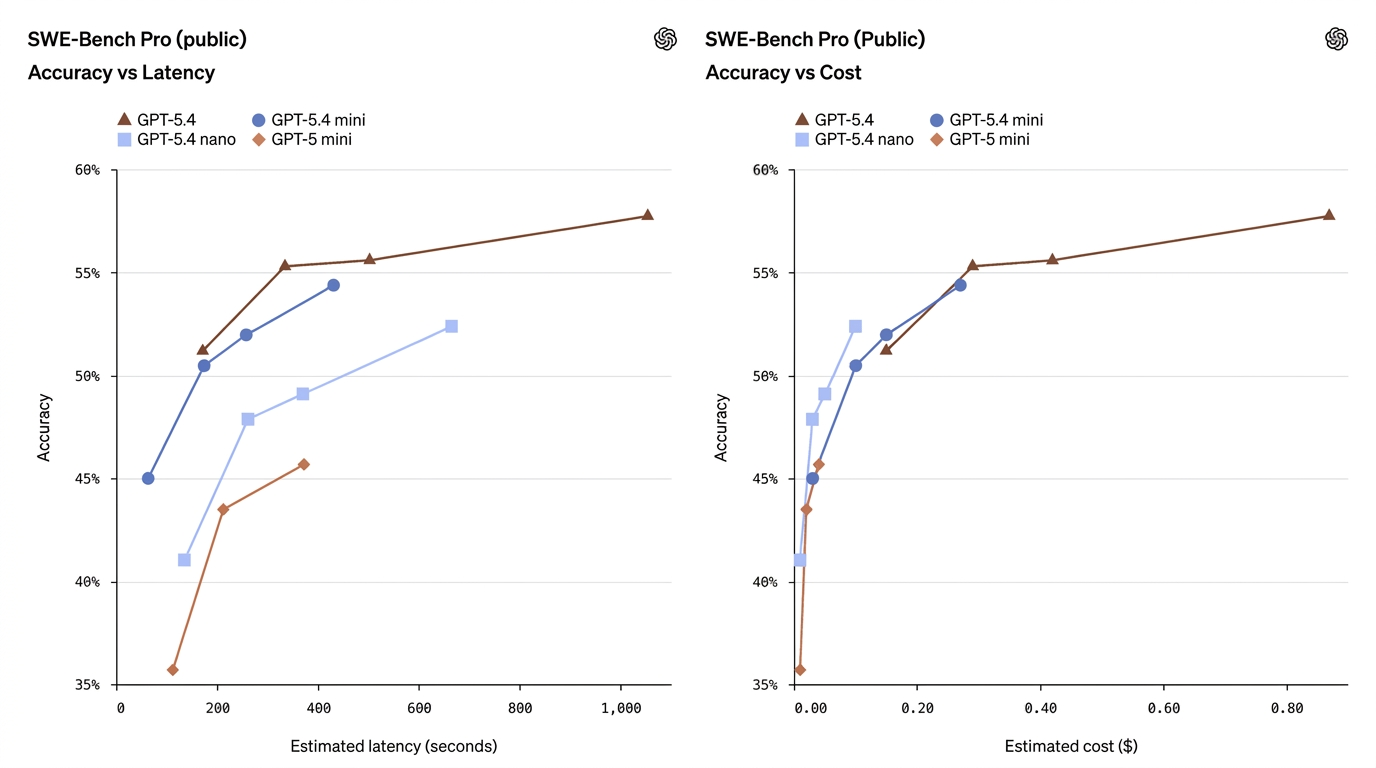

OpenAI publiceerde een uitgebreide reeks benchmarkvergelijkingen voor coderen, toolgebruik, multimodale computer-use-taken, intelligentietests en evaluaties met lange context. De belangrijkste cijfers (xhigh reasoning effort waar van toepassing) zijn:

| Benchmark | GPT-5.4 | GPT-5.4 Mini | GPT-5.4 Nano | GPT-5 Mini (oud) | Opmerkingen |

|---|---|---|---|---|---|

| SWE-Bench Pro (coderen) | 57.7% | 54.4% | 52.4% | 45.7% | Mini benadert de codeerprestaties van het volledige model |

| Terminal-Bench 2.0 (interactief coderen) | 75.1% | 60.0% | 46.3% | — | Sterk realtime codeervermogen voor Mini |

| Toolathlon (toolgebruik) | 54.6% | 42.9% | 35.5% | — | Meet orkestratie en tool-calling |

| GPQA Diamond (geavanceerde QA) | 93.0% | 88.0% | 82.8% | — | Benchmark voor intelligentie en redeneren |

| OSWorld-Verified (GUI-taken) | 75.0% | 72.1% | 39.0% | 42.0% | UI-/computer-use-capaciteit |

Deze cijfers laten zien dat mini de kloof vaak aanzienlijk verkleint — vooral bij coderen en computer-use-taken — terwijl nano een bruikbaar midden vormt tussen capaciteit en kosten.

Wat betekenen deze cijfers in gewone taal?

- GPT-5.4 Mini ≈ “bijna vlaggenschip” op veel productietaken. Op SWE-Bench Pro (een coderings-pass-rate-meting) scoort mini 54.4% tegenover 57.7% voor het vlaggenschip — een kleine relatieve kloof voor veel echte codeertaken, vooral wanneer latentie belangrijk is. Op OSWorld (computergebruik) scoort mini 72.1% tegenover 75.0% voor het vlaggenschip — opnieuw zeer dichtbij voor UI-/screenshot-taken.

- GPT-5.4 Nano ruilt meer capaciteit in voor snelheid/kosten. Nano’s codeerscore (52.4% op SWE-Bench Pro) is respectabel ten opzichte van oudere mini’s, maar de OSWorld-score daalt naar 39.0%, wat laat zien dat nano minder geschikt is voor taken die complex, meerstaps UI-begrip of agentische toolsequenties vereisen. Nano blinkt uit in single-turn-classificatie, extractie en kleine hulptaken.

- Toolgebruik verbetert, maar blijft gevoelig. Toolathlon en andere toolgebruik-metrieken stijgen aanzienlijk bij de overstap van GPT-5 mini naar GPT-5.4 mini/nano, wat laat zien dat OpenAI’s engineering de betrouwbaarheid van toolaanroepen in kleinere modellen heeft verbeterd — maar het volledige model blijft vooroplopen in complexe toolorkestratie.

Hoe ze in productie werken

Compressie, distillatie en engineeringoptimalisaties

Compacte modellen zoals mini/nano gebruiken doorgaans een combinatie van modeldistillatie, quantization en architectural pruning om waardevolle capaciteiten (codeerheuristieken, visuele percepten) te behouden en tegelijkertijd de inferentiecompute te verlagen. De bewoording van OpenAI wijst op gerichte engineering om specifieke vaardigheden (coderen, multimodaal UI-begrip) in kleinere footprints te behouden.

Aanbevolen patronen

- Orchestrator + subagent-patroon: Gebruik GPT-5.4 (groot) als planner/judge en stuur werk door naar GPT-5.4 mini / nano-subagenten voor snelle uitvoering (zoeken, parseren, bewerken). Dit verlaagt de totale kosten en vermindert de latentie voor de gebruiker. OpenAI ondersteunt dit ontwerppatroon expliciet.

- Fallback en afhandeling van rate limits: Stel mini beschikbaar als terugvaloptie bij rate limits in ChatGPT of Codex, zodat tijdgevoelige vragen toch een capabel antwoord krijgen wanneer het volledige model niet beschikbaar is.

- Gelaagde architectuur voor kostenbeheersing: Bulk-pijplijnen (indexering, extractie) → GPT-5.4 nano; interactieve UI-componenten → GPT-5.4 mini; eindoordeel van de redactie / complexe chains → GPT-5.4 full. Deze meerlagige aanpak balanceert kosten en capaciteit.

Latentie en parallellisatie

Mini en nano zijn geoptimaliseerd voor parallelle subagenten, waarbij veel kleine workers gelijktijdig draaien — bijvoorbeeld het parallel scannen van duizenden PDF’s. OpenAI’s concept van “tool yields” meet hoe parallelle tool calls de wall-clock-latentie verminderen; mini/nano zijn ontworpen om die patronen kosteneffectief te maken.

Hoe zou ik mini en nano in de praktijk gebruiken

Moet ik mijn vlaggenschip-calls overal vervangen door mini/nano?

Niet automatisch. Het juiste patroon dat OpenAI expliciet aanbeveelt is delegatie: gebruik een groter model voor planning, complexe oordeelsvorming of eindverificatie, en stuur veel ondersteunende, kortere subtaken naar mini- of nano-subagenten. Dit patroon verlaagt kosten en latentie, terwijl de guardrails van het grotere model behouden blijven waar dat het belangrijkst is. Gebruiksscenario’s:

- Interactieve code-assistenten: het vlaggenschip plant en reviewt; mini verzorgt snelle codezoekopdrachten, bewerkingen en korte unit-tests.

- Screenshot-gestuurde “computer use”-agenten: mini kan dichte interfaces snel parseren; het vlaggenschip lost ambigu meerstapsplanning op.

- Pijplijnen voor extractie en classificatie met hoog volume: nano verwerkt enorme batchinvoer (formulieren, logs) en retourneert gestructureerde resultaten; het vlaggenschip behandelt uitzonderingen en complexe edge cases.

Kunnen mini of nano worden gebruikt voor multimodale of beeldtaken?

Ja — mini ondersteunt beeldinvoer en presteert goed op multimodale/vision-gedreven benchmarks (MMMUPro/OmniDocBench), waarbij het op sommige tests het vlaggenschip benadert. Nano’s multimodale kracht is beperkter: hoewel het beter presteert dan eerdere nano’s, is het niet de beste keuze voor diep multimodaal redeneren of agentische, op beelden gebaseerde taken.

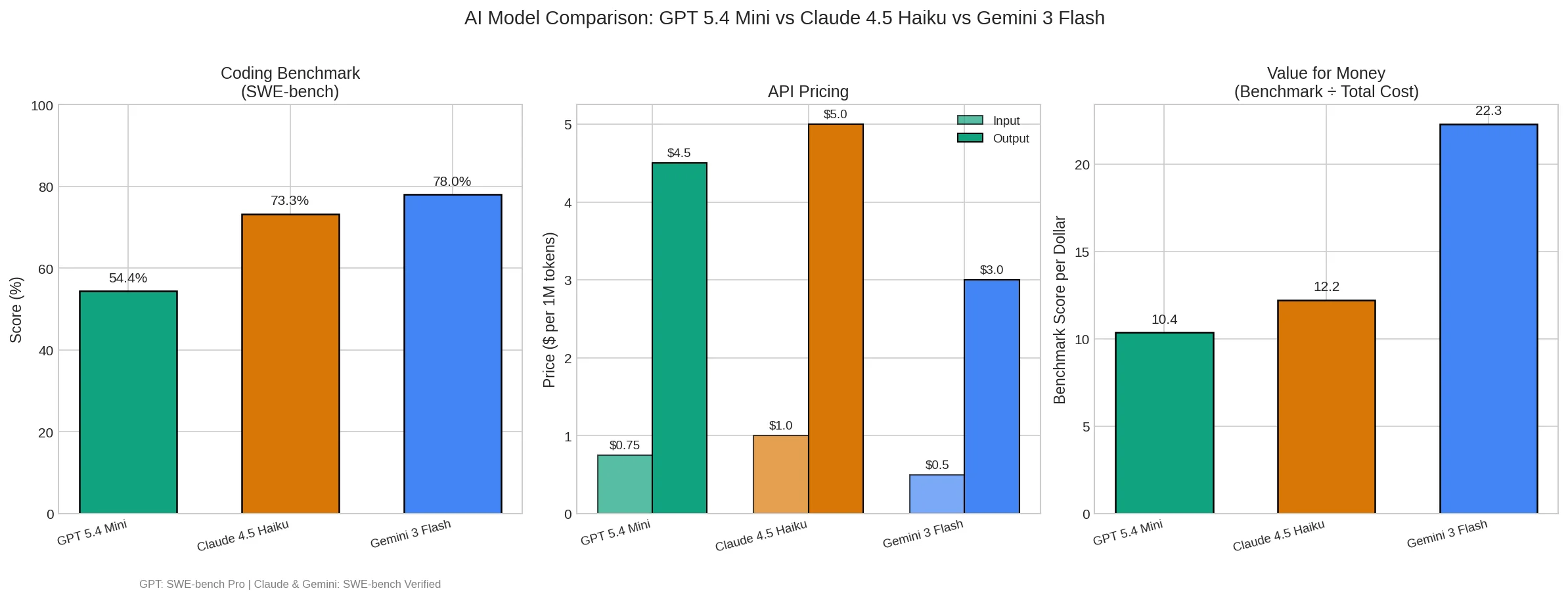

De race om kleine modelcapaciteiten is intenser geworden

Drie maanden geleden werden kleine modellen beschouwd als "goed genoeg". Nu benadert GPT-5.4 mini vlaggenschipmodellen op programmeerbenchmarks en evenaart het ze bijna in computationele prestaties.

De trend hierachter is duidelijk: de capaciteiten van vlaggenschipmodellen worden snel overgedragen aan kleinere modellen. OpenAI, Google en Anthropic doen allemaal hetzelfde: de kerncapaciteiten van grote modellen distilleren naar kleinere, snellere en goedkopere versies.

Conclusie

De introductie van deze twee modellen betekent een verschuiving in AI-toepassingen van een focus op schaal naar een focus op praktische efficiëntie. Door hun snelle responscapaciteiten bieden ze betrouwbaardere onderliggende ondersteuning voor realtime AI-interactie en het opsplitsen van complexe taakstromen.

Voor ontwikkelaars betekent dit dat de kostenstructuur van agentsystemen opnieuw wordt gedefinieerd. Wanneer de kosten tot dit niveau dalen, worden veel agentscenario’s die voorheen "theoretisch haalbaar maar economisch onhaalbaar" waren, wel levensvatbaar.

Ontwikkelaars hebben nu toegang tot GPT 5.4 Mini en GPT-5.4 Nano via CometAPI(CometAPI is een one-stop aggregatieplatform voor large model API’s zoals GPT API’s, Nano Banana API’s enz.) Voordat je toegang krijgt, moet je ervoor zorgen dat je bent ingelogd op CometAPI en de API-sleutel hebt verkregen. CometAPI biedt een prijs die veel lager ligt dan de officiële prijs om je te helpen bij integratie.

Klaar om te gaan?

.png&w=3840&q=75)