In 2025–2026 bleef het landschap van AI-tools zich consolideren: gateway-API’s (zoals CometAPI) breidden uit om OpenAI-achtige toegang te bieden tot honderden modellen, terwijl eindgebruikers-LLM-apps (zoals AnythingLLM) hun provider “Generic OpenAI” verder verbeterden zodat desktop- en local-first-apps elk OpenAI-compatibel endpoint kunnen aanroepen. Daardoor is het vandaag eenvoudig om AnythingLLM-verkeer via CometAPI te routeren en te profiteren van modelkeuze, kostenrouting en uniforme facturatie — terwijl je nog steeds de lokale UI en RAG-/agentfuncties van AnythingLLM gebruikt.

Wat is AnythingLLM en waarom zou je het met CometAPI willen verbinden?

Wat is AnythingLLM?

AnythingLLM is een open-source, alles-in-één AI-applicatie en lokale/cloudclient voor het bouwen van chatassistenten, retrieval-augmented generation (RAG)-workflows en door LLM’s aangedreven agents. Het biedt een strakke UI, een developer-API, workspace-/agentfuncties en ondersteuning voor lokale en cloud-LLM’s — ontworpen om standaard privé te zijn en uitbreidbaar via plugins. AnythingLLM biedt een provider Generic OpenAI waarmee het kan communiceren met OpenAI-compatibele LLM-API’s.

Wat is CometAPI?

CometAPI is een commercieel API-aggregatieplatform dat 500+ AI-modellen beschikbaar maakt via één OpenAI-achtige REST-interface en uniforme facturatie. In de praktijk kun je er modellen van meerdere leveranciers mee aanroepen (OpenAI, Anthropic, Google/Gemini-varianten, beeld-/audiomodellen, enz.) via dezelfde endpoints https://api.cometapi.com/v1 en één enkele API-sleutel (indeling sk-xxxxx). CometAPI ondersteunt standaard OpenAI-achtige endpoints zoals /v1/chat/completions, /v1/embeddings, enz., waardoor tools die al OpenAI-compatibele API’s ondersteunen eenvoudig kunnen worden aangepast.

Waarom AnythingLLM integreren met CometAPI?

Drie praktische redenen:

- Modelkeuze en flexibiliteit tussen leveranciers: AnythingLLM kan “elk OpenAI-compatibel” LLM gebruiken via de Generic OpenAI-wrapper. Door die wrapper naar CometAPI te laten verwijzen, krijg je direct toegang tot honderden modellen zonder de UI of workflows van AnythingLLM te wijzigen.

- Optimalisatie van kosten/operations: Met CometAPI kun je modellen centraal wisselen (of overschakelen naar goedkopere modellen) voor kostenbeheersing, en uniforme facturatie behouden in plaats van met meerdere providersleutels te werken.

- Sneller experimenteren: Je kunt verschillende modellen A/B-testen (bijvoorbeeld

gpt-4o,gpt-4.5, Claude-varianten of open-source multimodale modellen) via dezelfde AnythingLLM-UI — handig voor agents, RAG-antwoorden, samenvattingen en multimodale taken.

Welke omgeving en voorwaarden moet je voorbereiden vóór de integratie?

Systeem- en softwarevereisten (hoog niveau)

- Desktop of server waarop AnythingLLM draait (Windows, macOS, Linux) — desktopinstallatie of self-hosted instantie. Controleer of je een recente build gebruikt waarin de instellingen LLM Preferences / AI Providers beschikbaar zijn.

- CometAPI-account en een API-sleutel (de geheime sleutel in

sk-xxxxx-stijl). Je gebruikt deze sleutel in de Generic OpenAI-provider van AnythingLLM. - Netwerkconnectiviteit van je machine naar

https://api.cometapi.com(geen firewall die uitgaand HTTPS-verkeer blokkeert). - Optioneel maar aanbevolen: een moderne Python- of Node-omgeving voor tests (Python 3.10+ of Node 18+), curl en een HTTP-client (Postman / HTTPie) om CometAPI te controleren voordat je het aan AnythingLLM koppelt.

AnythingLLM-specifieke voorwaarden

De LLM-provider Generic OpenAI is de aanbevolen route voor endpoints die het API-oppervlak van OpenAI nabootsen. In de documentatie van AnythingLLM staat dat deze provider op ontwikkelaars is gericht en dat je de invoer die je opgeeft moet begrijpen. Als je streaming gebruikt of je endpoint streaming niet ondersteunt, bevat AnythingLLM een instelling om streaming voor Generic OpenAI uit te schakelen.

Beveiligings- en operationele checklist

- Behandel de CometAPI-sleutel als elk ander geheim — commit deze niet naar repositories; sla hem waar mogelijk op in OS-sleutelhangers of omgevingsvariabelen.

- Als je gevoelige documenten in RAG wilt gebruiken, controleer dan of de privacygaranties van het endpoint aan je compliance-eisen voldoen (raadpleeg de documentatie/voorwaarden van CometAPI).

- Bepaal limieten voor max tokens en contextvenster om uit de hand lopende kosten te voorkomen.

Hoe configureer je AnythingLLM om CometAPI te gebruiken (stap voor stap)?

Hieronder staat een concrete reeks stappen — gevolgd door voorbeeld-omgevingsvariabelen en codefragmenten om de verbinding te testen voordat je de instellingen in de AnythingLLM-UI opslaat.

Stap 1 — Verkrijg je CometAPI-sleutel

- Registreer of meld je aan bij CometAPI.

- Ga naar “API Keys” en genereer een sleutel — je krijgt een tekenreeks die eruitziet als

sk-xxxxx. Houd deze geheim.

Stap 2 — Controleer of CometAPI werkt met een snelle aanvraag

Gebruik curl of Python om een eenvoudig chat-completion-endpoint aan te roepen en de connectiviteit te bevestigen.

Curl-voorbeeld

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

Als dit een 200 retourneert en een JSON-respons met een choices-array, werken je sleutel en netwerk. (De documentatie van CometAPI toont het OpenAI-achtige oppervlak en de endpoints.)

Python-voorbeeld (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

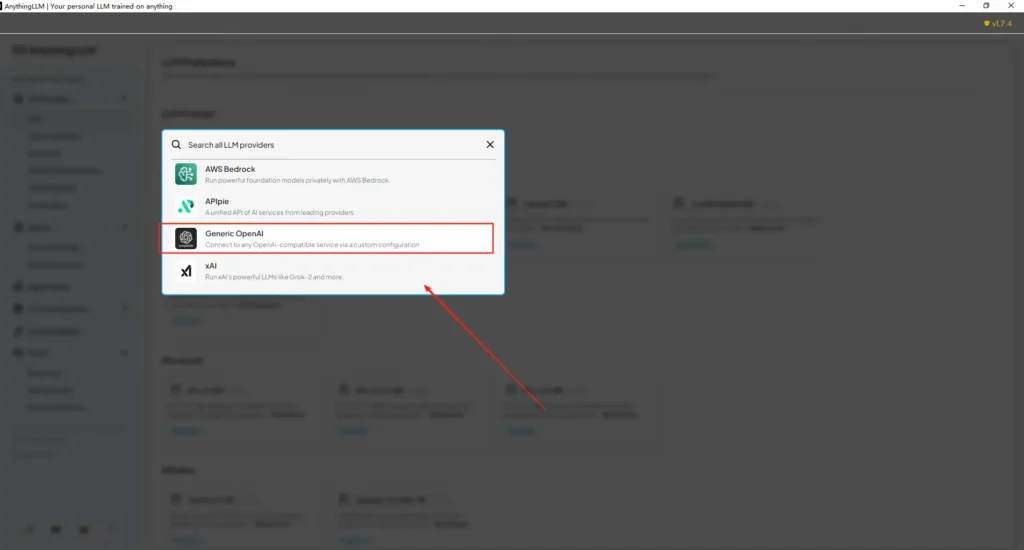

Stap 3 — Configureer AnythingLLM (UI)

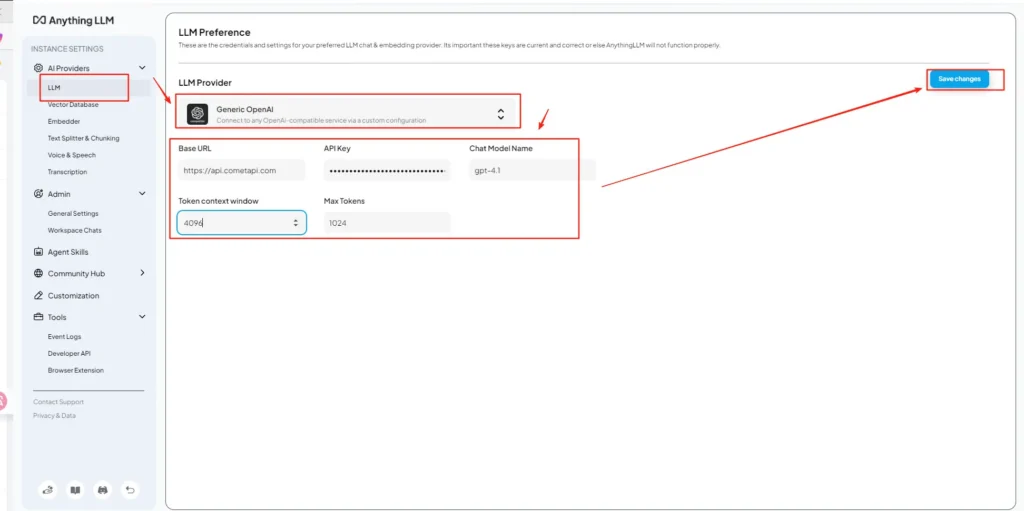

Open AnythingLLM → Settings → AI Providers → LLM Preferences (of een vergelijkbaar pad in jouw versie). Gebruik de provider Generic OpenAI en vul de velden als volgt in:

API Configuration (voorbeeld)

• Open het instellingenmenu van AnythingLLM en zoek LLM Preferences onder AI Providers.

• Selecteer Generic OpenAI als modelprovider en voerhttps://api.cometapi.com/v1in het URL-veld in.

• Plak desk-xxxxxvan CometAPI in het invoervak voor de API-sleutel. Vul Token context window en Max Tokens in volgens het daadwerkelijke model. Je kunt op deze pagina ook modelnamen aanpassen, bijvoorbeeld door het modelgpt-4otoe te voegen.

Dit sluit aan bij de richtlijnen van AnythingLLM voor “Generic OpenAI” (developer-wrapper) en de OpenAI-compatibele base-URL-benadering van CometAPI.

Stap 4 — Stel modelnamen en tokenlimieten in

Voeg op hetzelfde instellingenscherm modelnamen toe of pas ze aan exact zoals CometAPI ze publiceert (bijvoorbeeld gpt-4o, minimax-m2, kimi-k2-thinking), zodat de AnythingLLM-UI deze modellen aan gebruikers kan tonen. CometAPI publiceert modeltekenreeksen voor elke leverancier.

Stap 5 — Test in AnythingLLM

Start een nieuwe chat of gebruik een bestaande workspace, selecteer de Generic OpenAI-provider (als je meerdere providers hebt), kies een van de CometAPI-modelnamen die je hebt toegevoegd en voer een eenvoudige prompt uit. Als je coherente completions krijgt, is de integratie geslaagd.

Hoe AnythingLLM deze instellingen intern gebruikt

De Generic OpenAI-wrapper van AnythingLLM construeert OpenAI-achtige aanvragen (/v1/chat/completions, /v1/embeddings), dus zodra je de base URL instelt en de CometAPI-sleutel opgeeft, zal AnythingLLM chats, agentaanroepen en embedding-aanvragen transparant via CometAPI routeren. Als je AnythingLLM-agents gebruikt (de @agent-flows), nemen die dezelfde provider over.

Wat zijn best practices en mogelijke valkuilen?

Best practices

- Gebruik modelgeschikte contextinstellingen: Stem Token Context Window en Max Tokens in AnythingLLM af op het model dat je op CometAPI kiest. Een mismatch leidt tot onverwachte truncatie of mislukte aanroepen.

- Beveilig je API-sleutels: Sla CometAPI-sleutels op in omgevingsvariabelen en/of Kubernetes/secret manager; commit ze nooit naar git. AnythingLLM slaat sleutels op in de lokale instellingen als je ze in de UI invoert — behandel de opslag van de host als gevoelig.

- Begin met goedkopere / kleinere modellen voor experimentele workflows: Gebruik CometAPI om voordeligere modellen voor ontwikkeling te proberen, en reserveer premiummodellen voor productie. CometAPI adverteert expliciet met kostenwisseling en uniforme facturatie.

- Controleer gebruik en stel waarschuwingen in: CometAPI biedt gebruiksdashboards — stel budgetten/waarschuwingen in om verrassende rekeningen te voorkomen.

- Test agents en tools geïsoleerd: AnythingLLM-agents kunnen acties activeren; test ze eerst met veilige prompts en op staging-instanties.

Veelvoorkomende valkuilen

- Conflicten tussen UI en

.env: Bij self-hosting kunnen UI-instellingen.env-wijzigingen overschrijven (en omgekeerd). Controleer de gegenereerde/app/server/.envals instellingen na een herstart worden teruggezet. Community-issues melden resets vanLLM_PROVIDER. - Mismatch in modelnamen: Het gebruik van een modelnaam die niet beschikbaar is op CometAPI veroorzaakt een 400/404 van de gateway. Controleer altijd de beschikbare modellen in de modellijst van CometAPI.

- Tokenlimieten en streaming: Als je streamingantwoorden nodig hebt, controleer dan of het CometAPI-model streaming ondersteunt (en of jouw versie van de AnythingLLM-UI dit ondersteunt). Sommige providers verschillen in streamingsemantiek.

Welke praktijktoepassingen maakt deze integratie mogelijk?

Retrieval-Augmented Generation (RAG)

Gebruik de documentloaders + vector-DB van AnythingLLM met CometAPI-LLM’s om contextbewuste antwoorden te genereren. Je kunt experimenteren met goedkope embeddings + dure chatmodellen, of alles op CometAPI houden voor uniforme facturatie. De RAG-flows van AnythingLLM zijn een primaire ingebouwde functie.

Agentautomatisering

AnythingLLM ondersteunt @agent-workflows (pagina’s browsen, tools aanroepen, automatiseringen uitvoeren). Door de LLM-aanroepen van agents via CometAPI te routeren, krijg je keuze uit modellen voor controle-/interpretatiestappen zonder agentcode te wijzigen.

Multi-model A/B-testen en kostenoptimalisatie

Wissel modellen per workspace of functie (bijvoorbeeld gpt-4o voor productieantwoorden, gpt-4o-mini voor dev). CometAPI maakt modelwissels triviaal en centraliseert de kosten.

Multimodale pijplijnen

CometAPI biedt beeld-, audio- en gespecialiseerde modellen. De multimodale ondersteuning van AnythingLLM (via providers) in combinatie met de modellen van CometAPI maakt image captioning, multimodale samenvatting of audiotranscriptieworkflows via dezelfde interface mogelijk.

Conclusie

CometAPI blijft zich positioneren als een gateway met meerdere modellen (500+ modellen, OpenAI-achtige API) — wat het een natuurlijke partner maakt voor apps zoals AnythingLLM die al een Generic OpenAI-provider ondersteunen. Evenzo maken de Generic-provider van AnythingLLM en recente configuratieopties het eenvoudig om verbinding te maken met zulke gateways. Deze convergentie vereenvoudigt experimenten en productiemigratie eind 2025.

Hoe je aan de slag gaat met Comet API

CometAPI is een uniform API-platform dat meer dan 500 AI-modellen van toonaangevende providers samenbrengt — zoals de GPT-serie van OpenAI, Gemini van Google, Claude van Anthropic, Midjourney, Suno en meer — in één ontwikkelaarsvriendelijke interface. Door consistente authenticatie, aanvraagopmaak en responsverwerking aan te bieden, vereenvoudigt CometAPI de integratie van AI-mogelijkheden in je applicaties aanzienlijk. Of je nu chatbots, beeldgeneratoren, muziekcomponisten of datagedreven analysepijplijnen bouwt, CometAPI laat je sneller itereren, kosten beheersen en leverancier-onafhankelijk blijven — terwijl je profiteert van de nieuwste doorbraken in het AI-ecosysteem.

Om te beginnen kun je de modelmogelijkheden van CometAPI verkennen in de Playground en de API-handleiding raadplegen voor gedetailleerde instructies. Zorg er vóór toegang voor dat je bent ingelogd bij CometAPI en de API-sleutel hebt verkregen. CometAPI biedt een prijs die veel lager ligt dan de officiële prijs om je te helpen integreren.

Klaar om te gaan?→ Meld je vandaag nog aan voor CometAPI !

Als je meer tips, handleidingen en nieuws over AI wilt weten, volg ons dan op VK, X en Discord!