Anthropic bracht Claude Opus 4.5 eind november 2025 uit als een capabeler en efficiënter model in de Opus-klasse, gericht op professionele software-engineering, agent-gestuurde workflows en langetermijntaken. Het is beschikbaar via het ontwikkelaarsplatform van Anthropic en via CometAPI en introduceert nieuwe API-regelaars (met name de parameter effort), verbeterde computer-use tooling, extended thinking en token-efficiëntieverbeteringen die in productie het verschil maken.

Hieronder volgt een praktische, professionele walkthrough: wat er is veranderd, hoe je toegang krijgt, hoe je de nieuwe regelaars gebruikt (effort, extended thinking, tool use, files/computer use), kosten- en optimalisatie-advies, veiligheids-/governance-overwegingen, en integratiepatronen uit de praktijk.

Wat is Claude Opus 4.5 precies en waarom is het belangrijk?

Claude Opus 4.5 is het nieuwste model in de Opus-klasse van Anthropic (uitgebracht op 24–25 november 2025), dat zich richt op maximale redeneer- en codeercapaciteit, terwijl het de token-efficiëntie verbetert en nieuwe API-regelaars biedt om kosten en grondigheid in balans te brengen. Anthropic positioneert Opus 4.5 als het “meest intelligente model” dat het heeft uitgebracht, gericht op complexe software-engineeringtaken, langlopende agents, spreadsheet/Excel-automatisering en taken die volgehouden meerstapsredenering vereisen.

Wat zijn de belangrijkste updates in Opus 4.5?

Anthropic ontwierp Opus 4.5 om de diepte van het redeneren en het agent-gedrag te verbeteren, terwijl ontwikkelaars betere controle krijgen over de afweging tussen kosten en latency. De hoogtepunten van de release:

- Effort-parameter (beta): een eersteklas API-knop die bepaalt hoeveel “denkbudget” Claude aan een verzoek besteedt (meestal

low,medium,high). Het beïnvloedt redenering, tool-calls en interne “thinking”-tokens, zodat je snelheid vs. grondigheid per call kunt afstemmen zonder van model te wisselen. Dit is een kenmerkende capaciteit van Opus 4.5. - Betere orkestratie van agents en tools: verbeterde nauwkeurigheid bij het kiezen van tools, beter gestructureerde tool-calls en een robuustere workflow voor tool-resultaten voor het bouwen van agents en meerstapspijplijnen. Anthropic levert documentatie en SDK-richtlijnen voor de “tool use”-flow.

- Token-/kosten-efficiëntie — Anthropic meldt tot ~50% minder tokenverbruik voor sommige workflows t.o.v. Sonnet 4.5, plus minder fouten bij tool-calls en minder iteraties voor complexe engineeringtaken.

- Verbeterde multimodale capaciteiten: algehele verbeteringen in visuele, redeneer- en wiskundige prestaties.

- Contextvenster uitgebreid tot 200K tokens, waardoor diepe, lange gesprekken en complexe documentanalyse mogelijk zijn.

Welke praktische capaciteiten zijn verbeterd?

Prestatie-upgrade

- Betere orkestratie van agents en tools: verbeterde nauwkeurigheid bij het kiezen van tools, beter gestructureerde tool-calls en een robuustere workflow voor tool-resultaten voor het bouwen van agents en meerstapspijplijnen. Anthropic levert documentatie en SDK-richtlijnen voor de “tool use”-flow. Verbeterde omgang met context, compactie-helpers voor lange agent-runs en eersteklas tool-SDK’s voor het registreren en valideren van tools betekenen dat Opus 4.5 beter is voor het bouwen van agents die vele stappen onbewaakt draaien.

- Verbeterde multimodale capaciteiten: algehele verbeteringen in visuele, redeneer- en wiskundige prestaties.

- Contextvenster uitgebreid tot 200K tokens, waardoor diepe, lange gesprekken en complexe documentanalyse mogelijk zijn.

Coderen en langetermijnwerk

Opus 4.5 blijft benchmark-gedreven voor coderings taken; het vermindert het aantal iteraties en fouten bij tool-calls tijdens lange jobs (code-migratie, refactor, meerstapsdebugging). Vroege rapporten en de system card van Anthropic vermelden verbeterde prestaties op engineeringbenchmarks en dramatische efficiëntiewinsten in tool-gedreven pijplijnen.

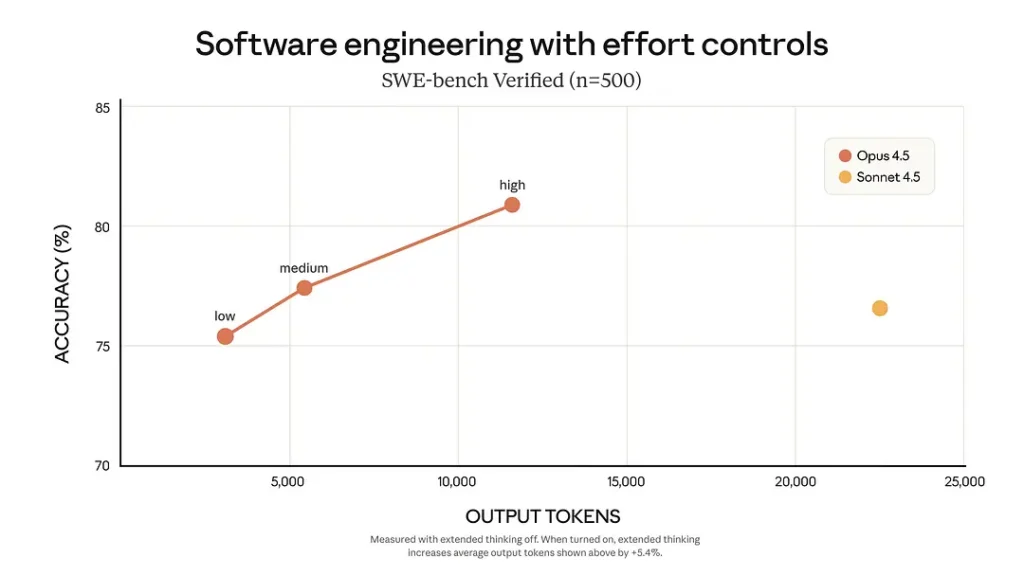

In SWE-bench rapporteert Opus 4.5 leidende scores op software-engineeringbenchmarks (Anthropic noemt 80,9% op SWE-bench Verified in het lanceringsmateriaal), en klanten melden verbeteringen bij debuggen, bewerkingen over meerdere bestanden en langetermijn codeertaken.

Kosten en efficiëntie

Anthropic ontwierp Opus 4.5 om de diepte van redenering en agent-gedrag te verbeteren, terwijl ontwikkelaars betere controle krijgen over de afweging tussen kosten en latency:

- Prijsverlaging t.o.v. Opus 4.1: $5 (input) / $25 (output) per miljoen tokens.

- Verbetering in tokenverbruik: Gemiddelde reductie van 50–75% in consumptie met behoud van prestaties.

- een eersteklas API-knop die bepaalt hoeveel “denkbudget” Claude aan een verzoek besteedt (meestal

low,medium,high). Het beïnvloedt redenering, tool-calls en interne “thinking”-tokens, zodat je snelheid vs. grondigheid per call kunt afstemmen zonder van model te wisselen. Dit is een kenmerkende capaciteit van Opus 4.5 (vergeleken met Sonnet 4.5: Medium Effort → 76% minder tokens, vergelijkbare performance; High Effort → 4,3% prestatieverbetering, 48% reductie in tokenverbruik).

Hoe krijg ik toegang tot en gebruik ik de Claude Opus 4.5 API?

Hoe kan ik toegang en keys verkrijgen?

- Maak een Anthropic/Claude-ontwikkelaarsaccount aan. Meld je aan via het Anthropic/Claude-ontwikkelaarsportaal en maak een API-sleutel aan via de Console (organisatie-/admin-flows bestaan voor teams). De Messages API is het primaire endpoint voor chat-/assistant-achtige interacties.

- Cloudpartners: Opus 4.5 is ook beschikbaar via grote cloudmarktplaatsen Google Vertex AI, CometAPI (een AI-API-aggregatieplatform, vereist de eigen authenticatie). In CometAPI krijg je toegang tot de Claude Opus 4.5 API via het Anthropic Messages-formaat en Chat-formaat.

Hoe moet ik mijn verzoeken authenticeren?

Gebruik standaard bearer tokens: voeg een Authorization: Bearer $_API_KEY-header toe aan elke API-call. Verzoeken zijn JSON over HTTPS; de Messages API accepteert een lijst van gestructureerde berichten (system + user + assistant).

Quickstart — Python (officiële SDK)

Installeer de SDK:

pip install anthropic

Minimaal voorbeeld (synchronisch):

import os

from anthropic import Anthropic

# expects ANTHROPIC_API_KEY in env

client = Anthropic(api_key=os.environ)

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

max_tokens=512,

)

print(resp.content.text) # SDK returns structured content blocks

Deze call gebruikt de canonieke modelidentifier voor Opus 4.5. Voor provider-beheerde endpoints (Vertex, CometAPI, Foundry) volg je de providerdocumentatie om de client te construeren en de URL en sleutel van de provider op te geven (bijv. https://api.cometapi.com/v1/messages voor CometAPI).

Quickstart — Python (CometAPI)

Je moet inloggen bij CometAPI en een sleutel verkrijgen.

curl

--location

--request POST 'https://api.cometapi.com/v1/messages' \

--header 'Authorization: Bearer ' \

--header 'Content-Type: application/json' \

--data-raw '{ "model": "claude-opus-4-5-20251101", "max_tokens": 1000, "thinking": { "type": "enabled", "budget_tokens": 1000 }, "messages": }'

Hoe gebruik ik de nieuwe parameter effort en extended thinking?

Wat is de parameter effort en hoe stel ik die in?

De parameter effort is een eersteklas API-regelaar, geïntroduceerd met Opus 4.5, die aanpast hoeveel interne berekening en tokenbudget het model besteedt aan het genereren van output. Typische waarden zijn low, medium en high. Gebruik dit om latency en tokencost te balanceren tegenover grondigheid:

low— snelle, token-efficiënte antwoorden voor high-volume automatisering en routinetaken.medium— gebalanceerde kwaliteit/kosten voor productiegebruik.high— diepe analyses, meerstapsredenering of wanneer nauwkeurigheid het belangrijkst is.

Anthropic introduceerde effort voor Opus 4.5 (beta). Je moet een beta-header opnemen (bijv. effort-2025-11-24) en output_config: { "effort": "low|medium|high" } specificeren (zie voorbeeld hieronder). high is het standaardgedrag. Het verlagen van de effort reduceert het tokengebruik en de latency, maar kan de grondigheid enigszins verminderen. Gebruik dit voor high-throughput- of latency-gevoelige taken.

Voorbeeld:

# Example using the beta messages API shown in Anthropic docs

from anthropic import Anthropic

import os

client = Anthropic(api_key=os.getenv("ANTHROPIC_API_KEY"))

response = client.beta.messages.create(

model="claude-opus-4-5-20251101",

betas=, # required beta header

messages=,

max_tokens=1500,

output_config={"effort": "medium"} # low | medium | high

)

print(response)

Wanneer welke te gebruiken: gebruik low voor geautomatiseerde pijplijnen (bijv. e-mailcategorisatie), medium voor standaardassistenten en high voor codegeneratie, diep onderzoek of risicogevoelige taken. Anthropic benadrukt deze parameter als een belangrijke regeling voor Opus 4.5.

In de SWE-bench-test:

- In Medium Effort-modus: prestaties vergelijkbaar met Sonnet 4.5, maar outputtokens zijn met 76% gereduceerd;

- In High Effort-modus: prestaties liggen ongeveer 4,3 procentpunt boven Sonnet 4.5, en tokens zijn met 48% gereduceerd.

Wat is Extended Thinking en hoe roep ik het aan?

Extended Thinking (ook “extended thinking” of “thinking blocks” genoemd) laat het model intermediaire denkstappen of stapsgewijze redenering uitvoeren, met optionele bewaring of samenvatting van de interne denkblokken. De Messages API ondersteunt dit gedrag en Anthropic heeft regelaars toegevoegd om eerdere denkblokken te behouden, zodat agents met meerdere beurten eerdere redenering kunnen hergebruiken zonder dure herberekening. Gebruik extended thinking wanneer de taak meerstapsplanning, langetermijnprobleemoplossing of toolorkestratie vereist.

Hoe integreer ik tools en bouw ik agents met Opus 4.5?

Een van de grote sterke punten van Opus 4.5 is verbeterd toolgebruik: definieer tools in je client, laat Claude beslissen wanneer ze aan te roepen, voer de tool uit en retourneer het tool_result — Claude gebruikt die resultaten in het uiteindelijke antwoord. Anthropic levert Agent-SDK’s waarmee je getypeerde toolfuncties kunt registreren (bijv. run_shell, call_api, search_docs) die Claude kan ontdekken en aanroepen tijdens extended thinking. Het platform zet tooldefinities om in aanroepbare functies die het model kan aanroepen en waarvan het resultaten kan ontvangen. Zo bouw je agent-gestuurde workflows veilig (met gecontroleerde inputs/outputs).

Hieronder volgt een praktisch patroon en een end-to-end Python-voorbeeld.

Tool-use-patroon (conceptueel)

- Client levert

tools-metadata met naam, beschrijving en JSON-schema (input_schema). - Model retourneert een

tool_use-blok (de gestructureerde instructie van het model om een specifieke tool met specifieke input aan te roepen). De API-responsstop_reasonkantool_usezijn. - Client voert de tool uit (jouw code roept de externe API of lokale functie aan).

- Client stuurt een vervolggbericht met

role:"user"en eentool_result-inhoudsblok met de output van de tool. - Model verbruikt het toolresultaat en retourneert een definitief antwoord of verdere tool-calls.

Deze flow maakt veilige client-side controle mogelijk over wat het model uitvoert (het model stelt tool-calls voor; jij controleert de uitvoering).

End-to-end-voorbeeld — Python (eenvoudige weertool)

# 1) Define tools metadata and send initial request

from anthropic import Anthropic

import os, json

client = Anthropic(api_key=os.environ)

tools = [

{

"name": "get_weather",

"description": "Return the current weather for a given city.",

"input_schema": {"type":"object","properties":{"city":{"type":"string"}},"required":}

}

]

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

tools=tools,

max_tokens=800,

)

# 2) Check if Claude wants a tool call

stop_reason = resp.stop_reason # SDK field

if stop_reason == "tool_use":

# Extract the tool call (format varies by SDK; this is schematic)

tool_call = resp.tool_calls # e.g., {"name":"get_weather", "input":{"city":"Tokyo"}}

tool_name = tool_call

tool_input = tool_call

# 3) Execute the tool client-side (here: stub)

def get_weather(city):

# Replace this stub with a real weather API call

return {"temp_c": 12, "condition": "Partly cloudy"}

tool_result = get_weather(tool_input)

# 4) Send tool_result back to Claude

follow_up = client.messages.create(

model="claude-opus-4-5-20251101",

messages=[

{"role":"user", "content":[{"type":"tool_result",

"tool_use_id": resp.tool_use_id,

"content": json.dumps(tool_result)}]}

],

max_tokens=512,

)

print(follow_up.content.text)

else:

print(resp.content.text)

Hoe structureer je agents voor betrouwbaarheid?

- Sanitize tool-inputs (voorkom injectie via prompts).

- Valideer tool-outputs voordat je ze terugstuurt naar het model (schemacontroles).

- Beperk de scope van tools (principe van minimale privileges).

- Gebruik compactie-helpers (van Anthropic SDK’s) om de context beheersbaar te houden tijdens lange runs.

Hoe ontwerp ik prompts en structureer ik berichten voor Opus 4.5?

Welke berichtrollen en prefill-strategieën werken het best?

Gebruik een drieluik:

- System (rol: system): globale instructies — toon, guardrails, rol.

- Assistant (optioneel): vooraf ingevulde voorbeelden of primingcontent.

- User (rol: user): het directe verzoek.

Vul het system-bericht met constraints (formaat, lengte, veiligheidsbeleid, JSON-schema als je gestructureerde output wilt). Voor agents: voeg toolspecificaties en gebruiksvoorbeelden toe zodat Opus 4.5 die tools correct kan aanroepen.

Hoe gebruik ik contextcompactie en promptcaching om tokens te besparen?

- Contextcompactie: comprimeer oudere delen van een conversatie tot kernachtige samenvattingen die het model kan blijven gebruiken. Opus 4.5 ondersteunt automatisering om context te compacten zonder cruciale denkblokken te verliezen.

- Promptcaching: cache modelresponsen voor herhaalde prompts (Anthropic biedt promptcachingpatronen om latency/kosten te reduceren).

Beide functies verlagen de tokenfootprint van lange interacties en worden aanbevolen voor langlopende agentworkflows en productieassistenten.

Foutafhandeling en best practices

Hieronder vind je pragmatische aanbevelingen voor betrouwbaarheid en veiligheid bij productie-integratie met Opus 4.5.

Betrouwbaarheid & retries

- Handel rate limits (HTTP 429) af met exponentiële backoff en jitter (begin bij 500–1000 ms).

- Idempotentie: voor niet-mutatieve LLM-calls kun je veilig opnieuw proberen, maar wees voorzichtig in workflows waar het model externe side-effects triggert (tool-calls) — dedupliceer door

tool_use_idof je eigen request-ID’s te tracken. - Streamingstabiliteit: behandel gedeeltelijke streams en maak netjes opnieuw verbinding; als er een onderbreking optreedt, probeer bij voorkeur het hele verzoek opnieuw of hervat met applicatieniveau-status om inconsistente toolinteracties te voorkomen.

Security & safety

- Prompt-injectie & toolveiligheid: laat het model nooit direct willekeurige shellcommands of code uitvoeren zonder validatie. Valideer altijd tool-inputs en sanitize outputs. Het model stelt tool-calls voor; jouw code beslist of ze worden uitgevoerd. De system card en documentatie van Anthropic beschrijven alignment-constraints en veiligheidsniveaus — volg die voor domeinen met hoog risico.

- Gegevensverwerking & compliance: behandel prompts en tool-inputs/-outputs met PII of gereguleerde data volgens je juridische/compliancebeleid. Gebruik provider-VPC/enterprise-controls als je strikte dataresidency- of auditvereisten hebt (Bedrock / Vertex / Foundry bieden enterprise-opties).

Observability & kostenbeheersing

- Log request-/response-metadata (niet de ruwe gevoelige inhoud tenzij toegestaan) — tokenaantallen,

effort-niveau, latency, model-ID en provider. Deze metrics zijn essentieel voor kostenallocatie en debugging. - Gebruik effort om kosten per call te sturen: kies

lowvoor routinematige samenvatting of high-QPS-endpoints; gebruikhighvoor diepgaand debuggen of onderzoeken. Monitor kwaliteit vs. tokenconsumptie om defaults te kiezen voor verschillende endpoints.

Conclusie — Wanneer (en hoe) kies je voor Opus 4.5?

Claude Opus 4.5 is een logische keuze wanneer je product behoefte heeft aan:

- diepe meerstapsredenering (lange logische ketens, onderzoek of debugging),

- robuuste orkestratie van agents/tools (complexe workflows die externe API’s aanroepen), of

- productieklare code-assistentie over grote codebases.

Operationeel gebruik je effort om per call het budget af te stemmen; vertrouw op het tool-use-patroon om de uitvoeringsveiligheid te behouden en kies een cloudpartner (of direct de Anthropic API) op basis van je compliancebehoeften. Benchmark met je eigen corpus: leverancierscijfers (SWE-bench enz.) zijn nuttige signalen, maar jouw echte taak en data bepalen de ROI. Volg voor veiligheid de Opus 4.5 system card en plaats guardrails rond toolexecutie en PII-verwerking.

Ontwikkelaars hebben toegang tot de Claude Opus 4.5 API via CometAPI. Om te beginnen, verken de modelcapaciteiten van CometAPI in de Playground en raadpleeg de API-gids voor gedetailleerde instructies. Zorg ervoor dat je bent ingelogd bij CometAPI en de API-sleutel hebt verkregen voordat je toegang probeert te krijgen. CometAPI biedt een prijs die aanzienlijk lager ligt dan de officiële prijs om je te helpen bij de integratie.

Klaar om te beginnen?→ Meld je vandaag nog aan voor CometAPI!

Wil je meer tips, gidsen en nieuws over AI? Volg ons op VK, X en Discord!