Luma AI’s Uni-1 is meer dan een nieuw tekst-naar-afbeelding-model. In Luma’s eigen bewoording is het een “multimodaal redeneermodel dat pixels kan genereren”, gebouwd op “Unified Intelligence” zodat het intentie kan begrijpen, op aanwijzingen kan reageren en “met je mee kan denken”. Het technische rapport van het bedrijf zegt dat het model een decoder-only autoregressieve transformer gebruikt waarin tekst en afbeeldingen worden weergegeven in één enkele geïnterleaveerde sequentie, en dat Uni-1 gestructureerd intern kan redeneren vóór en tijdens beeldsynthese. Die combinatie maakt Uni-1 tot een van de interessantste releases van afbeeldingsmodellen van 2026.

Wat is het UNI-1-afbeeldingsmodel?

Uni-1 is het nieuwe afbeeldingsmodel van Luma AI voor taken die zowel begrip als generatie in één systeem vereisen. Luma presenteert het als een multimodaal redeneermodel in plaats van een klassiek, uitsluitend op diffusie gebaseerd afbeeldingsmodel, wat belangrijk is omdat het model bedoeld is om meer te doen dan visueel aantrekkelijke output produceren: het is ontworpen om instructies te interpreteren, referentiebeperkingen te behouden en de logica van een scène mee te redeneren als onderdeel van de generatie. Het technische rapport van het bedrijf beschrijft Uni-1 als zijn eerste uniforme begrip-en-generatie-model op weg naar multimodale algemene intelligentie.

Waarom Uni-1 anders is

De oude pijplijn heeft een grens: beeldgeneratie zonder begrip komt maar tot op zekere hoogte. Uni-1 wordt gepresenteerd als een stap richting “unified intelligence”, waarbij taal, perceptie, verbeelding, planning en uitvoering binnen één architectuur worden afgehandeld. Dit is meer dan branding. Uni-1 kan verschuiven van visuele gelijkenis naar intentionele compositie, plausibiliteit en scènelogica.

Het grotere verhaal is dat afbeeldingsmodellen steeds agentischer worden. Google’s nieuwste afbeeldingsstack legt nu de nadruk op conversatiebewerking, zoekgebaseerde grounding, fusie van meerdere afbeeldingen en karakterconsistentie; OpenAI’s GPT Image-familie legt de nadruk op native multimodaliteit en het volgen van instructies. Uni-1 sluit zich bij die verschuiving aan, maar leunt sterker op het idee dat het model over de afbeelding moet “nadenken” voordat het deze tekent. Dat maakt Uni-1 bijzonder interessant voor workflows waarin precisie en reproduceerbaarheid net zo belangrijk zijn als visuele flair.

Hoe werkt Uni-1 eigenlijk?

🔬 Tokenisatieproces

- Tekst → tokenreeks

- Afbeelding → getokeniseerde patches

- Gecombineerd tot één enkele geïnterleaveerde sequentie

🔁 Generatieproces

- Invoerprompt + referenties

- Model voert intern redeneren uit

- Plant de compositie

- Genereert tokens sequentieel

Mathematically: P(x1,...,xn)=∏P(xi∣x1,...,xi−1)P(x_1,...,x_n) = \prod P(x_i | x_1,...,x_{i-1})P(x1,...,xn)=∏P(xi∣x1,...,xi−1)

🧠 Interne redeneerlaag

Uni-1:

- Splitst instructies op

- Lost beperkingen op

- Plant de lay-out vóór het renderen

👉 Dit is een grote sprong ten opzichte van diffusiemodellen.

Decoder-only autoregressieve generatie

Het belangrijkste technische detail is dat Uni-1 autoregressief is in plaats van diffusiegebaseerd. Luma’s technische rapport zegt dat het een decoder-only autoregressieve transformer is, en dat tekst en afbeeldingen in één enkele geïnterleaveerde sequentie worden gecodeerd. In gewoon Nederlands betekent dit dat het model niet simpelweg vanuit ruis begint en geleidelijk naar een afbeelding “denoiset”. In plaats daarvan genereert het tokens stap voor stap, waardoor het model over de prompt kan redeneren, beperkingen kan oplossen en de compositie kan plannen vóór en tijdens het renderen.

🔬 Tokenisatieproces

- Tekst → tokenreeks

- Afbeelding → getokeniseerde patches

- Gecombineerd tot één enkele geïnterleaveerde sequentie

Diffusie versus autoregressief

| Kenmerk | Diffusiemodellen | Uni-1 (autoregressief) |

|---|---|---|

| Generatie | Ruis → afbeelding | Token voor token |

| Redeneren | Beperkt | Sterk |

| Bewerken | Zwak | Multi-turn |

| Tekstrendering | Slecht | Sterk |

| Controle | Laag | Hoog |

Kernarchitectuur

Uni-1 is:

- Decoder-only autoregressieve transformer

- Gedeelde tokenruimte voor tekst + afbeeldingen

Die architectuur is belangrijk omdat ze het model de kans geeft om coherentie te behouden wanneer de prompt ingewikkeld is. Luma zegt dat Uni-1 instructies kan opsplitsen, conflicterende beperkingen kan oplossen en de afbeelding kan plannen voordat het renderen begint. Dat is vooral nuttig voor taken zoals gestructureerde scèneaanvulling, plaatsing van meerdere onderwerpen, multi-turn verfijning en bewerkingen waarbij de output trouw moet blijven aan een referentieafbeelding en toch nieuwe instructies moet volgen.

Wat het model beter lijkt te kunnen

Leren om afbeeldingen te genereren verbetert het begrip. Luma zegt dat de training voor beeldgeneratie het fijnmazige visuele begrip materieel verbetert, vooral voor regio’s, objecten en lay-outs. Daarom is Uni-1 geen eenrichtingsgenerator, maar een uniform systeem waarvan generatie en begrip elkaar versterken. Op inferentieniveau betekent dit dat Uni-1 probeert de kloof tussen “zien” en “maken” te dichten. Dit is een grote sprong ten opzichte van diffusiemodellen.

Generatieproces:

- Invoerprompt + referenties

- Model voert intern redeneren uit

- Plant de compositie

- Genereert tokens sequentieel

Mathematically: P(x1,...,xn)=∏P(xi∣x1,...,xi−1)P(x_1,...,x_n) = \prod P(x_i | x_1,...,x_{i-1})P(x1,...,xn)=∏P(xi∣x1,...,xi−1)

Welke functies en kernvoordelen biedt Uni-1?

Sterke instructievolging en stuurbaarheid

Uni-1’s sterkste verkoopargument is controle. het model is gebouwd voor nauwkeurige bewerking, gestructureerd gebruik van referenties en reproduceerbare workflows. Voor creators betekent dat minder prompt-gokken en meer reproduceerbare output.

Een van Uni-1’s praktische voordelen is dat het gebouwd is voor gecontroleerde iteratie. Seeds laten gebruikers resultaten reproduceren, terwijl referentierollen het model helpen te weten of een afbeelding karakteridentiteit, sfeer, palet of compositie moet sturen. Dat maakt Uni-1 gemakkelijker aan te sturen dan een puur promptgedreven model, vooral voor teams die advertenties, storyboards, productmock-ups of merkmiddelen produceren waarbij consistentie belangrijk is.

Referentiegebaseerde generatie die identiteit behoudt

Een groot voordeel is de omgang met referenties. Luma zegt expliciet dat Uni-1 source-grounded controls gebruikt en identiteit, compositie en belangrijke visuele beperkingen uit één of meer referenties kan behouden. Dat maakt het aantrekkelijk voor commerciële workflows zoals merkpersonages, productmock-ups, campagnemateriaal en elk project waarbij een onderwerp herkenbaar moet blijven over varianten heen. Dit is een van de duidelijkste manieren waarop Uni-1 verschilt van meer puur esthetische afbeeldingssystemen.

Culturele vloeiendheid en stijlbreedte

Luma benadrukt ook cultuurgevoelige generatie. De sectie “Cultured” verwijst naar memes, manga, filmische looks, casual foto’s, sport en dierenbeelden, waarmee wordt getoond dat het model bedoeld is om over visuele talen heen te werken in plaats van in één generieke stijl. Dat is belangrijk, omdat een goed modern afbeeldingsmodel niet alleen een realistische scène moet kunnen renderen; het moet ook de visuele conventies van internetcultuur, redactioneel ontwerp, gestileerde illustratie en social content begrijpen.

Multimodaal denken als ontwerpkeuze

De echte onderscheidende factor is niet alleen dat Uni-1 afbeeldingen genereert, maar dat Luma beeldgeneratie neerzet als een redeneertaak. Uni-1 kan gestructureerd intern redeneren en het leren genereren van afbeeldingen verbetert het fijnmazige visuele begrip van regio’s, objecten en lay-outs. Dat wijst op een model dat de scène probeert te begrijpen voordat het deze rendert, in plaats van de prompt simpelweg statistisch te benaderen.

Prestatiebenchmarks

Luma’s eigen resultaten voor menselijke voorkeur

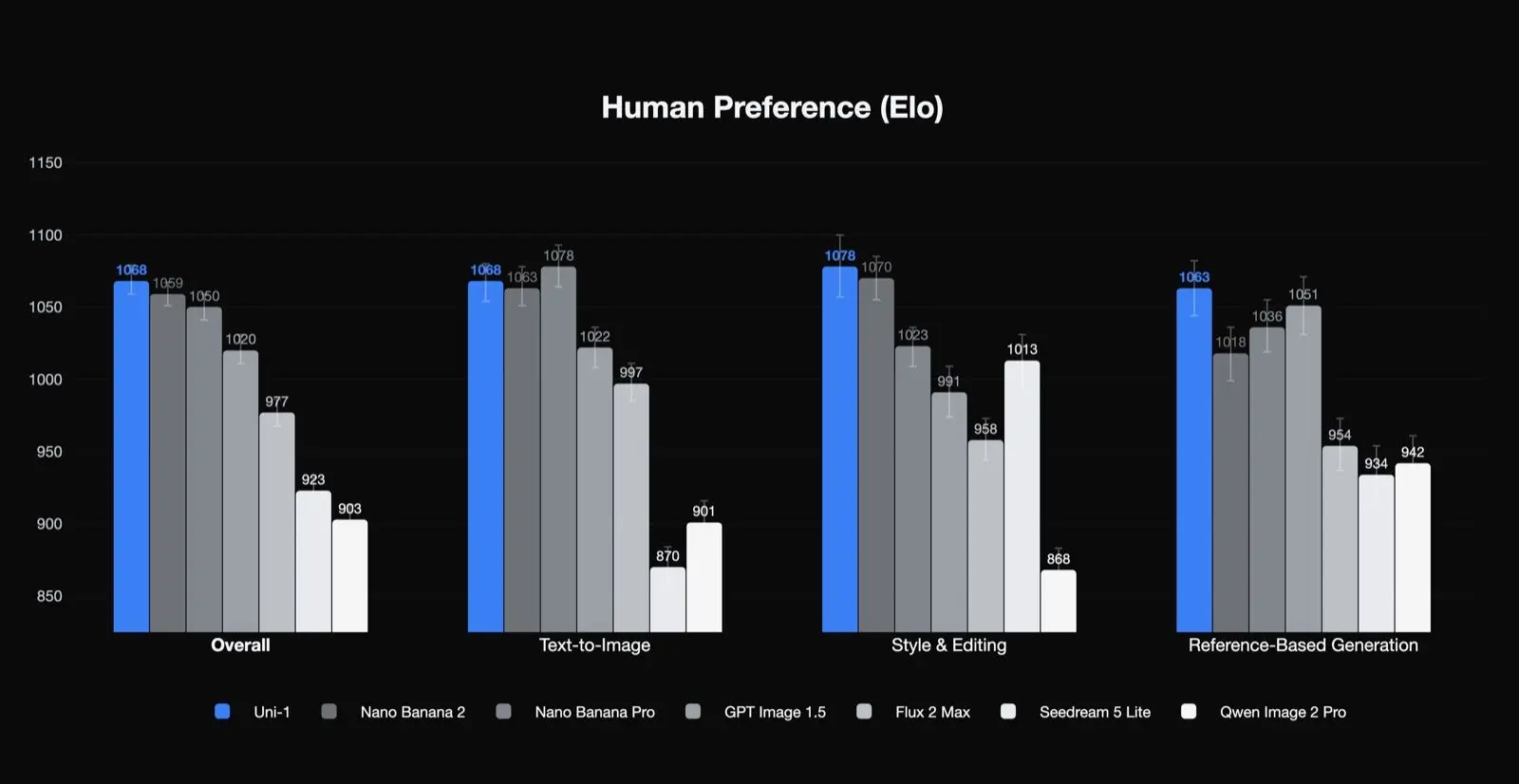

Uni-1 staat op de eerste plaats in human-preference Elo voor algemene kwaliteit, stijl en bewerking, en referentiegebaseerde generatie, en op de tweede plaats in tekst-naar-afbeelding. Dat is een betekenisvol resultaat omdat het suggereert dat het model vooral sterk is in het soort taken waar productieteams om geven: bewerking, consistentie en begeleide transformatie. Het suggereert ook dat de beste use-cases misschien niet alleen eenvoudige one-shot tekst-naar-afbeelding-generatie zijn.

RISEBench: door redenering geïnformeerde visuele bewerking

De benchmark die de meeste aandacht trekt is RISEBench, die door redenering geïnformeerde visuele bewerking evalueert op temporeel, causaal, ruimtelijk en logisch redeneren. Rapportage van derden over de lancering van Luma zegt dat Uni-1 in totaal 0.51 scoort op RISEBench, vóór Google’s Nano Banana 2 met 0.50, Nano Banana Pro met 0.49 en OpenAI’s GPT Image 1.5 met 0.46. Op ruimtelijk redeneren wordt Uni-1 gerapporteerd op 0.58 versus Nano Banana 2 op 0.47. Op logisch redeneren wordt Uni-1 gerapporteerd op 0.32, meer dan het dubbele van GPT Image 1.5’s 0.15. De marges zijn in totaal niet enorm, maar ze zijn groot in de moeilijkste redeneercategorieën.

ODinW-13 en de bewering “generatie verbetert begrip”

Uni-1 presteert ook sterk op ODinW-13, een open-vocabulary benchmark voor dense detection. Rapportage over Luma’s technische data zegt dat het volledige model 46.2 mAP scoort, bijna gelijk aan Google’s Gemini 3 Pro met 46.3. Diezelfde rapportage zegt dat een variant die alleen op begrip is gericht 43.9 mAP scoort, wat impliceert dat generatietraining het begrip met 2.3 punten verbetert. Dat is een opvallende bevinding omdat het Luma’s kernthese ondersteunt: beeldgeneratie en beeldbegrip kunnen elkaar wederzijds versterken in plaats van concurrerende doelstellingen te zijn.

Prijs van de Uni-1 API

| Input price (text) | $0.50 |

|---|---|

| Input price (images) | $1.20 |

| Output price (text and thinking) | $3.00 |

| Output price (images) | $45.45 |

Aan de consumentenkant vermeldt Luma's prijspagina Plus voor $30/maand, Pro voor $90/maand en Ultra voor $300/maand, met gratis proefcredits inbegrepen bij alle plannen. Dit betekent dat er in wezen twee prijslagen zijn om rekening mee te houden: het consumentenlidmaatschap voor het platform en de API-prijzen op modelniveau voor productiegebruik.

Voor nu is CometAPI's Uni-1 API binnenkort beschikbaar, met een beloofde korting bij de lancering. Momenteel biedt CometAPI ook uitstekende raw image-modellen aan, zoals Midjourney en Nano Banana 2.

Uni-1 versus GPT Image 1.5 versus Nano Banana 2

Uni-1 versus Google’s Nano Banana 2

Nano Banana 2 lijkt sterker in de breedte van referentieverwerking en ecosysteemintegratie. Google benadrukt grounding via beeldzoekopdrachten, conversationele iteratie en workflows met veel referenties met tot wel 14 referenties. Uni-1 daarentegen wordt explicieter gepositioneerd rond redeneren, scèneplausibiliteit en nauwkeurige bewerking binnen een uniforme modelarchitectuur. In praktische termen lijkt Google geoptimaliseerd voor snelheid, productie op grote schaal en native Google-grounding; Luma lijkt geoptimaliseerd voor gestructureerd visueel redeneren en direct aanstuurbare beeldbewerking.

In de openbare vergelijkingen rond Uni-1 is de afweging duidelijk: Nano Banana 2 lijkt zeer sterk te blijven voor pure tekst-naar-afbeelding-kwaliteit en snelheid, terwijl Uni-1 sterker inzet op bewerking met veel redenering, referentiecontrole en instructietrouw.

Uni-1 versus OpenAI’s GPT Image

In benchmarkrapportage scoort Uni-1 iets beter dan GPT Image 1.5 op RISEBench in totaal en duidelijker op logisch redeneren. Vergeleken met OpenAI’s GPT Image-familie is Uni-1 nauwer en agressiever gepositioneerd rond visueel redeneren en gecontroleerde bewerking. OpenAI’s documentatie benadrukt wereldkennis, multimodaal begrip en contextbewustzijn; Luma’s documentatie benadrukt gestructureerd intern redeneren, referentiegegronde controle en gebenchmarkte vaardigheid in visuele bewerking. Dus hoewel beide multimodaal zijn, is Uni-1 duidelijker het “afbeeldingsspecialistische redeneermodel”, terwijl GPT Image meer leest als een algemeen multimodaal systeem dat toevallig ook extreem goed afbeeldingen genereert.

Prijsvergelijking tussen de drie

Qua prijs hangt de vergelijking af van outputgrootte en productlaag, dus het is niet helemaal appels met appels vergelijken. Uni-1’s gepubliceerde 2048px-equivalent komt neer op ongeveer $0.0909 per afbeelding. Google’s nieuwste prijspagina voor afbeeldingsmodellen vermeldt $0.134 per 1K/2K-afbeelding en $0.24 per 4K-afbeelding voor zijn nieuwste Gemini image preview, terwijl OpenAI’s prijspagina voor GPT Image per-afbeelding-outputprijzen vermeldt van $0.011 bij lage kwaliteit voor 1024x1024, $0.042 bij gemiddelde kwaliteit en $0.167 bij hoge kwaliteit, met grotere outputs van hoge kwaliteit op $0.25. Met andere woorden: OpenAI kan aan de onderkant veel goedkoper zijn, Google is agressief aan de kant van snelheid en schaal, en Uni-1 zit in het midden met een sterk op 2K gericht prijs-prestatieprofiel.

Filosofische verschillen

| Model | Benadering |

|---|---|

| Uni-1 | Uniforme multimodale intelligentie |

| GPT Image | LLM + beeldgeneratie |

| Nano Banana 2 | Geoptimaliseerde productiediffusie |

Gedetailleerde vergelijkingstabel

| Kenmerk | Uni-1 | GPT Image 1.5 | Nano Banana 2 |

|---|---|---|---|

| Architectuur | Autoregressief | Hybride | Diffusie |

| Multimodale unificatie | ✅ Native | Gedeeltelijk | ❌ |

| Redeneervermogen | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ |

| Beeldkwaliteit | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Tekstrendering | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐ |

| Bewerkingsworkflows | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐⭐ |

| Snelheid | Gemiddeld | Snel | Snel |

| Controle | Hoog | Gemiddeld | Gemiddeld |

CometAPI biedt interactieve raw images voor GPT Image 1.5, Nano Banana 2 en de aankomende Uni-1, evenals API-programmering. Kortingsprijzen en pay-as-you-go-opties maken het tot een voorkeurskeuze voor ontwikkelaars.

Waar Uni-1 het best voor is

Uni-1 lijkt bijzonder sterk voor gevallen waarin je reproduceerbaarheid, karakterconsistentie of controle over meerdere referenties nodig hebt. Dat omvat merkcampagnes, productmock-ups, redactionele concepten, storyboards, lokalisatievarianten en beeldbewerkingen waarbij de compositie intact moet blijven maar stijl of omgeving moet veranderen. Luma’s eigen voorbeelden leunen sterk op deze use-cases, en de splitsing van het model tussen “Create vs Modify” is in feite een direct antwoord op veelvoorkomende productieproblemen.

Als je werk vooral bestaat uit “maak iets moois op basis van één enkele prompt”, dan voelt de onderscheidende factor misschien minder dramatisch. Maar als je workflow is: “maak vijf verwante versies, behoud hetzelfde personage, behoud de kadrering, verander de belichting en maak het volgende week reproduceerbaar”, dan begint het ontwerp van Uni-1 veel logischer te worden. Dat is een inferentie, maar het volgt vanzelf uit de controlefuncties die Luma benadrukt.

Best practices om betere resultaten te krijgen met Uni-1

Begin met het gebruik van de juiste modus. Luma’s richtlijn is eenvoudig: Create wanneer je een nieuwe scène wilt, Modify wanneer je een bestaande scène wilt behouden. Het mengen van die intenties maakt output instabieler.

Gebruik referentielabels als een professional. Luma raadt formuleringen aan zoals “Use IMAGE1 as a STYLE reference” of “Use IMAGE2 as LIGHTING.” Het model presteert beter wanneer elke referentie een taak heeft, in plaats van vage “inspiratie”.

Vergrendel de seed zodra je iets goeds hebt gevonden. Luma raadt expliciet aan eerst zonder seed te verkennen en de seed pas op te slaan zodra je een sterk resultaat hebt. Verander daarna telkens één variabele. Dat is de eenvoudigste manier om generatie om te zetten in een gecontroleerd productiesysteem.

Wees specifiek en concreet. Luma waarschuwt tegen vage woorden zoals “beautiful” of “amazing” en moedigt in plaats daarvan benoemde esthetieken aan zoals “1970s Italian giallo film poster” of exacte camera-achtige aanwijzingen. In de praktijk verslaan specifieke prompts meestal poëtische prompts omdat het model zich kan verankeren op echte structuur.

Gebruik de keten Create → Modify. Luma noemt dit expliciet een van zijn krachtigste workflows: verkennen in Create en daarna verfijnen in Modify. Dat is het ideale punt voor serieus productiewerk, omdat het terugwerk vermindert en de goede delen van een compositie behoudt terwijl de details worden aangescherpt.

Eindoordeel

Uni-1 is Luma’s duidelijkste verklaring tot nu toe dat beeldgeneratie verschuift van “prompt in, afbeelding uit” naar door redenering geleide visuele creatie. De publieke sterke punten zijn controle, referentieverwerking, reproduceerbaarheid en een modelarchitectuur die taal en pixels in hetzelfde systeem houdt.

Voor creators en teams die geven om visuele output met hoge klikratio, consistente personages, nauwkeurige bewerkingen en duidelijke prijzen voor hoge resolutie, is Uni-1 absoluut een model om in de gaten te houden. Als de API-uitrol soepel verloopt, zou het een van de interessantste alternatieven kunnen worden voor Google’s Nano Banana 2 en OpenAI’s GPT Image 1.5 in 2026.

Van plan om raw images te gaan maken? CometAPI, een one-stop aggregatieplatform voor multimodale model-API’s, heet je welkom!