Características clave

- Renderizado de texto nativo/de alta calidad dentro de las imágenes — sobresale en producir texto legible y semánticamente preciso en imágenes generadas (carteles, empaques, capturas de pantalla), un área en la que muchos modelos de imagen anteriores tenían dificultades.

- Salida multimodal de alta fidelidad — produce imágenes fotorrealistas y estilizadas con buen nivel de detalle y maquetación sensible al idioma.

- Transferencia de estilo y mejora de detalles — puede aplicar estilos artísticos consistentes o realzar detalles locales preservando la coherencia de la escena.

Detalles técnicos — cómo funciona Qwen-Image

Arquitectura y componentes (palabras clave: MMDiT, Qwen2.5-VL). El modelo utiliza un transformer de difusión basado en MMDiT para la síntesis de imágenes, combinado con un codificador viso-lingüístico (Qwen2.5-VL) para interpretar los prompts y el contexto visual. Esta separación permite al modelo tratar de forma distinta la guía semántica y la apariencia de píxeles, mejorando la fidelidad del texto y la consistencia de las ediciones. El repositorio oficial y el informe técnico señalan un backbone de 20B parámetros para el modelo T2I principal.

Pipeline de entrenamiento (palabras clave: aprendizaje por currículo, data pipeline). Para resolver el renderizado de texto complejo, Qwen-Image utiliza un currículo progresivo: comienza con imágenes más simples sin texto y gradualmente entrena con ejemplos más complejos y ricos en texto hasta entradas a nivel de párrafo. El equipo construyó una canalización integral que incluye recolección a gran escala, filtrado cuidadoso, aumentación sintética y balanceo para asegurar que el modelo vea muchas composiciones realistas de texto/foto durante el entrenamiento. Este currículo estratégico es una razón clave por la que el modelo destaca en el renderizado de texto multilingüe.

Mecanismo de edición (palabras clave: codificación dual, VAE + codificador VL). Para editar, el sistema alimenta la imagen original dos veces: una al codificador Qwen2.5-VL para control semántico y otra a un codificador VAE para información reconstructiva de apariencia. El diseño de codificación dual permite que el módulo de edición preserve la identidad y la fidelidad visual, al tiempo que permite modificaciones semánticas — por ejemplo, reemplazar un objeto o cambiar contenido textual sin degradar regiones no relacionadas.

Rendimiento en benchmarks

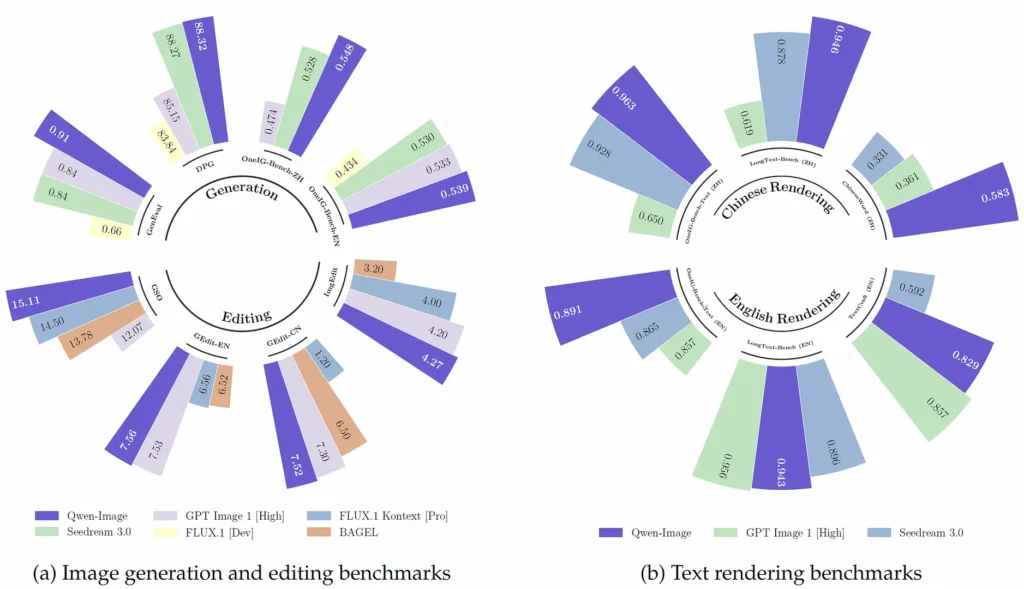

Qwen-Image alcanza un rendimiento SOTA o cercano a SOTA en múltiples benchmarks públicos tanto para generación como para edición, con resultados particularmente sólidos en tareas de renderizado de texto y benchmarks de composición del mundo real (p. ej., T2I-CoreBench y suites curadas de edición de imágenes).

Cómo se compara Qwen-Image con otros modelos líderes

Fortalezas relativas: el renderizado de texto y la fidelidad del texto bilingüe son ventajas distintivas del modelo frente a muchos competidores generativos (p. ej., DALL·E 3, SDXL, Midjourney), que con frecuencia son más fuertes en composición puramente artística o diversidad estilística, pero más débiles en diseños de texto densos y multilínea o en chino. Múltiples comparativas de la comunidad y las tablas de benchmarks de los autores del modelo respaldan esta caracterización.

Compensaciones relativas: comparado con sistemas comerciales cerrados y muy ajustados, Qwen-Image puede requerir posprocesamiento o ajuste de prompts/adaptadores para alcanzar un realismo idéntico en algunos contextos (deformación en superficies curvas, composición fotorrealista), según pruebas independientes. Para usuarios que priorizan diseños con plantillas, maquetas de empaque o diseños de texto bilingües, Qwen-Image suele ser preferible.

Casos de uso típicos y de alto valor

- Maquetas de empaque y producto: texto preciso y diseños multilínea para etiquetas y pruebas de empaque.

- Publicidad y bocetos de diseño: prototipado rápido donde la fidelidad del texto importa (carteles, banners).

- Generación de imágenes documentadas: generar imágenes que deben incluir contenido legible (menús, señales, interfaces).

- Flujos de edición de imágenes: ediciones dirigidas (reemplazo de texto, agregar/eliminar objetos) preservando estilo y perspectiva.

- Cómo acceder a Qwen image API

Paso 1: Registrarse para obtener la clave de API

Inicia sesión en cometapi.com. Si aún no eres usuario, regístrate primero. Accede a tu Consola de CometAPI. Obtén la clave de API de credenciales de acceso de la interfaz. Haz clic en “Add Token” en el token de API del centro personal, obtén la clave del token: sk-xxxxx y envíala.

Paso 2: Enviar solicitudes a Qwen image API

Selecciona el “qwen-image ”endpoint para enviar la solicitud de API y configurar el cuerpo de la solicitud. El método y el cuerpo de la solicitud se obtienen de la documentación de la API en nuestro sitio web. Nuestro sitio también proporciona pruebas con Apifox para tu comodidad. Reemplaza <YOUR_API_KEY> con tu clave real de CometAPI de tu cuenta. La URL base es Imágenes formato(https://api.cometapi.com/v1/images/generations) a través de CometAPI.

Inserta tu pregunta o solicitud en el campo content—esto es a lo que el modelo responderá .

Paso 3: Recuperar y verificar resultados

Procesa la respuesta de la API para obtener la respuesta generada. Tras el procesamiento, la API responde con el estado de la tarea y los datos de salida.