De Qwen2.5-Omni-7B API biedt ontwikkelaars OpenAI-compatibele methoden om met het model te communiceren, waardoor tekst-, beeld-, audio- en video-invoer kan worden verwerkt en zowel tekst- als natuurlijke spraakreacties in realtime kunnen worden gegenereerd.

Wat is Qwen2.5-Omni-7B?

Qwen2.5-Omni-7B is Alibaba's vlaggenschip multimodale AI-model, met 7 miljard parameters. Ontworpen om meerdere datamodaliteiten te verwerken en begrijpen, ondersteunt het tekst-, beeld-, audio- en video-inputs. Het model faciliteert realtime spraak- en video-interacties, waardoor het een veelzijdige tool is voor verschillende toepassingen.

Belangrijkste kenmerken van Qwen2.5-Omni-7B

- Multimodale verwerking: Kan uiteenlopende invoer verwerken, waaronder tekst, afbeeldingen, audio en video, waardoor een uitgebreid inzicht in de gegevens mogelijk is.

- Realtime interactie: Ondersteunt verwerking met lage latentie, waardoor realtime spraak- en videogesprekken mogelijk zijn.

- Denker-spreker architectuur: Maakt gebruik van een systeem met een dubbele architectuur, waarbij de 'Denker' de gegevensverwerking en het begrip beheert, terwijl de 'Praater' vloeiende spraakuitvoer genereert.

- Tijdsgebonden multimodale RoPE (TMRoPE): Maakt gebruik van TMRoPE voor nauwkeurige synchronisatie van temporele gegevens over verschillende modaliteiten, waardoor een coherent begrip en responsgeneratie wordt gegarandeerd.

Prestatiestatistieken

Benchmarkprestaties

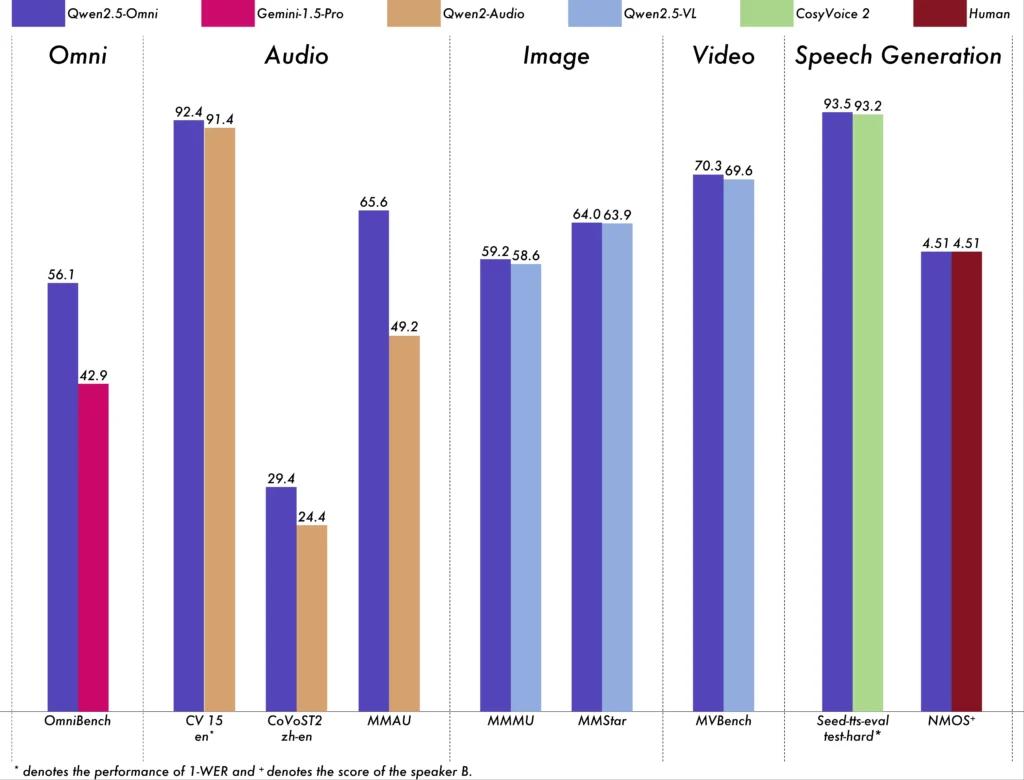

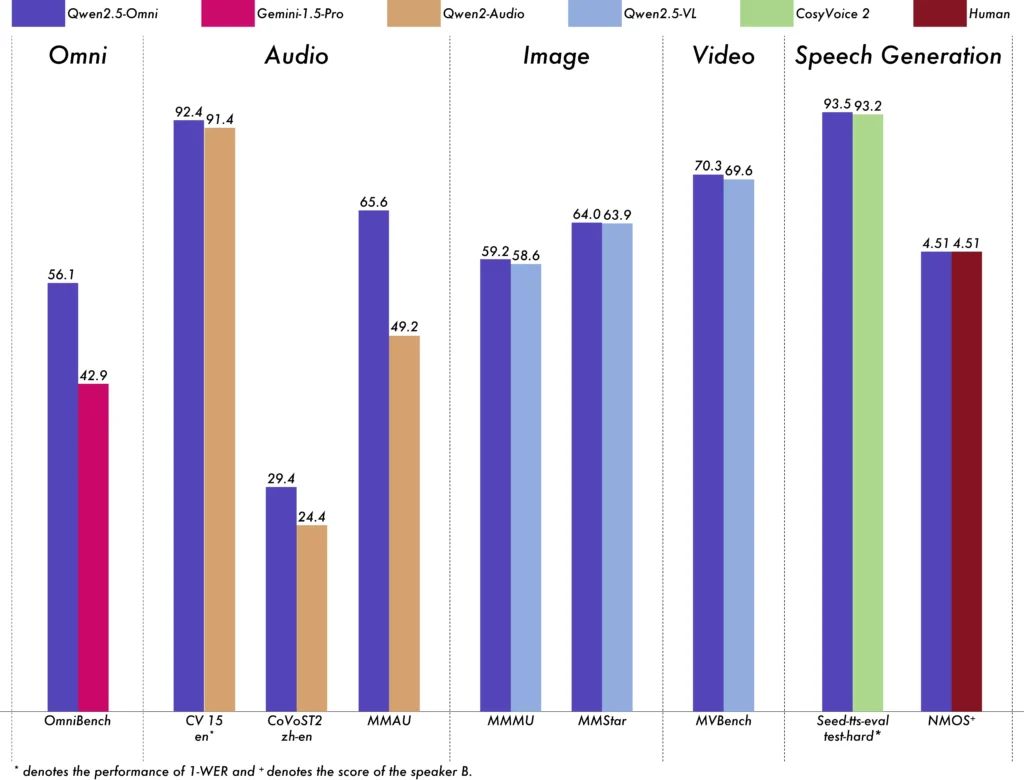

Qwen2.5-Omni-7B heeft uitzonderlijke prestaties geleverd in verschillende benchmarks:

- OmniBench: Behaalde een gemiddelde score van 56.13% en overtrof daarmee modellen als Gemini-1.5-Pro (42.91%) en MIO-Instruct (33.80%).

- Spraakherkenning: In de Librispeech-dataset werden woordfoutpercentages van 1.6% tot 3.5% bereikt, vergelijkbaar met gespecialiseerde modellen zoals Whisper-large-v3.

- Herkenning van geluidsgebeurtenissen: Een score van 0.570 behaald op de Meld-dataset, waarmee een nieuwe norm in het veld werd gezet.

- Muziekbegrip: Behaalde een score van 0.88 op de GiantSteps Tempo-benchmark, wat de bekwaamheid in muziekbegrip onderstreept.

Real-time verwerkingsmogelijkheden

Qwen2.5-Omni-7B is ontworpen voor realtime-toepassingen en ondersteunt blok-voor-blok streaming, waardoor directe audiogeneratie met minimale latentie mogelijk is. Deze functie is met name nuttig voor toepassingen die snelle reacties vereisen, zoals virtuele assistenten en interactieve AI-systemen.

Technische specificaties

Architectueel ontwerp

- Denker-spreker raamwerk: De 'Thinker'-component verwerkt en begrijpt multimodale inputs, genereert semantische representaties op hoog niveau en tekstuele outputs. De 'Talker' zet deze representaties om in natuurlijke, vloeiende spraak, wat zorgt voor naadloze communicatie tussen het AI-systeem en gebruikers.

- TMRoPE-mechanisme: Pakt de uitdaging aan om temporele gegevens uit verschillende bronnen te synchroniseren door tijdstempels van video- en audio-invoer op elkaar af te stemmen, waardoor een coherent multimodaal begrip mogelijk wordt.

Trainingsmethodologie

Het model onderging een trainingsproces in drie fasen:

- Fase een: Vaste taalmodelparameters tijdens het trainen van visuele en audio-encoders met behulp van uitgebreide audio-tekst- en afbeelding-tekstparen om multimodaal begrip te verbeteren.

- Fase twee: Alle parameters werden ontdooid en er werd getraind op een diverse dataset bestaande uit afbeeldingen, video, audio en tekst, waardoor het uitgebreide multimodale begrip verder werd verbeterd.

- Fase drie: Gericht op training van lange-reeksgegevens om de capaciteit van het model voor het verwerken van complexe, uitgebreide invoer te vergroten.

Evolutie van Qwen-modellen

Voortgang van Qwen naar Qwen2.5

De evolutie van Qwen naar Qwen2.5 betekent een substantiële sprong voorwaarts in de ontwikkeling van AI-modellen:

- Verbeterde parameters: Qwen2.5 is uitgebreid naar modellen met maximaal 72 miljard parameters en biedt schaalbare oplossingen voor uiteenlopende toepassingen.

- Uitgebreide contextverwerking: De mogelijkheid om maximaal 128,000 tokens te verwerken is nu mogelijk, waardoor de verwerking van omvangrijke documenten en complexe gesprekken eenvoudiger wordt.

- Codeermogelijkheden: De Qwen2.5-Coder-variant ondersteunt meer dan 92 programmeertalen en biedt ondersteuning bij codegeneratie, debuggen en optimalisatietaken.

Voordelen van Qwen2.5-Omni-7B

Uitgebreide multimodale integratie

Door de effectieve verwerking van tekst, afbeeldingen, audio en video biedt Qwen2.5-Omni-7B een holistische AI-oplossing die geschikt is voor een breed scala aan toepassingen.

Realtime interactie

De verwerking met lage latentie zorgt voor onmiddellijke reacties, wat de gebruikerservaring bij interactieve toepassingen verbetert.

Open source-toegankelijkheid

Als open-sourcemodel bevordert Qwen2.5-Omni-7B de transparantie en kunnen ontwikkelaars het model aanpassen en integreren in verschillende platforms zonder bedrijfseigen beperkingen.

Technische indicatoren

- Modelparameters: 7 miljard

- Invoermodaliteiten: Tekst, afbeelding, audio, video

- Uitvoermodaliteiten: Tekst, Spraak

- Verwerkingsvermogen: Realtime spraak- en video-interactie

- Prestatiebenchmarks:

- OmniBench: 56.13% gemiddelde score

- Librispeech (woordfoutpercentage): Test-schoon: 1.8%, Test-overig: 3.4%

Applicatiescenario's

Interactieve virtuele assistenten

Dankzij de realtimeverwerking en het multimodale begrip van Qwen2.5-Omni-7B is deze technologie ideaal voor virtuele assistenten die op natuurlijke wijze kunnen zien, horen en reageren.

Creatie van multimedia-inhoud

Contentmakers kunnen het model gebruiken om boeiende multimediacontent te genereren, waarbij tekst, afbeeldingen en audio naadloos worden gecombineerd.

Hulptechnologieën

De mogelijkheden van het model kunnen mensen met een beperking helpen, bijvoorbeeld door beschrijvende audio te leveren bij visuele content.

Gebruikstips

Prestaties optimaliseren

Om optimale prestaties te behalen, vooral in realtimetoepassingen, wordt aanbevolen hardwareversnellers te gebruiken en te zorgen voor voldoende GPU-geheugen.

Integratie met bestaande systemen

Ontwikkelaars moeten rekening houden met de invoer- en uitvoerformaten van het model bij de integratie met bestaande toepassingen om compatibiliteit te garanderen en de efficiëntie te maximaliseren.

Op de hoogte blijven

Controleer regelmatig de officiële repositories en documentatie op updates en best practices om de mogelijkheden van Qwen2.5-Omni-7B optimaal te benutten.

Gerelateerde onderwerpen Hoe het Qwen2.5-Omni-7B-model uit te voeren

Conclusie

Qwen2.5-Omni-7B is een voorbeeld van de convergentie van geavanceerd AI-onderzoek en praktische toepassing, en biedt een veelzijdige en efficiënte oplossing voor een veelheid aan taken in verschillende industrieën. De open-source aard ervan zorgt ervoor dat het toegankelijk en aanpasbaar blijft, en baant de weg voor toekomstige innovaties in multimodale AI.

Hoe Qwen2.5-Omni-7B API aan te roepen vanuit CometAPI

1.Login naar cometapi.com. Als u nog geen gebruiker van ons bent, registreer u dan eerst

2.Haal de API-sleutel voor toegangsreferenties op van de interface. Klik op "Token toevoegen" bij de API-token in het persoonlijke centrum, haal de tokensleutel op: sk-xxxxx en verstuur.

-

Haal de url van deze site op: https://api.cometapi.com/

-

Selecteer het Qwen2.5-Omni-7B-eindpunt om de API-aanvraag te verzenden en stel de aanvraagbody in. De aanvraagmethode en aanvraagbody worden verkregen van onze website API-doc. Onze website biedt ook een Apifox-test voor uw gemak.

-

Verwerk de API-respons om het gegenereerde antwoord te krijgen. Nadat u de API-aanvraag hebt verzonden, ontvangt u een JSON-object met de gegenereerde voltooiing.